人工智能

解纠缠是下一个深度伪造革命

CGI 数据增强正在被用于一个新项目中,以获得对深度伪造图像的更大控制权。虽然您仍然不能有效地使用 CGI 头来填充深度伪造面部数据集中的缺失间隙,但一个关于解纠缠身份与上下文的新研究浪潮意味着您可能不需要这样做。

深度伪造视频的创作者在过去的几年中选择他们的源视频非常小心,避免持续的侧面拍摄(即警察逮捕程序中流行的侧面特写),锐角和不寻常或夸张的表情。越来越多,病毒式深度伪造视频由编辑的合辑组成,这些合辑选择“最容易”的角度和表情来深度伪造。

事实上,原始人(其身份将被深度伪造所抹去)直接面对摄像机、表情最小的目标视频是插入深度伪造名人最方便的视频。

最近几年最流行的深度伪造视频中,主体直接面对摄像机, либо只表现出流行的表情(如微笑),这些可以从红毯拍照输出中轻松提取,或者(如 2019 年对西尔维斯特·史泰龙作为终结者的伪造),理想情况下没有任何表情,因为中性表情非常常见,很容易融入深度伪造模型中。

由于 DeepFaceLab 和 FaceSwap 等深度伪造技术执行这些更简单的交换非常好,我们被它们的成就所震撼,以至于没有注意到它们无法做什么,而且通常甚至不尝试:

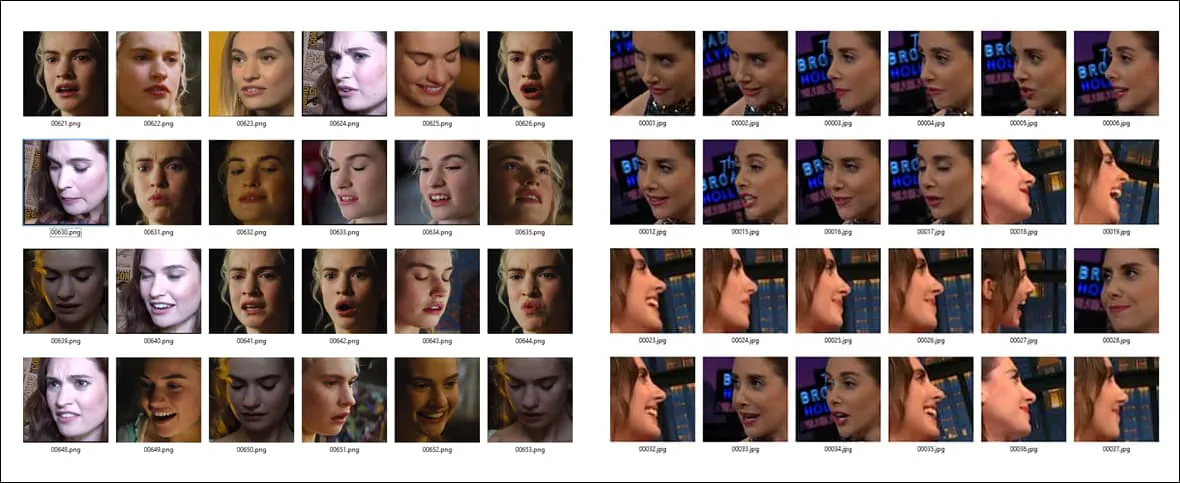

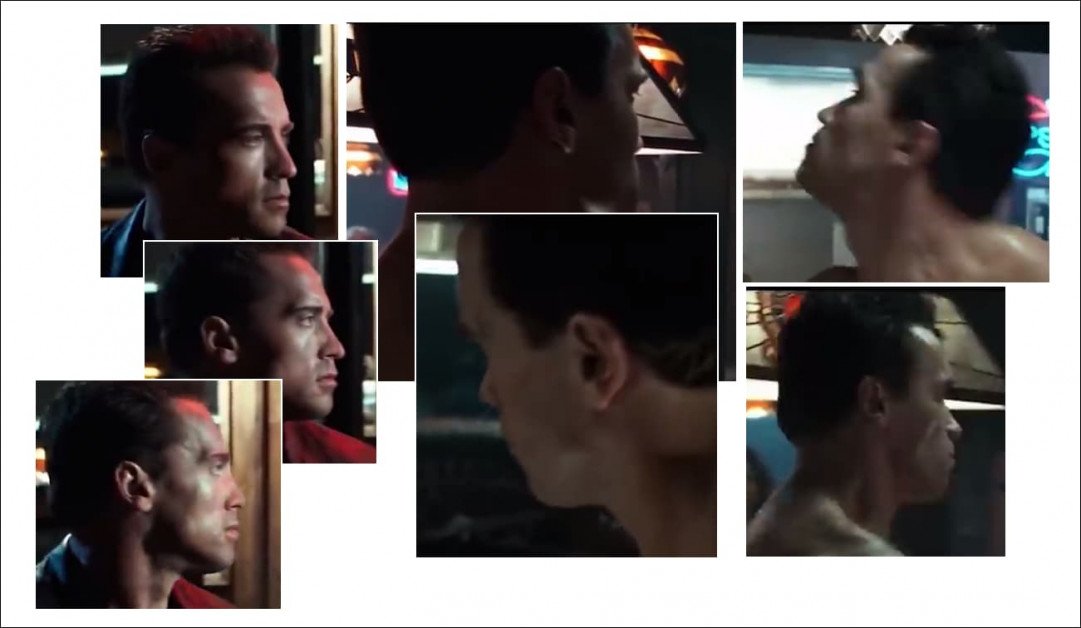

来自一段著名的深度伪造视频的截图,其中阿诺德·施瓦辛格被变成西尔维斯特·史泰龙——除非角度太棘手。侧面仍然是当前深度伪造方法的持久问题,部分原因是用于定义深度伪造框架中面部姿势的开源软件不适用于侧视图,但主要是因为两个必要数据集中都缺乏合适的源材料。来源:https://www.youtube.com/watch?v=AQvCmQFScMA

以色列的新研究提出了一种使用合成数据(如 CGI 头部)的新方法,以真正将身份(即“汤姆·克鲁斯”的基本面部特征)与其上下文(即“向上看”,“向侧看”,“皱眉”,“在黑暗中皱眉”,“眉头紧皱”,“闭眼”等)分离。

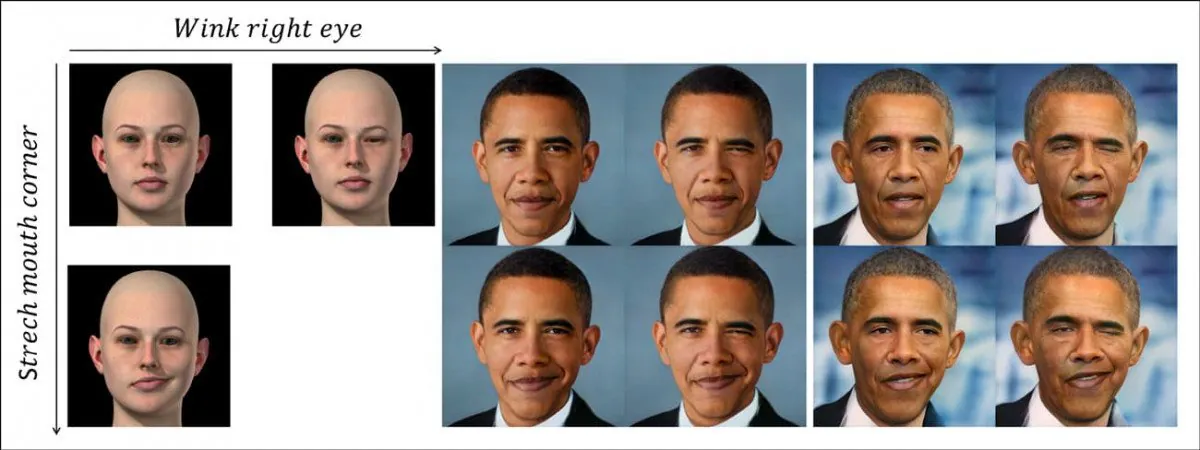

新的系统使用无关的合成面部数据(如左图所示)来分离姿势和上下文(即眨眼)与个人的身份编码。在顶行中,我们看到“眨眼”被转移到巴拉克·奥巴马的身份上,提示来自 GAN 的潜在空间的非线性路径,由左侧的 CGI 图像表示。在下一行中,我们看到拉伸的嘴角被转移到前总统身上。底部右侧,我们看到两个特征同时应用。来源:https://arxiv.org/pdf/2111.08419.pdf

这不仅仅是深度伪造头部木偶戏,一种更适合头像和部分面部唇部同步的技术,并且对于全面的深度伪造视频转换具有有限的潜力。

相反,这代表着一种前进的方式,用于从工具性(如“改变头部角度”、“创建皱眉”)中分离身份,提供了一条通往高级而不是“衍生”的图像合成基于的深度伪造框架的路径。

新论文的标题为《Delta-GAN-Encoder:使用少量合成样本对显式图像编辑进行语义更改的编码》,来自以色列理工学院的研究人员。

为了了解这项工作的意义,让我们来看看深度伪造视频目前如何在从深度伪造色情网站到工业光魔(由于 DeepFaceLab 开源存储库目前在业余和专业深度伪造中都占主导地位)等各个地方生产。

什么阻碍了当前的深度伪造技术?

当前的深度伪造技术是通过训练一个编码器/解码器机器学习模型在两个面部图像文件夹上创建的——您想要“覆盖”的人(在前面的例子中,就是阿诺德)和您想要覆盖到视频中的那个人(史泰龙)。

编码器/解码器系统然后比较每个文件夹中的每个图像与其他图像,维持、改进和重复此操作数十万次(通常需要一周),直到它足够了解两个身份的基本特征,以便在需要时交换它们。

对于交换过程中涉及的每个人来说,深度伪造架构中关于身份的学习是与上下文交织在一起的。它无法学习和应用关于通用姿势的一般原则,而需要在训练数据集中为每个将参与面部交换的身份提供大量示例:

由于面部 ID 和姿势特征目前交织在一起,需要在两个面部数据集中对表达、头部姿势和(在一定程度上)照明进行广泛的对齐,以便在 DeepFaceLab 等系统上训练有效的深度伪造模型。两个面部数据集中特定配置(如侧面/微笑/日照)出现的次数越少,深度伪造视频中渲染的准确性就越低。

如果集合 A 包含不寻常的姿势,但集合 B 缺乏它,那么您基本上没有运气;无论您训练模型多长时间,它都永远无法很好地在身份之间复制该姿势,因为它只在训练过程中拥有所需信息的一半。

即使您拥有匹配的图像,也可能不够:如果集合 A 具有匹配的姿势,但具有刺眼的侧面照明,与另一个面部数据集中的平面照明相比,交换的质量不会像每个共享共同照明特征时那样好。

为什么数据稀缺

除非您经常被逮捕,否则您可能没有很多侧面拍摄的自己照片。您可能会丢弃任何出现的照片。由于图片机构也这样做,侧面拍摄的面部照片很难找到。

深度伪造者通常会在面部数据集中包含多个副本中他们拥有的有限的侧面视图数据,只是为了让该姿势在训练期间获得一些关注和时间,而不是被丢弃为异常值。

但可能的侧面面部照片类型远远超过可能包含在数据集中的数量——微笑、皱眉、尖叫、哭泣、暗照、轻蔑、无聊、欢快、闪光照、向上看、向下看、睁眼、闭眼……等等。任何这些姿势的组合都可能在目标深度伪造视频中需要:

合成替换

自深度伪造技术出现以来,深度伪造者一直在尝试使用 CGI 风格的图像、在 3D 应用程序(如 Cinema4D 和 Maya)中创建的头部来生成这些“缺失的姿势”。

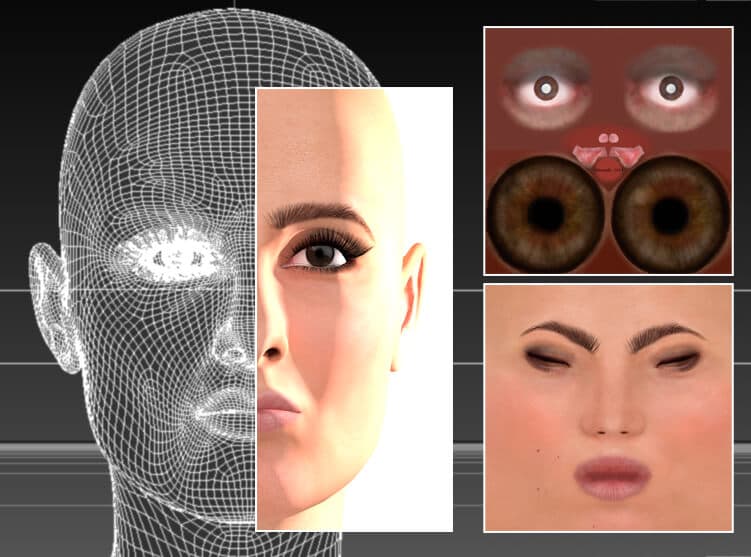

不需要 AI;一位女演员在传统的 CGI 程序 Cinema 4D 中使用网格和位图纹理重现——这项技术可以追溯到 1960 年代,尽管它只在 1990 年代开始被广泛使用。理论上,这个面部模型可以用于生成深度伪造源数据,用于不寻常的姿势、照明风格和面部表情。实际上,它在深度伪造中几乎没有用,因为渲染的“假”外观往往会渗透到交换的视频中。来源:本文作者的图像 https://rossdawson.com/futurist/implications-of-ai/comprehensive-guide-ai-artificial-intelligence-visual-effects-vfx/

这种方法通常被新深度伪造者很快放弃,因为虽然它可以提供其他方式无法获得的姿势和表情,但合成面部的外观通常会由于身份和上下文/语义信息的交织而渗透到交换的视频中。

这可能会导致在一个原本令人信服的深度伪造视频中突然闪现“不适感谷”面部,因为算法开始依赖于它可能拥有的唯一数据用于不寻常的姿势或表情——明显的假面部。

在最受欢迎的深度伪造主题中,DeepFaceLive 的默认安装中包含澳大利亚女演员玛格特·罗比的 3D 深度伪造算法,DeepFaceLive 是可以在实时流媒体(如网络摄像头会话)中执行深度伪造的 DeepFaceLab 版本。如上图所示,CGI 版本可以用于在深度伪造数据集中获得不寻常的“缺失”角度。来源:https://sketchfab.com/3d-models/margot-robbie-bust-for-full-color-3d-printing-98d15fe0403b4e64902332be9cfb0ace

CGI 面部作为分离的概念指南

相反,以色列研究人员的新 Delta-GAN 编码器(DGE)方法更有效,因为来自 CGI 图像的姿势和上下文信息已经与目标完全分离。

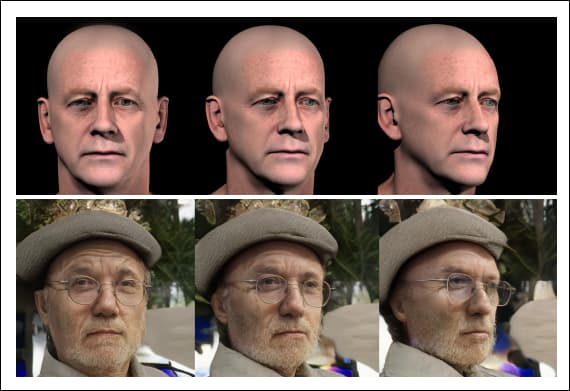

我们可以在下图中看到这一原理的作用,其中使用 CGI 图像作为指南获得了各种头部方向。由于身份特征与上下文特征无关,因此没有渗透到交换的视频中,既没有 CGI 面部的假外观,也没有其中所描绘的身份:

使用新方法,您不需要找到三个单独的真实生活照片来从多个角度执行深度伪造——您只需旋转 CGI 头部,其高级抽象特征被施加到身份上而不会泄漏任何 ID 信息。

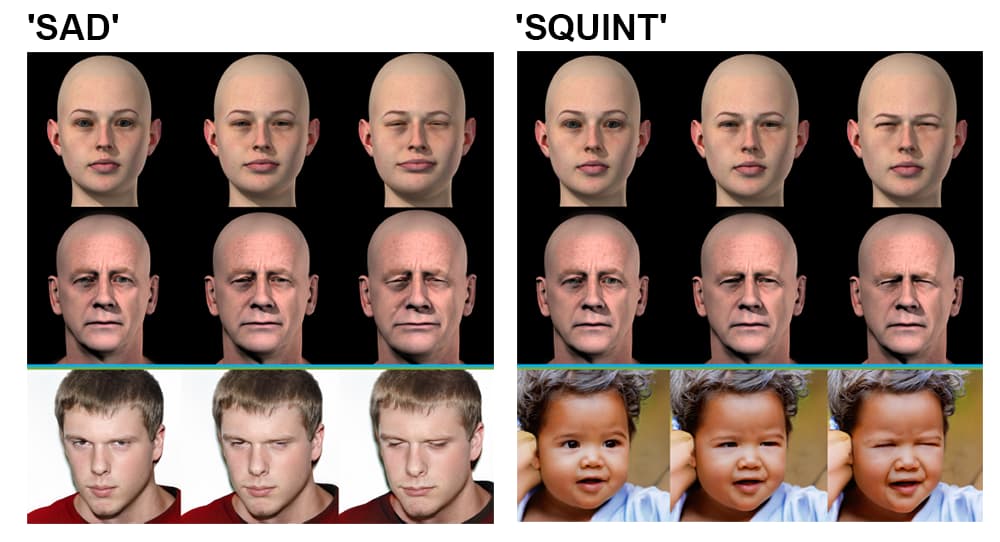

Delta-GAN-Encoder。顶部左侧组:源图像的角度可以在一秒内更改以渲染新的源图像,这在输出中得到了体现;顶部右侧组:照明也与身份分离,允许照明风格的叠加;底部左侧组:多个面部细节被修改以创建“悲伤”的表情;底部右侧组:单个面部表情细节被更改,使眼睛眯起来。

这种身份和上下文的分离是在训练阶段实现的。新的深度伪造架构的流水线寻求在预训练的生成对抗网络(GAN)中匹配要转换的图像的潜在向量——一种 Sim2Real 方法,建立在 2018 年 IBM AI 研究部门的一个项目上。

研究人员观察到:

‘仅需几个样本,即可学习预训练的交织生成模型的分离行为。没有必要使用真实世界样本来实现这一目标,这在某些情况下可能不可行。 ‘

‘使用非真实样本,可以通过利用编码的潜在向量的语义来实现相同的目标。可以在不需要显式探索潜在空间行为的情况下对现有数据样本应用所需的更改。 ‘

研究人员预计,该项目中探索的分离原理可以转移到其他领域,例如室内建筑模拟,而采用 Delta-GAN-Encoder 的 Sim2Real 方法最终可能会使基于草图而不是 CGI 风格输入的深度伪造工具成为可能。

可以认为,新以色列系统可能或可能无法合成深度伪造视频的程度远不如该研究在分离上下文和身份方面取得的进展重要,因为它在控制 GAN 的潜在空间方面获得了更多的控制权。

分离是图像合成中一个活跃的研究领域;2021 年 1 月,亚马逊领导的研究论文展示了类似的姿势控制和分离,并且 2018 年,中国科学院深圳先进技术研究所的一篇论文在 GAN 中生成任意视点方面取得了进展。