Anderson 视角

为 AI 开发带来嗅觉

一个新的 AI 数据集教会机器通过将嗅觉数据与图像关联来嗅觉,让模型将气味与物体、场景和材料匹配。

也许是因为嗅觉输出机器有如此复杂的历史,嗅觉在 AI 研究文献中是一个相对被忽视的感官。除非您计划制作另一个嗅觉视觉的长期作品(迄今为止已经超过一个世纪),否则用例在与图像、音频和视频数据集以及从中训练的 AI 模型相比,似乎总是相当“小众”。

事实上,自动化、工业化和普及炸弹犬、尸体犬、疾病嗅探犬和其他各种类型的犬类嗅探单位所提供的检测设施,将是一个值得注意的好处,在市政和安全服务中。尽管需求很高,但供不应求,训练和维护检测犬是一项昂贵的业务,并不总是提供良好的性价比。

到目前为止,大多数侵入这一研究领域的工作都局限于实验室,通常由手工制作的特征组成的精心策划的集合——更倾向于定制的家庭手工业解决方案,而不是工业化应用。

领先一步

在这个相当陈旧的气氛中,来自美国的一个有趣的新学术/产业合作出现了,其中一组研究人员花了几个月的时间在纽约市的室内和室外环境中编目多种气味,并且第一次收集了与捕获的气味相关的图像:

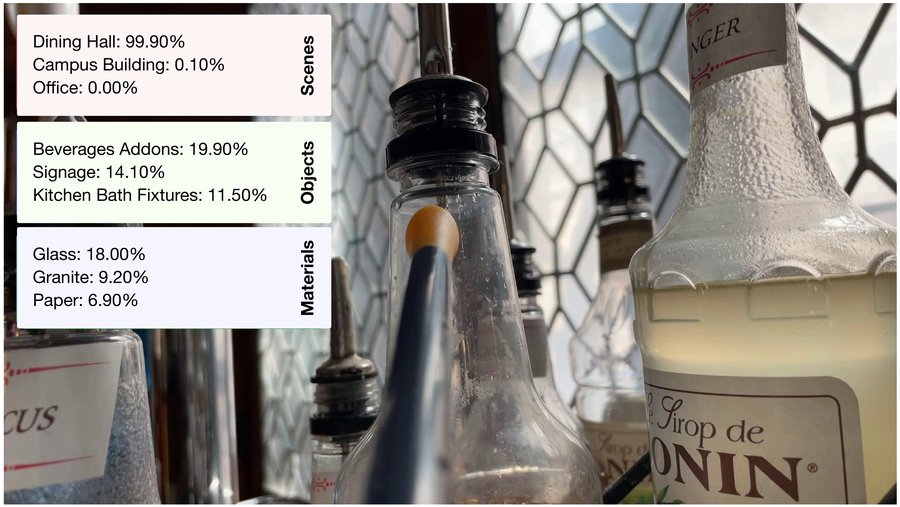

注意中央传感器,即嗅觉设备的“鼻子”。仅训练嗅觉,模型猜测它是否正在嗅探花岗岩、塑料或皮革,并且甚至在不看到单个像素的情况下识别它所在的房间。来源:https://smell.cs.columbia.edu/

这一研究导致论文作者设计了一个对比语言图像预训练(CLIP)框架的变体,即对比嗅觉图像预训练(COIP),它连接气味和图像。

<img class=" wp-image-226467" src="https://www.unite.ai/wp-content/uploads/2025/11/figure-1-3.jpg" alt="顶部:在自然环境中使用相机-电子鼻架捕获同步的视频和嗅觉传感器数据。底部左侧(b):通过跨模式自监督学习联合嵌入。 (c):系统仅根据嗅觉查询检索视觉匹配。 (d):个别嗅觉样本用于分类环境、物体和材料类别。 (e):没有视觉输入,区分了诸如两种类型的草等非常相似的气味。来源:https://arxiv.org/pdf/2511.20544” width=”933″ height=”481″ /> 顶部:在自然环境中使用相机-电子鼻架捕获同步的视频和嗅觉传感器数据。底部左侧(b):通过跨模式自监督学习联合嵌入。 (c):系统仅根据嗅觉查询检索视觉匹配。 (d):个别嗅觉样本用于分类环境、物体和材料类别。 (e):没有视觉输入,区分了诸如两种类型的草等非常相似的气味。来源:https://arxiv.org/pdf/2511.20544

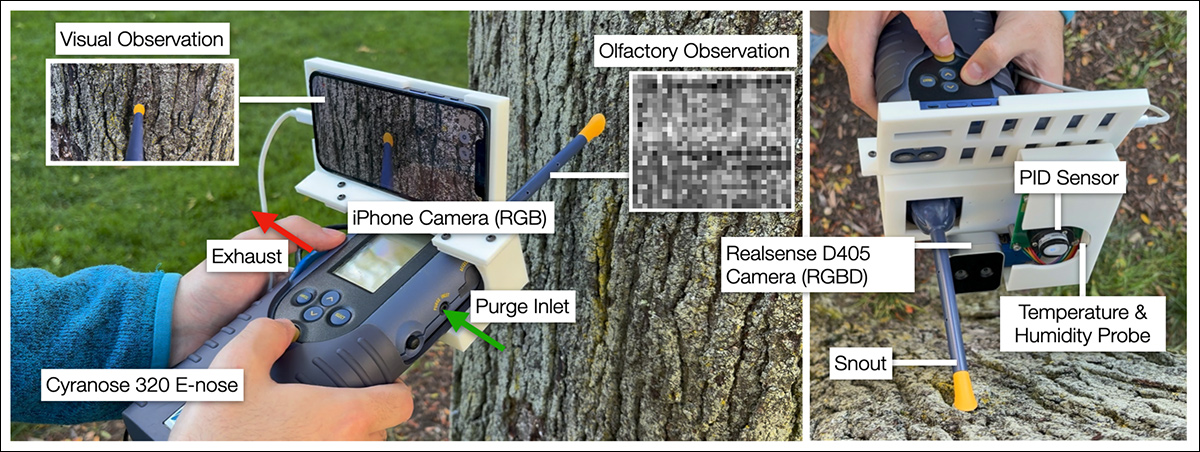

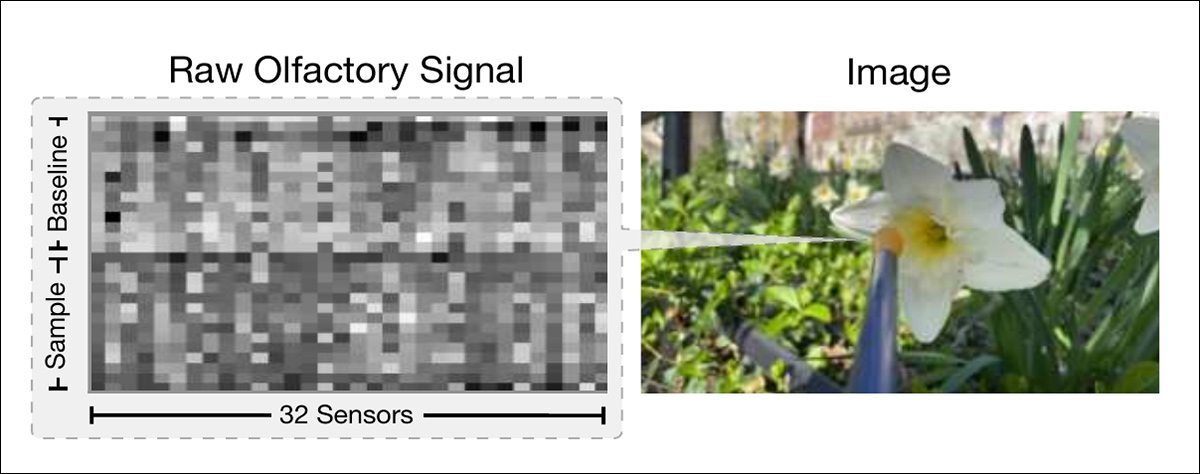

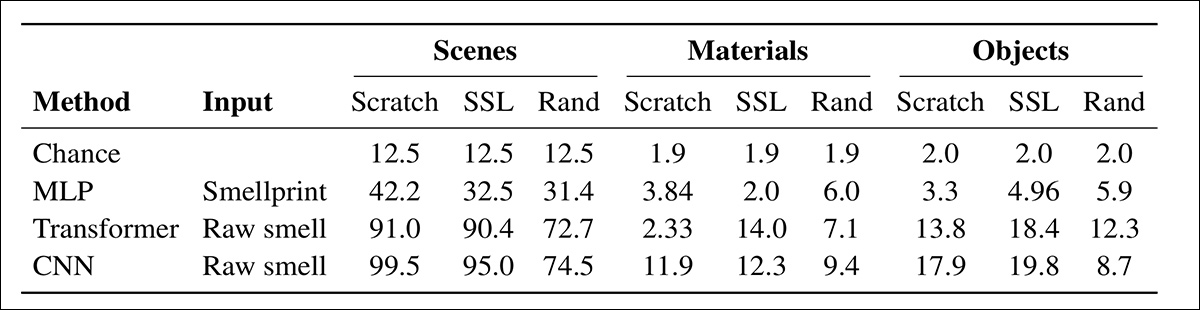

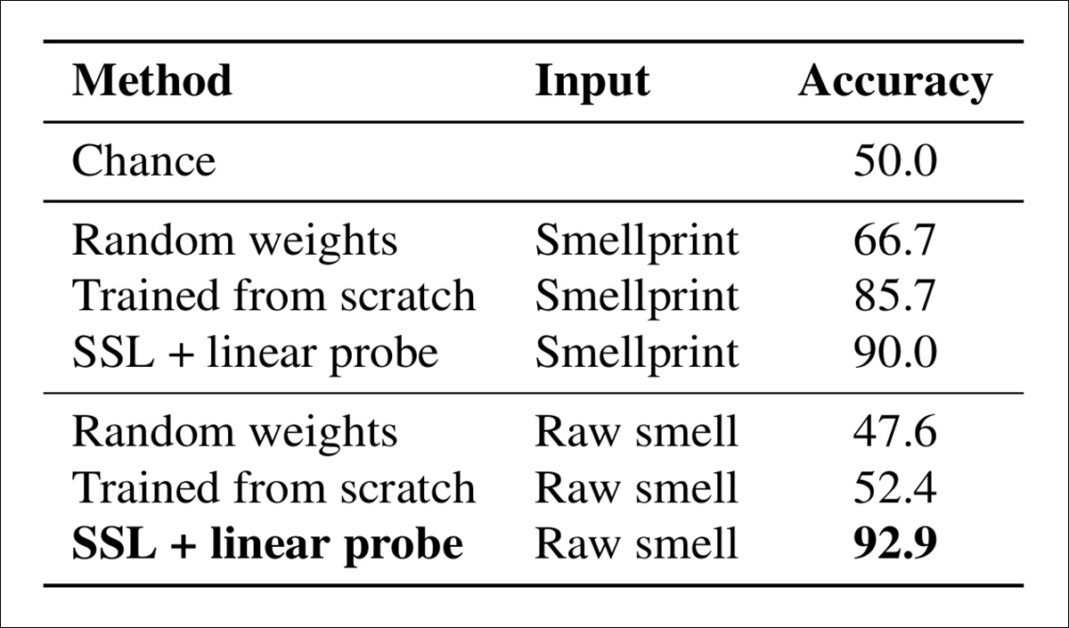

新数据集,名为纽约气味,包含7,000个气味-图像对,具有3,500个不同的物体。经过训练的测试中,新数据被发现优于流行的手工特征,在相似的先前数据集中。 作者希望他们的初次尝试将为后续工作铺平道路,朝着设计用于野外的嗅觉检测系统努力,就像嗅探犬一样: ‘我们认为这个数据集是朝着野外、多模态嗅觉感知以及将视觉与嗅觉联系起来迈出的一步。虽然嗅觉传统上是在受限的环境中进行的,例如质量保证,但在自然环境中有很多应用。 ‘例如,作为人类,我们不断使用我们的嗅觉来评估食物的质量,识别危险,并检测看不见的物体。 ‘此外,许多动物,例如狗、熊和老鼠,表现出超人类的嗅觉能力,表明人类的嗅觉感知远远没有达到机器的能力极限。’ 虽然新论文,名为纽约气味:一个用于嗅觉的大型多模态数据集,承诺数据和代码将被发布,但一个27GB的数据文件已经通过论文的项目网站可用。该论文由九位研究人员在哥伦比亚大学、康奈尔大学和Osmo实验室合作完成。 为了收集新集合的材料,研究人员使用了Cyranose 320电子鼻,带有一个安装在前进气口上的iPhone来捕获视觉上正在注册的气味: 一个手持式传感器rig收集相机和电子鼻的配对视频和气味数据。电子鼻的喇叭口对准物体,同时排气和清洗进气口在采样期间管理气流。一个RGB-D相机捕获深度,而挥发性有机化合物(VOC)浓度、温度和湿度通过集成的传感器记录,包括比例-积分-微分(PID)模块和环境探头。 Cyranose设备以2Hz运行,记录32维的嗅觉时间步。挥发性有机化合物(VOC)浓度由MiniPID2 PPM WR传感器记录。 便携式单元作为一个灵活的传感器,向一个更具计算能力的移动站发送数据进行处理。 为了将目标气味放在上下文中,记录了一个“基线气味”,然后使用Cyranose的“喇叭口”直接针对更具体的物体。然后从单元的侧端口取样,以确保它足够远离主要气味源以免被污染。 两个样本通过传感器的主进气口采集,每个10秒的记录从物体周围的不同位置捕获,以提高数据效率。然后将样本与基线气味结合,形成一个28×32矩阵,代表完整的嗅觉测量: 该示例显示花的信号和对应的图像。完整的嗅觉信号由一个28×32矩阵组成,通过将14帧基线气味与物体周围不同角度采集的两个10秒样本相结合。 视觉语言模型(VLMs)用于自动标记iPhone在Cyranose rig中捕获的物体和材料,使用GPT-4o执行此任务;然而,场景类别是手动标记的: 项目中捕获的气味来源和环境的详细插图的示例。 数据集被分为训练和验证拆分,每个物体的两个样本都分配到同一个拆分中,以避免交叉污染。最终集合包括7,000个嗅觉-视觉对,来自3,500个未标记的物体,以及70小时的视频和196,000个原始嗅觉时间步长,来自基线和样本阶段。 数据在两个月的时间内跨60个会话中收集,涵盖公园、大学建筑、办公室、街道、图书馆、公寓和餐厅,多个会话在每个位置进行。所得数据集包含41%的室外环境和59%的室内环境。 为了开发通用目的的嗅觉表示,作者训练了一个对比模型,将数据集中的同步图像-气味对关联起来。这种方法,即上述COIP,使用一个从CLIP改编的损失函数,将共发生的视觉和嗅觉信号的嵌入对齐。 训练使用了视觉编码器和嗅觉编码器,目标是教导模型将匹配的气味和图像在共享表示空间中拉近。所得表示支持一系列下游任务,包括气味到图像检索、场景和物体识别、材料分类和细粒度气味区分。 模型使用两种类型的嗅觉输入进行训练:原始原始传感器信号和一种称为气味打印的简化手工摘要——在嗅觉研究中广泛使用的特征,它通过比较采样期间的峰值电阻与基线电阻的平均值,将每个传感器的响应压缩为一个数字。 相比之下,原始输入记录了Cyranose设备内部32个化学传感器的时间序列,捕获了每个传感器的电阻如何随时间变化以响应气味。 对于数据集的策划,未处理的信号直接输入神经网络,允许使用原始嗅觉信号进行端到端学习,使用卷积或变换器为骨干。使用对比学习评估了使用气味打印和从纽约市各个环境中收集的原始输入训练的模型。 通过将每个气味样本及其配对图像嵌入到共享表示空间中,并测试是否可以仅根据气味输入检索正确的图像来评估跨模态检索。 排名由图像嵌入与查询气味在该空间中的接近度确定,性能使用平均排名、中位排名和召回率在多个阈值下进行测量: 不同气味编码器的跨模态检索准确率,显示每个模型根据气味查询识别正确图像的准确率。结果比较了在原始嗅觉信号和气味打印上训练的架构。 关于这些结果,作者指出: ‘使用气味打印的对比预训练在所有指标中都优于偶然性。然而,训练嗅觉编码器使用原始嗅觉信号(而不是手工特征)会导致与气味打印编码器相比显著改善,无论架构如何。 ‘这表明原始嗅觉数据中存在更丰富的信息,解锁了更强的跨模态关联。’ 来源论文中的第七个插图的详细信息,由于太过密集,无法在此处有意义地复制。这里,跨模态检索示例显示模型如何将气味与匹配图像链接。每行从气味查询开始,接着是共享嵌入空间中的前几张图像预测。每个查询的正确图像用绿色勾选,说明气味如何将模型拉向视觉和语义相关的场景。 作者还指出,检索结果显示了明显的语义模式: ‘我们的模型的检索结果经常显示语义分组。书的气味检索其他书的图像,树叶的气味检索叶子的图像。 ‘这些结果表明,学习的表示捕获了有意义的跨模态结构。’ 模型在没有视觉输入的情况下识别气味的能力是通过训练它仅根据嗅觉数据来识别场景、物体和材料来评估的;为此,使用了一个线性探针(一个在冻结表示上训练的简单分类器)来评估在学习的嗅觉嵌入中编码了多少信息。 标签从训练集中配对的图像中使用GPT-4o派生而来——但仅在分类期间使用嗅觉信号。 测试了几种编码器类型:一些随机初始化,一些从头开始训练,还有一些使用对比学习来对齐嗅觉和视觉在共享表示空间中的对齐,评估了原始数据和气味打印: 仅使用嗅觉信号评估场景、材料和物体的分类准确率。原始传感器输入优于气味打印,使用从头开始训练的CNN产生最高结果,包括99.5%的场景。SSL预训练在某些情况下有所帮助,但通常被监督训练所超越。随机权重基线表明,仅靠模型容量是不够的。 当使用原始嗅觉数据时,尤其是在使用跨模态监督训练的模型中,获得了显著更高的准确率。作者评论说: ‘训练在原始感官输入上的模型也比训练在手工特征气味打印上的模型准确率更高。这些结果表明,从原始嗅觉信号中进行深度学习比手工特征更好。’ 为了评估是否可以学习细粒度的气味区分,建立了一个基准,从同一校园草坪上共存的两种草类中构建。交替样本在六个30分钟的会话中收集,产生256个示例。训练了一个线性分类器,使用来自嗅觉-视觉对比学习的特征,并在42个样本的保留集上进行了评估: 仅从气味中对草类物种的分类准确率。模型的性能是根据其使用仅嗅觉输入区分两种视觉相似的草类型的能力来比较的。性能是跨气味打印和原始传感器数据、模型随机初始化、从头开始训练或使用自监督学习(SSL)后进行线性探测来比较的。使用SSL和原始嗅觉信号的最高准确率为92.9%,表明原始输入和视觉指导的训练最好地捕捉了细粒度的气味差异。 这里,研究人员指出: ‘训练原始嗅觉传感器信号(而不是手工特征)会产生最高的准确率——超过所有基于气味打印的变体。 ‘这些结果表明,嗅觉-视觉学习保留了比学习气味打印更细粒度的信息,并且视觉监督提供了一个信号来利用这种信息。’ 虽然气味合成似乎将在未来一段时间内仍然是一个未解决的问题,但一个有效且经济的野外气味分析系统具有巨大的潜力,不仅适用于警察、安全和医疗目的,还适用于生活质量和城市监测。 目前,所涉及的设备通常是小众且昂贵的;因此,在“嗅觉 AI”方面的真正进展似乎需要一个具有灵感和经济的传感器,就像树莓派一样。 * 我将作者的内联引用转换为超链接。 ** 请注意,进一步的插图(图8)可在来源论文中找到,但最好在该上下文中查看。 首次发布于2025年11月28日星期五方法

数据和测试

跨模态检索

场景、物体和材料识别

细粒度区分

结论