人工智能

AI生成的语言开始污染科学文献

法国和俄罗斯的研究人员发表了一项研究,表明使用GPT-3等AI驱动的概率文本生成器正在将“扭曲的语言”、非-existent文献的引用和临时、未经认可的图像重用引入以前尊重的科学文献发布渠道。最令人担忧的是,被研究的论文还包含科学上不准确或不可重复的内容,呈现为客观和系统研究的成果,表明生成式语言模型不仅被用于增强论文作者有限的英语技能,而且实际上被用于完成相关的工作(并且,通常情况下,做得很糟糕)。报告报告,题为《Tortured phrases:科学中出现的可疑写作风格》由图卢兹大学计算机科学系和雅虎研究员Alexander Magazinov编写,目前在特拉维夫大学任职。该研究特别关注Elsevier Journal《Microprocessors and Microsystems》中AI生成的科学出版物的增长。

以任何其他名称

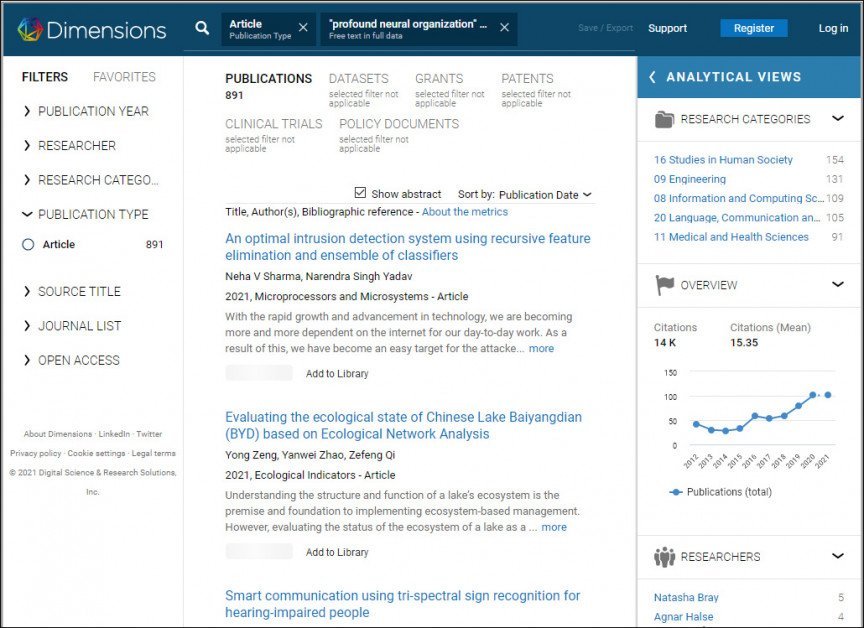

诸如GPT-3的自回归语言模型是在大量数据上训练的,旨在将这些数据 paraphrase、总结、收集和解释为连贯的生成语言模型,能够复制自然的言语和写作模式,同时保留原始数据的意图。由于这些框架通常在模型训练阶段因提供直接和“非吸收”的原始数据而受到惩罚,因此它们最终会寻找同义词,甚至对于成熟的短语。研究人员发现的显然是AI创建/辅助的科学提交中包含大量失败的创造性同义词的尝试,用于机器学习领域的已知短语:深度神经网络:深层神经组织、人工神经网络:(伪造|假的)神经组织、移动网络:多功能组织、网络攻击:组织(伏击|袭击)、网络连接:组织关联、大数据:(巨大|庞大|巨额|巨大的)信息、数据仓库:信息(仓库|配送中心)、人工智能(AI):(伪造|人造)意识、高性能计算:精英计算、雾/迷雾/云计算:雾计算、图形处理单元(GPU):设计准备单元、中央处理单元(CPU):焦点准备单元、工作流引擎:工作过程马达、面部识别:面部确认、语音识别:话语确认、均方误差:均方(错误|失误)、均绝对误差:均(绝对|最高)(错误|失误)、信噪比:(运动|标志|指标|信号)到(喧嚣|骚动|噪音)、全局参数:全球参数、随机访问:(任意|不规则)获取权限、随机森林:(任意|不规则)(林地|森林|茂密地区)、随机值:(任意|不规则)价值、蚁群:地下昆虫(州|省|地区|地区|定居点)、蚁群:地下爬行昆虫(州|省|地区|地区|定居点)、剩余能量:剩余活力、动能:运动活力、天真贝叶斯:(天真|纯洁|轻信)贝叶斯、个人数字助手(PDA):个人计算机协助。2021年5月,研究人员查询了Dimensions学术搜索引擎,寻找这种类型的混乱、自动化语言,注意排除诸如“巨大信息”(这是一个有效的短语,不是“大数据”的失败同义词)等合法短语。在这一点上,他们观察到《Microprocessors and Microsystems》具有最多的误用表达式。目前,仍然可以检索(存档快照,2021年7月15日)一系列科学论文,用于“深层神经组织”(即“深度神经网络”)等无意义短语,其他上述列表中的短语也会产生类似的结果。

Dimensions中’深层神经组织’(’深度神经网络’)的搜索结果 来源:https://app.dimensions.ai/

《Microprocessors》杂志成立于1976年,两年后更名为《Microprocessors and Microsystems》。

无意义语言的增长

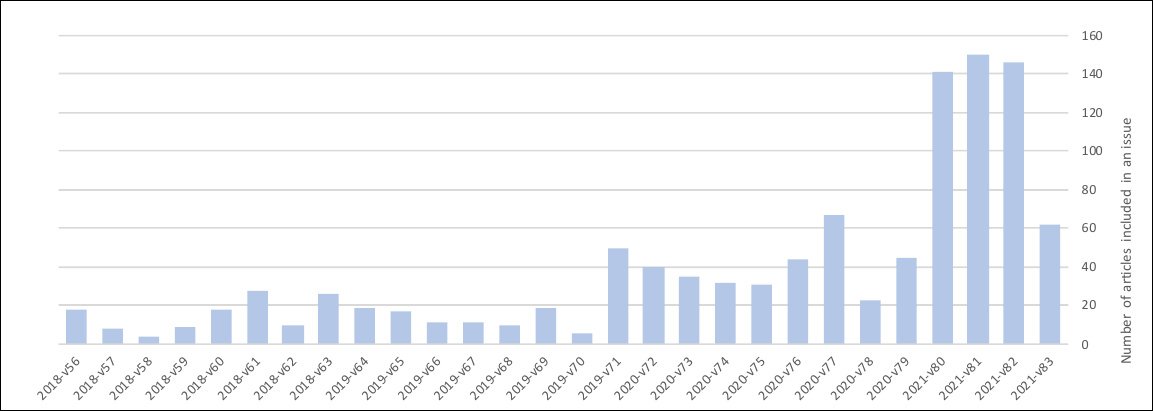

研究人员研究了2018年2月至2021年6月的时期,观察到过去两年提交量的急剧增加,特别是在过去6-8个月内:

相关性还是因果关系?《Microprocessors and Microsystems》杂志的提交量增加似乎与’无意义’文本和同义词在看似尊重的提交中的增长相吻合。 来源:https://arxiv.org/pdf/2107.06751.pdf

研究人员收集的最终数据集包含通过图卢兹大学的Elsevier订阅获得的1,078篇全文文章。

对中国科学论文的编辑监督减少

该论文指出,2021年被标记的提交的编辑评估时间大幅缩短,降至40天以下;从2021年2月开始,同行评审的标准时间减少了六倍。被标记的论文中,来自中国大陆的作者占比最高:在404篇在30天内接受的论文中,97.5%与中国有关。相反,在编辑过程超过40天(615篇)的情况下,中国相关提交仅占该类别的9.5%——一个十倍的失衡。报告将被标记的论文的渗透归因于编辑过程的缺陷,以及可能面临提交量增加的资源匮乏。研究人员假设,GPT风格的生成模型和类似的语言生成框架被用于生成被标记的论文中的大部分文本;然而,生成模型抽象其源的方式使其难以证明,而主要证据在于对不必要的同义词和提交的逻辑一致性的常识性评估。研究人员进一步观察到,他们认为正在贡献这种无意义的洪水的生成语言模型不仅能够创建问题文本,还能够识别和系统地标记它们,就像研究人员自己手动执行的那样。该工作详细介绍了使用GPT-2的此类实现,并为未来系统提供了识别问题科学提交的框架。被污染的提交的发生率在Elsevier期刊(72.1%)中远高于其他研究期刊(最高13.6%)。

不仅仅是语义

研究人员强调,许多期刊不仅仅使用错误的语言,还包含科学上不准确的陈述,表明生成式语言模型不仅被用于增强科学家有限的语言技能,还可能被用于制定至少一些论文的核心定理和数据。在其他情况下,研究人员认为,抽象的(和更好的)先前工作的“重合成”或“重新组合”被用于满足“发表或灭亡”的学术研究文化的压力,并可能提高国家在人工智能研究方面的全球排名,仅凭借纯粹的数量。

提交论文中的无意义内容。在这种情况下,研究人员发现文本是从EDN文章中派生而来的,附带的插图也是从那里未经引用而来的。原始内容的重写如此极端,以至于变得毫无意义。

分析了几篇提交的Elsevier论文后,研究人员发现了一些句子,他们无法推断出任何意义;对不存在的文献的引用;对公式中不存在的变量和定理的引用(表明语言抽象或“幻觉”);以及图像的重用而没有任何来源的引用(研究人员批评这不是从版权的角度,而是从科学严谨性的角度来看)。

引用失败

用于支持科学论文论点的引用在许多被标记的例子中被发现“要么是破碎的,要么是指向无关的出版物”。此外,所谓的“相关工作”的引用往往包括研究人员认为是由GPT风格系统“幻觉”出来的作者。

注意力分散

即使是像GPT-3这样的最先进的语言模型,也存在一个缺点,即它们在长篇讨论中容易失去焦点。研究人员发现,被标记的论文往往在论文开始时提到一个主题,但实际上在初步笔记或其他地方之后就再也没有提到过。他们还推测,一些最糟糕的例子是通过源文本多次通过一系列翻译引擎, 每个引擎都进一步扭曲了含义。

来源和原因

在试图确定这一现象背后的原因时,论文作者提出了一些可能性:来自论文工厂的内容被用作源材料,引入了早期的不准确性,这将不可避免地产生进一步的不准确性;文章旋转工具,如Spinbot,被用来掩盖抄袭;以及压力迫使研究人员定期发表论文,导致资源不足的研究人员使用GPT-3风格的系统来增强或完全生成新的学术论文。研究人员以呼吁行动结束,要求在学术出版的这一领域中进行更大的监督和更好的标准,这个领域似乎正在成为其自身主题——机器学习系统的滋生地。他们还敦促Elsevier和其他出版商引入更严格的筛查和审查程序,并广泛批评当前的标准和做法,在这一方面,建议“合成文本的欺骗威胁着科学文献的完整性。”