Anderson 视角

AI 的美丽追求

一种新的 AI 驱动的美丽评估系统评估面部的吸引力,同时比典型的深度学习模型训练速度更快,可能使大规模自动美丽评分更加实用。

面部美丽预测(FBP)是一个大行业,并且是研究文献中一个相当强大的研究方向。尽管它违反了 AI 和机器学习实践中几乎所有的反偏见原则,并且在很多方面支持算法对女性的物化和还原主义,但它仍然吸引了多个价值数十亿美元的行业的兴趣,其中大多数行业直接针对女性,例如化妆品、整容手术、直播 和时尚等:

女性从 1 到 5 的评分,从论文 ‘Asian Female Facial Beauty Prediction Using Deep Neural Networks via Transfer Learning and Multi-Channel Feature Fusion’ 中获取。 来源

除了这些明显的以女性为中心的商业领域外,广告和其他多个行业,包括娱乐和出版业,在了解男性和女性认为什么是“吸引人”的方面都有着重要的利益,当然,这是基于每种文化的基础。

事实上,美的整体认知在各个地区有所不同,这意味着无法获得一个适用于全球的数据集,并且新的研究必须要么保持本地化,要么集中于可以应用于不同文化数据的“高级”方法。

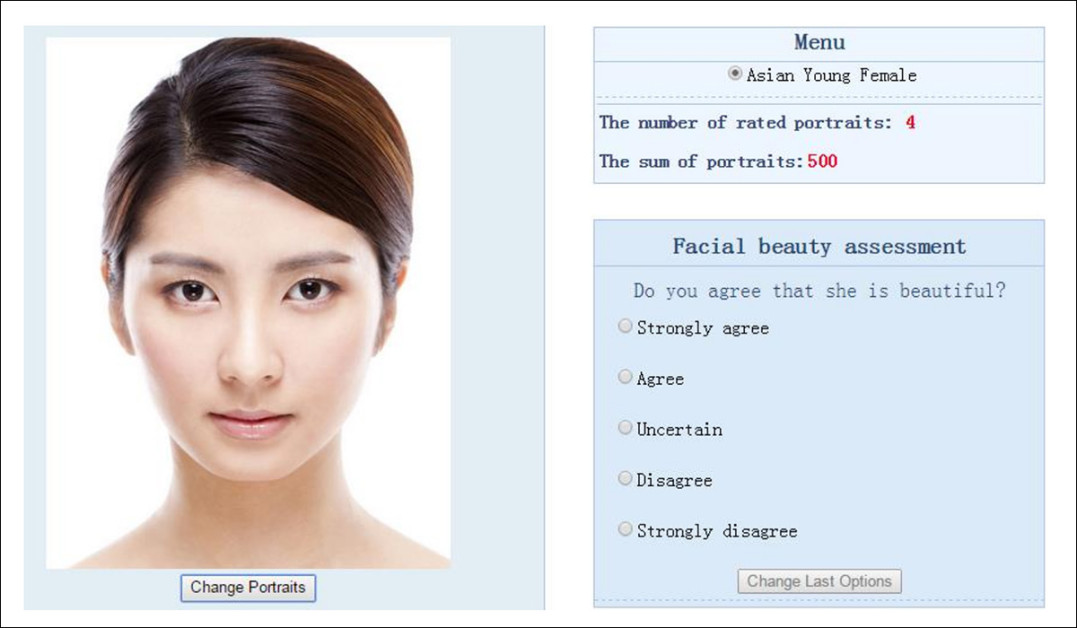

2015 年 SCUT-FBP 项目的面部美丽评估系统界面。 来源

通常,地理位置并不是唯一的限制,因为以吸引力为重点的数据集可能难以在性别或特定应用方面提供均等的有效性,或者可能是以特定的目的而策划的,这可能会限制该集合在其他领域的使用。

例如,在 2025 年,我 报道了一项相对大规模(10 万+ 身份)的数据集的开发,用于评估直播中的吸引力,其紧密的标准可能需要在更广泛的项目中进行显著的适应,尽管该项目背后付出了巨大的努力。

面部呈现

如上面的链接和图像所示,亚洲的研究机构通常不受西方同行的相同文化限制,他们很难发表一篇科学论文,根据西方女性的吸引力进行评分,就像我们在上面提到的 研究 中所看到的那样。

可以认为,在亚洲起源的这种系统被证明在公共领域是有效的,没有当地的批评,西方的利益可以使用或将这种研究适应到私有的、专有的实施中。在这种情况下,“评分女性”的任务被转移到一个可以在没有批评的情况下追求的地点。

无论这种情况是否普遍,还是不太公开的西方等效系统倾向于远离开源协作和公众的审查,但可以合理地假设目标是全球性的,考虑到可以或可能从准确的吸引力评估中受益的众多专业领域。

适者生存

它可能看起来像巨大的网络数据集,如 Tik Tok、Instagram 和 YouTube 将证明是美的优秀仲裁者,通过关联关注者、点赞和流量到吸引力,因为这是一个常见的 合理的关联(尽管有一些 例外)。

同样,现有的集合,如 ImageNet 和 LAION,以演员和模特为特色,他们“登上了巅峰”– 通常会以有吸引力的个人为特色(尽管通常有太多关于太少的人的数据点),允许更广泛的文化机制作为吸引力的代理。

然而,这并没有考虑到 人们对美的品味的变化 随着时间的推移(更不用说地理位置了)。因此,同样需要高级和数据无关的系统,而不是个别和特殊的集合或策划,这些集合或策划将无法反映不断变化的品味。

混合皮肤

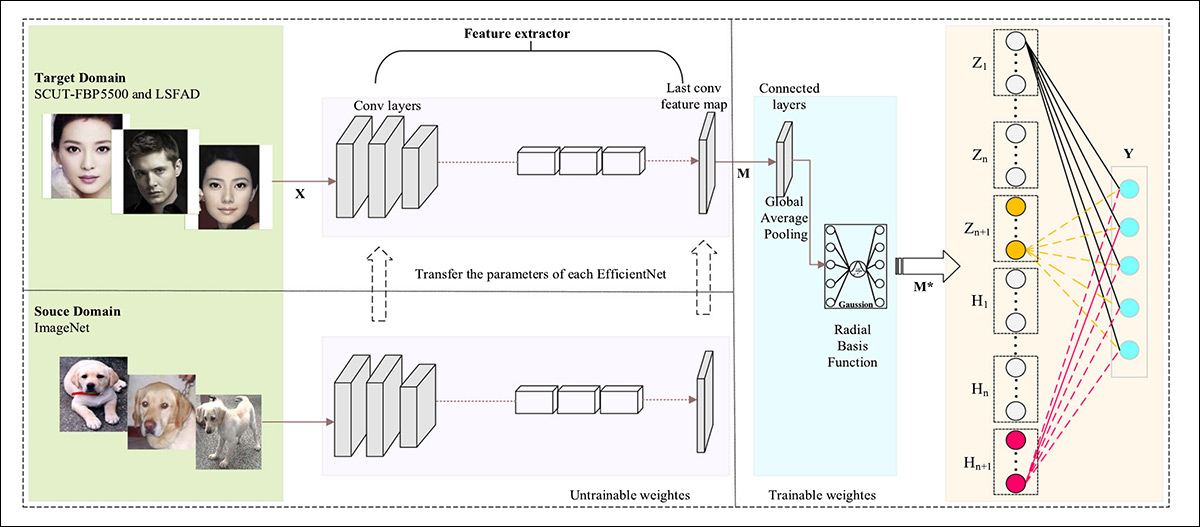

最新的学术贡献来自中国,研究人员将 迁移学习 和 广泛学习系统(BLS)结合起来,以解决长期存在的准确性和计算成本之间的权衡。

传统的神经网络通常只在重度训练后才能获得强大的结果,而像 BLS 这样的轻量级系统可以快速训练,但难以捕捉到足够的细节。新的工作弥合了这一差距,使用预训练的视觉模型提取面部特征,然后将这些特征传递给快速的 BLS 系统进行评分,允许在不从头开始训练整个深度神经网络的情况下重用特征,同时保持高效的训练:

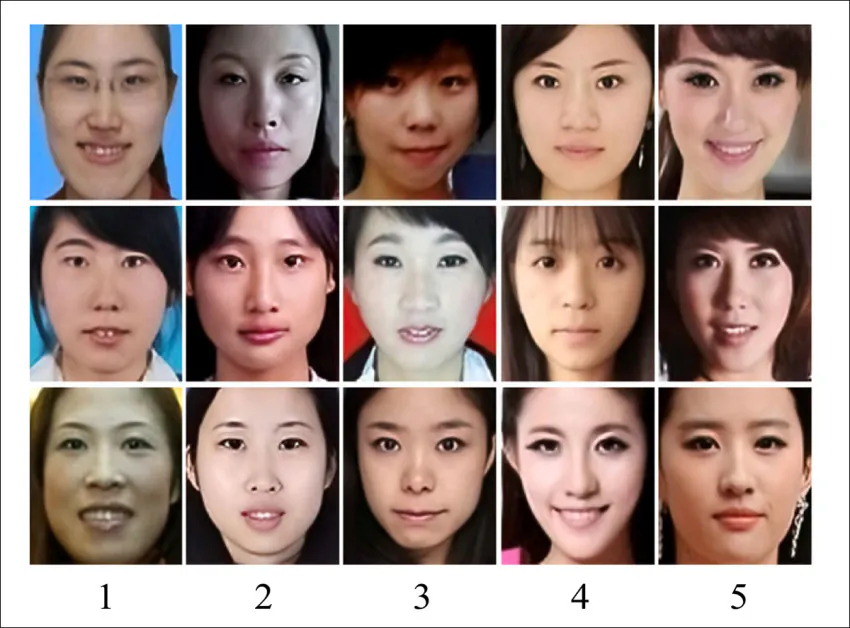

LSAFBD 数据集的样本图像,显示按人类分配的美丽评分从 1 到 5 的女性面部。 来源

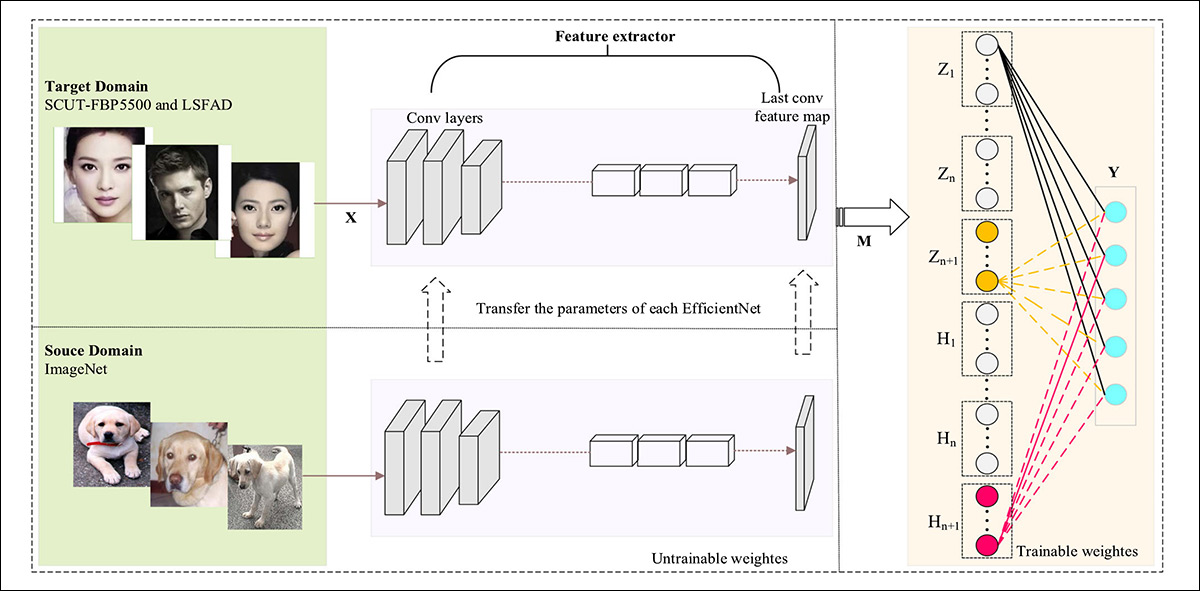

第一种变体,E-BLS,直接将提取的特征输入到轻量级系统中,而第二种变体,ER-BLS,在 EfficientNet 特征提取器和 BLS 之间添加了一个中间处理阶段,以标准化和改进这些特征,然后再用于预测:

ER-BLS 模型的架构。

相反,将 EfficientNet 的原始特征直接发送到 BLS,ER-BLS 首先将它们传递给一个改进层,该层标准化和重塑数据,有助于减少噪音,并使特征在不同图像中更加一致。这一步的设计目的是提高系统的泛化能力,特别是当面部在照明、姿势或其他可能引入不稳定性的视觉条件方面有所不同时。

经过改进的特征然后被送入与 E-BLS 中使用的相同的 BLS 结构中,特征节点和增强节点将信息转换和组合以产生最终的吸引力评分。

方法

上述的 广泛学习系统 是一种比深度神经网络更轻量级的替代方案,它跳过了堆叠多个 层,而是将学习扩散到一个更广泛的简单连接集,允许模型快速训练 – 但通常以牺牲更细的视觉细节为代价。

第一种变体,E-BLS,将 EfficientNet 基础的迁移学习与 BLS 结合,提取面部的详细视觉特征,然后将它们传递给 BLS,涉及最终的预测,这避免了从头开始训练整个深度神经网络的需要:

E-BLS 模型的架构。

EfficientNet,在 ImageNet-1k 上预训练,并且大部分保持不变,将每个输入图像转换为一个紧凑的特征值集,以结构化的方式描述面部,而 BLS 接受这些值并通过一个简单的、随机连接的节点网络处理它们,这些节点转换和组合信息,然后产生最终的吸引力评分。

由于 BLS 不依赖于深层结构,E-BLS 可以通过添加更多节点而不是重新训练整个系统来更新。这保持了快速的训练速度,并使得在引入新数据时更容易改进模型。

第二种变体,ER-BLS,在 EfficientNet 特征提取器和 BLS 之间添加了一个中间处理阶段,以标准化和改进提取的特征,然后再用于预测:

ER-BLS 模型的架构。

相反,将 EfficientNet 的原始特征直接发送到 BLS,ER-BLS 首先将它们传递给一个改进层,该层标准化和重塑数据,有助于减少噪音,并使特征在不同图像中更加一致。这一步的设计目的是提高系统的泛化能力,特别是当面部在照明、姿势或其他可能引入不稳定性的视觉条件方面有所不同时。

经过改进的特征然后被送入与 E-BLS 中使用的相同的 BLS 结构中,特征节点和增强节点将信息转换和组合以产生最终的吸引力评分。

数据和测试

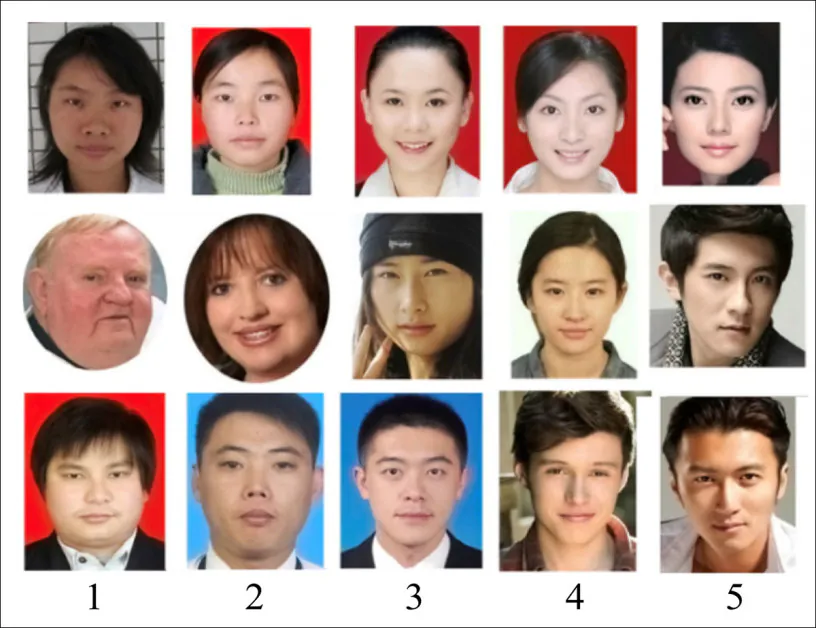

为了测试他们的方法,作者利用了 SCUT-FBP5500 数据集,这是一个来自华南大学的面部美丽预测集合,包含 5,500 张正面面部图像,分辨率为 350x350px,具有多样化的种族、性别和年龄:

SCUT-FBP5500 数据集的样本面部图像,从最不吸引人(1)到最吸引人(5)。

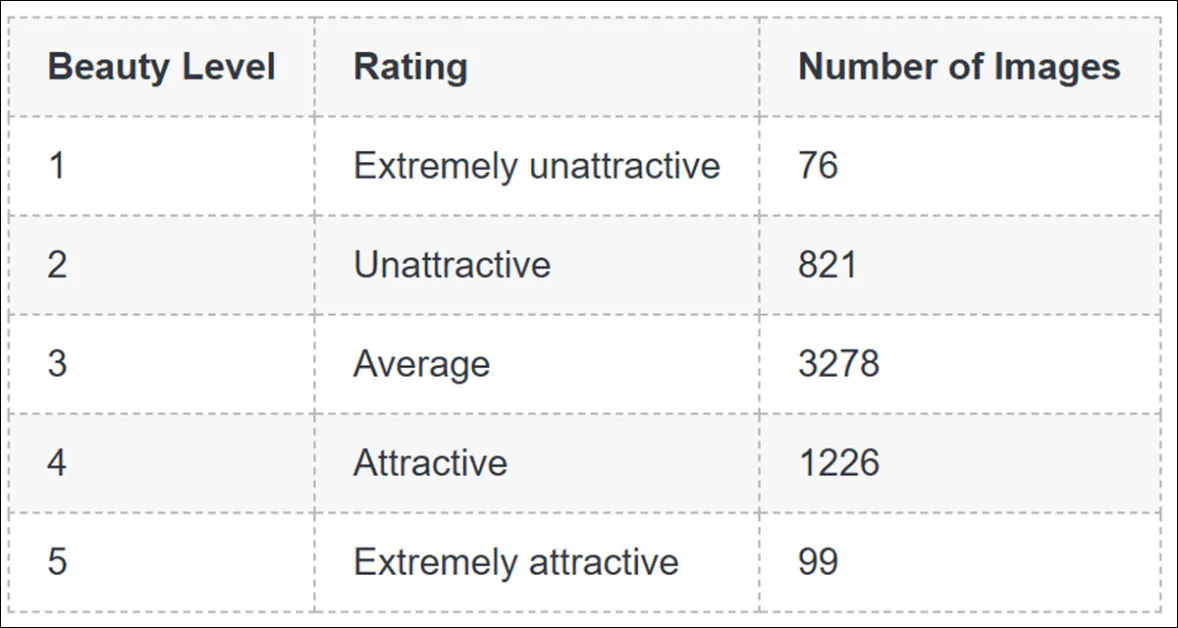

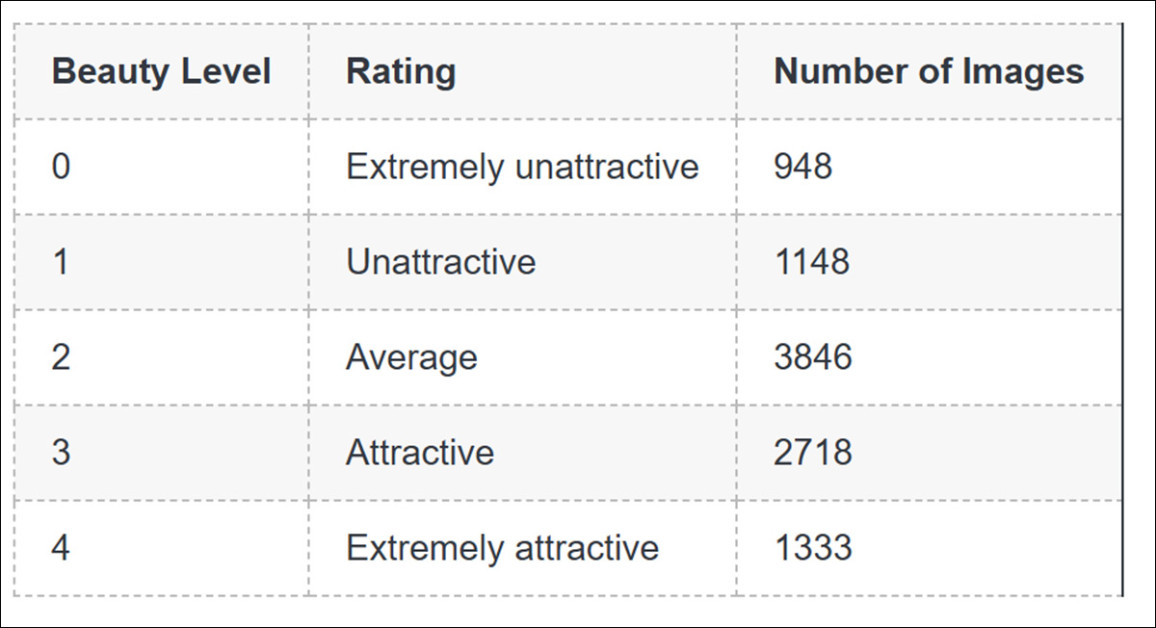

每张图像由 60 名志愿者根据 1-5 的比例评分,范围从 极不吸引人(1)到 极吸引人(5):

按美丽评分划分的图像比例。

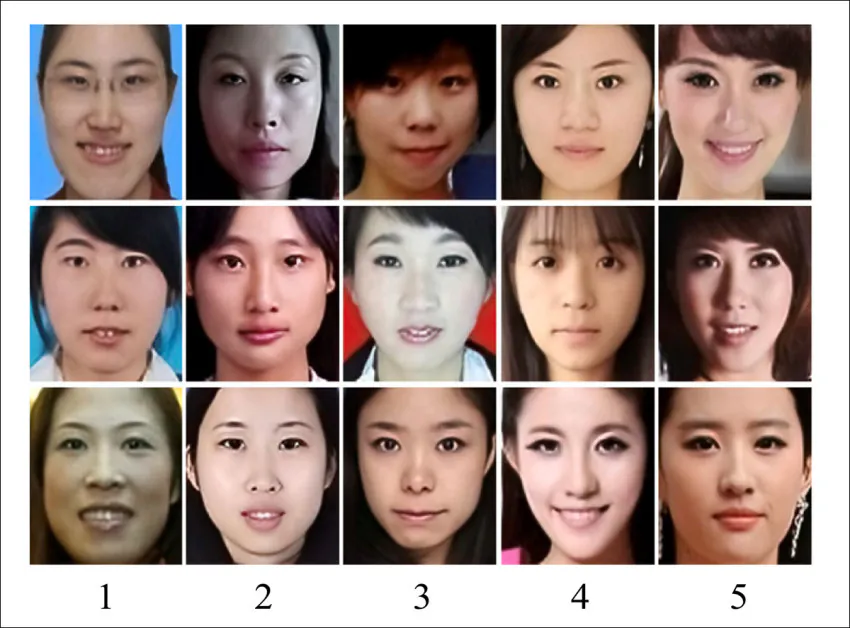

使用的另一个数据库是 大规模亚洲女性美丽数据集(LSAFBD)集合,这是一个由作者自己策划的数据集。

LSAFBD 数据集的样本面部图像,从最不吸引人(1)到最吸引人(5)。

该集合包含 80,000 张未标记的图像,分辨率为 144x144px,具有姿势和背景的变化,以及年龄。这些图像由 75 名志愿者根据与前一个数据集相同的标准进行评分,这次评分范围为 0-4:

LSAFBD 数据集的划分。

每个数据集都被分割成训练和测试段,比例为 8/20,并使用 交叉验证 来稳定结果。BLS 组件通过特征窗口的数量、每个窗口的节点数量和增强节点的数量进行配置,使用 Hyperopt 来搜索有效的组合。

为了建立基线,一个标准的 BLS 模型在相同的设置下进行了训练,然后引入了一系列迁移学习模型,包括 ResNet50、Inception-V3、DenseNet121、InceptionResNetV2、EfficientNetB7、MobileNetV2、NASNet 和 Xception – 所有这些模型都使用 ImageNet-1k 的权重进行初始化,并且在训练中解冻了最后几层。

训练使用 0.001 的学习率(当进展停滞时减少),批大小为 16,跨 50 个 epoch,并在整个过程中应用了正则化和 ReLU 激活。

性能使用准确性和 Pearson 相关性 进行评估,并与总训练时间一起,结果在五次运行中平均。

作者报告训练设置为 Intel-i7 3.6 GHz CPU 和 64GB RAM 的“台式电脑”:

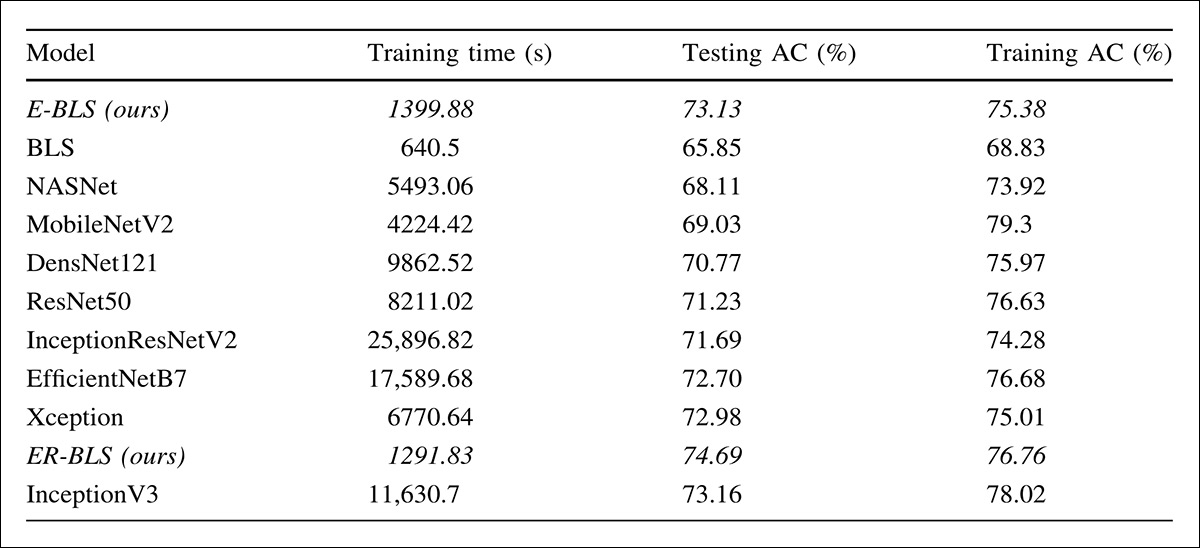

在 SCUT-FBP5500 上的性能比较,E-BLS 和 ER-BLS 达到了与深度 CNN 模型(包括 ResNet50、EfficientNetB7、InceptionV3 和 Xception)具有竞争力的准确性,同时需要的训练时间大大减少 – 突出了将迁移学习与广泛学习系统结合的效率优势。

结果表明,E-BLS 将准确性从 65.85% 提高到 73.13%,而 ER-BLS 达到了 74.69%,超过了所有比较模型。训练时间仍然远远低于深度 CNN,约为 1,300 秒,而深度 CNN 的训练时间则为几千到超过 25,000 秒。

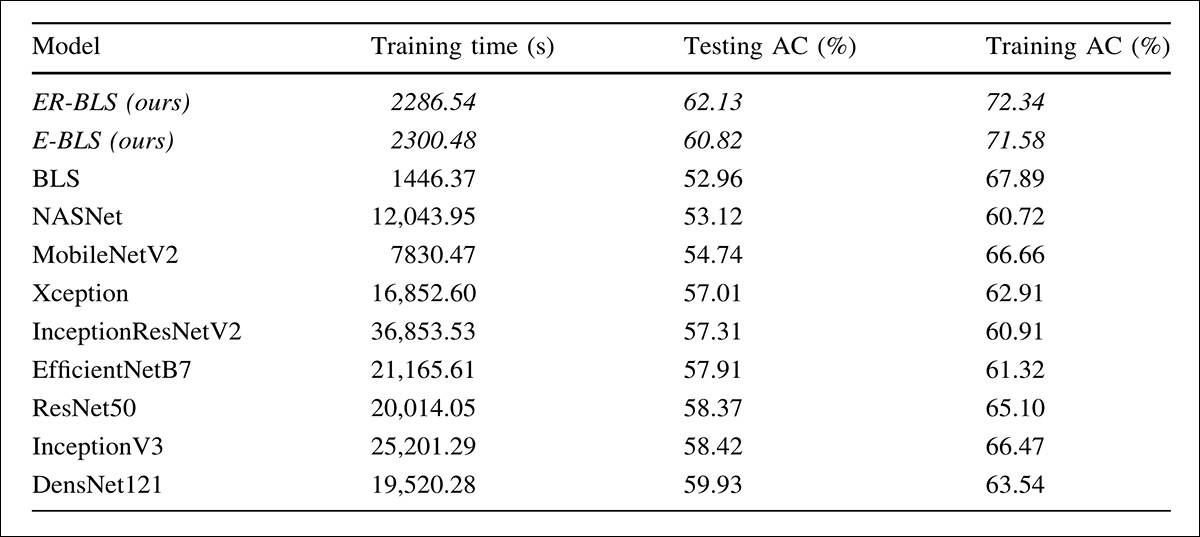

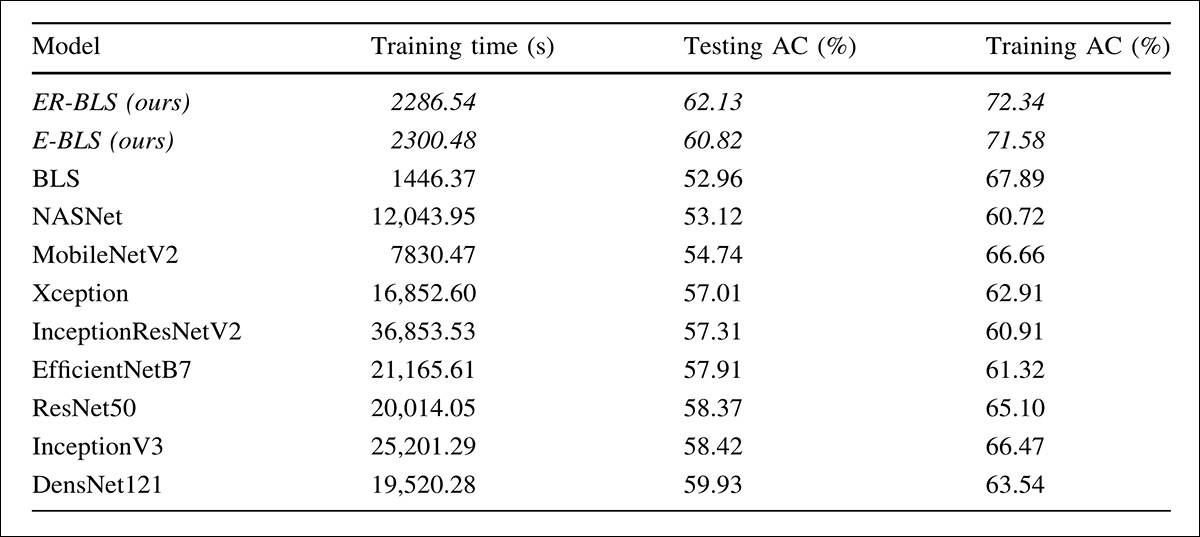

在 LSAFBD 上的测试结果显示,E-BLS 提高了准确性,而 ER-BLS 达到了最高的准确性,超过了所有比较方法:

在 LSAFBD 上的性能,ER-BLS 和 E-BLS 提供了比所有基线和迁移学习模型更高的准确性,同时只需要很小一部分的训练时间,表明在不牺牲预测质量的情况下具有效率优势。

两种变体都保持了远远低于深度 CNN 模型的训练时间,表明在性能和计算成本之间取得了更好的平衡。

结论

这是一个有点“复古”的出版物,如其使用前热门的 CNN 和最低级别的训练设备所证明的。

尽管如此,它处理的是计算机视觉中一个令人惊讶的坚韧目标,这个目标深深地涉及人类的体验和主观解释,并且需要一个超越当时美学趋势的模式,并且能够提供一个真正坚韧的管道来完成这项任务。

首次发布于 2026 年 3 月 19 日