Anderson 视角

在广告商的受众中寻找“猫头鹰和蜥蜴”

由于在线广告行业预计在2023年花费了740.3亿美元,因此可以理解为什么广告公司会在这方面投入大量资源。虽然行业封闭且保护自己的利益,但偶尔会发布一些研究,暗示更先进的专有技术在面部和眼球识别方面,包括年龄识别,这是人口统计学统计的核心。

在野外广告环境中估计年龄,对于可能针对特定年龄人口统计学的广告商来说是有趣的。在这个自动面部年龄估计的实验示例中,跟踪了多年来表演者Bob Dylan的年龄。 来源:https://arxiv.org/pdf/1906.03625

这些研究很少出现在公共存储库中,例如Arxiv,它们使用合法招募的参与者作为人工智能分析的基础,旨在确定观看者在多大程度上以及以何种方式与广告互动。

Dlib的方向梯度直方图(HoG)通常用于面部估计系统。 来源:https://www.computer.org/csdl/journal/ta/2017/02/07475863/13rRUNvyarN

动物本能

在这方面,广告行业自然对确定假阳性(分析系统误解释受试者行为的事件)感兴趣,并确定明确的标准,以确定观看其广告的人是否没有完全参与内容。

至于基于屏幕的广告,研究通常专注于两个问题,跨两个环境。这些环境是“桌面”或“移动”,每个都有特定的特征,需要定制的跟踪解决方案;而问题——从广告商的角度来看——由猫头鹰行为和蜥蜴行为代表——观看者没有完全关注广告的倾向。

广告研究项目中“猫头鹰”和“蜥蜴”行为的示例。 来源:https://arxiv.org/pdf/1508.04028

如果你用整个头看向广告以外的东西,这就是“猫头鹰”行为;如果你的头部姿势是静态的,但你的眼睛从屏幕上游离,这就是“蜥蜴”行为。在广告分析和测试的背景下,这些都是系统需要捕获的基本操作。

SmartEye的Affectiva收购的一篇新论文解决了这些问题,提出了一种架构,利用现有的框架提供所有必要条件和可能反应的组合和连接特征集,并能够判断观看者是否感到无聊、参与或以某种方式远离广告商希望他们观看的内容。

不同干扰信号的真阳性和假阳性示例,分别显示在桌面和移动设备上。 来源:https://arxiv.org/pdf/2504.06237

作者写道:

‘有限的研究深入研究在线广告中的注意力监测。虽然这些研究专注于估计头部姿势或凝视方向以识别凝视偏离的实例,但它们忽略了设备类型(桌面或移动)、相对于屏幕的摄像头位置和屏幕大小等关键参数。这些因素显著影响注意力检测。 ‘

‘在本文中,我们提出了一种注意力检测架构,涵盖检测各种干扰因素,包括猫头鹰和蜥蜴行为的凝视屏幕以外、说话、瞌睡(通过哈欠和长时间闭眼)和离开屏幕未受关注。 ‘

‘与以前的方法不同,我们的方法将设备特定功能(如设备类型、摄像头位置、屏幕大小(用于桌面)和摄像头方向(用于移动设备))与原始凝视估计相结合,以提高注意力检测的准确性。 ‘

新作品在线广告期间的观看者注意力监测,来自Affectiva的四位研究人员。

方法和数据

由于此类系统的保密性和封闭性质,新论文没有直接比较作者的方法与竞争对手,而是将其发现仅作为消融研究呈现;该论文也不遵循计算机视觉文献的通常格式。因此,我们将按照研究的呈现方式进行检查。

作者强调,只有有限的研究专门解决在线广告的注意力检测问题。在AFFDEX SDK中,提供实时多面识别,注意力仅从头部姿势推断,参与者被标记为不关注,如果他们的头部角度超过定义的阈值。

来自Affectiva系统的示例,该系统依赖头部姿势作为注意力的指标。 来源:https://www.youtube.com/watch?v=c2CWb5jHmbY

在2019年的合作使用深度学习自动测量视频内容的视觉注意力中,包含大约28,000名参与者的数据集被注释为各种不关注行为,包括凝视离开、闭眼或从事无关活动,并训练了一个CNN-LSTM模型来检测注意力从面部外观随时间的变化。

来自2019年论文的示例,展示观看视频内容的观看者的预测注意力状态。 来源:https://www.jeffcohn.net/wp-content/uploads/2019/07/Attention-13.pdf.pdf

然而,作者观察到,这些早期的努力没有考虑到设备特定的因素,例如参与者是否使用桌面或移动设备;也没有考虑到屏幕大小或摄像头位置。此外,AFFDEX系统仅专注于识别凝视偏离,并省略了其他干扰源,而2019年的工作尝试检测更广泛的行为——但其使用单个浅CNN可能,论文指出,对于这一任务来说是不充分的。

作者观察到,在这一领域中最受欢迎的研究并未针对广告测试进行优化,这与驾驶或教育等领域有不同的需求——在这些领域中,摄像头位置和校准通常在事先固定,并依赖于未校准的设置,在桌面和移动设备的有限凝视范围内运行。

因此,他们设计了一种用于检测在线广告期间观看者注意力的架构,利用两个商业工具包:AFFDEX 2.0和SmartEye SDK。

AFFDEX 2.0的面部分析示例。 来源:https://arxiv.org/pdf/2202.12059

这些先前的作品提取了低级别的特征,例如面部表情、头部姿势和凝视方向。这些特征然后被处理以产生更高级别的指标,包括凝视在屏幕上的位置;打哈欠;和说话。

系统识别四种干扰类型:屏幕以外的凝视;瞌睡;说话;和未受关注的屏幕。它还根据观看者是否在桌面或移动设备上调整凝视分析。

数据集:凝视

作者使用四个数据集来训练和评估注意力检测系统:三个分别关注凝视行为、说话和打哈欠;和一个来自真实广告测试会话的数据集,包含各种干扰类型的混合。

由于工作的具体要求,创建了每个类别的自定义数据集。所有数据集都是从包含数百万录制会话的参与者观看广告的专有存储库中获取的,使用基于Web的设置和知情同意——由于这些同意协议的限制,作者指出,新工作的数据集无法公开提供。

为了构建凝视数据集,参与者被要求在屏幕上的各个点上跟随一个移动的点,包括其边缘,然后在四个方向(上、下、左、右)上看向屏幕以外的区域,序列重复三次。在这种方式下,建立了捕获和覆盖之间的关系:

显示桌面(a)和移动设备(b)上的凝视视频刺激。第一和第三帧显示跟随移动点的指令,第二和第四帧提示参与者看向屏幕以外的区域。

移动点段被标记为关注,屏幕以外的段被标记为不关注,产生了一个带有正面和负面示例的标记数据集。

每个视频大约持续160秒,分别为桌面和移动平台创建了单独的版本,分辨率分别为1920×1080和608×1080。

收集了609个视频,包括322个桌面和287个移动录音。标签基于视频内容自动应用,并将数据集分割为158个训练样本和451个测试样本。

数据集:说话

在这种情况下,定义“不关注”的一个标准是,当一个人超过一秒钟说话(这种情况可能是一时的评论,甚至是咳嗽)。

由于受控环境不记录或分析音频,语音是通过估计面部标志物的内部运动推断出来的。因此,作者创建了一个基于视觉输入的数据集,用于检测说话,该数据集分为两部分:第一部分包含大约5,500个视频,每个视频由三个注释器手动标记为说话或不说话(其中4,400个用于训练和验证,1,100个用于测试)。

第二部分包含16,000个会话,根据会话类型自动标记:10,500个会话中包含参与者默默地观看广告,5,500个会话中包含参与者对品牌发表意见。

数据集:打哈欠

虽然有一些“打哈欠”数据集,包括YawDD和Driver Fatigue,但作者断言,没有一个适合广告测试场景,因为它们要么包含模拟的哈欠,要么包含可能与恐惧或其他非哈欠动作混淆的面部扭曲。

因此,作者使用了735个来自内部集合的视频,选择了可能包含下颌松开超过一秒的会话。每个视频由三个注释器手动标记为活动或非活动哈欠。仅2.6%的帧包含活动哈欠,突出了类别不平衡,并将数据集分为670个训练视频和65个测试视频。

数据集:干扰

干扰数据集也是从作者的广告测试存储库中获取的,在那里参与者观看了实际广告,没有指定任务。随机选择了520个会话(193个移动设备和327个桌面环境),并由三个注释器手动标记为关注或不关注。

不关注行为包括屏幕以外的凝视、说话、瞌睡和未受关注的屏幕。会话跨越世界各地的不同地区,桌面录音更为常见,主要是由于网络摄像头的灵活摆放。

注意力模型

提出的注意力模型处理低级别的视觉特征,例如面部表情;头部姿势;和凝视方向——通过上述AFFDEX 2.0和SmartEye SDK提取。

这些特征然后被转换为更高级别的指标,每个干扰因素由一个单独的二元分类器处理,该分类器在其自己的数据集上进行训练,以实现独立优化和评估。

提出的监测系统的架构。

凝视模型使用归一化的凝视坐标确定观看者是否在看屏幕或看向屏幕以外的区域,并为桌面和移动设备进行了单独的校准。支持这一过程的是一个线性支持向量机(SVM),它在空间和时间特征上进行训练,并包含一个记忆窗口,以平滑快速的凝视转移。

为了检测说话(无音频),系统使用了嘴巴区域的裁剪和在对话和非对话视频片段上训练的3D-CNN。标签基于会话类型,时间平滑减少了由于短暂的嘴部运动可能产生的假阳性。

打哈欠是使用全脸图像裁剪来捕捉更广泛的面部运动检测到的,并在手动标记的帧上训练了一个3D-CNN(尽管由于打哈欠在自然观看中的低频率和与其他表情的相似性,这项任务变得复杂)。

屏幕遗弃是通过面部或极端头部姿势的缺失来识别的,预测是通过决策树来完成的。

最终注意力状态是使用固定规则确定的:如果任何模块检测到不关注,观看者被标记为不关注——一种优先考虑敏感性的方法,并针对桌面和移动环境进行了单独的调整。

测试

如前所述,测试遵循一种消融方法,即组件被删除,结果被记录下来。

研究中识别的不同类别的感知不关注。

凝视模型通过三个关键步骤识别屏幕以外的行为:归一化原始凝视估计,细化输出,并估计桌面设备的屏幕大小。

为了了解每个组件的重要性,作者单独删除了它们,并在从两个数据集中提取的226个桌面和225个移动视频上评估了性能。结果以G-mean和F1得分来衡量,如下所示:

显示完整凝视模型的性能,以及删除个别处理步骤后的版本。

在每种情况下,性能都会在删除步骤后下降。归一化被证明在桌面设备上特别有价值,因为摄像头位置的变化比移动设备更大。

该研究还评估了视觉特征如何预测移动摄像头的方向:面部位置、头部姿势和眼球凝视分别得分0.75、0.74和0.60,而它们的组合达到0.91,突出了集成多个线索的优势。

说话模型在手动标记的测试集上训练基于垂直嘴唇距离,实现了ROC-AUC的0.97,并在较大的自动标记数据集上实现了0.96,表明在两个数据集上都表现一致。

打哈欠模型仅使用嘴部宽高比达到96.6%的ROC-AUC,这个结果在与AFFDEX 2.0的动作单元预测相结合时提高到97.5%。

未受关注的屏幕模型将没有面部或极端头部姿势的时刻分类为不关注,当AFFDEX 2.0和SmartEye都无法检测到面部超过一秒钟时,预测就会被触发。为了评估这一点的有效性,作者手动注释了真实干扰数据集中所有没有面部的事件,找到了每次触发的潜在原因。模糊的案例(例如摄像头阻塞或视频失真)从分析中排除。

如下所示的结果表明,只有27%的“无面部”激活是由于用户物理离开屏幕。

在某些情况下没有找到面部的各种原因。

论文指出:

‘尽管未受关注的屏幕仅占实例的27%,但它被激活了其他原因,表明不关注,例如参与者以极端角度凝视屏幕以外、进行过度运动或以物体/手显著遮挡面部。 ‘

在最后一次定量测试中,作者评估了逐渐添加不同干扰信号——屏幕以外的凝视(通过凝视和头部姿势)、瞌睡、说话和未受关注的屏幕——如何影响其注意力模型的整体性能。

测试是在两个数据集上进行的:真实干扰数据集和凝视数据集的一个测试子集。G-mean和F1得分被用来衡量性能(尽管瞌睡和说话在凝视数据集分析中被排除在外,因为它们在这种情况下相关性有限)。

如下所示,注意力检测在添加更多干扰类型时一致性地提高,屏幕以外的凝视提供了最强的基线,它是最常见的干扰因素。

向架构添加各种干扰信号的效果。

关于这些结果,论文指出:

‘从结果来看,我们可以首先得出结论,集成所有干扰信号有助于增强注意力检测。

‘其次,注意力检测的改进在桌面和移动设备上都是一致的。第三,在真实数据集中的移动设备会话中,当凝视离开时会出现显著的头部运动,这些运动很容易被检测到,从而导致移动设备的性能优于桌面设备。第四,添加瞌睡信号与其他信号相比,改进相对较小,因为它通常很少发生。 ‘

‘最后,未受关注的屏幕信号在移动设备上比桌面设备上有相对更大的改进,因为移动设备很容易被遗弃。’

作者还将他们的模型与AFFDEX 1.0进行了比较,这是一个以前用于广告测试的系统——即使是他们的当前模型的基于头部的凝视检测也优于AFFDEX 1.0,跨越两个设备类型:

‘这种改进是由于在两个方向(yaw和pitch)中都包含头部运动,以及对头部姿势进行归一化以考虑小的变化所致。移动设备中显著的头部运动使我们的头部模型的性能与AFFDEX 1.0相似。’

作者以一个(可能有些公式化的)定性测试环节结束了论文,如下所示。

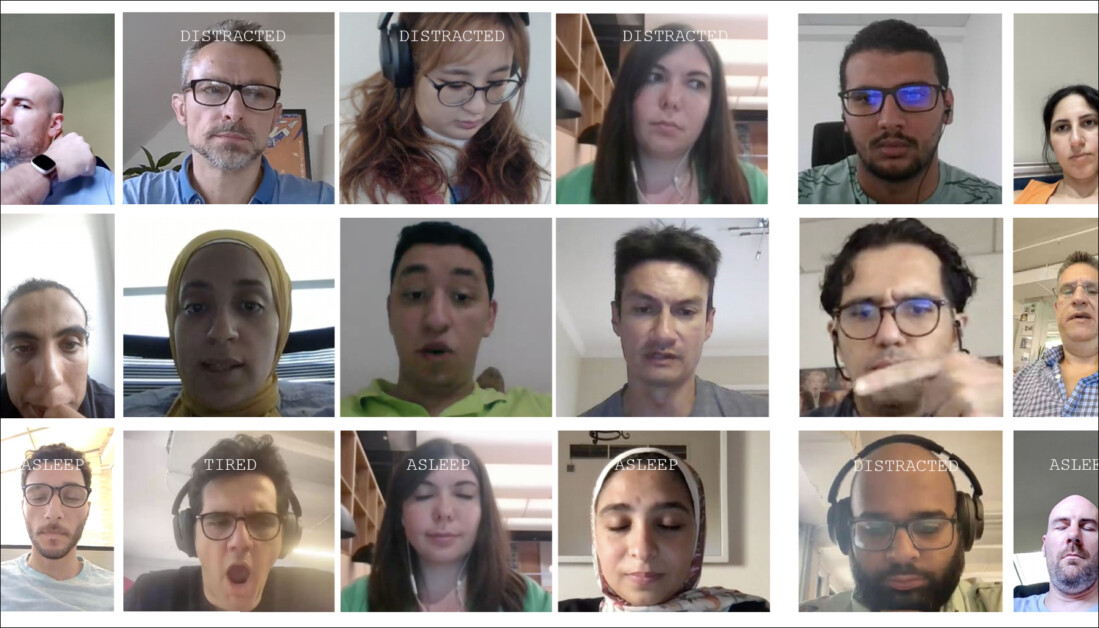

注意力模型在桌面和移动设备上的示例输出,每行显示不同干扰类型的真阳性和假阳性示例。

作者指出:

‘结果表明我们的模型在非受控环境中有效地检测各种干扰因素。然而,它可能会在某些边缘情况下产生假阳性,例如严重的头部倾斜、嘴部遮挡或面部图像过度模糊。 ‘

结论

虽然结果代表了对先前工作的有意义的进步,但更深层次的价值在于它为我们提供了对获取观看者内部状态的持续驱动力的洞察。虽然数据是以知情同意的方式收集的,但该方法指向了未来可能超越结构化的市场研究环境的框架。

这种相当偏执的结论仅被这方面研究的隐蔽、受限和保护性质所加强。

* 我将作者的内联引用转换为超链接。

首次发布于2025年4月9日星期三