Погляд Anderson

Поза оком, поза увагою: Вирішення найбільшої проблеми в AI-відео

Найбільшою проблемою навіть найкращих генераторів AI-відео є їхня хронічна амнезія – виклик, який зараз вирішує нове дослідження з Китаю.

Найбільшою проблемою навіть найкращих і найсучасніших систем генерації AI-відео є те, що всі вони мають хронічну амнезію: якщо камера відведе об’єкт від фокусу, а потім повернеться назад, вона ніколи не знайде того, що було на початку – персонажі зникнуть, змінять зовнішність та/або тип руху, а фон, швидше за все, також зміниться.

Це відбувається тому, що дифузійна система генерації має обмежене ковзне вікно уваги, і тому що вона завжди працює з тим, що бачить у даний момент; у справжньому втіленні соліпсизму, те, що знаходиться поза кадром, для генеративного ШІ не існує – воно буквально видаляється з пам’яті.

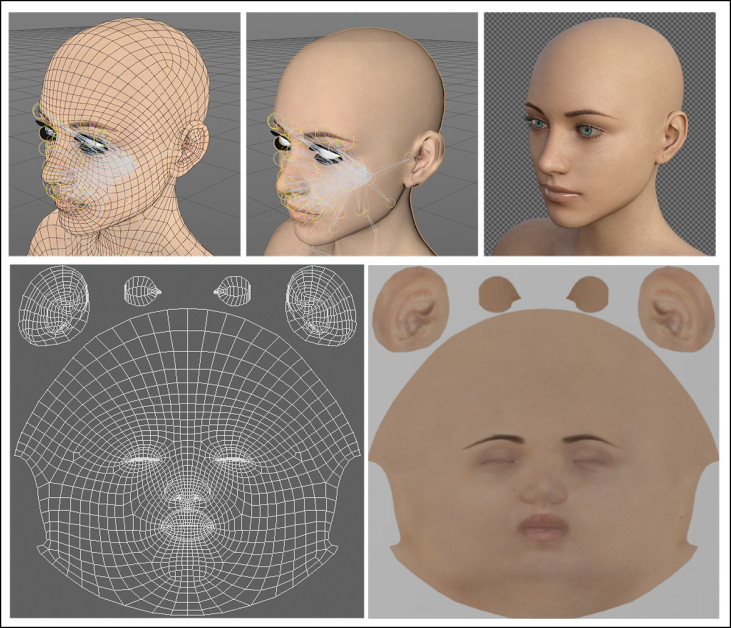

Це ніколи не було проблемою в традиційній CGI, яка завжди може звернутися до об’єкта та точно відтворити його, включаючи зовнішність і рух, у будь-який момент візуалізованого відео, де він може знадобитися знову:

Традиційні CGI-меші та растрові текстури завжди можна використовувати при рендерингу, забезпечуючи послідовність зовнішності – прийом, який набагато важче реалізувати в AI-підходах, оскільки немає еквівалентного ‘плоского посилання’ або колекції пов’язаних файлів.

Це тому, що компонентні елементи CGI, такі як меші та текстури (див. зображення вище), а також файли руху та інша динамічна поведінка, можуть існувати окремо на диску та використовуватися в композиції в будь-який час.

У генеративному відео ШІ немає такого ‘плоского сховища’; найближчим аналогом цієї функціональності є LoRA – спеціально навчені додаткові файли, які можна тренувати на споживчому обладнанні, дозволяючи ‘впроваджувати’ нових персонажів та конкретний одяг у відео:

Натисніть, щоб відтворити. Проблему соліпсизму в AI-відео можна певною мірою пом’якшити за допомогою LoRA – але результати можуть бути переважними.

Однак це не ідеальне рішення. По-перше, LoRA прив’язані до точної конкретної версії базової моделі (наприклад, Wan2+ або Hunyuan Video), і їх потрібно відтворювати щоразу, коли змінюється базова модель. По-друге, LoRA схильні спотворювати ваги базової моделі, так що навчена ідентичність LoRA накладається на всіх персонажів у сцені. Крім того, методи доопрацювання такого типу дуже чутливі до погано підібраних наборів даних.

Точні повтори

Тепер нове академічно-промислове співробітництво з Китаю пропонує перше значне виправлення, яке потрапило в поле моєї уваги за понад три роки висвітлення цієї проблеми. Метод використовує те, що дослідники називають гібридною пам’яттю, щоб тримати персонажа поза кадром та його безпосереднє оточення активними та точними в латентному просторі моделі, так що коли наша точка зору повертається до них, ефект є послідовним:

Натисніть, щоб відтворити. З сайту проекту нової статті, два приклади AI-згенерованих (WAN) персонажів, що виходять з кадру та точно повертаються. Джерело

Слід підкреслити, що це не те саме, що досягнення консистентності персонажа в різних кадрах – щось, про що заявлялося як про досягнення рік тому в релізі Runway Gen 4, і що залишається постійним предметом досліджень у науковій літературі.

Швидше, тут вирішено те, що жодна комерційна чи експериментальна платформа, яку я бачив, не змогла досягти – візуально послідовне повторне з’явлення колишнього вигляду, руху та оточення персонажа поза кадром:

Натисніть, щоб відтворити. Інші два головні приклади, наведені на сайті проекту нової ініціативи.

Очевидно, що принципи, що тут працюють, можна однаково застосувати до інших областей, таких як урбаністичні дослідження, водіння від першої особи або інші види візуалізації без персонажів.

Також слід підкреслити, що цей новий підхід не вирішує та не стосується проблеми, яку, за твердженням Runway Gen4 та інших закритих платформ, вони вирішили, відтворюючи персонажів в різних кадрах; натомість він робить те, в чому жоден з них ще не досяг успіху – зберігає персонажа та оточення в пам’яті, не вимагаючи, щоб вони залишалися видимими для глядача весь час.

Нова робота включає спеціальний набір даних, згенерований за допомогою Unreal Engine, а також спеціальні метрики для проблеми соліпсизму*, та спеціальну генеративну платформу, побудовану поверх WAN. У тестах проти небагатьох доступних аналогічних систем автори заявляють про результати на рівні сучасних досягнень і коментують:

‘[Механізми пам’яті] виявилися критичним кордоном у вдосконаленні світових моделей, оскільки ємність пам’яті визначає просторову та часову консистентність згенерованого контенту.

‘Зокрема, це когнітивний якір, який дозволяє моделі зберігати історичний контекст під час змін точки зору або довгострокової екстраполяції.

‘Без надійної пам’яті імітований світ швидко розпадається на роз’єднані, хаотичні кадри.’

Нова стаття має назву Out of Sight but Not Out of Mind: Hybrid Memory for Dynamic Video World Models і належить семи дослідникам з Хуачжунського університету науки і технологій та команди Kling у Kuaishou Technology.

Метод

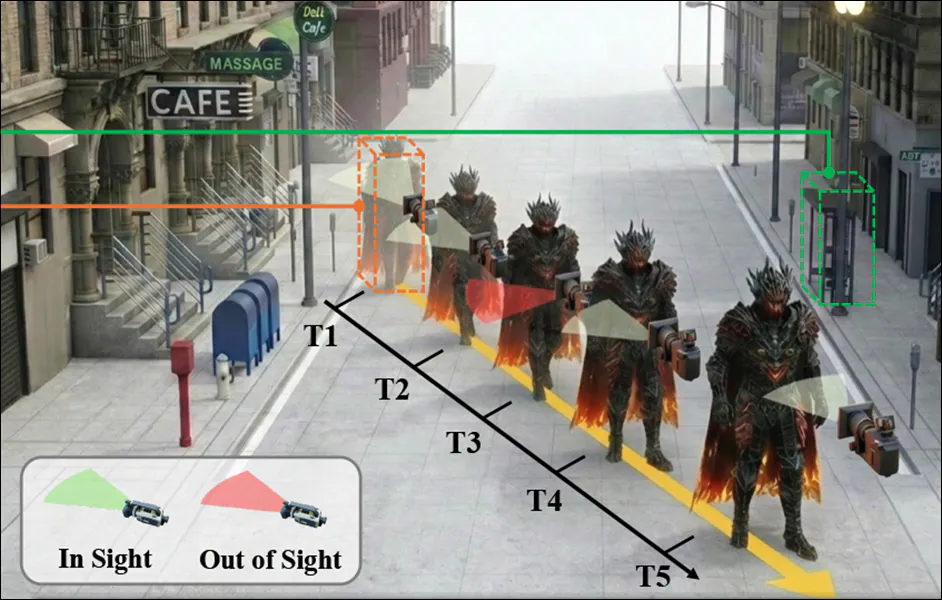

Центральною основою нової роботи є гібридна пам’ять, яка сприяє ‘екстраполяції поза полем зору’ – збереженню персонажів та їхнього контексту, поки глядач ‘відвертає погляд’ (або поки сам персонаж виходить з поля зору). У цьому сценарії платформа повинна виконувати просторово-часове розв’язування, при якому вона одночасно зосереджена на генерації, видимій глядачеві, та на позакадровому існуванні персонажа, який зараз не видно.

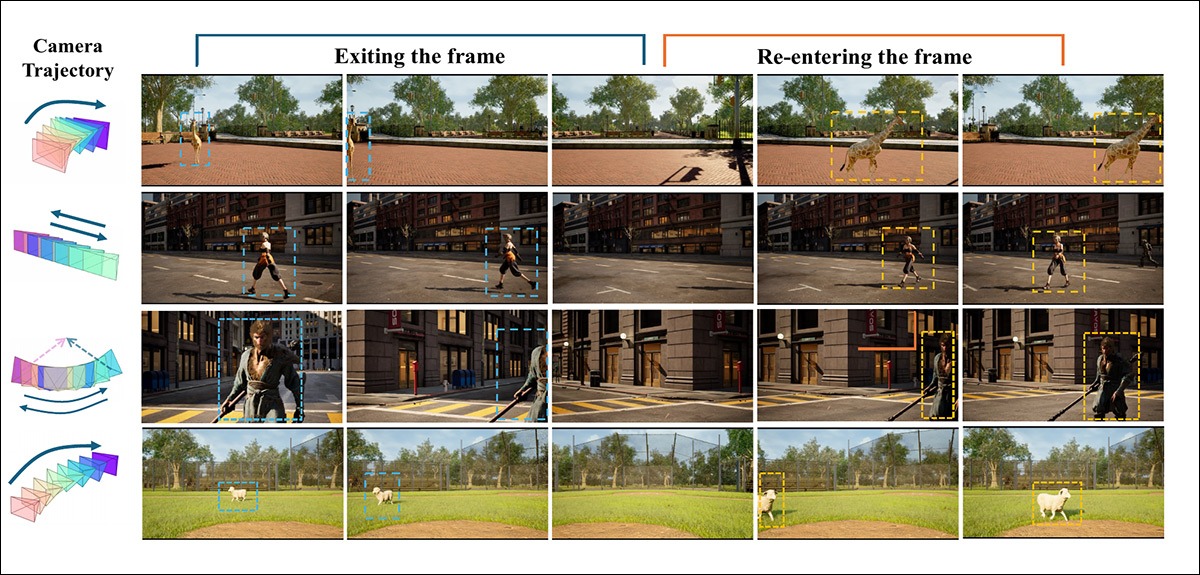

Приклади руху камери входу/виходу. У цих випадках саме рух камери змушує персонажа вийти з кадру, але в різноманітних зразках ми також можемо спостерігати, як самі персонажі тимчасово виштовхують себе за межі екрана. Джерело

Автори зазначають, що в дифузійних латентних ембедінгах ознаки, які потрібно витягнути та використати, сильно переплетені з іншими ознаками та властивостями; і що спроба їх витягнути часто призводить до того, що об’єкт ‘заморожується’ у фоні. Тому вони розробили та підготували набір даних HM-World**, спеціально спрямований на навчання гібридної пам’яті:

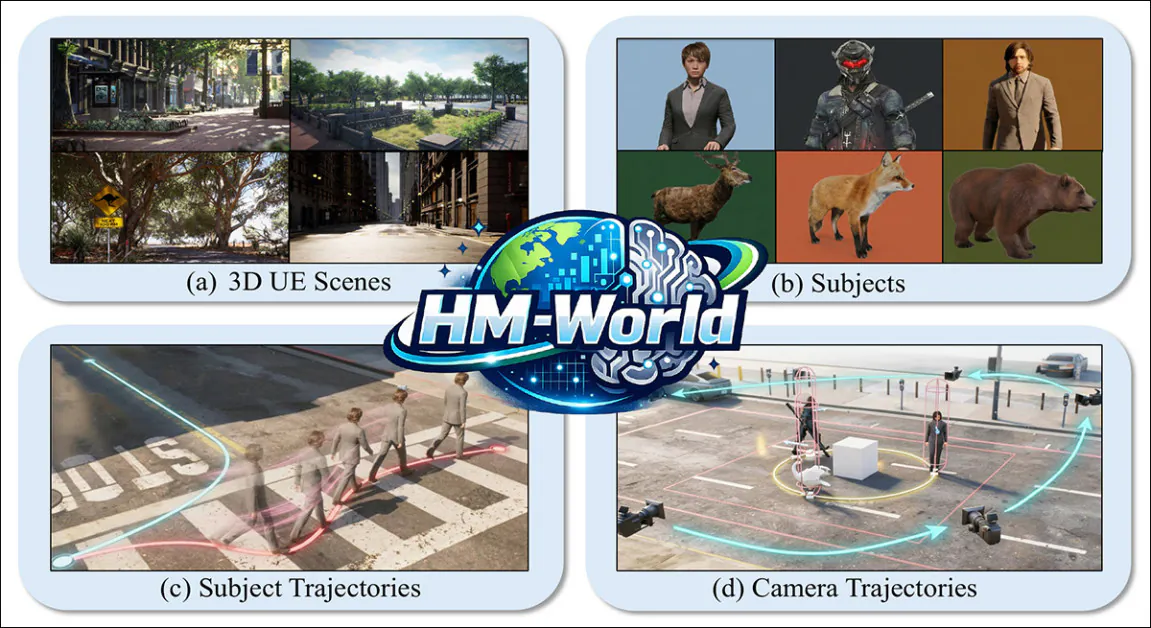

Зі статті, зразки з чотирьох категорій, що містяться в наборі даних HM-World.

Колекція побудована за чотирма вимірами: траєкторії суб’єкта, траєкторії камери, сцени та суб’єкти.

Синтетичні дані в HM-World містять 17 сцен та 49 суб’єктів, включаючи людей різної зовніш