Погляд Anderson

Шукаючи «Сов і Ящірок» в аудиторії рекламодавця

Оскільки онлайн-сектор реклами, як очікується, витратив 740,3 мільярда доларів США у 2023 році, легко зрозуміти, чому рекламні компанії вкладають значні ресурси в цей конкретний напрямок досліджень комп’ютерного зору.

Хоча індустрія ізольована і захищена, вона періодично публікує дослідження, які натякають на більш просунуту власну роботу в галузі розпізнавання обличчя та напрямку погляду – включаючи розпізнавання віку, центральне для демографічної статистики:

Оцінка віку в контексті реклами в дикій природі є цікавою для рекламодавців, які можуть націлюватися на конкретну вікову демографічну групу. У цьому експериментальному прикладі автоматичної оцінки віку обличчя вік виконавця Боба Ділана відстежується протягом років. Джерело: https://arxiv.org/pdf/1906.03625

Ці дослідження, які рідко з’являються в публічних репозиторіях, таких як Arxiv, використовують легітимно-звербованих учасників як основу для аналізу, керованого ІІ, який має на меті визначити, якою мірою та яким чином глядач взаємодіє з рекламою.

Dlib’s Гістограма орієнтованих градієнтів (HoG) часто використовується в системах оцінки обличчя. Джерело: https://www.computer.org/csdl/journal/ta/2017/02/07475863/13rRUNvyarN

Тваринний інстинкт

У цьому відношенні природно, що рекламна індустрія зацікавлена у визначенні помилкових позитивів ( випадків, коли аналітична система неправильно тлумачить дії суб’єкта) та встановленні чітких критеріїв для того, коли людина, яка дивиться їхні рекламні ролики, не повністю взаємодіє з контентом.

Що стосується реклами на основі екрана, дослідження зазвичай зосереджуються на двох проблемах у двох середовищах. Середовища – це “настільний комп’ютер” або “мобільний”, кожне з яких має особливі характеристики, які потребують індивідуальних рішень для відстеження; і проблеми – з точки зору рекламодавця – представлені поведінкою сови і ящірки – схильністю глядачів не звертати повну увагу на рекламу, яка знаходиться перед ними.

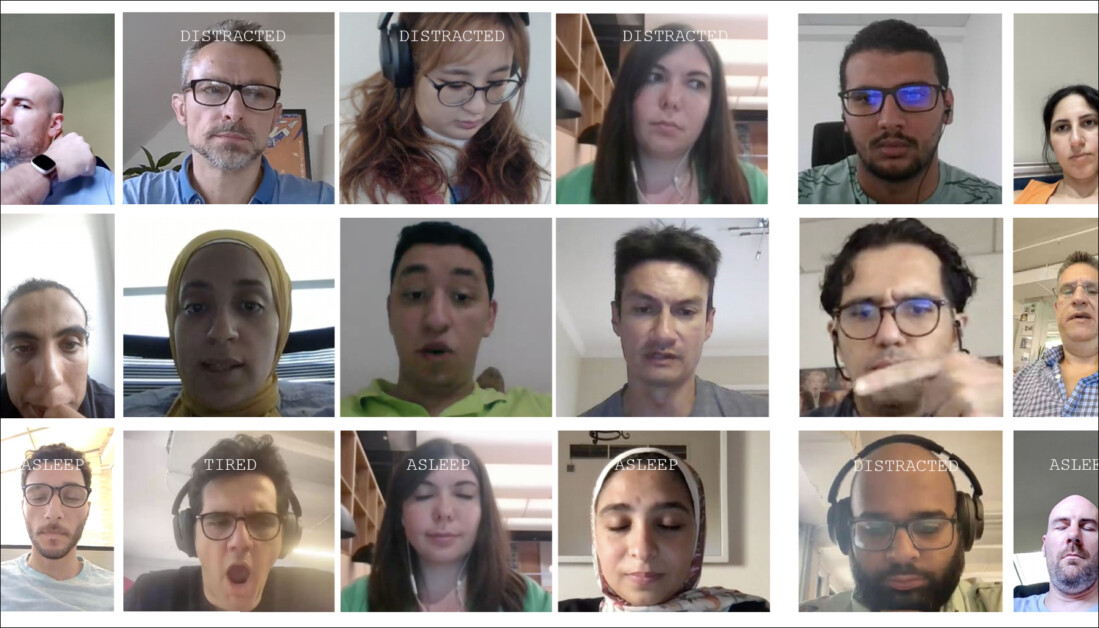

Приклади поведінки “сови” і “ящірки” в суб’єкті проекту рекламних досліджень. Джерело: https://arxiv.org/pdf/1508.04028

Якщо ви дивитеся від реклами цілком головою, це поведінка “сови”; якщо ваша поза голови статична, але ваші очі блукають від екрана, це поведінка “ящірки”. У контексті аналітики та тестування нових рекламних роликів у контрольованих умовах ці дії є важливими для того, щоб система могла їх захопити.

Нова робота від SmartEye’s Affectiva пропонує архітектуру, яка використовує кілька існуючих фреймворків для надання поєднаного та з’єднаного набору функцій по всіх необхідних умовах та можливих реакціях – і щоб можна було визначити, чи є глядач нудьгуючим, залученим або в якійсь мірі віддаленим від контенту, який рекламодавець бажає, щоб вони дивилися.

Приклади справжніх і хибних позитивів, виявлених новою системою уваги для різних сигналів відволікання, показаних окремо для настільних і мобільних пристроїв. Джерело: https://arxiv.org/pdf/2504.06237

Автори заявляють*:

‘Обмежене дослідження займалося моніторингом уваги під час онлайн-реклами. Хоча ці дослідження зосереджувалися на оцінці пози голови або напрямку погляду для визначення випадків відволікання погляду, вони ігнорують критичні параметри, такі як тип пристрою (настільний комп’ютер або мобільний), розміщення камери відносно екрана та розмір екрана. Ці фактори суттєво впливають на виявлення уваги.

‘У цій роботі ми пропонуємо архітектуру для виявлення уваги, яка охоплює виявлення різних відволікань, включаючи поведінку сови і ящірки, а також говоріння, сонливість (через зевання та тривале закриття очей) та залишення екрана без уваги.

‘На відміну від попередніх підходів, наш метод інтегрує пристроєві функції, такі як тип пристрою, розміщення камери, розмір екрана (для настільних комп’ютерів) та орієнтацію камери (для мобільних пристроїв), з грубою оцінкою погляду для підвищення точності виявлення уваги.’

Нова робота названа Моніторинг уваги глядача під час онлайн-реклами, і походить від чотирьох дослідників з Affectiva.

Метод і дані

Головним чином через секретність і закритий характер таких систем, нова робота не порівнює підхід авторів безпосередньо з конкурентами, а радше представляє свої результати виключно як дослідження з виключенням; жодна з робіт не слідує загальному формату літератури комп’ютерного зору. Тому ми розглянемо дослідження так, як воно представлено.

Автори підкреслюють, що лише обмежена кількість досліджень займалася виявленням уваги конкретно в контексті онлайн-реклами. У AFFDEX SDK, який пропонує реальний багатогранний розпізнавання обличчя, увага припускається лише з пози голови, з учасниками, позначеними як неуважні, якщо їхній кут голови перевищує певний поріг.

Приклад з AFFDEX SDK, системи Affectiva, яка покладається на позу голови як індикатор уваги. Джерело: https://www.youtube.com/watch?v=c2CWb5jHmbY

У 2019 році Автоматичний вимір візуальної уваги до відеоконтенту за допомогою глибокого навчання, набір даних з близько 28 000 учасників був анотований для різних неуважних поведінок, включаючи відволікання погляду, закриття очей або участь у неспов’язаних діяльності, і модель CNN-LSTM була навчена для виявлення уваги з вигляду обличчя за час.

З 2019 року робота, приклад, який ілюструє передбачені стани уваги для глядача, який дивиться відеоконтент. Джерело: https://www.jeffcohn.net/wp-content/uploads/2019/07/Attention-13.pdf.pdf

Однак автори спостерігають, що ці попередні зусилля не враховували пристроєві фактори, такі як те, чи використовував учасник настільний комп’ютер або мобільний пристрій; ні вони не розглядали розмір екрана чи розміщення камери. Крім того, система AFFDEX фокусується лише на виявленні відволікання погляду, і опускає інші джерела відволікання, тоді як робота 2019 року намагається виявити ширший набір поведінок – але використання одного неглибокого CNN може, як зазначено в роботі, бути недостатнім для цього завдання.

Автори спостерігають, що деякі з найбільш популярних досліджень у цьому напрямку не оптимізовані для тестування реклами, яке має інші потреби порівняно з доменами, такими як водіння або освіта – де розміщення камери та калібрування зазвичай фіксовані заздалегідь, залежать від некаліброваних налаштувань, і працюють у обмеженому діапазоні погляду настільних і мобільних пристроїв.

Отже вони розробили архітектуру для виявлення уваги глядача під час онлайн-реклами, використовуючи дві комерційні інструментальні набори: AFFDEX 2.0 і SmartEye SDK.

Приклади аналізу обличчя з AFFDEX 2.0. Джерело: https://arxiv.org/pdf/2202.12059

Ці попередні роботи витягують низькорівневі функції, зокрема вирази обличчя, позу голови та напрямок погляду. Ці функції потім обробляються для виробництва високорівневих індикаторів, включаючи позу голови на екрані; зевання; і говоріння.

Система визначає чотири типи відволікань: погляд за межами екрана; сонливість,; говоріння; і екрани, які залишаються без уваги. Вона також регулює аналіз погляду залежно від того, чи знаходиться глядач на настільному комп’ютері або мобільному пристрої.

Набори даних: Погляд

Автори використали чотири набори даних для підтримки та оцінки системи виявлення уваги: три, які зосереджувалися на поведінці погляду, говорінні та зеванні; і четвертий, який був отриманий з реальних сесій тестування реклами, що містять змішаний набір типів відволікань.

Через конкретні вимоги роботи були створені індивідуальні набори даних для кожної з цих категорій. Усі набори даних, які були зібрані, були отримані з власного репозиторію, який містить мільйони записаних сесій учасників, які дивляться рекламу в домашніх або робочих середовищах, за допомогою веб-налаштування, з інформованим згодом – і через обмеження цих угод про згоду, автори заявляють, що набори даних для нової роботи не можуть бути зроблені публічно доступними.

Для створення набору даних погляду учасникам було запропоновано слідувати за рухомою крапкою по різних точках на екрані, включаючи його краї, і потім дивитися від екрана в чотирьох напрямках (вгору, вниз, ліворуч і праворуч) з послідовністю, повтореною тричі. Таким чином, була встановлена взаємозв’язок між захопленням і покриттям:

Знімки екрана, які показують стимул відео погляду на (а) настільних і (б) мобільних пристроях. Перший і третій кадри відображають інструкції слідувати за рухомою крапкою, тоді як другий і четвертий кадри запрошують учасників дивитися від екрана.

Сегменти рухомої крапки були позначені як уважні, а сегменти за межами екрана – як неуважні, що дало позначений набір даних як позитивних, так і негативних прикладів.

Кожне відео тривало приблизно 160 секунд, з окремими версіями, створеними для настільних і мобільних платформ, кожна з роздільною здатністю 1920×1080 і 608×1080 відповідно.

Було зібрано загалом 609 відео, що складаються з 322 настільних і 287 мобільних записів. Мітки були застосовані автоматично на основі вмісту відео, а набір даних розділено на 158 навчальних зразків і 451 для тестування.

Набори даних: Говоріння

У цьому контексті одним з критеріїв, що визначає “неуважність”, є ситуація, коли людина говорить більше однієї секунди (що може бути моментальним коментарем або навіть кашлем).

Поскольку контрольоване середовище не реєструє або аналізує аудіо, говоріння припускається шляхом спостереження за внутрішнім рухом оцінених ознак обличчя. Отже, для виявлення говоріння без аудіо автори створили набір даних, заснований цілком на візуальному вводі, отриманий з їхнього внутрішнього репозиторію, і розділений на дві частини: перша частина містила приблизно 5 500 відео, кожне з яких було вручну позначено трьома анотаторами як говоріння або не говоріння (з них 4 400 були використані для навчання і валідації, а 1 100 для тестування).

Друга частина складалася з 16 000 сесій, автоматично позначених на основі типу сесії: 10 500 сесій містили учасників, які мовчазно дивилися рекламу, а 5 500 сесій показували учасників, які висловлювали свої думки про бренди.

Набори даних: Зевання

Хоча існують деякі набори даних зевання, включаючи YawDD і Driver Fatigue, автори стверджують, що жоден з них не підходить для сценаріїв тестування реклами, оскільки вони або містять симульовані зевання, або містять конторсії обличчя, які можуть бути сплутані з страхом або іншими, не-зевними діями.

Отже автори використали 735 відео з їхнього внутрішнього зібрання, вибравши сесії, які, ймовірно, містять опускання щелепи, яке триває більше однієї секунди. Кожне відео було вручну позначено трьома анотаторами як активне або неактивне зевання. Лише 2,6% кадрів містили активне зевання, підкреслюючи дисбаланс класів, і набір даних був розділений на 670 навчальних відео і 65 для тестування.

Набори даних: Відволікання

Набір даних відволікання також був отриманий з репозиторію авторів, де учасники дивилися фактичні рекламні ролики без призначених завдань. Загалом 520 сесій (193 на мобільних і 327 на настільних середовищах) були випадково вибрані та вручну позначені трьома анотаторами як уважні або неуважні.

Неуважна поведінка включала погляд за межами екрана, говоріння, сонливість і екрани, які залишаються без уваги. Сесії охоплювали різні регіони світу, з більш поширеними записами на настільних комп’ютерах через гнучке розміщення веб-камери.

Моделі уваги

Пропонована модель уваги обробляє низькорівневі візуальні функції, зокрема вирази обличчя; позу голови; і напрямок погляду – витягнуті через згадані вище AFFDEX 2.0 і SmartEye SDK.

Ці функції потім перетворюються у високорівневі індикатори, з кожним відволіканням, обробленим окремим бінарним класифікатором, навченим на власному наборі даних для незалежної оптимізації та оцінки.

Схема пропонованої системи моніторингу.

Модель погляду визначає, чи дивиться глядач на екран чи ні, використовуючи нормалізовані оцінки погляду, з окремою калібруванням для настільних і мобільних пристроїв. Цьому процесу допомагає лінійна машина опорних векторів (SVM), навчена на просторових і тимчасових функціях, яка включає вікно пам’яті для згладжування швидких зміщень погляду.

Для виявлення говоріння без аудіо система використовувала обрізані регіони рота та 3D-CNN, навчений на конверсаційних і неконверсаційних відеосегментах. Мітки були призначені на основі типу сесії, з тимчасовим згладжуванням, яке зменшує хибні позитиви, які можуть виникнути через короткі рухи рота.

Зевання виявлялося за допомогою повних обрізок обличчя, щоб захопити ширші рухи обличчя, з 3D-CNN, навченим на вручну позначених кадрах (хоча завдання було ускладнено низькою частотою зевання в природному перегляді, і його схожістю з іншими виразами).

Екран, який залишається без уваги, визначався через відсутність обличчя або екстремальної пози голови, з передбаченнями, зробленими за допомогою дерева рішень.

Остатній статус уваги визначався за допомогою фіксованого правила: якщо будь-який модуль виявив неуважність, глядач позначався як неуважний – підхід, який пріоритезує чутливість, і налаштовується окремо для настільних і мобільних контекстів.

Тести

Як згадувалося раніше, тести проводяться методом виключення, де компоненти видаляються, і спостерігається вплив на результат.

Різні категорії сприйманої неуважності, виявлені в дослідженні.

Модель погляду визначила поведінку за межами екрана через три ключових кроки: нормалізацію грубих оцінок погляду, налаштування виходу та оцінку розміру екрана для настільних пристроїв.

Для розуміння важливості кожного компоненту автори видалили їх окремо та оцінили продуктивність на 226 настільних і 225 мобільних відео, отриманих з двох наборів даних. Результати, виміряні за допомогою G-mean і F1 балів, показані нижче:

Результати, які показують продуктивність повної моделі погляду, поряд з версіями з окремими кроками обробки, видаленими.

У кожному випадку продуктивність погіршувалася, коли крок був опущений. Нормалізація довела свою особливу цінність на настільних комп’ютерах, де розміщення камери варіюється більше, ніж на мобільних пристроях.

Дослідження також оцінило, як візуальні функції передбачали орієнтацію камери на мобільному пристрої: розташування обличчя, поза голови та напрямок погляду мали оцінки 0,75, 0,74 і 0,60, тоді як їхнє поєднання досягло 0,91, підкреслюючи – як зазначають автори – перевагу інтеграції декількох сигналів.

Модель говоріння досягла ROC-AUC 0,97 на вручну позначеному тестовому наборі, і 0,96 на більшому автоматично позначеному наборі даних, вказуючи на стабільну продуктивність у обох випадках.

Модель зевання досягла ROC-AUC 96,6% за допомогою співвідношення рота лише, яке покращилося до 97,5%, коли було поєднано з передбаченнями одиниць дії з AFFDEX 2.0.

Модель екрану, який залишається без уваги, класифікувала моменти як неуважні, коли як AFFDEX 2.0, так і SmartEye не виявили обличчя протягом більш ніж однієї секунди. Для оцінки валідності цього автори вручну позначили всі такі події без обличчя в реальному наборі даних відволікання, ідентифікуючи основну причину кожної активації. Незрозумілі випадки (наприклад, блокування камери або спотворення відео) були виключені з аналізу.

Як показано в таблиці результатів нижче, лише 27% активацій “без обличчя” були спричинені користувачами, які фізично залишили екран.

Різноманітні отримані причини, чому обличчя не було знайдено, в деяких випадках.

Папера заявляє:

‘Відволікання екрану становило лише 27% випадків, які спровокували сигнал без обличчя, але воно було активовано за інші причини, які свідчать про неуважність, такі як учасники, які дивилися за межами екрана з екстремальним кутом, робили надмірні рухи або значно закривали своє обличчя об’єктом/рукою.’

У останньому з кількісних тестів автори оцінили, як прогресивне додавання різних сигналів відволікання – погляду за межами екрана (через погляд і позу голови), сонливість, говоріння і екрани, які залишаються без уваги – впливає на загальну продуктивність їхньої моделі уваги.

Тестування проводилось на двох наборах даних: реальному наборі даних відволікання і тестовому піднаборі набору даних погляду. G-mean і F1 балів були використані для вимірювання продуктивності (хоча сонливість і говоріння були виключені з аналізу набору даних погляду через їх обмежену актуальність у цьому контексті).

Як показано нижче, виявлення уваги покращувалося послідовно, коли додавалося більше типів відволікань, з поглядом за межами екрана, найбільш поширеним відволіканням, яке забезпечувало найсильніший базовий рівень.

Ефект додавання різних сигналів відволікання до архітектури.

З цих результатів папера заявляє:

‘З результатів ми можемо спочатку зробити висновок, що інтеграція всіх сигналів відволікання сприяє покращенню виявлення уваги.

‘Друга, покращення виявлення уваги є послідовним у обох настільних і мобільних пристроях. Третя, мобільні сесії в реальному наборі даних показують значні рухи голови при погляді за межами екрана, які легко виявляються, що призводить до вищої продуктивності для мобільних пристроїв порівняно з настільними комп’ютерами. Четверта, додавання сигналу сонливості має відносно незначне покращення порівняно з іншими сигналами, оскільки воно зазвичай рідко трапляється.

‘Нарешті, сигнал екрана, який залишається без уваги, має відносно більше покращення на мобільних пристроях порівняно з настільними комп’ютерами, оскільки мобільні пристрої можуть бути легко залишені без уваги.’

Автори також порівняли свою модель з AFFDEX 1.0, попередньою системою, використовуваною в тестуванні реклами – і навіть поточна модель голови, заснована на погляді, перевершує AFFDEX 1.0 на обидвох типах пристроїв:

‘Це покращення є результатом інтеграції рухів голови в обох напрямках, а також нормалізації пози голови для врахування незначних змін. Виділені рухи голови в реальному мобільному наборі даних призвели до того, що наша модель голови працює подібно до AFFDEX 1.0.’

Автори завершують паперу (можливо, досить формальним) кваліфікаційним раундом тестів, показаним нижче.

Зразкові виходи моделі уваги на настільних і мобільних пристроях, з кожним рядком, який показує приклади справжніх і хибних позитивів для різних типів відволікань.

Автори заявляють:

‘Результати показують, що наша модель ефективно виявляє різні відволікання в неконтрольованих умовах. Однак вона іноді може генерувати хибні позитиви в деяких крайніх випадках, таких як сильне нахил голови при підтримці погляду на екрані, деякі закриття рота або надмірно розмиті очі чи сильно затемнені зображення обличчя. ‘

Висновок

Хоча результати представляють виміряний, але значимий крок вперед порівняно з попередньою роботою, глибша цінність дослідження полягає в тому, що воно пропонує погляд на постійну тенденцію до доступу до внутрішнього стану глядача. Хоча дані були зібрані з згоди, методологія вказує на майбутні рамки, які можуть розширити свій вплив за межі структурованих, ринкових досліджень.

Цей дещо параноїдальний висновок ще більше підтримується ізольованим, обмеженим і ревно захищеним характером цього конкретного напрямку досліджень.

* Мій перехід цитат авторів у гіперпосилання.

Опубліковано вперше у середу, 9 квітня 2025 року