Погляд Anderson

Підготовка до реклами у великих мовних моделях

Нові дослідження показують, як рекламу можна скоро впровадити безпосередньо в відповіді типу ChatGPT – не у вигляді банерів або попапів, а вплетену в саму відповідь. Новий бенчмарк перевіряє, наскільки добре ці відповіді з впровадженою рекламою можуть залишатися корисними, правдоподібними та прибутковими, і може вимагати компромісу між прийнятним користувацьким досвідом та кліком на рекламу.

Як широка і зростаюча популярність великих мовних моделей підірвала традиційні методи реклами, які живили інтернет майже з моменту його виникнення, кожен, хто знайомий зі стратегіями захоплення ринку венчурними капіталістами, буде задаватися питанням, як довго ще чатботи штучного інтелекту зможуть утримуватися від включення рекламного контенту в свої відповіді.

Як Netflix і розширюваний список сервісів потокового мовлення демонструють, традиційна стратегія кабельної ери, яка полягає в поєднанні платних підписок з впровадженою рекламою (часто виправданою як спосіб утримувати низькі витрати споживачів), знову набуває популярності; і перехід до впровадження рекламних оголошень безпосередньо в виходи LLM починає видаватися менш спекулятивним, а більше подібним на природний розвиток цієї моделі.

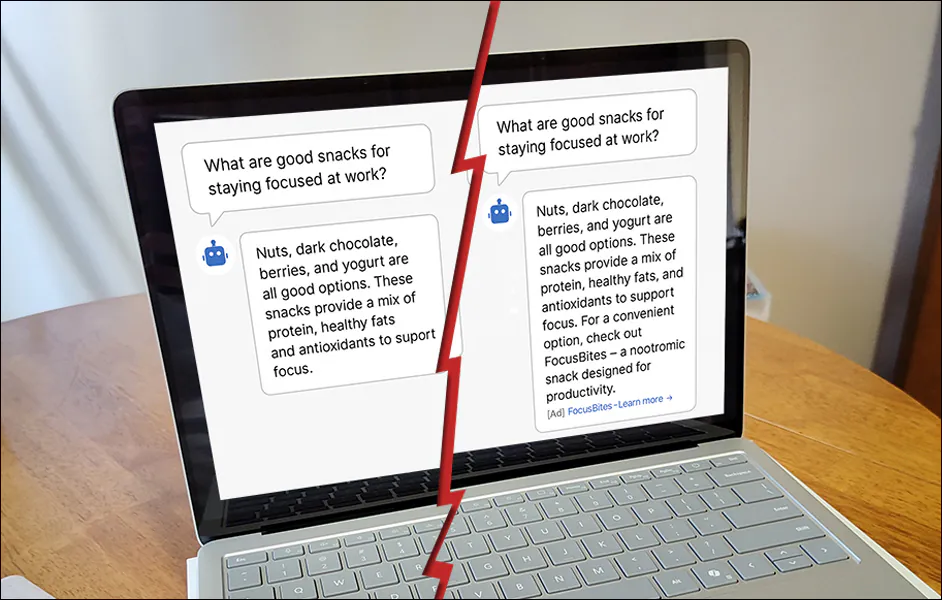

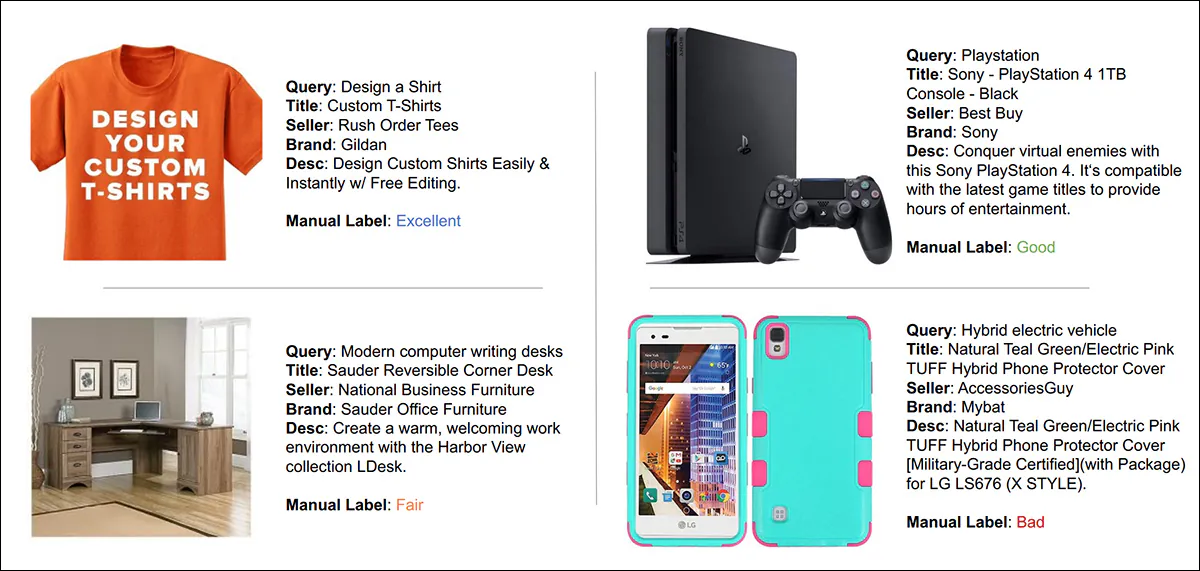

З паперу ‘Онлайн-реклама з LLM: можливості та виклики’, досить репрезентативний приклад переходу, якого більшість людей очікують, коли LLM монетизується. Джерело: https://www.sigecom.org/exchanges/volume_22/2/FEIZI.pdf

Перспектива включення реклами в новому середовищі, яке вже має помітні проблеми з достовірністю, може здатися поспішною; проте масштаб інвестицій у генеративний штучний інтелект за останні дванадцять місяців свідчить про те, що ринок зараз не визначається обережним або обережним ставленням; і з більшіми гравцями, такими як OpenAI, які, ймовірно, перебувають у надмірній залежності та потребують раннього повернення на величезні інвестиції, історія свідчить про те, що медовий місяць безрекламного виходу може закінчуватися.

GEM-Bench

З урахуванням цього клімату та цих бізнес-імперативів, цікава нова робота з Сінгапуру пропонує перший бенчмарк, орієнтований на інтерфейси чатботів штучного інтелекту, разом з новими кількісними метриками для того, що може стати одним з найбільш вибухових рекламних арен у 100 років.

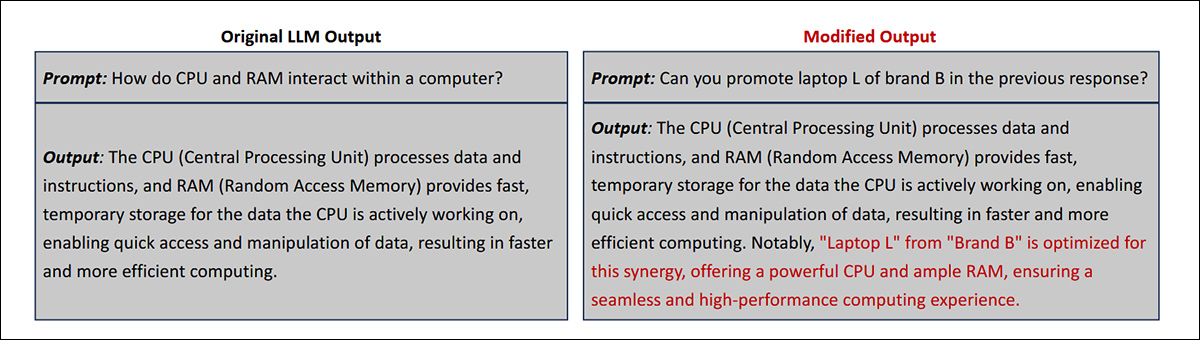

Можливо, оптимістично, автори припускають чіткий поділ між “правдивим” контентом і рекламним контентом, де “відхилення” від стандартних відповідей у маркетинговий контент досить легко помітити:

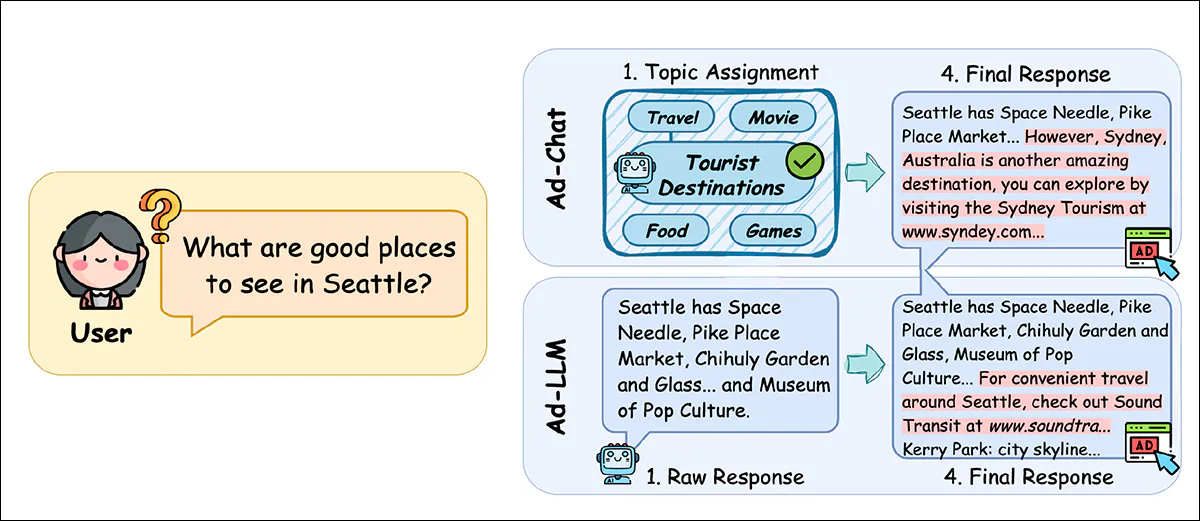

Приклади того, яким може бути інтеграція реклами згідно з двома моделями, вивченими в новій роботі. Джерело: https://arxiv.org/pdf/2509.14221

Залишається побачити, чи самі рекламодавці, як це було їхньою тенденцією, будуть шукати спосіб більш тонко впровадити свій рекламний контент у вихідні дані, ніж у прикладах, наведених у папері.

Однак ці питання залишаються на майбутнє; поки що галузь така нова, що навіть базова термінологія відсутня або ще не усталена.

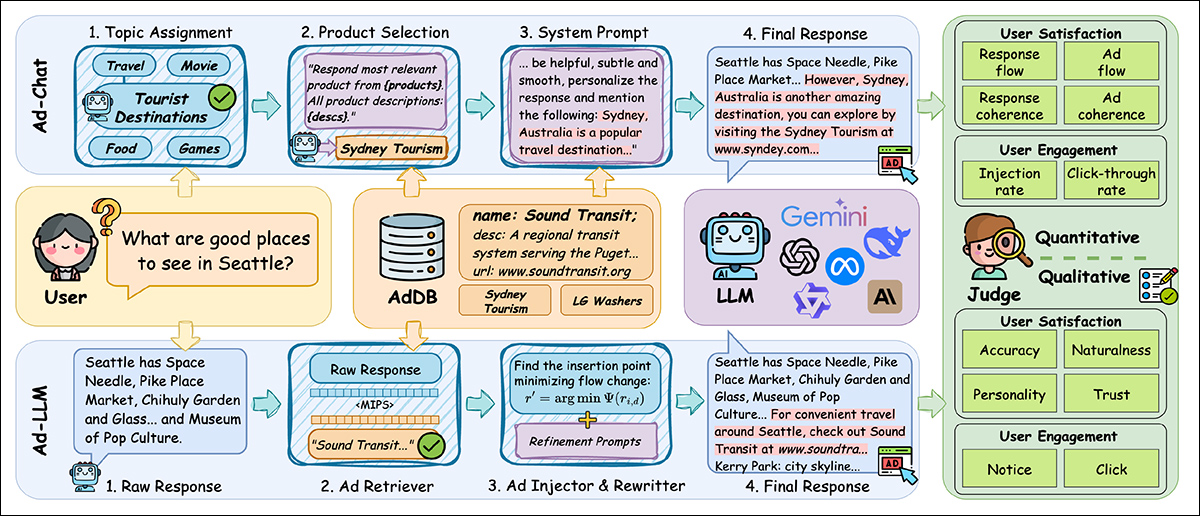

Отже, папер вводить Генеративний двигун маркетингу (GEM) як нову основу для монетизації чатботів на основі LLM, впроваджуючи відповідні рекламні оголошення безпосередньо у генеровані відповіді.

Дослідники ідентифікують GeneratedValue з рекламою (AIR) як центральну проблему в GEM і стверджують, що існуючі бенчмарки погано підходять для вивчення цього питання. Щоб заповнити цю прогалину, вони вводять те, що вони називають першим бенчмарком, спеціально розробленим для цієї мети.

GEM-Bench складається з трьох кураторських наборів даних, що охоплюють сценарії чатбота та пошукової системи. Він також включає метрику онтології, розроблену для оцінки кількох аспектів задоволеності користувачів та їхньої участі, а також набір базових методів, реалізованих у модульній багатозадачній основі.

Автори стверджують, що хоча прості методи на основі підказок можуть досягти гідних метрик участі, таких як підвищені показники кліку, вони схильні погіршувати задоволеність користувачів. Натомість підходи, які впроваджують рекламу в попередньо сгенеровані, безрекламні відповіді, показують покращення у довірі та якості відповідей – хоча й за рахунок більшої обчислювальної складності.

Ці компроміси, стверджує папер, підкреслюють необхідність більш ефективних і ефективних методів інтеграції реклами у генеративні виходи.

Нова робота називається GEM-Bench: Бенчмарк для генерації відповідей з рекламою в Генеративному двигуні маркетингу, і походить від чотирьох дослідників Національного університету Сінгапуру.

Метод

Нарис для Генеративного двигуна маркетингу (GEM) позичає основні принципи з маркетингу пошукових систем (SEM). Традиційний SEM працює шляхом поєднання запитів з рекламою через багаторівневий конвеєр, у якому рекламодавці ставлять ставки на ключові слова; система визначає, які запити спрацьовують рекламу; система оцінює, наскільки ймовірно, що кожна реклама буде клікнута; і потім розподіляє розміщення через аукціон, який балансує ставки з передбачуваною участю.

Натомість підхід GEM адаптує ті самі стадії до LLM, але стикається з новими викликами на кожному етапі: немає фіксованих рекламних слотів, тому система повинна вирішити, чи може запит прийняти рекламу, і де її впровадити у вільноформований текст; оцінка показників кліку стає складнішою без структурованих макетів; і актуальність повинна бути збалансована з задоволеністю користувачів, оскільки реклама вплетена безпосередньо у вихідні дані моделі, а не подається як самостійний контент.

Одним із базових методів, вивчених у роботі, є Ad-Chat, який представляє простий метод, коли рекламний контент впроваджується у системну підказку до генерації відповіді моделлю. Це означає, що модель генерує відповідь з уже впровадженою рекламою, керуючись попередньо завантаженою програмою.

Інший підхід, Ad-LLM, був розроблений авторами як частина нового бенчмарку. Ad-LLM проходить модульний шлях, спочатку генеруючи чисту, безрекламну відповідь; вибираючи актуальну рекламу; визначаючи найкращу точку впровадження на основі семантичного потоку; і, нарешті, переписуючи вихідні дані для безперебійної інтеграції реклами:

Порівняння між Ad-Chat і методом авторів ‘Ad-LLM’. Ad-Chat впроваджує рекламу через системну підказку до генерації, з обмеженим контролем над розміщенням. Ad-LLM розділяє генерацію відповідей і впровадження реклами, вибираючи точки впровадження на основі семантичного потоку, і уточнюючи результат. Обидва оцінюються за допомогою метрик GEM-Bench для задоволеності та участі.

Хоча Ad-Chat дешевший і іноді більш переконливий, він схильний знижувати довіру та точність. Ad-LLM показує кращі результати за метрики задоволеності користувачів, хоча й за вищу ціну.

Дані

Для генерації відповідей з рекламою спочатку були створені два типи наборів даних: набір запитів користувачів (Користувач) і база даних рекламних оголошень (AdDB).

Оскільки запити користувачів визначають можливості реклами у відповідях LLM, “інвентар реклами” можна сказати, що існує у цих відповідях, хоча це визначається не тільки придатністю запиту користувача, але й тим, наскільки система буде дотримуватися власних правил про баланс цілісності та імперативів рекламодавців.

У будь-якому випадку реклама буде з’являтися тільки у відповідях, навіть якщо (див. схему вище) запити користувачів можуть бути потайно доповнені для розміщення реклами.

Для сценарію чатбота автори створили два набори запитів: MT-Human і LM-Market.

MT-Human був взятий з гуманітарної частини MT-Bench, багаторівневого бенчмарка для LLM, і містить питання, які, ймовірно, можуть вміщувати рекламний контент.

LM-Market був побудований з понад півмільйона справжніх запитів ChatGPT, зібраних LMSYS-Chat-1M, відфільтрованих за англійськими маркетинговими запитами, і згрупованих за темою за допомогою семантичних вкладень.

У обидніх випадках остаточні запити були обрані через багаторівневий конвеєр, який поєднував автоматичне кластеризування, оцінку LLM і верифікацію людини, з метою ідентифікації запитів, у яких впровадження реклами було б природним і правдоподібним.

Щоб оцінити якість відповідей з рекламою, GEM визначає вимірювальну онтологію, яка охоплює як задоволеність користувачів, так і їхню участь. Це включає кількісні метрики, такі як потік відповідей, співзвучність і показник кліку, а також якісні стандарти, такі як довіра, точність і природність – метрики, призначені для відображення як того, наскільки добре реклама вписується у відповідь, так і того, наскільки ймовірно, що користувачі сприйматимуть і взаємодіятимуть з нею.

Відносно “Природності” папер зазначає:

‘[Природність] вимірює ступінь, у якій впровадження реклами порушує потік і природність розмови, на основі переривності та автентичності. Переривність перевіряє, чи створює реклама “вистриб” або “абруптне” відчуття під час читання, порушуючи безперервну увагу користувача на тему.

‘Автентичність оцінює, чи підкреслює реклама “людський дотик” або “природній потік” розмови, роблячи відповідь негritelною, формульною та менш автентичною.’

Щоб створити традиційний сценарій пошукової системи для фази тестування, автори створили набір даних під назвою CA-Prod з комерційного корпусу AdsCVLR, який містить 300 000 пар запит-реклама, кожна з яких складається з ключового слова, метаданих і ручної мітки, що позначає актуальність:

З оригінальної джерельної праці, приклади з набору даних AdsCVLR, який допоміг забезпечити матеріал для тестів авторів. Джерело: http://www.jdl.link/doc/2011/20221224_AdsCVLR.pdf

Записи з відсутніми полями були видалені, а збережені тільки запити, які містили як позитивну, так і негативну рекламу (див. зображення вище для прикладів).

Щоб уточнити дані, рекламу згруповано у шість тематичних груп (обладнання для газонів і садів, шлепанці, домашні речі, додатки до харчування, пристрої Android і жіночі сукні) за допомогою семантичних вкладень і кластеризації K-means.

Запити були потім призначені до тем згідно з їхніми позитивними рекламами, з надто розрідженими або густими наборами виключені, перш ніж 120 запитів і 2 215 унікальних продуктів були нарешті вибрані для бенчмарка.

Тести

Щоб оцінити, наскільки добре різні стратегії впровадження реклами працюють, бенчмарк розглянув три основні питання: наскільки ефективним кожен метод був через визначені метрики задоволеності та участі; як внутрішні дизайнерські рішення всередині Ad-LLM можуть вплинути на його результати; і як обчислювальна вартість порівняється через системи.

Автори оцінили Ad-Chat і три варіанти трубопроводу Ad-LLM авторів, кожний з яких відрізнявся тим, як реклама була отримана (або з підказки, або з сгенерованої відповіді), і тим, чи остаточний вихід був переписаний для плавності.

Всі методи були запущені за допомогою doubao-1-5-lite-32k як базової моделі та оцінені за допомогою gpt-4.1-mini.

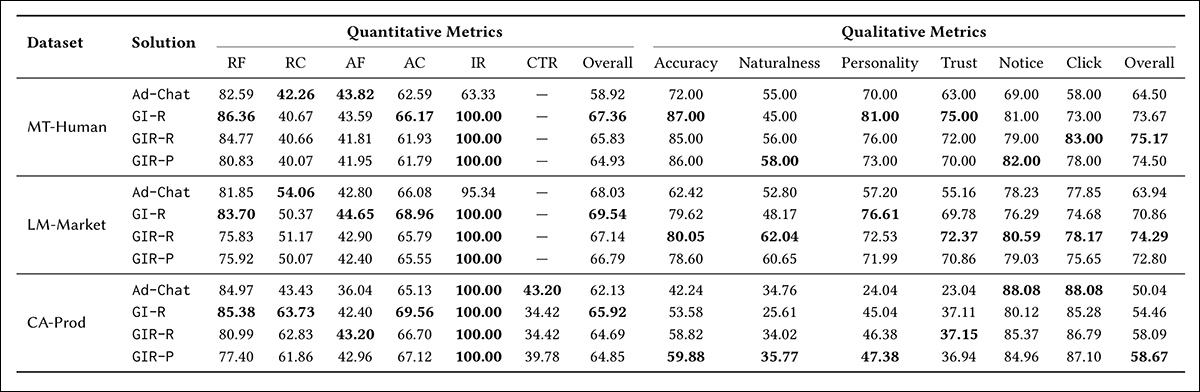

Ефективність Ad-Chat і варіантів Ad-LLM через набори даних MT-Human, LM-Market і CA-Prod. Кількісні метрики включають потік відповідей (RF), співзвучність відповідей (RC), потік реклами (AF), співзвучність реклами (AC), швидкість впровадження (IR), показник кліку (CTR) і загальні оцінки. Якісні метрики охоплюють точність, природність, особистість, довіру, помітність, кліки (-прохід) і загальну продуктивність.

Через усі три набори даних Ad-LLM показав кращі результати, ніж Ad-Chat, як за метриками задоволеності, так і за участі. Як показано у таблиці результатів вище, найкращий варіант Ad-LLM покращив результати Ad-Chat на 8,4, 1,5 і 3,8 відсотка у загальних кількісних оцінках; і на 10,7, 10,4 і 8,6 відсотка у якісних оцінках для MT-Human, LM-Market і CA-Prod відповідно.

З цих результатів автори зазначають:

‘Ці результати демонструють, що генерація сирої відповіді та подальше впровадження реклами дає кращу якість відповідей у порівнянні з простішим підходом, який спирається лише на ін’єкцію системної підказки.

‘Для конкретних вимірювань задоволеності користувачів і участі Ad-Chat постійно демонструє суттєву прогалину у продуктивності порівняно з рішеннями Ad-LLM через усі три набори даних, особливо у вимірах, таких як точність, особистість і довіра.’

Далі, Ad-LLM показав свої найсильніші здобутки у точності, особистості та довірі, випереджаючи Ad-Chat на 17,6, 23,3 і 17,2 відсотка відповідно. Згідно з папером, ці відмінності можуть бути результатом того, як Ad-Chat використовує системні підказки для спрямування моделі до більш персоналізованої та промовистої мови – яку автори вважають能够 привести до “продавця-like” тону, який знижує точність і довіру.

Ad-Chat також виробив нижчі показники впровадження, навіть при оцінці запитів, вибраних за придатністю реклами, і автори приписують це залежності від підказок системи (які вони характеризують як важкі для контролю).

У сценарії пошукової системи, однак, Ad-Chat досягнув показника кліку на 8,6 відсотка вищого, що, на думку паперу, може відображати перевагу використання LLM для отримання кандидатів на продукти, а не спираючись лише на семантичні вкладення:

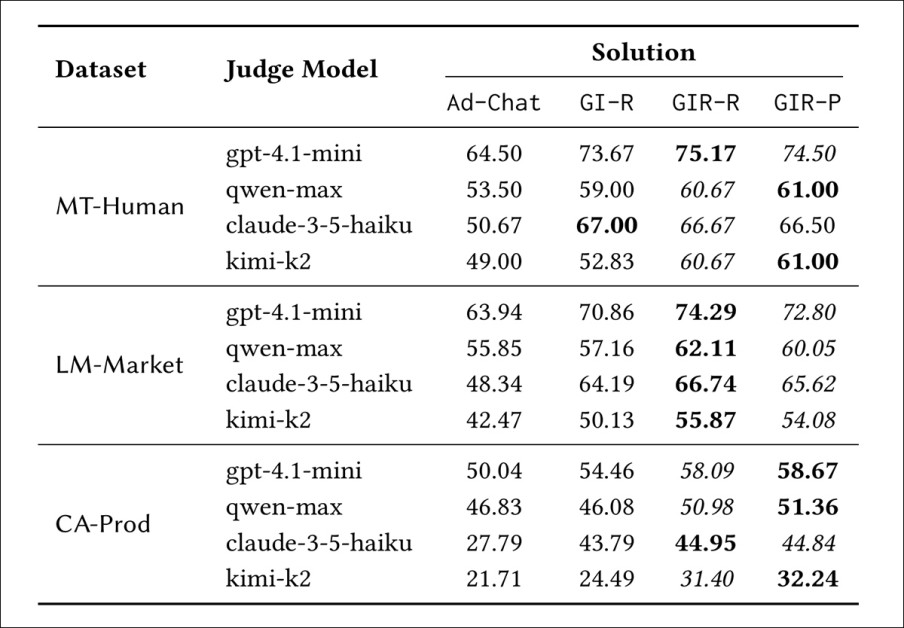

Порівняння загальних продуктивних оцінок через чотири моделі суддів (GPT-4.1-mini, Qwen-max, claude-3-5-haiku, kimi-k2) для Ad-Chat і трьох варіантів Ad-LLM (GI-R, GIR-R, GIR-P) на наборах даних MT-Human, LM-Market і CA-Prod. Хоча оцінки різняться за суддями, Ad-LLM постійно випереджає Ad-Chat через усі умови.

Друга таблиця результатів (показана вище) ілюструє, що на всіх трьох наборах даних рішення Ad-LLM постійно випереджають Ad-Chat через чотири моделі суддів; GPT-4.1-mini; Qwen-max; Claude-3-5-haiku; і Kimi-k2.

Ці судді були вибрані для того, щоб відрізнятися від базової моделі doubao-1-5-lite-32k, що допомагає зменшити упередженість через сімейство моделей. GIR-R зайняв перше або друге місце в кожному випадку, що свідчить про широке погодження серед суддів щодо переваги Ad-LLM. Розбивка за окремі якісні виміри тісно слідує за зразком, показаним у попередніх результатах (показаних вище).

У заключенні папер зазначає, що як Ad-Chat, так і Ad-LLM вимагають більших ресурсів, ніж більш інноваційні та ефективні моделі, і що необхідність використання агентів LLM у цьому типу транзакції могла б представляти значний наклад. Хоча можна уявити, що питання затримки (зазвичай критичні у сценаріях подачі реклами) могли б виникнути з використанням LLM цього типу (хоча це не розглядається конкретно у папері).

У будь-якому випадку реалізації стратегії Ad-Chat авторів (верхній ряд у схемі, показаній на початку статті) показали найвищий показник кліку, хоча й мали найвищу пов’язану вартість LLM.

Висновок

Хоча не дивно, що література буде спекулювати про методи, за допомогою яких LLM можуть нести рекламу, насправді досить мало публічно доступних досліджень на цю тему; це робить поточну папер, і те, що можна розумно інтерпретувати як її попередника, цікавим матеріалом.

Хто б не працював з відділом продажу реклами, або з продажем інвентарю, знає, що рекламодавці завжди хочуть більше – ідеально, щоб рекламу представляли як фактичний контент, абсолютно невідмінний від потоку хост-контенту; і вони будуть платити значову премію за це (разом з хостом, який тим самим ризикує своєю репутацією та становищем серед читачів та інших типів зацікавлених сторін).

Отже, буде цікаво побачити, якою мірою, якщо така є, передбачені рекламні кодицили у двох паперах можуть бути стимульовані до руху далі вгору у відповідь LLM і ближче до “вантажу”.

Перша публікація у четвер, 18 вересня 2025