ปัญญาประดิษฐ์

คาร์เทลของชุดข้อมูลที่มีอิทธิพลกำลังครอบงำการวิจัย Machine Learning การศึกษาใหม่แนะนำ

วิจัยใหม่จากมหาวิทยาลัยแคลิฟอร์เนียและ Google Research พบว่าชุดข้อมูล Machine Learning ‘มาตรฐาน’ จำนวนไม่มาก ซึ่งส่วนใหญ่มาจากสถาบันตะวันตกที่มีอิทธิพล และบ่อยครั้งมาจากองค์กรของรัฐบาล กำลังครอบงำภาคการวิจัย AI มากขึ้น

นักวิจัยสรุปว่าแนวโน้มที่ ‘ตั้ง mặc định’ ไปยังชุดข้อมูลโอเพ่นซอร์สที่มีชื่อเสียง เช่น ImageNet ทำให้เกิดปัญหาหลายประการ ทั้งด้านปฏิบัติ ด้านจริยธรรม และด้านการเมือง

จากผลการวิจัยซึ่งอาศัยข้อมูลหลักจากโครงการ Papers With Code (PWC) ของ Facebook นักวิจัยยืนยันว่า ‘ชุดข้อมูลที่ใช้กันอย่างกว้างขวางถูกนำเสนอโดยเพียงไม่กี่สถาบันที่มีอำนาจ’ และการ ‘รวมกลุ่ม’ นี้เพิ่มขึ้นถึง 80% ในช่วงไม่กี่ปีที่ผ่านมา

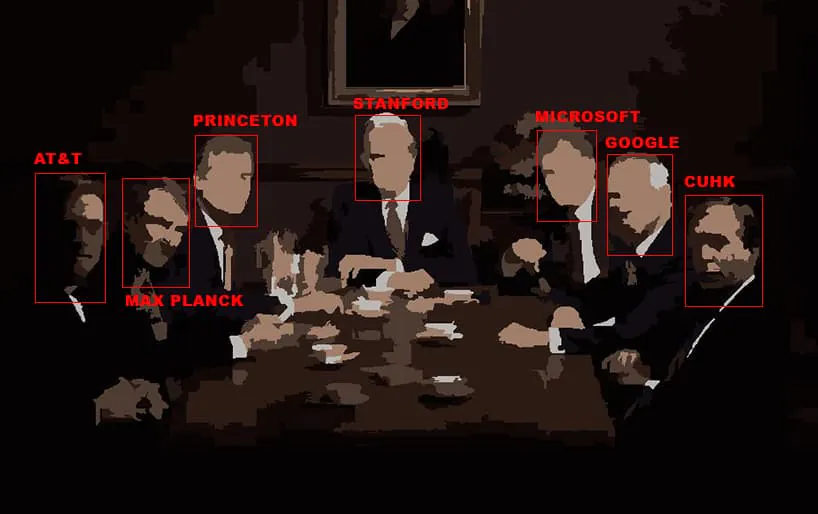

‘[เรา] พบว่ามีความไม่เท่าเทียมกันในการใช้ชุดข้อมูลทั่วโลก และว่ามากกว่า 50% ของการใช้ชุดข้อมูลทั้งหมดในตัวอย่างของเรา 43,140 ชุดข้อมูล สอดคล้องกับชุดข้อมูลที่นำเสนอโดย 12 สถาบันที่มีอำนาจเป็นหลัก ซึ่งส่วนใหญ่เป็นสถาบันตะวันตก’

แผนที่การใช้ชุดข้อมูลที่ไม่เฉพาะเจาะจงในการทำงานในช่วงสิบปีที่ผ่านมา Source: https://arxiv.org/pdf/2112.01716.pdf

สถาบันที่มีอำนาจรวมถึง Stanford University, Microsoft, Princeton, Facebook, Google, Max Planck Institute และ AT&T สี่ใน十อันดับแรกของแหล่งชุดข้อมูลเป็นสถาบันองค์กร

วิจัยนี้ยังอธิบายถึงการใช้ชุดข้อมูลที่มีอำนาจที่เพิ่มขึ้นเป็น ‘ phương tiệnของความไม่เท่าเทียมกันในวิทยาศาสตร์’ เนื่องจากทีมวิจัยที่ต้องการการยอมรับจากชุมชนมีแรงจูงใจที่จะบรรลุผลลัพธ์ที่ดีที่สุด (SOTA) กับชุดข้อมูลที่สอดคล้องกันมากกว่าที่จะสร้างชุดข้อมูลดั้งเดิมที่ไม่มีฐานะและต้องการให้เพื่อนร่วมงานปรับตัวเข้ากับมาตรการใหม่ๆ

ในกรณีอื่น ตามที่วิจัยยอมรับ การสร้างชุดข้อมูลของตนเองเป็นการแสวงหาที่มีค่าใช้จ่ายสูงเกินไปสำหรับสถาบันและทีมที่มีทรัพยากรไม่เพียงพอ

‘การ prima facie ความถูกต้องทางวิทยาศาสตร์ที่ได้รับจาก SOTA benchmarking ถูกผสมผสานกับ ความน่าเชื่อถือทางสังคมที่นักวิจัยได้รับจากการแสดงให้เห็นว่าพวกเขาสามารถแข่งขันกับชุดข้อมูลที่ได้รับการยอมรับอย่างกว้างขวาง แม้ว่าชุดข้อมูลที่เหมาะสมกับบริบทมากกว่าอาจเป็นมาตรฐานที่เหมาะสมกว่าก็ตาม

‘เราเสนอว่าพลวัตเหล่านี้สร้าง “ผลกระทบของแมทธิว” (เช่น “คนรวยจะรวยขึ้น และคนจนจะยิ่งจนลง”) โดยที่ผลลัพธ์ที่ประสบความสำเร็จ และสถาบันที่มีอำนาจที่นำเสนอผลลัพธ์เหล่านั้น จะได้รับการยอมรับในระดับสูงในวงการ’

<vijjค้นคว้าpaper มีชื่อเรื่องว่า Reduced, Reused and Recycled: The Life of a Dataset in Machine Learning Research และมาจาก Bernard Koch และ Jacob G. Foster ที่ UCLA และ Emily Denton และ Alex Hanna ที่ Google Research

งานนี้ชี้ให้เห็นถึงปัญหาหลายประการเกี่ยวกับแนวโน้มที่เพิ่มขึ้นของการรวมกลุ่มที่มันบันทึก และได้รับการตอบรับที่ดีจาก Open Review ผู้รีวิวจาก NeurIPS 2021 แสดงความคิดเห็นว่างานนี้ ‘มีความเกี่ยวข้องอย่างมากต่อทุกคนที่เกี่ยวข้องกับการวิจัย Machine Learning’

จากความจำเป็นไปสู่การคอร์รัปต์

นักวิจัยชี้ว่าวัฒนธรรม ‘beat-the-benchmark’ ที่มีอยู่ในปัจจุบันเกิดขึ้นเพื่อแก้ปัญหาการขาดเครื่องมือประเมินผลที่เป็นกลาง ซึ่งเป็นสาเหตุของการล่มสลายของความสนใจและการลงทุนใน AI ครั้งที่สอง เมื่อสามสิบปีที่แล้ว หลังจากการลดลงของความกระตือรือร้นของธุรกิจต่อการวิจัยใหม่ใน ‘Expert Systems’:

‘มาตรฐานโดยทั่วไปจะกำหนดงานโดยเฉพาะผ่านชุดข้อมูลและมาตรการประเมินที่เกี่ยวข้อง การปฏิบัตินี้ถูกนำมาใช้กับการวิจัย Machine Learning หลังจาก “AI Winter” ของทศวรรษ 1980 โดยผู้ให้ทุนของรัฐบาลที่ต้องการประเมินมูลค่าที่ได้รับจากเงินทุนอย่างแม่นยำ’

วิจัยนี้ยังแย้งว่าข้อดีเบื้องต้นของวัฒนธรรมที่ไม่เป็นทางการนี้ (การลดข้อจำกัดในการเข้าร่วม การวัดที่สอดคล้องกัน และโอกาสในการพัฒนาที่คล่องตัว) เริ่มถูกชดเชยด้วยข้อเสียที่เกิดขึ้นเมื่อชุดข้อมูลใดชุดหนึ่งมีอำนาจมากจนสามารถกำหนด ‘เงื่อนไขการใช้งาน’ และอิทธิพลของมัน

นักวิจัยเสนอว่าตามที่คิดเห็นในอุตสาหกรรมและวิชาการหลายๆ เรื่องเกี่ยวกับเรื่องนี้ ชุมชนการวิจัยไม่ได้เสนอปัญหาใหม่ๆ หากปัญหาเหล่านั้นไม่สามารถแก้ไขได้ด้วยชุดข้อมูลมาตรฐานที่มีอยู่

พวกเขายังชี้ว่าการยึดมั่นอย่างอ่อนแอกับชุดข้อมูล ‘มาตรฐาน’ เหล่านี้ส่งเสริมให้นักวิจัยบรรลุผลลัพธ์ที่ ‘overfitted’ (เช่น ผลลัพธ์ที่เฉพาะเจาะจงสำหรับชุดข้อมูลและไม่น่าจะทำงานได้ดีในโลกแห่งความเป็นจริง หรือในชุดข้อมูลใหม่หรือดั้งเดิม)

‘เมื่อพิจารณาจากการรวมกลุ่มของการวิจัยบนชุดข้อมูลมาตรฐานที่มีจำนวนน้อย เราเชื่อว่าการกระจายรูปแบบการประเมินคือสิ่งสำคัญเพื่อหลีกเลี่ยงการ overfitting กับชุดข้อมูลที่มีอยู่และบิดเบือนความก้าวหน้าในวงการ’

อิทธิพลของรัฐบาลในการวิจัย Computer Vision

ตามวิจัย การวิจัย Computer Vision ได้รับผลกระทบจากอาการที่อธิบายมากกว่าภาคอื่นๆ โดยนักวิจัยชี้ว่าการวิจัย Natural Language Processing (NLP) ไม่ได้รับผลกระทบมากนัก นักวิจัยเสนอว่าสิ่งนี้อาจเป็นเพราะชุมชน NLP ‘มีความสอดคล้อง’ และใหญ่กว่า และชุดข้อมูล NLP มีความเข้าถึงได้ง่ายและง่ายต่อการดูแล รวมทั้งเล็กและใช้ทรัพยากรในการรวบรวมข้อมูลน้อยกว่า

ใน Computer Vision และโดยเฉพาะอย่างยิ่งในการจดจำใบหน้า (FR) นักวิจัยแย้งว่าผลประโยชน์ขององค์กร รัฐ และเอกชนมักจะปะทะกัน:

‘องค์กรและรัฐบาลมีวัตถุประสงค์ที่อาจขัดแย้งกับความเป็นส่วนตัว (เช่น การเฝ้าระวัง) และการชั่งน้ำหนักของลำดับความสำคัญเหล่านี้มีแนวโน้มที่จะแตกต่างจากที่นักวิชาการหรือผู้มีส่วนได้ส่วนเสียของ AI โดยทั่วไป’

สำหรับการจดจำใบหน้า นักวิจัยพบว่าจำนวนชุดข้อมูลที่เป็นเอกภาพลดลงอย่างมากเมื่อเทียบกับค่าเฉลี่ย:

‘[สี่] ในแปดชุดข้อมูล (33.69% ของการใช้ทั้งหมด) ได้รับการสนับสนุนโดยองค์กรเอกชน กองทัพสหรัฐ หรือรัฐบาลจีน (MS-Celeb-1M, CASIA-Webface, IJB-A, VggFace2) MS-Celeb-1M ถูกถอนออกเนื่องจากข้อขัดแย้งเกี่ยวกับคุณค่าของความเป็นส่วนตัวสำหรับผู้มีส่วนได้ส่วนเสียต่างๆ’

ในกราฟด้านบน ตามที่นักวิจัยชี้ นอกจากนี้เรายังเห็นว่าสาขา Image Generation (หรือ Image Synthesis) ที่ค่อนข้างใหม่นี้พึ่งพาชุดข้อมูลที่มีอยู่แล้วซึ่งเก่ากว่าและไม่ได้ถูกออกแบบมาเพื่อใช้ในวัตถุประสงค์นี้

วิจัยนี้สังเกตเห็นแนวโน้มที่เพิ่มขึ้นของ ‘การย้ายถิ่น’ ของชุดข้อมูลออกจากวัตถุประสงค์ที่ตั้งใจไว้ ทำให้เกิดคำถามเกี่ยวกับความเหมาะสมของชุดข้อมูลเหล่านี้สำหรับความต้องการของสาขาวิจัยใหม่ๆ และระดับที่ข้อจำกัดด้านงบประมาณอาจ ‘ทำให้ความตั้งใจของนักวิจัยแคบลง’ ในกรอบที่ชุดข้อมูลที่มีอยู่และวัฒนธรรมที่มุ่งเน้นไปที่การให้คะแนนมาตรฐานปีละ

‘ผลการวิจัยของเราแสดงให้เห็นว่าชุดข้อมูลมีการย้ายระหว่างชุมชนงานต่างๆ ในระดับที่สุดขั้ว ชุดข้อมูลมาตรฐานส่วนใหญ่ที่ใช้ในบางชุมชนงานถูกสร้างขึ้นสำหรับงานอื่นๆ’

เกี่ยวกับบุคคลสำคัญใน Machine Learning (รวมทั้ง Andrew Ng) ที่ได้เรียกร้องให้มีความหลากหลายและคัดเลือกชุดข้อมูลมากขึ้นในช่วงไม่กี่ปีที่ผ่านมา นักวิจัยสนับสนุนความคิดเห็นนี้ แต่เชื่อว่าความพยายามประเภทนี้ แม้ว่าจะประสบความสำเร็จ ก็อาจถูกบ่อนทำลายโดยวัฒนธรรมที่มีอยู่ที่พึ่งพาผลลัพธ์ SOTA และชุดข้อมูลที่กำหนดไว้แล้ว:

‘การวิจัยของเราแสดงให้เห็นว่าการเรียกร้องให้นักวิจัย Machine Learning พัฒนาชุดข้อมูลมากขึ้น และการเปลี่ยนแปลงโครงสร้างการให้แรงจูงใจเพื่อให้คุณค่าและรางวัลแก่การสร้างชุดข้อมูล อาจไม่เพียงพอที่จะกระจายการใช้ชุดข้อมูลและความเห็นที่กำหนดวาระการวิจัย Machine Learning ในที่สุด’

‘นอกเหนือจากการกระตุ้นให้พัฒนาชุดข้อมูล เราเสนอแนะมาตรการนโยบายที่ให้ความสำคัญกับความเท่าเทียม โดยจัดสรรเงินทุนอย่างมีนัยสำคัญให้กับบุคคลในสถานศึกษาที่มีทรัพยากรไม่เพียงพอ เพื่อสร้างชุดข้อมูลที่มีคุณภาพสูง ซึ่งจะกระจายชุดข้อมูลมาตรฐานที่ใช้ในการประเมินวิธีการ Machine Learning ในมุมมองทางสังคมและวัฒนธรรม’