Andersons vinkel

Fördelarna med att bli fet genom AI

En ny AI-system kan realistiskt omforma människors kroppar i foton, göra dem fetare, smalare eller mer muskulösa, utan att ändra deras ansikte, kläder eller bakgrund. Systemet är tränat på en fullständigt syntetisk dataset som visar varje identitet över flera kroppstyper.

Förutom den alltmer vanliga användningen av AI som en metod för att förfinare kroppens form på sociala nätverk, eller (potentiellt) för att ändra kroppstyper för VFX-ändamål, kan användningen av maskinlärande för att ändra utseendet på individer tjäna ett viktigare syfte: att hjälpa individer med ätstörningar att förstå sin egen dysmorfa tolkning av sitt utseende, samt erbjuda ett potentiellt motivationsverktyg för allmänna idrotts- och fitnessändamål:

Från papperet ‘Body size estimation in women with anorexia nervosa and healthy controls using 3D avatars’, ett GUI för att visualisera kroppsförändringar. Individer med kroppsdysmorfism kan ha svårt att associera en realistisk tolkning av sin kropp med en liknande bild, vilket ger kliniker en metric för dysmorfa svar, bland annat. Källa: https://www.nature.com/articles/s41598-017-15339-z.pdf

Dessutom har den mycket eftertraktade modeprövning underströmmen inom datorseende forskning också ett intresse för att tillhandahålla precisa visualiseringar över ett urval av kroppstyper. Medan ramverk som den 2024 DiffBody erbjudandet från Japans universitet i Tsukuba, har skapat några ögonblickliga funktioner inom detta område:

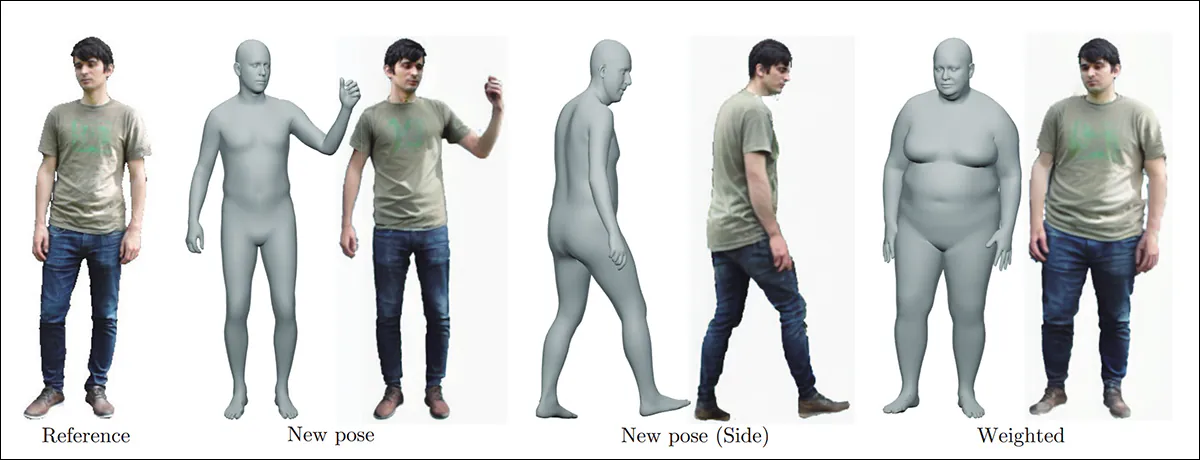

Några av transformationerna som är möjliga med den tidigare DiffBody-tekniken. Källa: https://arxiv.org/pdf/2401.02804

Eftersom AI-grundmodellerna är optimerade för konventionellt attraktiva eller andra vanliga kroppstyper, är ovanliga storlekar som ‘fet’ antingen minimalt tillgängliga i standardmodellerna, eller också kommer med några straffande fördomar.

Par Nödvändigheter

En av de största utmaningarna i att skapa AI-system som kan realistiskt lägga till eller subtrahera fett och muskler från bilder av individer – utan att ändra deras identitet, miljöer eller kläder – är att detta innebär parat träning, där AI-systemet effektivt lär ‘före’ och ‘efter’ bilder som definierar vilken transformation modellen är avsedd att utföra.

Denna typ av träning har kommit tillbaka i rampljuset under sommaren på grund av framgången med Black Forest Labs’ Kontext serie av bildredigeringsmodeller, där denna typ av pardata användes för att lära en rad transformationer till modellerna:

Från Flux Kontext-webbplatsen, ett exempel på en transformation som reflekterar den typ av källdata som behövs för att träna en modell som kan behålla bildintegritet när stora förändringar införs. Källa: https://bfl.ai/models/flux-kontext

Tydligt, i fallet med att utveckla en modell som kan betydligt ändra utseendet på en person (utan att omforma hela bilden), behöver man något som är helt omöjligt i den verkliga världen: radikala ‘före’ och ‘efter’ bilder tagna bara sekunder isär.

Den enda utvägen är syntetisk data. Några projekt av denna typ har använt individuella, höginsats kontrastiva par skapade manuellt i Photoshop; dock är detta orealistiskt i stor skala, och en automatiserad eller semi-automatiserad, AI-driven process för att generera paren anses nu alltmer vara att föredra.

Problemet med GAN-baserade och de flesta SMPL/X-baserade tillvägagångssätten (där en virtuell CGI-figur används som en sorts utbytesmekanism mellan riktiga bilder och önskade transformationer), och med tillvägagångssätt som använder bildvävning, är att bakgrunden och identiteten tenderar att lida i processen.

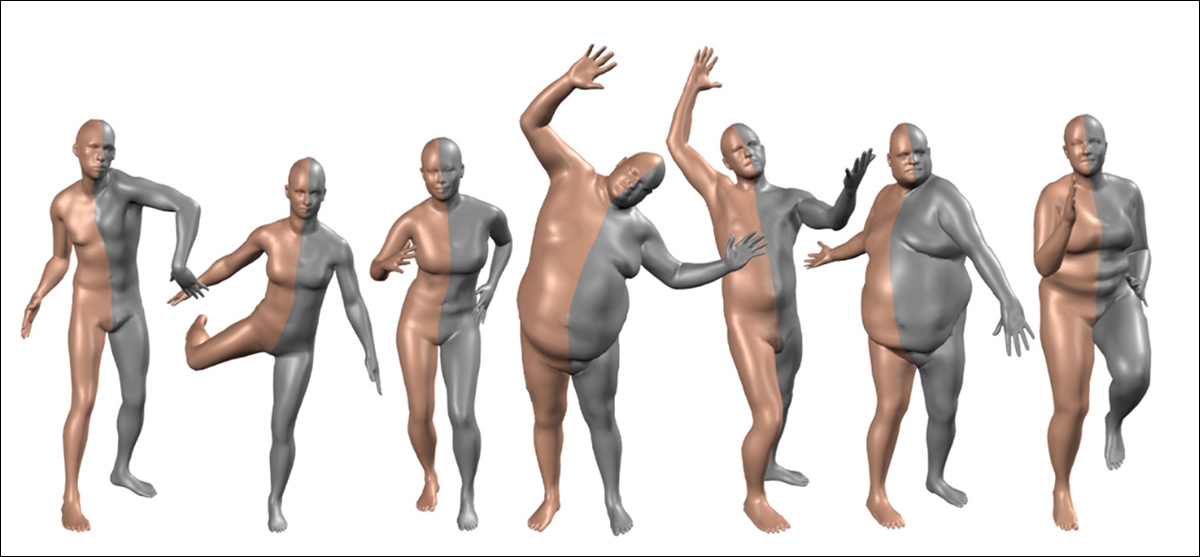

Parametriska, vektorbaserade CGI-modeller som SMPL och SMPL-X (bland andra), tillhandahåller definierade konventionella fysiska 3D-koordinater som kan tolkas och införlivas i datorseende-ramverk. Källa: https://files.is.tue.mpg.de/black/papers/SMPL2015.pdf

Eftersom det är viktigt att AI lär sig att ändra endast de önskade aspekterna, istället för att lära sig att förvränga bakgrunder och replikera andra oönskade fel, har ingen kroppsförändrande system ännu nått en perfekt lösning.

En nyligen artikel från Indien föreslår dock en anmärkningsvärd förbättring av tillståndet genom att använda den äldre Flux diffusionsmodellramverket, förstärkt med ett antal sekundära tillvägagångssätt som möjliggör en överlägsen och mer konsekvent parat dataset:

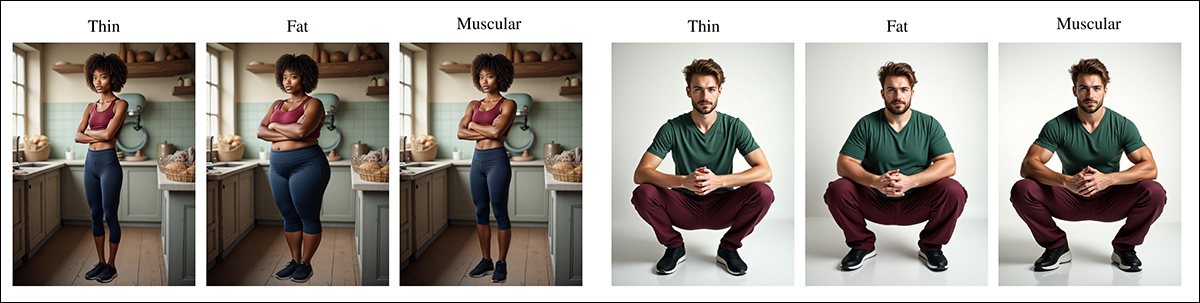

Datasetexempel från det nya projektet. Källa: https://arxiv.org/pdf/2508.13065

Projektet består av en ny och omfattande parat dataset; Odo, en generativ diffusionsmodell tränad på denna data; och en specialdesignad ny benchmark för att kvantitativt bedöma mänsklig formredigering.

I tester hävdar författarna en anmärkningsvärd förbättring av standarden som uppnåtts av liknande jämförbara modeller.

Den nya artikeln har titeln Odo: Depth-Guided Diffusion for Identity-Preserving Body Reshaping, och kommer från tre forskare vid Fast Code AI Pvt. Ltd i Bangalore.

Data och Metod

Dataset som skapats av forskarna innehåller 7 615 högupplösta bilder (960×1280 pixlar) för varje målkroppstyp (fet, smal och muskulös).

Initialt genererades 1 523 mänskliga ansikten via FLUX.1-dev 12-miljarders parameter diffusionsmodell, dock med hjälp av ett obestämt antal licensfria referensansikten från Pexels och Unsplash, för att öka mångfalden.

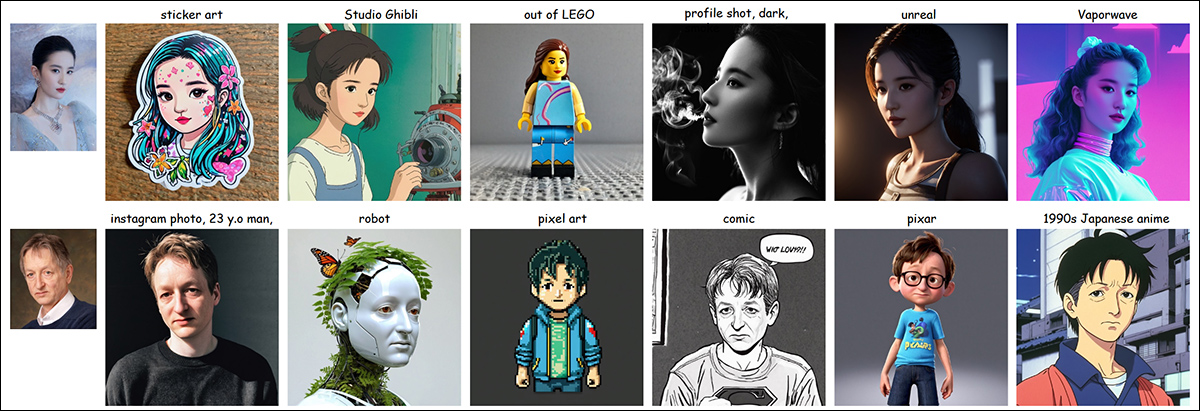

För att generera fullständiga kroppsbilder som inkorporerar dessa ansikten, använde forskarna ByteDances 2024 erbjudande PuLID, en kontrollpunkt finjusterad över bas Flux, och som innehåller en kontrastiv ID-förlust som är utformad för att hjälpa till att bevara ansiktsidentitet under transformationsprocesser:

Exempel från PuLID-projektet. Källa: https://arxiv.org/pdf/2404.16022

Modellen fick ett ansiktsbild och en standardiserad prompt som begärde genus, kläder, pose, scen, samt kroppstyp av smal, fet eller muskulös.

De tre kroppstypsbilderna för varje identitet visade ibland mindre förskjutningar i bakgrundsjustering och upplevd föremålsstorlek, vilket beror på den stokastiska beteendet hos diffusionsmodeller, där varje generation börjar från en ny brus seed. Även små förändringar i prompten, såsom att modifiera kroppstypbeskrivningen, kan påverka modellens bana i latent utrymme och orsaka visuell drift.

För att korrigera för denna variation, tillämpades en fyra-stegs automatisk efterbearbetningspipeline, med smal bilden i varje trippel vald som referens, eftersom dess mindre silhuett exponerade mer bakgrund.

Persondetektering utfördes med RT-DETRv2, följt av segmentering med SAM 2.1 för att extrahera subjektmasker för alla tre kroppstyper. Smal referensbilden passerades sedan till FLUX.1 Kontext Pro (den nyare bildredigeringsystemet) för bakgrundsutfyllnad, vilket producerade en ren version av scenen, med subjektet borttaget.

Fet och muskulösa varianterna storleksändrades med hjälp av enhetlig skalning för att matcha höjden på den smala referensmasken och sammansattes på den rena bakgrunden vid samma nedre justering, vilket säkerställde konsekvent ramning över alla bilder.

Författarna hävdar:

‘De resulterande transformations-tripletterna (smal, fet och muskulös) har en identisk bakgrund och enhetlig subjektskala. Detta tar bort irrelevanta variationer som kunde negativt påverka efterföljande träning eller utvärdering.’

Varje trippel av smal, fet och muskulös bild tillät sex möjliga transformationspar, vilket resulterade i 45 690 teoretiska kombinationer över 7 615 identiteter.

Efter att ha filtrerat bort exempel med oöverensstämmande kläder, onaturliga poser, förvrängda lemmar, identitetsdrift eller minimal formändring, behölls 18 573 högkvalitativa par. Även om några små pose-skillnader kvarstod, visade sig modellen vara robust mot dessa variationer.

Träning och Tester

De resulterande bilderna användes för att träna Odo-modellen – en diffusionsbaserad tillvägagångssätt för omformning av människor, med användning av Skinned Multi-Person Linear Model (SMPL, dvs. intermediär CGI) kartor.

Informeras av 2024 Neural Localizer’s metoder, konformerades datat till SMPL-figurerna på en per-individuell basis, med de resulterande optimerade parametrarna kapabla att producera djupkartor från vilka de ändrade bilderna skulle härledas:

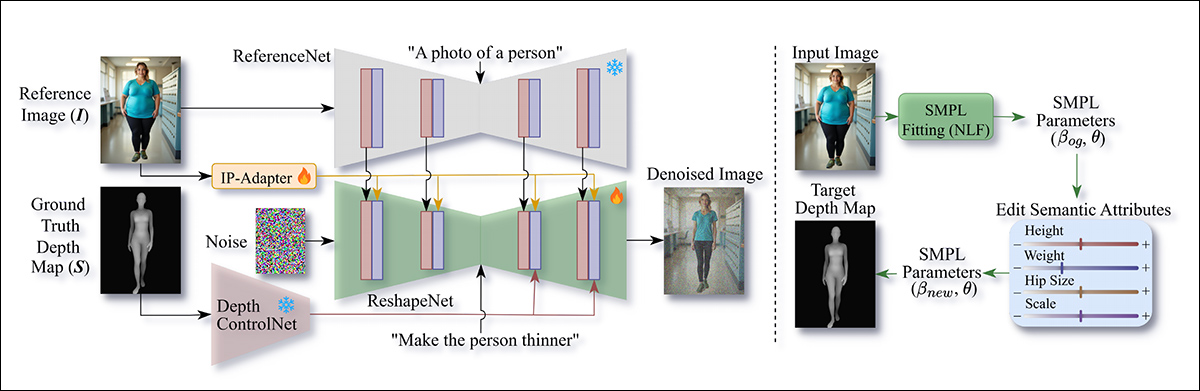

Schema för träningspipelinen. Den vänstra sidan visar träningsuppställningen, där SMPL-djupkartor från målbilden guidar ReshapeNet via ControlNet för att utföra kroppstransformation. Funktioner från källbilden extraheras av ReferenceNet och sammanfogas i ReshapeNet med hjälp av spatial självuppmärksamhet. Den högra sidan visar inferens, där SMPL-parametrar uppskattas från inmatningsbilden, modifieras av semantiska attribut och återges i en måldjupkarta som villkorar ReshapeNet under avbrusning, för att producera den slutliga transformerade bilden.

Modellen (se schema ovan) består av ReshapeNet-modulen, som stöds av tre hjälpmoduler: ReferenceNet; en IP-Adapter-modul; och en djupbaserad ControlNet-modul.

ReferenceNet extraherar detaljerade funktioner som bakgrund, kläder och identitet från inmatningsbilden och skickar dem till ReshapeNet. IP-Adapter bidrar med högnivåfunktionell vägledning, medan Depth ControlNet tillämpar SMPL-baserad villkorsstyrd kroppstransformation. I linje med tidigare arbeten, användes en SDXL-baserad frusen UNet för att extrahera mellanliggande funktioner.

Som för IP-Adapter-modulen, kodar denna inmatningsbilden via CLIP, med de resulterande inbäddningarna integrerade tillbaka i ReshapeNet via korsuppmärksamhet.

Som för Depth ControlNet-modulen, guidar denna mellan- och avkodarlager i ReshapeNet med hjälp av residualanslutningar. Därefter tar den en djupkarta återgiven från mål-SMPL-parametrarna och justerar den med målbilden.

ReshapeNet, baserat på SDXL UNet, är kärnnätverket i Odo. Under träning kodas målbilder in i latent utrymme med en variational autoencoder, brusas över tid och sedan avbrusas av ReshapeNet med funktioner från ControlNet och ReferenceNet.

Kategorispecifika textprompts som “Gör personen fetare”, “Gör personen smalare” eller “Gör personen muskulös” lades till, för att guida transformationer. Medan djupkartorna fångade grova kroppformer, tillhandahöll prompten den semantiska detaljen som behövdes för förändringar som muskeldефиниция, vilket möjliggjorde för modellen att producera mer exakta och realistiska modifieringar.

Träningsimplementering

Odo tränades på projektets syntetiska dataset, kombinerat med en undermängd av DeepFashion-MultiModal-dataseten, vilket resulterade i totalt 20 000 bildpar.

DeepFashion-MultiModal-data tillhandahöll variation i kläder och ansiktsdrag, med bilder parade mot sig själva under träning. Med alla SMPL-djupkartor förkalkylerade för effektivitet, kördes träningen i 60 epoch på en enda NVIDIA A100 GPU med 80 GB VRAM.

Med inmatningsbilderna storleksändrade till 768×1024, användes Adam-optimeraren, med en inlärningshastighet på 1×10⁻⁵. ReshapeNet initierades med SDXL UNet-vikter och finjusterades gemensamt med IP-Adapter från dess kontrollpunkt.

ReferenceNet initierades med SDXL-vikter och förblev frusen, medan Depth ControlNet använde förtränade vikter och förblev också frusen.

Den slutliga modellen krävde cirka 23 GB GPU-minne, och krävde 18 sekunder för enkelbildsinferens.

En Ny Metric

Bristen på dataset av den typ som krävs för detta projekt medförde att inga befintliga metricer verkligen tillgodosåg utmaningen. Därför utvecklade författarna en ny benchmark, bestående av 3 600 bildpar, som innehåller riktiga ansiktsbilder och bakgrundsbeskrivningar, samt diversa kroppstypvarianter.

Andra metricer som användes var Structural Similarity Index (SSIM); Peak Signal-to-Noise Ratio (PSNR); Learned Perceptual Image Patch Similarity (LPIPS); och Scale Corrected Per-Vertex Euclidean error in neutral (T-)pose (PVE-T-SC).

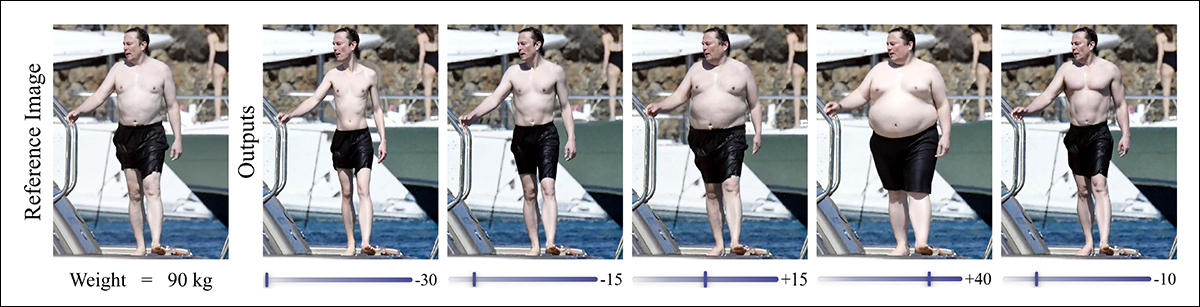

Först testade författarna sin metod kvalitativt mot vilda bilder (bilder som inte setts av modellen under träning):

Kvalitativa tester. Exemplen visar omvandlingar från originalbilden till smalare, överviktiga och muskulösa kroppstyper över olika poser, inklusive sittande och stående. Vänligen se källpapperet för bättre definition och detalj.

Av dessa resultat hävdar papperet:

‘[Vår] metod hanterar effektivt diversa poser, bakgrunder och kläder samtidigt som den bevarar personens identitet.

‘Förutom SMPL-målformer tillhandahåller vi textprompts – ‘Gör personen fetare,’ ‘Gör personen smalare’ eller ‘Gör personen muskulös’– för att uttryckligen guida önskade transformationer…

…'[Bilden nedan] visar ytterligare vår modells förmåga att utföra diversa formomvandlingar. Modellen följer exakt SMPL-djupkartor för att generera flera varianter av smalare och fetare versioner från referensbilden.’

Ytterligare kvalitativa tester som täcker området för målkroppstyper. Vänligen se källpapperet för bättre definition och detalj.

Författarna hävdar vidare:

‘Våra resultat visar mer realistiska transformationer enligt målvikt, eftersom vår modell samtidigt justerar övergripande kroppform, lemmproportioner och kläder, vilket resulterar i anatomiskt konsekventa och visuellt övertygande modifieringar.’

För kvantitativa tester, ställde författarna sin system mot den öppna källkoden Flux Kontext [dev] modell, FLUX.1, och 2022 erbjudandet Structure-Aware Flow Generation for Human Body Reshaping.

För FLUX.1 Kontext [dev], utformades prompter för att instruera ‘Gör personen fetare,’ ‘Gör personen smalare’ eller ‘Gör personen muskulös’, med målvikt specificerad – men bristen på finjusterade kontroller begränsade prestandan:

![Jämförelse av Odo med Structure-Aware Flow Generation for Human Body Reshaping och FLUX.1 Kontext [dev] på testuppsättningen, tillsammans med avlägsnande resultat för modeller tränade utan promptkonditionering i ReshapeNet, utan ReferenceNet (användning endast IP-Adapter) och med träning begränsad till BR-5K-datasetet.](https://www.unite.ai/wp-content/uploads/2025/08/table-2-1.jpg)

Jämförelse av Odo med Structure-Aware Flow Generation for Human Body Reshaping och FLUX.1 Kontext [dev] på testuppsättningen, tillsammans med avlägsnande resultat (inte täckt i denna artikel) för modeller tränade utan promptkonditionering i ReshapeNet, utan ReferenceNet (användning endast IP-Adapter) och med träning begränsad till BR-5K-datasetet.

Slutsats

Tillkomsten av Flux Kontext i år, och ännu nyligen utgivningen av de oquantifierade viktorna för Qwen Image Edit, har återigen tagit parat data till framträdande ställning i både hobbyist- och proffssamhällen. I den växande kritiken mot och otåligheten gentemot den otillräckliga precisionen i generativ AI, är modeller av denna typ utformade för betydligt högre trohet mot ingångsbilderna (även om mindre modeller ibland hämmas av sina mycket specifika träningsmål).

I detta fall verkar nyttan av en kroppsförändrande system ligga i psykologiska, medicinska och modebaserade områden. Trots detta är det möjligt att system av denna typ kommer att uppnå en högre nivå av framträdande, och kanske en mer avslappnad och potentiellt problematisk uppsättning användningar.

Publicerad första gången måndag, 25 augusti 2025