Andersons vinkel

Mindre Deepfakes Kan Vara En Större Hot

Conversational AI-verktyg som ChatGPT och Google Gemini används nu för att skapa deepfakes som inte byter ansikten, utan på mer subtila sätt kan om skriva hela historien inuti en bild. Genom att ändra gester, rekvisita och bakgrunder lurar dessa redigeringar både AI-detektorer och människor, vilket höjer insatserna för att upptäcka vad som är verkligt online.

I den nuvarande klimatet, särskilt i kölvattnet av betydande lagstiftning som TAKE IT DOWN-lagen, förknippar många av oss deepfakes och AI-driven identitetssyntes med icke-samtyckande AI-porr och politisk manipulation – i allmänhet, grova förvanskningar av sanningen.

Detta gör oss vana vid att förvänta oss att AI-manipulerade bilder alltid ska vara inriktade på högriskinnehåll, där kvaliteten på renderingen och manipulationen av sammanhanget kan lyckas med att uppnå en trovärdighetskupp, åtminstone på kort sikt.

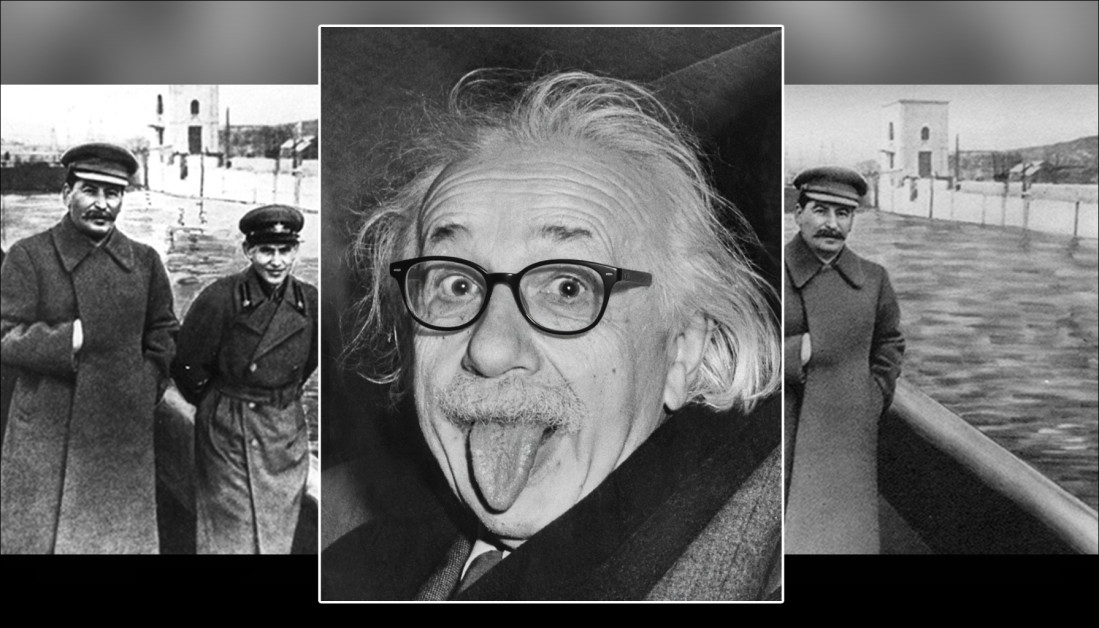

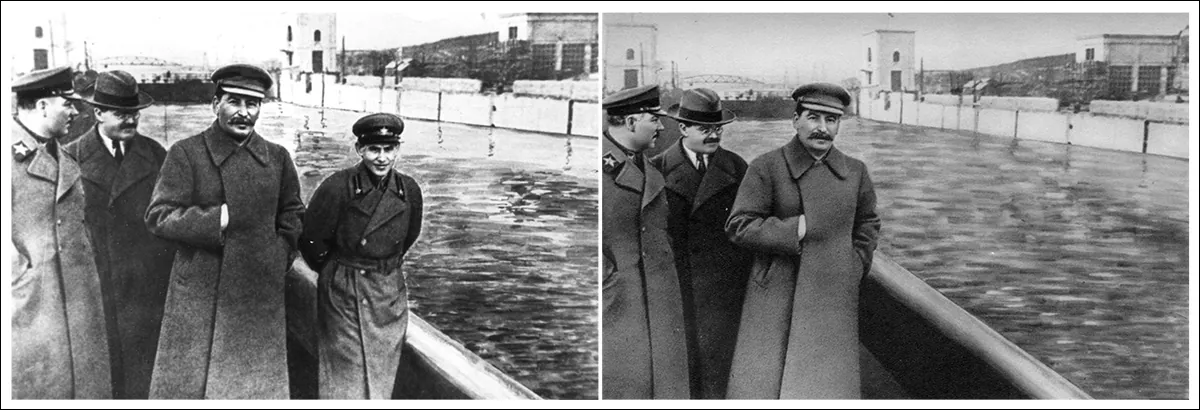

Historiskt sett har dock långt mer subtila ändringar ofta haft en mer ondskefull och varaktig effekt – såsom den statliga fototrickery som tillät Stalin att ta bort dem som hade fallit i onåd från det fotografiska registret, som parodierades i George Orwells roman 1984, där huvudpersonen Winston Smith tillbringar sina dagar med att om skriva historia och skapa, förstöra och “ändra” foton.

I följande exempel är problemet med den andra bilden att vi “inte vet vad vi inte vet” – att den tidigare chefen för Stalins hemliga polis, Nikolai Yezhov, tidigare upptog utrymmet där det nu bara finns en säkerhetsbarriär:

Nu ser du honom, nu är han… försvunnen. Stalins fotomanipulation tar bort en vanärad partimedlem från historien. Källa: Public domain, via https://www.rferl.org/a/soviet-airbrushing-the-censors-who-scratched-out-history/29361426.html

Strömmar av det här slaget, ofta upprepade, består på många sätt; inte bara kulturellt, utan också i datorseende, som härrör från statistiskt dominerande teman och motiv i träningsdata. För att ge ett exempel, det faktum att smartphones har sänkt tröskeln och massivt sänkt kostnaden för fotografering, innebär att deras ikonografi har blivit oåterkalleligen associerad med många abstrakta koncept, även när detta inte är lämpligt.

Om konventionell deepfaking kan uppfattas som en “attack”, är perniciösa och bestående mindre ändringar i audiovisuella medier mer lika “gaslighting”. Dessutom gör förmågan att denna typ av deepfaking kan gå obemärkt förbi det svårt att identifiera via statliga deepfake-detektionssystem (som letar efter grova förändringar). Detta tillvägagångssätt är mer likt vatten som nöter bort sten under en längre period, än en sten riktad mot huvudet.

MultiFakeVerse

Forskare från Australien har gjort ett försök att hantera bristen på uppmärksamhet för “subtil” deepfaking i litteraturen, genom att kurera en betydande ny dataset av personcentrerade bildmanipulationer som ändrar sammanhang, känslor och berättelse utan att ändra subjektets kärnidentitet:

Exempel från den nya samlingen, äkta/falska par, med vissa ändringar mer subtila än andra. Observera till exempel förlusten av auktoritet för den asiatiska kvinnan, nedre höger, när hennes läkarstetoskop tas bort av AI. Samtidigt har ersättningen av läkarens block för klippboken ingen uppenbar semantisk vinkel. Källa: https://huggingface.co/datasets/parulgupta/MultiFakeVerse_preview

Den kallas MultiFakeVerse, samlingen består av 845 826 bilder genererade via visionsspråkmodeller (VLM), som kan åtkommas online och laddas ner, med tillstånd.

Författarna skriver:

‘Denna VLM-drivna metod möjliggör semantiska, sammanhangsmedvetna ändringar, såsom ändring av handlingar, scener och mänskliga objektsinteraktioner snarare än syntetiska eller lågnivåidentitetsswap och regionsspecifika redigeringar som är vanliga i befintliga dataset.’

‘Våra experiment visar att nuvarande statliga deepfakedetektionsmodeller och mänskliga observatörer kämpar för att upptäcka dessa subtila men meningsfulla manipulationer.’

Forskarna testade både människor och ledande deepfakedetektionssystem på deras nya dataset för att se hur väl dessa subtila manipulationer kunde identifieras. Mänskliga deltagare kämpade, korrekt klassificerade bilder som äkta eller falska endast cirka 62 procent av tiden, och hade ännu svårare att peka ut vilka delar av bilden som hade ändrats.

Befintliga deepfakedetektorer, tränade mest på mer uppenbara ansiktsbyten eller inpainting-dataset, presterade dåligt också, ofta misslyckades med att registrera att någon manipulation hade skett. Även efter finjustering på MultiFakeVerse, förblev upptäcktsfrekvensen låg, vilket visar hur dåligt nuvarande system hanterar dessa subtila, berättelsedrivna redigeringar.

Den nya artikeln heter Multiverse Through Deepfakes: The MultiFakeVerse Dataset of Person-Centric Visual and Conceptual Manipulations, och kommer från fem forskare över Monash University i Melbourne, och Curtin University i Perth. Koden och relaterad data har släppts på GitHub, utöver Hugging Face-värdtjänsten som nämndes tidigare.

Metod

MultiFakeVerse-datasetet byggdes från fyra realvärldens bildsats som visar människor i olika situationer: EMOTIC; PISC, PIPA, och PIC 2.0. Utgångspunkten var 86 952 ursprungliga bilder, forskarna producerade 758 041 manipulerade versioner.

Gemini-2.0-Flash och ChatGPT-4o-ramverken användes för att föreslå sex minimala redigeringar för varje bild – redigeringar som var utformade för att subtilt ändra hur den mest framträdande personen i bilden skulle uppfattas av en tittare.

Modellerna instruerades att generera ändringar som skulle göra ämnet naivt, stolt, ångerfullt, ovan, eller nonchalant, eller för att justera något faktiskt element inom scenen. Utöver varje redigering producerade modellerna också en hänvisningsuttryck för att tydligt identifiera målet för redigeringen, vilket säkerställde att den efterföljande redigeringsprocessen kunde applicera ändringar på rätt person eller objekt inom varje bild.

Författarna förtydligar:

‘Observera att hänvisningsuttryck är ett brett utforskat område i samhället, som innebär en fras som kan skilja målet i en bild, t.ex. för en bild med två män som sitter på ett skrivbord, en som pratar i telefon och den andra som tittar på dokument, ett lämpligt hänvisningsuttryck för den senare skulle vara mannen till vänster som håller i ett papper.’

När redigeringarna var definierade, utfördes den faktiska bildmanipulationen genom att visionsspråkmodeller uppmanades att applicera de angivna ändringarna medan resten av scenen lämnades intakt. Forskarna testade tre system för denna uppgift: GPT-Image-1; Gemini-2.0-Flash-Bildgenerering; och ICEdit.

Efter att ha genererat tjugo tusen exempelbilder, visade sig Gemini-2.0-Flash vara den mest konsekventa metoden, som producerade redigeringar som smälte naturligt in i scenen utan att införa synliga artefakter; ICEdit producerade ofta mer uppenbara förfalskningar, med märkbara fel i de ändrade områdena; och GPT-Image-1 påverkade ibland oavsiktliga delar av bilden, delvis på grund av dess förenlighet med fasta utmatningsaspekter.

Bildanalys

Varje manipulerad bild jämfördes med sin ursprungliga för att bestämma hur mycket av bilden som hade ändrats. Pixeldifferenserna mellan de två versionerna beräknades, med små slumpmässiga brusfilter bort för att fokusera på meningsfulla redigeringar. I vissa bilder påverkades endast små områden; i andra ändrades upp till åttio procent av scenen.

För att utvärdera hur mycket betydelsen av varje bild förändrades i ljuset av dessa ändringar, genererades undertexter för både de ursprungliga och manipulerade bilderna med hjälp av ShareGPT-4V-visionsspråkmodellen.

Dessa undertexter konverterades sedan till inbäddningar med hjälp av Long-CLIP, vilket möjliggjorde en jämförelse av hur långt innehållet hade avvikit mellan versioner. De starkaste semantiska förändringarna sågs i fall där objekt nära eller direkt involverade personen hade ändrats, eftersom dessa små justeringar kunde signifikant förändra hur bilden tolkades.

Gemini-2.0-Flash användes sedan för att klassificera typen av manipulation som applicerats på varje bild, baserat på var och hur redigeringarna gjordes. Manipulationer grupperades i tre kategorier: personnivå-redigeringar involverade ändringar av subjektets ansiktsuttryck, pose, blick, kläder eller andra personliga funktioner; objektnivå-redigeringar påverkade föremål som var kopplade till personen, såsom föremål de höll i eller interagerade med i förgrunden; och scennivå-redigeringar involverade bakgrunds-element eller bredare aspekter av inställningen som inte direkt involverade personen.

MultiFakeVerse-datasetgenereringspipelinen börjar med riktiga bilder, där visionsspråkmodeller föreslår berättelseredigeringar som riktar sig till personer, föremål eller scener. Dessa instruktioner appliceras sedan av bildredigeringsmodeller. Högerpanelen visar fördelningen av personnivå-, objektnivå- och scennivåmanipulationer i datasetet. Källa: https://arxiv.org/pdf/2506.00868

Eftersom enskilda bilder kunde innehålla flera typer av redigeringar samtidigt, kartlades fördelningen av dessa kategorier över datasetet. Ungefär en tredjedel av redigeringarna riktade sig enbart mot personen, cirka en femtedel påverkade enbart scenen, och runt en sjättedel var begränsade till föremål.

Bedömning av perceptuell påverkan

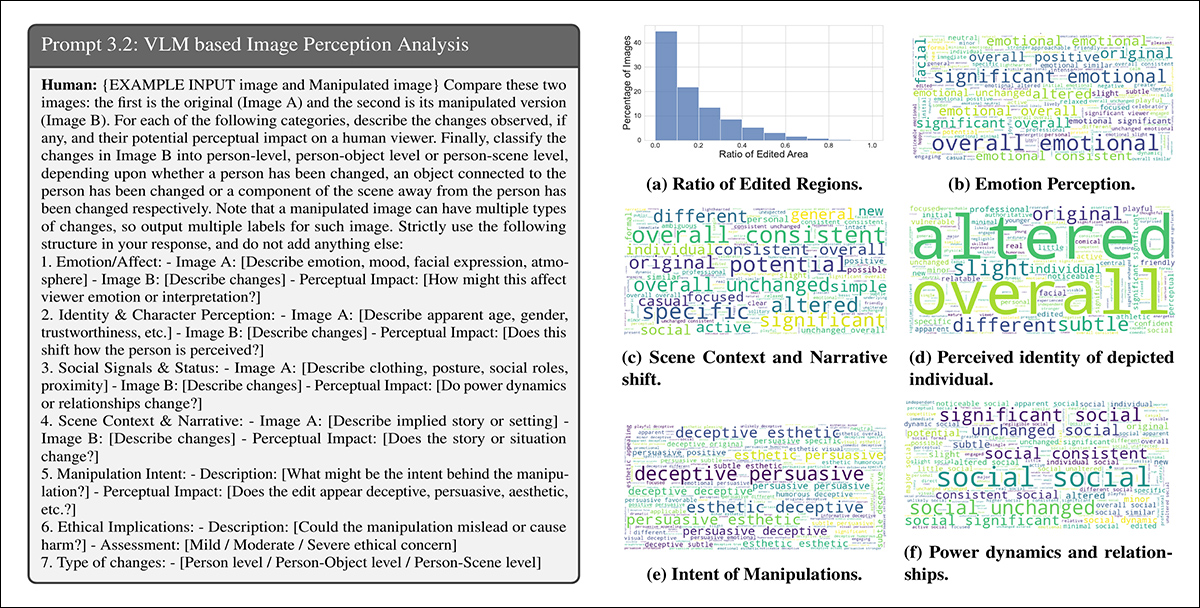

Gemini-2.0-Flash användes för att bedöma hur manipulationerna kunde förändra en tittares perception över sex områden: känslor, personlig identitet, maktdynamik, scenberättelse, manipulationens avsikt och etiska problem.

För känslor beskrevs redigeringarna ofta med termer som glada, engagerande eller tillgängliga, vilket tyder på förändringar i hur ämnen emotionellt ramades. I narrativa termer indikerade ord som professionell eller annorlunda förändringar i den underförstådda berättelsen eller inställningen:

Gemini-2.0-Flash uppmanades att utvärdera hur varje manipulation påverkade sex aspekter av tittarens perception. Vänster: exempel på promptstruktur som vägleder modellens utvärdering. Höger: ordmoln som sammanfattar förändringar i känslor, identitet, scenberättelse, avsikt, maktdynamik och etiska problem över datasetet.

Beskrivningar av identitetsförändringar inkluderade termer som yngre, leksamma och sårbara, vilket visar hur små förändringar kunde påverka hur individer uppfattades. Avsikten bakom många redigeringar betecknades som övertygande, bedräglig eller estetisk. Medan de flesta redigeringar bedömdes ha endast milda etiska problem, sågs en liten andel som medförande måttliga eller allvarliga etiska implikationer.

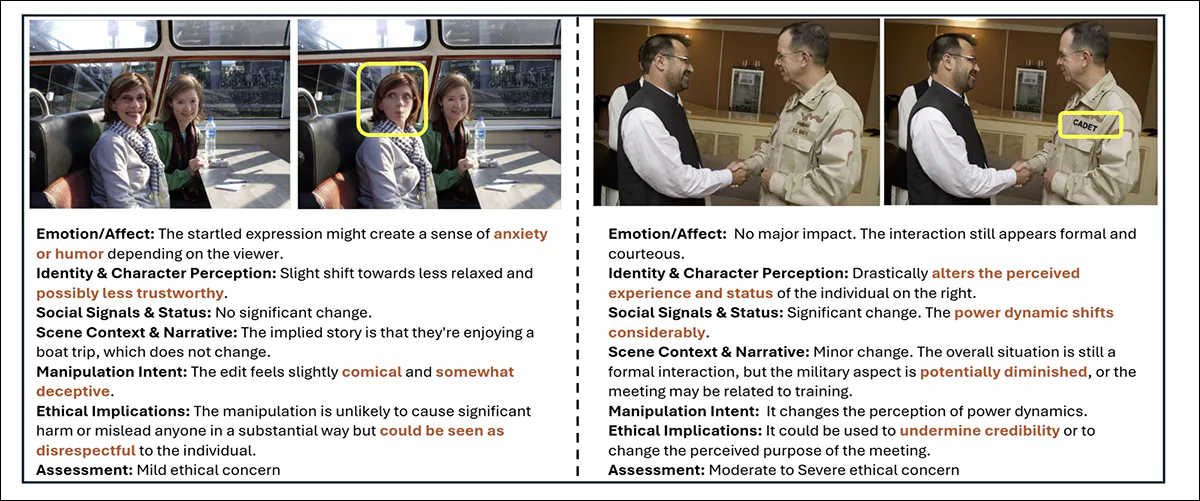

Exempel från MultiFakeVerse som visar hur små redigeringar förändrar tittarens perception. Gula rutor markerar de ändrade områdena, med tillhörande analys av förändringar i känslor, identitet, berättelse och etiska problem.

Mätvärden

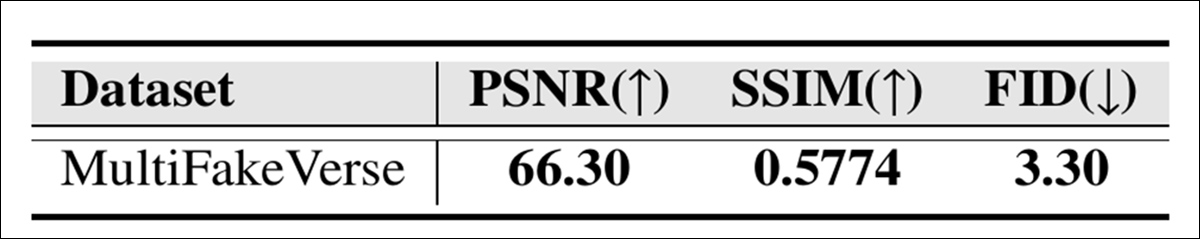

Den visuella kvaliteten på MultiFakeVerse-samlingen utvärderades med hjälp av tre standardmätvärden: Peak Signal-to-Noise Ratio (PSNR); Structural Similarity Index (SSIM); och Fréchet Inception Distance (FID):

Bildkvalitetssiffror för MultiFakeVerse mätta med PSNR, SSIM och FID.

SSIM-poängen på 0,5774 reflekterar en måttlig grad av likhet, i linje med målet att bevara större delen av bilden medan målinriktade redigeringar appliceras; FID-poängen på 3,30 tyder på att de genererade bilderna behåller hög kvalitet och mångfald; och ett PSNR-värde på 66,30 decibel indikerar att bilderna behåller god visuell trohet efter manipulation.

Användarstudie

En användarstudie genomfördes för att se hur bra människor kunde upptäcka de subtila förfalskningarna i MultiFakeVerse. Arton deltagare visades femtio bilder, jämnt fördelade mellan äkta och manipulerade exempel som täckte ett brett spektrum av redigeringstyper. Varje person ombads att klassificera om bilden var äkta eller falsk, och om falsk, att identifiera vilken typ av manipulation som hade applicerats.

Den övergripande noggrannheten för att avgöra äkta eller falskt var 61,67 procent, vilket innebär att deltagarna missklassificerade bilder mer än en tredjedel av tiden.

Författarna skriver:

‘Genom att analysera mänskliga förutsägelser av manipulationsnivåer för de falska bilderna, visade sig den genomsnittliga överlappningen mellan de förutsagda och faktiska manipulationsnivåerna vara 24,96%.

‘Detta visar att det inte är enkelt för mänskliga observatörer att identifiera manipulationsområdena i vårt dataset.’

Att bygga MultiFakeVerse-datasetet krävde omfattande beräkningsresurser: för att generera redigeringsinstruktioner gjordes över 845 000 API-samtal till Gemini- och GPT-modeller, och dessa uppmaningsuppgifter kostade cirka 1000 dollar; att producera Gemini-baserade bilder kostade ungefär 2867 dollar; och att generera bilder med GPT-Image-1 kostade cirka 200 dollar. ICEdit-bilder skapades lokalt på en NVIDIA A6000 GPU, och uppgiften slutfördes på cirka tjugofyra timmar.

Tester

Före testerna delades datasetet in i tränings-, validerings- och testuppsättningar genom att först välja 70 procent av de äkta bilderna för träningsändamål; 10 procent för validering; och 20 procent för testning. De manipulerade bilderna som genererades från varje äkta bild tilldelades samma uppsättning som den ursprungliga.

Ytterligare exempel på äkta (vänster) och ändrade (höger) innehåll från datasetet.

Prestanda på att upptäcka förfalskningar mättes med hjälp av bildnivånoggrannhet (om systemet korrekt klassificerar hela bilden som äkta eller falsk) och F1-poäng. För att lokalisera de manipulerade områdena inom varje bild användes Area Under the Curve (AUC), F1-poäng och intersection over union (IoU).

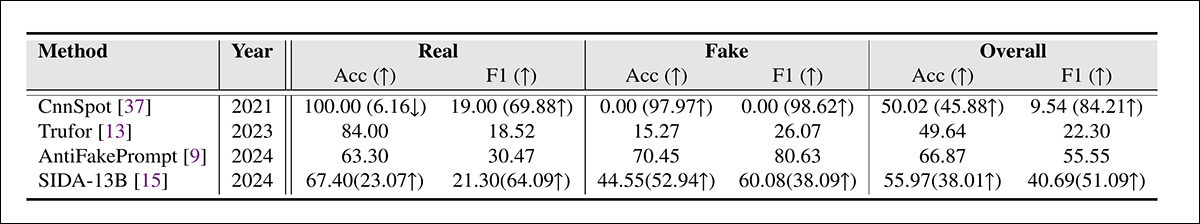

MultiFakeVerse-datasetet användes mot ledande deepfakedetektionssystem på hela testuppsättningen, med rivaliserande ramverk som CnnSpot; AntifakePrompt; TruFor; och visionsspråk-baserade SIDA. Varje modell utvärderades först i zero-shot-läge, med hjälp av sina ursprungliga förtränade vikter utan ytterligare justering.

Två modeller, CnnSpot och SIDA, justerades sedan finjusterade på MultiFakeVerse-träningsdata för att bedöma om omträning förbättrade prestandan.

Deepfakedetektionsresultat på MultiFakeVerse under zero-shot och finjusterade förhållanden. Siffror inom parentes visar förändringar efter finjustering.

Av dessa resultat skriver författarna:

‘[Modellerna] tränade på tidigare inpainting-baserade förfalskningar kämpar för att identifiera våra VLM-redigeringsbaserade förfalskningar, särskilt, CNNSpot tenderar att klassificera nästan alla bilderna som äkta. AntifakePrompt har den bästa zero-shot-prestandan med 66,87% genomsnittlig klassvis noggrannhet och 55,55% F1-poäng.

‘Efter finjustering på vår träningsuppsättning observerar vi en prestandaförbättring i både CNNSpot och SIDA-13B, med CNNSpot som överträffar SIDA-13B i termer av både genomsnittlig klassvis noggrannhet (med 1,92%) och F1-poäng (med 1,97%).’

SIDA-13B utvärderades på MultiFakeVerse för att mäta hur exakt det kunde lokalisera de manipulerade områdena inom varje bild. Modellen testades både i zero-shot-läge och efter finjustering på datasetet.

I dess ursprungliga tillstånd nådde den en IoU-poäng på 13,10, en F1-poäng på 19,92 och en AUC på 14,06, vilket visar svag lokaliseringsprestanda.

Efter finjustering förbättrades poängen till 24,74 för IoU, 39,40 för F1 och 37,53 för AUC. Trots extra utbildning hade modellen fortfarande svårt att hitta exakt var redigeringarna hade gjorts, vilket understryker hur svårt det kan vara att upptäcka dessa typer av små, målinriktade ändringar.

Slutsats

Den nya studien avslöjar en blind fläck både i mänsklig och maskinperception: medan mycket av den offentliga debatten kring deepfakes har fokuserat på rubrikerna om identitetsswap, är dessa tysta “berättelseredigeringar” svårare att upptäcka och potentiellt mer korrosiva på lång sikt.

Sådana system som ChatGPT och Gemini tar en mer aktiv roll i att generera detta slag av innehåll, och eftersom vi själva alltmer deltar i att ändra verkligheten i våra egna fotostreams, kan detektionsmodeller som förlitar sig på att upptäcka grova manipulationer erbjuda otillräckligt försvar.

Vad MultiFakeVerse demonstrerar är inte att upptäckt har misslyckats, utan att åtminstone en del av problemet kan vara på väg att förändras till en mer svårhanterlig, långsammare form: en där små visuella lögner ackumuleras obemärkt.

Publicerad första gången torsdagen den 5 juni 2025