Andersons vinkel

Att bringa AI-genererade bilder till liv med HDR

AI-bilder och video kan vara imponerande, men de är inte av “professionell” standard – ett problem som ett nytt forskningsprojekt försöker åtgärda.

I den professionella audiovisuella gemenskapen är en av de vanligaste invändningarna mot AI:s intrång den nuvarande bristen på professionella standarder för bild- och videoreproduktion. Inte minst av dessa är förmågan att arbeta med High Dynamic Range (HDR)-bilder och video.

HDR-bilder är den moderna motsvarigheten till en fotografisk teknik från 1800- och 1900-talet som kallas bracketing, där samma bild tas flera gånger med ökande mängder ljus som tillåts nå filmemulsionen:

Ovan, en kort bracket-sekvens. I infälld nedan, den höga dynamiska omfång som kan extrapoleras från dessa foton till en enda bild. Källa

I traditionell fotografi resulterade detta i flera bilder som kunde, med viss expertis och ansträngning, komponeras till en enda utskrift som drog nytta av alla olika detaljnivåer som var tillgängliga över exponeringsområdet. Men det var inte en trivial eller lätt process.

Dessa dagar kan en ‘auto-bracketed’ bildsekvens antingen producera flera bilder eller kombineras till en enda HDR-bild – effektivt en mångfald av exponeringar i en bild, som HDR-kapabla bildredigeringsprogram som Photoshop kan iterera genom och låta fotografen dirigera till en idealisk utdata bild.

Om du undrar varför du bör bry dig, eller hur detta påverkar din egen fotografering, är illustrationen för den här artikeln tänkt att demonstrera detta på ett bekant sätt:

Ovan, till vänster ser vi ett typiskt exempel på en sRGB (dvs. icke-HDR)-bild. Bara genom att ljusa upp den (visad till höger) visas inte monstret i garderoben, eftersom den detaljen kastades bort när fotografen och kamerans automatiserade processer bestämde vad som skulle prioriteras i bilden:

Nedan är en indikation (till vänster) på hur “utblekt” förgrunden skulle behöva vara vid exponeringstillfället för att registrera garderobsmonstret i en icke-HDR-bild, och (till höger) hur monstret kastas in i mörker när exponeringen görs lämplig för de välupplysta förgrundsobjekten istället:

Nedan ser vi den typ av detalj som kan “räddas” från en HDR-bild eller bildsekvens. I detta fall “gömde” sig monstret i de lägsta visuella registren i HDR-sekvensen, i en nivå där resten av innehållet skulle ha varit “utbränt” till nästan vitt (ovan, vänster). Genom att specificera att en stor mängd ljusnivåer skulle uttryckas, selektivt, i samma bild, kan dessa diskorda element komponeras till en enda rationell bild:

En icke-HDR-bild kallas för en display-referred bild, och en hög-gamut HDR-bild kallas för en scene-referred bild.

HDR-video är också en sak, och denna typ av tonal flexibilitet och ductilitet ger filmare en viss frihet att rädda, gradera och tolka footage på ett kreativt och konsekvent sätt; inte förvånansvärt, då, att kreativa personer är ovilliga att arbeta med den “utplattade” sRGB-utmatningen som är typisk för de flesta generativa AI-ramverk.

HDR i AI

Naturligtvis är forskarscenen intresserad av att bringa AI-genererade ramverk in i HDR-eran. Men det är inte en trivial uppgift, både på grund av den grundläggande arkitekturen i diffusionsbaserade generativa system och på grund av att bra HDR-data tar upp mycket diskutrymme, vilket gör det till ett omständligt urval; följaktligen är dataset som är lämpliga för uppgiften sällsynta.

Trots detta erbjuder ett samarbete mellan ett universitet i Singapore och Adobe Research en metod för att producera HDR-bildsekvenser, i en metodik som teoretiskt kan tillämpas på video såväl som stillbilder:

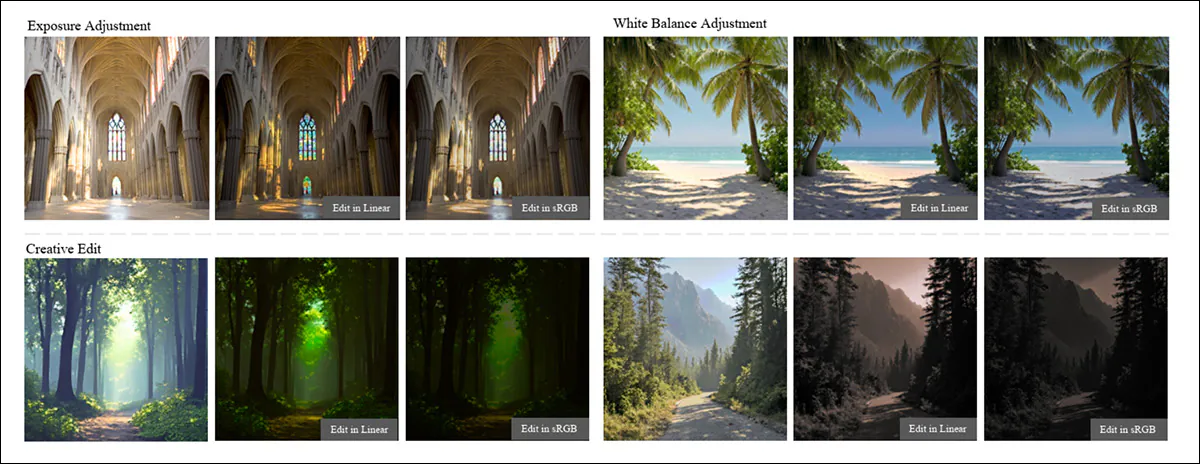

Från projektets webbplats för det nya arbetet, exempel på ‘bracketed’ text-till-bild-utdata. Källa

Det nya systemet genererar flera justerade versioner av samma bild i olika ljusnivåer och lär sig hur ljust scenen verkligen var, och kombinerar sedan dessa till en enda resultat som behåller detaljer i både skuggor och höjdpunkter, och tillåter senare redigeringar av exponering eller färg att bete sig mer som justeringar av en riktig kamerakapning, snarare än ömtåliga justeringar av en fullständigt bearbetad bild.

Systemet utnyttjar en mångfald av olika modeller för uppgiften, inklusive varianter av Qwen och Flux:

Exempel från den nya artikeln, som visar hur systemet kan generera flera exponeringsversioner av samma scen medan den behåller den underliggande strukturen fixerad. Utgångspunkten från en enkel kantkarta, producerar modellen konsekventa bilder över mycket mörka till mycket ljusa inställningar, oavsett om prompten beskriver månljus, solljus, solnedgång eller till och med ett litet föremål som en ballong, med ämnet och kompositionen som förblir stabila medan endast belysningen ändras. Metoden kan variera ljusstyrka på ett kontrollerat, kameralikt sätt, snarare än att driva eller uppfinna nytt innehåll när exponeringen ändras. Källa

Författarna skriver:

‘Att generera linjära bilder är utmanande, eftersom förtränade VAE i latent diffusionsmodeller kämpar för att samtidigt bevara extrema höjdpunkter och skuggor på grund av den högre dynamiska omfånget och bitdjupet.

‘För detta ändamål representerar vi en linjär bild som en sekvens av exponeringsbracket, var och en som fångar en specifik del av det dynamiska omfånget, och föreslår en DiT-baserad flödesmatchningsarkitektur för text-villkorad exponeringsbracket-generering.

‘Vi visar dessutom nedströmsapplikationer, inklusive text-styrd linjär bildredigering och struktur-villkorad generering via ControlNet.’

Den nya artikeln har titeln Linjär bildgenerering genom syntes av exponeringsbracket, och kommer från fyra författare på S-Lab vid Nanyang Technological University, Adobe NextCam och Adobe Research. Utöver den ovannämnda projektwebbplatsen och YouTube-videon som åtföljer utgåvan, finns det också ett (för närvarande tomt) GitHub-repo, och löftet om en dataset-utgåva.

Även om författarna tillhandahåller många exempel på utdata från systemet på den associerade projektwebbplatsen, kommer tittarna att behöva en HDR-kapabel skärm för att verkligen kunna urskilja egenskaperna hos HDR-utmatningen som presenteras. Ändå hittar du forskarnas YouTube-översikt inbäddad i slutet av den här artikeln – men var medveten om att skillnaderna mellan visade exempel kanske inte är tydliga på en icke-HDR-skärm.

Metod och data

Författarna betonar den utsträckning till vilken datainsamling är en utmaning i detta särskilda företag:

‘Att skaffa ett stort antal linjära bilder är extremt svårt i praktiken. Dessutom är de flesta offentliga HDR-dataset antingen panoramiska (och fokuserar nästan uteslutande på storskalig sceninnehåll) eller tillhandahåller inte riktiga linjära bilder, vilket gör dem olämpliga för våra syften.

‘Därför använder vi främst RAW-bild-dataset som grund för utbildning.’

Forskarna gjorde kreativ användning av de få alternativ som fanns till hands, och utnyttjade RAISE-dataset som faktisk utbildningsdata, och MIT-Adobe FiveK-dataset som utvärderingsdata*.

För att bygga användbar HDR-träningsdata körde forskarna de råa kamerabilderna genom en standardiserad pipeline för att avlägsna kameratypiska egenheter, och omvandla bilderna till en konsekvent, scen-hänvisad linjär format:

Systemets arbetsflöde: systemet startar med brus som representerar fyra exponeringsnivåer av samma scen, tillsammans med en textprompt och en ljusstyrka-token, och bearbetar dem genom staplade transformer-block som håller de olika exponeringarna justerade medan de justerar för belysning. Det förutsäger sedan både uppsättningen exponeringsbilder, tillsammans med en allmän ljusstyrka, och kombinerar dem sedan till en enda scen-hänvisad bild, som behåller detaljer i både skuggor och höjdpunkter.

Detta innebar att rekonstruera full RGB från sensordata, tillämpa färgkorrigering, normalisera vitbalans och kortvarigt flytta in i ett perceptuellt färgutrymme för brusreducering innan återgången till en ren linjär signal. Det faktiska ljuset i scenen återställdes sedan med hjälp av kamerans exponeringsinställningar, så att varje pixel skulle reflektera den faktiska ljusstyrkan snarare än en display-klar approximation.

Eftersom sådana värden kan variera kraftigt, stabiliserades data sedan genom att skala varje bild baserat på dess egen ljusstyrkefördelning, med hjälp av mittfälts- och höjdpunktsstatistik för att undvika både utblekta bilder och överexponerade höjdpunkter, och slutligen erhöll en normaliserad linjär bild som bevarade det faktiska omfånget av ljus i scenen, samtidigt som den förblev stabil nog för utbildning.

Textetiketter för bilderna skapades sedan med Qwen2.5-VL 7B-modellen, med promter som utformats för att matcha egenskaperna hos Flux-modellen som skulle användas vid genereringstillfället.

Varje bild delades sedan in i exponerings-“skivor” och passerades genom en delad VAE-kodare, som omvandlade alla exponeringar till ett gemensamt latenta utrymme som var utformat för att fånga det fulla ljusomfånget. Latenterna raffinerades sedan från brus, och avkodades tillbaka till bilder, vilket möjliggjorde en konsekvent rekonstruktion över mörka och ljusa områden, utan att kollapsa dem till en enda “utplattad” exponering.

LoRA-fine-tuning användes för att anpassa den förtränade Flux-ryggraden till linjära bild-data med minimala extra parametrar, vilket hjälpte Single-Diffusion Transformers (single-DiT)-modellen att förbli stabil, även när ljusstyrkan varierade över exponeringsbracket.

Exponeringsmodulering självuppmärksamhet (central kolumn i schemat ovan) introducerades för att gemensamt bearbeta alla bracket, och tillåta luminans att justeras per exponering medan struktur och fina detaljer hölls justerade.

3D Rotary Positional Embedding (3D-R[o]PE) användes för att koda både spatial position och exponeringsidentitet, så att modellen kunde skilja på vilken bracket varje token tillhörde, samtidigt som den bevarade spatial konsekvens, och möjliggjorde en ren separation av ljusstyrkevariation från sceninnehåll.

En översikt av det dataset som används i studien, som visar hur bilder är fördelade över innehållstyper och inomhus- respektive utomhusscener, tillsammans med spridningen av ljusstyrkevärden i den bearbetade datan. Histogrammen visar luminans och strålningsomfånget i log-rymd, och visar hur stor variation det faktiska ljuset kan ha, med högre strålningsvärden som motsvarar fysiskt ljusare scener och som betonar den starka dynamiska omfånget som modellen är utbildad för att hantera.