Andersons vinkel

Använda AI för att förbättra riktiga foton innan de tas

I stället för att använda GenAI för att korrigera foton efter du har tagit dem, har forskare tränat ett system som berättar för dig hur du ska flytta, posera och ramla in bilden innan, med hjälp av studerad kunskap om vad som gör bilder minnesvärda.

Att korrigera foton efteråt har blivit lättare under en ganska lång tid, eftersom tillverkare och tekniska plattformar alltmer erbjuder redigering i kameran som tillåter användare att ändra bilder så snart de har tagits. Populära system av detta slag inkluderar Googles konversationsredigering, och Samsungs generativ redigering, bland andra.

Men en ny trend som föredrar “autenticitet” över AI-“förbättrade” resultat kan innebära att många av de konsumenter som sådana system riktar sig till börjar betrakta “ändrade” foton som AI-slop.

Kanske är det därför som Google skapat en AI-tränad “kameracoach” informerad av Gemini, som kan ge direkt instruktion för att förbättra en bild under processen att ta den:

Googles kameracoach berättar för användaren hur man ska omramla en bild, bland annat. Källa

Som ett proprietärt system, och med praktiskt taget ingen information tillgänglig online om det, verkar kameracoachen utnyttja Gemini för att hjälpa användare att förbättra ramningen (se bild ovan) eller göra mindre ändringar i stance (såsom att flytta närmare varandra eller titta rakt in i kameran).

Så långt som någon kan se, trycker produkten kompositionen mot medianen, antagligen baserat på miljontals uppladdade innehållsdata som troligen bidragit till Geminis träningsdata. På detta sätt har de uppladdande användarna skapat AI:s kalibrering genom att avvisa otillfredsställande skott och ladda upp de som de gillar – en effektiv (och gratis) form av dataset-kurering!

Det som sagts, foton som genomsnitts i termer av komposition besitter inte nödvändigtvis samma estetiska värden eller tittar-impact som foton som är minnesvärda.

Bortom “Ost!” och tredjedelsregeln

I detta syfte, och mot ett system som är mer tillgängligt över plattformar, erbjuder ny forskning från Italien ett coach-liknande system som baseras på föregående kunskap om vad som gör bilder minnesvärda:

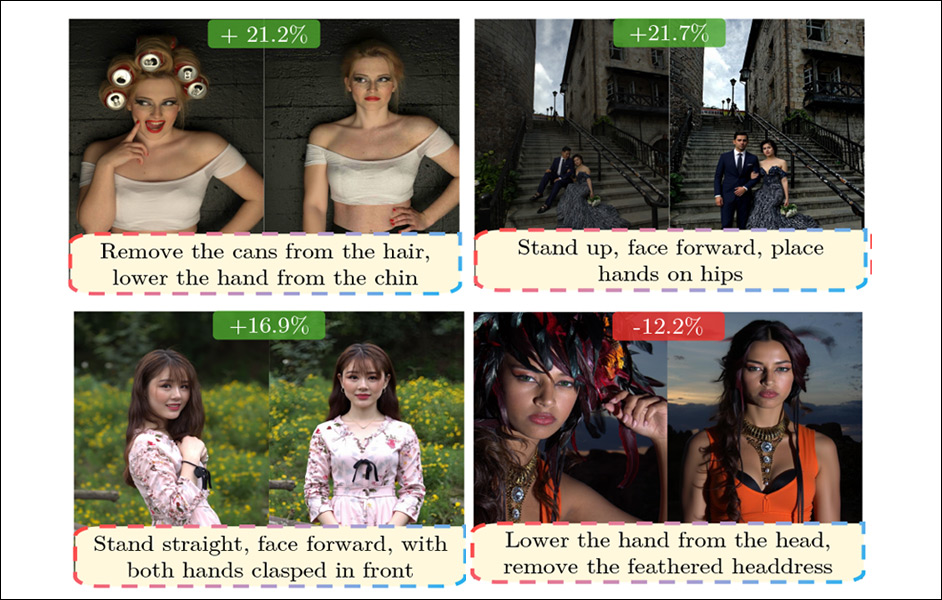

Långtgående exempel på råd från författarnas nya system. Källa

I exemplen ovan ser vi råd givet av författarnas nya system – kallat MemCoach – som det är svårt att föreställa sig att en kompositionscentrerad AI som kameracoachen skulle kunna ge. I det första (vänstra) fallet är rådet att ta bort huvudbonaden särskilt misstänkt; i den andra bilden är det svårt att föreställa sig vad en konventionell kontext en kompositionscentrerad AI kunde dra från den allmänna scenen (dvs. en “konstnärlig” bild av en ung kvinna som ligger på golvet med ögonen stängda).

Kärnkunskapen om minnesvärdhet i fotografi, som används för att utveckla det tre-delade italienska systemet, är hämtad från olika tidigare arbeten, inklusive 2015 års utgång Vad gör ett föremål minnesvärt?, och 2013 års papper Vad gör en fotograf minnesvärd?.

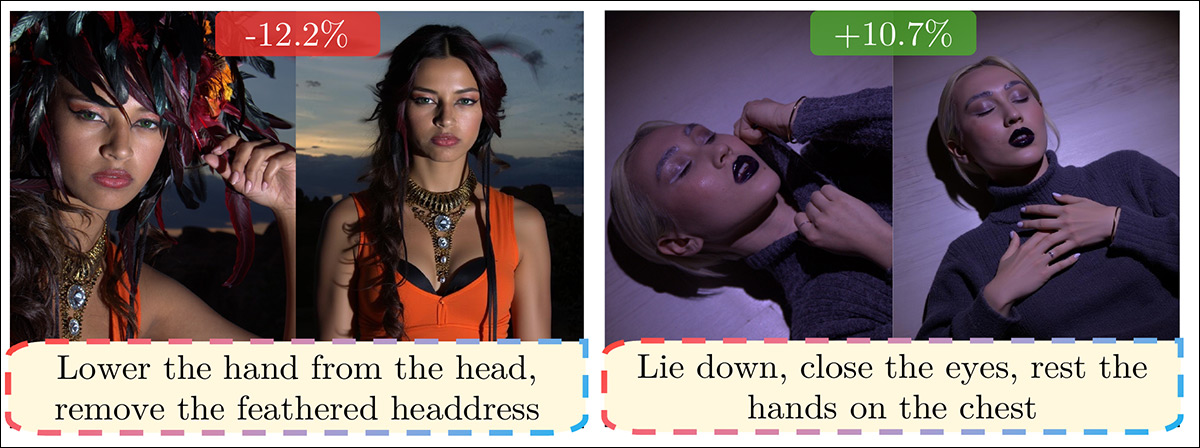

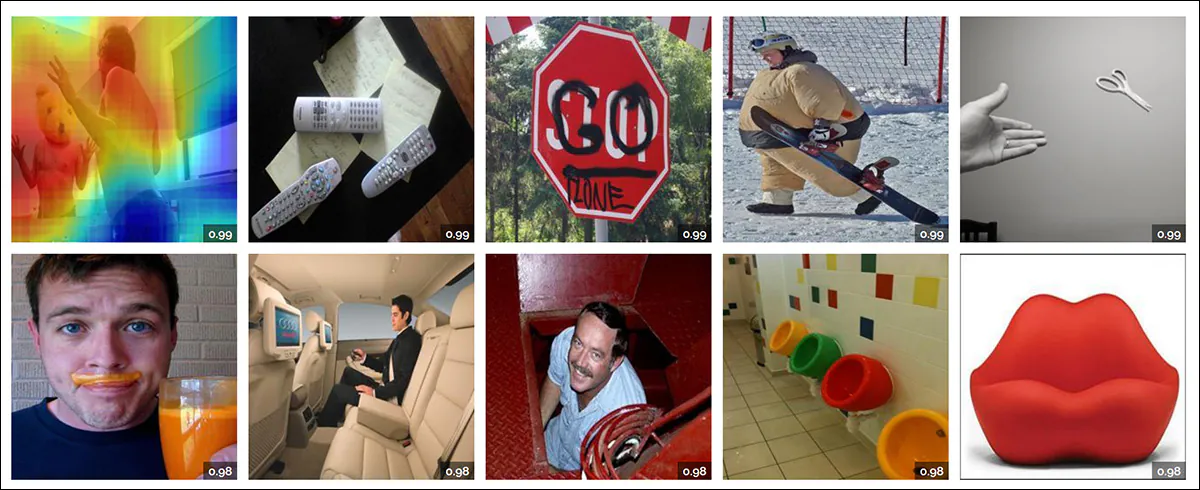

Från papperet Vad gör en fotograf minnesvärd?, representativa exempel på bra, medel och dåliga foton, i termer av minnesvärdhet. Källa

Vem som helst, som jag, med en negativ Unix-födelsedag, kommer förmodligen att känna igen mallen för “minst minnesvärda bilder” (övre höger i bilden ovan), från de oändliga slidenätter som förbannade vår barndom. Som författarna påstår*:

‘Dessa arbeten identifierade nyckelintrinsiska faktorer som närvaro av människor, inomhusscener eller emotionella uttryck, snarare än föremål och panoramautsikt, samt extrinsiska faktorer, inklusive kontext och observatören.’

Projektet kretsar kring “minnesvärdhetsåterkoppling” (MemFeed), som uttrycks i MemCoach-tutorprogrammet, och en benchmark (med titeln MemBench) baserad på PPR10K-dataseten.

Från papperet PPR10K: A Large-Scale Portrait Photo Retouching Dataset with Human-Region Mask and Group-Level Consistency, olika prover från datasetet. Övre raden visar de ursprungliga bilderna, nedre raden visar expert-retuscherade versioner tillsammans med motsvarande mänskliga regionmasker. De ursprungliga bilderna varierar kraftigt i vy, bakgrund, belysning och kamerainställningar, medan de retuscherade resultaten visar förbättrad visuell kvalitet och starkare konsekvens inom varje grupp. Källa

Papperet observerar att minnesvärdhet är kvantifierbar i foton, snarare än en registrering av subjektiva bedömningar, och författarna noterar vidare att egenskapen har identifierats både för foton (i olika arbeten) och videor (i olika andra).

Den nya papperet heter Hur tar man ett minnesvärt foto? Ge användarna handlingsbara råd, och kommer från fyra forskare på universitetet i Trento, universitetet i Pisa och Fondazione Bruno Kessler. Projektets sidan föreslår att GitHub-kod och Hugging Face-värd data kommer att finnas tillgängliga nästa månad (mars 2026).

Metod

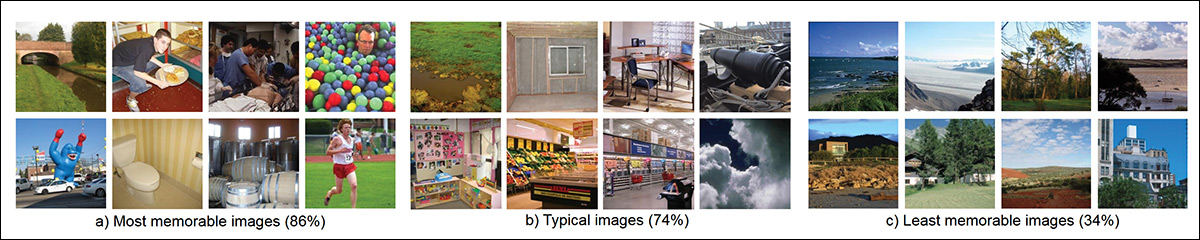

För att kurera MemBench-datasetet från käll-PPR10K-porträttdatasetet, grupperade forskarna foton från samma scen och poängsatte varje bild för minnesvärdhet med hjälp av en tränad prediktor baserad på CLIP funktioner. De rankade sedan foton inom varje scen från mindre till mer minnesvärt och parade dem enligt:

Översikt av MemBench-konstruktion och utvärdering. Övre raden visar data-pipelinen, från gruppering av bilder efter scen och förutsägelse av minnesvärdhet, till rangordning av foton och generering av minnesvärdhetsmedveten återkoppling. Nedre raden visar utvärdering, mätning av återkopplingskvalitet genom redigeringsbaserad minnesvärdhetsvinst och perplexitetspoäng.

För varje par genererades naturliga språkbeskrivningar med InternVL3.5-modellen för att förklara de synliga skillnaderna mellan den mindre minnesvärda versionen och den mer minnesvärda versionen; och dessa beskrivningar skulle utgöra träningsignalen för minnesvärdhetsåterkopplingssystemet.

Till skillnad från den typ av logik som ligger till grund för Googles kameracoach, sökte forskarna en mer subtil uppsättning tolkningar†:

‘Till skillnad från beräkningsfotografiska justeringar som fokuserar på efterföljande korrigeringar (t.ex. “gör bilden ljusare”), fokuserar vi på semantiska åtgärder som en användare kan vidta på plats för ett bättre skott, t.ex. “Vänd er mot varandra”.’

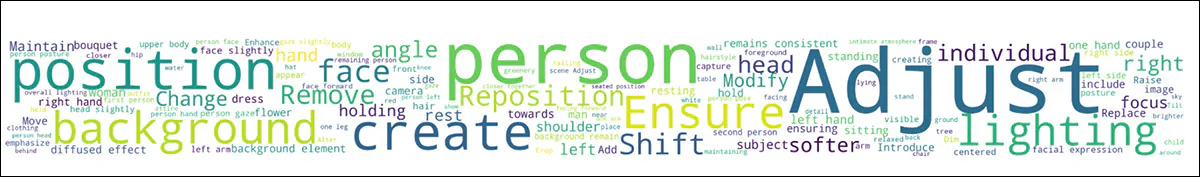

Den slutliga MemBench-samlingen består av cirka 10 000 bilder grupperade i 1 570 scener, med i genomsnitt 6,5 bilder per scen. Ord-molnet som författarna genererade (se bild nedan), visar en stor mängd semantiska kategorier i datasetet:

Ett ord-moln av de vanligaste termerna i MemBench.

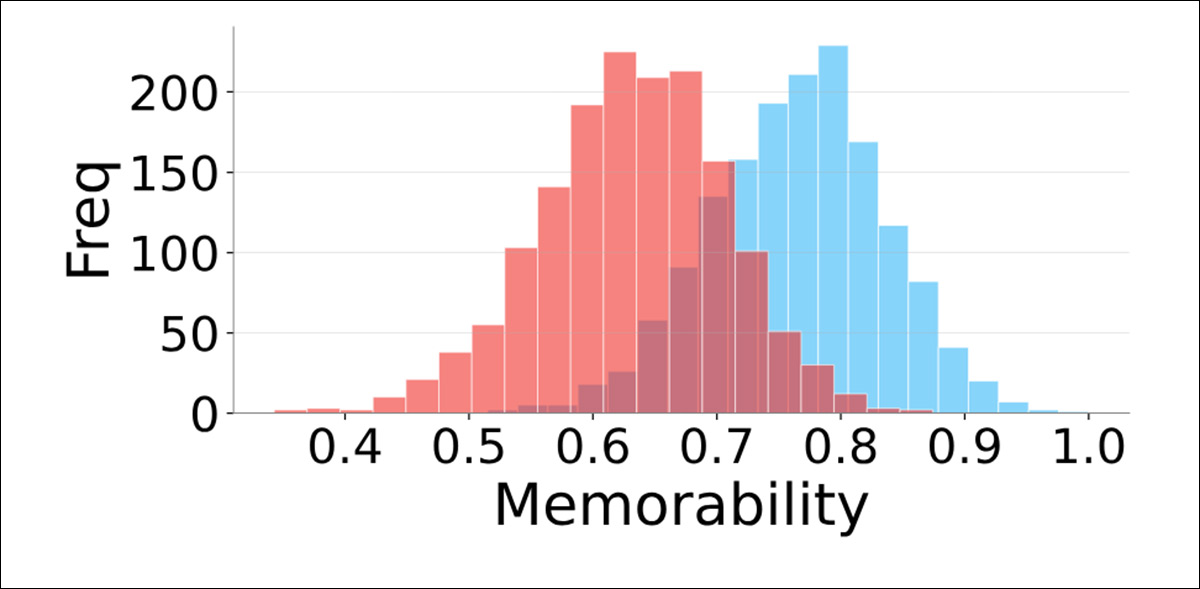

Källbilder hade i genomsnitt en minnesvärdhetspoäng på 0,63, medan de mest minnesvärda skotten från samma scen sträckte sig från 0,51 upp till 1,0, med märkbar överlappning mellan de två grupperna:

Fördelning av minnesvärdhetspoäng som jämför de minst och mest minnesvärda bilderna inom varje scen.

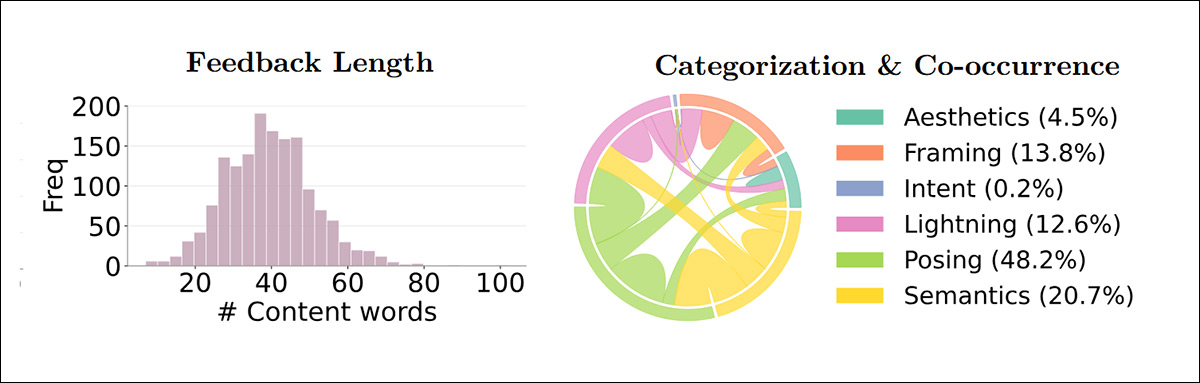

Återkopplingen sträckte sig från korta sju-ordsnotiser till betydligt längre instruktioner (vänster, i bilden nedan). Varje råd delades sedan upp i små åtgärdstyper med hjälp av GPT-5 Mini (höger, i bilden nedan):

Fördelning av återkopplingslängd mätt i innehållsord, och kategorisering av atomära underåtgärder med ackordbredder som indikerar samtidighetsfrekvens över kategorier.

Författarna noterar att de flesta förslagen fokuserade på hur motivet var poserat, följt av ändringar i betydelse eller sceninnehåll, med ramning ofta länkad till posering, och belysningsjusteringar ofta knutna till semantiska ändringar.

Flux-kapacitor

För att utvärdera om minnesvärdhet ökades av återkopplingen, simulerades användarkompatibilitet med hjälp av den generativa modellen FLUX.1 Kontext som en proxy för fotografen. Givet en källbild och en textbaserad återkoppling, genererades en redigerad version av Flux som simulerade de föreslagna ändringarna:

Bilderna till vänster är riktiga, från datasetet, och bilderna till höger (i varje fall) är skapade av Flux, baserat på prompten (i gul, nedan). På detta sätt kunde effektiviteten av prompter utvärderas utan omfattande mänskligt engagemang. Denna kunskap skulle slutligen mata tillbaka till MemCoach-ramverket, och faktiskt representera en arbetsflöde som kunde iterativt förbättra ett system av detta slag (dvs. slutligen med riktiga världsexempel snarare än Flux-exempel).

Både den ursprungliga och den redigerade bilden passerades sedan genom en minnesvärdhetsprediktor, vilket möjliggjorde mätning av hur ofta den redigerade versionen uppnådde en högre poäng – kallad förbättringsförhållande – och hur stor vinsten var i förhållande till startbilden, kallad relativ minnesvärdhet.

Likhet med minnesvärdhetsfokuserad referensåterkoppling mättes också genom att beräkna perplexitet mot grund-sanningbeskrivningarna, och en 80–20 uppdelning tillämpades på scen-nivå så att testning endast utfördes på scener som inte hade använts under träning.

Tillståndet i konsten

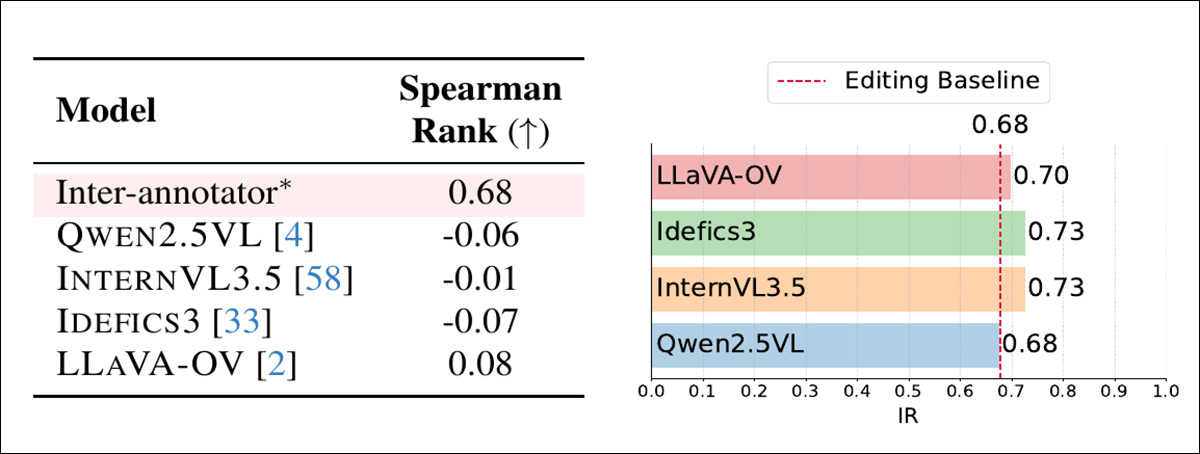

Minnesvärdhetsmedvetenheten hos nuvarande multimodala stora språkmodeller testades. Bilder från LaMem-datasetet visades för flera ledande modeller, som ombads att avgöra om bilden var minnesvärd. Modellens konfidensuppskattning jämfördes sedan med poängen som tilldelats av mänskliga tittare i den ursprungliga studien:

Tester som visar att baslinjemultimodala modeller inte fångar minnesvärdhet. Vänster, Spearman-rankkorrelation mellan modellprediktioner och LaMem-grund-sanningpoäng, med inter-annotatoröverensstämmelse från LaMem visas som referens. Höger, förbättringsförhållande som uppnåddes av nollskottsåterkoppling i förhållande till redigeringsbaslinjen, som visar endast marginella vinster.

Nästan ingen meningsfull korrelation med mänskliga bedömningar hittades, och trots stor skala förutbildning, hävdar författarna att modellerna inte spårade vad människor konsekvent minns.

Exempel från LaMem-datasetet. Övre vänster, ser vi också en värme-karta avbildad för den bilden. Källa

MemCoach

MemCoach fokuserar på semantiska, på-plats-instruktioner som kan utföras innan slutaren trycks – till exempel justering av pose, ändring av interaktioner mellan motiv, eller modifiering av scen-element. Återkopplingen som tillhandahålls av MemCoach varierar från 7 till 102 innehållsord. Minnesvärdhet, hävdar papperet, verkar drivas mer av motivkonfiguration och narrativa signaler än av enkla kompositionella justeringar:

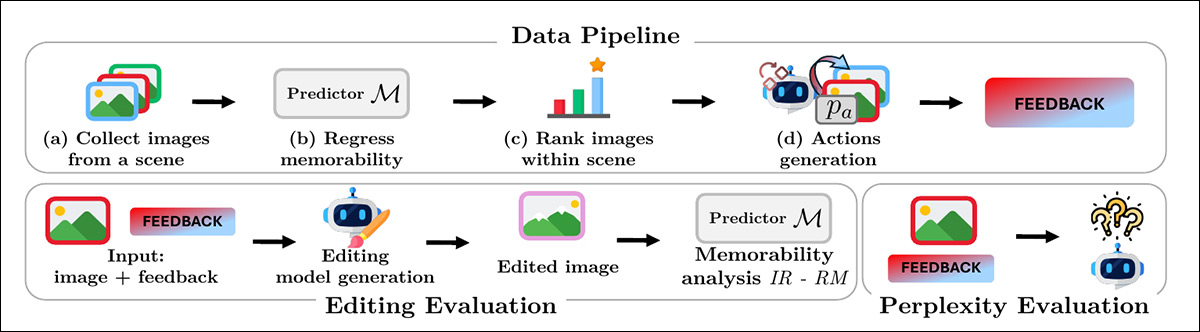

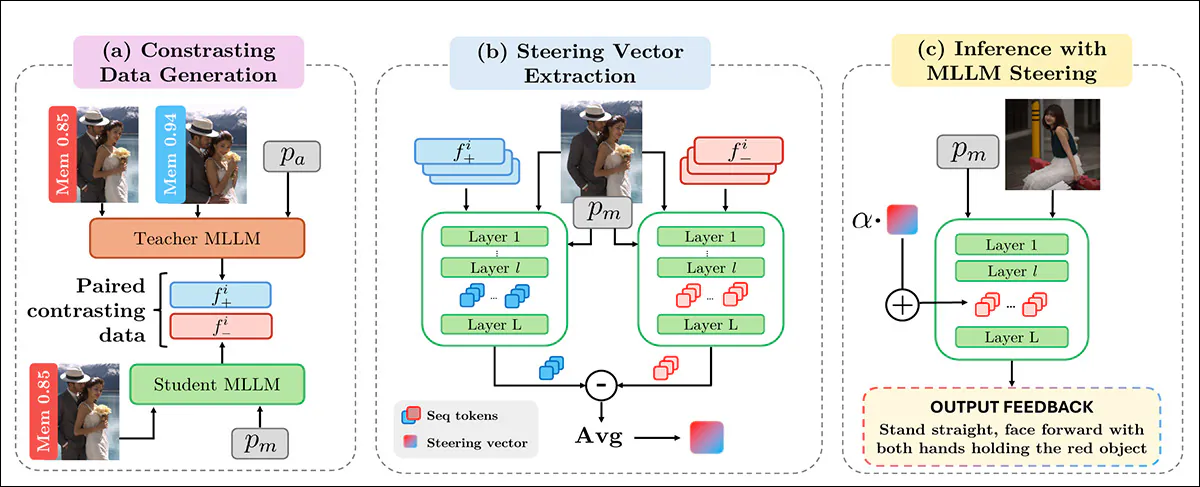

Översikt av MemCoach-pipelinen, där minnesvärdhetsmedveten vägledning från en lärar-MLLM paras med neutrala elevsvar för att bilda kontrasterande data; aktiverings skillnader över lager genomsnitts för att erhålla en minnesvärdhets-styrningsvektor; och den vektorn injiceras vid inferens för att förskjuta elevaktiveringar mot att producera förbättrad, minnesvärdhetsinriktad återkoppling, utan ytterligare träning.

Tester

Sju multimodala stora språkmodeller (MLLMs) användes i testfasen för det nya systemet: Qwen2.5V.L; InternVL3_5-8B; Idefics3-8B; och LLaVA-OneVision-1.5. Dessutom ingick GPT-5 Mini som representant för proprietära, slutna modeller, tillsammans med de estetikspecialiserade Q-Instruct och AesExpert-modellerna. MLLMerna fungerade som nollskott och lärar-orakel.

InternVL3.5 användes för både lärar- och elevmodellerna, med MemBench-träningsuppdelningen använd för att skapa kontrasterande exempel:

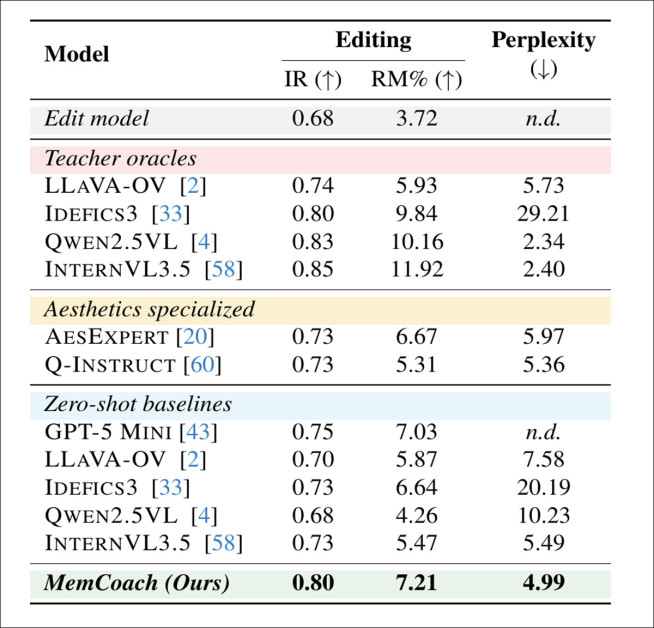

MemCoach-prestanda jämförd med state-of-the-art MLLM över lärar-orakel, estetikspecialiserade modeller och nollskotts-baslinjer, som visar högre förbättringsförhållande och konkurrenskraftig relativ minnesvärdhet tillsammans med den lägsta perplexiteten, vilket indikerar mer konsekvent och minnesvärdhetsinriktad återkoppling.

I tabellen för det första testet (visad ovan) ser vi att MemCoach verkar leverera mer effektiv minnesvärdhetsåterkoppling än någon av de jämförda modellerna – och den styrda InternVL3.5-modellen ökar minnesvärdhet oftare och med en större mängd, med en 5% förbättringsförhållande-vinst över GPT-5 Mini, och en 31,81% hopp i relativ minnesvärdhet över sin ostyrda version.

Det överträffar också estetikfokuserade system, trots att det inte kräver någon extra träning. Lägre perplexitet, hävdar papperet, antyder ytterligare att dess återkoppling följer samma språkliga mönster som mänskliga minnesvärdhetsbedömningar tenderar att belöna:

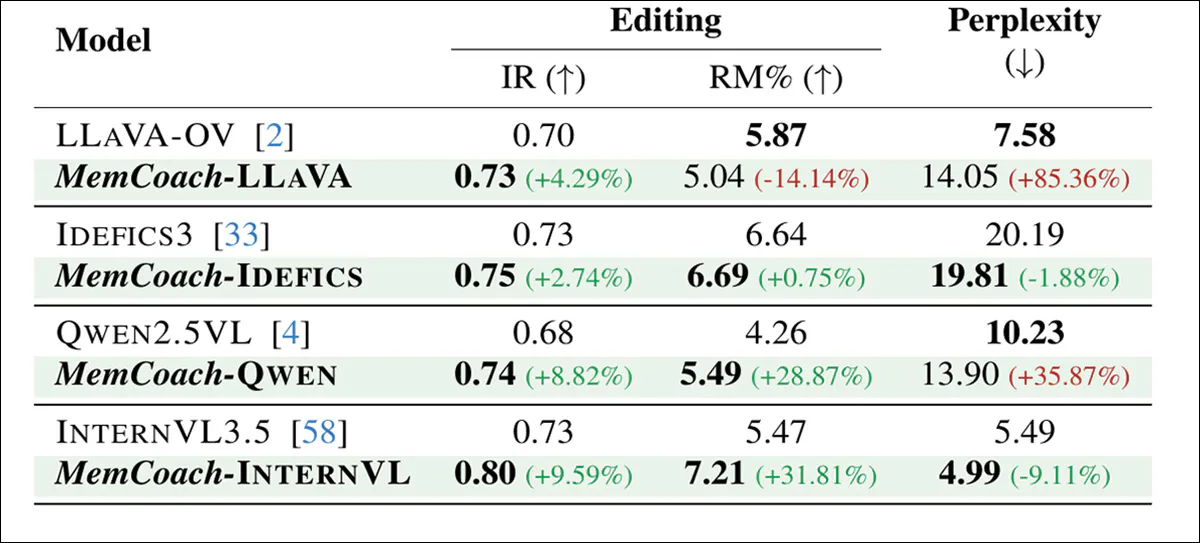

Generaliseringsresultat som visar att MemCoach förbättrar minnesvärdhetsinriktad återkoppling över flera multimodala ryggradsstrukturer, konsekvent ökar förbättringsförhållande och relativ minnesvärdhet samtidigt som det minskar perplexitet för de flesta modeller.

En ytterligare test (se tabell ovan) visar att tillägg av MemCoach förbättrade minnesvärdhetsinriktad återkoppling över varje testad multimodal ryggrad, med konsekventa vinster i förbättringsförhållande och den största hoppet för Qwen2.5VL och LLaVA-OV.

En kvalitativ utvärdering utfördes sedan, med analys av exempel på MemCoach-återkoppling där källbilden, den naturliga språkinstruktionen och den förbättrade resultatbilden undersöktes sida vid sida:

Kvalitativa exempel på minnesvärdhetsinriktad återkoppling genererad av MemCoach. Varje trippel visar källbilden, den naturliga språkinstruktionen och den resulterande redigerade bilden, med relativ minnesvärdhet (RM) som indikerar den uppmätta förändringen. Vägledningen sträcker sig från pose- och blickjusteringar till semantiska ingrepp som föremålsborttagning, vilket illustrerar både lyckade vinster och fall där borttagning av ovanliga element minskar minnesvärdhet.

Av dessa resultat hävdar författarna:

‘Exemplen belyser variationen av förslag som modellen föreslår, som sträcker sig från fina kompositionella justeringar, såsom att ändra blickriktning, pose eller handposition, till semantiska ingrepp som föremålsborttagning eller ansiktsuttrycksförändring.

‘Återkopplingen är naturligt tolkningsbar och handlingsbar, uttryckt i koncisa textinstruktioner (främst innehållande verb “Bring”, “Stand”, “Remove”) som kan implementeras direkt, och effektivt verbaliserar hur man tar ett minnesvärt foto.’

Slutsats

Det vore mest intressant att jämföra metodiken i Googles slutna tillvägagångssätt med MemBench-projektet – inte minst för att veta vilka centrala standarder, referenser och databaser Google använde för att definiera systemets estetiska standarder.

Den negativa aspekten av system av detta slag, öppen eller sluten källkod, är att de i stor skala riskerar att tvinga fram enhetliga standarder som är avsedda att sluta som memes och klichéer – en sorts visuell motsvarighet till AI-strecksdebatter, där den “korrekta” proceduren har blivit något förbannad i informell användning.

* Min konvertering av författarnas inline-citat till hyperlänkar, om länken inte presenteras någon annanstans i artikeln.

† Papperet hänvisar här, liksom på flera andra ställen, till “tilläggsmaterial” som jag inte kan hitta, vare sig från papperet, den grundläggande Arxiv-listningen eller projektsidan.

Publicerad första gången torsdag, 26 februari 2026