Tankeledare

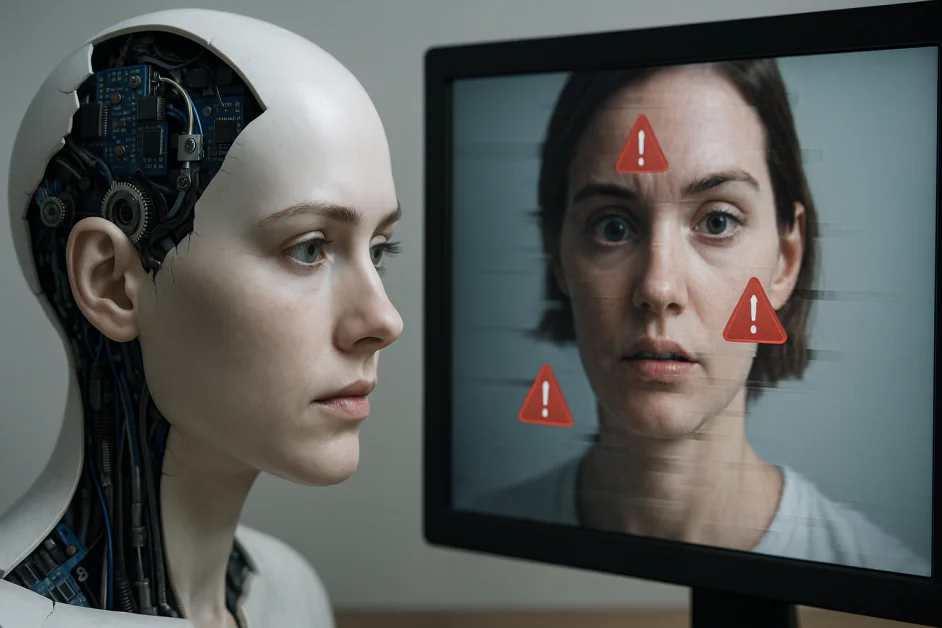

Varför dina AI-bilder kommer med fel — och hur du kan förbättra dem

AI-drivna text-till-bild-genereringsmodeller har vänt upp och ner på digital konst och innehållsskapande, vilket gör det möjligt för alla användare, oavsett bakgrund, att producera högkvalitativa, anpassningsbara visuella element med bara några ord på en bråkdel av den tid det skulle ta en mänsklig proffs med hjälp av klassiska design- eller fotoverktyg.

Med kraftfulla tekniska framsteg blir AI-assisterad kreativitet alltmer en integrerad del av arbetsflöden inom olika branscher. Men att skapa ett färdigt kommersiellt verk med AI är inte bara att trycka på en magisk knapp, eftersom dess “voilà”-effekt inte alltid ger användbara resultat, särskilt för de som förlitar sig på det för att uppfylla professionella konstnärliga och designstandarder.

I verkligheten, medan mästerskap av promptskrivning — det språk AI förstår — är den primära förutsättningen för att uppnå utdata som stämmer överens med ens kreativa vision, kan AI-genererade bilder fortfarande presentera vissa vanliga frustrerande fel, som påverkar inte bara nybörjare utan också erfarna skapare. Att övervinna dessa problem kräver ofta ytterligare kunskap och färdigheter från både användare och utvecklare.

Nedan kommer jag att beskriva de vanligaste utmaningarna i AI-bildgenerering och dela praktiska lösningar för att arbeta runt dem.

Promptteknikens komplexitet

Kärnan i AI-bildgenerering är att förvandla idéer till visuella element på nästan ett ögonblick med bara ord. Men komplexiteten i promptteknik är fortfarande ett av de största hindren för att producera meningsfulla bilder. Även små variationer i ordval kan leda till drastiskt olika utdata. Promptstrukturer kan också variera mellan modeller, så det som fungerar bra i en modell kan producera dåliga resultat i en annan. Avsaknaden av standardisering i promptspråk tvingar ofta användare att gå igenom trial and error.

Promptbibliotek och databaser hjälper till att minska gissningen genom att tillhandahålla testade promptrar som användare kan referera till eller modifiera vid behov. Visuella promptbyggare möjliggör för användare att mata in nyckelord på ett strukturerat sätt, välja attribut, justera reglage och mer, vilket gör processen att skapa en effektiv prompt mer intuitiv. Att lära sig från lyckade promptrar som delas av gemenskapen är också värdefullt, eftersom dessa verkliga exempel visar vad som fungerar.

För att förbättra konsekvensen föreslår standardiserade prompt-syntaxguider bästa praxis för att strukturera nyckelordsinmatning över olika modeller. Användning av promptmallar främjar mer förutsägbara resultat, vilket hjälper användare att generera flera bilder med en konsekvent stil. Nya modeller som FLUX är mer användarvänliga överlag, eftersom de är utformade för att vara mindre känsliga för promptkomplexitet, vilket möjliggör för användare att skapa sammanhängande, komplexa scener från mer raka instruktioner.

Anatomisk inkorrekt

På grund av hur neuronnät lär sig från datamängder, genererar diffusionsmodeller inte bilder baserat på en strukturerad biologisk ram, utan snarare på mönsterigenkänning. Till exempel ser AI inte en hand som en sammansättning av fem distinkta fingrar som kan artikulera olika. Istället blandar den statistiska medelvärden som ses över träningsbilder. Som ett resultat kan avvikelser från förväntade poser eller vinklar orsaka förvrängningar. Medan moderna modeller har förbättrats avsevärt, kvarstår abnormiteter som extra fingrar, onaturliga ansikts- och kroppproportioner, orealistiska lemmar och ledplaceringsfel eller asymmetriska och feljusterade ögon.

Finjustering av modeller med LoRas (Low-Rank Adaptation-teknik) fokuserad explicit på anatomiska datamängder hjälper dem att utveckla en mer omfattande förståelse av mänsklig struktur. ControlNets, särskilt de som använder posestimering eller kantdetektering (såsom Canny-filtren), möjliggör för AI att följa anatomiska riktlinjer.

Promptrar som specifikt hänvisar till realistiska kroppsdetaljer kan också förbättra den anatomiska noggrannheten hos genererade figurer. Efterbearbetning med anatomivara korrektionsverktyg tillåter användare att fixa felaktiga områden utan att regenerera hela bilden.

Identitetsinkonsekvens över flera generationer

Eftersom AI behandlar varje generation som en oberoende process, kvarstår underhåll av en konsekvent karaktärsserie över flera bilder, särskilt problematiskt för berättande eller seriebaserad konst där karaktärskontinuitet är avgörande. Även när man använder samma prompt kan subtila förändringar i ansiktsdrag, kläder eller stil uppträda mellan renderningar. Problemet kan bli ännu mer uttalat i batchgenerationer, där kvalitet och visuella egenskaper fluktuerar oförutsägbart.

Träning av en LoRA på en uppsättning bilder av en specifik person eller föremål och användning av en referensbild som indata kan förbättra identitetsvillkor, konsekvens och enhetlighet. Inbäddningstekniker och adaptrar (såsom PuLID, IPAdapter, InstantID och EcomID) hjälper till att bevara karaktärsegenskaper över generationer. När ansiktsnoggrannhet är kritisk, erbjuder ansiktsutbytesmodeller eller efterbearbetning en mer anpassad finjustering, vilket säkerställer att nyckelfunktioner förblir identiska från generation till generation.

Bakgrundsinkoherens

AI-genererade bakgrunder är benägna att vara orealistiska, strukturmässigt och kontextuellt inkonsekventa, vilket gör att bilderna ser mindre trovärdiga ut. Till exempel kan perspektivet kännas av eller så kan belysning och skuggor inte matcha motivet. Detta beror på att diffusionsmodeller uppfattar bakgrunden som en sekundär komponent snarare än en integrerad del av scenen, vilket resulterar i problem med djupperception, objektkorrelation och miljökontext.

Djupkartering hjälper modeller att tolka rumsliga relationer mer exakt, vilket underlättar en mer realistisk integration mellan förgrunden och bakgrunden. Perspektivguider tvingar geometrisk justering, vilket hjälper till att hålla arkitektoniska strukturer och försvinnande punkter konsekventa. Fokuserad omlysning LoRas kan lära sig att generera belysning och skuggor tillsammans med bakgrunden, vilket säkerställer att reflektionerna beter sig naturligt i hela scenen.

Finjustering av modeller på datamängder med specifika miljöer (såsom stadslandskap, naturscener eller inomhusutrymmen) kan förbättra den övergripande bakgrundsrealismen. Referensbakgrundsbilder hjälper också till att fästa generationen till verkliga kompositioner.

Textrenderingsproblem

Tränade främst på visuella data, inte strukturerad språk, kämpar AI med att generera läsbara ord och fraser inom bilden. Texten kan se ofullständig, nonsens, sammanblandad eller meningslös ut, med oregelbundna teckensnitt eller feljusterad placering. När den är läsbar kan den fortfarande se stilistiskt av eller otympligt integrerad i bakgrunden.

Till skillnad från människor, känner de flesta AI-modeller inte igen text som skild från omgivande element, så de behandlar den inte som en separat entitet. Istället behandlar de teckensekvenser som ett annat visuellt mönster med abstrakta former snarare än meningsfulla semantiska symboler.

För att förbättra textrenderingskvaliteten tränar forskare modeller på specialiserade textdatamängder som innehåller korrekt märkta typografiexempel som hjälper AI att bättre förstå bokstavsformering, justering och avstånd. Textmedveten maskering är en annan effektiv teknik när tomma områden reserveras för text under bildgenerering, vilket möjliggör renare integration under efterbearbetning.

Brist på kontroll över utdata

Medan resultaten kan vara visuellt imponerande, härrör en betydande begränsning av AI-bildgenerering från bristen på exakt kontroll över den slutliga utdatan. Användare kan kämpa för att styra modellen mot specifika stilar, säkerställa realism eller justera fina detaljer. Andra vanliga fel inkluderar oväntade element i scenen, störande färger och layoutinkonsekvens. Till skillnad från mänskliga konstnärer, som justerar med avsikt, opererar AI probabilistiskt, ibland resulterande i överraskande eller oönskade resultat.

Kontrollmekanismer, såsom ControlNets och LoRas, tillåter användare att villkora struktur genom pose, djup eller kantvägledning. För mer exakt estetisk styrning kan anpassade modeller tränade på specifika stilar avsevärt förbättra samstämmighet i konstnärlig riktning. Dessutom hjälper referens till en specifik bild genom bild-till-bild-generering till att upprätthålla utdatans relevans.

Maskering och inpainting-verktyg möjliggör redigering av specifika delar av en bild utan att påverka resten. Efterbearbetningsverktyg, såsom uppskalnings- och förbättringsverktyg, kan lägga den sista poleringen till AI-utdata genom att förbättra upplösning och klarhet.

Sammanfattningsvis har AI ännu inte utvecklat en mer sofistikerad och nyanserad prompttolkning — en utmaning som förblir en av de centrala för att upprätthålla kontroll. Många modeller tenderar att övertolka instruktioner, försöka utvinna djupa eller lagerade betydelser där de inte är avsedda. Medan detta låter intelligent, kan till och med en detaljerad prompt producera oförutsägbara resultat. Till exempel kan AI betona eller uppfinna oväntade element baserat på associationer den har lärt sig. Det ökar komplexiteten i promptskapande, vilket kräver att användare anpassar sig till hur modellen “tänker” (vilket inte alltid är intuitivt) och tillbringar mer tid med att experimentera med ordval för att uppnå det önskade resultatet.

Slutliga tankar

Att förstå hur AI tolkar visuell data — och erkänna var den tenderar att brista — möjliggör för smartare val i promptskrivning, effektiva problemlösningsstrategier och urval av rätt verktyg för att arbeta runt förekommande generationsfel. I slutändan ger det användare möjlighet att arbeta med AI som en kreativ partner snarare än att förlita sig på tur eller se dess tekniska begränsningar som avgörande hinder för att skapa användbart innehåll som återger skaparens vision.