Andersons vinkel

Användning av ‘sannolikhet’ som en metod för upptäckt av deepfakes

Om AI-genererade videor och ljud blir tillräckligt bra, kommer deepfake-detektorer som bygger på visuella artefakter eller andra traditionella signaler inte att fungera längre. Men med tanke på hur sällan människor avviker från förutsägbar beteende, kan kanske ‘sannolikhet’ antas som en signal för om en video eller en nyhetsrykte troligen är sann.

Åsikt I början av 1990-talet avslöjade den respekterade före detta brittiska fotbollsspelaren och TV-sportkommentatorn David Icke oväntat på en pratshow att han var ‘Guds son’ – en bisarr och oväntad avslöjande som skulle utvecklas under de följande decennierna till en bestående och elaborerad konspirations-teori om en hemlig och mäktig global kabal av ‘ödla-människor’.

Med internet-användning fortfarande flera år bort, och sociala medier ännu längre in i framtiden, hade den renodlade dissonansen mellan Ickes berömmelse och naturen hos hans nya insikter en djup inverkan på den brittiska allmänheten – inte minst på grund av den fullständiga bristen på sammanhang eller någon form av förberedelse för denna massiva vändning, från en välkänd och etablerad sportpersonlighet.

Mer än tjugo år senare inträffade en liknande och mycket mörkare variant av denna samhälleliga chock, när den älskade välgörenhets-kampanjören och barn-TV-värden Jimmy Savile postumt befanns vara en seriell och rapace livslång sexförbrytare som hade använt sin oskuldsfulla offentliga bild för att underlätta sina brott.

Den efterföljande Operation Yewtree polisutredning skulle avslöja många fler brittiska kändisar med långa historier av sexbrott; senare skulle Harvey Weinsteins åtal leda till en liknande upptäckt av kändis-sexförbrytare i USA, som skulle utvecklas till #metoo-rörelsen, och permanent integreras i amerikansk kultur i utgåvor som The Morning Show. ‘Chock’-nyheter tycktes utveckla en ny och plötslig mall – en som skulle så småningom antas av deepfake-angripare.

Slutet för ‘traditionell’ deepfake-detektion?

Även om sociala medier och AI hade funnits tillgängliga i början av 1990-talet, kunde ingen förutsägelsesystem i världen ha förutsett Ickes pratshow-avslöjanden, som (såsom jag väl minns) inte alls var förskuggade i åren som ledde upp till händelsen.

Men om AI hade funnits tillgängligt, skulle det kanske ha tagit några månader att övertyga en bredare publik om att Ickes uttalanden inte var produkten av Google Veo 3, eller någon annan av de nya hyperrealistiska ljud-/videodeepfake-ramverken.

Det är bara under de senaste 6-12 månaderna som AI-deepfake-metoder har blivit tillräckligt effektiva för att uppfylla års medie-doom-saying om deepfake-valinterferens, och kapabla att generera den typ av snabb-strike ryktesfläck som är falskt, men svårt att utplåna i en alltmer lättlurad kultur.

Hittills har AI-videoutmatning vanligtvis fallit kort av sann realism, begränsad av tekniska hinder och alltmer polariserad av ett växande gap mellan restriktiva västerländska modeller och Kinas ocensurerade öppna källkodsutgåvor**.

Trots allt märker jag en alltmer närvarande koncession av denna kalla kriget, till exempel i den nya artikeln Performance Decay in Deepfake Detection†:

‘[Vi] antar att deepfake-videor kommer att fortsätta innehålla maskinlärande funktioner som tillförlitligt skiljer dem från äkta videor. När generativ AI:s förmågor fortsätter att utvecklas snabbt, kan denna antagande mycket väl bryta samman.

‘I ett sådant scenario kommer vattenstämpel och andra proveniensspårningsmetoder att erbjuda den enda återvändsgränden för att upprätthålla förtroendet för digitala medier.’

Men samma artikel medger att proveniensbaserade lösningar, såsom Adobe-ledda Content Authenticity Initiative (och de många mindre forsknings erbjudanden under de senaste 7-8 åren) kräver en sådan omfattande antagande att det är orealistiskt; och artikeln avslutas med en allmän not om reträtt, om inte nederlag.

Om audiovisuella deepfake-detektionsmetoder utvecklas av generativ AI, och global antagande av en intrusiv vattenstämpel eller proveniensschema faller vid de diversa logistiska hindren, vad kan då en gemensam central funktion ersätta dem som indikatorer för potentiellt falskt utmatning? Eller måste vi resignera oss till en värld där all media är tvivelaktig, och Lögnens Dividend råder?

Kunskapsgrafer

Det verkar som att det är dags att mer djupt utnyttja sannolikhet och sannolikhetsbedömning av ‘rapporterade händelser’ som en signal-egenskap i deepfake-detektion. Dessutom, eftersom video- och ljud-generativ AI-system alltmer konvergerar, kan det också vara dags för de separata forskningssträngarna för ‘falska nyheter’ (som en textbaserad berättelse-händelse) och falska bilder/video att likaså konvergera.

En sannolikhet-deepfake-mätning är inte samma sak som RAG-assisterad fakta-verifiering, där en AI-modell kan hämta in aktuella webbresultat för att få kunskap om händelser som inträffar efter dess egen avstängningsdatum, och/eller för att bekräfta dess påståenden.

Istället skulle den utföra förutsägelser baserade på allmänt indikativa statistiska trender, som härrör från historiska mönster som överensstämmer med en aktuell förfrågan.

I denna mening är en sannolikhet-metod närmare statistisk analys än mer moderna trådar i den nuvarande maskinlärnings-scenen.

Även om de tidigare överträffades av mer moderna Transformers-era-ansatser, kunskapsgrafer gör en sorts comeback i företags-världen, och verkar anpassade för den potentiella distributionen av ‘sannolikhet’-metoder i deepfake-detektion.

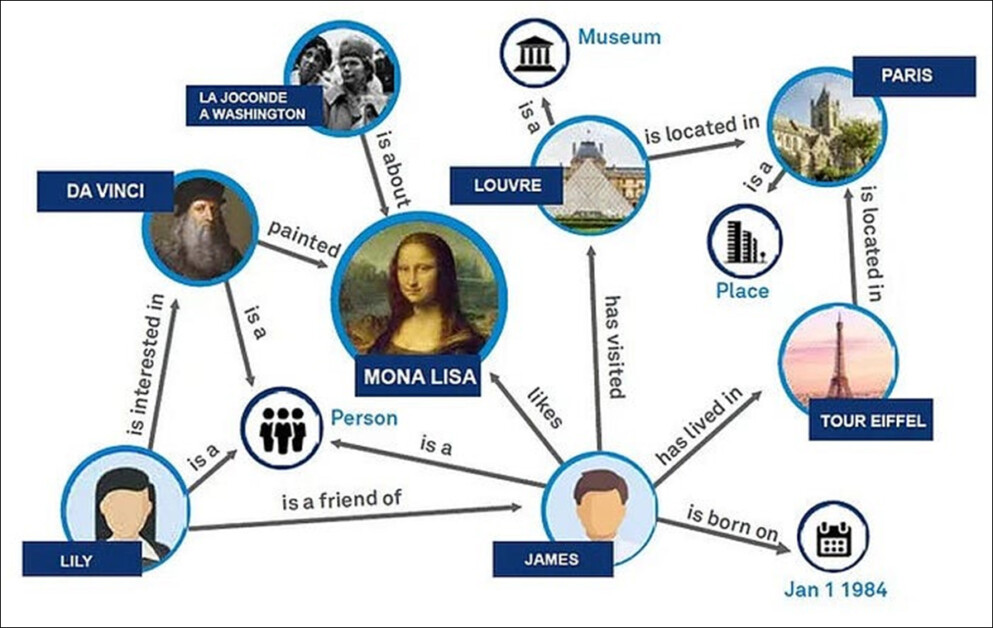

En förenklad kunskapsgraf som visar hur människor, platser, konstverk och händelser kan kopplas samman genom märkta relationer, vilket möjliggör för maskiner att resonera över verkliga entiteter och deras samband. Källa

En kunskapsgraf är ett sätt att organisera information genom att mappa verkliga saker som människor, företag, händelser eller idéer till ett nätverk av sammankopplade fakta.

Varje under-enhet är en nod, och länkarna mellan dem (kanter) beskriver hur de relaterar till varandra. Till exempel kan ‘Microsoft’ (en nod) kopplas till ‘OpenAI’ (en annan nod) av en kant som säger ‘är en kund till’. Dessa anslutningar lagras ofta i graf-databaser och följer en subjekt-predikat-objekt-struktur, som ‘Microsoft är en kund till OpenAI’.

Bestående Minne

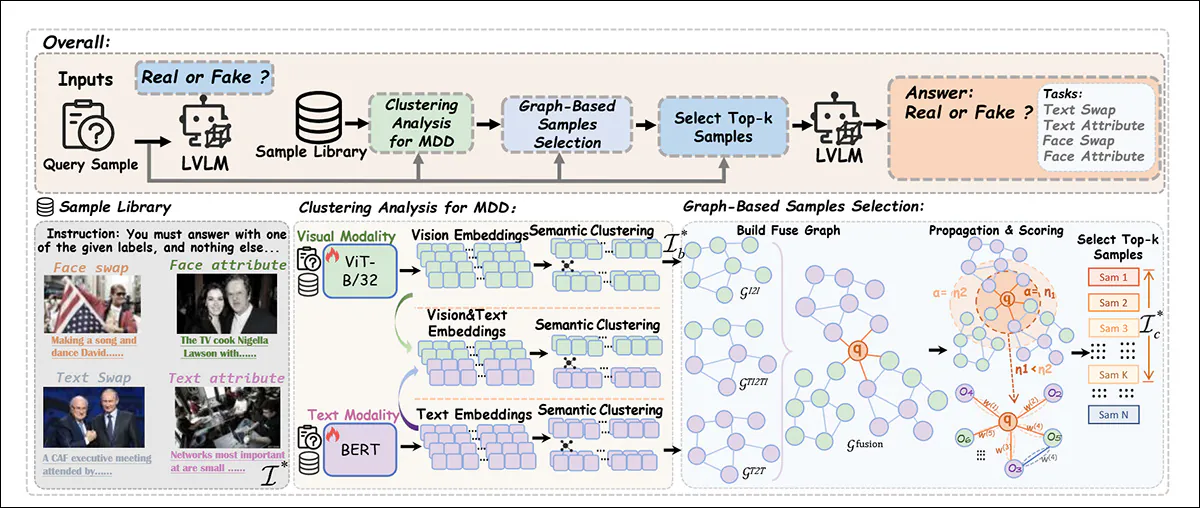

En kinesisk studie från september i år föreslog en träningsfri metod som använder graf-baserad resonemang för att upptäcka subtila inkonsekvenser i multimodala deepfakes.

Istället för att generera motiveringar eller finjustera stora modeller, hämtar systemet bild-text-par, bygger en likhetsgraf och poängsätter anslutningar, för att hämta de mest relevanta exemplen, och dessa vägleder modellens bedömning utan behov av ny utbildning:

En översikt av GASP-ICL-ramverket, som förbättrar deepfake-detektion genom att kombinera graf-baserad exempelval med in-context-lärande, vilket tillåter en frusen vision-språk-modell att klassificera bild/text-par som äkta eller falska, utan utbildning eller finjustering. Källa [https://www.arxiv.org/pdf/2509.21774](https://www.arxiv.org/pdf/2509.21774)

Detta är troligen den närmaste arbetet, åtminstone det som har kommit i min väg, till en ‘informerad’ och historie-medveten ansats för utvärdering och verifiering av ny media-utmatning. För det mesta fortsätter datorseende-ansatser att analysera bilder (inklusive bildrutor av videor och temporala anomalier som omfattar flera bildrutor) medan ‘falska nyheter’-detektions-ramverk fortsätter att betona textbaserad data, även i multimodala projekt.

Funktions-krypning

Utgörandet av en förutsägelsesystem av detta slag är den omfattande övervakning som kan vara nödvändig för att göra ansatsen fullt ut funktionell – åtminstone bortom analysen av kändisar och offentliga personer, för vilka fritt tillgängliga data redan existerar.

Troligen den mest liknande nuvarande strängen i forskningen är fältet för-brott, som märker olika multimodala intelligens-signaler som ‘misstänkta’, och presenterar sig som en trogen AI-skräckduk i utgåvor som Jonathan Nolans Person of Interest (2011-2016), och Steven Spielbergs Minority Report (2002).

Medan ett Person of Interest-liknande allomfattande övervakningssystem skulle producera optimala resultat, är det osannolikt att västerländsk kultur för närvarande kunde sanktionera den nivå av personlig intrång som Kinas interna nätverk påtvingar sina medborgare.

Därför, i fråga om potentiellt falska nyheter om icke-kändisar, skulle endast myndighetsorgan, såsom polisen (såväl som födelse- och dödsregister och skattemyndigheter) ha tillräckligt med relevant historisk information för att informera sannolikheter i en graf-baserad arbetsflöde; och även de skulle behöva CCCP-stil, vilja, kapacitet, lagstiftning och resurser för att inkludera genomsnittliga medborgare i sin täckning och analyser (dvs. bortom banala men obligatoriska data-punkter som pass-nummer och bilregistreringar).

Sannolikhets-poängsättning

Det verkar troligt att den potentiella effektiviteten hos ett system av detta slag skulle vara begränsad till de mest uppenbara (nuvarande) användningsfallen för deepfake-innehåll: destabilisering (stats-stödda deepfakes); kändis- och ‘okänd’ porr-deepfakes (som båda kan anses vara elaka, även om den senare fallet tenderar att dra till sig djupare medie-oro); bedrägeri (inklusive audio/video-deepfakes som är utformade för att utföra ‘impersonation-rån’); och politisk karaktär-mord.

Ett kunskaps-baserat system skulle behöva en skala av sannolikheter för en mångfald av möjliga händelser. I ena änden av spektrumet, vanliga mänskliga svagheter som tveksam ekonomisk hantering, otrohet, beroende, oaktsamhet, etc.; i den andra änden… att avslöja att du är Guds son på en live-TV-pratshow (eller händelser av liknande skala och inverkan).

Även i det senare fallet skulle personliga historiska faktorer för varje enskild individ väga sannolikhets-resultatet: en framstående politisk figur som offentligt har tvivlat på kontroversiella frågor (såsom sanningen om 1960-/70-talets månlandningar) för att vinna kapital hos en alltmer ‘alternativt’-informerad väljarkår, kan vinna extra wildcard-status i verifierings-rutiner, jämfört med deras mer återhållsamma kollegor.

I fallet med kändis-porr, finns det tillräckligt med verkliga sammanhang (dvs. 2012 års kändis-foto-läckor, bland andra – ganska sällsynta – incidenter) för att generera en måttlig Lögnens Dividend, i vissa sammanhang; men eftersom dessa outlier-incidenter tenderar att fungera som undantag som bekräftar regeln, skulle de flesta av de nuvarande kändis-porr-videor som genereras med diffusion-baserade metoder anses vara extremt ‘osannolika’ (även om detta inte löser problemet med att appropriera människors identiteter för sådana ändamål).

I termer av nationell störning, finns det en betydande mängd statistisk data som kan hjälpa till att bedöma sannolikheterna för ‘katastrofala’ rapporter. Även i forntida historia, tycktes ‘out-of-the-blue’-händelser som vulkanen Vesuvius utbrott 79 e.Kr. vara förskuggade, om man hade uppmärksammat tillräckligt; och förutom tillgängligheten av en mängd olika regerings- och NGO-stödda flöden, kan AI:s utvecklande förmåga att extrahera struktur från rådata ge ytterligare historisk sammanhang för sannolikhets-poängsättning.

Slutsats

Även ett välgenomfört förutsägelsesystem av detta slag kunde inte ta hänsyn till slumpmässig chans, gudomliga ingripanden, udda förekomster eller elaka händelser som konstruerats bortom all tillsyn.

Dessutom skulle den renodlade volymen och djupet av data som behövs, för att ge täckning även för icke-kända personer, vara en politisk strävan – åtminstone för tillfället.

Men valet verkar vara att minska; vision-baserad analys är redo att misslyckas inför den förbättrade generativa AI:n, medan verifierings- och proveniens-scheman bär en hämmande börda av teknisk skuld, och friktion mot antagande. Detta gör lösningar som Content Authenticity Initiative, och det outförverkligade Metaphysic.ai ansikts-upphovsrätts-system Metaphysic Pro, utmanande att popularisera.

I deras bredaste användning, kan RAG-baserade system bara bestämma om en auktoritativ källa stöder ett overifierat påstående; och eftersom många stora (sanna) nyhets-historier uppstår utan föregående sammanhang, är bristen på underlag från auktoritativa källor inte nödvändigtvis meningsfull.

Deras värde kan visa sig vara större om de kan bilda en del av ett större data-ekosystem som är involverat i den enda saken som de flesta former av AI har svårt att hantera – historisk sammanhang.

* Inte att förväxlas med de tidiga autoencoder-utgåvorna som debuterade 2017 och skulle så småningom ersättas av överlägsna ansatser.

† https://arxiv.org/abs/2511.07009

** Som vanligtvis kan köras fritt på mer kraftfulla hem-datorer, istället för att bara vara tillgängliga via gate-hållna API:er som ChatGPT och Veo-serien.

††† Uteslutande legitima underhållnings-ändamål, såsom professionella visuella effekter i film- och TV-produktioner.

Publicerad första gången torsdag, 13 november 2025