Andersons vinkel

Verbositet minskar noggrannheten i stora språkmodeller

Ny forskning visar att det att tvinga stora språkmodeller att ge kortare svar märkbart förbättrar noggrannheten och kvaliteten på deras svar.

Den som har försökt att stoppa en chatbot från “prata för mycket” känner igen slutsatserna från ny forskning: att tvinga AI att ge kortare svar gör den mer exakt.

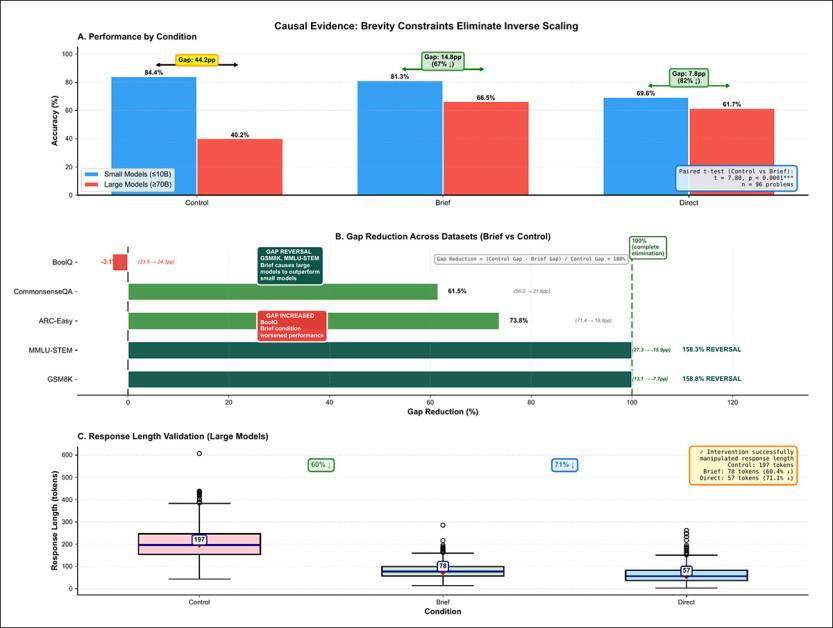

Genom att undersöka varför större AI-chatbotar presterar sämre i detta avseende än mindre, i vissa fall (kända som invers skalförändring), fann forskningen att att tvinga 31 populära stora språkmodeller (LLM) att ge kortare svar orsakade upp till 26,3 procents förbättring av noggrannheten i deras svar:

‘Resultaten ger övertygande kausala bevis: begränsningar av verbositet förbättrade stor modellnoggrannhet med 26,3 procentenheter och minskade gapet för invers skalförändring med 67% (från 44,2% till 14,8%, parvis t-test: t = 7,80, p < 0,0001).'

Överdriven verbositet är ett vanligt klagomål bland slutanvändare, inte minst bland dem som använder kommersiella modeller som ChatGPT, där supportforum innehåller detta ämne ofta.

Det domän som påverkas mest av att åtgärda verbositet i svaren är matematik, där de testade AI-modellerna begränsades till att svara på 50 ord eller mindre. För läsförståelse-uppgifter begränsades de till att svara med bara 10 ord.

Forskningsartikeln definierar AI:s tendens till verbositet som överanalys, där det centrala meddelandet inte bara döljs av verbiage, utan ibland även påverkas negativt av det. Ju mindre modellen är, observerar artikeln, desto mindre behövs denna åtgärd, eller fungerar den.

Forskningen slutsats är att det inte finns något arkitektoniskt som behöver åtgärdas för att tillämpa denna lösning systematiskt. Men i en användares chatsession skulle en direktiv mot verbositet troligen behöva upprepas, medan ett globalt tillämpat systemprompt – som skulle behöva implementeras som en ingenjörsstandard på plattformar som ChatGPT – kunde göra kortare svar till standardbeteende.

Blåsiga vindar

Ingenting av detta förklarar exakt varför större modeller tenderar mot verbositet, eftersom detta är något som påverkar öppen källkodmodeller också. Artikeln föreslår att protokoll och vanliga metoder i förstärkt inlärning från mänsklig feedback (RLHF) tekniker kunde erbjuda en förklaring*:

‘En trolig ursprung är RLHF-justeringsutbildning, där mänskliga annotatorer belönar grundlighet oproportionerligt i större modeller med större kapacitet att agera på längdbelöningsignalerna – förenligt med verbositets skillnader som är större i instruktionsjusterade än basmodellvarianter.

‘Tidigare arbete dokumenterar systematisk längdbias i belönings modeller, där annotatorer förväxlar längd med kvalitet.

‘Större modeller, som har större kapacitet att tillfredsställa längdbelöningsignalerna, kan internalisera verbos generation mer djupt än mindre modeller, vilket producerar den skalfördelade överanalysen som vi observerar.’

Hos människor kan verbositet förekomma för att fylla i en tystnad, eller för att maskera känslor av obehag, på grund av mentalsjukdom, eller för att dölja brist på kunskap. I verkligheten kunde en AI endast påverkas av dessa faktorer genom absorption av utbildningsdata som reflekterar/manifest dessa egenskaper.

I datamängder finns andra motiv för prolix svar, såsom SEO-incitament att producera längre textinnehåll, till exempel i receptinlägg, där längd ofta förknippas med auktoritet.

Vad som inte kan uteslutas helt är att API-baserade plattformar, som uppmuntras att sporra användare till en högre och dyrare prenumerationsnivå, antingen uppmuntrar eller inte övervakar verbositet, eftersom det ökar tokenanvändning ganska billigt, utan behov av överdriven resonemang eller RAG-samtal†.

Den nya artikeln har titeln Brevity Constraints Reverse Performance Hierarchies in Language Models, och kommer från datavetenskapsavdelningen vid Sveriges polytekniska institut i Chattogram, i Bangladesh.

Metod

För att testa artikelförfattarnas teorier utvärderades 31 språkmodeller – för många för att lista i textform här, men avbildade i bilden nedan:

De stora språkmodellerna (LLM) som testades i olika delar av försöken för den nya artikeln.

Modellerna utvärderades mot fem benchmark-samlingar: GSM8K, för matematiskt resonemang; BoolQ, för läsförståelse; CommonsenseQA, för sunt förnuft; ARC-Easy, som täcker vetenskapsfrågor; och MMLU-STEM, också för vetenskaplig kunskap.

Svar genererades med girig avkodning för att säkerställa deterministiska utdata, sedan extraherades med uppgiftsspecifika regler, med noggrannhet mätt som andelen korrekta svar mot grund sanning.

Modellerna delades upp efter storlek, med de som var under eller lika med tio miljarder parametrar behandlades som “små”, och de över sjuttio miljarder som “stora”, baserat på observerade prestandagap.

Att utesluta återkallande

För att utesluta möjligheten att modellerna enbart återkallade utbildningsdata, genomfördes tre separata kontroller, som undersökte hur varierande svaren var; hur mycket deras längd fluktuerade; och hur fel gjordes. Om modellerna förlitade sig på inlärda mönster, skulle svaren tendera att upprepa eller följa fasta mallar; istället visade sig svaren vara mestadels unika över modellerna, med märkbar variation i längd, från ett svar till ett annat.

Felen undersöktes direkt, med de flesta misslyckanden i form av långa, felaktiga förklaringar, snarare än korta, undvikande svar – vilket indikerar att modellerna genererade faktiskt resonemang, snarare än att hämta lagrade svar.

Data och tester

Vid testning för enskilda frågor snarare än rubrikscore, visade sig en stor andel av benchmark-uppgifter vara oinformativa, med 27,1% som inte kunde skilja modellerna åt alls, eftersom antingen alla system lyckades eller alla system misslyckades, vilket lämnade inget riktigt signal om relativ prestanda:

Uppgiftsvis fördelning över fem benchmark-samlingar visade att en betydande andel av uppgifterna inte kunde skilja mellan modellerna, medan en mindre men konsekvent andel visade invers skalförändring, där mindre modeller presterade bättre än större. Den totala fördelningen över 1 485 problem indikerar att 7,7% visar invers skalförändring. Källa

Bland de frågor som verkligen differentierade modellerna, betedde sig de flesta som förväntat, med större system som presterade bättre, men en mindre grupp som visade det motsatta mönstret, med mindre modeller som gick segrande ur.

Invers skalförändring uppkommer

Över de fem benchmark-samlingarna hittades 115 problem där mindre modeller presterade bättre än större, vilket utgjorde 7,7% av alla 1 485 uppgifter, vilket indikerar att invers skalförändring inte är någon sorts sällsynt eller marginell företeelse i detta sammanhang.

I verkligheten visade sig effekten i varje datamängd: mest påtagligt i BoolQ, och mer svagt i CommonsenseQA, ARC-Easy, GSM8K och MMLU-STEM, vilket indikerar att det är utbrett, men varierar beroende på uppgift:

Invers skalförändring uppkom över alla benchmark-samlingar, från 3,9% i MMLU-STEM till 11,3% i BoolQ, med 115 problem totalt. Prestandagapen gynnade mindre modeller med i genomsnitt 28,4 procentenheter. Noggrannheten minskade allteftersom modellstorleken ökade, med små modeller som nådde 66,1%, jämfört med 41,5% för större modeller.

Gapet visade sig vara betydande, med mindre modeller som gynnades med i genomsnitt 28,4 procentenheter, och varje fall visade samma riktning på fördel, vilket indikerar en konsekvent minskning av prestanda, snarare än tillfälliga eller ad hoc-fel.

Samma mönster hölls över olika modellfamiljer, inklusive Llama, Qwen, Gemma och Mistral, där större versioner underpresterade mindre, med noggrannhet som tenderade att minska allteftersom modellstorleken ökade på dessa problem.

Gapet mellan små och stora modeller var tillräckligt stort för att slumpen skulle vara osannolik att förklara det; och eftersom samma mönster visade sig över olika benchmark-samlingar, uppgifter och modellfamiljer, uppkom invers skalförändring som en konsekvent snarare än slumpmässig effekt.

Vid en närmare granskning inom varje modellfamilj, presterade större versioner upprepade gånger sämre än mindre på dessa problem, vilket tyder på att minskningen kan vara kopplad till skalan i sig, snarare än till skillnader i design.

Resultaten pekar också på en gräns för varje uppgift, där en ökning av modellstorleken börjar skada prestanda, vilket visar att större modeller inte alltid leder till bättre resultat.

Att undersöka överanalys

Efter att ha etablerat att större modeller ibland presterar sämre på vissa domäner, vände analysen till varför detta sker, och föreslog att problemet inte är brist på förmåga, utan för mycket förklaring – d.v.s. fall där längre svar börjar skymma korrekt resonemang.

Över hela datamängden var längre svar kopplade till lägre noggrannhet på dessa svåra problem, även om stora och små modeller producerade ungefär lika många resonemangssteg, vilket tyder på att problemet inte är hur mycket resonemang som görs, utan hur det uttrycks:

Kortare svar förbättrade stor modellprestanda och minskade gapet med mindre modeller, från 44,2 procentenheter till 14,8 (och i vissa fall vände det helt), medan direkt svarsmönster minskade det ytterligare. De starkaste vinsterna visade sig i GSM8K och MMLU-STEM, där rankingarna vändes till fördel för större modeller, och kontroller av svarslängd bekräftade att ingreppet fungerade, med utdata som minskade från runt 197 token till under 80, vilket kopplar minskad verbositet till förbättrad noggrannhet.

När svaren tvingades att vara kortare, förbättrades stora modeller kraftigt, och minskade ett betydande prestandagap, och i vissa fall nästan eliminerade det. Omvänt förändrades små modeller mycket lite, vilket indikerar att verbositet aktivt skadade större system.

Effekten visade sig variera beroende på uppgift, med vissa benchmark-samlingar som drog nytta av kortare svar, och andra som krävde en viss grad av förklaring; men i flera fall vändes rankingen mellan små och stora modeller helt när verbositet begränsades, vilket visar att större modeller hade en dold förmåga som skymdes av överelaborering.

Ytterligare analys visade att stora modeller tenderade att producera längre utdata overall, trots att de använde något färre explicita resonemangssteg, vilket indikerar en mer diffus och mindre strukturerad stil av resonemang.

Omvänt gav små modeller kortare, mer direkta svar, vilket tyder på att sättet resonemang uttrycks, snarare än mängden resonemang i sig, driver minskningen av prestanda.

Författarna slutsats är att begränsningar av verbositet bringar noggrannhetsfördelar, och anser att detta kunde bli en grundläggande funktion i språkmodeller, snarare än en upprepad, användarapplikation som inte överlever över sessioner; och de påstår:

‘[Brevity] begränsningar hjälper stora modeller dramatiskt medan de knappt påverkar små modeller.

‘Om verbositet vore oväsentligt snarare än kausalt, skulle enhetliga noggrannhetsförändringar förväntas över båda storlekskategorierna. Den differentierade responsen bekräftar att överanalys är en skalfördelad felmod, inte en uppgiftssvårighets effekt.’

Slutsats

Utöver de öppna källkodsversioner som testades av forskarna, verkar problemet med verbositet, anekdotiskt, med en viss frekvens över många stora modeller utöver ChatGPT, inklusive Claude, Gemini och Grok.

Oavsett om dessa plattformar försummar problemet med verbositet eftersom det ökar tokenanvändning och uppmuntrar högre utgifter†, verkar det inte rimligt att de skulle acceptera minskningen av noggrannhet som följer med denna “uppmuntran”.

Det vore intressant att se om någon empirisk metod kunde bestämma med säkerhet var tendensen till verbositet kommer ifrån. Den som har försökt att få en chatbot att faktiskt prata, snarare än att “blogga” verbosa, flerstegssvar till användaren, har insett att modellen har blivit allvarligt präglad av “allt-i-ett”-användarhandböcker och “accepterade lösningar” i sin utbildningsdata.

Det vore därför mycket intressant att se om en modell som specifikt tränats på steg-för-steg-samtal kunde faktiskt undvika den verbosa, sammanfattningsbenägna tendensen. Men det verkar troligt att vissa begränsningar eller filter skulle behöva placeras på den vikt som modellen tränas att ge på det “beslutade” svaret, så att den tränar direkt också på det föregående materialet – i princip, det explicita resonemanget som är uttryckt i turordningsbaserade samtal.

Eftersom lämpliga data av detta slag verkar sannolikt vara sällsynta, kanske den enda vägen framåt med denna metod vore via syntetiska data, där “sammansatta” slutkonklusioner plockas isär konversationsvis – ironiskt nog, på samma sätt som AI-podcasts som Google NotebookLM kan tolka från vanlig textinmatning.

* Min omvandling av författarnas inline-citationer till hyperlänkar.

† Men låt oss vara ärliga, underskottet mellan faktiska AI-kostnader och prenumerationsavgifter är för närvarande så stort att detta bara skulle skada användarbasens rykte utan att lösa den allvarliga ekonomiska situationen i denna fas av “omvandling” och “konvergens” av AI.

Publicerad första gången söndag, 5 april 2026