Artificiell intelligens

MagicDance: Realistisk generering av mänsklig dansvideo

Datorseende är ett av de mest diskuterade områdena inom AI-branschen, tack vare dess potentiella tillämpningar över ett brett spektrum av realtidsuppgifter. Under de senaste åren har datorseendeframework har utvecklats snabbt, och moderna modeller kan nu analysera ansiktsdrag, objekt och mycket mer i realtids-scenarier. Trots dessa förmågor kvarstår mänsklig rörelseöverföring som en formidabel utmaning för datorseendemodeller. Denna uppgift innebär att omriktning av ansikts- och kroppsrörelser från en källbild eller video till en målbild eller video. Mänsklig rörelseöverföring används i stor utsträckning i datorseendemodeller för bild- och videoredigering, multimediainnehållsredigering, digital mänsklig syntes och till och med generering av data för perceptions-baserade ramverk.

I den här artikeln fokuserar vi på MagicDance, ett diffusionsbaserat modell som syftar till att revolutionera mänsklig rörelseöverföring. MagicDance-ramverket syftar specifikt till att överföra 2D-mänskliga ansiktsuttryck och rörelser på utmanande mänskliga dansvideos. Dess mål är att generera nya pose-sekvens-styrda dansvideos för specifika målidentiteter samtidigt som den ursprungliga identiteten behålls. MagicDance-ramverket använder en tvåstegs utbildningsstrategi, med fokus på mänsklig rörelseavkoppling och utseendefaktorer som hudton, ansiktsuttryck och kläder. Vi kommer att dyka in i MagicDance-ramverket, undersöka dess arkitektur, funktion och prestanda i jämförelse med andra state-of-the-art mänskliga rörelseöverföringsramverk. Låt oss dyka in.

MagicDance : Realistisk mänsklig rörelseöverföring

Som nämnts tidigare är mänsklig rörelseöverföring en av de mest komplexa datorseendeuppgifterna på grund av den enorma komplexiteten som är involverad i att överföra mänskliga rörelser och uttryck från källbilden eller videon till målbilden eller videon. Traditionellt har datorseendemodeller uppnått mänsklig rörelseöverföring genom att träna en uppgiftsspecifik generativ modell, inklusive GAN eller Generative Adversarial Networks på måldatasets för ansiktsuttryck och kroppspose. Även om utbildning och användning av generativa modeller ger tillfredsställande resultat i vissa fall, lider de vanligtvis av två stora begränsningar.

- De förlitar sig tungt på en bildförvrängningskomponent, vilket gör att de ofta kämpar för att interpolera kroppsdelar som är osynliga i källbilden, antingen på grund av en förändring i perspektiv eller självocclusion.

- De kan inte generalisera till andra bilder som hämtas externt, vilket begränsar deras tillämpningar, särskilt i realtids-scenarier i vilden.

Moderna diffusionsmodeller har visat exceptionella bildgenereringsförmågor över olika förhållanden, och diffusionsmodeller kan nu presentera kraftfulla visuella effekter på en mängd nedströmsuppgifter, såsom videogenerering och bildinpainting, genom att lära av web-skala-bild-datasets. På grund av deras förmågor kan diffusionsmodeller vara ett idealiskt val för mänsklig rörelseöverföring. Även om diffusionsmodeller kan implementeras för mänsklig rörelseöverföring, har de vissa begränsningar, antingen när det gäller kvaliteten på den genererade innehållet eller när det gäller identitetsskydd eller lider av temporala inkonsekvenser på grund av modell-design- och utbildningsstrategibegränsningar. Dessutom visar diffusionsbaserade modeller ingen signifikant fördel över GAN-ramverk när det gäller generaliserbarhet.

För att övervinna de hinder som diffusions- och GAN-baserade ramverk möter vid mänsklig rörelseöverföring, har utvecklare introducerat MagicDance, ett nytt ramverk som syftar till att utnyttja potentialen hos diffusionsramverk för mänsklig rörelseöverföring, med en utanförstående nivå av identitetsskydd, överlägsen visuell kvalitet och domän-generaliserbarhet. I sin kärna är den grundläggande konceptet för MagicDance-ramverket att dela upp problemet i två faser: utseendekontroll och rörelsekontroll, två förmågor som krävs av bild-diffusionsramverk för att leverera precisa rörelseöverföringsutdata.

Ovanstående figur ger en kort översikt av MagicDance-ramverket, och som det kan ses, använder ramverket Stable Diffusion-modellen, och också distribuerar två ytterligare komponenter: Utseendekontrollmodell och Pose ControlNet, där den förra ger utseendeguidning till SD-modellen från en referensbild via uppmärksamhet, medan den senare ger uttryck/pose-guidning till diffusionsmodellen från en villkorsstyrd bild eller video. Ramverket använder också en multi-stegs utbildningsstrategi för att lära dessa undermoduler effektivt för att avkoppla pose-kontroll och utseende.

Sammanfattningsvis är MagicDance-ramverket ett

- Nytt och effektivt ramverk bestående av utseende-avkopplad pose-kontroll och utseendekontroll för-utbildning.

- MagicDance-ramverket är kapabelt att generera realistiska mänskliga ansiktsuttryck och mänsklig rörelse under kontroll av pose-villkor och referensbilder eller videor.

- MagicDance-ramverket syftar till att generera utseende-konsistent mänskligt innehåll genom att införa en Multi-Source Attention Module som erbjuder exakt guidning för Stable Diffusion UNet-ramverket.

- MagicDance-ramverket kan också användas som en bekväm utvidgning eller plugin för Stable Diffusion-ramverket, och säkerställer kompatibilitet med befintliga modell-vikter, eftersom det inte kräver ytterligare finjustering av parametrarna.

Dessutom visar MagicDance-ramverket exceptionella generaliseringsförmågor för både utseende och rörelse.

- Utseendegeneralisering: MagicDance-ramverket visar överlägsna förmågor när det gäller att generera olika utseenden.

- Rörelsegeneralisering: MagicDance-ramverket har också förmågan att generera en stor mängd rörelser.

MagicDance : Mål och Arkitektur

För en given referensbild, antingen av en verklig människa eller en stiliserad bild, är det primära målet för MagicDance-ramverket att generera en utgångsbild eller en utgångsvideo som är villkorad på indata och pose-inmatningar {P, F}, där P representerar mänsklig pose-skelett och F representerar ansiktslandmärken. Den genererade utgångsbilden eller videon ska kunna bevara utseendet och identiteten hos de människor som är inblandade, tillsammans med bakgrundsinnehållet i referensbilden, medan den behåller posen och uttrycken som definieras av pose-inmatningarna.

Arkitektur

Under utbildning utbildas MagicDance-ramverket som en ram-rekonstruktionsuppgift för att rekonstruera grund-sanningen med referensbilden och pose-inmatningen som hämtas från samma referensvideo. Under testning för att uppnå rörelseöverföring hämtas pose-inmatningen och referensbilden från olika källor.

Den övergripande arkitekturen för MagicDance-ramverket kan delas in i fyra kategorier: Preliminär fas, Utseendekontroll för-utbildning, Utseende-avkopplad pose-kontroll och Rörelsemodul.

Preliminär fas

Latent Diffusionsmodeller eller LDM representerar unikt utformade diffusionsmodeller för att operera inom det latenta utrymmet som möjliggörs av användningen av en autoencoder, och Stable Diffusion-ramverket är ett noterbart exempel på LDM som använder en Vektor-kvantiserad-Variationell AutoEncoder och temporal U-Net-arkitektur. Stable Diffusion-modellen använder en CLIP-baserad transformer som en text-encoder för att bearbeta text-inmatningar genom att konvertera text-inmatningar till inbäddningar. Utbildningsfasen för Stable Diffusion-ramverket utsätter modellen för en text-villkor och en inmatningsbild med processen som innefattar kodning av bilden till en latent representation, och utsätter den för en fördefinierad sekvens av diffusionssteg som styrs av en Gaussisk metod. Den resulterande sekvensen ger en bullrig latent representation som ger en standard normalfördelning med det primära lärandemålet för Stable Diffusion-ramverket som är att rensa den bullriga latent representationen iterativt till latent representationer.

Utseendekontroll för-utbildning

Ett stort problem med det ursprungliga ControlNet-ramverket är dess oförmåga att kontrollera utseendet bland spatialt varierande rörelser konsekvent, även om det tenderar att generera bilder med poser som liknar dem i inmatningsbilden, med det övergripande utseendet som påverkas främst av text-inmatningar. Även om denna metod fungerar, är den inte lämplig för rörelseöverföring som involverar uppgifter där det inte är text-inmatningarna utan referensbilden som utgör den primära källan för utseendeinformation.

Utseendekontroll för-utbildningsmodulen i MagicDance-ramverket är utformad som en hjälp-gren för att ge guidning för utseendekontroll i en lager-för-lager-ansats. Istället för att förlita sig på text-inmatningar, fokuserar den övergripande modulen på att utnyttja utseende-attributen från referensbilden med målet att förbättra ramverkets förmåga att generera utseende-egenskaperna exakt, särskilt i scenarier som involverar komplexa rörelsedynamik. Dessutom är det endast Utseendekontrollmodellen som är utbildningsbar under utseendekontroll för-utbildning.

Utseende-avkopplad pose-kontroll

En naiv lösning för att kontrollera posen i utgångsbilden är att integrera det för-utbildade ControlNet-modellen med det för-utbildade Utseendekontrollmodellen direkt utan finjustering. Men integrationen kan resultera i att ramverket kämpar med utseende-oberoende pose-kontroll, vilket kan leda till en diskrepans mellan inmatningsposerna och de genererade poserna. För att hantera denna diskrepans finjusterar MagicDance-ramverket Pose ControlNet-modellen tillsammans med det för-utbildade Utseendekontrollmodellen.

Rörelsemodul

När de arbetar tillsammans kan Utseende-avkopplad Pose ControlNet och Utseendekontrollmodellen uppnå exakt och effektiv bild-till-rörelse-överföring, även om det kan resultera i temporala inkonsekvenser. För att säkerställa temporala inkonsekvenser integrerar ramverket en ytterligare rörelsemodul i den primära Stable Diffusion UNet-arkitekturen.

MagicDance : För-utbildning och Datasets

För för-utbildning använder MagicDance-ramverket ett TikTok-dataset som består av över 350 dans-videor av varierande längd mellan 10 till 15 sekunder som fångar en enskild person som dansar med en majoritet av dessa videor som innehåller ansiktet och den övre kroppen av människan. MagicDance-ramverket extraherar varje enskild video vid 30 FPS och kör OpenPose på varje ram individuellt för att härleda pose-skelettet, hand-pose och ansiktslandmärken.

För för-utbildning för-utbildas utseendekontrollmodellen med en batch-storlek på 64 på 8 NVIDIA A100 GPU:er för 10 000 steg med en bild-storlek på 512 x 512, följt av att man tillsammans finjusterar pose-kontroll- och utseendekontrollmodellerna med en batch-storlek på 16 för 20 000 steg. Under utbildning sampas MagicDance-ramverket slumpmässigt två ramar som mål och referens, med bilderna som beskärs på samma position längs samma höjd. Under utvärdering beskär modellen bilden centralt istället för att beskära dem slumpmässigt.

MagicDance : Resultat

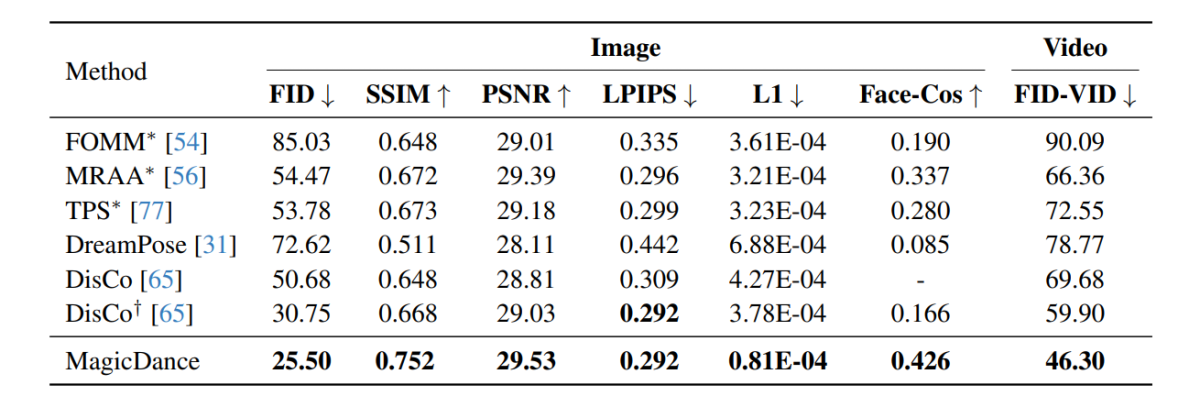

De experimentella resultaten som utfördes på MagicDance-ramverket visas i följande bild, och som det kan ses, överträffar MagicDance-ramverket befintliga ramverk som Disco och DreamPose för mänsklig rörelseöverföring över alla mått. Ramverk som består av en “*” framför deras namn använder målbilden direkt som inmatningen och innehåller mer information jämfört med de andra ramverken.

Det är intressant att notera att MagicDance-ramverket uppnår en Face-Cos-poäng på 0,426, en förbättring på 156,62% över Disco-ramverket, och nästan 400% ökning när jämfört med DreamPose-ramverket. Resultaten indikerar den robusta kapaciteten hos MagicDance-ramverket att bevara identitetsinformationen, och den synliga förbättringen i prestanda indikerar överlägsenheten hos MagicDance-ramverket över befintliga state-of-the-art-metoder.

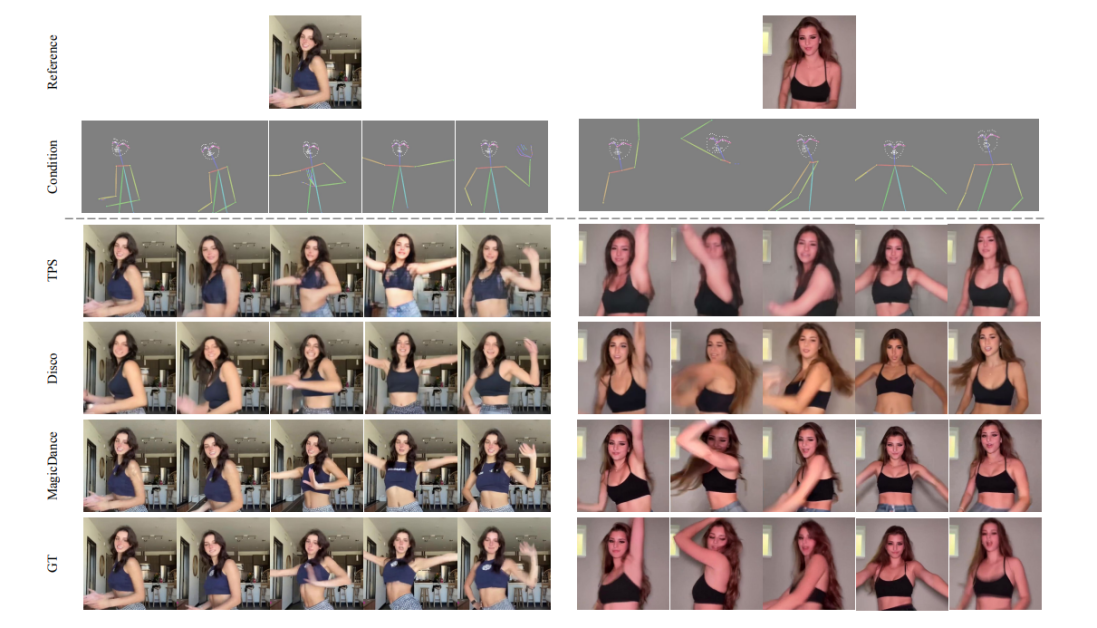

Följande figurer jämför kvaliteten på mänsklig videogenerering mellan MagicDance-, Disco- och TPS-ramverken. Som det kan observeras lider resultaten som genereras av GT-, Disco- och TPS-ramverken av inkonsekventa mänskliga pose-identiteter och ansiktsuttryck.

Dessutom visar följande bild visualiseringen av ansiktsuttryck och mänsklig pose-överföring på TikTok-datasetet med MagicDance-ramverket som kan generera realistiska och livfulla uttryck och rörelser under olika ansiktslandmärken och pose-skelett-inmatningar, medan den exakt bevarar identitetsinformationen från referens-inmatningsbilden.

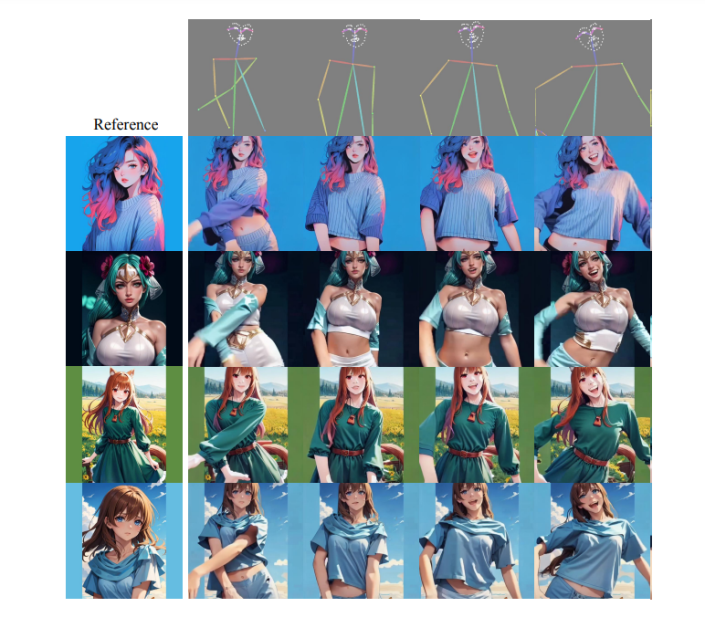

Det är värt att notera att MagicDance-ramverket har exceptionella generaliseringsförmågor för out-of-domain-referensbilder av osedda poser och stilar med imponerande utseendekontroll, även utan någon ytterligare finjustering på måldomen, med resultaten som visas i följande bild.

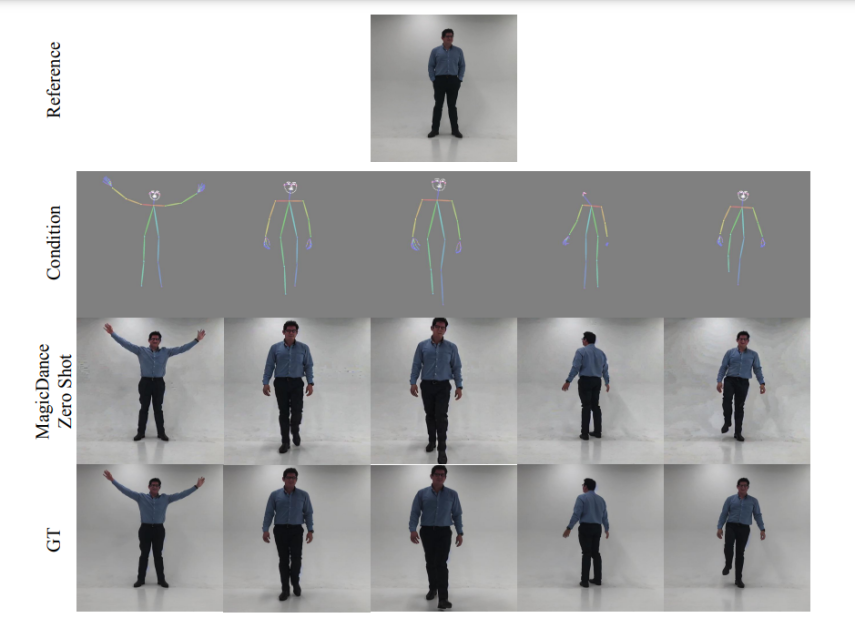

Följande bilder visar visualiseringsförmågorna hos MagicDance-ramverket när det gäller ansiktsuttrycks-överföring och zero-shot mänsklig rörelse. Som det kan ses generaliserar MagicDance-ramverket till i-vilden-mänskliga rörelser perfekt.

MagicDance : Begränsningar

OpenPose är en avgörande komponent i MagicDance-ramverket, eftersom det spelar en avgörande roll för pose-kontroll, som påverkar kvaliteten och den temporala inkonsekvensen hos de genererade bilderna betydligt. Men MagicDance-ramverket hittar det fortfarande en aning utmanande att upptäcka ansiktslandmärken och pose-skelett exakt, särskilt när objekten i bilderna är delvis synliga eller visar snabb rörelse. Dessa problem kan resultera i artefakter i den genererade bilden.

Slutsats

I den här artikeln har vi talat om MagicDance, ett diffusionsbaserat modell som syftar till att revolutionera mänsklig rörelseöverföring. MagicDance-ramverket försöker överföra 2D-mänskliga ansiktsuttryck och rörelser på utmanande mänskliga dans-videor med det specifika målet att generera nya pose-sekvens-styrda mänskliga dans-videor för specifika mål-identiteter, medan den ursprungliga identiteten behålls. MagicDance-ramverket är en två-stegs utbildningsstrategi för mänsklig rörelse-avkoppling och utseende som hudton, ansiktsuttryck och kläder.

MagicDance är en ny ansats för att underlätta realistisk mänsklig videogenerering genom att inkorporera ansikts- och rörelse-uttryck, och möjliggör konsekvent i-vilden-animering utan att behöva någon ytterligare finjustering, vilket visar en betydande förbättring jämfört med befintliga metoder. Dessutom visar MagicDance-ramverket exceptionella generaliseringsförmågor över komplexa rörelse-sekvenser och olika mänskliga identiteter, vilket etablerar MagicDance-ramverket som ledande i fältet för AI-assisterad rörelse-överföring och videogenerering.