Andersons Blickwinkel

Mit KI simulieren von Filmkorn

Mach Amerika wieder körnig: Ein neues KI-Tool kann Filmkorn von alten Footage entfernen, das Video bei einem Bruchteil der Größe komprimieren und das Korn dann wieder hinzufügen, sodass Zuschauer nichts bemerken. Es funktioniert mit bestehenden Video-Standards und reduziert die Bandbreite um bis zu 90 Prozent, während es das vintage-Look beibehält.

Für viele von uns, die Filme oder alte Fernsehsendungen ansehen, ist das “Knistern” von Filmkorn beruhigend; selbst wenn wir es nicht bewusst wahrnehmen, sagt uns das Korn, dass das, was wir ansehen, mit Chemikalien und nicht mit Code gemacht wurde, und bindet die Erfahrung an die physische Welt: an die Wahl des Materials, die Belichtung, Laborprozesse und vergangene Epochen:

Hollywoods Ansatz zum Korn hat sich im Laufe der Zeit mit den Veränderungen in Kultur und Produktionsmethoden verschoben. In den 1960er Jahren trugen die Entwicklung von Kameras und fotografischen Praktiken zur visuellen Identität des Jahrzehnts bei. Später führten Regisseure, die mit digitalen Techniken arbeiteten, Korn wieder bewusst ein. In den mittleren 1980er Jahren wählte der Regisseur James Cameron für Aliens (1986, unten rechts im Bild) ein besonders grobes Kodak-Material, wahrscheinlich, um die Atmosphäre zu verstärken und auch, um Drahtseile von praktischen VFX-Miniaturarbeiten zu verbergen. Quelle: https://archive.is/3ZSjN (mein letzter Artikel zu diesem Thema)

Analoge Textur stammt aus einer Zeit, in der die Produktion von Medien echtes Geld kostete, der Zugang begrenzt war und es zumindest einen lockeren Sinn gab, dass nur die fähigsten oder entschlossenen durchkommen konnten, was als Abkürzung für Realismus und Glaubwürdigkeit diente – und, als Hochauflösungstechnologien es eliminierten, Nostalgie.

Christopher Nolan wechselte nie. Während die meisten der Branche Digitaltechnik für ihre Geschwindigkeit und Flexibilität annahmen, beharrte der renommierte Regisseur auf Zelluloid als Disziplin und Ästhetik.

Denis Villeneuve, der innerhalb digitaler Pipelines arbeitet, filtert seine Footage durch photochemische Prozesse. Für die Dune-Filme, die digital gedreht wurden, wurde das Material auf Filmstock gedruckt und dann zurück in Digital gescannt, rein für Atmosphäre und Effekt.

Falsches Korn

Liebhaber von Film- und Fernsehqualität assoziieren sichtbares Korn mit Hochauflösung, wo die Bitrate (die Menge an Daten, die in jeden Frame gepusht wird) so hoch ist, dass sogar die kleinsten Details, wie Halidkörner, erhalten bleiben.

Allerdings würde es, wenn Streaming-Netzwerke tatsächlich eine solche Bitrate zur Verfügung stellten, eine erhebliche Belastung der Netzwerkkapazität darstellen und wahrscheinlich zu Pufferung und Stocken führen. Deshalb erstellen Plattformen wie Netflix optimierte AV1-Versionen ihrer Inhalte und nutzen die AV1-Codec-Fähigkeiten, um Korn hinzuzufügen zum Film oder zur Episode auf intelligente und angemessene Weise, 30% der Bandbreite sparend bei dem Prozess.

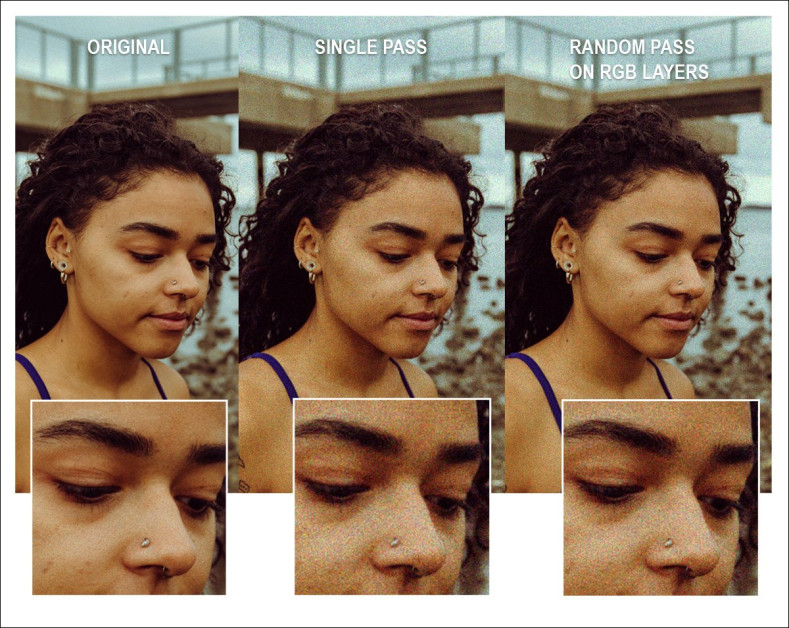

AV1 ist dafür ausgelegt, künstliches Filmkorn zu integrieren, wie in diesen Beispielen. Quelle: https://waveletbeam.com/index.php/av1-film-grain-synthesis

Die ‘Korn-Fetisch’ ist ein relativ seltener digitaler Äquivalent zu atavistischen Trends wie der Wiederbelebung von Vinyl, und es ist schwer zu sagen, ob es von Streamern verwendet wird, um hoch optimiertes Video wie wirklich teures ‘rohes Video’ aussehen zu lassen (für die Zuschauer, die unbewusst diese Eigenschaften assoziiert haben), die Bitrate höher erscheinen zu lassen, als sie tatsächlich ist; oder um den wahrgenommenen Qualitätsverlust abzulenken, den alte 4:3-Shows sonst bei der Streaming-Bereitstellung in Widescreen-Aspect-Ratio nehmen würden; oder einfach, um dem Retro-‘Nolan-Ästhetik’ im Allgemeinen zu huldigen.

Korn Siloed

Das Problem ist, dass Korn auch Rauschen ist. Digitale Systeme hassen Rauschen, und Streaming-Codecs wie AV1 streichen es weg, um Bandbreite zu sparen, es sei denn, Korn-Einstellungen sind explizit konfiguriert. Ebenso KI-Up scaler wie die Topaz Gigapixel-Serie behandeln Korn als Fehler, der korrigiert werden muss.

In dem Bereich der diffusionsbasierten Bildsynthese ist Korn extrem herausfordernd zu generieren, da es extreme Details darstellt, und würde normalerweise nur in massiv übertrainierten Modellen auftreten, da die gesamte latente Diffusionsmodell-Architektur (LDM) dafür ausgelegt ist, Rauschen (wie Korn) in klare Bilder zu dekonstruieren, anstatt Korn-Flecken als implizite Eigenschaften in Medien zu behandeln.

Deshalb kann es schwierig sein, überzeugendes Korn mit maschinellem Lernen zu erstellen. Und selbst wenn man es könnte, würde das direkte Rendern in ein optimiertes Video die Dateigröße wieder aufblähen.

Aufgrund dieser letzten logistischen Überlegung bieten state-of-the-art-Video-Codecs wie Versatile Video Coding (VVC) Korn als eine Art ‘Sidecar’-Service an.

VVC komprimiert das saubere, geräuschfreie Video und verwirft das Korn. Anstatt Daten zu verschwenden, um zufällige hohe Frequenz-Korn-Muster zu erhalten, analysiert es das Korn separat und codiert eine kleine Menge an Parametern (z.B. Amplitude, Frequenz und Mischmodus), die beschreiben, wie ähnliches Korn während der Wiedergabe zu regenerieren ist.

Diese Parameter werden in einem FGC-SEI (Film Grain Characteristics Supplemental Enhancement Information) Stream gespeichert, der neben dem Haupt-Bit-Stream läuft. Nach dem Decodieren verwendet ein Synthese-Modul diese Anweisungen, um synthetisches Korn zu erzeugen, das dem ursprünglichen ähnelt.

Dies bewahrt das ‘Aussehen’ von hochbitratigem, kornreichem Emulsion, während die tatsächliche Bitrate niedrig bleibt, da der Encoder nicht gezwungen ist, Ressourcen für die Erhaltung unvorhersehbaren Rauschens aufzuwenden.

Zusätzlich, wie bei diskreten Untertitel-Dateien, ist dieser ‘Korn’-Inhalt spezifisch für das Video in Frage; das willkürliche Anwenden von generischen Korn-Filtern in Plattformen wie Photoshop oder After Effects oder in automatisierten Verarbeitungspipelines würde nicht zu ‘angepasstem’ Korn führen, sondern zu einer nicht verwandten Überlagerung von Rauschen:

Links: Originalbild. Mitte: Photoshop Camera Raw Grain einheitlich auf alle Kanäle angewendet. Rechts: derselbe Grain-Filter auf jeden Kanal in Folge angewendet. Quellbild (CC0): https://stocksnap.io/photo/woman-beach-FJCOO6JWDP (aus meinem vorherigen Artikel)

Photoshops ‘Grain’-Filter fügt einheitliches zufälliges Rauschen hinzu; aber echtes Filmkorn stammt von Halidkristallen unterschiedlicher Größe. Das Anwenden des Filters auf jeden Kanal separat (siehe Bild oben) erzeugt nur mehr Chaos, nicht Realismus. Echtes Filmkorn spiegelt wider, wie Licht auf geschichtete Emulsionen im Moment der Belichtung trifft. Das Simulieren davon würde erfordern, zu schätzen, wie verschiedene Bereiche eines Bildes jede Halidschicht aktivieren würden, und nicht nur den Effekt über RGB-Kanäle aufteilen.

FGA-NN

In diese spezifische Verfolgung kommt ein neues Forschungspapier aus Frankreich – ein kurzer, aber interessanter Ausflug, der eine quantitativ und qualitativ überlegene Methode zur Analyse und Rekonstruktion von Korn anbietet:

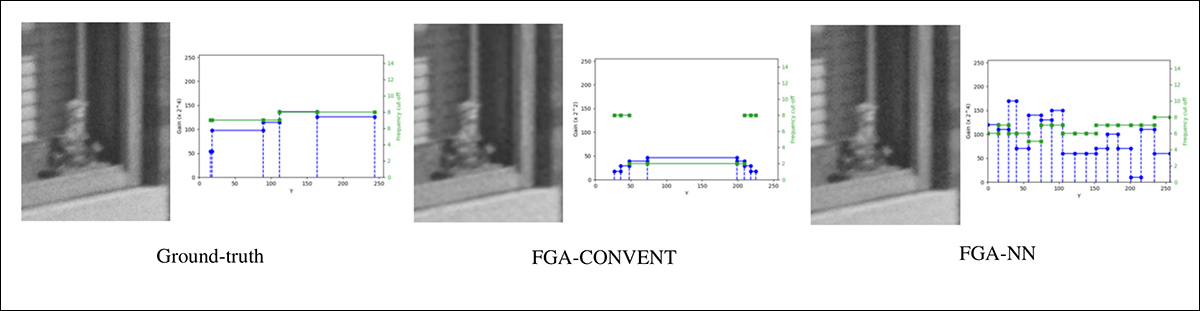

Vergleich zwischen Ground-Truth-Korn und Ergebnissen aus verschiedenen Analyse- und Synthesemethoden. Quelle: https://arxiv.org/pdf/2506.14350

Das neue System, betitelt FGA-NN, weicht nicht von der konventionellen Verwendung von konventionellem Gaussian-basierten Korn-Synthese durch die standardmäßige VVC-kompatible Methode, Versatile Film Grain Synthesis (VFGS), ab. Was das System ändert, ist die Analyse, die ein neuronales Netzwerk verwendet, um die Synthese-Parameter genauer zu schätzen

Daher ist das endgültige Korn immer noch mit demselben konventionellen Gaussian-Modell synthetisiert – aber das Netzwerk füttert bessere Metadaten in einen standardmäßigen, regelbasierten Generator ein, um ein state-of-the-art-Modell zu erhalten.

Das neue Papier ist betitelt FGA-NN: Film Grain Analysis Neural Network und stammt von drei Forschern bei InterDigital R&D, Cesson-Sévigné. Obwohl das Papier nicht lang ist, lassen Sie uns einen Blick auf einige der wichtigsten Aspekte der Fortschritte werfen, die die neue Methode bietet.

Methode

Um zusammenzufassen: Das FGA-NN-System nimmt ein körniges Video als Eingabe und extrahiert eine kompakte Beschreibung des Korns, gibt Parameter im standardisierten FGC-SEI-Format aus, das von diversen modernen Codecs verwendet wird. Diese Parameter werden zusammen mit dem Video übertragen, um es dem Decoder zu ermöglichen, das Korn mit VFGS zu rekonstruieren, anstatt das Korn direkt zu codieren.

Das Schema für die Analyse und erneute Anwendung von Filmkorn in der Videoverteilung, unter Verwendung von FGA-NN für die Parameterextraktion und VFGS für die Synthese.

Um das Netzwerk zu trainieren, benötigten die Autoren Paare von körnigen Videos und entsprechenden FGC-SEI-Metadaten. Da die meisten körnigen Footage diese Art von Metadaten nicht haben, erstellten die Forscher ihre eigene Datenbank, indem sie FGC-SEI-Parameter generierten, synthetisches Korn auf saubere Videos anwendeten und diese als Trainingsbeispiele verwendeten.

Trainingsdaten für FGA-NN wurden erstellt, indem synthetisches Korn auf saubere Footage aus den BVI-DVC– und DIV2K-Datenbanken angewendet wurde. Zufällige FGC-SEI-Parameter wurden generiert und mit dem VFGS-Synthesetool verwendet, um jedem körnigen Video ein bekanntes Metadaten-Paar zuzuordnen.

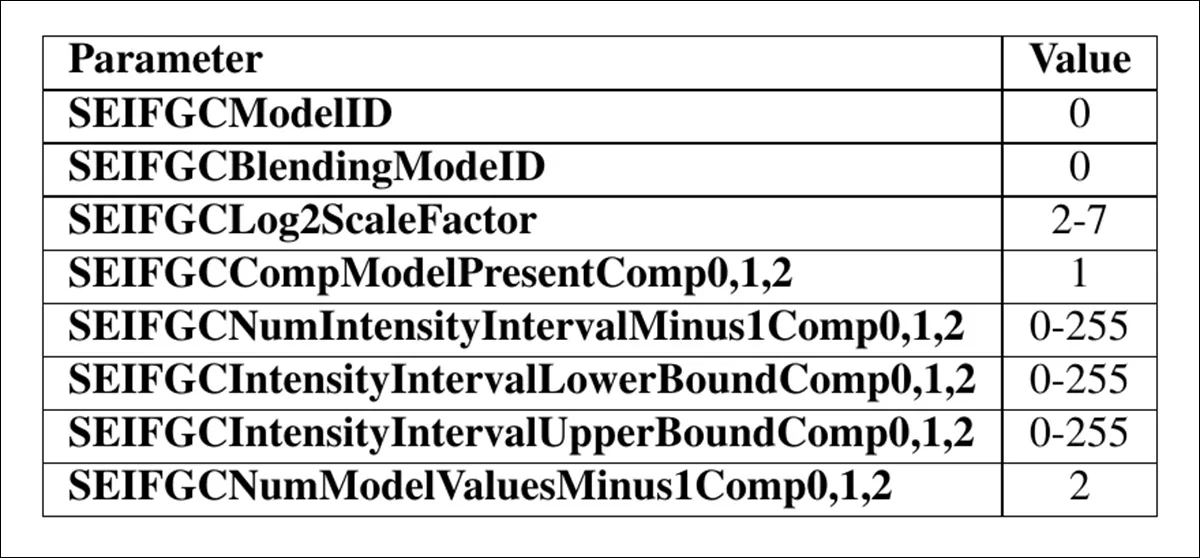

Überblick über die zufälligen FGC-SEI-Parameterbereiche, die für die Trainingsdaten verwendet wurden, angewendet auf saubere Footage aus den BVI-DVC- und DIV2K-Datenbanken. Parameter wurden so eingeschränkt, dass visuell plausible Ergebnisse über beide Luminanz- und Chroma-Kanäle hinweg erhalten blieben.

Das Frequenzfilter-Modell, die einzige Synthesemethode, die derzeit in Codec-Implementierungen wie dem VVC Test Model (VTM) unterstützt wird, wurde überall verwendet. Parameterbereiche wurden so eingeschränkt, dass visuell plausible Ergebnisse über beide Luminanz- und Chroma-Kanäle hinweg erhalten blieben.

Netzwerkeffekt

FGA-NN verfügt über zwei koordinierte Modelle, für Luminanz und Chroma, jeweils dazu ausgelegt, die spezifischen Parameter vorherzusagen, die zum Rekonstruieren von realistischem Filmkorn erforderlich sind.

Für jedes Eingabebild schätzt das System einen Satz von Intensitätsintervallen, die Skalierungsfaktoren, die mit jedem Intervall verknüpft sind, die horizontalen und vertikalen Cut-off-Frequenzen und eine Gesamtskalierung, bekannt als Log2Scale-Faktor. Um dies zu bewältigen, verwendet das Modell einen gemeinsamen Feature-Extractor, der das körnige Eingabe verarbeitet und in vier separate Ausgabezweige einfügt, von denen jeder für eine andere Vorhersageaufgabe verantwortlich ist:

Architektur der Luminanz-Version von FGA-NN. Ein gemeinsamer Backbone extrahiert Features aus körnigen Eingabeframes, gefolgt von vier Ausgabezweigen, die für spezifische Parameter-Vorhersageaufgaben zugeschnitten sind: Intervallgrenzen, Skalierungsfaktoren, Cut-off-Frequenzen und globale Log2Scale. Das Chroma-Netzwerk verwendet die gleiche Struktur mit angepassten Eingabe- und Ausgabedimensionen.

Intervallgrenzen werden durch Regression vorhergesagt, während Skalierungsfaktoren, Cut-off-Frequenzen und die globale Skalierung als Klassifizierungsprobleme behandelt werden.

Die Architektur ist so angepasst, dass sie der Komplexität jeder Aufgabe entspricht, wobei größere interne Schichten für feinere Vorhersagen verwendet werden; speziell spiegelt das Chroma-Modell die Luminanz-Struktur wider, aber passt sich den unterschiedlichen Eigenschaften von Farbdaten an.

Training und Tests

FGA-NN wurde mit vier Zielgrößen trainiert, von denen jede mit einer seiner Vorhersageaufgaben übereinstimmt. Für die Klassifizierungs-Ausgaben wurde eine kategorische Cross-Entropy-Verlust verwendet, um den Abstand zwischen vorhergesagten Labels und Ground-Truth zu verringern.

Intervallgrenzen wurden auf einen Bereich von 0 bis 1 normalisiert und mit einem kombinierten Verlust optimiert: einem exponentiell skalierten L1 Verlust (expL1), der größere Fehler stärker bestrafte, und einer Monotonie-Strafe, die Abnahmen entmutigte. Alle vier Verluste wurden kombiniert, wobei hohe Gewichte den Cut-off- und Skalierungsfaktoren zugewiesen wurden, während Intervallgrenzen und Log2Scale mit 1 bzw. 0,1 gewichtet wurden.

Das Training wurde unter dem Adam-Optimizer durchgeführt, mit einer Lernrate von 5e-4, über 10.000 Iterationen, mit einer Batch-Größe von 64.

Das einzige vergleichbare Tool, das für vergleichende Tests geeignet war, war FGA-CONVENT, das ebenfalls Werte im FGC-SEI-Format produziert und für Kornverarbeitung verwendet wird. Beide Systeme wurden auf UHD-Sequenzen aus dem JVET-subjektiven Bewertungsset getestet, das Footage mit echtem Filmkorn enthält.

Vertikale gestrichelte Linien zeigen Intensitätsintervallgrenzen an, während der Log2Scale-Gewinn in der Achsenbeschriftung angegeben ist.

In dem Bild oben sehen wir identische beschnittene Frames, die von VFGS unter Verwendung von Parametern aus jeder Methode generiert wurden, im Vergleich zum Original. Ihre jeweiligen Luminanz-Schätzungen sind auch gegen Ground-Truth-Werte aufgetragen, die manuell mit VFGS festgelegt wurden, die hier Pixelintensität auf der X-Achse (0–255), Skalierungsfaktoren auf der blauen Y-Achse (0–255) und Cut-off-Frequenzen auf der grünen Y-Achse (2–14) darstellt.

Die Autoren erklären:

‘Man kann beobachten, dass FGA-NN den allgemeinen Trend des Ground-Truth-Filmkorn-Musters und der Amplitude genau erfasst und so synthetisierte Bilder mit einem wahrgenommenen Filmkorn ähnlich dem der Ground-Truth-Bilder erzeugt.

‘Andererseits schätzt FGA-CONVENT einen niedrigeren Skalierungsfaktor, der durch einen entsprechend niedrigeren Log2Scale-Faktor als Ergebnis seines Designs kompensiert wird, und neigt dazu, ein gröberes Filmkorn-Muster als die Referenz zu erzeugen, was zu einem unterschiedlichen, aber visuell konsistenten Aussehen führt.’

Sie bemerken, dass ein direkter Vergleich mit Ground-Truth-Korn-Parametern unzuverlässig ist, da Skalierung und Log2Scale einander kompensieren können und kleine Fehler oft wenig visuellen Einfluss haben.

Test der Treue

Die Filmkorn-Treue wurde über vier Workflows benchmarkt: FGA-NN mit VFGS; FGA-CONVENT plus VFGS; Style-FG; und 3R-INN. Tests verwendeten sowohl die FGC-SEI- als auch die FilmGrainStyle740k-Datenbanken, verglichen die Ausgabe mit Ground-Truth unter Verwendung von gelernten wahrgenommenen Ähnlichkeitsmetriken (LPIPS); JSD-NSS; und Kullback-Leibler (KL)-Divergenz.

Benchmark-Ergebnisse auf der FilmGrainStyle740k-Datenbank. Style-FG und 3R-INN überbieten andere, da sie auf dieser Datenbank trainiert wurden, während FGA-NN dicht folgt. FGA-CONVENT unterbietet, was auf seine Abhängigkeit von Mehrfachframe-Analyse und homogenen Regionen zurückzuführen ist – Bedingungen, die in diesem Fall nicht erfüllt sind.

Von diesen Ergebnissen sagen die Autoren:

‘Auf der FilmGrainStyle740k-Testmenge erzielen Style-FG und 3R-INN die besten Ergebnisse, da diese Methoden speziell auf dieser Datenbank trainiert wurden, während FGA-NN dicht folgt. Die Leistung von FGA-CONVENT in Kombination mit VFGS ist auf beiden Testsets suboptimal.

‘Dies liegt allein daran, dass die Analyse auf homogenen Regionen und der Ausnutzung von Informationen aus mehreren Frames in einem realen Filmkorn-Analyse-Szenario basiert, während in der vorliegenden Bewertung die Analyse mit einem einzelnen niedrigauflösenden Bild (256×256 bis maximal 768×512) durchgeführt wird, das oft erhebliche Texturen enthält.

‘Dies erschwert die Herausforderung für konventionelle Analysemethode, was es unmöglich macht, FGA-CONVENT auf solche kleinen Bilder anzuwenden.’

Schließlich bemerken die Autoren, dass zwar lernbasierte Methoden wie 3R-INN und Style-FG starke visuelle Ergebnisse auf kuratierten Datenbanken produzieren, ihre hohe Rechenkosten sie jedoch für die Bereitstellung auf Endgeräten untauglich machen.

Vergleich von Niedrigbitrate-Frames, die mit verschiedenen Analyse- und Syntheseworkflows (dritte bis letzte Spalten) verbessert wurden.

Im Gegensatz dazu kombiniert der in diesem Papier vorgeschlagene Ansatz das leichte FGA-NN-Analysemodul mit der hardware-effizienten VFGS-Synthesemethode, die die Autoren als eine vielversprechendere und bereitstellbare Lösung für die Wiederherstellung von Filmkorn in komprimiertem Video beschreiben.

Sie erklären weiter, dass die Vorteile von FGA-NN potenziell erheblich sind, im großen Maßstab:

‘[Das Codieren] von UHD-Videos mit Filmkorn bei mittlerer bis niedriger Bitrate unter Verwendung unseres Filmkorn-Analyse- und Syntheseworkflows ermöglicht es, die Bitrate um bis zu 90% im Vergleich zum Hochbitrate-Codieren zu sparen.’

Schlussfolgerung

Die Obsession mit Filmkorn ist eine der seltsamsten und merkwürdigsten Marotten des post-analogischen Zeitalters, und es ist interessant zu beachten, dass das, was einst als Einschränkung des Mediums angesehen wurde, nun zu einem Symbol von Wahrhaftigkeit und Authentizität in sich selbst geworden ist, sogar (vielleicht unbewusst) für eine neue Generation von Zuschauern, die nach dem effektiven Niedergang der Emulsion geboren wurden.

Es sollte beachtet werden, dass keine der state-of-the-art-Korn-Rekonstruktionsmethoden, einschließlich dieser neuesten Innovation, genau die wahre Wirkung der Art und Weise erfassen kann, wie Licht auf geschichtete Halide in einem echten photochemischen Prozess wirkt, über einen Bereich von Bedingungen.

Erstveröffentlicht am Mittwoch, den 18. Juni 2025