Künstliche Intelligenz

Lösung des JPEG-Artefaktproblems in Computer Vision-Datensätzen

Eine neue Studie der University of Maryland und Facebook AI hat eine „erhebliche Leistungseinbuße“ bei Deep-Learning-Systemen festgestellt, die in ihren Datensätzen stark komprimierte JPEG-Bilder verwenden, und bietet einige neue Methoden, um die Auswirkungen dieser Einbußen zu mildern.

Die berichtenassoziierte Zeichnung mit dem Titel Analyse und Behebung von JPEG-Komprimierungsfehlern beim Deep Learning, behauptet, „deutlich umfassender“ zu sein als frühere Studien zu den Auswirkungen von Artefakten beim Training von Computer Vision-Datensätzen. Das Papier stellt fest, dass „[starke] bis moderate JPEG-Komprimierung zu erheblichen Leistungseinbußen bei Standardmetriken führt“ und dass neuronale Netzwerke möglicherweise nicht so widerstandsfähig gegen solche Störungen sind wie frühere Arbeiten schlägt vor.

Ein Foto eines Hundes aus dem MobileNetV2018-Datensatz von 2. Bei Qualität 10 (links) kann ein Klassifizierungssystem die richtige Rasse „Pembroke Welsh Corgi“ nicht identifizieren und tippt stattdessen auf „Norwich Terrier“ (das System weiß bereits, dass es sich um ein Foto eines Hundes handelt, aber nicht um die Rasse). Im zweiten Bild von links kann eine handelsübliche, artefaktkorrigierte JPEG-Version des Bildes die richtige Rasse erneut nicht identifizieren. Im zweiten Bild von rechts stellt eine gezielte Artefaktkorrektur die richtige Klassifizierung wieder her. Und rechts das Originalfoto, korrekt klassifiziert. Quelle: https://arxiv.org/pdf/2011.08932.pdf

Komprimierungsartefakte als „Daten“

Bei extremer JPEG-Komprimierung entstehen wahrscheinlich sichtbare oder halbsichtbare Ränder um das Bild herum 8×8 Blöcke Aus diesen wird ein JPEG zu einem Pixelraster zusammengesetzt. Sobald diese Blockierungs- oder „Klingel“-Artefakte auftreten, werden sie von maschinellen Lernsystemen wahrscheinlich als reale Elemente des Bildmotivs fehlinterpretiert, sofern hierfür keine Kompensation erfolgt.

Oben extrahiert ein maschinelles Lernsystem für Computer Vision ein „sauberes“ Gradientenbild aus einem Bild guter Qualität. Unten verdecken „blockierende“ Artefakte in einer Bildabbildung geringerer Qualität die Merkmale des Motivs und können die aus einem Bildsatz abgeleiteten Merkmale „infizieren“, insbesondere in Fällen, in denen der Datensatz sowohl Bilder hoher als auch niedriger Qualität enthält, wie z. B. in Web-Scraping-Sammlungen, auf die nur eine allgemeine Datenbereinigung angewendet wurde. Quelle: http://www.cs.utep.edu/ofuentes/papers/quijasfuentes2014.pdf

Wie im ersten Bild oben zu sehen ist, können sich solche Artefakte auf Bildklassifizierungsaufgaben auswirken, was auch Auswirkungen auf Texterkennungsalgorithmen hat, die von Artefakten betroffene Zeichen möglicherweise nicht korrekt identifizieren können.

Bei Trainingssystemen für die Bildsynthese (wie Deepfake-Software oder GAN-basierten Bildgenerierungssystemen) kann ein fehlerhafter Block minderwertiger, stark komprimierter Bilder in einem Datensatz entweder die mittlere Reproduktionsqualität beeinträchtigen oder von einer größeren Anzahl hochwertigerer Merkmale, die aus besseren Bildern im Datensatz extrahiert wurden, subsumiert und im Wesentlichen überschrieben werden. In jedem Fall sind bessere Daten wünschenswert – oder zumindest konsistente Daten.

JPEG – Normalerweise „gut genug“

Die JPEG-Komprimierung ist ein irreversibel verlustbehafteter Codec, der auf verschiedene Bildformate angewendet werden kann, obwohl er hauptsächlich auf die JFIF-Bilddatei angewendet wird. Verpackung. Trotzdem wurde das JPEG-Format (.jpg) nach der zugehörigen Komprimierungsmethode benannt und nicht nach dem JFIF-Wrapper für die Bilddaten.

In den letzten Jahren sind ganze Architekturen für maschinelles Lernen entstanden, die die Reduzierung von Artefakten im JPEG-Stil als Teil von KI-gesteuerten Hochskalierungs-/Wiederherstellungsroutinen umfassen, und die KI-basierte Entfernung von Komprimierungsartefakten ist mittlerweile in eine Reihe kommerzieller Produkte integriert, wie zum Beispiel das Topaz-Bild/ Video Suiteund die neuronale Merkmale der neuesten Versionen von Adobe Photoshop.

Da der 1986 Das derzeit allgemein verwendete JPEG-Schema wurde Anfang der 1990er Jahre weitgehend festgelegt. Es ist nicht möglich, einem Bild Metadaten hinzuzufügen, die angeben, in welcher Qualitätsstufe (1-100) ein JPEG-Bild gespeichert wurde – zumindest nicht ohne die Änderung von über dreißig Jahren veralteter Softwaresysteme für Verbraucher, Fachleute und Hochschulen, die nicht mit der Verfügbarkeit solcher Metadaten gerechnet hatten.

Daher ist es nicht ungewöhnlich, Trainingsroutinen für maschinelles Lernen an die bewertete oder bekannte Qualität von JPEG-Bilddaten anzupassen, wie es die Forscher für die neue Arbeit getan haben (siehe unten). Fehlt ein Metadateneintrag zur „Qualität“, ist es derzeit notwendig, entweder die Details der Komprimierung des Bildes zu kennen (d. h. aus einer verlustfreien Quelle komprimiert) oder die Qualität durch Wahrnehmungsalgorithmen oder manuelle Klassifizierung abzuschätzen.

Ein wirtschaftlicher Kompromiss

JPEG ist nicht die einzige verlustbehaftete Komprimierungsmethode, die die Qualität von Datensätzen für maschinelles Lernen beeinträchtigen kann; Komprimierungseinstellungen in PDF-Dateien können auf diese Weise auch Informationen verwerfen und auf sehr niedrige Qualitätsstufen eingestellt werden, um Speicherplatz für lokale oder Netzwerkarchivierungszwecke zu sparen.

Dies lässt sich anhand verschiedener PDF-Dateien auf archive.org belegen. Einige davon wurden so stark komprimiert, dass sie für Bild- oder Texterkennungssysteme eine erhebliche Herausforderung darstellen. In vielen Fällen, beispielsweise bei urheberrechtlich geschützten Büchern, scheint diese starke Komprimierung als eine Art kostengünstiges DRM eingesetzt worden zu sein. Ähnlich wie Urheberrechtsinhaber die Auflösung von YouTube-Videos, deren IP sie besitzen, verringern und die „blockigen“ Videos als Werbemittel belassen, um zum Kauf von „vollständiger Auflösung“ zu animieren, anstatt sie löschen zu lassen.

In vielen anderen Fällen ist die Auflösung oder Bildqualität einfach deshalb niedrig, weil die Daten sehr alt sind und aus einer Zeit stammen, in der lokaler Speicher und Netzwerkspeicher teurer waren und begrenzte Netzwerkgeschwindigkeiten hochoptimierte und tragbare Bilder einer qualitativ hochwertigen Reproduktion vorzogen .

Es wurde argumentiert, dass JPEG zwar nicht die beste Lösung ist jetzt an, wurde „verankert“ als unentfernbare Altinfrastruktur, die im Wesentlichen mit den Grundlagen des Internets verflochten ist.

Vermächtnislast

Obwohl neuere Innovationen wie JPEG 2000, PNG und (zuletzt) das .webp-Format eine höhere Qualität bieten, würde die erneute Abtastung älterer, sehr beliebter Machine-Learning-Datensätze wohl die Kontinuität und Geschichte der jährlichen Herausforderungen der Computervision in der akademischen Gemeinschaft „zurücksetzen“ – ein Hindernis, das auch beim erneuten Speichern von PNG-Datensätzen mit höheren Qualitätseinstellungen gelten würde. Dies könnte als eine Art technische Schuld betrachtet werden.

Während ehrwürdige servergesteuerte Bildverarbeitungsbibliotheken wie ImageMagick bessere Formate, einschließlich .webp, unterstützen, treten bei älteren Systemen häufig Anforderungen an die Bildtransformation auf, die nicht für etwas anderes als JPG oder PNG eingerichtet sind (was eine verlustfreie Komprimierung bietet, allerdings auf Kosten von Latenz und Speicherplatz). Sogar WordPress, das CMS, das es antreibt fast 40 % aller Websites, nur .webp-Unterstützung hinzugefügt vor drei Monaten.

PNG war ein später (wohl zu später) Einstieg in den Bereich der Bildformate und entstand als Reaktion darauf Ende der 1990er Jahre als Open-Source-Lösung eine Erklärung von 1995 von Unisys und CompuServe, dass künftig Lizenzgebühren für das LZW-Komprimierungsformat in GIF-Dateien zu entrichten seien, die damals häufig für Logos und flache Farbelemente verwendet wurden, auch wenn das Format Auferstehung in den frühen 2010er Jahren konzentrierte sich auf seine Fähigkeit, schnelle animierte Inhalte mit geringer Bandbreite bereitzustellen (ironischerweise erlangten animierte PNGs nie Popularität oder breite Unterstützung, und das sogar). von Twitter verboten in 2019).

Trotz ihrer Mängel ist die JPEG-Komprimierung schnell, platzsparend und tief in Systemen aller Art verankert – und wird daher in naher Zukunft wahrscheinlich nicht ganz aus der Szene des maschinellen Lernens verschwinden.

Das Beste aus der KI/JPEG-Entspannung machen

Bis zu einem gewissen Grad hat sich die Community des maschinellen Lernens mit den Schwächen der JPEG-Komprimierung abgefunden: 2011 veröffentlichte die European Society of Radiology (ESR) eine Studie über die 'Nutzbarkeit irreversibler Bildkompression in der radiologischen Bildgebung' und bietet Richtlinien für 'akzeptable' Verluste; wenn der ehrwürdige MNIST Der Texterkennungsdatensatz (dessen Bilddaten ursprünglich in einem neuartigen Binärformat bereitgestellt wurden) wurde in ein „normales“ Bildformat portiert, JPEG, nicht PNG, wurde ausgewählt; und eine frühere (2020) Zusammenarbeit der Autoren des neuen Papiers bot „eine neuartige Architektur“ zur Kalibrierung maschineller Lernsysteme auf die Unzulänglichkeiten unterschiedlicher JPEG-Bildqualität, ohne dass Modelle für jede JPEG-Qualitätseinstellung trainiert werden müssen – eine Funktion, die in der neuen Arbeit genutzt wird.

Tatsächlich ist die Erforschung des Nutzens qualitätsvarianter JPEG-Daten ein relativ florierendes Feld des maschinellen Lernens. Eigentlich ein (unabhängiges) Projekt aus dem Jahr 2016 des Center for Automation Research an der University of Maryland konzentriert sich auf die DCT-Domäne (wobei JPEG-Artefakte bei niedrigen Qualitätseinstellungen auftreten) als Weg zur tiefgreifenden Merkmalsextraktion; Ein weiteres Projekt aus dem Jahr 2019 konzentriert sich auf Lesen von JPEG-Daten auf Byte-Ebene ohne die zeitaufwändige Notwendigkeit, die Bilder tatsächlich zu dekomprimieren (dh sie irgendwann in einem automatisierten Workflow zu öffnen); und ein Studie aus Frankreich im Jahr 2019 nutzt aktiv die JPEG-Komprimierung für Objekterkennungsroutinen.

Tests und Schlussfolgerungen

Um auf die jüngste Studie von UoM und Facebook zurückzukommen: Die Forscher wollten die Verständlichkeit und Nützlichkeit von JPEG anhand von Bildern testen, die zwischen 10 und 90 komprimiert wurden (unterhalb dieses Wertes ist das Bild kaum noch gestört, oberhalb entspricht die Komprimierung verlustfrei). Die in den Tests verwendeten Bilder wurden mit jedem Wert innerhalb des Zielqualitätsbereichs vorkomprimiert, was mindestens acht Trainingssitzungen erforderte.

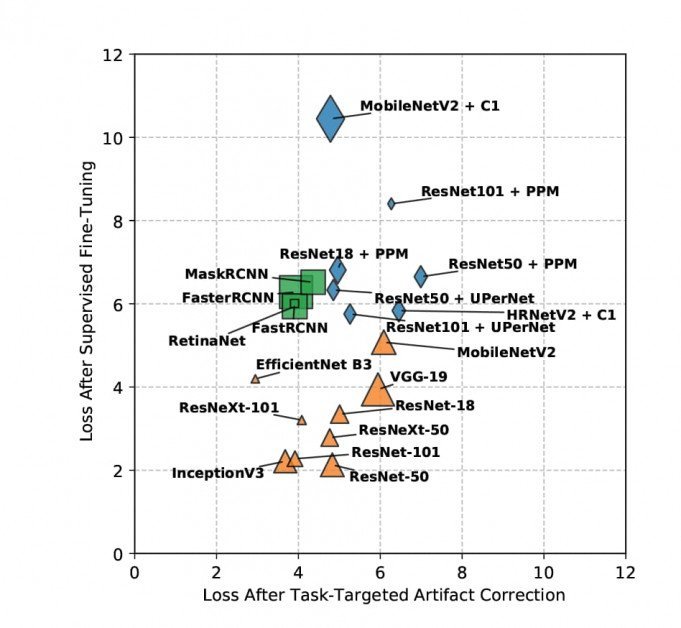

Modelle wurden auf den stochastischen Gradientenabstieg mit vier Methoden trainiert: Baseline, wo keine zusätzlichen Abhilfemaßnahmen hinzugefügt wurden; überwachte Feinabstimmung, wobei der Trainingssatz den Vorteil vorab trainierter Gewichte und gekennzeichneter Daten hat (obwohl die Forscher einräumen, dass dies in Anwendungen auf Verbraucherebene schwer zu reproduzieren ist); Artefaktkorrektur, wobei vor dem Training eine Vergrößerung/Verbesserung der komprimierten Bilder durchgeführt wird; Und aufgabenbezogene Artefaktkorrektur, wobei das Artefaktkorrekturnetzwerk auf zurückgegebene Fehler abgestimmt wird.

Das Training fand an einer Vielzahl von apt-Datensätzen statt, darunter mehrere Varianten von ResNet. FastRCNN, MobileNetV2, MaskRCNN und Keras' EinführungV3.

Die Ergebnisse des Probenverlusts nach der aufgabenbezogenen Artefaktkorrektur werden unten visualisiert (niedriger = besser).

Es ist nicht möglich, tief in die Details der in der Studie erzielten Ergebnisse einzutauchen, da die Erkenntnisse der Forscher zwischen dem Ziel der Auswertung von JPEG-Artefakten und neuen Methoden zur Linderung dieser Probleme aufgeteilt sind; das Training wurde wiederholt pro Qualität über so viele Datensätze; und die Aufgaben umfassten mehrere Ziele wie Objekterkennung, Segmentierung und Klassifizierung. Im Wesentlichen positioniert sich der neue Bericht als umfassendes Nachschlagewerk, das sich mit mehreren Themen befasst.

Dennoch kommt das Papier allgemein zu dem Schluss, dass „die JPEG-Komprimierung bei hohen bis mittleren Komprimierungseinstellungen generell hohe Nachteile mit sich bringt“. Es wird außerdem behauptet, dass die neuartigen, unmarkierten Minderungsstrategien im Vergleich zu anderen ähnlichen Ansätzen bessere Ergebnisse erzielen; dass die überwachte Methode der Forscher bei komplexen Aufgaben ebenfalls bessere Ergebnisse liefert, obwohl sie keinen Zugriff auf Ground-Truth-Labels hat; und dass diese neuartigen Methoden die Wiederverwendung von Modellen ermöglichen, da die erhaltenen Gewichte zwischen Aufgaben übertragbar sind.

In Bezug auf Klassifizierungsaufgaben heißt es in dem Dokument ausdrücklich, dass „JPEG die Gradientenqualität verschlechtert und Lokalisierungsfehler verursacht“.

Die Autoren hoffen, zukünftige Studien auf andere Komprimierungsmethoden wie die weitgehend ignorierten auszuweiten JPEG 2000, sowie WebP, heif und BPG. Sie schlagen außerdem vor, dass ihre Methodik auf eine analoge Forschung zu Videokomprimierungsalgorithmen angewendet werden könnte.

Da sich die aufgabenorientierte Methode zur Artefaktkorrektur in der Studie als so erfolgreich erwiesen hat, signalisieren die Autoren auch ihre Absicht, die im Rahmen des Projekts trainierten Gewichte freizugeben, in der Erwartung, dass „[viele] Anwendungen von der Verwendung unserer TTAC-Gewichte ohne Änderungen profitieren werden.“

Hinweis: Das Quellbild für den Artikel stammt von thispersondoesnotexist.com