Künstliche Intelligenz

Durch die Nutzung der menschlichen Aufmerksamkeit können AI-generierte Bilder verbessert werden

Neue Forschung aus China hat eine Methode vorgeschlagen, um die Qualität von Bildern zu verbessern, die von Latent Diffusion Models (LDMs) wie Stable Diffusion generiert werden.

Die Methode konzentriert sich auf die Optimierung der salienten Regionen eines Bildes – Bereiche, die am wahrscheinlichsten die menschliche Aufmerksamkeit auf sich ziehen.

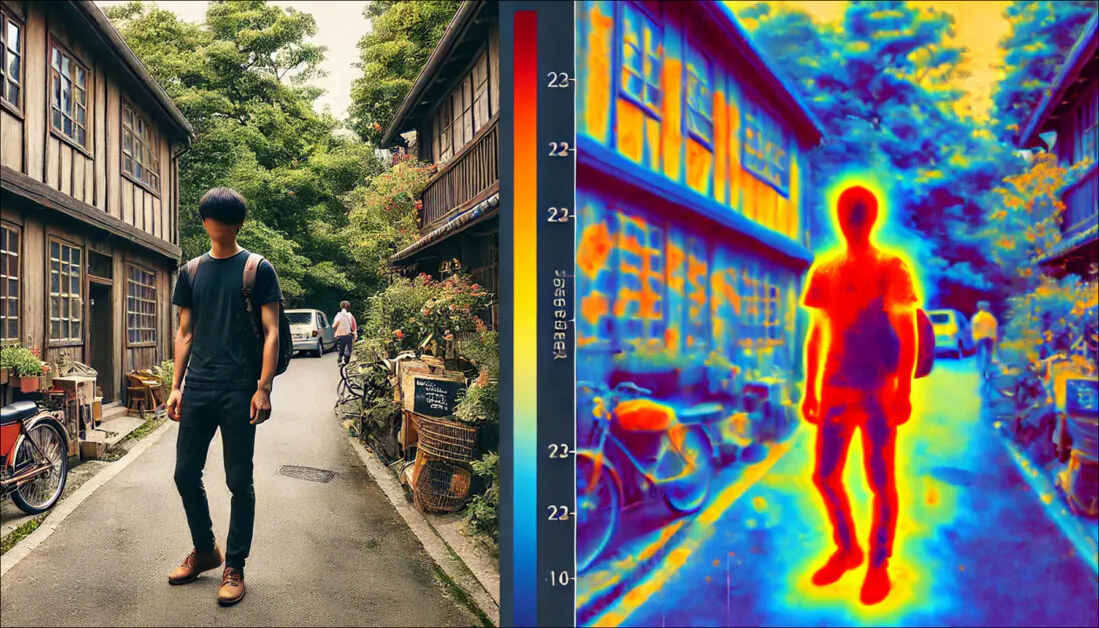

Die neue Forschung hat herausgefunden, dass Saliency-Karten (vierte Spalte von links) als Filter oder ‘Maske’ verwendet werden können, um die Aufmerksamkeit in Denoising-Prozessen auf Bereiche des Bildes zu lenken, die Menschen am wahrscheinlichsten beachten. Quelle: https://arxiv.org/pdf/2410.10257

Traditionelle Methoden optimieren das gesamte Bild gleichmäßig, während die neue Methode einen Saliency-Detektor verwendet, um wichtigere Regionen zu identifizieren und zu priorisieren, wie es Menschen tun.

In quantitativen und qualitativen Tests konnte die Methode der Forscher vorherige Diffusionsmodelle sowohl in Bezug auf Bildqualität als auch in Bezug auf die Treue zu Text-Prompts überbieten.

Die neue Methode erzielte auch die beste Bewertung in einem Test mit 100 Teilnehmern, bei dem die menschliche Wahrnehmung bewertet wurde.

Natürliche Selektion

Saliency, die Fähigkeit, Informationen in der realen Welt und in Bildern zu priorisieren, ist ein wesentlicher Teil der menschlichen Wahrnehmung.

Ein einfaches Beispiel dafür ist die erhöhte Aufmerksamkeit für Details, die klassische Kunst wichtigen Bereichen eines Gemäldes zuweist, wie dem Gesicht in einem Porträt oder den Masten eines Schiffes in einem Meeres-Thema; in solchen Beispielen konzentriert sich die Aufmerksamkeit des Künstlers auf das zentrale Thema, was bedeutet, dass breite Details wie ein Hintergrund oder ferne Wellen eines Sturms skizzenhafter und repräsentativer sind als detaillierte.

Unter Berücksichtigung von Studien über menschliches Verhalten sind maschinelle Lernmethoden in den letzten zehn Jahren entstanden, die diese menschliche Aufmerksamkeitsausrichtung in jedem Bild nachahmen oder zumindest approximieren können.

Objekt-Segmentierung (semantische Segmentierung) kann bei der Identifizierung von Bildfacetten und der Entwicklung entsprechender Saliency-Karten helfen. Quelle: https://arxiv.org/pdf/1312.6034

In der Forschungsliteratur war der beliebteste Saliency-Karten-Detektor der letzten fünf Jahre der 2016 Gradient-weighted Class Activation Mapping (Grad-CAM)-Ansatz, der später zum verbesserten Grad-CAM++-System weiterentwickelt wurde, sowie andere Varianten und Verfeinerungen.

Grad-CAM verwendet die Gradient-Aktivierung eines semantischen Tokens (wie ‘Hund’ oder ‘Katze’) zur Erzeugung einer visuellen Karte, die zeigt, wo das Konzept oder die Annotation im Bild wahrscheinlich dargestellt wird.

Beispiele aus dem ursprünglichen Grad-CAM-Papier. In der zweiten Spalte wird durch guided Backpropagation jeder Beitrag identifiziert. In der dritten Spalte werden semantische Karten für die beiden Konzepte ‘Hund’ und ‘Katze’ gezeichnet. Die vierte Spalte stellt die Kombination der beiden vorherigen Inferenzen dar. Die fünfte Spalte stellt die Occlusion (Maskierung)-Karte dar, die der Inferenz entspricht; und schließlich stellt die sechste Spalte die Grad-CAM-Visualisierung eines ResNet-18-Layers dar. Quelle: https://arxiv.org/pdf/1610.02391

Menschliche Umfragen zu den Ergebnissen, die mit diesen Methoden erzielt wurden, haben eine Übereinstimmung zwischen diesen mathematischen Identifizierungen von Schlüsselinteressenpunkten in einem Bild und der menschlichen Aufmerksamkeit (bei der Bildbetrachtung) gezeigt.

SGOOL

Das neue Papier betrachtet, was Saliency zu Text-Bild- (und möglicherweise Text-Video-) Systemen wie Stable Diffusion und Flux beitragen kann.

Wenn ein Benutzertext-Prompt interpretiert wird, erkunden Latent-Diffusionsmodelle ihren trainierten latenten Raum nach gelernten visuellen Konzepten, die mit den verwendeten Wörtern oder Phrasen übereinstimmen. Sie parsen diese Datenpunkte dann durch einen Denoising-Prozess, bei dem zufälliges Rauschen allmählich in eine kreative Interpretation des Benutzertext-Prompts entwickelt wird.

An diesem Punkt jedoch gibt das Modell gleich viel Aufmerksamkeit jedem einzelnen Teil des Bildes. Seit der Popularisierung von Diffusionsmodellen im Jahr 2022, mit dem Start von OpenAIs verfügbaren Dall-E-Bildgeneratoren und der anschließenden Open-Source-Veröffentlichung von Stability.aus Stable Diffusion-Framework, haben Benutzer festgestellt, dass ‘wichtige’ Abschnitte eines Bildes oft unterversorgt sind.

Da in einer typischen Darstellung eines Menschen das Gesicht des Menschen (das für den Betrachter von maximaler Bedeutung ist) wahrscheinlich nicht mehr als 10-35% des gesamten Bildes einnimmt, arbeitet diese demokratische Methode der Aufmerksamkeitsverteilung gegen die Natur der menschlichen Wahrnehmung und die Geschichte der Kunst und Fotografie.

Wenn die Knöpfe auf den Jeans einer Person die gleiche Rechenleistung wie ihre Augen erhalten, kann die Ressourcenzuweisung als nicht optimal bezeichnet werden.

Daher verwendet die neue Methode, die von den Autoren vorgeschlagen wird und Saliency Guided Optimization of Diffusion Latents (SGOOL) heißt, einen Saliency-Mapper, um die Aufmerksamkeit auf vernachlässigte Bereiche eines Bildes zu erhöhen und weniger Ressourcen für Abschnitte zu verwenden, die wahrscheinlich am Rande der Aufmerksamkeit des Betrachters bleiben.

Methode

Die SGOOL-Pipeline umfasst Bildgenerierung, Saliency-Mapping und Optimierung, wobei das gesamte Bild und das saliency-refinierte Bild gemeinsam verarbeitet werden.

Konzeptuelles Schema für SGOOL.

Die latenten Einbettungen des Diffusionsmodells werden direkt mit Feinabstimmung optimiert, wodurch die Notwendigkeit, ein spezifisches Modell zu trainieren, entfällt. Die Denoising Diffusion Implicit Model (DDIM)-Stichprobemethode von Stanford University, die Benutzern von Stable Diffusion vertraut ist, wird angepasst, um die sekundäre Information zu berücksichtigen, die durch Saliency-Karten bereitgestellt wird.