Andersons Blickwinkel

Die Korrektur der begrenzten Verständnisse von Diffusionsmodellen für Spiegelungen und Reflexionen

Seit generative KI das öffentliche Interesse auf sich gezogen hat, hat das Forschungsfeld der Computer-Vision seine Bemühungen um die Entwicklung von KI-Modellen, die physikalische Gesetze verstehen und replizieren können, intensiviert; jedoch stellt die Herausforderung, maschinelle Lernsysteme dazu zu bringen, Phänomene wie Schwerkraft und Flüssigkeitsdynamik zu simulieren, ein erhebliches Forschungsziel dar, das seit mindestens fünf Jahren besteht.

Seit latente Diffusionsmodelle (LDMs) im Jahr 2022 die generative KI-Szene dominierten, haben Forscher zunehmend auf die begrenzte Fähigkeit der LDM-Architektur hingewiesen, physikalische Phänomene zu verstehen und zu reproduzieren. Jetzt hat dieses Problem durch die bahnbrechende Entwicklung von OpenAIs generativem Video-Modell Sora und die (arguably) folgenreichere jüngste Veröffentlichung der Open-Source-Video-Modelle Hunyuan Video und Wan 2.1 zusätzliche Bedeutung gewonnen.

Schlechte Reflexionen

Die meisten Forschungen, die darauf abzielen, das Verständnis von LDMs für Physik zu verbessern, haben sich auf Bereiche wie Gangsimulation, Teilchenphysik und andere Aspekte der newtonschen Bewegung konzentriert. Diese Bereiche haben Aufmerksamkeit erregt, weil Ungenauigkeiten in grundlegenden physikalischen Verhaltensweisen sofort die Authentizität von künstlich generierten Videos untergraben würden.

Es gibt jedoch einen kleinen, aber wachsenden Forschungsstrang, der sich auf eine der größten Schwächen von LDMs konzentriert – ihre relative Unfähigkeit, genaue Reflexionen zu erzeugen.

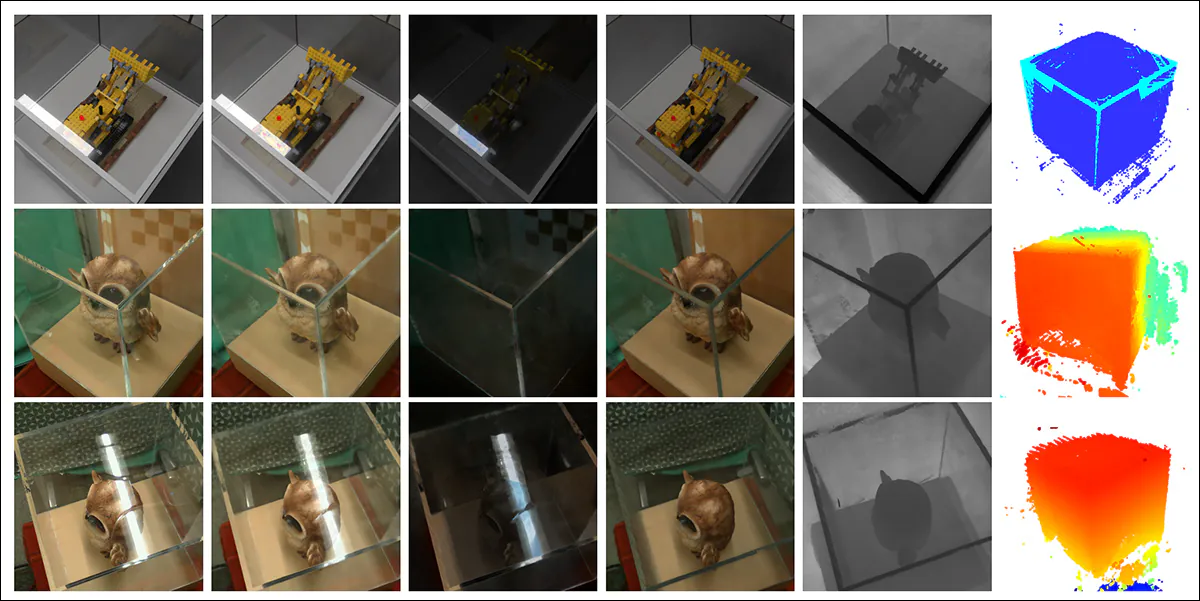

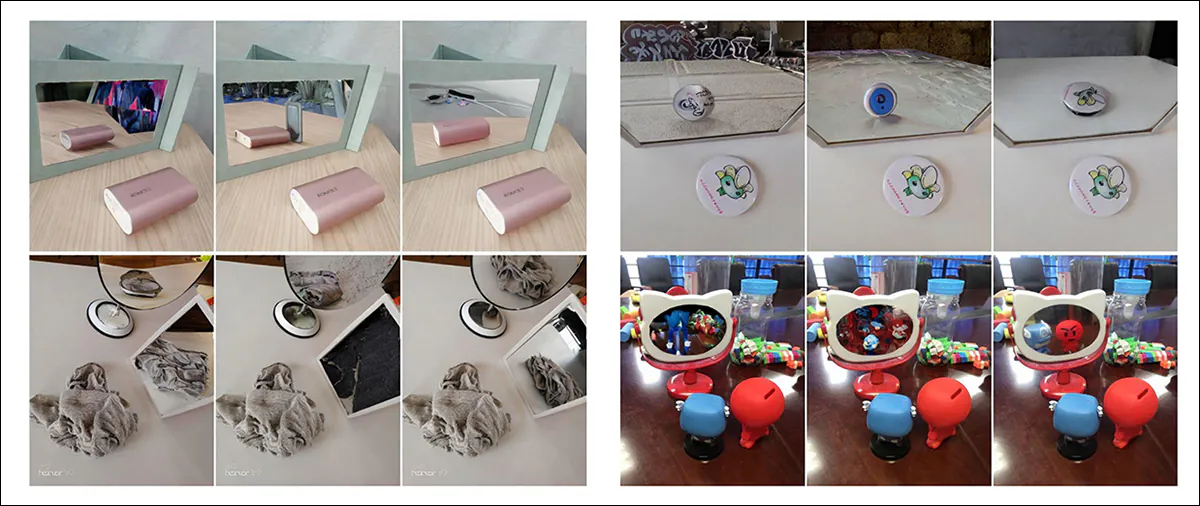

Aus dem Januar 2025-Papier ‘Reflecting Reality: Enabling Diffusion Models to Produce Faithful Mirror Reflections’, Beispiele für ‘Reflexionsfehler’ im Vergleich zum eigenen Ansatz der Forscher. Quelle: https://arxiv.org/pdf/2409.14677

Dieses Problem war auch während der CGI-Ära und bleibt es im Bereich der Videospiele, wo Ray-Tracing-Algorithmen den Pfad des Lichts simulieren, wenn es mit Oberflächen interagiert. Ray-Tracing berechnet, wie virtuelle Lichtstrahlen von Objekten abprallen oder durch sie hindurchgehen, um realistische Reflexionen, Brechungen und Schatten zu erzeugen.

Jedoch erhöht jeder zusätzliche Abprall den Rechenaufwand erheblich, sodass Echtzeitanwendungen einen Kompromiss zwischen Latenz und Genauigkeit eingehen müssen, indem sie die Anzahl der zulässigen Lichtstrahl-Abpralle begrenzen.

![Eine Darstellung eines virtuell berechneten Lichtstrahls in einer herkömmlichen 3D-basierten (d. h. CGI-)Szene, die Technologien und Prinzipien verwendet, die erstmals in den 1960er Jahren entwickelt und zwischen 1982-93 (dem Zeitraum zwischen Tron [1982] und Jurassic Park [1993]) zur vollen Entfaltung kamen. Quelle: https://www.unrealengine.com/en-US/explainers/ray-tracing/what-is-real-time-ray-tracing](https://www.unite.ai/wp-content/uploads/2025/04/ray-tracing.jpg)

Eine Darstellung eines virtuell berechneten Lichtstrahls in einer herkömmlichen 3D-basierten (d. h. CGI-)Szene, die Technologien und Prinzipien verwendet, die erstmals in den 1960er Jahren entwickelt und zwischen 1982-93 (dem Zeitraum zwischen ‘Tron’ [1982] und ‘Jurassic Park’ [1993]) zur vollen Entfaltung kamen. Quelle: https://www.unrealengine.com/en-US/explainers/ray-tracing/what-is-real-time-ray-tracing

Zum Beispiel könnte die Darstellung eines Chromteekessels vor einem Spiegel ein Ray-Tracing-Prozess beinhalten, bei dem Lichtstrahlen wiederholt zwischen reflektierenden Oberflächen abprallen, was eine fast endlose Schleife mit wenig praktischem Nutzen für das Endbild erzeugt. In den meisten Fällen reicht eine Reflexionstiefe von zwei bis drei Abprallen bereits aus, um zu überschreiten, was der Betrachter wahrnehmen kann. Ein einzelner Abprall würde zu einem schwarzen Spiegel führen, da das Licht mindestens zwei Reisen zurücklegen muss, um eine sichtbare Reflexion zu bilden.

Jeder zusätzliche Abprall erhöht den Rechenaufwand stark, oft verdoppelt er die Renderte Zeit, was ein schnelleres Handling von Reflexionen eine der größten Chancen für die Verbesserung der Qualität von Ray-Tracing-Darstellungen macht.

Natürlich treten Reflexionen auch in weniger offensichtlichen Szenarien auf – wie auf der reflektierenden Oberfläche einer Stadtstraße oder eines Schlachtfelds nach dem Regen; die Reflexion der gegenüberliegenden Straße in einem Schaufenster oder einer Glastür; oder in den Brillen dargestellter Charaktere, wo Objekte und Umgebungen so erscheinen müssen, als ob sie reflektiert würden.

Ein simulierter Zwillingsreflex, der durch traditionelle Komposition für eine ikonische Szene in ‘The Matrix’ (1999) erzeugt wurde.

Bildprobleme

Aus diesem Grund haben Frameworks, die vor der Einführung von Diffusionsmodellen populär waren, wie Neuronale Radiance-Felder (NeRF), und einige neuere Herausforderer wie Gaussian Splatting ihre eigenen Schwierigkeiten, Reflexionen auf natürliche Weise zu simulieren.

Das REF2-NeRF-Projekt (abgebildet unten) schlug eine NeRF-basierte Modellierungsmethode für Szenen mit einem Glasgehäuse vor. Bei dieser Methode wurden Refraktion und Reflexion mithilfe von Elementen modelliert, die von der Perspektive des Betrachters abhängig und unabhängig waren. Dieser Ansatz ermöglichte es den Forschern, die Oberflächen zu schätzen, an denen Refraktion auftrat, insbesondere Glasoberflächen, und ermöglichte die Trennung und Modellierung sowohl direkt als auch reflektierter Lichtkomponenten.

Beispiele aus dem Ref2Nerf-Papier. Quelle: https://arxiv.org/pdf/2311.17116

Andere NeRF-Reflexionslösungen der letzten 4-5 Jahre umfassen NeRFReN, Reflecting Reality und Meta’s 2024 Planar Reflection-Aware Neural Radiance Fields Projekt.

Für GSplat haben Papiere wie Mirror-3DGS, Reflective Gaussian Splatting und RefGaussian Lösungen für das Reflexionsproblem angeboten, während das 2023 Nero-Projekt eine spezielle Methode zur Einbeziehung reflektierender Eigenschaften in neuronale Darstellungen vorschlug.

MirrorVerse

Es ist schwieriger, ein Diffusionsmodell dazu zu bringen, Reflexionslogik zu respektieren, als bei explizit strukturierten, nicht-semantischen Ansätzen wie Gaussian Splatting und NeRF. In Diffusionsmodellen ist eine Regel dieser Art nur dann zuverlässig einbettbar, wenn die Trainingsdaten viele verschiedene Beispiele aus einer breiten Palette von Szenarien enthalten, was es stark von der Verteilung und Qualität des ursprünglichen Datensatzes abhängig macht.

Traditionell ist das Hinzufügen bestimmter Verhaltensweisen dieser Art die Aufgabe eines LoRA oder der Feinabstimmung des Basismodells; aber diese sind keine idealen Lösungen, da ein LoRA tendenziell die Ausgabe auf seine eigene Trainingsdaten neigt, auch ohne Prompting, während Feinabstimmungen – abgesehen davon, dass sie teuer sind – ein großes Modell unwiderruflich von der Hauptlinie ablenken und eine Vielzahl von benutzerdefinierten Tools hervorrufen können, die nie mit einem anderen Stamm des Modells funktionieren werden, einschließlich des ursprünglichen.

Im Allgemeinen erfordert die Verbesserung von Diffusionsmodellen, dass die Trainingsdaten mehr Aufmerksamkeit auf die Physik der Reflexion legen. Es gibt jedoch viele andere Bereiche, die ähnliche besondere Aufmerksamkeit benötigen. Im Kontext von Hyperscale-Datensätzen, in denen eine benutzerdefinierte Kuration teuer und schwierig ist, ist es praktisch nicht möglich, jede einzelne Schwäche auf diese Weise anzugehen.

Trotzdem tauchen Lösungen für das LDM-Reflexionsproblem gelegentlich auf. Ein jüngstes Beispiel ist das MirrorVerse-Projekt aus Indien, das einen verbesserten Datensatz und ein Trainingsverfahren anbietet, das in der Lage ist, den aktuellen Stand der Technik in dieser speziellen Herausforderung der Diffusionsforschung zu verbessern.

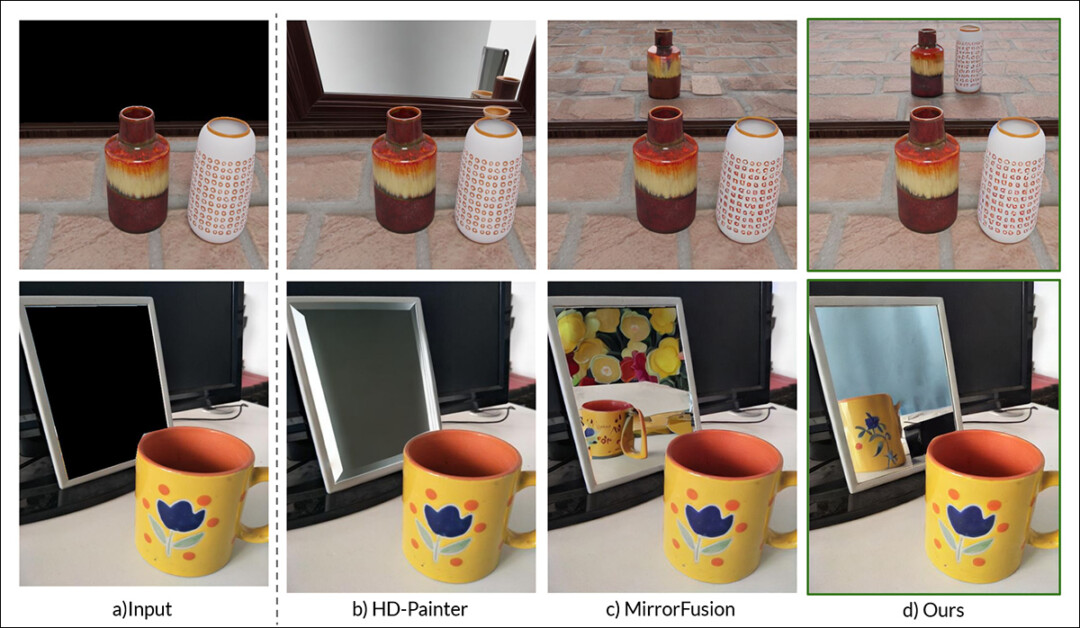

Rechts, die Ergebnisse von MirrorVerse im Vergleich zu zwei vorherigen Ansätzen (zwei mittlere Spalten). Quelle: https://arxiv.org/pdf/2504.15397

Wie wir im oben abgebildeten Beispiel sehen können (das Titelbild im PDF der neuen Studie), verbessert MirrorVerse die jüngsten Angebote, die dasselbe Problem angehen, aber ist weit davon entfernt, perfekt zu sein.

Im oberen rechten Bild sehen wir, dass die Keramikgefäße ein wenig rechts von ihrer korrekten Position sind, und im Bild darunter, das technisch gesehen keine Reflexion der Tasse aufweisen sollte, wurde eine ungenaue Reflexion in den rechten Bereich gezwängt, gegen die Logik natürlicher Reflexionswinkel.

Daher werden wir uns die neue Methode nicht so sehr ansehen, weil sie den aktuellen Stand der Technik im diffusionsbasierten Reflexionsverhalten darstellen könnte, sondern vielmehr, um die Ausmaße zu veranschaulichen, in denen dies ein unlösbares Problem für latente Diffusionsmodelle, statische und Video-Modelle, sein könnte, da die erforderlichen Beispieldaten für Reflexivität wahrscheinlich mit bestimmten Aktionen und Szenarien verflochten sind.

Daher kann diese spezielle Funktion von LDMs weiterhin hinter strukturbezogenen Ansätzen wie NeRF, GSplat und traditioneller CGI zurückbleiben.

Das neue Papier trägt den Titel MirrorVerse: Pushing Diffusion Models to Realistically Reflect the World und stammt von drei Forschern aus dem Vision and AI Lab, IISc Bangalore, und dem Samsung R&D Institute in Bangalore. Das Papier hat eine zugehörige Projektseite sowie ein Dataset bei Hugging Face mit Quellcode, der auf GitHub veröffentlicht wurde.

Methode

Die Forscher betonen von Anfang an die Schwierigkeit, die Modelle wie Stable Diffusion und Flux haben, Reflexions-basierte Prompts zu respektieren, und veranschaulichen das Problem auf eine ansprechende Weise:

Aus dem Papier: Aktuelle State-of-the-Art-Text-Bild-Modelle, SD3.5 und Flux, zeigten erhebliche Herausforderungen bei der Erzeugung konsistenter und geometrisch genauer Reflexionen, wenn sie aufgefordert wurden, sie in einer Szene zu generieren.

Die Forscher haben MirrorFusion 2.0 entwickelt, ein diffusionsbasiertes generatives Modell, das darauf abzielt, die Photorealismus und geometrische Genauigkeit von Spiegelreflexionen in synthetischen Bildern zu verbessern. Die Trainingsdaten für das Modell basierten auf dem eigenen neu kuratierten Datensatz der Forscher, der MirrorGen2 heißt und darauf abzielt, die Generalisierungsschwächen zu adressieren, die in vorherigen Ansätzen beobachtet wurden.

MirrorGen2 erweitert frühere Methoden, indem es zufällige Objektpositionierung, zufällige Rotationen und explizite Objektverankerung einführt, mit dem Ziel, sicherzustellen, dass Reflexionen über eine breitere Palette von Objektposen und -platzierungen im Verhältnis zur Spiegelfläche plausibel bleiben.

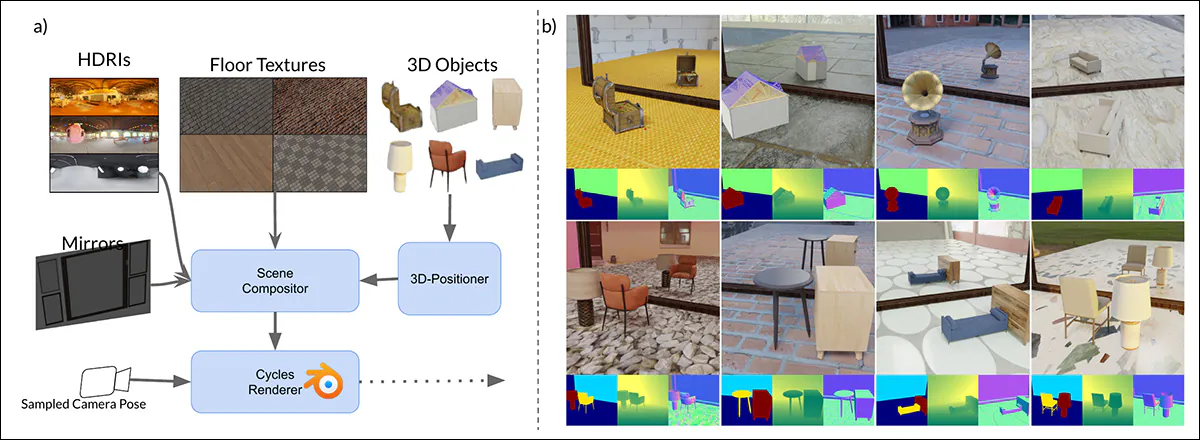

Schema für die Generierung von synthetischen Daten in MirrorVerse: Die Datengenerierungspipeline wendete wichtige Augmentierungen an, indem sie Objekte zufällig innerhalb der Szene positionierte, rotierte und verankerte, unter Verwendung des 3D-Positionierers. Objekte wurden auch in semantisch konsistenten Kombinationen gepaart, um komplexe räumliche Beziehungen und Okklusionen zu simulieren, was es dem Datensatz ermöglichte, realistischere Interaktionen in Szenen mit mehreren Objekten zu erfassen.

Um die Fähigkeit des Modells zur Handhabung komplexer räumlicher Anordnungen weiter zu stärken, integrierte die MirrorGen2-Pipeline gepaarte Objektszenen, was es dem System ermöglichte, Okklusionen und Interaktionen zwischen mehreren Elementen in reflektierenden Umgebungen besser darzustellen.

Das Papier besagt:

‘Kategorien werden manuell gepaart, um semantische Kohärenz zu gewährleisten – zum Beispiel, indem ein Stuhl mit einem Tisch gepaart wird. Während der Rendering-Prozess, nachdem die Positionierung und Rotation des primären [Objekts] durchgeführt wurde, wird ein zusätzliches [Objekt] aus der gepaarten Kategorie ausgewählt und so angeordnet, dass es nicht mit dem primären Objekt überschneidet, wodurch unterschiedliche räumliche Bereiche innerhalb der Szene geschaffen werden.’

In Bezug auf die explizite Objektverankerung stellten die Autoren sicher, dass die generierten Objekte im synthetischen Ausgabedatensatz “verankert” waren, anstatt unangemessen “schwebend”, was bei der Generierung von synthetischen Daten im großen Maßstab oder mit hochautomatisierten Methoden auftreten kann.

Da die Datensatzinnovation zentral für die Neuheit des Papiers ist, werden wir früher als üblich zu diesem Abschnitt des Artikels übergehen.

Daten und Tests

SynMirrorV2

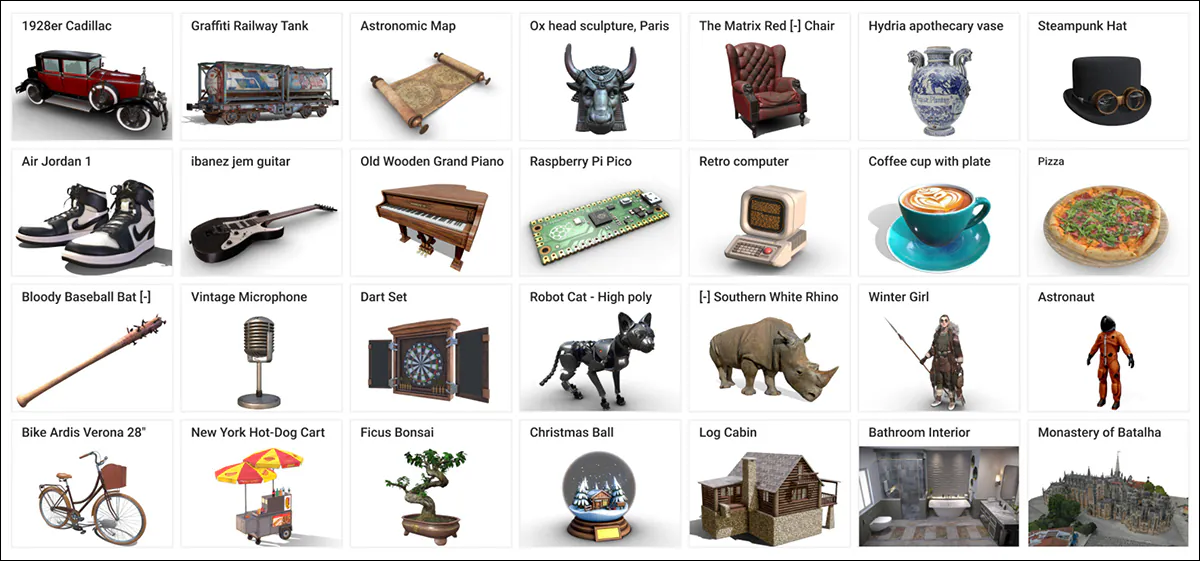

Der SynMirrorV2-Datensatz der Forscher wurde entwickelt, um die Vielfalt und Realistik von Trainingsdaten für Spiegelreflexionen zu verbessern, mit 3D-Objekten aus dem Objaverse und Amazon Berkeley Objects (ABO)-Datensatz, die anschließend durch OBJECT 3DIT sowie den Filterprozess aus dem V1 MirrorFusion-Projekt verfeinert wurden, um niedrigwertige Assets auszuschließen. Dies führte zu einem verfeinerten Pool von 66.062 Objekten.

Beispiele aus dem Objaverse-Datensatz, der zur Erstellung des kuratierten Datensatzes für das neue System verwendet wurde. Quelle: https://arxiv.org/pdf/2212.08051

Die Szenenkonstruktion umfasste das Platzieren dieser Objekte auf texturierten Böden aus CC-Textures und HDRI-Hintergründen aus dem PolyHaven-CGI-Repository, unter Verwendung von vollständigen Wandspiegeln oder hohen rechteckigen Spiegeln. Die Beleuchtung wurde standardisiert mit einer Flächenlichtquelle, die über und hinter den Objekten bei einem 45-Grad-Winkel positioniert war. Objekte wurden skaliert, um in einen Einheitswürfel zu passen, und unter Verwendung einer vorkomputierten Schnittmenge des Spiegels und der Kamera-Sicht-Frustums positioniert, um Sichtbarkeit zu gewährleisten.

Zufällige Rotationen wurden um die y-Achse angewendet, und eine Verankerungstechnik wurde verwendet, um “schwebende Artefakte” zu vermeiden.

Um komplexere Szenen zu simulieren, umfasste der Datensatz auch mehrere Objekte, die gemäß semantisch kohärenten Paarungen basierend auf ABO-Kategorien angeordnet wurden. Sekundäre Objekte wurden so platziert, dass sie nicht mit dem primären Objekt überschnitten, wodurch 3.140 Szenen mit mehreren Objekten erstellt wurden, die darauf abzielten, verschiedene Okklusionen und Tiefenbeziehungen zu erfassen.

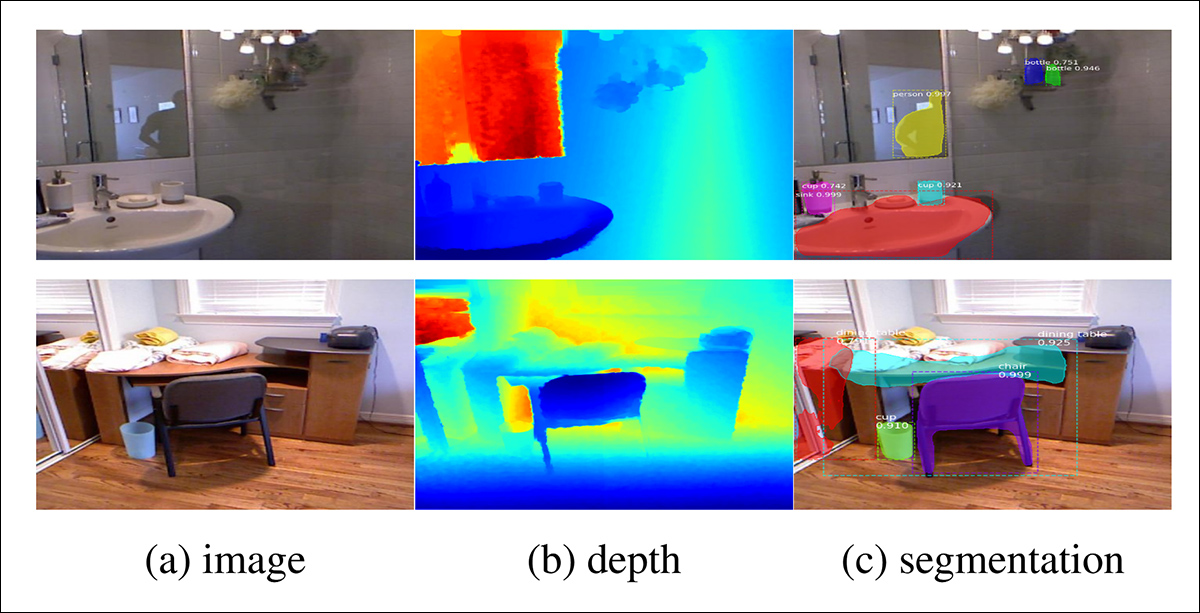

Beispiele für gerenderte Ansichten aus dem Datensatz der Autoren, der mehrere (mehr als zwei) Objekte enthält, mit Darstellungen von Objektsegmentierung und Tiefenkartendarstellungen unten.

Trainingsprozess

Die Forscher haben anerkannt, dass synthetische Realistik allein nicht ausreicht, um eine robuste Generalisierung auf Echtdaten zu gewährleisten, und haben daher einen dreistufigen Lernprozess für die Trainierung von MirrorFusion 2.0 entwickelt.

In Phase 1 initialisierten die Autoren die Gewichte beider Bedingungs- und Generierungsbranchen mit dem Stable Diffusion v1.5-Checkpoint und feinabstimmten das Modell auf dem Single-Object-Trainings-Split des SynMirrorV2-Datensatzes. Im Gegensatz zum oben erwähnten Reflecting Reality-Projekt froren die Forscher die Generierungsbranche nicht ein. Sie trainierten das Modell dann für 40.000 Iterationen.

In Phase 2 wurde das Modell für weitere 10.000 Iterationen auf dem Multiple-Object-Trainings-Split des SynMirrorV2-Datensatzes feinabgestimmt, um das System zu lehren, Okklusionen und komplexere räumliche Anordnungen in realistischen Szenen zu handhaben.

Schließlich wurde in Phase 3 eine weitere Feinabstimmung von 10.000 Iterationen mit Echtdaten aus dem MSD-Datensatz durchgeführt, unter Verwendung von Tiefenkartendaten, die mit dem Matterport3D-monokularen Tiefenschätzer generiert wurden.

Beispiele aus dem MSD-Datensatz, mit realen Szenen, die in Tiefen- und Segmentierungskarten analysiert wurden. Quelle: https://arxiv.org/pdf/1908.09101

Während der Trainierung wurden Textprompts für 20 Prozent der Trainingszeit weggelassen, um das Modell zu ermutigen, die verfügbare Tiefeninformation optimal zu nutzen (d. h. ein “maskierter” Ansatz).

Die Trainierung fand auf vier NVIDIA A100-GPUs für alle Phasen statt (die VRAM-Spezifikation wird nicht angegeben, aber es wäre 40 GB oder 80 GB pro Karte gewesen). Ein Lernrate von 1e-5 wurde mit einem Batch-Size von 4 pro GPU unter dem AdamW-Optimizer verwendet.

Dieses Trainingsverfahren erhöhte schrittweise die Schwierigkeit der Aufgaben, die dem Modell präsentiert wurden, beginnend mit einfacheren synthetischen Szenen und fortschreitend zu komplexeren Zusammensetzungen, mit dem Ziel, eine robuste Übertragbarkeit auf Echtdaten zu entwickeln.

Testen

Die Autoren bewerteten MirrorFusion 2.0 gegen den vorherigen State-of-the-Art, MirrorFusion, der als Baseline diente, und führten Experimente auf dem MirrorBenchV2-Datensatz durch, der sowohl Single- als auch Multi-Object-Szenen abdeckt.

Zusätzliche qualitative Tests wurden auf Proben aus dem MSD-Datensatz und dem Google Scanned Objects (GSO)-Datensatz durchgeführt.

Die Bewertung verwendete 2.991 Single-Object-Bilder aus bekannten und unbekannten Kategorien und 300 Zwei-Objekt-Szenen aus ABO. Die Leistung wurde unter Verwendung von Peak Signal-to-Noise Ratio (PSNR); Structural Similarity Index (SSIM); und Learned Perceptual Image Patch Similarity (LPIPS) Scores bewertet, um die Reflexionsqualität im maskierten Spiegelbereich zu bewerten; CLIP-Ähnlichkeit wurde verwendet, um die textuelle Ausrichtung mit den Eingabeprompts zu bewerten.

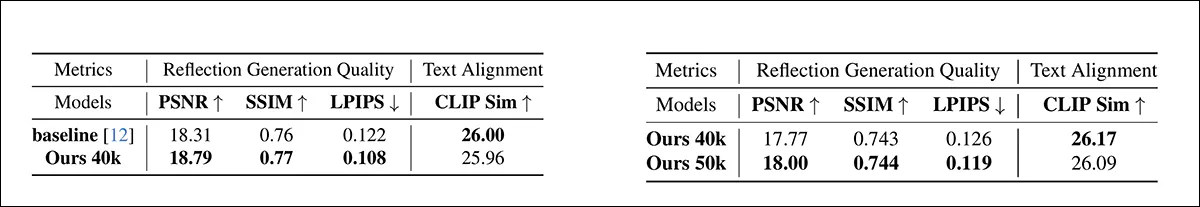

In quantitativen Tests generierten die Autoren Bilder unter Verwendung von vier Seeds für einen bestimmten Prompt und wählten das resultierende Bild mit dem besten SSIM-Score aus. Die beiden in den Ergebnistabellen aufgeführten Tabellen sind unten dargestellt.

Links, quantitative Ergebnisse für die Generierung von Single-Object-Reflexionen auf dem MirrorBenchV2-Single-Object-Split. MirrorFusion 2.0 übertraf die Baseline, mit den besten Ergebnissen in Fettschrift. Rechts, quantitative Ergebnisse für die Generierung von Multi-Object-Reflexionen auf dem MirrorBenchV2-Multi-Object-Split. MirrorFusion 2.0, trainiert mit mehreren Objekten, übertraf die Version, die ohne sie trainiert wurde, mit den besten Ergebnissen in Fettschrift.

Die Autoren bemerken:

‘[Die Ergebnisse] zeigen, dass unsere Methode die Baseline-Methode übertrifft und das Feinabstimmen auf mehrere Objekte die Ergebnisse in komplexen Szenen verbessert.’

Der Großteil der Ergebnisse und diejenigen, die von den Autoren betont werden, beziehen sich auf qualitative Tests. Aufgrund der Dimensionen dieser Abbildungen können wir sie nur teilweise reproduzieren.

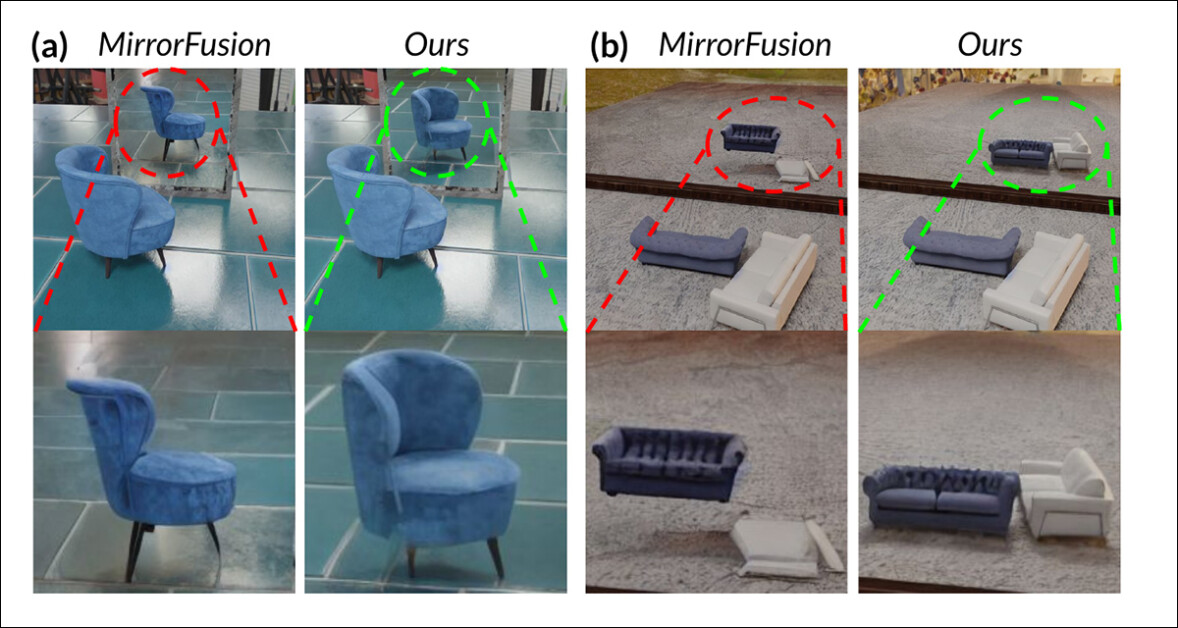

Vergleich auf MirrorBenchV2: Die Baseline scheiterte daran, genaue Reflexionen und räumliche Konsistenz beizubehalten, zeigte falsche Stuhl-Orientierung und verzerrte Reflexionen mehrerer Objekte, während (die Autoren behaupten) MirrorFusion 2.0 den Stuhl und die Sofas richtig wiedergibt, mit genauer Position, Orientierung und Struktur.

Von diesen subjektiven Ergebnissen sind die Forscher der Meinung, dass das Baseline-Modell nicht in der Lage war, Objekt-Orientierung und räumliche Beziehungen in Reflexionen genau wiederzugeben, oft Artefakte wie falsche Rotation und schwebende Objekte erzeugend. MirrorFusion 2.0, trainiert auf SynMirrorV2, bewahrt (laut den Autoren) korrekte Objekt-Orientierung und -Positionierung in Single-Object- und Multi-Object-Szenen, was realistischere und kohärentere Reflexionen zur Folge hat.

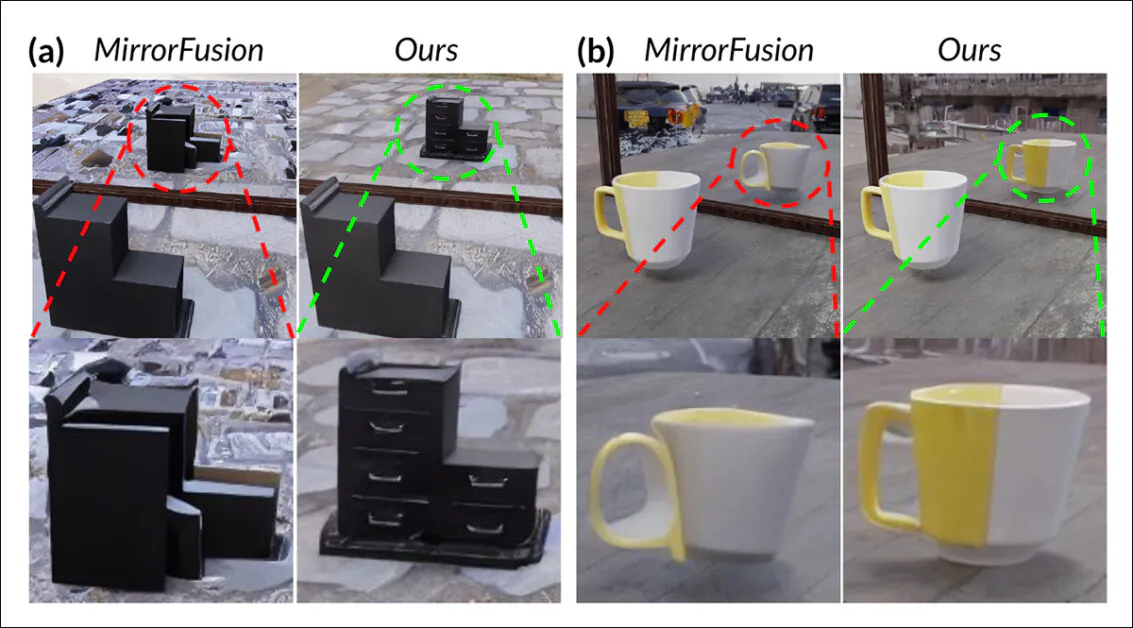

Unten sehen wir qualitative Ergebnisse auf dem oben erwähnten GSO-Datensatz:

Vergleich auf dem GSO-Datensatz. Die Baseline verfälschte die Objektstruktur und produzierte unvollständige, verzerrte Reflexionen, während MirrorFusion 2.0, laut den Autoren, räumliche Integrität bewahrt und genaue Geometrie, Farbe und Details erzeugt, sogar bei nicht im Trainingsdatensatz enthaltenen Objekten.

Hier bemerken die Autoren:

‘MirrorFusion 2.0 erzeugt wesentlich genauere und realistischere Reflexionen. Zum Beispiel erzeugt MirrorFusion 2.0 im Bild 5 (a – oben) die Schubladen-Griffe (grün hervorgehoben) richtig, während die Baseline eine unplausible Reflexion (rot hervorgehoben) produziert.

‘Ebenso erzeugt MirrorFusion 2.0 für den “Weiß-Gelben Becher” in Bild 5 (b) eine überzeugende Geometrie mit minimalen Artefakten, im Gegensatz zur Baseline, die nicht in der Lage ist, die Geometrie und Erscheinung des Objekts genau zu erfassen.’

Der letzte qualitative Test wurde gegen den oben erwähnten realen MSD-Datensatz (teilweise Ergebnisse unten) durchgeführt:

Ergebnisse realer Szenen, die MirrorFusion, MirrorFusion 2.0 und MirrorFusion 2.0, feinabgestimmt auf den MSD-Datensatz, vergleichen. MirrorFusion 2.0, laut den Autoren, erfasst komplexe Szenendetails genauer, einschließlich überfüllter Objekte auf einem Tisch und der Anwesenheit mehrerer Spiegel in einer dreidimensionalen Umgebung. Nur teilweise Ergebnisse werden hier gezeigt, aufgrund der Dimensionen der Ergebnisse im Originalpapier, auf das wir den Leser für vollständige Ergebnisse und bessere Auflösung verweisen.

Hier bemerken die Autoren, dass MirrorFusion 2.0, obwohl es auf MirrorBenchV2 und GSO-Daten gut abschnitt, anfangs mit komplexen realen Szenen im MSD-Datensatz zu kämpfen hatte. Die Feinabstimmung des Modells auf einem Teil des MSD-Datensatzes verbesserte seine Fähigkeit, überfüllte Umgebungen und mehrere Spiegel zu handhaben, was zu kohärenteren und detaillierteren Reflexionen auf dem Testsplit führte.

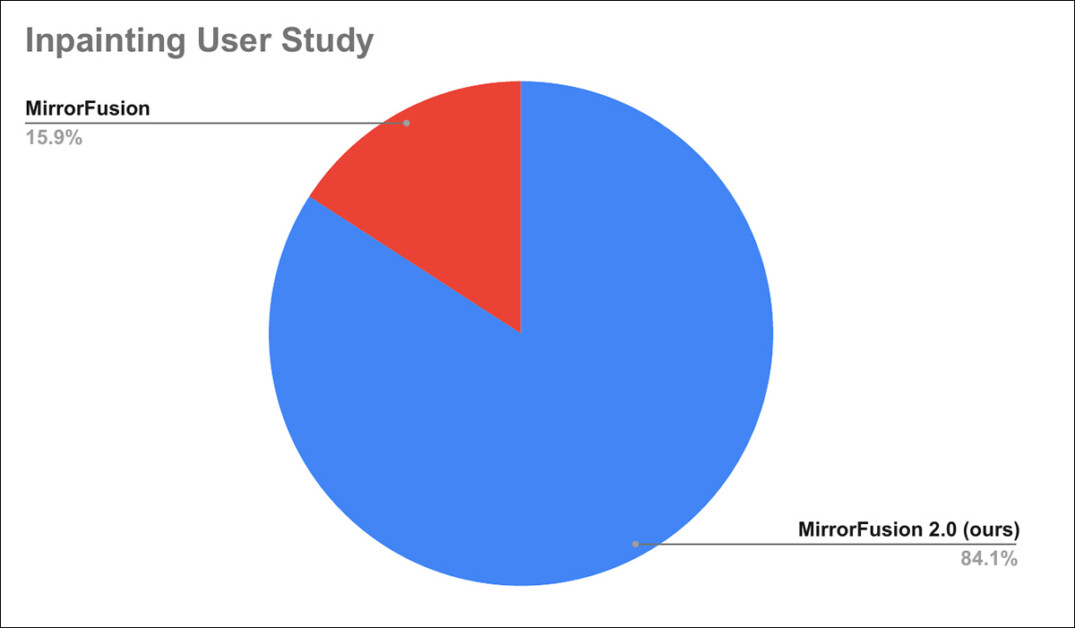

Zusätzlich wurde eine Benutzerstudie durchgeführt, bei der 84 % der Benutzer die Generierungen von MirrorFusion 2.0 gegenüber der Baseline-Methode bevorzugten.

Ergebnisse der Benutzerstudie.

Da Details der Benutzerstudie dem Anhang des Papiers zugewiesen wurden, verweisen wir den Leser darauf, um die spezifischen Details der Studie zu erfahren.

Schlussfolgerung

Obwohl einige der im Papier gezeigten Ergebnisse beeindruckende Verbesserungen gegenüber dem aktuellen Stand der Technik darstellen, ist der aktuelle Stand der Technik in diesem speziellen Verfolg so schlecht, dass sogar eine unüberzeugende Gesamtlösung mit einem Minimum an Aufwand siegen kann. Die grundlegende Architektur eines Diffusionsmodells ist der zuverlässigen Erfassung und Demonstration konsistenter Physik nicht zugänglich, sodass das Problem schlecht gestellt ist und offensichtlich nicht für eine elegante Lösung geeignet ist.

Weiterhin ist das Hinzufügen von Daten zu bestehenden Modellen bereits die Standardmethode, um Mängel in der LDM-Leistung zu beheben, mit allen oben genannten Nachteilen. Es ist vernünftig anzunehmen, dass, wenn zukünftige groß angelegte Datensätze mehr Aufmerksamkeit auf die Verteilung (und Annotation) von reflexionsbezogenen Datenpunkten legen, wir erwarten können, dass die resultierenden Modelle dieses Szenario besser handhaben würden.

Jedoch gilt das Gleiche für mehrere andere Probleme in der LDM-Ausgabe – wer kann sagen, welches von ihnen am meisten die Anstrengung und das Geld verdient, die in die Art von Lösung investiert werden, die die Autoren des neuen Papiers hier vorschlagen?

Erstveröffentlicht am Montag, den 28. April 2025. Am Dienstag, den 29. April, wurde eine grammatische Korrektur in den letzten Absätzen vorgenommen.