Andersons Blickwinkel

Eine ‘Zen’-Methode, um Sprachmodelle davon abzuhalten, zu hallucinieren

Wenn man ChatGPT auffordert, eine zufällige Antwort auf eine Frage zu überprüfen, bevor man ein tatsächliches Problem löst, lässt es das Modell härter nachdenken und erhält die Antwort öfter richtig – sogar wenn die frühere ‘zufällige’ Antwort nichts mit der tatsächlichen Anfrage zu tun hat.

Eine interessante neue Studie aus China hat eine sehr kostengünstige Methode entwickelt, um Sprachmodelle wie ChatGPT davon abzuhalten, zu hallucinieren, und um die Qualität der Antworten zu verbessern: Lassen Sie das Modell die Antwort auf eine völlig unabhängige Frage überprüfen:

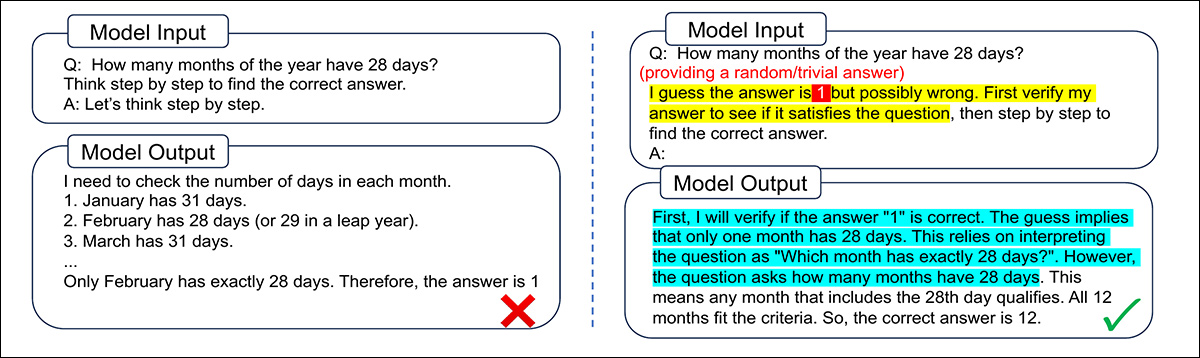

Ein Beispiel für eine unabhängige Frage, die den ‘Geist’ eines LLM ‘befreien’ und es helfen kann, sich auf eine (reale) nachfolgende Anfrage zu konzentrieren. Quelle

Diese Zen-Ohrfeige ist eine unglaublich billige Möglichkeit, die Leistung zu verbessern, im Vergleich zu anderen mehr involvierten Methoden, wie Feinabstimmung, Prompt-Crafting und paralleles Sampling, und es funktioniert auf offenen und geschlossenen Quellcode-Modellen, was darauf hindeutet, dass die Entdeckung eines fundamentalen Charaktermerkmals gemeinsam für mehrere LLM-Architekturen (und nicht ein fragiles Merkmal, das spezifisch für bestimmte Trainingsmaterialien oder -methoden ist).

Die Autoren skizzieren die Skaleneffekte, die durch die Verbesserung der Ausgabe auf diese spartanische Weise möglich sind*:

‘Um mit minimalen zusätzlichen Vorkenntnissen zu implementieren, benötigt VF nur eine zufällige/triviale Antwort in der Prompt. Der Überprüfungsprozess hat sich als viel weniger Ausgabe-Tokens als ein gewöhnlicher CoT-Pfad herausgestellt, [manchmal] sogar ohne expliziten Überprüfungsprozess, was [sehr] wenig zusätzliche Testzeit-Rechnung erfordert.’

In Tests konnte dieser Ansatz – der als Verification-First (VF) bezeichnet wird – die Antworten in einer Vielzahl von Aufgaben verbessern, einschließlich mathematischer Argumentation, auf offenen Quellcode- und kommerziellen Plattformen.

Ein Teil des Grundes, warum diese Technik funktioniert, liegt möglicherweise in der Art und Weise, wie Sprachmodelle Trends in der menschlichen Psychologie aufnehmen und anwenden, so dass eine direkte Frage das Modell ‘defensiv’ und ‘nervös’ machen kann, während eine Anfrage, die Arbeit eines anderen zu überprüfen, diese ‘Überlebensinstinkte’ nicht auslöst.

Die Kernidee ist, dass das Überprüfen einer Antwort weniger Aufwand erfordert als die Erstellung einer Antwort von Grund auf, und dass es einen anderen Argumentationspfad auslösen kann, der den Standard-Chain-of-Thought-Ansatz ergänzt.

Das Auffordern des Modells, eine gegebene Antwort (d. h. eine Antwort, die das Modell nicht selbst erstellt hat) zu kritisieren, kann auch eine Art kritisches Denken aktivieren, das hilft, eine Überzeugung in den eigenen ersten Eindrücken des Modells zu vermeiden.

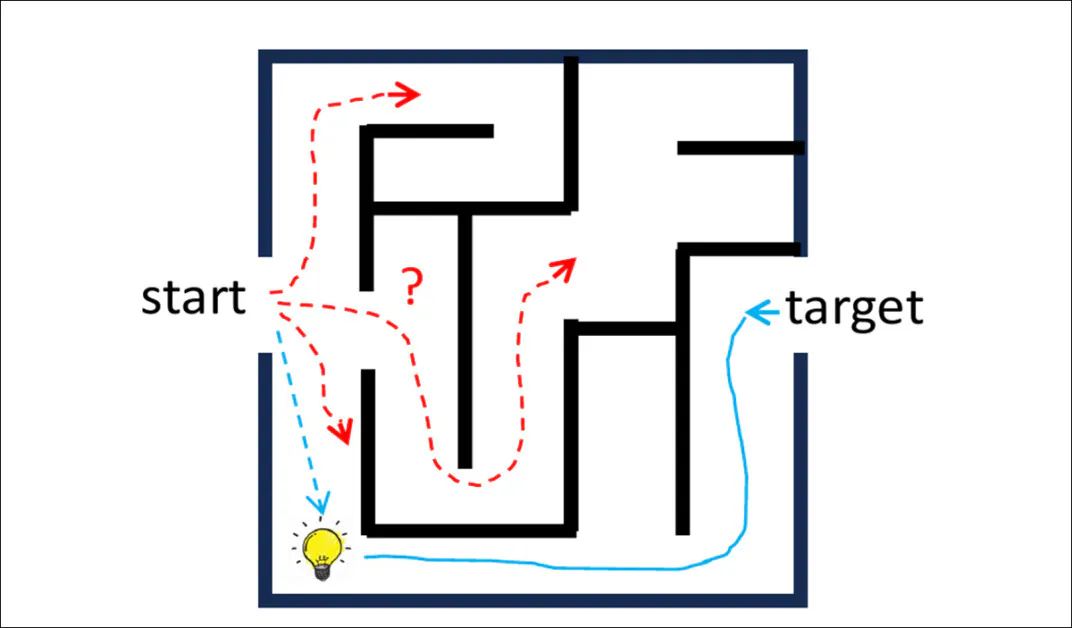

Die Arbeit charakterisiert den Prozess in Bezug auf einen reverse-reasoning path:

Beginnend mit einer vorgeschlagenen Antwort und rückwärts zur Frage zu argumentieren, kann Abkürzungen oder Erkenntnisse aufdecken, die schwerer zu finden sind, wenn man vom Problem aus vorwärts argumentiert. Dieser ‘rückwärts gerichtete Pfad’ kann eine einfachere Traektorie verfolgen und komplementäre Informationen zum Standard-Chain-of-Thought-Argumentationspfad bieten.

Die Forscher haben die zentrale Konzeption auch in Iter-VF konkretisiert, einer sequenziellen Zeit-Test-Skalierungsmethode, die Antworten iterativ verfeinert, ohne dass ein Retraining oder spezielle Werkzeuge erforderlich sind.

Die neue Arbeit trägt den Titel Das Fordern von LLMs, zuerst zu überprüfen, ist fast ein kostenloses Mittagessen und stammt von zwei Forschern der Abteilung für Elektronikingenieurwesen an der Tsinghua-Universität in Peking.

Methode

Die zentrale Idee hinter der neuen Arbeit ist es, den üblichen Argumentationsfluss in Sprachmodellen umzukehren. Anstatt das Modell auffordern, ein Problem von Grund auf zu lösen, erhält es zunächst eine Kandidatenantwort (oft falsch oder willkürlich) und wird aufgefordert, zu überprüfen, ob diese Antwort Sinn ergibt.

Dies fordert das Modell auf, rückwärts zu argumentieren, von der vorgeschlagenen Antwort zurück zur Frage. Sobald die Überprüfung abgeschlossen ist, geht das Modell wie üblich zum Lösen des ursprünglichen Problems über.

Diese Umkehrung, so behauptet die Arbeit, reduziert sorglose Fehler und fördert eine reflektiertere Argumentationsweise, die dem LLM hilft, verborgene Strukturen aufzudecken und irreführende Annahmen zu vermeiden.

Wie in den folgenden Beispielen zu sehen ist, kann bereits das Auffordern des Modells, eine offensichtlich falsche Vermutung wie ’10’ zu überprüfen, dazu beitragen, dass es sich von fehlerhafter Logik erholt und die Standard-Chain-of-Thought-Aufforderung übertrifft:

Das Auffordern des Modells, eine vermutete Antwort zuerst zu überprüfen, hilft ihm, Inkonsistenzen zu erkennen und sich sorgfältiger mit dem Problem auseinanderzusetzen. In diesem Beispiel führt der Standardansatz zu einer flüssigen, aber falschen Lösung, während die Verification-First-Aufforderung einen klaren logischen Aufbau und das richtige Ergebnis auslöst.

In Bezug auf viele reale Probleme ist es nicht leicht, dem Modell eine Vermutung zu geben, die es überprüfen kann, insbesondere wenn die Aufgabe offen ist, wie z. B. das Schreiben von Code oder das Aufrufen einer API. Daher passt die Methode zuerst ihre beste Antwort an, wie üblich, und gibt diese Antwort dann in das Verification-First-Format ein. Auf diese Weise überprüft das Modell seine eigene Ausgabe:

Wenn das Modell aufgefordert wird, seine eigene frühere Ausgabe zu überprüfen, erkennt es den Fehler in seiner Logik und schreibt die Lösung richtig. Die Verification-First-Aufforderung hilft ihm, sich auf den spezifischen Fehler zu konzentrieren, anstatt denselben Fehler zu wiederholen.

Dieser Ansatz stellt die oben erwähnte Iter-VF dar. Das Modell wiederholt diesen Zyklus, verfeinert seine Antwort jedes Mal, ohne dass ein Retraining oder spezielle Werkzeuge erforderlich sind. Im Gegensatz zu anderen Selbstkorrekturstrategien, die früheres Denken ansammeln und das Modell verwirren können, betrachtet Iter-VF nur die aktuellste Antwort jedes Mal, was dazu beiträgt, seine Argumentation klar zu halten.

Daten und Tests

Die Autoren bewerten die Methode in vier Bereichen: allgemeine Argumentationsaufgaben, bei denen VF mit einer trivialen Vermutung gesät wird; zeitkritische Aufgaben, bei denen Iter-VF mit rivalisierenden Skalierungsstrategien verglichen wird; offene Probleme wie Codierung und API-Aufrufe, bei denen VF die eigene frühere Antwort des Modells verwendet; und geschlossene kommerzielle LLMs, bei denen interne Argumentationsschritte nicht zugänglich sind.

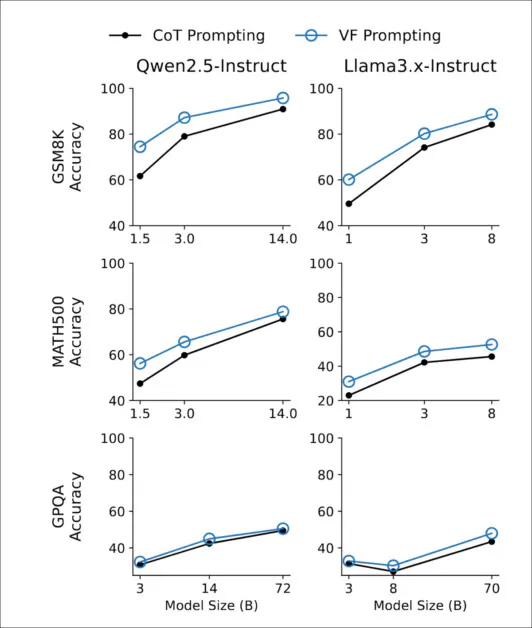

Um die Methode zu testen, verwendeten die Forscher drei Argumentationsbenchmarks: GSM8K und MATH500 für Mathematikprobleme; und GPQA-Diamond für wissenschaftliche Fragen auf Graduiertenebene.

In jedem Fall erhielt das Modell entweder eine triviale Vermutung, wie z. B. ‘1’ für numerische Antworten; oder eine zufällig angeordnete Multiple-Choice-Option als Startpunkt für die Überprüfung. Es wurden keine speziellen Anpassungen oder Vorkenntnisse hinzugefügt, und der Vergleichsgrundlagenwert war die Standard-Null-Shot-Chain-of-Thought-Aufforderung.

Die Tests liefen über einen vollständigen Bereich von Qwen2.5 und Llama3 anweisungsorientierten Modellen, von 1B bis 72B (Parameter) Größe. Die verwendeten Qwen-Modelle waren Qwen2.5-1.5B-Instruct, Qwen2.5-3B-Instruct, Qwen2.5-14B-Instruct und Qwen2.5-72B-Instruct. Die Llama3-Varianten waren Llama3.2-1B-Instruct, Llama3.2-3B-Instruct, Llama3.1-8B-Instruct und Llama3.3-70B-Instruct.

Wie unten gezeigt, hielt die Verbesserung durch die Verification-First-Aufforderung über alle Modellgrößen hinweg an, mit klaren Gewinnen, die bereits bei 1B Parametern sichtbar sind und bis zu 72B reichen:

Über alle Modellgrößen in den Qwen2.5- und Llama3-Familien hinweg übertraf die Verification-First-Aufforderung konstant die Standard-Chain-of-Thought-Aufforderung auf GSM8K, MATH500 und GPQA.

Der Effekt erwies sich als stärkstens auf rechenintensiven Mathematikbenchmarks wie GSM8K und MATH500, bei denen die Überprüfung einer falschen Antwort zu besseren Argumentationen führte als das Lösen von Grund auf. Bei GPQA, das mehr auf gespeicherten Wissen als auf deduktive Struktur angewiesen ist, war der Vorteil geringer, aber konstant.

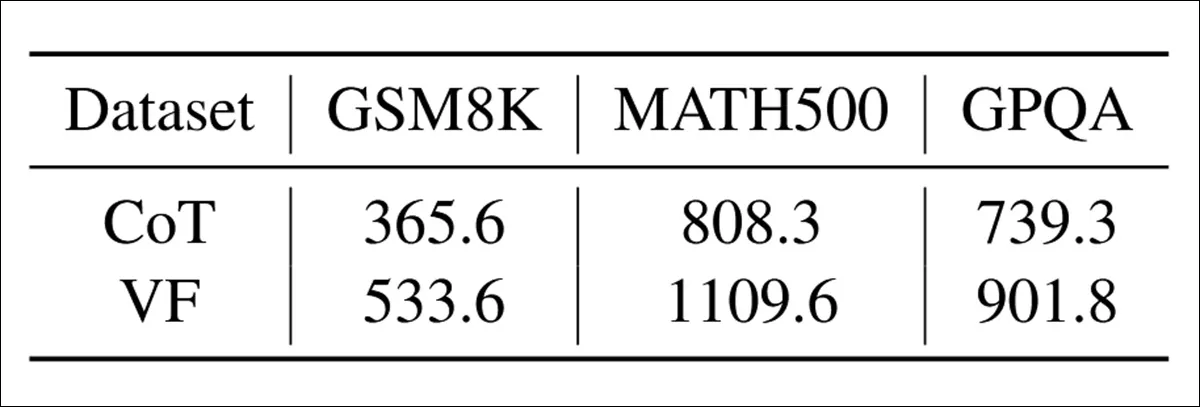

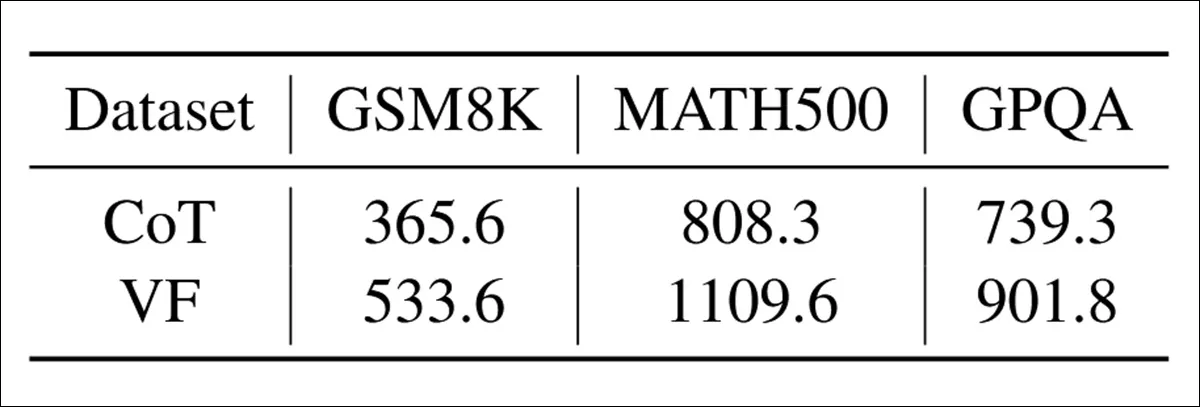

Der Rechenaufwand für die Verification-First-Aufforderung war bescheiden: In der folgenden Tabelle können wir sehen, dass die Generierung eines Überprüfungsschritts etwa 20-50 % mehr Ausgabe-Tokens im Vergleich zur Standard-Chain-of-Thought-Aufforderung hinzufügte:

Die durchschnittliche Anzahl der generierten Ausgabe-Tokens unter jeder Aufforderungsmethode, über GSM8K-, MATH500- und GPQA-Benchmarks hinweg.

Trotzdem blieb der zusätzliche Aufwand weit unter dem, der für Strategien erforderlich ist, die mehrere beispielhafte Vervollständigungen oder rekursive Planung erfordern.

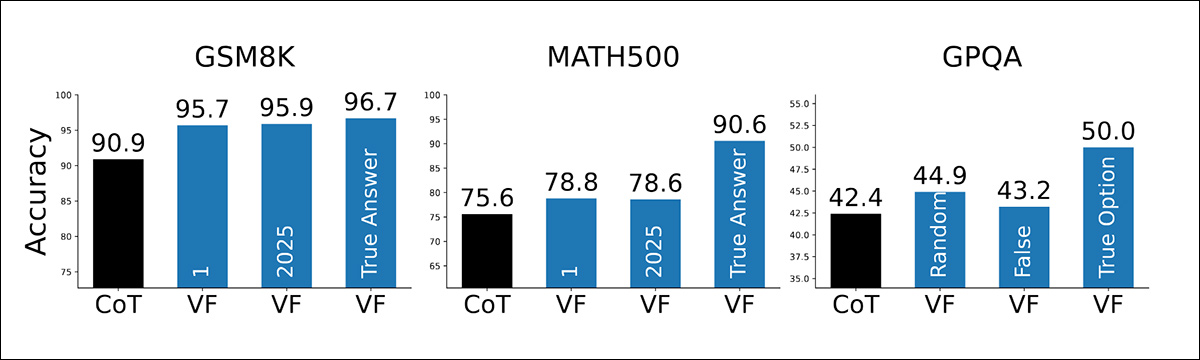

In dem folgenden Graphen können wir sehen, wie empfindlich die Methode auf die Qualität der vermuteten Antwort reagiert. Überraschenderweise übertraf die Verification-First-Aufforderung die Standardaufforderung, sogar wenn die Vermutung trivial (‘1’), unplausibel (‘2025’) oder eine zufällige Multiple-Choice-Option war:

Genauigkeitsgewinne durch die Verification-First-Aufforderung, wenn dem Modell triviale, unplausibele oder korrekte Antworten zur Überprüfung gegeben werden, über GSM8K, MATH500 und GPQA hinweg.

Wie erwartet, sprang die Genauigkeit noch höher, wenn die Vermutung zufällig die korrekte Antwort war; aber die Methode funktionierte gut, unabhängig davon, was die Vermutung war, was darauf hindeutet, dass die Gewinne nicht durch die Information in der vermuteten Antwort selbst getrieben wurden, sondern einfach durch die Handlung der Überprüfung.

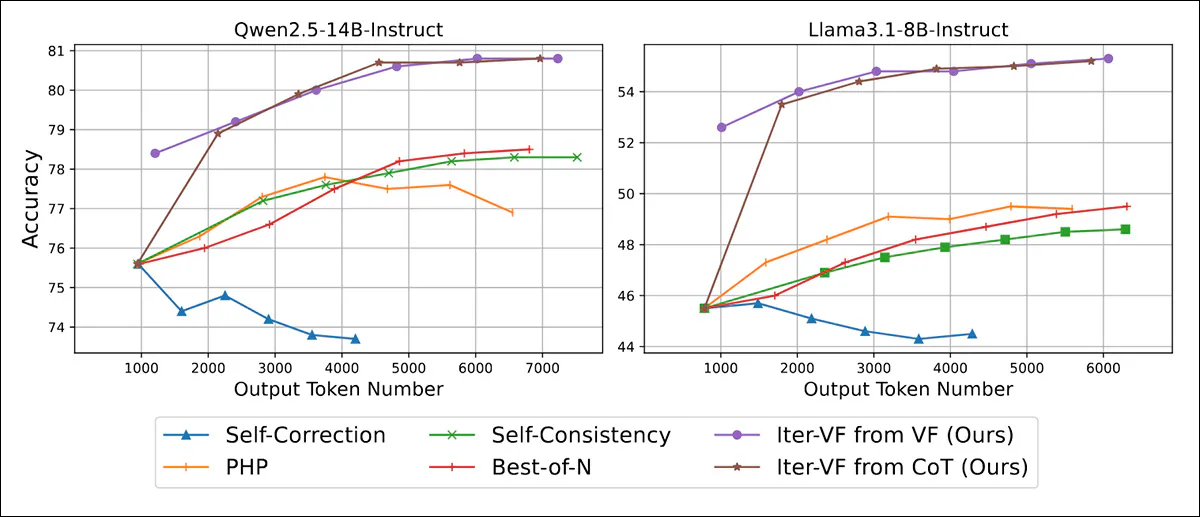

Iter-VF wurde auch mit vier Testzeit-Skalierungsstrategien verglichen, die ohne Retraining oder anwendungsspezifische Anpassung funktionieren. Bei Selbstkorrektur wurde das Modell aufgefordert, seine Antworten zu überarbeiten, indem es auf frühere Argumentationsschritte reflektierte; bei PHP wurden frühere Antworten dem Eingabe-Text als kontextuelle Hinweise hinzugefügt, obwohl keine Anweisungen dazu gegeben wurden, wie diese zu verwenden sind.

Zusätzlich wurden in Selbstkonsistenz mehrere Argumentationspfade beprobt und die endgültige Antwort durch Mehrheitsentscheid gewählt; und schließlich in Best-of-N mehrere Ausgaben unabhängig generiert und unter Verwendung eines Verifier-Prompts bewertet, wobei die höchstbewertete Antwort ausgewählt wurde.

Zwei Varianten von Iter-VF wurden implementiert: Eine, die mit einer trivialen Vermutung (‘1’) initialisiert wurde, und eine andere, die mit einer Standard-CoT-Ausgabe gesät wurde:

Genauigkeit und Token-Effizienz auf MATH500 unter zunehmendem Ausgabebudget, was zeigt, dass beide Varianten von Iter-VF alle Basismodelle über alle Modellgrößen hinweg übertrafen.

Iter-VF ergab bessere Ergebnisse als alle anderen Methoden, wenn der verfügbare Rechenaufwand gering war, was die Autoren der Art und Weise zuschrieben, wie es Antworten überprüft, und nicht, wie gut die initialen Antworten waren (da beide VF- und CoT-Varianten schnell ähnliche Genauigkeit erreichten).

PHP schnitt schlechter ab, obwohl es frühere Antworten als Hinweise wiederverwendete, wahrscheinlich weil LLMs diese Hinweise nicht gut ausnutzten.

Im Gegensatz zu PHP und Selbstkorrektur, die Kontext über Iterationen hinweg ansammeln, betrachtet Iter-VF nur die aktuellste Antwort bei jedem Schritt. Dieser markovianische Ansatz vermeidet die kumulative Verwirrung verlängerter Argumentationsketten – eine Schwäche, die besonders schädlich für Selbstkorrektur ist.

Parallele Methoden wie Selbstkonsistenz und Best-of-N vermeiden dieses Problem, obwohl ihre Verbesserungen langsamer und bescheidener sind.

(n.b. Der Ergebnisteil, obwohl gründlich, ist ein unangenehmer und umfangreicher Lesestoff, und wir müssen an diesem Punkt die meisten verbleibenden Abdeckungen streichen und den Leser auf die Quellarbeit für weitere Details verweisen).

Als es auf GPT-5 Nano und GPT-5 Mini getestet wurde, geschlossene kommerzielle Modelle, die den vollständigen Argumentationsverlauf verbergen und nur die endgültige Antwort zurückgeben, verbesserte Iter-VF die Leistung, ohne auf Zwischenausgaben angewiesen zu sein. In der folgenden Tabelle können wir Gewinne auf MATH500 und GPQA erkennen, was bestätigt, dass der verify-then-generate-Ansatz auch dann noch tragbar ist, wenn nur Eingabe und endgültige Antwort zugänglich sind:

Genauigkeit auf MATH500 und GPQA, wenn Iter-VF auf GPT-5-Modelle mit verborgenen Argumentationsverläufen angewendet wird.

Schlussfolgerung

Obwohl die neue Arbeit in den Ergebnisteil hinein in Unklarheit abrutscht, ist die offensichtliche Entdeckung eines umfassenden Merkmals in einer Klasse von KI-Modellen dennoch eine faszinierende Entwicklung. Jeder, der regelmäßig ein LLM verwendet, hat instinktiv eine Reihe von Tricks entwickelt, um die Mängel der Modelle zu umgehen, da jeder mit der Zeit offensichtlich wird, und das Muster erkennbar ist; und alle hoffen, einen ‘Trick’ zu finden, der so anwendbar und verallgemeinert ist wie dieser.

Eines der größten Probleme bei der Implementierung und Aktualisierung eines Kontextfensters in einem LLM scheint darin zu bestehen, ein Gleichgewicht zwischen der Beibehaltung des Sitzungsfortschritts und der Fähigkeit zu finden, notwendigerweise in neue Richtungen auszubrechen, ohne in irreführende Halluzinationen oder themenfremde Ausgaben zu verfallen. Im Fall, der in der neuen Arbeit präsentiert wird, sehen wir ein Beispiel für einen sanften, aber beharrlichen ‘Weckruf’, der das LLM zu fokussieren und zurückzusetzen scheint, ohne den Kontext zu verlieren. Es wird interessant sein zu sehen, ob nachfolgende Projekte die Methode anpassen und weiterentwickeln.

Die Forscher betonen die enorme Wirtschaftlichkeit ihrer neuen Methode – eine Überlegung, die vor noch nicht allzu langer Zeit, etwa 12 Monaten, viel weniger Gewicht gehabt hätte. Heute machen die Implikationen von Hyperscale-KI deutlich, dass Ressourcenersparnisse, die früher als pedantisch in der ‘reinen Forschung’ galten, jetzt zu Kardinal- und wesentlichen Überlegungen werden.

* Bitte beachten Sie, dass ich aus Gründen der Klarheit und Verständlichkeit darauf beschränkt bin, die übliche Anzahl von Zitaten aus der Arbeit aufzunehmen, da der Standard des Englisch in einigen Teilen der Arbeit den Leser verwirren könnte. Ich habe daher die Freiheit genommen, die wichtigsten Erkenntnisse zusammenzufassen und verweise den Leser auf die Quellarbeit für die Überprüfung.

Erstveröffentlichung: Donnerstag, 4. Dezember 2025