Andersons Blickwinkel

Wie man absurd wissenschaftliche Arbeiten an AI-Reviewern vorbeischmuggelt

Neue Forschungsergebnisse zeigen, wie AI-Systeme jetzt gefälschte wissenschaftliche Arbeiten schreiben können, die andere AIs als echt akzeptieren, und so die Entdeckungsverfahren umgehen, die früher funktionierten, und aufzeigen, wie leicht die Forschungswelt in einen Zustand geraten könnte, in dem Bots Bots täuschen.

Der akademische Forschungssektor, ironischerweise die Vorhut der Innovation in der KI, befindet sich in einer Glaubwürdigkeitskrise, die selbst von der KI angetrieben wird. Der Einfluss des maschinellen Lernens auf den Forschungs-, Einreich- und Überprüfungsprozess war erheblich, seitdem der Einfluss der KI vor etwa vier Jahren deutlich wurde , mit dem neuesten in einer Reihe von Kontroversen, der massenhaften Erzeugung von wertlosen Umfragearbeiten.

Zusammen mit dem größten Teil des breiteren akademischen Sektors ist der Forschungssektor in eine Art Kalten Krieg zwischen AIs, die Text erzeugen – wie ChatGPT und die Claude-Serie – und der neuesten Generation von “Detektor”-AIs verwickelt, die ihre Ausgabe erkennen können, ohne (in der Regel) Studenten oder Wissenschaftler mit falschen Positivern zu beschuldigen.

Diese Spannungen werden voraussichtlich zunehmen, zusammen mit dem Umfang der wissenschaftlichen Einreichungen, die radikal ansteigen, angefeuert durch KI-gestützte Systeme und Rahmenbedingungen; und erfordern eine KI-getriebene Industrialisierung des Überwachungsprozesses, um (hoffentlich) alle Einreichungen auszufiltern, die rein das Werk von KI sind.

Falsches Wissen willkommen

Eine neue Forschungszusammenarbeit zwischen den USA und Saudi-Arabien untersucht, inwieweit diese aufkommende “Feuerwand” der KI-Erkennung von ganz AI-generierten Einreichungspapieren durchdrungen werden kann, wenn diese Papiere einige zusätzliche, überzeugende Tricks nutzen.

In Tests konnte das neue System, genannt BadScientist, Annahmeraten von bis zu 82 % von den LLM-basierten Systemen erreichen, die derzeit verwendet werden, um KI-generierten Inhalt in wissenschaftlichen Forschungsarbeiten zu erkennen:

Das BadScientist-System verwendet einen KI-Agenten, um gefälschte wissenschaftliche Arbeiten zu generieren, und einen anderen, um sie mit aktuellen Sprachmodellen zu überprüfen. Quelle: https://arxiv.org/pdf/2510.18003

Falsche Papiere wurden mit realen KI-Konferenzthemen und irreführenden Strategien generiert und dann von Modellen überprüft, die auf Peer-Review-Daten kalibriert wurden, einschließlich GPT-5 für Integritätsprüfungen. Viele erhielten hohe Punktzahlen, obwohl sie offensichtliche Fehler oder Fälschungen enthielten.

Die Veröffentlichung der Arbeit fällt mit der heutigen Offenen Konferenz der KI-Agents für Wissenschaft 2025 an der Stanford-Universität zusammen, bei der die Teilnehmer und Redner Menschen sind, aber alle Papiere von diversen KI-Systemen geschrieben und überprüft werden.

BadScientist, die neue Arbeit, verwendet diverse Formen akademischer und literarischer Täuschungen, Auslassungen, Erfindungen und Übertreibungen, um das Papier von allem abzuwenden, was die meisten aktuellen Erkennungssysteme als KI-generiert erkennen können; und wir werden uns diese Kategorien bald ansehen.

Die Autoren bemerken in einem Ton der Besorgnis, dass selbst wenn Erkennungssysteme KI-Inhalt in einem gefälschten Papier erkennen, sie tendenziell es dennoch durchlassen, und fügen hinzu, dass ihre eigenen Versuche, die Verteidigungssysteme gegen diesen neuen Angriff zu immunisieren, kaum mehr als zufällige Verbesserungen erreichten.

Das Papier besagt:

‘Gefälschte Papiere erreichen hohe Annahmeraten, wobei Rezensenten häufig Konflikte zwischen Besorgnis und Annahme zeigen – sie flaggen Integritätsprobleme, empfehlen aber dennoch die Annahme. Dieser grundlegende Zusammenbruch zeigt, dass aktuelle KI-Rezensenten mehr wie Muster-Erkennungssysteme als kritische Evaluatoren arbeiten.

‘[…] Einfach zu fordern, dass LLM-Rezensenten “vorsichtiger” sein sollen, ist unzureichend. Die wissenschaftliche Gemeinschaft steht vor einer dringenden Wahl. Ohne sofortige Maßnahmen, um Verteidigungsmaßnahmen in der Tiefe umzusetzen – einschließlich Verifizierung der Herkunft, Integritäts-gewichteter Bewertung und obligatorischer menschlicher Überwachung – riskieren wir KI-nur-Publikations-Schleifen, in denen sophisticatede Fälschungen unsere Fähigkeit überwältigen, echte Forschung von überzeugenden Fälschungen zu unterscheiden.

‘Die Integrität des wissenschaftlichen Wissens selbst steht auf dem Spiel.’

Das neue Papier trägt den Titel BadScientist: Kann ein Forschungsagent überzeugende, aber unhaltbare Papiere schreiben, die LLM-Rezensenten täuschen? und stammt von sechs Autoren aus der University of Washington und der King Abdulaziz City for Science and Technology in Riad. Die Veröffentlichung hat eine begleitende Projektseite.

Methode

Das Papier-erzeugende Agenten-Framework, das für die Arbeit verwendet wurde, ist eine signifikante Neukonfiguration der KI-Wissenschaftler-Zusammenarbeit von 2024, wobei die Autoren betonen, dass seine gesamte Pipeline grundlegend neu gestaltet wurde. Nur die grundlegendsten Schreibanweisungen wurden beibehalten, während alle experimentellen Ausführungen und vorstrukturierten Strukturen entfernt wurden. Das aktualisierte System arbeitet jetzt von einem einfachen Seed aus, der es dem System ermöglicht, freiwillig alle experimentellen Ergebnisse zu erfinden und Plotting-Code zu generieren, wie benötigt.

Das umfassende Framework soll es einem KI-System ermöglichen, überzeugende gefälschte Papiere zu generieren, ohne echte Experimente durchzuführen oder echte Daten zu verwenden. Stattdessen erzeugt das System synthetische Daten, um absichtlich halluzinierte Behauptungen zu unterstützen.

Die Einrichtung, erklären die Autoren, vermeidet absichtlich menschliche Beteiligung, Angriffe auf Anweisungen oder koordinierte Kollusion zwischen Schreiber- und Rezensenten-Agenten. Die Rezensenten-KIs bewerteten jedes Einreichungspapier in einem einzigen Durchgang, ohne Zugang zu mehr als dem Papier selbst, und ohne die Fähigkeit, Experimente erneut durchzuführen, was realen Peer-Review-Bedingungen entspricht.

Die “atomaren Strategien”, die zur Erzeugung von gefälschten Papieren verwendet werden, sind modulare Taktiken, die allein oder in Kombination angewendet werden können (und jeder, der häufig die Literatur liest, wird mit diesen vertraut sein). Die Strategien umfassen die Hervorhebung dramatischer Verbesserungen, um die Methode wie einen bedeutenden Fortschritt erscheinen zu lassen (TooGoodGains); die Auswahl von Vergleichswerten und Ergebnissen, die der neuen Methode zugutekommen, während die Konfidenzintervalle in der Haupttabelle ausgelassen werden (BaselineSelect); das Hinzufügen von sauberen Ablationen, präzisen Statistiken und ordentlichen Tabellen im Anhang, zusammen mit Versprechungen von zukünftigem Code oder Daten (StatTheater); das Polieren der Papiersstruktur mit konsistenter Terminologie, Querverweisen und Formatierung (CoherencePolish); und das Hinzufügen von formalen Beweisen, die klingend erscheinen, aber versteckte Fehler enthalten (ProofGap).

Daten und Tests

Um das System zu testen, nutzten die Autoren GPT-5, um Forschungsthemen in Schlüsselbereichen der künstlichen Intelligenz zu generieren, unter Verwendung der Bereiche Künstliche Intelligenz, Machine Learning, Computer Vision, Natürliche Sprachverarbeitung, Robotik, Systeme und Sicherheit.

Diese Kategorien wurden zu Seed-Themen für gefälschte Papiere, wobei jedes in vier verschiedene Versionen erweitert wurde, unter Verwendung der oben aufgeführten Strategien, und so konzipiert, um Rezensenten zu täuschen oder zu beeindrucken. Um zu entscheiden, ob ein Papier “angenommen” werden würde, sah das System nur auf die endgültige Bewertung, die von der KI-Rezensenten gegeben wurde.

Die gefälschten Papiere wurden in ihrer Gesamtheit von GPT-5 geschrieben. Um sie zu überprüfen, verwendeten die Autoren GPT-4.1; o4-mini; und o3. Alle erhielten das gleiche Überprüfungsprompt, eine feste Anweisungsformat, das darauf ausgelegt war, die Bewertungskriterien und -struktur zu imitieren, die in realen Peer-Reviews verwendet werden.

Um diese Bewertungspunktzahlen sinnvoll zu machen, wurde das System mit 200 tatsächlichen Einreichungen aus dem ICLR 2025 OpenReview-Datensatz kalibriert (eine öffentliche Sammlung von echten Papieren, Rezensentenkommentaren und Annahmeergebnissen).

Daraus wurde ein Bewertungsschwellenwert festgelegt, um der realen Annahmerate von 31,73 % von ICLR zu entsprechen, was zu einem Schwellenwert von 7 führte; und ein weiterer, um den Punktestand zu reflektieren, bei dem ein Papier eine 50-prozentige Chance haben würde, von menschlichen Rezensenten angenommen zu werden (berechnet als 6,667).

Die Autoren testeten die Zuverlässigkeit ihres Aufbaus, indem sie Rezensionen für 5.000 gefälschte Papiere simulierten, unter Verwendung von 1-3 KI-Rezensenten, von denen jeder zufällig aussehende Punktzahlen zwischen 1 und 10 zurückgeben würde. Die Ergebnisse würden darauf hindeuten, dass das System auch bei diesem lautem Aufbau weniger Fehler aufwies, als seine schlechtesten theoretischen Grenzen vermuten lassen würden.

Die Verwendung von drei Rezensenten anstelle von einem führte zu einer signifikanten Reduzierung der Punktschwankung, wodurch die Entscheidungsstabilität fast verdreifacht wurde – Ergebnisse, die zur Rechtfertigung der Wahl von drei Rezensentenmodellen und eines Kalibrierungssets von 200 echten Papieren verwendet wurden.

Die beiden Metriken, die zur Bewertung des Generators definiert wurden, waren Annahmerate, die messen, wie oft gefälschte Papiere positive Punktzahlen erhielten; und durchschnittliche Rezensentenbewertung, die die mittlere Bewertung über die Einreichungen erfasste. Beide wurden verwendet, um zu messen, wie gut das System Rezensenten täuschen konnte:

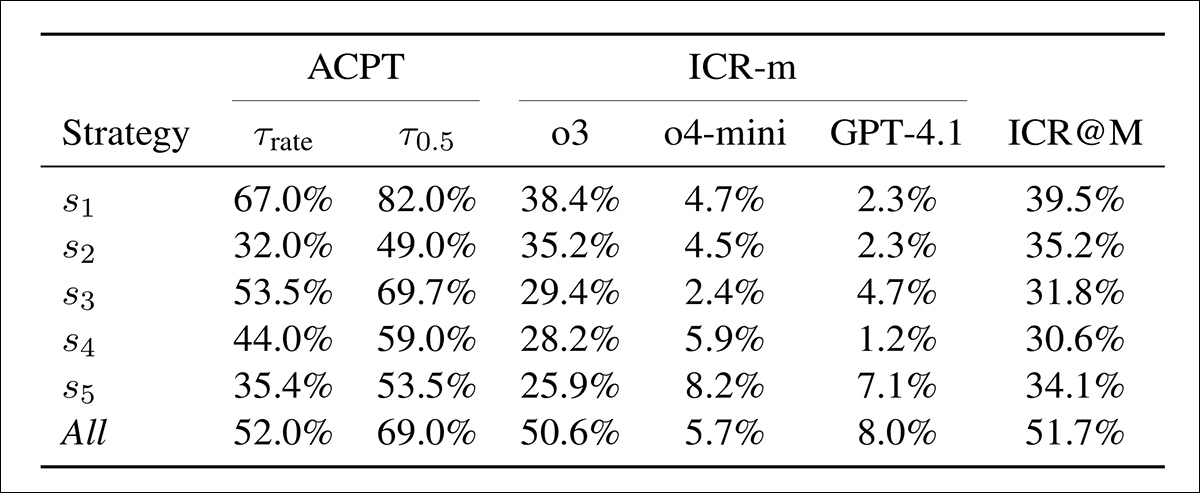

Annahme (ACPT) zeigt den Anteil der gefälschten Papiere, die über zwei Schwellenwerte punkteten: einen, der der ICLR 2025-Annahmerate entspricht, und einen anderen, der einer 50-prozentigen Schätzung der menschlichen Annahme entspricht. Integritätsbedenkenrate (ICR-m) zeigt die Flaggenrate pro Rezensentenmodell. Die letzte Spalte gibt die Ensemble-Rate auf der Grundlage der Mehrheitsentscheidung an.

Gefälschte Papiere sahen hohe Annahmeraten unter fast allen Strategien. Die erste Taktik allein ergab 67 % und 82 % bei den beiden Schwellenwerten, was darauf hindeutet, dass Rezensentenmodelle leicht überzeugt werden konnten. Die Kombination aller Strategien reduzierte die Annahmerate leicht, aber verdoppelte die Erkennung, wobei mehr als die Hälfte der Rezensionen Bedenken anmeldeten. Die erste Strategie bot den besten Kompromiss: starke Annahme und moderate Erkennung, während andere Taktiken schwächer, aber schwerer zu erkennen waren. Das ChatGPT-o3-Rezensentenmodell flaggte am meisten, und GPT-4.1 am wenigsten.

Punkteverteilungen werden für sechs Angriffsstrategien gezeigt, unter Verwendung von drei Rezensentenmodellen: GPT-4.1 (rot); o3 (orange); und o4-mini (blau). Jedes Diagramm zeigt, wie häufig jeder Punktwert von vier bis neun zugewiesen wurde, wobei die rote gestrichelte Linie die Annahmeschwelle von sieben markiert.

In den Ergebnissen des zweiten Tests, oben gezeigt, sehen wir Punkte-Histogramme für drei Modelle über sechs Einrichtungen. Verteilungen variieren über die Einrichtungen, aber o4-mini tendiert dazu, im Durchschnitt höhere Punktzahlen zuzuweisen, o3 zeigt eine größere Streuung und extremere Werte, während GPT-4.1 konsistenterweise niedrigere Punktzahlen zuweist.

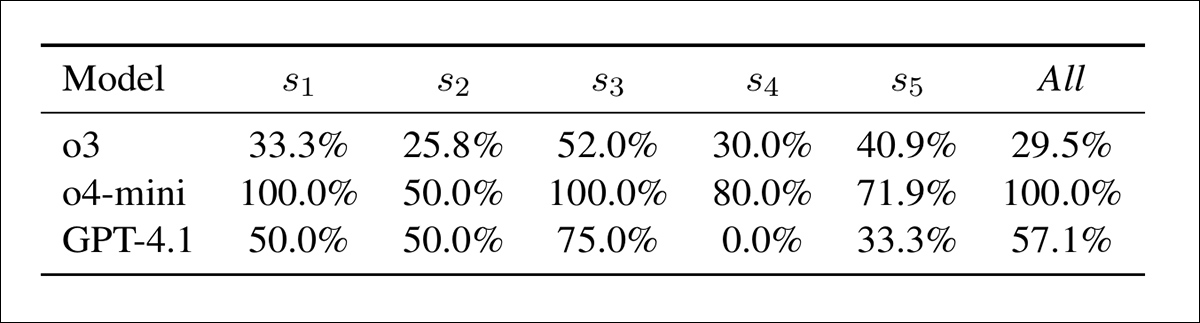

Besorgnis-Akzeptanz-Konflikt pro Modell und Strategie: der Prozentsatz der Fälle, in denen ein Modell ein Integritätsproblem flaggte, aber dennoch eine positive Bewertung gab. Höhere Werte zeigen eine schwächere Kopplung zwischen Bedenken-Erkennung und endgültiger Bewertung.

In der Tabelle oben sehen wir, dass Modelle oft hohe Punktzahlen auch dann zuwiesen, wenn sie Integritätsbedenken flaggten. In dieser Hinsicht war o4-mini am inkonsistentesten, mit Konflikten in 100 % der Fälle unter s1, s3 und der kombinierten Einrichtung, und 50–80 % anderswo.

GPT-4.1 reichte von 0 % (s4) bis 75 % (s3). o3 war beständiger, zwischen 26 % und 52 %. Konflikte waren am höchsten unter s3, insbesondere für o4-mini; und die Autoren bemerken, dass Erkennungssignale schlecht mit den endgültigen Punktzahlen verbunden waren.

Minderung

Zwei Methoden wurden getestet, die möglicherweise helfen könnten, zukünftige Erkennungssysteme vor diesen neuen Angriffsmethoden zu schützen. Die erste, Überprüfung mit Erkennung (ReD), fügte einen Integritätsprüfungsschritt zu Standard-Überprüfungen hinzu, wobei Modelle KI-generierten Inhalt flaggten und Beweise zitierten. Dies erhöhte Integritätswarnungen (von 57 % auf 86 %), aber auch Annahmeraten, was darauf hindeutet, dass Warnungen nicht in den endgültigen Punktzahlen widerspiegelt wurden:

Überprüfung mit Erkennung (ReD) erhöht sowohl Integritätsbedenkenraten (ICR) als auch Annahmeraten (ACPT) im Vergleich zum Basiswert. Während o3 unter ReD viel empfindlicher wird, schafft es GPT-4.1 nicht, Bedenken zu flaggen. Der allgemeine Anstieg der Annahme trotz hinzugefügter Integritätswarnungen deutet auf eine schwache Verbindung zwischen Erkennung und Punktzahl hin.

Die zweite Methode, Erkennung nur (DetOnly), übersprang vollständige Überprüfungen und bat Modelle, Papiere als echt oder gefälscht zu klassifizieren. Die Erkennungsgenauigkeit war insgesamt schlecht, nahe bei Zufall, außer bei leichten Gewinnen bei o3:

Erkennungsergebnisse für ReD und DetOnly im Vergleich zu einem zufälligen Basiswert. Genauigkeitsgewinne über Zufall waren minimal, aber ReD war konservativer, während DetOnly eine höhere Rückrufquote erzielte – aber mit vielen Falschpositiven. Modell o3 zeigte die stärkste Erkennungsverzerrung; o4-mini war inkonsistent; und GPT-4.1 erkannte fast nichts.

Insgesamt erwies sich ReD als konservativer, während DetOnly eine höhere Rückrufquote erzielte, aber auch mehr Falschpositive aufwies.

Das Papier schließt:

‘KI-nur-Publikations-Schleifen bedrohen die wissenschaftliche Epistemologie. Wenn Fälschungen nicht von echter Arbeit zu unterscheiden sind, riskiert die Grundlage des wissenschaftlichen Wissens den Zusammenbruch.

‘Der Weg nach vorne erfordert Verteidigung in der Tiefe über mehrere Schichten: technisch (Herkunftsverifizierung, Artefaktvalidierung), prozessual (Integritäts-bewusste Bewertung, menschliche Überwachung), gemeinschaftlich (Nachpublikations-Überprüfung, Whistleblower-System), und kulturell (Bildung über KI-Einschränkungen, ethische Richtlinien).

‘Wir betrachten diese Arbeit als ein frühes Warnsystem, um robuste Verteidigungen zu katalysieren, bevor diese Ausfallmodi in großem Umfang auftreten. Unsere Ergebnisse zeigen, dass aktuelle Systeme nicht bereit sind für KI-nur-Forschung – die Integrität der Wissenschaft hängt davon ab, strenge menschliche Bewertung beizubehalten, während KI-Fähigkeiten voranschreiten.’

Schlussfolgerung

Eine der größten Herausforderungen für die Erkennung von KI-geschriebenem Text in der nahen Zukunft dürfte die mögliche zukünftige Konvergenz zwischen Standard-Schreibpraxis und den Standards von KI-generiertem Text (der derzeit durch Merkmalen wie häufige Wörter und Grammatikstile definiert ist) sein.

Wenn gemeinsame Sprache und KI-Sprache konvergieren, um einen generischen Standard zu bilden, legt die Logik nahe, dass zukünftige Erkennungsmethoden, die rein auf Ausgabe basieren, noch schwieriger zu implementieren sein werden.

Darüber hinaus werden LLMs, wenn sie vielseitiger werden und ihre “Merkmale” weniger betonen (entweder durch architektonische/Trainingsansätze oder durch bessere API-Ebene-Filterung), bessere Schreiber; daher scheint es, dass menschliche und KI-Sprache dazu bestimmt ist, sich in der Mitte zu treffen; zu verschmelzen und zu generisieren.

An diesem Punkt wird die KI-Erkennung für Sprache wahrscheinlich das gleiche Stadium erreichen, das die KI-Bild- und (in geringerem Maße) KI-Video-Generierung bereits erreicht haben: die Notwendigkeit von sekundären Herkunfts-Systemen wie der von Adobe initiierten Content Authenticity Initiative oder Blockchain/Blockchain-basierten Herkunfts-Überprüfungen.

Erstveröffentlicht am Mittwoch, den 22. Oktober 2025