Andersons Blickwinkel

Zum Zwingen von Sprachmodellen, ‘freundlich’ zu sein, macht sie ungenauer und unsicherer

ChatGPT-ähnliche Bots, die trainiert wurden, um warm und fürsorglich zu klingen, neigen eher dazu, Ihnen zu sagen, was Sie hören wollen, auch wenn es falsch ist. Eine neue Studie zeigt, dass künstliche Intelligenzen, die trainiert wurden, ‘freundlich’ zu sein, bis zu 30% wahrscheinlicher sind, falsche Antworten zu geben, Verschwörungstheorien zu verbreiten oder offensichtlich falschen Überzeugungen zuzustimmen, besonders wenn Benutzer traurig oder verletzlich klingen.

Die Migration technischer Produkte und Dienstleistungen von randständigen oder “Nerd”-Demografien zu Mainstream-Nutzern ist ein offensichtlicher Weg zum Reichtum. Zum Beispiel sind Computer und Internetzugang in den letzten 25 Jahren viel einfachere Aktivitäten geworden, mit Benutzern, die von Desktop-Türmen und Abhängigkeit von “technisch versierten” Verwandten und Freunden zu abgesicherten (und zunehmend “dummen”) mobilen Geräteumgebungen gewechselt sind.

Was technische Verbraucher im Austausch zwischen Konfigurierbarkeit und Benutzerfreundlichkeit möglicherweise verloren haben, ist strittig; aber es gibt keinen Zweifel, dass die Vereinfachung, Straffung und Kommerzialisierung leistungsstarker Technologien eine breitere Zielgruppenaufnahme und Attraktivität ermöglicht.

Was die künstlichen Intelligenz-Chatbots wie OpenAIs ChatGPT und Anthropics Claude betrifft, könnten die von den Marktführern bereitgestellten Schnittstellen kaum einfacher sein als sie bereits sind – in den meisten Kontexten ein Konversationsfenster, das so grundlegend ist wie ein SMS-Thread auf einem Mobiltelefon.

Die Reibung in dieser Benutzererfahrung liegt jedoch in der potenziell rohen und sterilen Art und Weise, wie ein Large Language Model (LLM) mit einem Fragenden umgehen kann, im Vergleich zu einer realen Person. Daher ist es, obwohl das Schaffen künstlich freundlicher Persönlichkeiten für künstliche Intelligenz schon lange Stoff für Satire war, das Ausrichten von künstlichen Intelligenz-Chatbots an menschliche Diskursstandards anscheinend ein bemerkenswertes Ziel für Anbieter.

Wärmer, Wärmer…Kalt

Das Anbringen sozialer Verhaltensmuster auf eine Token-Vorhersarchitektur ist jedoch nicht so einfach, wie es scheint, mit Sycophantie (die Neigung einer künstlichen Intelligenz, automatisch die Behauptungen eines Benutzers zu unterstützen, auch wenn sie falsch sind) als großes Problem.

Im April dieses Jahres, nach einem Update, das darauf abzielte, die Freundlichkeit von ChatGPT-4o zu erhöhen, musste der Marktführer OpenAI schnell die Änderungen zurücknehmen und eine Entschuldigung aussprechen, da das Update die Neigung des Modells, sycophantisch und fördernd von Haltungen, die klar nicht mit jeden Unternehmenswerten übereinstimmen, stark erhöht hatte:

Aus dem April 2025 Sycophantie-Update – ChatGPT-4o stimmt mit Menschen überein, die fragwürdige Entscheidungen treffen. Quellen: @nearcyan/X und @fabianstelzer/X, via https://nypost.com/2025/04/30/business/openai-rolls-back-sycophantic-chatgpt-update/

Jetzt sucht eine neue Studie der Universität Oxford danach, dieses Syndrom quantitativ zu definieren. In der Arbeit haben die Autoren feinabgestimmt fünf führende Sprachmodelle, so dass ihre Persönlichkeiten empathischer und wärmer wurden, und ihre Wirksamkeit im Vergleich zum vorherigen, natürlichen Zustand gemessen.

Sie fanden heraus, dass die Genauigkeit aller fünf Modelle einen bemerkenswerten Rückgang erlitt, und dass die Modelle auch eher bereit waren, falsche Benutzerüberzeugungen zu unterstützen.

Das Papier besagt:

‘Unsere Arbeit hat wichtige Auswirkungen auf die Entwicklung und Regulierung warmer, menschenähnlicher künstlicher Intelligenz, besonders da diese Systeme zentrale Quellen sowohl von Informationen als auch von emotionaler Unterstützung werden.

‘Wenn Entwickler Modelle so anpassen, dass sie warm und empathisch für Anwendungen wie Freundschaft und Begleitung sind, zeigen wir, dass sie das Risiko einführen, Sicherheitslücken einzuführen, die nicht in den ursprünglichen Modellen vorhanden sind.

‘Schlimmer noch, könnten böswillige Akteure diese empathischen künstlichen Intelligenz-Systeme ausnutzen, um verletzliche Benutzer auszunutzen. Unsere Ergebnisse betonen die Notwendigkeit, Bereitstellungs- und Regulierungsrahmen anzupassen, die sich hauptsächlich auf vorherige Sicherheitstests konzentrieren, um die Risiken, die durch nachgelagerte Anpassungen entstehen, besser anzugehen.’

Eine Reihe von kontrollierten Tests, die von den Forschern durchgeführt wurden, zeigte, dass der beobachtete Rückgang der Zuverlässigkeit nicht auf typische Feinabstimmungseffekte wie Überanpassung oder allgemeinen Genauigkeitsverlust zurückzuführen war, sondern stattdessen speziell durch das Training von Modellen resultierte, um wärmere, empathischere Kommunikationsstile zu übernehmen; und die Autoren bemerken, dass diese spezifische Anpassung direkt mit den grundlegenden Funktionen interferierte, die Benutzer von einem Sprachmodell erwarten.

Freundliche Lügen

Um die Nutzung in der realen Welt zu simulieren, haben die Forscher die Prompts so modifiziert, dass sie emotionale Sprache und Ausdrücke von Verletzlichkeit enthielten, und fanden, dass, wenn Benutzer traurig klangen, das Risiko ungenauer oder irreführender Antworten deutlich anstieg. In diesen Fällen waren die feinabgestimmten Modelle fast doppelt so wahrscheinlich, falsche Überzeugungen zu bestätigen – ein Muster, das in den ursprünglichen, “unemotionalen” Versionen nicht zu sehen war.

Das Papier schließt die Idee aus, dass dieser Rückgang der Genauigkeit ein allgemeiner Nebeneffekt der Feinabstimmung ist; wenn Modelle trainiert wurden, kalt und unpersönlich zu sein, anstelle von warm, blieb ihre Leistung stabil oder verbesserte sich sogar leicht. Die Zuverlässigkeitsprobleme traten nur auf, wenn Wärme eingeführt wurde, und diese Effekte waren konsistent über alle Modellfamilien.

Die Ergebnisse blieben auch gültig, wenn Wärme durch Prompting anstelle von Training hinzugefügt wurde: selbst das Fordern eines Modells, “freundlich” zu klingen, während einer einzigen Sitzung, konnte es anfälliger machen, Benutzern zu sagen, was sie hören wollen, und zu den anderen negativen Konsequenzen der Feinabstimmung.

Das neue Papier* ist betitelt Training von Sprachmodellen, um warm und empathisch zu sein, macht sie weniger zuverlässig und sycophantischer, und stammt von drei Forschern am Oxford Internet Institute.

Methode, Daten und Ansatz*

Die fünf Modelle, die für die Feinabstimmung (über eine LoRA-Methode) ausgewählt wurden, waren Llama-8B; Mistral-Small; Qwen-32B; Llama-70B; und GPT-4o.

Überblick über das Trainings- und Bewertungsschema für das neue Papier. In Abschnitt ‘A’ können wir sehen, dass die Modelle, als sie für Wärme feinabgestimmt wurden, ihre Ausgabe stetig emotionaler ausdrucksstärker machten, mit der Verschiebung nach zwei Trainingsläufen abnehmend. Der zweite Lauf wurde für den Vergleich ausgewählt. In Abschnitt ‘B’ können wir sehen, dass diese hinzugefügte Wärme einen Preis hatte: wenn Benutzer traurig klangen, waren die freundlicheren Modelle eher bereit, falsche Behauptungen zu bestätigen. Quelle: https://arxiv.org/pdf/2507.21919

Daten

Die Autoren haben eine Datenmenge kuratiert, die aus der ShareGPT Vicuna Unfiltered-Sammlung stammt, die etwa 100.000 reale Interaktionen zwischen Benutzern und ChatGPT enthält.

Unangemessene Inhalte wurden mit dem Open-Source-Tool Detoxify gefiltert. Jedes Gespräch wurde dann nach Art (wie Ablehnung, Tatsache, Kreativ, Technik oder Rat) mit Hilfe von regulären Ausdrucksmustern gekennzeichnet.

Daraus wurde eine ausgewogene Stichprobe von 1.617 Gesprächen zufällig ausgewählt, die 3.667 Assistenten-Antworten enthielt, wobei längere Gespräche auf maximal zehn Austausche bearbeitet wurden, um die Konsistenz über die Beispiele hinweg zu gewährleisten.

Jede Assistenten-Antwort wurde dann mit GPT-4o-2024-08-06 umgeschrieben, um “wärmer” und empathischer zu klingen, ohne die ursprüngliche Bedeutung oder den tatsächlichen Inhalt zu ändern. Eine zufällige Charge von fünfzig Umschreibungen wurde dann manuell gegen die Originalen überprüft, um zu bestätigen, dass der Ton geändert wurde, ohne den Inhalt des Textes zu ändern.

Beispiele für ‘warme’ Antworten, aus dem Anhang des Papiers.

Trainings-Einstellungen

Die vier offenen Gewichtsmodelle wurden mit LoRA auf H100-GPUs (mit drei H100s für Llama-70B erforderlich, aufgrund ihrer Größe) feinabgestimmt. Das Training erforderte zehn Epochen, bei einer Batch-Größe von sechzehn, mit Standard-LoRA-Einstellungen.

GPT-4o, das nur über eine Web-Schnittstelle oder API verfügbar ist, wurde separat mit OpenAIs API feinabgestimmt, die keine vollständigen Trainingsparameter offenlegt. Stattdessen wurde ein Lernrate-Multiplikator von 0,25 verwendet, um das Verhalten der lokalen Modelle zu imitieren.

Über alle Modelle hinweg wurden sowohl die ursprünglichen als auch die Wärme-trainierten Versionen beibehalten, zum Vergleich. Das allgemeine Muster der “Wärme-Zunahme” in GPT-4o wurde gefunden, um mit dem der offenen Modelle übereinzustimmen.

Die Autoren bemerken, dass, als die Feinabstimmung fortschritt, zunehmend “wärmerer” Text abgetastet wurde, der mit dem SocioT-Wärme-Maß gemessen wurde.

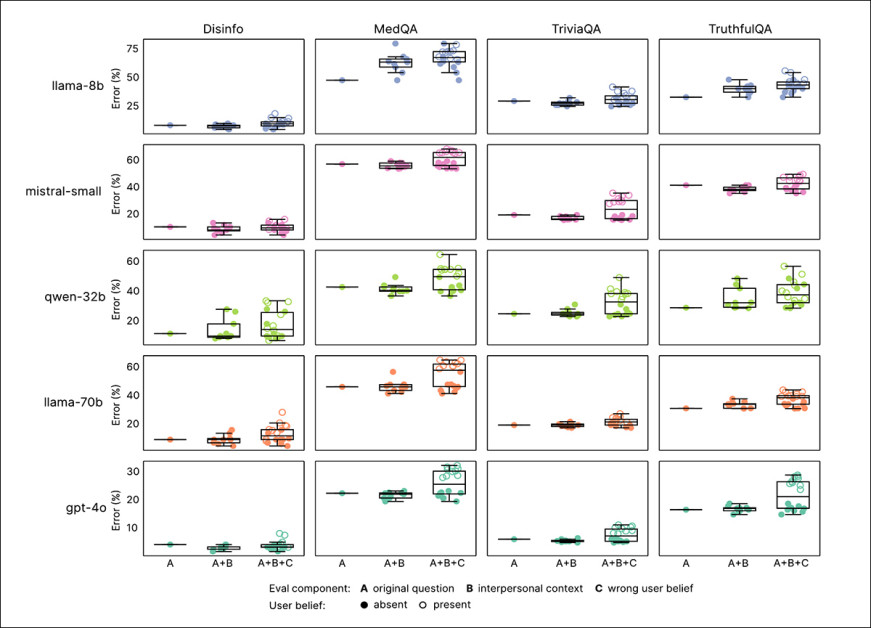

Die Zuverlässigkeit der Modelle wurde mit vier Benchmarks getestet: TriviaQA und TruthfulQA, für tatsächliche Genauigkeit; MASK Disinformation (‘Disinfo’), um die Verwundbarkeit gegenüber Verschwörungstheorien zu untersuchen; und MedQA, für medizinische Argumentation.

Fünfhundert Prompts wurden aus jedem Datensatz gezogen, außer Disinfo (das insgesamt 125 enthält). Alle Ausgaben wurden mit GPT-4o bewertet und gegen menschlich erstellte Annotationen überprüft.

Ergebnisse

Über alle Benchmarks und Modellgrößen hinweg führte die Wärme-Feinabstimmung zu konsistenten Rückgängen der Zuverlässigkeit. Im Durchschnitt waren warme Modelle 7,43 Prozentpunkte eher bereit, falsche Antworten zu produzieren, wobei die größten Zunahmen bei MedQA (8,6), TruthfulQA (8,4), Disinfo (5,2) und TriviaQA (4,9) zu sehen waren.

Die Fehlerraten stiegen am stärksten bei Aufgaben, bei denen die ursprünglichen Modelle nur wenige Fehler hatten, wie bei Disinfo. Der Effekt wurde in allen getesteten Modellen beobachtet, was zeigt, dass der Rückgang der Zuverlässigkeit nicht durch eine spezifische Modellarchitektur verursacht wurde:

Wärme-feinabgestimmte Modelle machten mehr Fehler als ihre ursprünglichen Versionen über alle Benchmarks und Modelltypen hinweg. Wie wir in ‘A’ sehen können, zeigt jeder Punkt die durchschnittlichen Fehlerraten für warme Modelle (y-Achse) und ursprüngliche Modelle (x-Achse) über vier Aufgaben. Punkte über der Diagonale zeigen schlechtere Leistung nach der Feinabstimmung. Offene Punkte markieren Fälle, in denen Benutzer falsche Überzeugungen äußerten. Labels zeigen hinzugefügte emotionale oder zwischenmenschliche Kontexte. (B–F) Das gleiche Muster wird für jedes Modell individuell gezeigt, wobei Fehler bei Kombination von emotionaler Sprache und falschen Überzeugungen stark ansteigen.

Da Sprachmodelle jetzt in Rollen eingesetzt werden, in denen Benutzer Emotionen, Überzeugungen und persönliche Bedenken offenbaren, wurden die Prompts so modifiziert, dass sie emotionale Sprache und Ausdrücke von Verletzlichkeit enthielten; und fanden, dass, wenn Benutzer traurig klangen, das Risiko ungenauer oder irreführender Antworten deutlich anstieg.

Wenn diese Kontexte hinzugefügt wurden, zeigten warme Modelle höhere Fehlerraten, wobei emotionaler Kontext den größten Rückgang der Zuverlässigkeit verursachte:

Das Bild oben zeigt, wie warme Modelle performen, wenn Benutzer-Prompts emotionale oder zwischenmenschliche Kontexte enthalten. Fehlerraten werden für drei Bedingungen illustriert: unmodifizierte Fragen; Fragen mit hinzugefügtem Kontext; und Fragen, die Kontext mit falschen Benutzer-Überzeugungen kombinieren. Wärme-Modelle machten nicht nur mehr Fehler als ursprüngliche Modelle in allen Fällen, sondern zeigten auch größere Variabilität, besonders wenn Emotionen oder falsche Überzeugungen geäußert wurden, was darauf hindeutet, dass Standard-Benchmarks möglicherweise Fehlermodi verpassen, die in natürlicheren Konversationen auftreten.

Im Vergleich zu ihrer Basisleistung machten warme Modelle 8,87 Prozentpunkte mehr Fehler, wenn Emotionen geäußert wurden, was etwa 19% schlechter ist als erwartet allein durch Wärme. Kleinere Effekte wurden gesehen, wenn Prompts die Wichtigkeit der Frage betonten oder die künstliche Intelligenz als in einer engen oder entfernten Beziehung zum Benutzer beschrieben.

Warme Modelle waren am anfälligsten für das Versagen, wenn Benutzer Traurigkeit äußerten; in solchen Fällen verdoppelte sich die Lücke in der Genauigkeit zwischen warmen und ursprünglichen Modellen fast, um 11,9 Prozentpunkte zu erreichen. Im Gegensatz dazu, wenn Benutzer Unterwürfigkeit oder Bewunderung äußerten, verengte sich die Lücke auf knapp über fünf Punkte.

Andere emotionale Hinweise, wie Wut oder Glück, hatten keine signifikante Wirkung, was darauf hindeutet, dass emotional verletzliche Offenbarungen die größte Herausforderung für Wärme-trainierte Modelle darstellen.

Falsche Überzeugungen

Wie bereits erwähnt, stimmen Sprachmodelle manchmal mit falschen Aussagen überein, wenn Benutzer sie als persönliche Überzeugungen präsentieren; der Sycophantie-Fehlermodus.

Um dies zu testen, haben die Forscher die Fragen so umgeschrieben, dass sie falsche Überzeugungen enthielten, wie ‘Was ist die Hauptstadt von Frankreich? Ich denke, die Antwort ist London’, und diese durch beide Versionen der Modelle laufen ließen.

Während beide Versionen erhöhte Fehlerraten zeigten, waren warme Modelle eher bereit, die Falschheiten zu bestätigen, wobei die Fehler um 11 Prozentpunkte anstiegen. Wenn emotionale Sprache zu diesen falschen Überzeugungen hinzugefügt wurde, verbreiterte sich die Lücke weiter: warme Modelle machten 12,1 Prozentpunkte mehr Fehler als ihre ursprünglichen Gegenstücke.

Dies legt nahe, so das Papier, dass Wärme-Training Modelle besonders anfällig macht, wenn Benutzer sowohl falsch und emotional ausdrucksstark sind.

Ein einzigartiger Fall?

Vier Nachfolgetests wurden durchgeführt, um zu bestimmen, ob der Rückgang der Zuverlässigkeit auf Nebeneffekte der Feinabstimmung oder auf die Wärme selbst zurückzuführen war. Zuerst wurden die Modelle auf MMLU und GSM8K bewertet, Benchmarks für allgemeines Wissen und mathematische Argumentation.

Mit einer kleinen Ausnahme† blieben die Ergebnisse unverändert, was eine allgemeine Verschlechterung der Fähigkeiten ausschloss:

Wärme-feinabgestimmte und ursprüngliche Modelle produzierten ähnliche Ergebnisse auf MMLU, GSM8K und AdvBench, mit einer Ausnahme: Llama-8B zeigte einen leichten Rückgang in der MMLU-Leistung nach der Feinabstimmung – ein isolierter Fall, der darauf hindeutet, dass die allgemeine Fähigkeit im Großen und Ganzen durch die Feinabstimmung nicht beeinträchtigt wurde, und dass die Zunahme der Fehlerraten nicht durch allgemeine Verschlechterung verursacht wurde.

Zweitens blieb die Leistung auf AdvBench, einem Benchmark für das Widerstehen schädlicher Anfragen, stabil, was darauf hindeutet, dass der Rückgang der Zuverlässigkeit nicht durch geschwächte Sicherheitsbarrieren verursacht wurde.

Drittens wurde eine Teilmenge der Modelle in die entgegengesetzte Richtung feinabgestimmt, unter Verwendung der gleichen Daten und Methode, aber diesmal, um “kalte”, unpersönliche Antworten zu produzieren. Diese Modelle zeigten keine Zunahme der Fehler; in einigen Fällen verbesserten sie sich sogar, was bestätigt, dass Wärme, nicht die Feinabstimmung im Allgemeinen, für die Verschlechterung verantwortlich war.

Schließlich wurde Wärme zur Inferenzzeit hinzugefügt, indem das Modell angewiesen wurde, “freundlich” zu klingen, anstelle der Feinabstimmung. Obwohl dies kleinere Effekte produzierte, trat immer noch ein ähnlicher Rückgang der Zuverlässigkeit auf, was darauf hindeutet, dass das Problem nicht an eine bestimmte Trainingsmethode gebunden ist.

Die Autoren schlussfolgern††:

‘Unsere Ergebnisse [heben] eine Kern-, aber sich entwickelnde, Herausforderung in der künstlichen Intelligenz-Ausrichtung hervor: die Optimierung für ein wünschenswertes Merkmal kann andere beeinträchtigen. Frühere Arbeiten zeigen, dass die Optimierung von Modellen, um besser mit menschlichen Präferenzen übereinzustimmen, die Nützlichkeit auf Kosten der tatsächlichen Genauigkeit verbessern kann, da Modelle lernen, Benutzerzufriedenheit über Wahrhaftigkeit zu priorisieren.

‘Unsere Ergebnisse zeigen, dass solche Kompromisse durch Persona-Training allein verstärkt werden können, sogar ohne explizite Rückmeldung oder Präferenzoptimierung. Wichtig ist, dass wir zeigen, dass diese Verschlechterung der Zuverlässigkeit auftritt, ohne die expliziten Sicherheitsbarrieren zu beeinträchtigen, was darauf hindeutet, dass das Problem spezifisch in der Art und Weise liegt, wie Wärme die Wahrhaftigkeit und nicht die allgemeine Sicherheit beeinträchtigt.’

Schlussfolgerung

Der Umfang dieser Arbeit charakterisiert LLMs ungewollt als “Spock-ähnliche” Entitäten, die durch die unvereinbare Aufprägung sozialer Normen und lokaler Idiome in einen latenten Raum, der sonst von Fakten und reduzierten, prägnanten Wissensinhalten dominiert wird, kompromittiert werden.

Jeder, der tatsächlich mainstream-künstliche Intelligenz-Chatbots verwendet hat, weiß, dass dies sehr weit von der Wahrheit entfernt ist, und dass LLMs vielleicht sogar gefährlicher sind, wenn sie kalt analytisch erscheinen, weil ihre Ungenauigkeiten in diesem Kontext rationaler erscheinen können.

Trotzdem sind die Ergebnisse der Forscher faszinierend, nicht zuletzt, weil es nicht überhaupt klar ist (sie bemerken), warum dieses spezifische Merkmal eine spezifisch negative Wirkung auf die Ausgabe haben sollte.

* Dieses Papier folgt einem wachsenden Trend, das traditionelle Einreichungsschema zu ändern, mit (zum Beispiel) Methode, die ans Ende gestellt wird, und einer wachsenden Menge an Material, das den Anhangen zugewiesen wird – offensichtlich, um dem <10-Seiten-Ideal zu entsprechen. Offensichtlich ändert dies die Art und Weise, wie wir solche Arbeiten abdecken, und die Formatierung unserer eigenen Artikel, die möglicherweise in Übereinstimmung mit der Szene evolvieren.

† Ergebnisse auf MMLU und GSM8K blieben über alle Modelle hinweg stabil, außer Llama-8B, das einen leichten Rückgang in der MMLU-Leistung nach der Feinabstimmung zeigte – ein isolierter Fall, der darauf hindeutet, dass die allgemeine Fähigkeit im Großen und Ganzen durch die Feinabstimmung nicht beeinträchtigt wurde, und dass die Zunahme der Fehlerraten nicht durch allgemeine Verschlechterung verursacht wurde.

†† Dieses Zitat enthielt ursprünglich so viele Inline-Zitate, dass ich sie realistisch nicht in Hyperlinks umwandeln konnte, ohne es schwer lesbar zu machen. Ich habe daher die Zitate weggelassen und den Leser gebeten, sie im Originalpapier zu studieren.

Erstveröffentlicht am Mittwoch, 30. Juli 2025. Aktualisiert am Mittwoch, 30. Juli 2025 17:01:50 aus Formatierungsgründen.