Andersons Blickwinkel

Selbst einfache KI kann jetzt Nachrichten schreiben, die als menschlich durchgehen

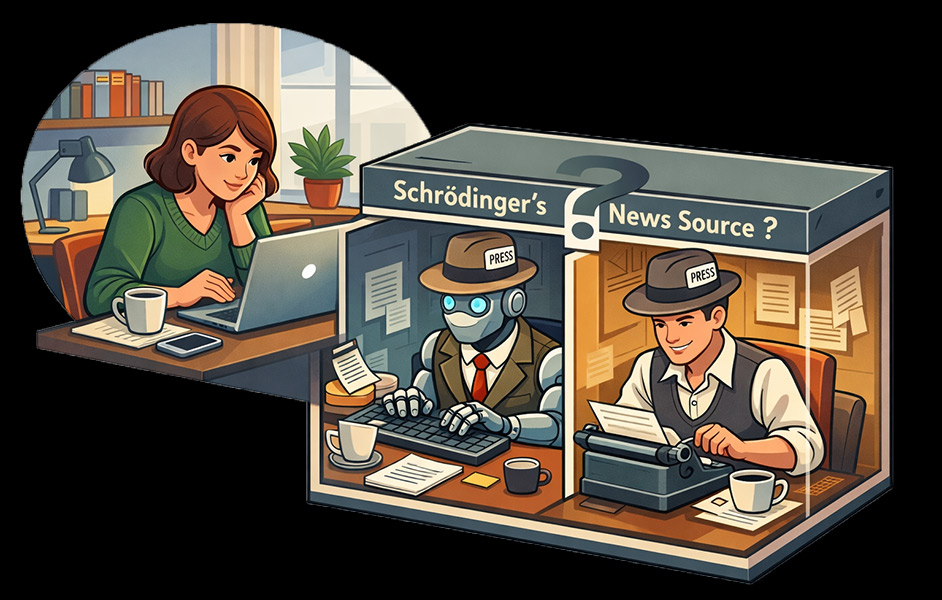

Neue Forschungsergebnisse deuten darauf hin, dass sogar kleine lokale KI-Modelle jetzt Nachrichten schreiben können, die Menschen nicht von echter Journalismus unterscheiden können, was den Spitzenmodellen entspricht und Leser dazu bringt, nicht zu erkennen, wer was geschrieben hat.

Laut einer neuen Forschungskooperation zwischen Deutschland und Frankreich können Menschen nicht erkennen, ob ein Nachrichtenartikel von einer KI oder einem Menschen geschrieben wurde – sogar wenn er von Open-Source-Modellen geschrieben wird, die heruntergeladen und auf relativ durchschnittlichen Consumer-Desktop-Computern ausgeführt werden können.

In einem weiteren Hinweis darauf, dass kleine KI auf dem Vormarsch ist, ergab eine Umfrage von 2.318 Urteilen, die von 1.054 Teilnehmern in einem dedizierten akademischen Studienportal gesammelt wurden, dass menschliche Leser die Herkunft eines Artikels nicht identifizieren konnten, wenn er von verhältnismäßig bescheidenen Modellen mit so wenigen wie sieben Milliarden Parametern erzeugt wurde, einschließlich Mistral und Llama-Varianten:

Mittelwerte für Quellen- und Authentifizierungsbewertungen für getestete LLMs. Die 200 Milliarden Parameter von GPT-4o übersteigen die 7 Milliarden Parameter der kleineren Modelle nicht wesentlich. Die getesteten Modelle waren Gemma 7B, Phi-3 Mini, LLaMA-2 13B, Mistral 7B, GPT-4o und GPT-3.5. Quelle

Die Autoren kehren zu einem Thema zurück, das sie erstmals in der Veröffentlichung von 2024 veröffentlichten Segen oder Fluch? Eine Umfrage über die Auswirkungen von generativer KI auf Fake News. Die Ergebnisse selbst sind neu veröffentlichte Ergebnisse aus einem größeren Projekt, das ursprünglich angekündigt wurde, und nutzen das eigene JudgeGPT-Online-Partizipationsframework der Autoren.

Leichtgewichtige Macht

Mit dem Titel Können Menschen erkennen? Eine Zwei-Achsen-Studie zur menschlichen Wahrnehmung von LLM-generierten Nachrichten und von drei Forschern der Frankfurt University of Applied Sciences und der IRISA-Forschungseinheit in Nantes, macht die neue Studie eine wichtige Unterscheidung zwischen ‘Fake News’ und ‘KI-geschriebenen Nachrichten’ (da Fake News von Menschen oder KI geschrieben werden können und die beiden Aspekte nicht notwendigerweise synonym sind).

Allerdings ist vielleicht der interessanteste Aspekt die Schlussfolgerung der Studie, dass kleine Modelle, einschließlich Mistral 7B und Gemma 7B, mit nur sieben Milliarden Parametern, sich mit Anstand gegen die likes von ChatGPT-Modellen (4o) mit 200 Milliarden Parametern behaupten können:

‘Open-Weight-Modelle mit so wenigen wie 7 Milliarden Parametern erzeugen Texte, die nicht anders bewertet werden als die Ausgabe von GPT-4o, was darauf hinweist, dass die Fähigkeit, menschlich nicht unterscheidbare Texte zu erzeugen, nicht mehr auf Frontier-Modelle beschränkt ist.’

Allerdings kann ‘KI-generierte Nachrichten’ viele verschiedene Arten von menschlicher/KI-Zusammenarbeit darstellen, von Rechtschreibprüfung bis hin zu vollständiger, karrierebeendender Aufgabenübertragung, und die Studie macht nicht klar, welche Art von KI-Inhalt für die Tests produziert wurde (obwohl sie die Methodik für die Erzeugung beschreibt – siehe unten).

Methodik

Für die Teilnehmer, die mit der JudgeGPT-Plattform interagierten, wurde jeder Nachrichtenfragment mit einem Zwei-Achsen-Framework bewertet, bei dem sie drei unabhängige Bewertungen auf kontinuierlichen 0-100-Schiebereglern abgaben:

Die JudgeGPT-Portal-Oberfläche, bei der Bewerter Material auf Quellenzuweisung; Authentizität; und Themekenntnis bewerten. Bitte verweisen Sie auf die Quellpapier für eine bessere Auflösung.

Quellenurteil erfasste, ob ein Absatz maschinengeschrieben oder von einem Menschen geschrieben schien; Authentizitätsurteil, ob es als gefälscht oder legitim wahrgenommen wurde; und Themekenntnis, wie gut der Leser das Thema kannte.

Kontinuierliche Skalen wurden anstelle einer Likert-Skala verwendet, um Grade der Sicherheit genauer zu erfassen und statistische Analysen zu unterstützen, einschließlich Pearson-Korrelation und Clustering.

Maschinengenerierte Textfragmente wurden mit dem eigenen RogueGPT-Framework der Autoren erzeugt, der die Zuführungsarchitektur für JudgeGPT ist. RogueGPT orchestriert Beiträge von sechs Large Language Models (LLMs): ChatGPT-4; ChatGPT-3.5; ChatGPT-4o; LLaMA-2 13B; Gemma 7B; und Mistral 7B.

Persona-basierte Aufforderungen wurden verwendet, um die Texte zu erzeugen, und die KI-Generierungen wurden durch reale Nachrichtenthemen und von Menschen durchgeführte Faktenchecks fundiert.

Im Gegenzug wurden menschlich geschriebene Fragmente aus ‘etablierten Nachrichtenquellen’ und ungenannten ‘Informationsdatenbanken’ ausgewählt.