Andersons Blickwinkel

Der ‘Survey Paper DDoS-Angriff’, der die wissenschaftliche Forschung überwältigt

Generative AI-Modelle wie ChatGPT überfluten akademische Publikationsplattformen mit AI-generierten Survey-Papern in einem Ausmaß, das das Signal-Rausch-Verhältnis kritisch macht. Eine neue Studie behauptet, dass diese Flut Forscher überwältigt, Zitate verfälscht und das Vertrauen in die wissenschaftliche Aufzeichnung untergräbt, indem sie die Flut von AI-gestützten Papern mit einem ‘DDoS-Angriff’ auf die Wissenschaft selbst vergleicht.

(Teilweise) Meinung Letzte Woche musste ich, zum ersten Mal in sieben Jahren, in denen ich mich mit dem wissenschaftlichen Literaturstrom im Zusammenhang mit KI auf dem Laufenden halte, mich geschlagen geben und zugeben, dass ich, zumindest zu Spitzenzeiten, wählen muss, ob ich mich auf neue Publikationen konzentriere oder Zeit habe, über einige von ihnen zu schreiben.

Die Gesamtzahl der Einträge in einer sehr begrenzten Anzahl relevanter Kategorien (Computer Vision, Machine Learning, Language Models und einige weniger abonnierte Abschnitte) lag bei erheblich über tausend – nur für die Einreichungen eines Tages.

Bei einem solchen Volumen würde sogar das Überfliegen aller neuen Titel und gelegentliches Schmökern in einigen der Abstract-Zusammenfassungen einen unproduktiven Tag bedeuten.

Dies war der Dienstag, 7. Oktober. Im Gegensatz dazu bot die Machine-Learning-Kategorie in dieser Woche (14. Oktober) eine Publikationsmenge, die slightly weniger intensiv war als die 400 Einreichungen vom Dienstag der vorherigen Woche; sie hatte eine 354 Einreichungen:

354 Einreichungen für die Machine-Learning-Kategorie an einem Tag. Quelle: https://arxiv.org/

Man müsste Arxiv jeden Tag, über einige Jahre, gelesen haben, um zu realisieren, wie verrückt diese Zahlen werden.

Zugegebenermaßen ist Dienstag Arxivs ‘Rush Hour’ für Einreichungen, vielleicht weil es der erste Arbeitstag ist, der nicht in der Nähe von langen Wochenenden liegt, die von einflussreichen Personen genossen werden, die Forscher erreichen möchten; und die Machine-Learning-Kategorie ist eine ‘Auffang’-Sektion mit einer geringeren Anzahl einzigartiger Papiere (Papiere, die nicht gleichzeitig in spezielleren Kanälen veröffentlicht werden) als die meisten anderen Kategorien.

Trotzdem ist der Anstieg der Papier-Einreichungen bereits ein bekanntes Phänomen in der Akademie und in den Medien.

Vielleicht ist der schockierendste Aspekt dieser Eskalation, wie alle anderen angrenzenden Kategorien mehr oder weniger unverändert in ihrer Häufigkeit über die letzten drei Jahre sind, während die Computer-Science-Kategorie (siehe, ob Sie sie in Arxivs offiziellen Zahlen finden können) auf einer starken Aufwärtskurve ist:

Der Anstieg der Computer-Science-Papiere über die letzten drei Jahre. Quelle: https://info.arxiv.org/about/reports/submission_category_by_year.html

Vor etwas mehr als drei Jahren wurde Arxivs AI-Papier-Einreichungsausstoß geschätzt, um alle paar Jahre zu verdoppeln; und es wird interessant sein, Arxivs eigene jährliche Zusammenfassung der Trends am Ende von 2025 zu lesen.

Volume auf 11

Die zwei offensichtlichsten Gründe, warum dies passiert, sind a) unprecedented finanzielle Verpflichtung zu generativer KI, die massive Forschungsinvestitionen in den privaten und akademischen Sektoren anzieht, die oft zusammenarbeiten; und b) die Tatsache, dass AI-Sprachmodell-Systeme wie ChatGPT jetzt das Einreichen von Forschungspapieren (einschließlich Papieren über KI) zu einem fast industrialisierten Prozess machen.

Allerdings steigt die Qualität der Forschungseinreichungen nicht im gleichen Maße wie das Volumen (obwohl die fehlerhafte Ausgabe von KI tendenziell mehr Schlagzeilen im Rechtssektor als in der Akademie macht, nicht zuletzt, weil die Auswirkungen dort offensichtlicher sind).

Eine Null-Toleranz-Politik ist in diesem Fall schwer umzusetzen, selbst wenn die Erkennung von AI-generiertem Inhalt einfacher wäre; abgesehen von der Tatsache, dass KI an sich ein manifester Segen für die wissenschaftliche Forschung im Allgemeinen ist, ihre Verwendung in Forschungspapier-Einreichungen im Allgemeinen* die Klarheit der Arbeit von vielen nicht-englischen Einreichern – Einzelpersonen und Teams, die bis jetzt unter einem Nachteil gelitten haben – verbessert hat.

Aber das Problem der Senkung der Sprachbarriere auf diese Weise ist, dass dies auch die reine Anzahl der globalen Einreicher erhöht, ohne die Ebene der menschlichen Überwachung zu erhöhen, die solche Arbeit wertvoll macht.

Wenn die Einreichungszahlen weiter exponentiell ansteigen, wird das Signal-Rausch-Verhältnis so unkontrollierbar, dass nur KI selbst möglicherweise die neuen Fluten und Nebenflüsse von KI-Papieren navigieren könnte; eine Aufgabe, die sie nicht besser erledigen kann als die Überprüfung ihrer eigenen Ausgabe. Ironischerweise ist wissenschaftliche Forschung ein intensiv menschliches Unternehmen.

Angriff auf die Forschung

Der Grund für diese Reflexion ist eine interessante neue Zusammenarbeit aus China mit dem Titel Stop DDoS Attacking the Research Community with AI-Generated Survey Papers.

Das neue Positionspapier konzentriert sich speziell auf Survey-Einreichungen – hochkarätige Zusammenfassungen bestimmter Stränge in der Forschung, die traditionell sowohl aufgelistet als auch kontextualisiert, interpretiert und informierte Vorhersagen gemacht haben:

Ein Bruchteil des riesigen und ständig wachsenden Körpers von Surveys in den Bereichen Machine Learning und KI, bei arxiv.org

Da Surveys kuratieren anstelle von Originieren, sind sie ungewöhnlich einfach zu automatisieren, und die Autoren des neuen Werks charakterisieren die Verbreitung von low-effort-Surveys in Bezug auf eine Sicherheitsbedrohung für den Forschungssektor†:

‘[Die] jüngste Flut von AI-generierten Surveys, insbesondere durch große Sprachmodelle (LLMs) ermöglicht, hat diese traditionell arbeitsintensive Gattung in eine low-effort, high-volume-Ausgabe verwandelt. Während eine solche Automatisierung die Einstiegshürden senkt, führt sie auch eine kritische Bedrohung ein: das Phänomen, das wir als „Survey-Paper-DDoS-Angriff“ auf die Forschungsgemeinschaft bezeichnen.

‘Dies bezieht sich auf die unkontrollierte Verbreitung von oberflächlich umfassenden, aber oft redundanten, low-quality- oder sogar halluzinierten Survey-Manuskripten, die Preprint-Plattformen überfluten, Forscher überwältigen und das Vertrauen in die wissenschaftliche Aufzeichnung untergraben.

‘[Wir] argumentieren, dass wir aufhören müssen, massive Mengen an AI-generierten Survey-Papern (d. h. Survey-Paper-DDoS-Angriff) in die Forschungsgemeinschaft hochzuladen, indem wir starke Normen für AI-gestützte Rezensionsschreiben einführen.’

Die Autoren behaupten, dass diese ungebremste Beschleunigung der Survey-Produktion droht, das Forschungssystem mit polierten Berichten zu überfluten, die zwar keine kritische Tiefe haben, aber wahrscheinlich faktuelle Fehler und/oder halluzinierte Zitate verbreiten.

Das Papier warnt, dass ohne bessere Regeln oder Überwachung AI-generierte Surveys in oberflächliche Kopien umgewandelt werden könnten, die wichtige Themen falsch darstellen, sinnvolle Analysen verbergen und Literaturübersichten weniger vertrauenswürdig machen:

‘Die Auswirkungen auf die Forschungsqualität und das Vertrauen sind tiefgreifend. Zunächst riskieren echte Fortschritte, von algorithmisch generierten Wiederholungen existing Arbeit überdeckt zu werden.

‘Neulinge und interdisziplinäre Gelehrte könnten Schwierigkeiten haben, verlässliche Übersichten inmitten des Lärms zu finden. Darüber hinaus können Fehler oder Voreingenommenheiten, die durch automatisierte Erstellung eingeführt werden, unkontrolliert verbreitet werden und nachfolgende Forschung mit fehlerhaften Prämissen anstoßen.

‘Insgesamt gefährdet die Flut von nicht peer-reviewed AI-generierten Surveys sowohl die Strenge von Literaturübersichten als auch die Glaubwürdigkeit der wissenschaftlichen Aufzeichnung.’

‘Abnormale’ Autoren

Die Forscher des neuen Papiers liefern einige interessante Analysen zur Entwicklung von Survey-Einreichungen:

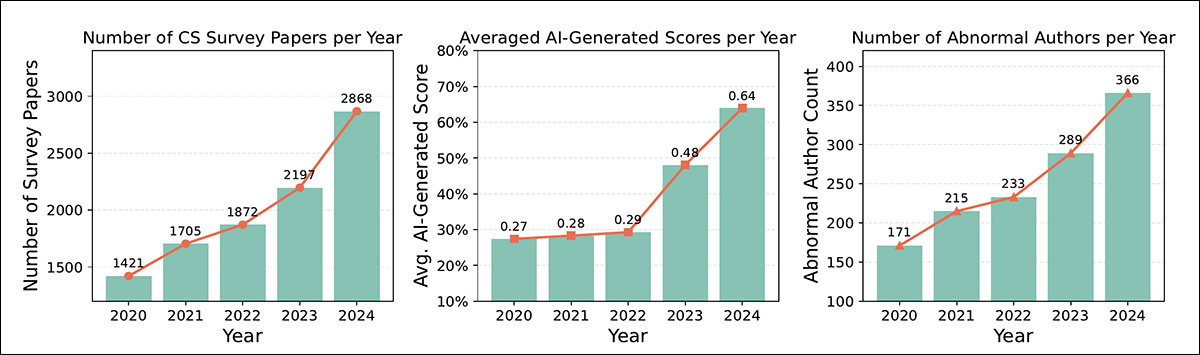

Links: die jährliche Anzahl von Computer-Science-Survey-Papern von 2020 bis 2024. Mitte: Durchschnittliche AI-Generierungspunktzahl für diese Papiere über den gleichen Zeitraum. Rechts: Anzahl der Autoren, die als abnormal (mit ungewöhnlich hoher Survey-Ausgabe, begrenzter Co-Autoren-Vielfalt und wiederkehrenden institutionellen Mustern) jedes Jahr gekennzeichnet sind.

In der ersten Spalte sehen wir Wachstumstrends: die Kurve beginnt, sich um 2022 zu steilen, gerade als ChatGPT aufkam und große Sprachmodelle in den Mainstream eintraten, und Nachfolgemodelle wie Claude, PaLM und Gemini würden diesen Schwung über 2023 hinweg aufrechterhalten.

Die mittlere Grafik zeigt einen steilen Anstieg der Einreichungen nach 2022, der mit der Veröffentlichung von ChatGPT zusammenfällt. Ein Forschungsteam fand heraus, dass bis 2024 mehr als 10 % der wissenschaftlichen Abstracts durch ein LLM verarbeitet worden waren. Ein separater Bericht von einem AI-Erkennungsunternehmen gab den Sprung nach der Veröffentlichung von ChatGPT mit 72 % für Papiere auf arXiv an, die möglicherweise mit AI-Hilfe geschrieben wurden. Die Anzahl der Papiere mit hohen AI-Generierungspunktzahlen verdoppelte sich innerhalb eines Jahres von 3,6 % auf 6,2 %.

Die dritte, rechte Grafik zeigt einen stetigen Anstieg der Anzahl ‘abnormaler’ Autorenmuster (Forscher, die drei oder mehr Surveys innerhalb eines Monats einreichen, während sie mit weniger als zwei Mitarbeitern zusammenarbeiten), mit einem steileren Anstieg, der 2022 beginnt.

Die Autoren behaupten, dass viele dieser Survey-Papiere möglicherweise von KI erstellt wurden, aus verschiedenen Gründen; einige sind von Solo-Autoren oder kleinen Gruppen geschrieben, die mehrere Surveys in kurzer Zeit einreichen; viele behandeln unabhängige Themen; und in einigen Fällen haben die Autoren keine vorherige Aufzeichnung in den Feldern, die sie zusammenfassen.

Zusätzlich werden einige unter anonymen Kollektiven mit keinen klaren institutionellen Bindungen veröffentlicht – Muster, die auf eine koordinierte Flutung des Feldes mit schnellen Surveys hindeuten, möglicherweise, um Zitate zu gewinnen oder akademische Profile zu verbessern, anstatt einen echten Beitrag zur Literatur zu leisten.

Probleme

Obwohl wir nicht alle Behauptungen des neuen Papiers abdecken können, sollten wir uns einige der bemerkenswertesten Beobachtungen ansehen, sowie einen kritischen Blick auf die von den Autoren vorgeschlagenen Lösungen für diese Probleme werfen.

Qualität und Originalität

Das Problem ist nicht nur das Volumen: viele AI-geschriebene Surveys verpassen, was ein guter Survey nützlich macht: klare Struktur, tiefe Analyse, korrekte und sorgfältige Anerkennung und echte Einsicht. Stattdessen schlagen die Autoren vor, dass AI-generierte/unterstützte Surveys oft wie zusammengestückelte Zusammenfassungen lesen, ohne die erforderliche Sorgfalt oder Kuratierung.

Die Autoren bemerken weiter, dass AI-geschriebene Surveys oft keine Struktur haben, sondern einfach nur Papiere auflisten, ohne klare Richtung, wichtige Abschnitte überspringen und keinen Kontext schaffen. Human-geschriebene Surveys hingegen neigen dazu, ordnungsgemäße Kategorien zu erstellen und eine kohärentere Geschichte zu erzählen.

Außerdem scheinen viele potenziell AI-gestützte Surveys einfach bestehende Themen-Unterteilungen zu kopieren, manchmal direkt aus Wikipedia. Zum Beispiel bemerkt das Papier, dass mehrere Surveys über Vision Transformers gemeinsame Abschnittstitel und -strukturen enthalten, was auf eine Vorlage-gesteuerte AI-Ausgabe hindeutet:

‘Im Gegensatz dazu könnte ein gut gearbeiteter human-geschriebener Survey eine neue Taxonomie einführen, z. B. ViT nach Effizienzstrategien kategorisieren. Das Fehlen einer solchen Originalstruktur in vielen aktuellen Survey-Preprints lässt Bedenken hinsichtlich der Möglichkeit aufkommen, dass sie von KI mit begrenzter menschlicher Einsicht generiert wurden.’

Zitieren Sie mich nicht darauf

Vielleicht am öffentlichkeitsschädlichsten erhalten AI-geschriebene Surveys oft Zitate falsch, verpassen wichtige Papiere, einschließlich nicht relevanter Papiere und manchmal sogar nicht existierende Papiere – Fehler, die darauf hindeuten, dass die Referenzen aus oberflächlichem Musterabgleich stammen, anstatt aus echter Expertise.

Die Autoren weisen auch darauf hin, dass einige aktuelle Survey-Papiere, oft von ganz unterschiedlichen Teams, bis zu 70 % ihrer Referenzlisten teilen – ein Überlappungsgrad, der so hoch ist, dass er auf eine gemeinsame Abhängigkeit von LLMs hindeutet, die aus dem gleichen engen Pool von Quellenmaterial schöpfen.

Tatsächlich wissen Casual-Nutzer von ChatGPT, dass das Thema, je obscurer es ist, desto weniger diverse Quellen es gibt, auf die das Modell zurückgreifen kann; sehr oft ist es nützlicher, die eigenen Quellen des Modells im Internet zu finden, als versucht, mit dieser Information über eine KI zu interagieren, die nicht ausreichend Daten in einem bestimmten Bereich hatte.

Ein ‘homogener Stil’ entsteht

Die Autoren bemerken auch, dass viele AI-geschriebene Surveys zum gleichen Thema fast identisch aussehen und klingen, da LLMs Phrasen und Strukturen wiederholen, insbesondere für beliebte Themen, was zu einem Sturm von fast identischen Papieren führt, die wenig Wert hinzufügen und auch erheblichen Lärm für Forscher hinzufügen, die nach Domain-Antworten suchen*:

‘Wenn mehrere Autoren ein LLM auffordern, „eine Literaturübersicht über X“ zu schreiben, produziert das Modell oft sehr ähnliche Antworten, insbesondere für gemeinsame Definitionen oder allgemein bekannte Fakten. Aktuelle Forschung hat einen steilen Anstieg der Verwendung bestimmter Schreibmuster im Zusammenhang mit LLMs gezeigt, was darauf hindeutet, dass viele Papiere jetzt den gleichen Stil haben.’

Ihre ChatGPT ist sichtbar

Das Papier bemerkt, dass ein schneller Weg, um AI-geschriebene Surveys zu erkennen, die Anwesenheit von Phrasen wie ‘als KI-Sprachmodell’ oder ‘mein Wissensstand’ ist, was darauf hindeutet, dass die Ausgabe von den Sprachmodellen vor dem Einreichen der Papiere nicht oder nur minimal kuratiert wurde (obwohl eine gezielte Suche zum Zeitpunkt des Schreibens keine solchen Hinweise in Google Search ergab).

Das Papier bemerkt, dass viele ‘verdächtige’ Surveys eine geringere Wortvielfalt und wiederholte Phrasen aufweisen, zum Beispiel, indem sie mehrere Absätze mit Weiterhin beginnen. Diese Art von Muster, so die Autoren, ist typisch für GPT-Style-Schreiben und könnte ein nützliches Flag für die Erkennung von auto-generiertem Text sein.

(Mein persönlicher Kommentar dazu ist, dass die Beschränkungen des Online-Journalismus oft einen Schriftsteller zwingen, viele Elemente in einer prosaischen, nicht stilisierten Form aufzulisten. Daher haben ChatGPT und seine Peers diese schlechte Angewohnheit wahrscheinlich von menschlichen Schriftstellern gelernt, die mit einer begrenzten Anzahl von lexikalischen Alternativen konfrontiert waren. Zusätzlich zeigt die Vermutung der Autoren, dass sie sich mit den Grundsätzen der AI-Inhalts-Erkennung befassen, einem komplexen und sich entwickelnden Feld mit wenigen dauerhaften Konstanten der Art, die die Autoren vorschlagen)

Obwohl die Forscher weiterhin eine faszinierende Diskussion über die negativen Auswirkungen von AI-Surveys auf die Forschungskultur und das Vertrauen führen, müssen wir den Leser auf das Quellenpapier verweisen, um mehr über dieses Thema zu erfahren.

Lösungen?

Die Lösung des Papiers ist faszinierend, radikal und gleichzeitig seltsam unoriginal: dass die Nützlichkeit von Survey-Papern durch eine Dynamic Live Survey ersetzt werden sollte – eine Art Hybrid zwischen einer Wiki und einer GitHub-Seite, die ständig mit neuen Daten von LLMs und anderen KI-Systemen gefüttert wird, aber mit Commits, die nur von Menschen durchgeführt werden, sodass KI nicht im Wesentlichen ‘Auto-Updates’ durchführen kann.

Das vorgeschlagene System würde die Versionierung und Verzweigung von GitHub teilen, indem es im Wesentlichen eine Informationsressource in eine ständig aktualisierte Liste ähnlich der ‘awesome’-Linie von kuratierten Listen bei GitHub umwandelt:

‘In diesem Rahmen legt ein Gemeinschaftsmitglied zunächst ein Survey-Thema-Wiki fest, indem es den Umfang, die wichtigsten Forschungsfragen und die grundlegenden Referenzen spezifiziert, was damit eine klare thematische Grenze und eine anfängliche Struktur setzt.

‘Anschließend überwacht ein LLM-basiertes Einreichungsagent kontinuierlich Preprint-Archive, Konferenz-Verhandlungen und Benchmark-Leaderboards. Es extrahiert automatisch Abstracts, Figuren und wichtige Leistungsmetriken; fasst neue Ergebnisse zusammen; aktualisiert den Zitationsgraphen, um die Beziehungen zwischen den Papieren widerzuspiegeln; und markiert aufkommende Forschungstrends für weitere Überprüfung.

‘Durch die Konstruktion erfolgen diese automatischen Updates innerhalb von Stunden nach der Veröffentlichung, um sicherzustellen, dass das Repository auf dem neuesten Stand bleibt.’

‘Menschliche Mitwirkende treten dann ein, um die interpretative Tiefe zu liefern, die Maschinen allein nicht bieten können. Sie verfeinern die Entwicklung von Taxonomien, um subtile methodologische Unterschiede zu erfassen, koordinieren widersprüchliche Interpretationen von algorithmischen Innovationen in verschiedenen Subfeldern und liefern tiefergehende kritische Vergleiche zum Dokument.’

Das Buch der Veränderungen

Die Autoren entwickeln ihre Vorschlag mit Begeisterung und in großer Ausführlichkeit, und rechtfertigen ihn im Wesentlichen mit etwas, das sehr wahr ist: hochkarätige, human-geschriebene Surveys zu volatilen Themen rund um KI altern so schnell, dass sie kaum der Mühe wert sind, geschrieben zu werden; und das Papier bemerkt, dass eine dreimonatige Wartezeit für ein neues Survey-Papier wahrscheinlich bedeuten würde, dass es überholt (oder sogar stark überholt) ist, wenn sein geplanter Veröffentlichungstag kommt:

‘Jahr für Jahr werden Gemeinschaften von wiederholten oder oberflächlichen Übersichten überflutet, die schnell ihre Relevanz verlieren, und Praktiker und Neulinge haben Schwierigkeiten, Signal von Rauschen zu unterscheiden. Der traditionelle Publikationszyklus (d. h. Entwurf, Einreichung, Überprüfung und Veröffentlichung) kann mehrere Monate dauern, bis zu dem Zeitpunkt, an dem kritische Durchbrüche bereits den Landschaftsplan geändert haben mögen.

‘Darüber hinaus trägt die zunehmende Menge an statischen Surveys zu kognitiver Überlastung bei, da Leser durch zahlreiche überlappende Dokumente blättern müssen, um substantielle Erkenntnisse zu finden.’

Leider teilt die Lösung des Papiers viele der schlimmsten und meist kritisierten Eigenschaften von Discord: vor allem, dass es eine ständig sich verändernde und sich entwickelnde Ressource wäre.

Da jeder Teil eines Dynamic Live Survey zu jedem Zeitpunkt verschwinden oder geändert werden könnte, wäre es unmöglich, es als zitierbare, stabile Quelle zu verwenden; es sei denn, indem man auf einen ‘vorherigen Commit’ verweist, ähnlich wie archive.is und die Wayback Machine, unter anderem Archiv-Websites, verlinkbare Schnappschüsse von Web-Inhaltsseiten bereitstellen, die zu einem bestimmten Zeitpunkt eingefroren sind. Aber welche Ressourcen würde ein solcher Commit benötigen, und könnte er darauf vertrauen, über die Zeit hinweg online zu bleiben?

Zusätzlich wäre eine Plattform/Wiki mit ständig sich ändernden Definitionen und Inhalten schwierig zu indizieren, entweder durch traditionelle Suchmaschinen oder LLMs.

Vielleicht ist der schwächste Teil des vorgeschlagenen Systems die Idee, dass echte Menschen die Commits von den LLM-Agents überwachen sollten; wie immer sind echte Menschen teuer. Was vorgeschlagen wird, ist etwas zwischen einem Museum und einer Bibliothek – beides benötigt eine Fleischware-Besetzung, die dem Datenvolumen und der Anzahl der behandelten Themen entspricht.

Wenn ‘Benutzen Sie echte Menschen‘ die einzige Antwort auf ein KI-Entwicklungsproblem ist, ist es fair zu sagen, dass das Problem weiterhin offen und ungelöst bleibt.

Schlussfolgerung

Im Moment ist die kurze Haltbarkeit von Survey-Papern über KI ärgerlich; wenn die aktuelle Tendenz hin zu groß angelegter automatisierter Schreib- und Einreichungspraxis weitergeht, wie im neuen Papier skizziert, wird das Signal-Rausch-Verhältnis chronisch und die Literatur unkontrollierbar.

In einer solchen Situation wäre es noch schwieriger als jetzt für kleine, sub-FAANG-Stimmen, im Sturm der Einreichungen gehört zu werden, und große Marktführer würden wahrscheinlich noch mehr Prominenz gewinnen.

Neben Live-Surveys schlägt das neue Papier vor, dass Autoren nicht nur selbst erklären sollten, wenn KI in irgendeinem Teil einer Einreichung verwendet wird, sondern auch, dass AI-gestützte Abschnitte innerhalb eines Papiers explizit gekennzeichnet werden sollten (vielleicht mit einer Neben-JSON-Datei…?).

Da dies eine mühsame Aufgabe ist, schlägt das Papier alternativ vor, was ich nur als ‘KI-Ghetto’ bezeichnen kann – einen bestimmten Abschnitt in der Einreichung, der für KI-Beiträge reserviert ist.

In Kürze hat die neue Arbeit, zumindest in meiner Meinung, keine realistischen Antworten zu bieten; aber die Autoren haben eine nützliche Dienstleistung geleistet, indem sie die Herausforderungen vor uns skizziert haben.

Das Papier Stop DDoS Attacking the Research Community with AI-Generated Survey Papers kann bei https://arxiv.org/abs/2510.09686 gefunden werden und ist von sechs Autoren aus Abteilungen der Shanghai Jiao Tong University geschrieben.

___________________________________

* Nicht alle sind der Meinung, dass dies der Fall ist.

† Betonung der Autoren, nicht meine. Außerdem, wo anwendbar, meine Umwandlung von Autoren-Zitaten in Hyperlinks.

Erstveröffentlicht am Freitag, 17. Oktober 2025