Andersons Blickwinkel

Kann AI einen Riecher für Nachrichten entwickeln?

AI wird besser darin, Nachrichtenartikel zu schreiben, aber nicht viel besser darin, sie zu identifizieren.

Meinung In den fünf Jahren seit ich zuletzt einen Blick auf die Fähigkeit von AI geworfen habe, eine heiße Nachrichtengeschichte zu finden, hat sich das Landschaftsbild erheblich verändert, mit zunehmenden Levels an AI-getriebener Automatisierung, begleitet von den unvermeidlichen wachsenden Schmerzen und Kontroversen.

Vor Kurzem präsentierte ein WSJ-Bericht über einen produktiven, AI-unterstützten Fortune-Mitwirkenden den Journalisten der Zukunft als befreit von Schmutzarbeit wie der Transliteration von Pressemitteilungen, sodass sie den Spielraum haben, die Features zu schreiben und die Recherchen durchzuführen, die normalerweise nur größere Verlage budgetieren können.

Aber was wir viel weniger oft hören, ist die Fähigkeit von AI, eine Nachrichtengeschichte zu erkennen.

Lärmminderung

In dem 2021er Stück konzentrierte ich mich auf Schreiber, die den Forschungsbeat abdecken, da dies der Bereich ist, in dem ich die meiste Zeit verbringe; und vielleicht ist der größte Effekt, den die neue AI-Revolution auf diesen Bereich hatte, dass sie einen ungovernable Blizzard von AI-gesteuerter Forschungspapier-Einreichungen geschaffen hat, die das Signal-Rausch-Verhältnis so hoch angesetzt haben, dass sogar die umfassende Abdeckung der Arxiv-AI-bezogenen Domänen jetzt über die Anstrengungen einer einzelnen Person hinausgeht.

Sicherlich ist dies der Bereich, in dem AI hervorragt – bei der Iteration durch riesige Datenmengen, die Menschen nicht auflösen können, um ‘Ausreißer’ (zu denen wir später kommen) in Sekunden zu finden, die Menschen Tage gekostet hätten, wenn sie es überhaupt hätten tun können.

Warum ist AI also immer noch so schlecht darin, eine heiße Nachrichtengeschichte aus Tausenden, sogar Zehntausenden, täglichen Bewerbern zu identifizieren?

Rückwärtsblickende AI

Diese massive Ausbreitung von AI-generiertem Inhalt findet weit über den akademischen Sektor hinaus statt, über den ich zuvor sprach. Im letzten Jahr wurde geschätzt, dass die Hälfte aller neuen Schreibarbeit im Internet jetzt von AI ‘geschrieben’ wird, mit noch stärkerer Beschleunigung dieser Tendenz, die vermutet wird. Daher ist der Lärm ohrenbetäubend überall, nicht nur in der Akademie.

Obwohl es in den letzten Jahren einige Fortschritte in der AI/algorithmischen Identifizierung einer ‘heißeren’ Geschichte gegeben hat, konzentrieren sich diese Systeme tendenziell auf stratifizierte und vorhersehbar organisierte Datenfeeds, was bedeutet, dass sie nur in einem ziemlich spröden Kontext operieren können.

In dieser Hinsicht hat der Stanford-Postdoktorand und ehemalige New York Times-Journalist Alexander Spangher mehrere Vorstöße unternommen, um ‘Nachrichtenwert’ in Begriffen zu definieren, die auf maschinelles Lernen und statistische Analyse angewendet werden können; und hat Beweise für automatisierte Lead-Generierung in Korpora wie Gerichtsakten, Gesetzesentwürfen und Stadtratssitzungen sowie allgemeinen öffentlichen Dokumenten – die Art von schema-getriebenen Ausgaben, die der AI-gesteuerte Schreiber von Fortune in 6-7 Nachrichtenstücken pro Tag umwandeln kann:

Die ‘Hitze’ der Wortverteilungen, die aus Korpora von öffentlichen Dokumenten gewonnen wurden. In diesem Fall können wir sehen, dass ‘authorizing’ einen hohen Score hat, vielleicht weil es Entscheidung, Wandel und Neuheit repräsentiert. Quelle

Allerdings besteht das Problem mit Ansätzen wie dem Spangher-geführten Angebot Tracking the Newsworthiness of Public Documents darin, dass sie in typischer AI-Manier auf beobachteten Trends in den Daten basieren. Mit anderen Worten, sie beobachten Dinge, die früher gute Nachrichten waren, und suchen nach mehr von dem Gleichen.

In der realen Welt sind unerwartete Quellen fast immer ein ‘One-Hit-Wonder’; und trotz gelegentlicher Versuche, von flüchtigem Ruhm oder Ansehen zu profitieren, werden sie normalerweise nie wieder etwas Nützliches produzieren.

Zeichen der Zeit

Daher, da die Überwachung einer solchen ‘One-and-Done’-Nachrichtenquelle normalerweise nur mehr Lärm zum allgemeinen Blizzard hinzufügen wird, könnte AI nicht stattdessen die Signifikatoren einer Quelle identifizieren, die eines Tages fruchtbar werden wird? Wenn man herausfinden könnte, was für eine Art Quelle möglicherweise eines Tages Nachrichten liefern wird, könnte man sich auf ihre Eigenschaften konzentrieren, anstatt auf ihren Kontext oder ihre Methoden.

Durch diese Logik könnte man folgern, dass die Enthüllungen von Edward Snowden in den 2010er Jahren zeigen, dass jeder, der kürzlich die CIA (oder eine ähnliche Organisation) verlassen hat, als potenzielle Quelle für eine zukünftige Sensation zu verfolgen wäre.

Allerdings gibt es keine RSS-Feeds oder APIs, die wahrscheinlich in der Lage wären, diese Art der laufenden Überwachung zu automatisieren, da LinkedIn und viele andere einst offene Datenquellen sich im Angesicht von rücksichtslosen und scofflaw AI-Web-Scrapern zurückziehen. Selbst wenn es sie gäbe, wäre die Frequenz ein Problem, da man eine API oder eine Website nicht alle fünf Sekunden abfragen kann; abgesehen von den Kosten für Ressourcen würde die IP-Sperre von den Plattformen diese Aktivität unhaltbar machen.

Weiterhin gibt es offensichtlich eine ‘menschliche Dimension’ bei solchen Enthüllungen, die schwer zu automatisieren ist.

Nachrichtensammlung mit persönlicher Note: Aufnahme aus einer Disc-Veröffentlichung des 1976er Alan J. Pakula-Films ‘All The President’s Men’, mit dem Informanten, der aus dem Schatten tritt. Quelle

Auch in der realen Welt ist es verdammt schwer, die definierenden Eigenschaften einer zukünftigen Nachrichtenquelle zu identifizieren. Es ist wahrscheinlich nicht ‘Menschen, die die CIA kürzlich verlassen haben’, und es ist sicherlich nicht durch ein Protokoll definiert: Plattformen wie X oder GitHub geben selbst zu viel Signal in sich aus, und selbst wenn man sich auf Suchbegriffe oder Post-Kategorien einengt, macht little Unterschied – nur wenn man in das Problem involviert ist und mit der Community (oder Repo usw.) engagiert ist, ist man wirklich wahrscheinlich, die Bedeutung einer Entwicklung zu erkennen.

Sogar ein Begriff wie ‘Sicherheitswarnung’ kann den wahren Schweregrad oder die Nachrichtenwertigkeit eines Vorfalls nicht kontextualisieren, da solche Verweise täglich von Tausenden in solchen Gemeinschaften verwendet werden – und selbst wenn man die Überwachung auf die englische Sprache allein einschränkt, würde die potenzielle Variation in Idiom sowie die Verwendung von umschweifender Sprache es sehr schwer machen, einen ‘im wilden’ Post in eine wahre Nachrichtenwarnung zu parsen.

Der schmale Pfad

Die aktuelle Generation von AI-gesteuerten Systemen zur Erkennung von Nachrichtenwert hängt von formalisierten Datenstrukturen (wie JSON-Ausgaben von einer API) ab oder von informellen Datenstrukturen, die AI-entwickelte Algorithmen eine Chance haben, in eine strukturierte Schema zu parsen (wie Pressemitteilungen von einer bestimmten Organisation):

Ein geparseter RSS/XML-Feed, der die starre Hierarchie von Datencontainern zeigt. Quelle

Offensichtlich sind Ansätze dieser Art gut geeignet für programmierten Output, wie die alltägliche Arbeit, die der oben genannte WSJ-Reporter erklärt, dass AI ihn befreit hat, einschließlich Wetter-, Aktien- und Sportberichterstattung sowie routinemäßiger Pressemitteilungen von kommunalen und anderen Regierungsorganisationen.

Während es möglich ist, ‘human-Alarm’-Trigger an statistische Feeds wie Wetter (plötzliche Stürme), Aktien (plötzliche Einbrüche) und Sport (unerwartete Siege/Verluste, mit einiger Vorbereitung) anzuhängen, benötigt auch dies menschliche Aufmerksamkeit, um die Nachrichtenwertigkeit zu beurteilen.

Obwohl Begriffe wie ‘Tod’, ‘unerwartete Krankheit’, ‘Leck’ und ‘Unfall’ alle helfen können, auf neue Nachrichten hinzuweisen, können sie auch nicht auf alternative Sprachen (oder Sprachen) eingehen.

Rückkehr der Elite-Schreiber?

In den letzten Jahren ist datengetriebene Journalismus zu einem aufsteigenden Teil der Nachrichtenberichterstattung geworden, mit dem die Redaktionsabteilungen nicht länger auf ‘Scoop’-Deals beschränkt sind, die ihnen eine frühe Veröffentlichung von Sonderberichten und Weißbüchern von großen Verlegern gewähren; stattdessen können sie die Zahlen selbst auswerten.

Allerdings ist dies kein kostenloses Mittagessen; da der offensichtliche Wert des Parsens von öffentlichen Daten mit AI auf diese Weise gewachsen ist, ist eine rentenorientierte/AI-blockierende Reaktion gefolgt – oder hat sogar die Nachfrage vorweggenommen – und treibt die daten hungrigen großen AI-Spieler in Stealth-Taktiken.

Die zusätzliche Reibung der Neuen Rückbesinnung gibt möglicherweise eine gewisse Macht von ‘Bürgerjournalisten’ zurück an die etablierte Medien – oder zumindest an gut finanzierte Nachrichtenorganisationen, die die Bandbreite haben, die zusätzliche manuelle Arbeit aufzunehmen, die erforderlich ist, um Daten zu sammeln, zu verfeinern und zu bewerten, in einer Ära, in der Verleger und Domänen zunehmend den Zugang einschränken.

So könnte die praktische Manifestation von AI im Journalismus, in Bezug auf die Art und Weise, wie große Spieler und Märkte auf AI-basierte Innovation und Adoption reagiert haben, tatsächlich dazu führen, dass wir in die Vergangenheit zurückkehren: die Demokratisierung der Nachrichtenproduktion entdemokratisieren und Hindernisse für bedeutungsvolle datengetriebene Systeme zur Bewertung von Nachrichtenwert schaffen.

Gemeinsame Instinkte

Diese Einschränkungen führen uns offensichtlich zurück zu ‘Bauchgefühl’ als einer unvermeidlichen Komponente bei der Bewertung der Nachrichtenwertigkeit einer Geschichte.

Natürlich ist dies für diejenigen, die professionell in diesem Aspekt engagiert sind, beruhigend; aber Selbstzufriedenheit wäre ein Fehler, da dieses Instinkt bis zu einem bestimmten Grad destilliert und operationalisiert werden kann, ohne dass man die Obsessionen oder Steckenpferde eines bestimmten Individuums oder einer bestimmten Organisation studieren muss: in einer Studie aus dem Jahr 2022 nutzten Forscher von der Northwestern University crowd-sourced Bewertungen von potenziell neuen Nachrichten, um ein prädiktives Modell zu trainieren, das speziell mit der Nachrichtenwertigkeit von neu veröffentlichten Arxiv-Forschungspapieren befasst ist:

Umfragefragen, die den Teilnehmern präsentiert wurden, um Trainingsdaten für ein ‘Newsworthiness-Vorhersage’-AI-Modell zu erhalten. Quelle

Das System bewertet Kandidaten ziemlich gut, mit etwa 80 % seiner Top-Ten-Auswahlen, die auch von Experten als neue Nachrichten bewertet werden. Allerdings erwies sich die Übereinstimmung mit Experten als moderat, mit Ergebnissen, die Faktoren wie Rahmenbedingungen oder Publikumspassung vermissen.

Das System basiert auf den Grundsätzen, die in der 2020-Paper Computational News Discovery: Towards Design Considerations for Editorial Orientation Algorithms in Journalism erläutert werden. Wie bei den meisten ähnlichen Projekten geht diese Arbeit den wissenschaftlichen Journalismus an, anstatt abstrakte Nachrichtensammlung – vielleicht weil die wissenschaftliche Literatur tendenziell zu templatierter Ausgabe neigt, die potenziell in trainierbare und interpretierbare Datenpunkte geparsed werden kann.

Nun, wie ich 2021 beobachtete, würde dies der Fall sein, außer dass Forschungswissenschaftler häufig die Konventionen der Forschungspapier-Einreichung missbrauchen, um unbeeindruckende Ergebnisse zu verstecken oder herunterzuspielen, oder sogar einen offenen Misserfolg.

Noch größerer Herausforderung ist die große Schwierigkeit, die AI-Systeme haben, wenn sie Abbildungen und Tabellen in wissenschaftlichen Papieren interpretieren, bis zu dem Punkt, an dem diese Verfolgung lately wurde ein aktiver Strang in der Literatur:

Aus dem Paper ‘SciFigDetect: A Benchmark for AI-Generated Scientific Figure Detection’, das reale wissenschaftliche Abbildungen, ihre Generierungsprompts und synthetische Gegenstücke zeigt, die von Nano Banana und GPT in drei Kategorien produziert wurden: Abbildung, Überblick und experimentelle Abbildungen. Quelle

Es ist oft der Fall, dass eine Grafik oder Tabelle Ergebnisse enthält, die der Hauptteil des Papiers entweder mit selektiver Voreingenommenheit berichtet oder ignoriert, oder wo es die negativen Konsequenzen, die in den Ergebnissen der Grafik/Tabelle impliziert sind, außer Acht lässt. Daher ist diese Blockierung in AI-getriebenem Wissenschaftsjournalismus kein kleiner.

Allein wieder, natürlich

Die crowd-sourced-Methode, die oben erläutert wurde, legt eine mögliche Übereinstimmung zwischen gemeinsamem Konsens über potenzielle Nachrichten und professioneller Bewertung derselben nahe. Aber ohne Kontext kann offensichtlich nur der breite Strich von Nachrichtenwertigkeit bestimmt werden.

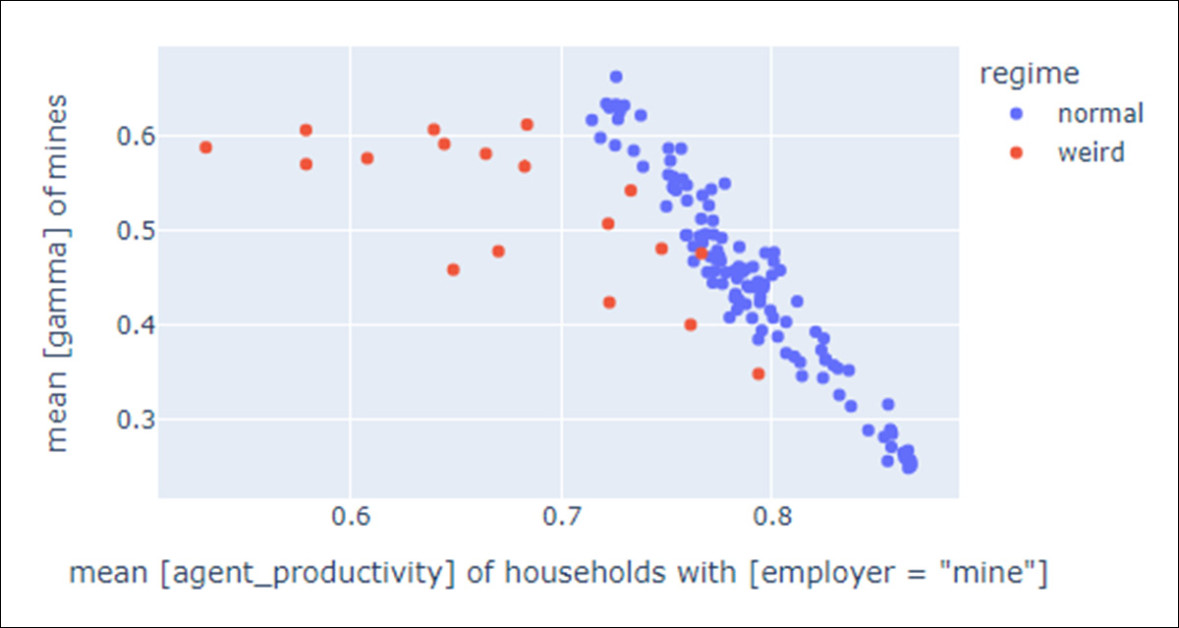

Die eigentliche Stärke von AI liegt in ihrer Fähigkeit, je nach Konfiguration, Ausreißer zu isolieren – entweder zum Zweck des Verwerfens als kurvenwerfender und nicht bedeutungsvoller Ausnahme von Trends in einem Datensatz oder (mehr relevant für Nachrichtensammlung) zur Identifizierung bedeutungsvoller und wertvoller ungewöhnlicher Instanzen und Vorkommnisse:

Ausreißer (in rot) in einem Streudiagramm. Quelle

Im Prinzip, dass der Blitz selten zweimal schlägt, sind fast alle Nachrichtenstorys Ausreißer. In Fällen, in denen sie aus einem aktiven und volatilen Bereich wie einem laufenden Krieg stammen, kann dieser Bereich mit hoher Wahrscheinlichkeit von neuen Nachrichten durchsucht werden – aber auf Kosten von massiver Konkurrenz, da die allgemeine Aufmerksamkeit wahrscheinlich auch auf den Bereich fokussiert ist.

Viele neue Nachrichtenführende sind per Definition nicht im Zentrum der Sprachverteilung. Sie sind seltene Kombinationen von Methoden, überraschende negative Ergebnisse oder anomale Replicationen. Wenn die Kompetenz des Modells disproportional auf solchen Low-Frequency-Gruppierungen abnimmt, dann wird die Region, in der ein redaktioneller ‘Riecher’ scharf sein muss, zur Region, in der das Modell am wenigsten zuverlässig ist.

Vertrauensprobleme

Bei der Suche nach neuen Geschichten balancieren Journalisten mehrere Einschränkungen, einschließlich Zeit, Zugang, Glaubwürdigkeit, Publikum und organisatorische Prioritäten), was zu nicht offensichtlichen Entscheidungen führt. Eine Literaturübersicht aus Dänemark charakterisierte Journalisten als balancierend zwischen mehreren Bedenken, sich sehr bewusst, dass Quellen Agenden haben oder falsch informiert sein können; und oft direktes Überprüfen gegenüber indirekten Vertrauenssignalen, wenn sie unter Druck stehen.

Diese gleichen ‘Vertrauensprobleme’ wären eine Entwicklungsbarriere in jedem definitiven AI-getriebenen System zur Identifizierung von Nachrichtenwert, da die Nutzung einer solchen Plattform vom Benutzer verlangt, zu vertrauen, dass algorithmisch verworfene Artikel tatsächlich nicht der Zeit des Schreibers wert sind.

Umfangreiches Beta-Testen und erneutes Trainieren oder Feinabstimmung, mit menschlicher Aufsicht, die Streuner und Nachzügler aufnimmt, könnte letztendlich die Zuverlässigkeit eines solchen Ansatzes verbessern; aber ein Wechsel in nationaler oder globaler Kultur – wie überraschende Veränderungen im politischen Landschaftsbild oder der Ausbruch von Krieg – könnte unweigerlich alle Basisprioritäten eines solchen fein abgestimmten Systems umwerfen, den AI-abhängigen Schreiber zwingend, sein notwendiges ‘internes Domänenmodell’ fast von vorne zu bauen.

Erstveröffentlicht am Montag, 20. April 2026