Andersons Blickwinkel

KI teilt die Web-Suche in drei verschiedene Realitäten auf

Neue Forschungsergebnisse zeigen, dass Google nun drei verschiedene InformationsSysteme innerhalb seines eigenen Suchimperiums verwendet, wobei reguläre Suche, KI-Zusammenfassungen und Gemini unterschiedliche Quellen, Ranglisten und Inhalte bevorzugen.

Reduktionismus regiert. Im Laufe der letzten zwölf Monate wurde das ‘Lass mich das für dich googeln’ Meme von einem neuen ‘Lass mich die Google-Suche für dich zusammenfassen’ Trend abgelöst, bei dem KI-Zusammenfassungen in den Suchergebnissen den Lesern zunehmend die Mühe ersparen, auf Suchlinks zu klicken (was die Quellseiten möglicherweise entfinanziert), indem sie die gesamten Suchergebnisse in wenige generierte Absätze kondensieren.

Man könnte annehmen, dass das aufgedeckte Wissen und die Auswahl der Quellen, aus denen dieses Wissen stammt, relativ ähnlich über alle drei der beliebtesten Methoden der Internetsuche nach Informationen wären: bei traditioneller Web-Suche; bei den KI-Zusammenfassungen (AIOs), die nun die meisten Web-Suchergebnisse anführen; und durch die zunehmende Verwendung von LLMs wie ChatGPT als Web-Orakel (mit oder ohne externe RAG-Anrufe).

Jedoch zeigen aktuelle Forschungsergebnisse aus den USA, dass dies überraschenderweise weit von der Realität entfernt ist; und dass sogar innerhalb von Googles eigener Dreifaltigkeit von Orakeln – SERPS*, KI-Zusammenfassungen und direkter Interaktion mit der Gemini-LLM-Serie – es offensichtlich signifikante und interessante Diskrepanzen gibt, für jeden Weg.

Dreiteilung

In einer klaren und umfassenden neuen Studie, betitelt Wie generative KI die Suche stört: Eine empirische Studie von Google-Suche, Gemini und KI-Zusammenfassungen, erläutern sechs Forscher des New Jersey Institute of Technology die Wege, auf denen die drei Suchmethoden divergieren, und bieten einige mögliche Theorien für diese Brüche in der Vorgehensweise an.

Die Studie besagt:

‘[Erstens] finden wir, dass für 51,5% der repräsentativen, realen Benutzeranfragen KI-Zusammenfassungen generiert und über den organischen Suchergebnissen angezeigt werden. Umstrittene Fragen führen häufig zu einer KI-Zusammenfassung.

‘Zweitens zeigen wir, dass die abgerufenen Quellen für jeden Suchdienst wesentlich unterschiedlich sind (<0,2 durchschnittliche Jaccard-Ähnlichkeit). Traditionelle Google-Suche ist wesentlich wahrscheinlicher, Informationen von populären oder institutionellen Websites in Regierung oder Bildung abzurufen, während generative Suchmaschinen wesentlich wahrscheinlicher Informationen von Google-eigenen Inhalten abrufen.

‘Drittens beobachten wir, dass Websites, die Googles KI-Crawler blockieren, wesentlich weniger wahrscheinlich von KI-Zusammenfassungen abgerufen werden, obwohl sie Zugang zu den Inhalten haben.’

Da die Studie ein breites Spektrum an faszinierenden Erkenntnissen bietet, anstatt sich an die übliche lineare und methodengetriebene Arbeitsweise zu halten, werden wir uns diesen und einige andere der überraschendsten und aufschlussreichsten Erkenntnisse genauer ansehen.

Das alte ‘Zwei-Eins’

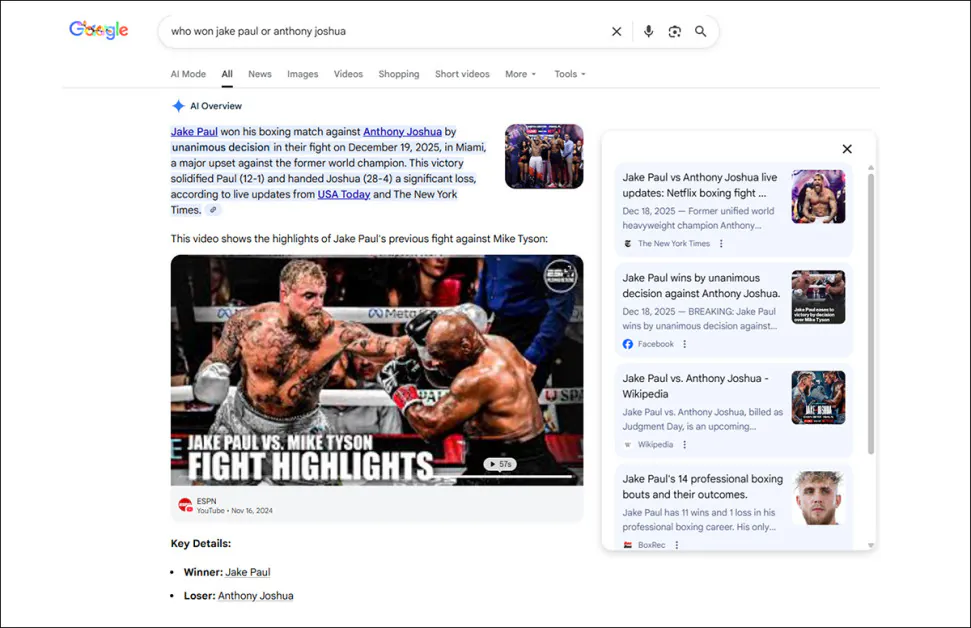

Eine der vielen interessanten Erkenntnisse in der Studie zeigt, dass Googles KI-Zusammenfassungen tendenziell bei plötzlichen Nachrichtenereignissen unterdrückt werden, da die frühesten und verfügbaren Quellen möglicherweise nicht die genauesten sind.

Dieses System funktioniert nicht immer: Im Beispiel, das von den Forschern angeführt wird, ordnete eine Google-KI-Zusammenfassung über das Ergebnis eines Boxkampfes den Sieg dem falschen Boxer zu, obwohl die einzige Quelle, die dieses (falsche) Ergebnis angab, ein satirischer Sport-Feed auf Facebook war:

Einer der Gründe, warum Googles KI-Zusammenfassungen Zeit-kritische Zusammenfassungen vermeiden, ist, dass frühe Informationen unvollständig oder völlig ungenau sein können. In diesem Fall hat der Boxer Jake Paul tatsächlich den Kampf verloren. Quelle

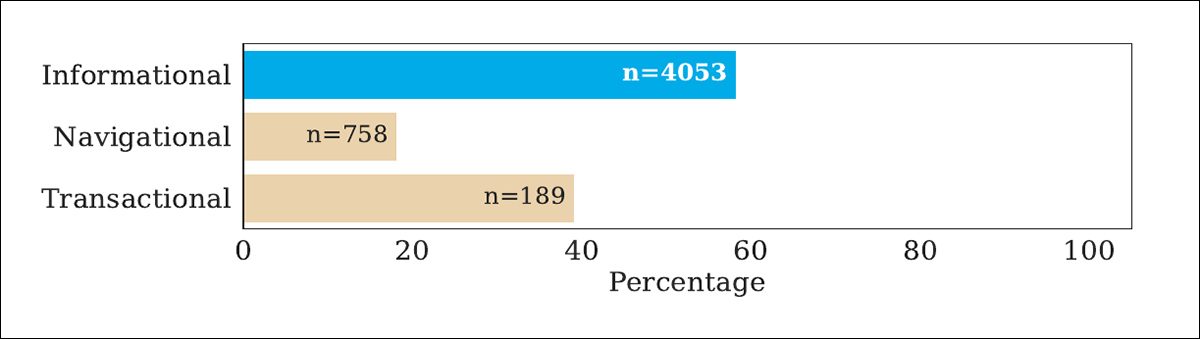

Die Autoren bemerken, dass KI-Zusammenfassungen tendenziell dann generiert werden, wenn die Anfrage mit einem Fragezeichen abgeschlossen wird, und dass Anfrage-Intention ein Faktor dafür ist, ob eine KI-Zusammenfassung präsentiert wird:

Prozentsatz der Vorfälle, bei denen eine KI-Suchzusammenfassung in einer Runde der Tests der Forscher produziert wurde. Hier bedeutet ‘informativ’ direkte Fragen, die tendenziell mehr KI-Zusammenfassungen produzieren als jede andere Art von Interaktion.

Darüber hinaus behauptet die Studie, dass längere Anfragen tendenziell eher eine KI-Zusammenfassung produzieren als nur direkte Suchergebnisse, obwohl die Autoren noch keine Theorie anbieten, um dies zu erklären.

Ein geteiltes Königreich

Vielleicht ist das überraschendste Ergebnis der neuen Studie die relativ geringe Überschneidung in den Ergebnisqualitäten/Typen zwischen Googles (oben genannten) drei Suchplattformen.

Die Studie zeigt wiederholt, dass reguläre Google-Suche, KI-Zusammenfassungen und Gemini (LLM) auffallend unterschiedliche Quellen für dieselbe Anfrage abrufen, mit Überschneidungswerten, die so niedrig sind, dass sie drei konkurrierende Abruflogiken innerhalb eines Unternehmens implizieren, während Benutzer annehmen könnten, dass Google einen autoritativen Index und eine Ranglistephilosophie hat:

Auch innerhalb von Googles eigenem Ökosystem erwies sich die Überschneidung zwischen traditioneller Suche, KI-Zusammenfassungen und Gemini als überraschend gering, wobei dieselbe Anfrage oft wesentlich unterschiedliche Quellisten produzierte, je nachdem, welches Google-System die Anfrage bearbeitete.

In Bezug auf diesen Teil ihrer Analyse bemerken die Autoren:

‘[Die Tabelle oben] zeigt die durchschnittliche Ähnlichkeit zwischen den Quellisten, die von der KI-Zusammenfassung, Gemini und traditioneller SERP für jede Anfrage im Benchmark-Datensatz abgerufen werden.

‘Das wichtigste Ergebnis ist, dass unabhängig von der Anfrage-Teilmenge und dem Vergleich von zwei Suchmaschinen die abgerufenen Listen unähnlich sind, obwohl alle drei von Google entwickelt wurden.’

Die Forscher bemerken weiter, dass keine Suchmethode, die getestet wurde, einen Rang-biased-Überschneidung (RBO) über 0,27 hatte, was ein sehr niedriger Wert ist. Sie bemerken weiter, dass Amazon-Retail und lokalisierte Anfragen (d. h. ‘Shops in der Nähe’) die geringste Ähnlichkeit zwischen den Suchmethoden aufwiesen.

Sie führen die geringe Übereinstimmung auf grundlegende ‘Inkonsistenzen zwischen Suchmaschinen’ zurück, indem sie bemerken, dass weder Zufall noch ein anderer offensichtlicher Faktor diese Diskrepanz erklären kann.

Eine intuitive Erklärung ist möglicherweise, dass Trainingsdatenpunkte auf eine sehr unterschiedliche Weise als die Methoden, die Google für PageRank und seine Nachfolger in den letzten zwei Jahrzehnten entwickelt hat, bewertet werden. Darüber hinaus ist es, wenn Googles Suchalgorithmus eine geheime Agenda hat, sehr viel schwieriger, Gemini konsistent zu handhaben, selbst durch Filterung, Systemanweisungen und die verschiedenen anderen Methoden, die auf kommerzielle Modelle aufgezwungen werden.

Selbstbedienung..?

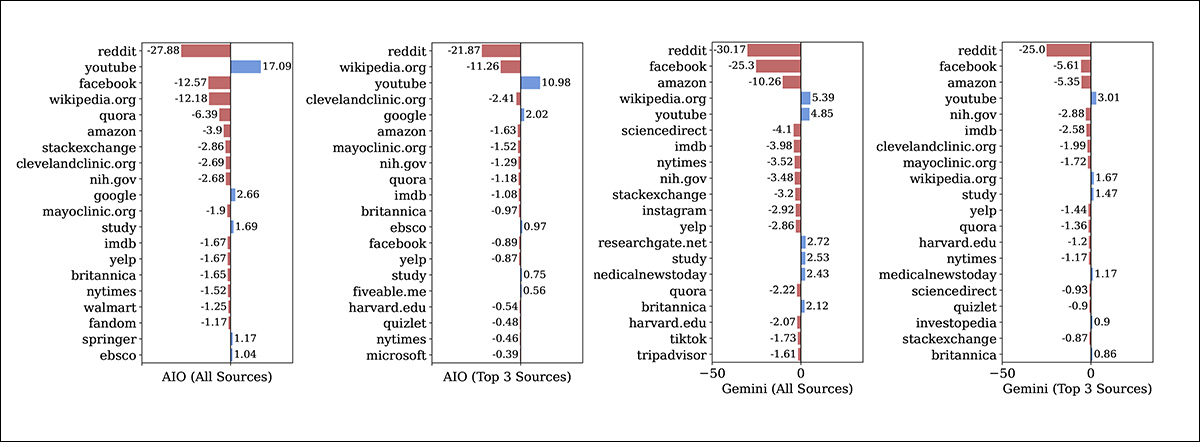

Bestimmte Websites oder Kategorien von Websites scheinen von der Einführung von KI-Zusammenfassungen und dem Eindringen von LLM-basierten Suchen in den traditionellen Suchraum betroffen zu sein – sowohl positiv als auch negativ, je nach Fall:

Im Vergleich zur traditionellen Google-Suche reduzierten KI-Zusammenfassungen und Gemini die Zitate von vielen großen Websites, während sie die Sichtbarkeit für eine kleine Anzahl bevorzugter Domänen erhöhten.

Die Autoren bemerken, dass einige unerwartete Präferenzen unter den drei Methoden während der Tests auftauchen:

‘Wir haben drei Hauptergebnisse aus [den Grafiken oben]. Erstens sind große und bekannte Websites am stärksten betroffen (sowohl positiv als auch negativ). Dies ist intuitiv, da große Websites den Ruf und die Vielfalt an Inhalten haben, um für viele verschiedene Anfragen relevant zu sein.

‘Zweitens erhalten die meisten dieser Websites weniger Gesamtzitate und weniger Top-3-Zitate durch generative Suchmaschinen (angezeigt durch rote Balken und negative Zahlen in [den Grafiken oben]). Dies deutet darauf hin, dass generative Suche tendenziell Informationen aus mehr Nischenquellen bezieht als traditionelle Suchmaschinen.

‘Drittens bevorzugen Googles KI-Zusammenfassungen Google-Websites (d. h. google.com- und youtube.com-Domänen).

‘Gemini bevorzugt YouTube im Vergleich zur traditionellen Google-Suche, aber der absolute Unterschied ist geringer.’

Gibt es ‘Blockierer’..?

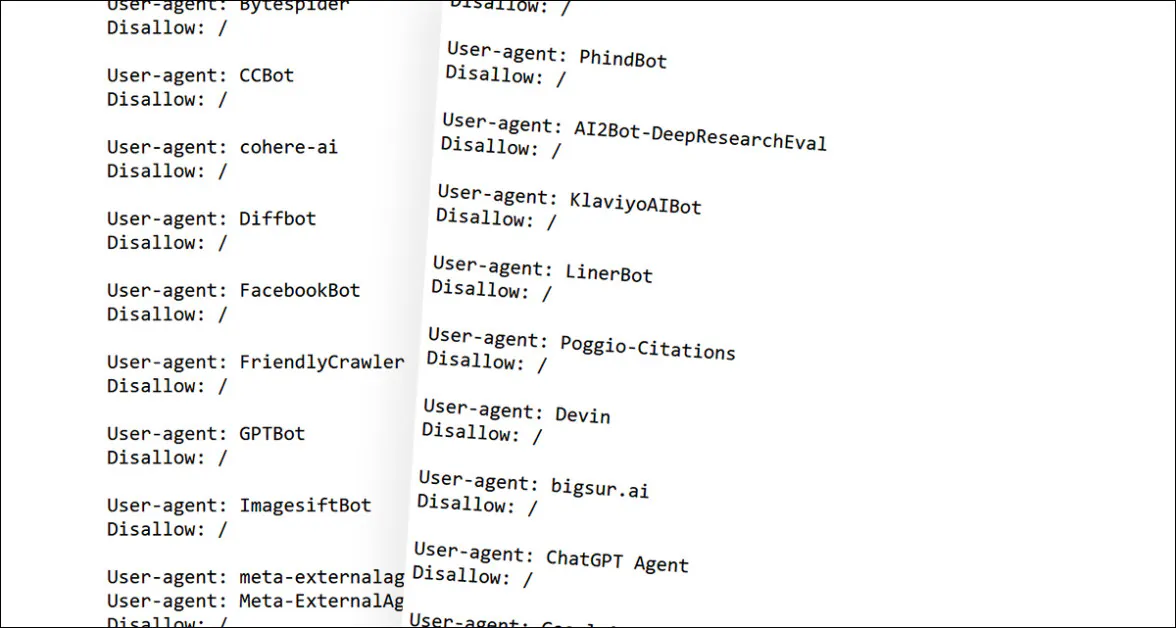

Die Studie fand auch heraus, dass Verleger, die Googles KI-Web-Crawler blockieren – den automatischen Web-Bot, der Daten von Ihrer Website sammelt, es sei denn, Sie sagen ihm, dass er dies nicht tun soll, mit einer robots.txt-Datei – tendenziell nicht in KI-Zusammenfassungen aufgeführt werden.

Dies mag wie ein offensichtlich selbst zugefügter Schaden erscheinen, aber tatsächlich hat Google öffentlich erklärt, dass Inhalte von Plattformen, die KI-Crawler blockieren, nicht daran gehindert werden, in KI-Zusammenfassungen aufgeführt zu werden; stattdessen werden die Verleger einfach nicht ihre Daten gesammelt, kuratiert und in eine Sammlung aufgenommen und nicht in die nächste Runde des KI-Trainings für Gemini und andere Google-KI-Projekte aufgenommen.

Die Autoren bemerken jedoch, dass beliebte KI-Blockierer-Verleger sehr selten von Gemini zitiert werden, entweder in der LLM oder in der gestripten und agileren Suchergebnis-Inkarnation. Die ‘effektiv blockierten’ Verleger wurden in der Studie als NYTimes, CNN, BBC, ScienceDirect, Reuters, Wiley, Nature, ESPN, Business Insider, CNBC, NPR, WIRED, USA Today, NBC News, Genius, National Geographic, The Conversation, U.S. News & World Report, Scientific American, Consumer Reports und STAT aufgeführt.

Einige der von den oben aufgeführten Verlegern vorgenommenen robots.txt-KI-Scraping-Blockierungen. Hat dies zu einer weiteren Zensur durch Google geführt?

Die Autoren bemerken:

‘In unserer Analyse der am stärksten betroffenen Domänen fanden wir, dass 21 beliebte [Verleger] (die für mindestens 20 eindeutige Anfragen von Google-Suche und KI-Zusammenfassungen abgerufen werden) nie von Gemini zitiert wurden.

‘Mehrere beliebte soziale Medien (Facebook, Instagram, Tiktok) und Bewertungs-Websites (IMDb, Yelp, Tripadvisor) erhielten auch keine Zitate von Gemini. Bei weiterer Untersuchung fanden wir heraus, dass alle diese Websites den Google-Extended-Bot in ihren robots.txt-Dateien blockieren.’

Wenn diese Erkenntnis sich als verifiziert und anhaltend erweist, könnte man spekulieren, dass diese Unternehmen möglicherweise von Google unter Druck gesetzt werden, um ihre KI-Operationen zu unterstützen, indem sie teilweise von der Liste entfernt werden. Auf den ersten Blick scheinen die Ergebnisse bestrafend zu sein, aber die Erkenntnisse der neuen Studie deuten eher auf Chaos als auf Vorsatz hin; daher ist der einzige vernünftige Kommentar, den man machen kann, dass diese Ergebnisse oberflächlich ‘rachsüchtig’ erscheinen, egal was wirklich dahinter steckt.

Schlussfolgerung

Meinung Dies ist eine klare und umfassende Zip-Bombe einer Studie, deren zehn Hauptseiten sich zu einer fast überwältigenden Kaskade von zusätzlichen Erkenntnissen entfalten. Da wir nur einen kleinen Teil davon abdecken konnten, empfehle ich das Quell-PDF sogar dem gelegentlichen Leser (ein seltenes Ereignis).

Obwohl eine ‘gelbe’ Disposition viele negative Interpretationen der Autorenentdeckungen hervorrufen könnte, ist die Arbeit möglicherweise am besten als Hinweis darauf zu betrachten, dass ein globaler Technologieführer versucht, eine globale Führung in der KI-basierten Suche zu erlangen und beizubehalten, indem er hochkontrastierende Plattformen verwendet, die unter sehr unterschiedlichen Umständen und in verschiedenen Epochen entwickelt wurden.

Während in der Studie drei Suchmethoden untersucht werden, besteht die eigentliche Auseinandersetzung zwischen traditionellen Suchmaschinen-Ergebnissen, die durch proprietäre Methoden rangiert werden, und den scharf kontrastierenden distributionsbasierten Auswahlmethoden, die die Datenkuratierung und KI-Trainings dominieren.

KI wie 1999

Bevor Google aufkam, war es möglich, Suchergebnisse durch reine Menge zu ‘manipulieren’ und auf diese Weise oft mit minimalem (häufig automatisiertem) Aufwand eine Platzierung auf der ersten SERP-Seite zu erreichen. Dieses ‘Zahlen-Spiel’ wurde effektiv um 2002 durch Googles komplexeres und geheimes Suchrankings-Algorithmus beendet. Aber da die Einsätze hoch waren, verschwand der niedrigwertige Inhalt nie in irgendeiner bedeutenden Weise.

Daher war es, als hyperskalige Sammlungen wie Common Crawl die Grundlagen der modernen KI-Revolution legten, war die Datenprominenz dazu bestimmt, von dem Ausmaß abhängig zu sein, in dem automatisierte Prozesse filtern und die Qualität der eingehenden Daten bewerten konnten, und (viel weniger wahrscheinlich) von dem Ausmaß, in dem Geld verfügbar war, um Menschen zu bezahlen, um diese Daten zu bewerten.

Es gab viele schlechte oder minderwertige Daten in diesen riesigen und undiskriminierenden Sammlungen; Daten, die möglicherweise keine Obszönitäten, Flüche, rassistische Klischees oder andere Dinge enthielten, die relativ einfach aus Trainingsdatensätzen zu filtern sind – aber die dennoch selbstsüchtig und umfangreich waren, genau wie die Ergebnisse aus Internet-Suchen um 1999-2001.

Weil diese Dateninduktionsprozesse nach wie vor nicht großartig sind, ist es sogar für Google sehr schwierig, KI dazu zu bringen, geschäftsmäßig zu handeln, da Geminis PageRank-ähnliche Entscheidungen nicht von Googles Richtlinien-Ingenieuren diktiert werden, sondern von einem unvollkommenen Verständnis davon, wie hyperskalige Daten in Datenverteilungen und latente Einbettungen während des KI-Trainings umgewandelt werden.

* Suchmaschinen-Ergebnisseiten.

† Autoren-Betonung, nicht meine. Ich habe jedoch fett für kursiv ersetzt, da kursiver Beton nicht gut in Anführungszeichen funktioniert, die hauptsächlich kursiv sind.

Erstveröffentlicht am Mittwoch, dem 13. Mai 2026