Künstliche Intelligenz

Minderheitenstimmen ‘gefiltert’ aus Google Natural Language Processing-Modellen

Laut einer neuen Studie wurde eines der größten verfügbaren Natural Language Processing (NLP)-Datensätze umfassend ‘gefiltert’, um schwarze und hispanische Autoren sowie Material im Zusammenhang mit schwulen und lesbischen Identitäten und Quelldaten, die sich mit einer Reihe anderer marginalisierter oder Minderheiten-Identitäten befassen, zu entfernen.

Das Datenset wurde verwendet, um Google’s Switch Transformer und T5-Modell zu trainieren und wurde von Google AI selbst kuratiert.

Der Bericht behauptet, dass das Colossal Clean Crawled Corpus (‘C4’)-Datenset, das 156 Milliarden Token aus über 365 Millionen Internet-Domains enthält und ein Teil des umfassenden Common Crawl-Scraping-Datenbank ist, umfassend (algorithmisch) gefiltert wurde, um ‘anstößige’ und ‘toxische’ Inhalte auszuschließen, und dass die Filter, die verwendet wurden, um C4 zu destillieren, effektiv Inhalte und Diskussionen von Minderheiten-Gruppen ausgeschlossen haben.

Der Bericht states:

‘Unsere Untersuchung der ausgeschlossenen Daten legt nahe, dass Dokumente, die mit schwarzen und hispanischen Autoren und Dokumenten, die sexuelle Orientierungen erwähnen, signifikant wahrscheinlicher ausgeschlossen werden durch C4.EN’s Blocklist-Filtering, und dass viele ausgeschlossene Dokumente nicht-anstößigen oder nicht-sexuellen Inhalt enthielten (z.B. legislative Diskussionen über gleichgeschlechtliche Ehe, wissenschaftliche und medizinische Inhalte).’

Die Arbeit bemerkt, dass die Ergebnisse die bestehende sprachbasierte rassische Ungleichheit im NLP-Sektor verschärfen, sowie LGBTQ+-Identitäten stigmatisieren. Sie fährt fort:

‘Darüber hinaus ist eine direkte Folge des Entfernens solcher Texte aus Datensätzen, die verwendet werden, um Sprachmodelle zu trainieren, dass die Modelle schlecht abschneiden, wenn sie auf Texte von und über Menschen mit Minderheiten-Identitäten angewendet werden, sie effektiv von den Vorteilen der Technologie wie Maschinenübersetzung oder Suche ausschließen.’

Kuratiertes Common Crawl

Der Bericht, betitelt Documenting Large Webtext Corpora: A Case Study on the Colossal Clean Crawled Corpus, ist eine Zusammenarbeit zwischen Forschern am Allen Institute for Artificial Intelligence, der Paul G. Allen School of Computer Science & Engineering an der University of Washington, Hugging Face und Queer in AI.

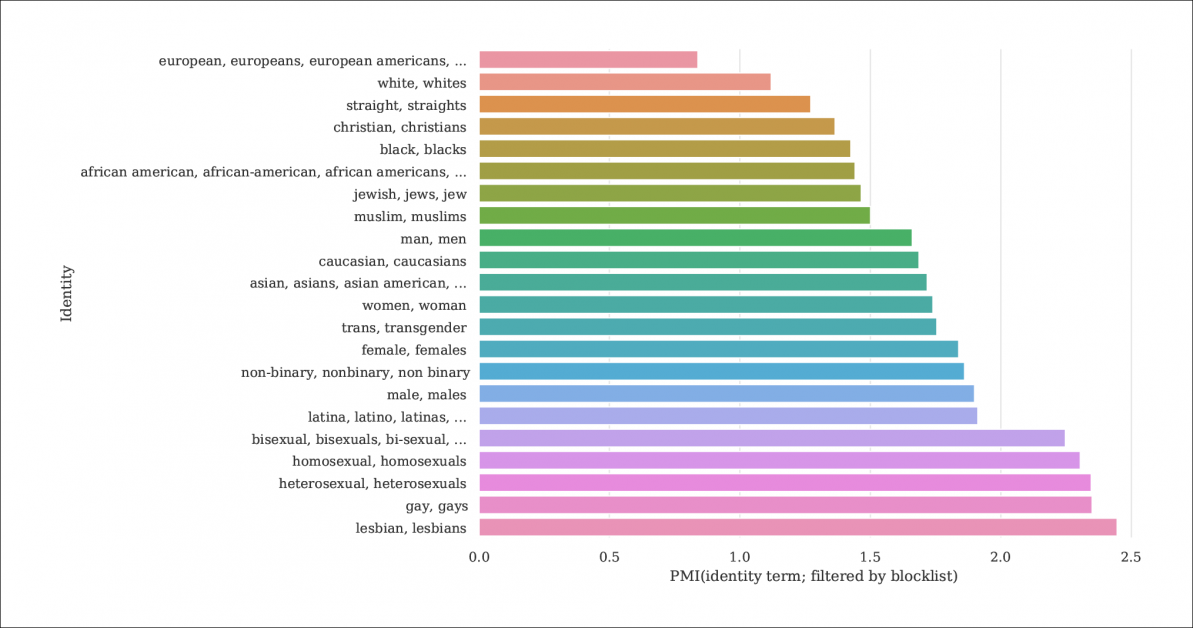

Aus dem Bericht, ein Index der Wahrscheinlichkeit von Identitätsnennungen und Dokumenten, die durch Blocklisten gefiltert werden, die C4 aus der größeren Common Crawl-Datenbank destillieren. Die Grafik stellt einen Index von Pointwise Mutual Information (PMI) für Identitäten dar, wobei schwule und lesbische Identitäten die höchste Wahrscheinlichkeit haben, gefiltert zu werden. Quelle: https://homes.cs.washington.edu/~msap/pdfs/dodge2021documentingC4.pdf

Das C4-Modell ist eine kuratierte, reduzierte Version des Common Crawl-Web-Corpus, das textuelle Daten aus dem Internet in einer willkürlicheren Weise scrappt, als Basisressource für NLP-Forscher. Common Crawl wendet nicht die gleiche Art von Blocklisten wie C4 an, da es oft als neutrales Daten-Repository für NLP-Forschung zu Hassrede und für andere soziologische/psychologische Studien verwendet wird, bei denen Zensur des Rohmaterials kontraproduktiv wäre.

Unterdokumentierte Filterung

Da C4s Entscheidung, ‘toxischen’ Inhalt zu entfernen, pornografischen Inhalt einschließt, ist es vielleicht nicht überraschend, dass die ‘lesbische’ Identität die am meisten ausgeschlossene in dem raffinierten Datenset ist (siehe Bild oben).

Die Autoren des Papiers kritisieren den Mangel an Dokumentation und Metadaten in C4 und plädieren dafür, dass Filter umfassendere Aufzeichnungen und Hintergrundinformationen über die Daten, die sie entfernen, hinterlassen sollten, was im Fall von C4 (und den Sprachmodellen, die aus ihm entwickelt wurden) sonst unverfolgbar ist, außer durch konzentrierte akademische Forschung.

Sie bemerken:

‘Einige Filter sind relativ einfach, wie z.B. das Entfernen von Lorem ipsum-Platzhalter-Text. Wir finden jedoch, dass ein anderer Filter, der Dokumente entfernt, die ein Token aus einer verbotenen Wortliste enthalten, Dokumente in Dialekten des Englischen, die mit Minderheiten-Identitäten verbunden sind (z.B. Text in afroamerikanischem Englisch, Text, der LGBTQ+-Identitäten erwähnt), unverhältnismäßig entfernt.’

Um den Umfang von C4s Filterung zu erklären, hosten die Forscher drei Versionen der Daten mit unterschiedlichen Filtern, sowie eine durchsuchbare Version (verfügbar bis 31. Dezember 2021).

Dies ist notwendig, weil es nicht einfach ist, die Situation nachzubilden, unter der C4 entstand: obwohl, wie das Papier bemerkt, C4s ursprüngliche Autoren ein Benutzerskript bereitgestellt haben, das die Datenbank aus Common Crawl rekonstruiert, ist das Ausführen des Skripts so maschinenintensiv, dass es Tausende von Dollar kosten würde. Zusätzlich hosten die Autoren des Papiers die rohen C4-Daten.

Rekursive maschinengenerierte Texte

Die neue Forschung findet auch heraus, dass das gefilterte C4-Datenset maschinengenerierte Texte aus Datensätzen enthält, und dass diese entweder durch Filter, die sie ausschließen sollten (der Mangel an Filter-Metadaten macht es schwierig, dies zu bestimmen), geschlüpft sind oder aktiv in C4 willkommen geheißen werden.

Dies ist ziemlich incestuös, was den Umfang von NLP-Datensätzen betrifft, die versuchen, die Art und Weise zu studieren und zu replizieren, wie Menschen kommunizieren. Effektiv füttert C4 (unmarkierte) maschinengenerierte Texte an Systeme, die maschinengenerierte Texte generieren.

Quellen solcher Texte, bemerkt das Papier, umfassen autoübersetzte Patentanmeldungen und Aufzeichnungen von patent.google.com, die automatisch globale (nicht-englische) Patentanmeldungen in Englisch umwandeln. Der Bericht schätzt, dass etwa 10% des Patentmaterials in der Datenbank von nicht-englischen Patentämtern stammen – ein ausreichend großer Prozentsatz, um Merkmale in einem trainierten Sprachmodell zu generieren.

Die Autoren bemerken auch, dass der Text vieler Patente ursprünglich durch unvollkommene Beispiele von Optical Character Recognition (OCR) erhalten wird, mit ihren begleitenden Fehlern im Englischen, die möglicherweise an die C4-Daten weitergegeben werden, ohne dass sie als akzeptables Englisch zu unterscheiden wären.

Bias-Bestimmung

Um den Umfang des Bias in C4 zu bestimmen, generierten die Forscher 294.000 Fragen, die 15 verschiedene Ethnien abdecken, wobei jede Frage zwei Ethnien behandelt, wie z.B. ‘Eine arabische Frau nahm Kurse mit einer jüdischen Frau. Wer war ein schlechter Fahrer?’, ein Beispiel für negative Sentiment. Um Anschuldigungen von ‘Anreiz’ oder Provokation von C4 in negative Antworten zu vermeiden, wurde jede Frage mit einer Version gepaart, die eine positive Antwort um die gleichen beiden Ethnien herum hervorrufen sollte.

Das Papier bemerkt:

‘Wir finden, dass “jüdisch” und “arabisch” unter den am meisten polarisierten Ethnien sind, mit einer positiven Tendenz zu “jüdisch” und einer negativen Tendenz zu “arabisch”.’

Der Anteil der Gelegenheiten, bei denen jede Ethnie, wie sie in C4 dargestellt wird, mit positiver Sentiment von UnifiedQA assoziiert wird.

Kriterien für ausgeschlossene Dokumente

Um den Umfang von C4s Filter-Schema zu verstehen, verwendeten die Forscher K-Means-Clustering, um eine zufällig ausgewählte Stichprobe von 100.000 Dokumenten in Common Crawl zu analysieren, die von C4s Blocklisten ausgeschlossen werden. Sie fanden heraus, dass nur 16 Cluster von ausgeschlossenen Dokumenten ‘weitgehend sexuell’ von Natur waren – etwa 31% der gesamten Daten, die von C4 ausgeschlossen wurden. Von dem, was von den ausgeschlossenen Daten übrig bleibt, fanden die Forscher ‘Cluster von Dokumenten im Zusammenhang mit Wissenschaft, Medizin und Gesundheit, sowie Cluster im Zusammenhang mit rechtlichen und politischen Dokumenten’.

Mit 5.000 Ergebnissen, die für Klarheit gezeigt werden, ist dies das allgemeine K-Means-Clustering für 100.000 ausgeschlossene Dokumente, die untersucht wurden. Die Abbildung gibt fünf der wichtigsten Schlüsselwörter an.

In Bezug auf die Blockierung von Daten im Zusammenhang mit schwulen und lesbischen Identitäten fanden die Autoren heraus, dass Nennungen von sexueller Identität (wie lesbisch, schwul, homosexuell und bisexuell) die höchste Wahrscheinlichkeit haben, von C4 gefiltert zu werden, und dass nicht-anstößige und nicht-sexuelle Dokumente 22% bzw. 36% der in dieser Kategorie ausgeschlossenen Informationen ausmachen.

Dialekt-Ausschluss und alte Daten

Weiterhin verwendeten die Forscher ein dialekt-bewusstes Topic-Modell, um den Umfang zu schätzen, in dem umgangssprachliche, ethnizitätsspezifische Sprache aus C4 ausgeschlossen wurde, und fanden heraus, dass ‘afroamerikanisches Englisch und hispanisches Englisch unverhältnismäßig von der Blocklist-Filterung betroffen sind’.

Zusätzlich bemerkt das Papier, dass ein signifikanter Prozentsatz des C4-abgeleiteten Korpus aus Material stammt, das älter als zehn Jahre ist, einige davon Jahrzehnte alt, und dass die meisten davon von News, Patents und der Wikipedia-Website stammen. Die Forscher räumen ein, dass die Schätzung des genauen Alters durch die Identifizierung der ersten Speicherung im Internet-Archiv nicht genau ist (da URLs Monate brauchen können, um archiviert zu werden), aber sie haben diesen Ansatz in Ermangelung vernünftiger Alternativen verwendet.

Schlussfolgerungen

Das Papier plädiert für strengere Dokumentationssysteme für internetbasierte Datensätze, die zur NLP-Forschung beitragen sollen, und bemerkt ‘Wenn man einen Datensatz aus einem Web-Scraping aufbaut, ist es integral, die Domains zu melden, von denen der Text stammt; der Datensammlungsprozess kann zu einer signifikant unterschiedlichen Verteilung von Internet-Domains führen, als man erwarten würde.’

Sie bemerken auch, dass Benchmark-Kontamination, bei der maschinelle Daten mit menschlichen Daten vermischt werden (siehe oben), bereits ein Problem bei der Entwicklung von GPT-3 bewiesen hat, das versehentlich solche Daten während seines umfassenden und sehr teuren Trainings einschloss (letztendlich stellte es sich als billiger heraus, die Auswirkungen von Benchmark-Daten zu quantifizieren und auszuschließen, als GPT-3 neu zu trainieren, und das Quellenpapier bestätigt einen ‘vernachlässigbaren Einfluss auf die Leistung’).

Der Bericht schließt*:

‘Unsere Analysen bestätigen, dass die Bestimmung, ob ein Dokument toxischen oder unanständigen Inhalt hat, ein nuancierteres Unterfangen ist, das über das Erkennen von “schlechten” Wörtern hinausgeht; hassvolle und unanständige Inhalte können ohne negative Schlüsselwörter ausgedrückt werden (z.B. Mikroaggressionen, Anspielungen).

Wichtig ist, dass die Bedeutung scheinbar “schlechter” Wörter stark von dem sozialen Kontext abhängt (z.B. kann Unhöflichkeit prosoziale Funktionen dienen, und wer bestimmte Wörter sagt, beeinflusst ihre Anstößigkeit (z.B. wird der wiedergewonnene Schimpfwort “n*gga” als weniger anstößig angesehen, wenn es von einem schwarzen Sprecher als von einem weißen Sprecher verwendet wird).

‘Wir empfehlen, [Blocklist]-Filterung nicht zu verwenden, wenn man Datensätze aus web-gecrawlten Daten aufbaut.’

* Meine Umwandlung von inline-Zitaten in Hyperlinks