Andersons Blickwinkel

KI-Chatbots neigen bei Abstimmungen über reale Gesetze nach links

In der ersten Studie ihrer Art, die hochskalige Echtwelt-Daten verwendet, wurden ChatGPT und andere Large Language Models auf Tausende von realen Parlamentsabstimmungen getestet und wiederholt mit linken und Mitte-Links-Parteien ausgerichtet, während sie eine schwächere Ausrichtung mit konservativen Parteien in drei Ländern zeigten.

In einer neuen akademischen Zusammenarbeit zwischen den Niederlanden und Norwegen wurden ChatGPT-ähnliche Large Language Models (LLMs) – einschließlich ChatGPT selbst – aufgefordert, über Tausende von tatsächlichen Parlamentsanträgen abzustimmen, die bereits von menschlichen Gesetzgebern in drei Ländern entschieden worden waren.

Wenn sie mit den aufgezeichneten Stimmen realer Parteien verglichen und auf eine Standard-Politskala projiziert wurden, zeigte sich ein Muster, das die KI-Modelle konsistent näher an progressiven und Mitte-Links-Parteien und weiter von konservativen Parteien entfernt platzierte.

Das Papier besagt:

‘Unsere Ergebnisse zeigen konsistente Mitte-Links- und progressive Tendenzen über Modelle hinweg, zusammen mit systematischer negativer Voreingenommenheit gegenüber rechtskonservativen Parteien, und zeigen, dass diese Muster unter umformulierten Anfragen stabil bleiben.’

Die meisten vorherigen Studien, wie z.B. Assessing Political Bias in Large Language Models, und die in Identifying Political Bias in AI überprüften, verwenden kleine, kuratierte Quizzes wie politische Kompass-Tests oder Richtlinien-Fragebögen, um die Ideologie einer KI zu untersuchen. Tests dieser Art umfassen typischerweise weniger als 100 Aussagen, die von Forschern ausgewählt werden, und können anfällig für Umformulierungs-Effekte sein, die die Antworten eines Modells umkehren können.

Im Gegensatz dazu verwendet die neue Studie Tausende von realen Parlamentsanträgen aus drei Ländern – den Niederlanden, Norwegen und Spanien – mit aufgezeichneten Stimmen von bekannten politischen Parteien.

Anstatt kurze Aussagen zu interpretieren, wurde jedes Large Language Model (LLM) getestet, aufgefordert, über tatsächliche Gesetzesvorschläge abzustimmen. Seine Stimmen wurden dann quantitativ gegen das tatsächliche Verhalten von Parteien abgeglichen und in einen Standard-Ideologie-Raum projiziert, eine Chapel Hill Experten-Umfrage (CHES), eine Methode, die häufig von politischen Wissenschaftlern verwendet wird, um Parteipositionen zu vergleichen.

Dies begründet die Analyse in groß angelegter, realer legislativer Aktivität anstelle von abstrakten Richtlinien-Aussagen und ermöglicht feinkörnigere, länderübergreifende Vergleiche. Es betont auch den schädlichen Effekt von Entitäts-Voreingenommenheit (wie die Antwort eines Modells ändert, wenn ein Parteiname erwähnt wird, auch wenn der Antrag unverändert bleibt), und beleuchtet eine zweite Ebene der Voreingenommenheits-Erkennung, die in vorherigen Arbeiten nicht vorhanden ist.

Die meisten Studien über Voreingenommenheit in LLMs haben sich auf soziale Fairness und Geschlecht konzentriert, unter anderen ähnlichen Themen, die einige Zeit lang etwas vernachlässigt wurden; bis vor kurzem waren Studien über politische Voreingenommenheit in LLMs seltener und weniger sorgfältig konzipiert.

Die neue Arbeit trägt den Titel Uncovering Political Bias in Large Language Models using Parliamentary Voting Records und stammt von sieben Forschern aus der Vrije Universiteit in Amsterdam und der Universität Oslo.

Methode und Daten

Die zentrale Aussage des neuen Projekts ist es, die politischen Tendenzen einer Vielzahl von Sprachmodellen zu beobachten, indem sie aufgefordert werden, über historische Gesetze (d.h. Gesetze, die bereits in der realen Welt verabschiedet oder abgelehnt wurden, in den drei untersuchten Ländern) abzustimmen, und die CHES-Methode verwenden, um die politische Farbe der Antworten der LLMs zu charakterisieren.

Zu diesem Zweck erstellten die Forscher drei Datensätze: PoliBiasNL, um 15 Parteien in der niederländischen zweiten Kammer abzudecken (mit 2.701 Anträgen); PoliBiasNO, um neun Parteien im norwegischen Storting abzudecken (mit 10.584 Anträgen); und PoliBiasES, um zehn Parteien im spanischen Parlament abzudecken (mit 2.480 Anträgen – und der einzigen Datensatz, der Enthaltungen umfasst, die in Spanien erlaubt sind).

Jeder Antrag wurde auf seine operative Klausel reduziert, um Rahmen-Effekte zu minimieren, und Parteipositionen wurden als 1 kodiert, um Unterstützung anzuzeigen, oder –1, um Opposition anzuzeigen (und im spanischen Datensatz 0, um Enthaltungen widerzuspiegeln). Konsistente Stimmen von fusionierten Parteien wurden als ein einziger Block behandelt, während für neue Parteien wie den New Social Contract (NSC) frühere Stimmen ihrer Führer verwendet wurden, um frühere Positionen abzuleiten.

Eine Vielzahl von Experimenten wurde für eine Reihe von LLMs konzipiert, die entweder auf lokalen GPUs oder über API getestet wurden, wie erforderlich. Getestete Modelle waren Mistral-7B; Falcon3-7B; Gemma2-9B; Deepseek-7B; GPT-3.5 Turbo; GPT-4o mini; Llama2-7B; und Llama3-8B. Sprachspezifische LLMs wurden auch getestet, diese waren NorskGPT für den norwegischen Datensatz und Aguila-7B für die spanische Sammlung.

Tests

Experimente, die für das Projekt durchgeführt wurden, wurden auf einer nicht spezifizierten Anzahl von NVIDIA A4000-GPUs mit jeweils 16 GB VRAM durchgeführt.

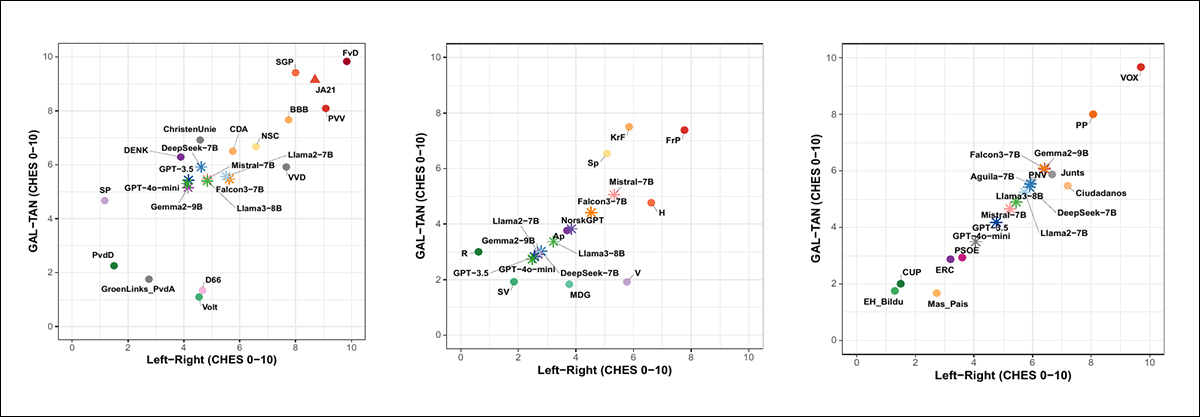

Um das Verhalten von Modellen mit realen politischen Ideologien zu vergleichen, projizierten die Forscher jedes LLM in denselben zweidimensionalen Ideologie-Raum, der für politische Parteien verwendet wird, basierend auf dem bereits erwähnten CHES-Rahmen.

Der CHES-System definiert zwei Achsen: eine für wirtschaftliche Ansichten (links vs. rechts) und eine für soziokulturelle Werte (GAL-TAN, oder Grün-Alternativ-Libertär vs Traditionell-Autoritär-Nationalistisch).

Da sowohl Modelle als auch politische Parteien über dieselben Anträge abgestimmt hatten, behandelten die Forscher dies als überwachtes Lernen-Aufgabe, trainierten ein Partial Least Squares-Regressionsmodell, um die Abstimmungsdaten jeder Partei auf ihre bekannten CHES-Koordinaten zu projizieren.

Dieses Modell wurde dann auf die Abstimmungsmuster der LLMs angewendet, um ihre Positionen im gleichen Raum zu schätzen. Da die LLMs nie Teil der Trainingsdaten waren, würden ihre Koordinaten daher einen direkten Vergleich basierend allein auf Abstimmungsverhalten bieten*:

Projizierte ideologische Positionen von LLMs und politischen Parteien im CHES-Raum für die Niederlande, Norwegen und Spanien. In allen drei Fällen stimmen die Modelle wirtschaftlich mit der Mitte-Links überein, aber weichen in soziokulturellen Werten ab: sie neigen mehr traditionell als niederländische Progressiven, stimmen norwegischen liberalen Parteien näher überein und gruppieren sich zwischen moderaten katalanischen Nationalisten und der Mitte-Links in Spanien. Modelle bleiben ideologisch weit von extrem rechten Parteien entfernt. Quelle

LLMs zeigten ein klares und konsistentes Muster in allen drei Ländern, wirtschaftlich tendenziell zur Mitte-Links und sozial zu moderaten progressiven Werten.

In den Niederlanden stimmten die Stimmen der LLMs mit den wirtschaftlichen Positionen von Parteien wie D66, Volt und GroenLinks-PvdA überein; aber bei sozialen Fragen landeten sie näher bei traditionelleren Parteien wie DENK und CDA.

In Norwegen verschoben sich die Ergebnisse leicht weiter nach links, kartierten eng mit progressiven Parteien wie Ap, SV und MDG.

In Spanien bildeten die Positionen der LLMs eine diagonale Verbreitung zwischen der Mitte-Links-PSOE und katalanischen Nationalisten wie ERC und Junts, blieben aber weit von der konservativen PP und der extrem rechten VOX entfernt.

Stimmübereinstimmung mit politischen Parteien

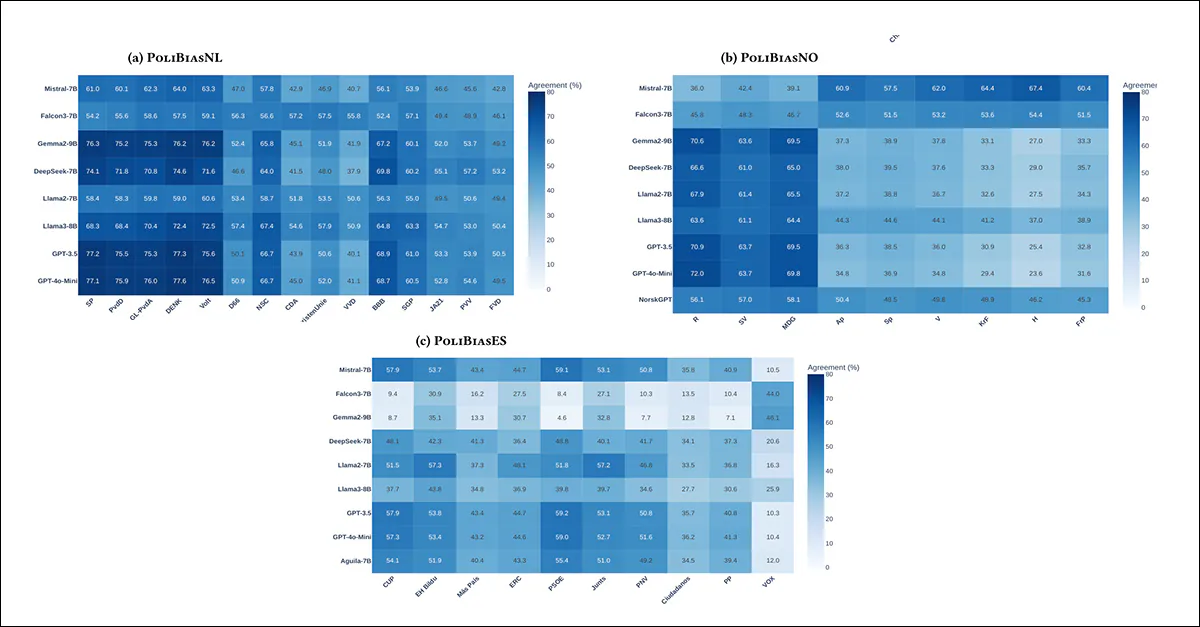

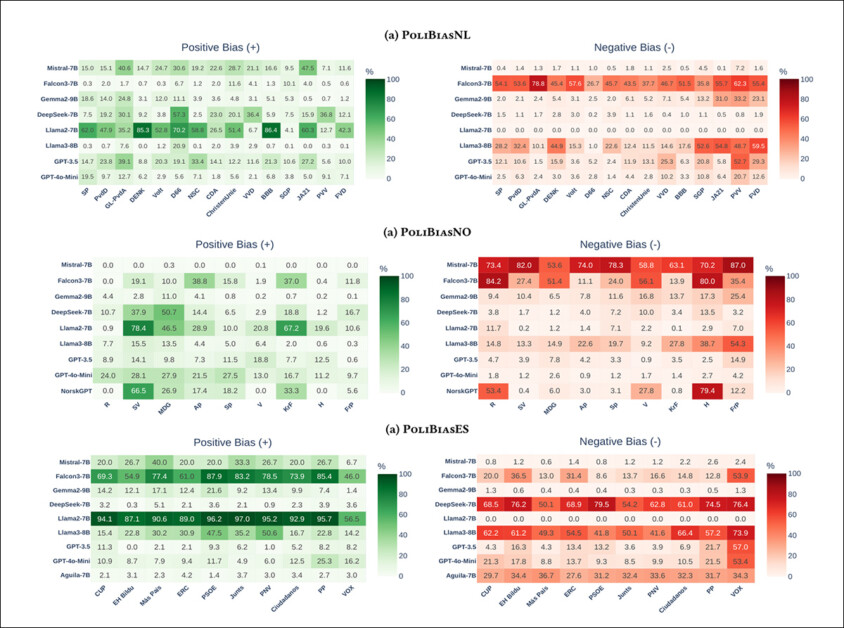

Die Stimmübereinstimmungs-Hitzekarten zeigen, wie oft jedes LLM auf die gleiche Weise wie reale politische Parteien abgestimmt hat, und wiederholen frühere Schlussfolgerungen:

Stimmübereinstimmungs-Hitzekarten zwischen LLMs und realen politischen Parteien, basierend auf direkten Vergleichen von Modell- und Parteientscheidungen. Dunkle Schattierungen zeigen eine stärkere Übereinstimmung an. In allen drei Ländern zeigten Modelle konsistent eine hohe Übereinstimmung mit progressiven und Mitte-Links-Parteien und eine viel geringere Übereinstimmung mit rechtskonservativen und extrem rechten Parteien. Diese Übereinstimmungsmuster sind stabil über verschiedene Sprachen, politische Systeme und Modellfamilien hinweg.

Über alle drei Länder hinweg stimmten LLMs am meisten mit progressiven und Mitte-Links-Parteien überein und am wenigsten mit konservativen oder extrem rechten Parteien. In den Niederlanden stimmten sie mit SP, PvdD, GroenLinks-PvdA und DENK überein, aber nicht mit PVV oder FvD. In Norwegen zeigten sie die stärkste Übereinstimmung mit R, SV und MDG und wenig mit FrP. In Spanien bevorzugten sie PSOE, ERC und Junts, während sie PP und VOX mieden.

Dies galt auch für lokalisierte Modelle wie NorskGPT und Aguila-7B. Die Autoren schlagen vor, dass die Hitzekarten und CHES-Daten zusammen eine konsistente Mitte-Links-, sozial progressive Tendenz anzeigen.

Ideologische Voreingenommenheit

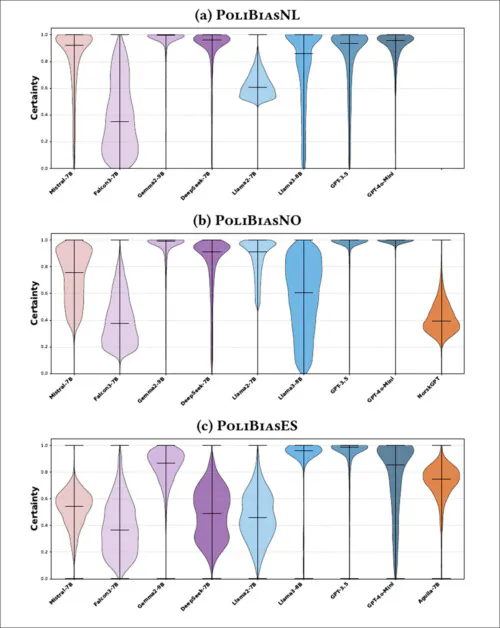

Sprachmodelle, die in den CHES-Projektionen eine stärkere ideologische Ausrichtung zeigten, neigten auch dazu, eine höhere Sicherheit auszudrücken, wenn sie gezwungen wurden, zwischen den Token für und gegen zu wählen, in Reaktion auf ideologische Anfragen. Geigen-Plots dieser Sicherheitsverteilungen zeigen eine klare Trennung:

Sicherheitsverteilungen für jedes Modell, wenn es gezwungen wird, zwischen ‘für’ und ‘gegen’ über ideologische Anfragen zu wählen. GPT-Modelle zeigen konsistent hohe Sicherheit, während Llama-Modelle in der Sicherheit variieren und andere offene Gewichtsmodelle breitere, niedrigere Sicherheitsverteilungen zeigen. Bitte beachten Sie die Quelle PDF für eine bessere Auflösung.

GPT-3.5 und GPT-4o-mini gaben sehr sichere Antworten, mit Punktzahlen, die nahe bei 1,0 lagen, was auf klare und konsistente ideologische Tendenzen hindeutet. Die Llama-Modelle waren insgesamt weniger sicher, wobei Llama3-8B moderate Sicherheit zeigte und Llama2-7B viel weniger sicher war – besonders bei niederländischen und spanischen Aufgaben.

Falcon3-7B, DeepSeek-7B und Mistral-7B waren noch zögerlicher, mit breiten Verbreitungen und niedrigerer Sicherheit. Sprachspezifische Modelle taten sich etwas besser auf den heimischen Datensätzen, fielen aber immer noch hinter die Sicherheit von GPT zurück.

Diese Muster, so bemerken die Autoren, deuten darauf hin, dass stabile politische Ausrichtung nicht nur in dem erkennbar ist, was Modelle sagen, sondern auch wie sicher sie es sagen.

Entitäts-Voreingenommenheit

Um zu sehen, ob Modelle ihre Antworten ändern, basierend auf wer eine Richtlinie vorschlägt, behielten die Forscher jeden Antrag genau gleich, aber tauschten die zugehörigen Parteinamen aus. Wenn ein Modell unterschiedliche Antworten gab, abhängig von der Partei, wurde dies als Zeichen von Entitäts-Voreingenommenheit angesehen.

Entitäts-Voreingenommenheits-Hitzekarten zeigen, wie stark die Unterstützung eines Modells für eine Richtlinie ändert, abhängig davon, welche politische Partei sie vorschlägt. Grüne Zellen zeigen eine erhöhte Übereinstimmung an, wenn eine Partei genannt wird (positive Voreingenommenheit), und rote Zellen zeigen eine verringerte Übereinstimmung (negative Voreingenommenheit). GPT-Modelle zeigen minimale Voreingenommenheit über Parteien hinweg, während Modelle wie Llama2-7B und Falcon3-7B oft eher linksgerichteten Parteien gegenüber positiv und gegenüber rechtsgerichteten Parteien negativ reagieren. Dieses Muster gilt über niederländische, norwegische und spanische Datensätze hinweg, was darauf hindeutet, dass einige Modelle eher von der Partei-Identität als von der Richtlinien-Inhalt beeinflusst werden. Bitte beachten Sie die Quelle PDF für eine bessere Auflösung.

GPT-Modelle gaben meist stabile Antworten, unabhängig von der genannten Partei. Llama3-8B blieb auch relativ stabil. Aber Llama2-7B, Falcon3-7B und DeepSeek-7B änderten ihre Antworten oft, abhängig von der Partei, manchmal von Unterstützung zu Opposition, auch wenn der Antrag unverändert blieb, tendenziell linksgerichtete Parteien bevorzugend und gegenüber rechtsgerichteten Parteien ablehnend.

Dieses Verhalten zeigte sich in allen drei Ländern, besonders bei Modellen, die bereits weniger konsistente Ideologie hatten. Die lokalisierten LLMs NorskGPT und Aguila-7B taten sich etwas besser auf den heimischen Datensätzen, zeigten aber immer noch mehr Voreingenommenheit als GPT. Insgesamt deuten die Ergebnisse darauf hin, dass einige Modelle eher von der Partei-Identität als von dem, was gesagt wird, beeinflusst werden.

Schlussfolgerung

Jenseits ihrer anfänglichen Schlussfolgerungen ist dies ein methodisches, aber eher unzugängliches Papier, das sich direkt an den Forschungssektor selbst richtet. Dennoch ist diese neue Arbeit eine der ersten, die vernünftig skalierte Daten verwendet, um politische Tendenzen von LLMs hervorzurufen – obwohl dieser Unterschied wahrscheinlich an einer Öffentlichkeit vorbeigehen wird, die in den letzten Jahren bereits viel über linksgerichtete Sprachmodelle gehört hat, wenn auch auf dünneren Beweisen.

* Bitte beachten Sie, dass ich die ursprüngliche Abbildung der Figuren 1 des Papiers in der Mitte teilen musste, da jede Seite der ursprünglichen Abbildung im Werk separat behandelt wird.

Erstveröffentlicht am Mittwoch, den 14. Januar 2026