Künstliche Intelligenz

Ein Kartell einflussreicher Datensätze dominiert die Maschinenlernforschung, legt eine neue Studie nahe

Ein neues Papier der University of California und Google Research hat herausgefunden, dass eine kleine Anzahl von “Benchmark”-Maschinenlern-Datensätzen, größtenteils von einflussreichen westlichen Institutionen und häufig von Regierungsorganisationen, den AI-Forschungssektor zunehmend dominiert.

Die Forscher kommen zu dem Schluss, dass diese Tendenz, auf hochpopuläre Open-Source-Datensätze wie ImageNet zurückzugreifen, eine Reihe von praktischen, ethischen und sogar politischen Bedenken aufwirft.

Unter ihren Erkenntnissen – basierend auf Kern-Daten des Facebook-geführten Community-Projekts Papers With Code (PWC) – behaupten die Autoren, dass ‘weit verbreitete Datensätze von nur einer Handvoll Elite-Institutionen eingeführt werden’, und dass diese “Konsolidierung” in den letzten Jahren auf 80% zugenommen hat.

‘[Wir] finden, dass es eine zunehmende Ungleichheit in der Datensatz-Verwendung weltweit gibt, und dass mehr als 50% aller Datensatz-Verwendungen in unserer Stichprobe von 43.140 Datensätzen denen entsprechen, die von zwölf Elite-Institutionen, vorwiegend westlichen, eingeführt wurden.’

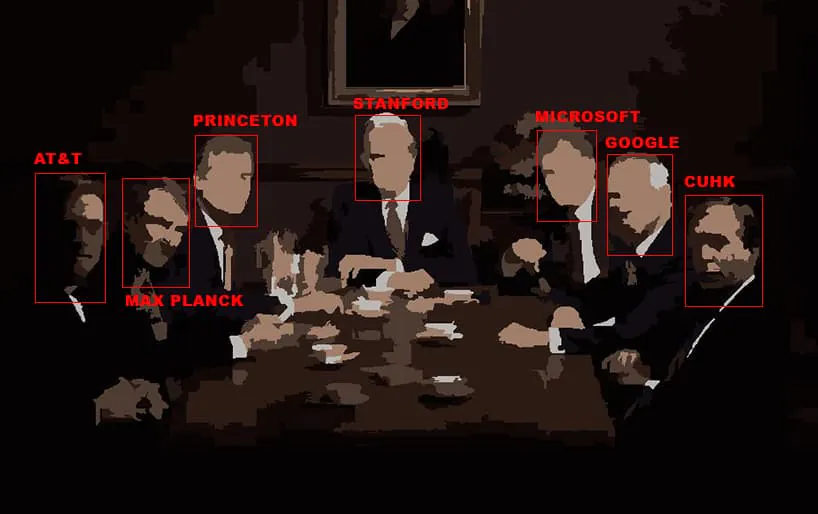

Eine Karte der nicht-aufgabenspezifischen Datensatz-Verwendungen der letzten zehn Jahre. Kriterium für die Aufnahme ist, wo die Institution oder Firma mehr als 50% der bekannten Verwendungen ausmacht. Rechts ist der Gini-Koeffizient für die Konzentration von Datensätzen über die Zeit für sowohl Institutionen als auch Datensätze. Quelle: https://arxiv.org/pdf/2112.01716.pdf

Die dominanten Institutionen umfassen Stanford University, Microsoft, Princeton, Facebook, Google, das Max-Planck-Institut und AT&T. Vier der Top-Ten-Datensatz-Quellen sind corporate Institutionen.

Das Papier charakterisiert auch die zunehmende Verwendung dieser Elite-Datensätze als ‘ein Vehikel für Ungleichheit in der Wissenschaft’. Dies liegt daran, dass Forscherteams, die nach Gemeinschafts-Anerkennung streben, eher motiviert sind, State-of-the-Art-Ergebnisse (SOTA) gegen einen konsistenten Datensatz zu erzielen, als originale Datensätze zu erstellen, die keinen solchen Ruf haben und die eine Anpassung an neue Metriken erfordern würden.

In jedem Fall, wie das Papier anerkennt, ist die Erstellung eines eigenen Datensatzes für weniger gut ausgestattete Institutionen und Teams ein prohibitiv teures Unterfangen.

‘Die prima facie wissenschaftliche Gültigkeit, die durch SOTA-Benchmarking gewährt wird, ist generisch mit der sozialen Glaubwürdigkeit verquickt, die Forscher durch die Demonstration erlangen, dass sie auf einem weithin anerkannten Datensatz konkurrieren können, auch wenn ein kontextspezifischerer Benchmark technisch angemessener sein könnte.

‘Wir gehen davon aus, dass diese Dynamik einen “Matthew-Effekt” (d. h. “die Reichen werden reicher und die Armen werden ärmer”) schafft, wo erfolgreiche Benchmarks und die Elite-Institutionen, die sie einführen, einen überproportionalen Status innerhalb des Feldes erlangen.

Das Papier trägt den Titel Reduced, Reused and Recycled: The Life of a Dataset in Machine Learning Research und stammt von Bernard Koch und Jacob G. Foster von der UCLA sowie Emily Denton und Alex Hanna von Google Research.

Die Arbeit wirft eine Reihe von Problemen mit der wachsenden Tendenz zur Konsolidierung auf, die sie dokumentiert, und wurde mit allgemeiner Anerkennung bei Open Review aufgenommen. Ein Rezensent von NeurIPS 2021 kommentierte, dass die Arbeit ‘extrem relevant für jeden, der in der Maschinenlernforschung tätig ist.’ und sah ihre Aufnahme als Pflichtlektüre in Universitätskursen vor.

Von Notwendigkeit zu Korruption

Die Autoren bemerken, dass die aktuelle Kultur des “Beat-the-Benchmark” als Heilmittel für den Mangel an objektiven Bewertungstools entstand, der den Interessen- und Investitionsrückgang in KI vor über dreißig Jahren verursachte, nach dem Niedergang des Geschäftsinteresses an neuen Forschungen in “Expertensystemen”:

‘Benchmarks formalisieren typischerweise eine bestimmte Aufgabe durch einen Datensatz und einen zugehörigen quantitativen Bewertungsmetriken. Die Praxis wurde ursprünglich in die Maschinenlernforschung nach dem “KI-Winter” der 1980er Jahre von Regierungsfördern eingeführt, die versuchten, den Wert, der durch Zuschüsse erhalten wurde, genauer zu bewerten.’

Das Papier argumentiert, dass die anfänglichen Vorteile dieser informellen Kultur der Standardisierung (Verringerung der Teilnahmebarrieren, konsistente Metriken und mehr agile Entwicklungsmöglichkeiten) zunehmend von den Nachteilen überwogen werden, die natürlich auftreten, wenn ein Datenbestand mächtig genug wird, um effektiv seine “Nutzungsbedingungen” und seinen Einflussbereich zu definieren.

Die Autoren schlagen vor, dass die Forschungsgemeinschaft, wie in vielen jüngsten industrie- und akademischen Überlegungen zu diesem Thema, keine neuen Probleme mehr stellt, wenn diese nicht durch bestehende Benchmark-Datensätze angegangen werden können.

Sie bemerken zusätzlich, dass die blinde Anpassung an diese kleine Anzahl von “Gold”-Datensätzen Forscher dazu ermutigt, Ergebnisse zu erzielen, die überanpasst sind (d. h. die datensatzspezifisch sind und nicht wahrscheinlich nahezu so gut auf reale Daten, neue akademische oder originale Datensätze oder sogar notwendigerweise auf andere Datensätze in der “Goldstandard”-Klasse performen).

‘Angesichts der beobachteten hohen Konzentration der Forschung auf eine kleine Anzahl von Benchmark-Datensätzen glauben wir, dass es besonders wichtig ist, die Formen der Bewertung zu diversifizieren, um Überanpassung an bestehende Datensätze und Fehldarstellung des Fortschritts im Feld zu vermeiden.’

Regierungs-Einfluss in der Computer-Vision-Forschung

Laut dem Papier ist die Computer-Vision-Forschung deutlich stärker von dem Syndrom betroffen, das es skizziert, als andere Sektoren, und die Autoren bemerken, dass die Natural Language Processing (NLP)-Forschung viel weniger betroffen ist. Die Autoren schlagen vor, dass dies daran liegen könnte, dass NLP-Gemeinschaften ‘kohärenter’ und größer sind und dass NLP-Datensätze zugänglicher und einfacher zu kuratieren sind, sowie kleiner und weniger ressourcenintensiv in Bezug auf Datenerfassung.

In der Computer-Vision, insbesondere bei der Gesichtserkennung (FR), behaupten die Autoren, dass corporate-, staatliche und private Interessen oft kollidieren:

‘Corporate- und Regierungs-Institutionen haben Ziele, die mit dem Privatsphärenschutz (z. B. Überwachung) in Konflikt geraten können, und ihre Gewichtung dieser Prioritäten ist wahrscheinlich anders als die von Akademikern oder den breiteren Stakeholdern der KI.’

Für Gesichtserkennungsaufgaben fanden die Forscher heraus, dass der Anteil rein akademischer Datensätze gegenüber dem Durchschnitt dramatisch abnimmt:

‘[Vier] der acht Datensätze (33,69% der gesamten Verwendungen) wurden ausschließlich von Corporations, dem US-Militär oder der chinesischen Regierung finanziert (MS-Celeb-1M, CASIA-Webface, IJB-A, VggFace2). MS-Celeb-1M wurde letztendlich wegen Kontroversen um den Wert der Privatsphäre für verschiedene Stakeholder zurückgezogen.’

Die Top-Datensätze, die in der Bildgenerierungs- und Gesichtserkennungsforschungsgemeinschaft verwendet werden.

In der obigen Grafik bemerken die Autoren, wie bereits erwähnt, auch, dass das relativ neue Feld der Bildgenerierung (oder Bildsynthese) stark von bestehenden, viel älteren Datensätzen abhängt, die nicht für diesen Zweck gedacht waren.

Tatsächlich bemerkt das Papier einen wachsenden Trend zur “Migration” von Datensätzen weg von ihrem ursprünglichen Zweck, was ihre Eignung für die Bedürfnisse neuer oder ausgelagerter Forschungsbereiche in Frage stellt und den Umfang, in dem Budgetbeschränkungen möglicherweise den Umfang der Forscherambitionen in den engeren Rahmen einschränken, der durch die verfügbaren Materialien und eine Kultur, die so sehr auf Jahr-für-Jahr-Benchmark-Ratings fixiert ist, dass neue Datensätze Schwierigkeiten haben, Fuß zu fassen.

‘Unsere Erkenntnisse deuten auch darauf hin, dass Datensätze regelmäßig zwischen verschiedenen Aufgabengemeinschaften transferiert werden. Am extremsten Ende wurden die Mehrheit der Benchmark-Datensätze, die für einige Aufgabengemeinschaften im Umlauf sind, für andere Aufgaben erstellt.’

In Bezug auf die Maschinenlern-Luminarien (einschließlich Andrew Ng), die in den letzten Jahren zunehmend nach mehr Vielfalt und Kuratierung von Datensätzen gerufen haben, unterstützen die Autoren die Gesinnung, glauben jedoch, dass dieser Art von Bemühungen, selbst wenn sie erfolgreich sind, möglicherweise durch die aktuelle Kultur der Abhängigkeit von SOTA-Ergebnissen und etablierten Datensätzen untergraben werden könnte:

‘Unsere Forschung legt nahe, dass es möglicherweise nicht ausreicht, einfach ML-Forscher aufzufordern, mehr Datensätze zu entwickeln und die Anreizstrukturen so zu ändern, dass die Datensatz-Entwicklung wertgeschätzt und belohnt wird, um die Datensatz-Verwendung und die Perspektiven, die letztendlich die MLR-Forschungs-Agendas prägen, zu diversifizieren.

‘Zusätzlich zu der Förderung der Datensatz-Entwicklung plädieren wir für equity-orientierte politische Interventionen, die eine signifikante Finanzierung für Menschen in weniger gut ausgestatteten Institutionen priorisieren, um hochwertige Datensätze zu erstellen. Dies würde – aus sozialer und kultureller Perspektive – die Benchmark-Datensätze diversifizieren, die zur Bewertung moderner ML-Methoden verwendet werden.’

6. Dezember 2021, 16:49 Uhr MEZ + 2 – Korrigierte Possessivpronomen im Titel. – MA