Andersonův úhel

Cesta k lepšímu AI-založenému video editování

Sektor výzkumu syntézy videa/obrazu pravidelně produkuje architektury pro editování videa, a za posledních devět měsíců se tyto výstupy staly ještě častějšími. Řekli bychom, že většina z nich představuje pouze.incrementální pokroky ve stavu umění, protože základní výzvy jsou podstatné.

Nicméně, nová spolupráce mezi Čínou a Japonskem z tohoto týdne vyprodukovala einige příklady, které si zaslouží bližší prozkoumání přístupu, i když to nemusí být nutně průlomová práce.

V níže uvedeném videu (z projektové webové stránky, která – varujte se – může zatížit váš prohlížeč) vidíme, že zatímco možnosti deepfaking systému jsou v současné konfiguraci neexistující, systém dělá velmi dobré práci při věrohodném a významném změně identity mladé ženy na obrázku, na základě video masky (vlevo dole):

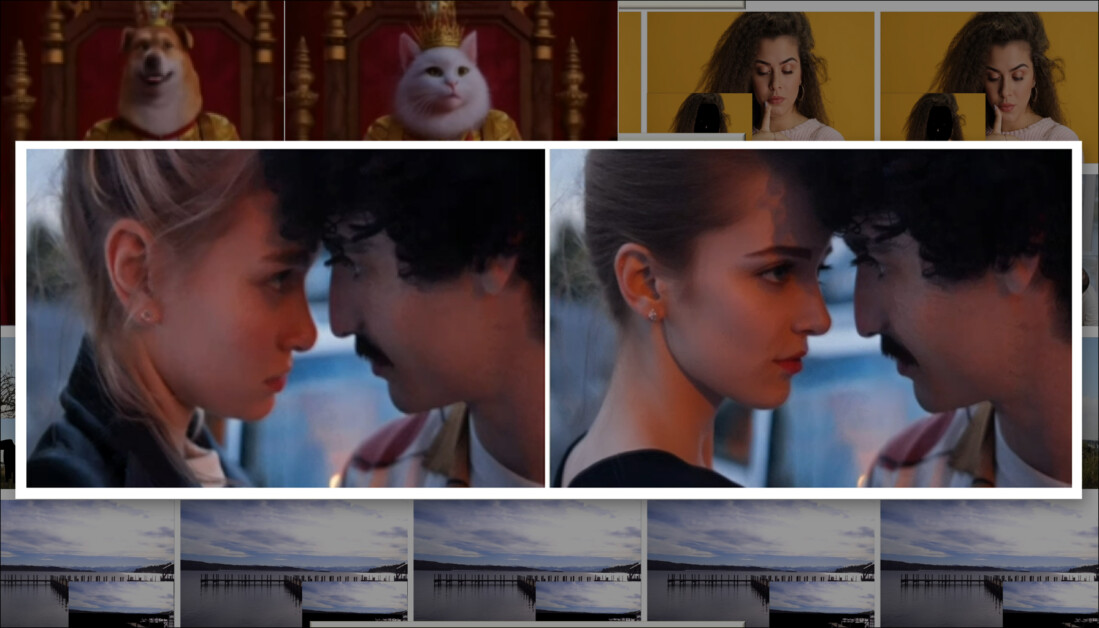

Klikněte na přehrávání. Založeno na semantické segmentační masky zobrazené v dolní části vlevo, původní (horní levá) žena je transformována do značně odlišné identity, i když tento proces nedosahuje výměny identity, jak je uvedeno v promptu. Source: https://yxbian23.github.io/project/video-painter/ (buďte si vědomi, že v době psaní tohoto článku, tato webová stránka s automatickým přehráváním a plná videa měla tendenci způsobovat pád mého prohlížeče). Prosím, odkážete se na zdrojová videa, pokud je můžete přístup, pro lepší rozlišení a detail, nebo zkontrolujte příklady na projektové přehledové video na https://www.youtube.com/watch?v=HYzNfsD3A0s

Editování založené na maskách tohoto druhu je dobře etablováno v statických latentních difuzních modelech, pomocí nástrojů jako ControlNet. Nicméně, udržování konzistence pozadí ve videu je mnohem více náročné, i když maskované oblasti poskytují modelu kreativní flexibilitu, jak je ukázáno níže:

Klikněte na přehrávání. Změna druhu, s novou metodou VideoPainter. Prosím, odkážete se na zdrojová videa, pokud je můžete přístup, pro lepší rozlišení a detail, nebo zkontrolujte příklady na projektové přehledové video na https://www.youtube.com/watch?v=HYzNfsD3A0s

Autoři nové práce považují svou metodu vzhledem k architektuře Tencent’s BrushNet (kterou my jsme pokryli minulý rok), a k ControlNet, obě z nichž se zabývají dual-branch architekturou schopnou izolovat generaci popředí a pozadí.

Nicméně, přímé použití této metody na velmi produktivní přístup Diffusion Transformers (DiT) navržen OpenAI’s Sora, přináší zvláštní výzvy, jak autoři poznamenávají

‘[Přímé] použití [architektury BrushNet a ControlNet] pro video DiTs představuje několik výzev: [Za prvé, s ohledem na] robustní generativní základnu Video DiT a velkou velikost modelu, replikace plné/polo-velké Video DiT základy jako kontextový kódér by byla zbytečná a výpočetně prohibitive.

‘[Za druhé, na rozdíl od] BrushNet’s čistě konvoluční kontrolní větve, DiT’s tokeny v maskovaných oblastech inherentně obsahují informace o pozadí kvůli globální pozornosti, komplikující rozlišení mezi maskovanými a nemaskovanými oblastmi v DiT základech.

‘[Nakonec,] ControlNet postrádá injekci funkcí napříč všemi vrstvami, bránící husté kontrole pozadí pro úkoly inpainting.’

Proto výzkumníci vyvinuli plug-and-play přístup v podobě dual-branch frameworku nazvaného VideoPainter.

VideoPainter nabízí dual-branch video inpainting framework, který vylepšuje předem trénované DiTs pomocí lehkého kontextového kódéru. Tento kódér zahrnuje pouze 6% parametrů základy, které autoři tvrdí, že činí přístup efektivnějším než konvenční metody.

Model navrhuje tři klíčové inovace: streamlinovaný dvouvrstvý kontextový kódér pro efektivní vedení pozadí; mask-selective feature integration systém, který odděluje maskované a nemaskované tokeny; a inpainting region ID resampling technika, která udržuje konzistenci identity napříč dlouhými videosekvencemi.

Zamrazením předem trénovaného DiT a kontextového kódéru a zavedením ID-Adapteru, VideoPainter zajišťuje, že tokeny inpainting oblasti z předchozích klipů přetrvávají po celou dobu videa, snižuje blikání a nekonzistence.

Rámec je také navržen pro plug-and-play kompatibilitu, umožňující uživatelům integrovat jej bezproblémově do stávajících video generace a editačních pracovních postupů.

Na podporu práce, která používá CogVideo-5B-I2V jako generativní motor, autoři kurátorovali to, co tvrdí, že je největší video inpainting dataset do dneška. Nazvaný VPData, sbírka se skládá z více než 390 000 klipů, pro celkovou dobu videa více než 886 hodin. Vyvinuli také související benchmarking framework nazvaný VPBench.

Klikněte na přehrávání. Z projektové webové stránky příklady, vidíme segmentační schopnosti napájené VPData sbírkou a VPBench testovacím frameworkem. Prosím, odkážete se na zdrojová videa, pokud je můžete přístup, pro lepší rozlišení a detail, nebo zkontrolujte příklady na projektové přehledové video na https://www.youtube.com/watch?v=HYzNfsD3A0s

Práce nová práce je nazvaná VideoPainter: Any-length Video Inpainting and Editing with Plug-and-Play Context Control, a pochází od sedmi autorů z Tencent ARC Lab, The Chinese University of Hong Kong, The University of Tokyo, a University of Macau.

Kromě výše uvedené projektové stránky, autoři také vydali více přístupný YouTube přehled, jakož i Hugging Face stránku.

Metoda

Datová sbírka pipeline pro VPData se skládá z kolekce, anotace, dělení, výběru a titulkování:

Schéma pro dataset konstrukční pipeline. Source: https://arxiv.org/pdf/2503.05639

Zdrojové sbírky použité pro tuto kompilaci pocházely z Videvo a Pexels, s počáteční sbírkou kolem 450 000 videí.

Mnoho přispívajících knihoven a metod se skládalo z předzpracování fáze: Recognize Anything framework byl použit pro poskytování otevřené sady video tagování, úkolem identifikovat primární objekty; Grounding Dino byl použit pro detekci bounding boxů kolem identifikovaných objektů; a Segment Anything Model 2 (SAM 2) framework byl použit pro rafinaci těchto hrubých výběrů do vysokokvalitních mask segmentací.

Na řízení scénických přechodů a zajištění konzistence ve video inpainting, VideoPainter používá PySceneDetect pro identifikaci a segmentaci klipů na přirozených přestávkách, vyhýbající se rušivým přechodům často způsobeným sledováním stejného objektu z více úhlů. Klipy byly rozděleny do 10-sekundových intervalů, s vším kratším než šest sekund odstraněným.

Pro datový výběr, tři filtrační kritéria byla aplikována: estetická kvalita, posouzená pomocí Laion-Aesthetic Score Predictor; pohybová síla, měřená pomocí optického toku pomocí RAFT; a obsahová bezpečnost, ověřená prostřednictvím Stable Diffusion’s Safety Checker.

Jedna z hlavních limitací stávajících video segmentačních datasetů je nedostatek podrobných textových anotací, které jsou zásadní pro vedení generativních modelů:

Výzkumníci zdůrazňují nedostatek video-podtitulků v srovnatelných sbírkách.

Proto VideoPainter datová kurátorská proces zahrnuje vedoucí vidění-jazykové modely, včetně CogVLM2 a Chat GPT-4o pro generování klíčových rámcových podtitulků a podrobných popisů maskovaných oblastí.

VideoPainter vylepšuje předem trénované DiTs zavedením vlastního lehkého kontextového kódéru, který odděluje pozadí kontext extrakci od generace popředí, viditelné v horní části ilustrativního schématu níže:

Konceptuální schéma pro VideoPainter. VideoPainter’s kontextový kódér zpracovává šumové latenty, downsamplované masky a maskované video latenty pomocí VAE, integrující pouze pozadí tokeny do předem trénovaného DiT, aby se zabránilo ambiguitě. ID Resample Adapter zajišťuje konzistenci identity konkatenující maskované regionální tokeny během trénování a resamplováním je z předchozích klipů během inferencing.

Místo zátěže základy redundantním zpracováním, tento kódér funguje na streamlinovaném vstupu: kombinaci šumového latentu, maskovaného video latentu (extrahovaného pomocí variational autoencoder, nebo VAE), a downsamplovaných masek.

Šumový latent poskytuje generační kontext, a maskovaný video latent se shoduje s DiT’s stávající distribucí, zaměřující se na vylepšení kompatibility.

Spíše než duplikovat velké části modelu, které autoři uvádějí, že se stalo v předchozích pracích, VideoPainter integruje pouze první dvě vrstvy DiT. Tyto extrahované funkce jsou reintrodukovány do zmrazeného DiT v strukturovaném, skupinovém způsobu – rané vrstvy informují počáteční polovinu modelu, zatímco pozdější vrstvy rafinují druhou polovinu.

Kromě toho token-selective mechanismus zajišťuje, že jsou reintegrovány pouze pozadí-relevantní funkce, bránící zmatku mezi maskovanými a nemaskovanými oblastmi. Tento přístup, autoři tvrdí, umožňuje VideoPainter udržet vysokou věrnost v pozadí uchování, zatímco zlepšuje efektivitu generace popředí.

Autoři poznamenávají, že metoda, kterou navrhují, podporuje různé stylizační metody, včetně nejpopulárnější, Low Rank Adaptation (LoRA).

Data a testy

VideoPainter byl trénován pomocí CogVideo-5B-I2V modelu, spolu s jeho text-to-video ekvivalentem. Kurátorovaná VPData sbírka byla použita na 480x720px, při učení sazbě 1×10-5.

ID Resample Adapter byl trénován po dobu 2 000 kroků, a kontextový kódér po dobu 80 000 kroků, oba pomocí AdamW optimalizátoru. Trénování probíhalo ve dvou fázích pomocí 64 NVIDIA V100 GPU (i když článek neuvádí, zda měly 16GB nebo 32GB VRAM).

Pro benchmarking, Davis byl použit pro náhodné masky, a autoři vlastní VPBench pro segmentační masky.

VPBench dataset obsahuje objekty, zvířata, lidi, krajiny a různé úkoly, a pokrývá čtyři akce: přidat, odstranit, změnit, a vyměnit. Sbírka obsahuje 45 6-sekundových videí, a devět videí trvajících v průměru 30 sekund.

Osm metrik bylo použito pro proces. Pro Masked Region Preservation, autoři použili Peak Signal-to-Noise Ratio (PSNR); Learned Perceptual Similarity Metrics (LPIPS); Structural Similarity Index (SSIM); a Mean Absolute Error (MAE).

Pro text-alignment, výzkumníci použili CLIP Similarity both pro vyhodnocení semantické vzdálenosti mezi klipovým podtitulkem a jeho skutečným vnímaným obsahem, a také pro vyhodnocení přesnosti maskovaných oblastí.

Pro vyhodnocení obecné kvality výstupních videí, Fréchet Video Distance (FVD) byl použit.

Pro kvantitativní srovnávací kolo pro video inpainting, autoři nastavili svůj systém proti předchozím přístupům ProPainter, COCOCO a Cog-Inp (CogVideoX). Test se skládal z inpainting prvního snímku klipu pomocí image inpainting modelů, a poté pomocí image-to-video (I2V) backbone pro propagaci výsledků do latentní blend operace, v souladu s metodou navrženou 2023 paper z Izraele.

Pokud projektová webová stránka není zcela funkční v době psaní, a pokud projektová YouTube video nemusí obsahovat celou řadu příkladů z projektové stránky, je poměrně obtížné najít video příklady, které jsou velmi specifické pro výsledky uvedené v článku. Proto budeme ukazovat částečné statické výsledky uvedené v článku, a uzavřeme článek s některými dalšími video příklady, které jsme podařilo extrahovat z projektové stránky.

Kvantitativní srovnání VideoPainter vs. ProPainter, COCOCO, a Cog-Inp na VPBench (segmentační masky) a Davis (náhodné masky). Metriky pokrývají maskované regionální uchování, text-alignment, a video kvalitu. Červená = nejlepší, Modrá = druhá nejlepší.

Z těchto kvalitativních výsledků, autoři komentují:

‘V segmentační VPBench, ProPainter a COCOCO vykazují nejhorší výkon napříč většinou metrik, primárně kvůli neschopnosti inpaintovat plně maskované objekty a single-backbone architektuře, která má potíže s vyvážením konkurenčních pozadí uchování a generace popředí, resp.

‘V náhodném maskovém benchmarku Davis, ProPainter ukazuje zlepšení tím, že využívá částečné pozadí informace. Nicméně, VideoPainter dosahuje optimálního výkonu napříč segmentací (standardní a dlouhou délku) a náhodnými maskami prostřednictvím své dual-branch architektury, která efektivně decouples pozadí uchování a generace popředí.’

Autoři poté představují statické příklady kvalitativních testů, z nichž uvádíme výběr níže. Ve všech případech odkazujeme čtenáře na projektovou stránku a YouTube video pro lepší rozlišení.

Srovnání proti inpainting metodám v předchozích rámcích.

Klikněte na přehrávání. Příklady spojené námi z ‘výsledků’ videí na projektové stránce.

Ohledně této kvalitativní kola pro video inpainting, autoři komentují:

‘VideoPainter konzistentně ukazuje výjimečné výsledky ve video koherenci, kvalitě a zarovnání s textovým podtitulkem. Značně, ProPainter selhává při generování plně maskovaných objektů, protože závisí pouze na pozadí pixel propagaci místo generace.

‘Zatímco COCOCO demonstruje základní funkčnost, selhává při udržování konzistentní ID v inpaintovaných oblastech (nekonzistentní vzhled lodí a náhlé změny terénu) kvůli jeho single-backbone architektuře, která se snaží vyvážit pozadí uchování a generaci popředí.

‘Cog-Inp dosahuje základních inpainting výsledků; nicméně, jeho blending operace selhává při detekci maskovaných hranic, vedoucí k významným artifactům.

‘Navíc, VideoPainter může generovat koherentní videa přesahující jednu minutu, zatímco udržuje ID konzistenci prostřednictvím našeho ID resampling.’

Výzkumníci také testovali VideoPainterovu schopnost vylepšit podtitulky a získat lepší výsledky touto metodou, postavili systém proti UniEdit, DiTCtrl, a ReVideo.

Video-editační výsledky proti třem předchozím přístupům.

Autoři komentují:

‘Pro obě standardní a dlouhou videa ve VPBench, VideoPainter dosahuje lepšího výkonu, dokonce překonávající koncový ReVideo. Tento úspěch lze připsat jeho dual-branch architektuře, která zajišťuje vynikající pozadí uchování a generace popředí schopnosti, udržující vysokou věrnost v needitovaných oblastech, zatímco editované oblasti úzce zarovnávají s editačními instrukcemi, doplněné o inpainting regionální ID resampling, který udržuje ID konzistenci v dlouhém videu.’

Ačkoli článek obsahuje statické kvalitativní příklady pro tuto metriku, jsou neosvětlující, a odkazujeme čtenáře na různé příklady rozeseté napříč různými videi publikovanými pro tento projekt.

Nakonec, byla provedena lidská studie, kde třicet uživatelů bylo požádáno, aby vyhodnotili 50 náhodně vybraných generací z VPBench a editačních subsetů. Příklady zdůrazňovaly pozadí uchování, zarovnání s promptem, a obecnou video kvalitu.

Výsledky z uživatelské studie pro VideoPainter.

Autoři prohlašují:

‘VideoPainter významně překonal stávající benchmarky, dosahující vyšší preference sazby napříč všemi vyhodnocovacími kritérii v obou úkolech.’

Přiznávají, nicméně, že kvalita VideoPainterových generací závisí na základním modelu, který může mít potíže s komplexním pohybem a fyzikou; a pozorují, že také funguje špatně s nízkou kvalitou masek nebo nesouladnými podtitulky.

Závěr

VideoPainter se zdá být hodnotným přídavkem k literatuře. Typickým pro nedávné řešení, nicméně, má značné výpočetní nároky. Kromě toho, mnoho příkladů vybraných pro prezentaci na projektové stránce je daleko od nejlepších příkladů; proto by bylo zajímavé vidět tento rámec postavený proti budoucím vstupům, a širšímu rozsahu předchozích přístupů.

* Je třeba poznamenat, že ‘video-editace’ v tomto smyslu neznamená ‘sestavení různých klipů do sekvence’, což je tradiční význam tohoto termínu; ale spíše přímo mění nebo nějakým způsobem modifikuje vnitřní obsah stávajících video klipů, pomocí technik strojového učení

Poprvé publikováno v pondělí, 10. března 2025