Andersonův úhel

Přidání dialogu do skutečných videí pomocí AI

Nový rámec AI může přepisovat, odstraňovat nebo přidávat slova osoby ve videu bez opětovného natáčení, v jednom koncovém systému.

Před třemi lety by internet byl šokován jakýmkoli z 20-30 rámců AI pro úpravu videa, které jsou publikovány na akademických portálech týdně; jak tomu je, tento populární směr výzkumu se nyní stal tak prosperujícím, že téměř tvoří další větev ‘AI Slop’, a pokrývám mnohem méně takových vydání než bych dělal před dvěma nebo třemi lety.

Nicméně jedna aktuální verze v tomto směru upoutala mou pozornost: integrovaný systém, který může zasahovat do skutečných videoklipů a vkládat nový dialog do existujícího videa (na rozdíl od vytváření celého generativního klipu z obličeje nebo rámečku, což je mnohem častější).

V následujících příkladech, které jsem upravil z množství vzorkových videí dostupných na webové stránce projektu project website, vidíme nejprve skutečný zdrojový klip a poté, pod ním, vložený AI dialog uprostřed klipu, včetně syntézy hlasu a synchronizace rtů:

Kliknutím se přehraje.Místní úprava se šitím – jedna z několika modalit nabízených FacEDiT. Prosím, odkážete se na zdroj webové stránky pro lepší rozlišení.

Zdroj – https://facedit.github.io/

Tento přístup je jedním ze tří vyvinutých pro novou metodu, tato s názvem ‘místní úprava se šitím’, a ta, která nejvíce zajímá autory (stejně jako mě). Základní myšlenka spočívá v tom, že klip je prodloužen pomocí jedné z prostředních snímků jako výchozího bodu pro novou interpretaci AI a jeho následující (skutečný) snímek jako cíl, ke kterému by generovaný vložený klip měl směřovat. V výše uvedených klipech jsou tyto ‘seed’ a ‘target’ snímky reprezentovány horním videem, které se zastaví, zatímco upravené video níže poskytuje generativní výplň.

Autoři rámcují tento přístup k syntéze obličeje a hlasu jako první plně integrovanou koncovou metodu pro úpravy videa AI tohoto druhu, přičemž pozorují potenciál plně vyvinutého rámcu, jako je tento, pro produkci TV a filmů:

‘Filmaři a producenti médií často potřebují revidovat specifické části zaznamenaných videí – možná bylo slovo vysloveno nesprávně nebo scénář změněn po natáčení. Například v ikonické scéně z Titanic (1997), kde Rose říká, “I’ll never let go, Jack,” režisér by později mohl rozhodnout, že by to mělo být “I’ll never forget you, Jack”.

‘Tradičně vyžadují takové změny opětovné natáčení celé scény, což je nákladné a časově náročné. Syntéza mluvené tváře nabízí praktickou alternativu automatickým úpravám obličejového pohybu, aby odpovídal revidovanému dialogu, a eliminuje potřebu opětovného natáčení.’

Ačkoli mohou úpravy AI tohoto druhu čelit kulturní nebo odporu průmyslu, mohou také představovat nový typ funkcionality v systémech a nástrojových sadách VFX řízených lidmi. V každém případě, prozatím, jsou výzvy striktně technické.

Kromě prodloužení klipu pomocí dodatečného dialogu generovaného AI může nový systém také měnit existující dialog:

Kliknutím se přehraje.Příklad změny existujícího dialogu místo vkládání dodatečného dialogu. Prosím, odkážete se na zdroj webové stránky pro lepší rozlišení.

Stav umění

V současné době neexistují žádné koncové systémy, které by nabízely tuto kind syntézy; ačkoli rostoucí počet generativních platforem AI, jako je série Veo od Googlu, může generovat audio, a různé další rámce mohou vytvářet deepfaked audio,目前 je nutné vytvořit poměrně složitou pipeline různých architektur a triků, aby se mohlo zasahovat do skutečných snímků způsobem, jakým může nový systém – nazvaný FacEDiT – dosáhnout.

Systém používá Diffusion Transformers (DiT) v kombinaci s Flow Matching pro vytváření obličejových pohybů podmíněných okolními (kontextovými) pohyby a obsahem speech audio. Systém využívá stávající populární balíčky, které se zabývají rekonstrukcí obličeje, včetně LivePortrait (nedávno převzatého Klingem).

Kromě této metody, vzhledem k tomu, že jejich přístup je první, který integruje tyto výzvy do jednoho řešení, autoři vytvořili novou benchmark nazvanou FacEDiTBench, spolu s několika zcela novými evaluačními metrikami vhodné pro tuto velmi specifickou úlohu.

Nová práce je nazvaná FacEDiT: Unified Talking Face Editing and Generation via Facial Motion Infilling, a pochází od čtyř výzkumníků z Korejské univerzity vědy a technologie (POSTECH), Korejského pokročilého institutu vědy a technologie (KAIST) a Texaské univerzity v Austinu.

Metoda

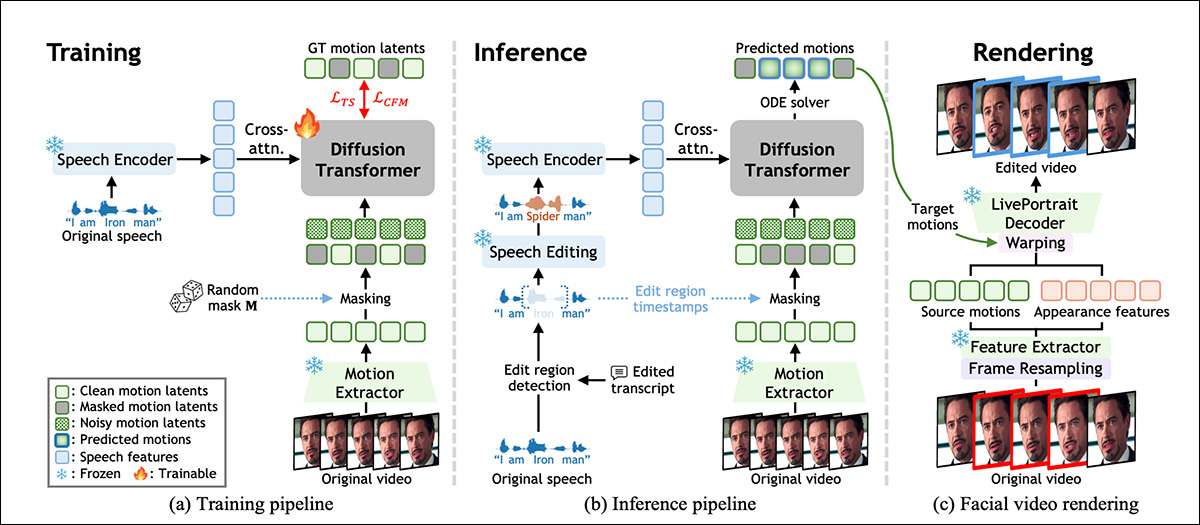

FacEDiT je trénován na rekonstrukci obličejového pohybu tak, že se učí, jak vyplnit chybějící části původního výkonu herce, na základě okolního pohybu a speech audio. Jak je znázorněno v níže uvedeném schématu, tento proces umožňuje modelu fungovat jako gap-filler během trénování, predikující obličejové pohyby, které odpovídají hlasu, zatímco zůstávají konzistentní s původním videem:

Přehled systému FacEDiT, ukazující, jak se obličejový pohyb učí prostřednictvím samo-supervizovaného vyplňování během trénování, řízeného editovaným dialogem při inference, a nakonec renderovaného zpět do videa pomocí opětovného použití vzhledu z původního footage, zatímco nahrazuje pouze cílený pohyb. Zdroj

Během inferenci podporuje stejná architektura dva různé výstupy v závislosti na tom, kolik videa je maskováno: částečné úpravy, kde je změněna pouze jedna fráze a zbytek zůstává nedotčen; nebo generace plných vět, kde je nový pohyb syntetizován zcela ze scratch.

Model je trénován prostřednictvím flow matching, který považuje video úpravy za druh cesty mezi dvěma verzemi obličejového pohybu.

Místo toho, aby se učilo, jak vypadá upravená tvář, se flow matching učí plynule a hladce pohybovat mezi šumivým placeholderem a správným pohybem. K tomu je navržen tak, aby reprezentoval obličejový pohyb jako kompaktní sadu čísel extrahovaných z každého snímku pomocí verze výše uvedeného systému LivePortrait (viz schéma výše).

Tyto vektory pohybu jsou navrženy tak, aby popisovaly výrazy a polohu hlavy bez zapletení identity, aby změny dialogu mohly být lokalizovány bez ovlivnění celkového vzhledu osoby.

Trénování FacEDiT

Pro trénování FacEDiT byl každý videoklip rozdělen na řadu snímků obličejového pohybu, a každý snímek spárován s odpovídajícím kusem audio. Náhodné části dat pohybu byly poté skryty, a model byl požádán, aby uhádl, jak by měly vypadat tyto chybějící pohyby, pomocí både speech a okolního ne-maskovaného pohybu pro kontext.

Protože maskované rozpětí a jejich pozice se liší od jednoho tréninkového příkladu k druhému, model postupně učí, jak zvládat malé vnitřní úpravy, a delší mezery, pro plnou generaci sekvencí, v závislosti na tom, kolik informací má k dispozici.

Systém Diffusion Transformer se učí obnovit maskovaný pohyb tak, že postupně vylepšuje šumivé vstupy. Místo toho, aby se.feedoval speech a pohyb do modelu najednou, je audio vlákno do každého zpracovatelského bloku prostřednictvím cross-attention, což pomáhá systému lépe sladit pohyby rtů s audio.

Aby se zachovala realističnost úprav, pozornost je zkreslena směrem k sousedním snímkům spíše než celému časovému rámci, což nutí model soustředit se na lokální kontinuitu a brání třesku nebo skokům pohybu na hranicích upravených oblastí. Položené vložené (které informují model, kde se každý snímek objeví v sekvenci) dále pomáhají modelu udržet přirozený temporální tok a kontext.

Během trénování se systém učí predikovat chybějící obličejový pohyb rekonstruováním maskovaných rozpětí na základě speech a okolního ne-maskovaného pohybu. Při inferenci je stejný nastavení znovu použito, ale s maskami, které jsou nyní řízeny úpravami v dialogu.

Když je vloženo, odstraněno nebo změněno slovo nebo fráze, systém lokalizuje postiženou oblast, maskuje ji a regeneruje pohyb, který odpovídá novému audio. Plná generace sekvencí je považována za speciální případ, kde je celá oblast maskována a syntetizována ze scratch.

Data a testy

Základní kostra systému se skládá z 22 vrstev pro Diffusion Transformer, každá s 16 attention heads a feedforward dimenzemi 1024 a 2024px. Rysy pohybu a vzhledu jsou extrahovány pomocí zmrazených komponent LivePortrait, a speech je kódován pomocí WavLM a upraven pomocí VoiceCraft.

Dedikovaná projekční vrstva mapuje 786-rozměrné rysy speech do latentního prostoru DiT, přičemž pouze DiT a projekční moduly jsou trénovány od scratch.

Trénování bylo provedeno pomocí AdamW optimalizátoru na cílové rychlosti učení 1e‑4, po milion kroků, na dvou A6000 GPU (každý s 48GB VRAM), při celkovém velikosti batche osm.

FacEDiTBench

Datová sada FacEDiTBench obsahuje 250 příkladů, každý se videoklipem původního a upraveného dialogu, a transkripty pro oba. Videoklipy pocházejí ze tří zdrojů, se 100 klipy z HDTF, 100 z Hallo3, a 50 z CelebV-Dub. Každý byl ručně zkontrolován, aby se potvrdilo, že cả audio i video jsou dostatečně čisté pro evaluaci.

GPT‑4o byl použit k revizi každé transkripce, aby se vytvořily gramaticky platné úpravy. Tyto revidované transkripce, spolu s původním dialogem, byly předány do VoiceCraft, aby se vyrobilo nové audio; a v každém stádiu byly obě transkripce a generované speech ručně přezkoumány pro kvalitu.

Každý vzorek byl označen typem úpravy, časováním změny a délkou upraveného rozpětí, a úpravy byly klasifikovány jako insertions, deletions, nebo substitutions. Počet slov, která byla změněna, se pohyboval od krátkých úprav 1 až 3 slov, středních úprav 4 až 6 slov a delších úprav 7 až 10 slov.

Byly definovány tři vlastní metriky pro evaluaci kvality úprav. Photometric continuity, pro měření, jak dobře se osvětlení a barva upraveného segmentu sladí se surrounding videem, porovnáním rozdílů na pixlové úrovni na hranicích; motion continuity, pro hodnocení konzistence obličejového pohybu, měřením změn optického toku přes upravené a neupravené snímky; a identity preservation, pro odhad, zda vzhled subjektu zůstává konzistentní po úpravě, porovnáním obličejových vložených ze původních a generovaných sekvencí pomocí ArcFace modelu rozpoznávání obličeje.

Testy

Testovací model byl trénován na materiálu z výše uvedených tří datových sad, celkem kolem 200 hodin video obsahu, včetně vlogů a filmů, jakož i high-resolution YouTube videí.

Pro evaluaci úprav obličeje při mluvení byl použit FacEDiTBench, kromě testovacího rozdělení HDTF, které se stalo standardem pro tuto sadu úkolů.

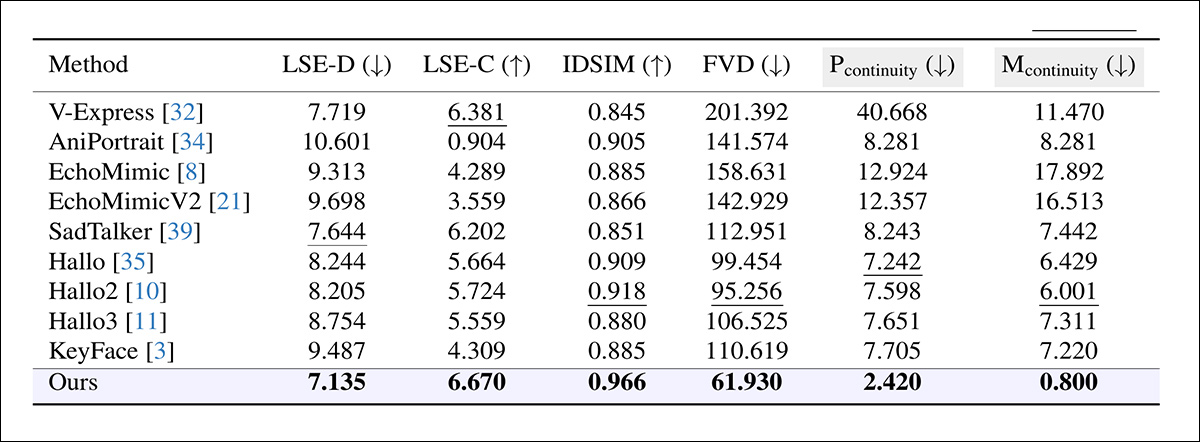

Jelikož neexistovaly přímo srovnatelné systémy, které by mohly zahrnout tuto kind koncové funkcionality, autoři zvolili řadu rámců, které reprodukovaly alespoň část cílové funkcionality, a které mohly fungovat jako baseline; konkrétně KeyFace; EchoMimic; EchoMimicV2; Hallo; Hallo2; Hallo3; V-Express; AniPortrait; a SadTalker.

Byly použity také několik zavedených metrik pro hodnocení kvality generování a úprav. Lip-sync přesnost byla hodnocena pomocí SyncNet, které hlásilo jak absolutní chybu mezi pohyby rtů a audio (LSE-D), tak i důvěru (LSE-C); Fréchet Video Distance (FVD) kvantifikující, jak realistické video vypadá celkově; a Learned Perceptual Similarity Metrics (LPIPS), měřící percepční podobnost mezi generovanými a původními snímky.

Pro úpravy byly všechny metriky kromě LPIPS aplikovány pouze na upravený segment; pro generování bylo vyhodnoceno celé video, s výjimkou hranic kontinuity.

Každý model byl donucen syntetizovat odpovídající video segment, který byl poté vložen do původního klipu (výzkumníci poznamenávají, že tato metoda často introdukovala viditelné diskontinuity, kde upravená sekce potkávala surrounding footage). Byl také otestován druhý přístup, ve kterém bylo celé video regenerováno z upraveného audio – ale tato metoda nevyhnutelně přepisovala neupravené oblasti a nezachovávala původní výkon:

Srovnání úpravnické výkonnosti napříč systémy původně navržené pro generování obličeje při mluvení, s FacEDiT, který překonává všechny baseline systémy napříč všemi metrikami, dosahující nižší chyby lip-sync (LSE-D), vyšší synchronizační důvěru (LSE-C), silnější uchování identity (IDSIM), větší percepční realističnost (FVD) a hladší přechody přes editační hranice (Pcontinuity, Mcontinuity). Šedé sloupce zvýrazňují klíčová kritéria pro hodnocení kvality hranic; tučné a podtržené hodnoty označují nejlepší a druhý nejlepší výsledky, resp.

Pokud jde o tyto výsledky, autoři komentují:

‘[Náš] model výrazně překonává stávající metody v úpravnické úloze. Dosahuje silné hranice kontinuity a vysoké uchování identity, demonstrující jeho schopnost udržet temporální a vizuální konzistenci během úprav. Kromě toho jeho lepší lip-sync přesnost a nízká FVD odrážejí realističnost syntetizovaného videa.’

Kliknutím se přehraje.Výsledky, sestavené tímto autorem z publikovaných videí na podpůrné projektové stránce. Prosím, odkážete se na zdroj webové stránky pro lepší rozlišení.

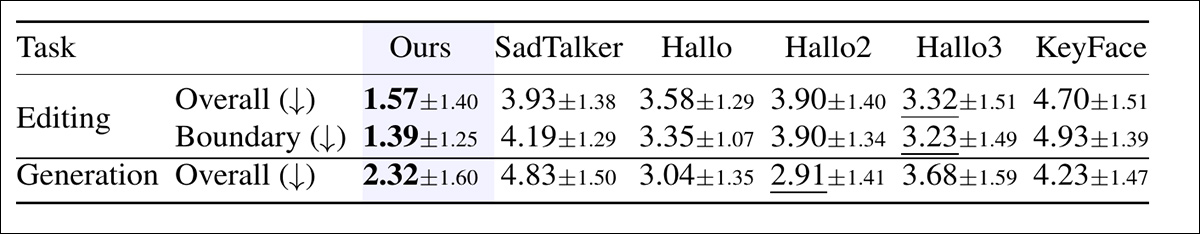

Dále byla provedena studie lidské evaluace, aby se vyhodnotila vnímaná kvalita napříč úpravami a generováním.

Pro každou komparaci účastníci sledovali šest videí a řadili je podle celkové kvality, zohledňující lip-sync přesnost, přirozenost a realističnost pohybu hlavy. V úpravnických testech účastníci také ohodnotili hladkost přechodů mezi upravenými a neupravenými segmenty:

Průměrné hodnocení přidělené lidskými evaluačními, kde nižší znamená lepší. V úpravách i generování účastníci ohodnotili, jak přirozené a dobře sladěné každé video vypadalo. Pro úpravy také ohodnotili, jak hladký byl přechod mezi upraveným a neupraveným dialogem. Tučné a podtržené čísla ukazují nejlepší a druhý nejlepší skóre.

Ve studii byl FacEDiT konzistentně hodnocen jako nejlepší s výrazným náskokem, jak pro kvalitu úprav, tak pro hladkost přechodů, a také obdržel silné skóre v generování, naznačující, že jeho měřené výhody se překládají do percepčně preferovaných výstupů.

Kvůli omezenému prostoru odkazujeme čtenáře na zdroj článku pro další podrobnosti o studiích ablace a dalších testech, které byly provedeny a hlášeny v nové práci. Ve skutečnosti, prototypické výzkumné nabídky tohoto druhu bojují s generováním smysluplných testovacích výsledků, protože jádrové nabídky samo o sobě je nevyhnutelně potenciálním baseline pro pozdější práci.

Závěr

I pro inferenci mohou systémy, jako je tento, vyžadovat významné výpočetní zdroje, což činí obtížným pro downstream uživatele – zde, zřejmě, VFX obchody – udržet práci na místě. Proto se budou vždy upřednostňovat přístupy, které lze přizpůsobit realistickým místním zdrojům, které jsou povinny chránit klientův footage a obecný IP.

To však není kritika nové nabídky, která může fungovat dokonale pod kvantizovanými váhami nebo jinými optimalizacemi, a která je první nabídkou svého druhu, která mě přitáhla zpět k této oblasti výzkumu po quite some time.

Poprvé publikováno ve středu, 17. prosince 202. Upraveno 20.10 EET, stejného dne, pro extra prostor v prvním odstavci.