Andersonův úhel

AI video dokáže vytvořit dokonalou selfie kočky

Často jsou výsledky generátorů AI videa blízké, ale ne zcela přesné, pokud jde o dodání toho, co uživatel požaduje ve svém textovém podnětu. Nová vysokou úroveň opravy však dělá veškerý rozdíl.

Generativní video systémy často mají potíže s vytvářením skutečně kreativních nebo divokých videí a často nesplňují očekávání uživatelů ohledně textových podnětů.

Jednou z příčin tohoto jevu je entanglement – fakt, že modely založené na vidění a jazyku musí dělat kompromis, pokud jde o délku tréninku na jejich zdrojových datech. Příliš málo tréninku a koncepty jsou flexibilní, ale nejsou plně vytvořené – příliš mnoho a koncepty jsou přesné, ale již nejsou dostatečně flexibilní, aby je bylo možné začlenit do nových kombinací.

Můžete získat představu z videa umístěného níže. Na levé straně je vidět kompromis, kterého mnoho systémů AI dosahuje v odpovědi na náročný podnět (podnět je umístěn v horní části videa ve všech čtyřech příkladech), který požaduje některé kombinace prvků, které jsou příliš fantastické, aby mohly být skutečným tréninkovým příkladem. Na pravé straně je výstup AI, který se drží podnětu mnohem lépe:

Kliknutím spustíte (bez zvuku). Na pravé straně vidíme ‘factorized’ WAN 2.2, který skutečně dodává na podněty, ve srovnání s vágními interpretacemi ‘vanilla’ Wan 2.2. na levé straně. Pro lepší rozlišení a více příkladů se prosím obraťte na zdrojové video soubory, i když kurátorské verze zobrazené zde neexistují na projektu a byly sestaveny pro tento článek. Zdroj

Zjevně, i když musíme omluvit kachnu, která tleská lidskými rukama (!), je zřejmé, že příklady na pravé straně dodržují původní textový podnět mnohem lépe než ty na levé straně.

Zajímavě, obě architektury jsou zásadně stejné – populární a velmi schopný Wan 2.2, čínské vydání, které získalo významný prostor v otevřených zdrojových a hobbyistických komunitách tohoto roku.

Rozdíl spočívá v tom, že druhá generativní pipeline je factorized, což v tomto případě znamená, že velký jazykový model (LLM) byl použit k reinterpretaci první (základní) snímku videa, aby bylo pro systém mnohem snazší dodat to, co uživatel požaduje.

Toto “vizuální kotvení” zahrnuje injekci obrazu vytvořeného z tohoto LLM-enhanced podnětu do generativní pipeline jako “start frame” a použití LoRA interpretačního modelu, aby pomohl začlenit “intruder” snímek do procesu vytváření videa.

Výsledky, pokud jde o věrnost podnětu, jsou quiteremarkable, zejména pro řešení, které parece bastante elegantní:

Kliknutím spustíte (bez zvuku). Další příklady ‘factorized’ video generací, které skutečně dodržují scénář. Pro lepší rozlišení a více příkladů se prosím obraťte na zdrojové video soubory, i když kurátorské verze zobrazené zde neexistují na projektu a byly sestaveny pro tento článek.

Toto řešení přichází v podobě nové práce Factorized Video Generation: Decoupling Scene Construction and Temporal Synthesis in Text-to-Video Diffusion Models, a její video-laden doprovodný projektový web.

Zatímco mnoho současných systémů se snaží zvýšit přesnost podnětu pomocí jazykových modelů k přepsání vágních nebo nedostatečně specifikovaných textů, nová práce tvrdí, že tato strategie stále vede k selhání, když je interní scéna reprezentace modelu vadná.

I s podrobným přepsaným podnětem, text-to-video modely často miscompose klíčové prvky nebo generují nekompatibilní počáteční stavy, které porušují logiku animace. Dokud první snímek neodráží to, co popisuje podnět, výsledné video nemůže být obnoveno, bez ohledu na to, jak dobrý je model pohybu.

Práce uvádí*:

‘[Text-to-video] modely často produkují distribučně posunuté snímky, ale stále dosahují [hodnoty hodnocení] srovnatelné s I2V modely, což naznačuje, že jejich modelování pohybu zůstává přirozeně i když scéna věrnost je relativně špatná.

‘[Image-to-Video] modely vykazují komplementární chování, silné [hodnoty hodnocení] z přesných počátečních scén a slabší temporální koherence, zatímco I2V+text vyvažuje oba aspekty.

‘Tento kontrast naznačuje strukturální nesoulad v současných T2V modelech: scéna kotvení a temporální syntéza profitují z různých induktivních偏見, ale existující architektury se snaží naučit oba současně v rámci jednoho modelu.’

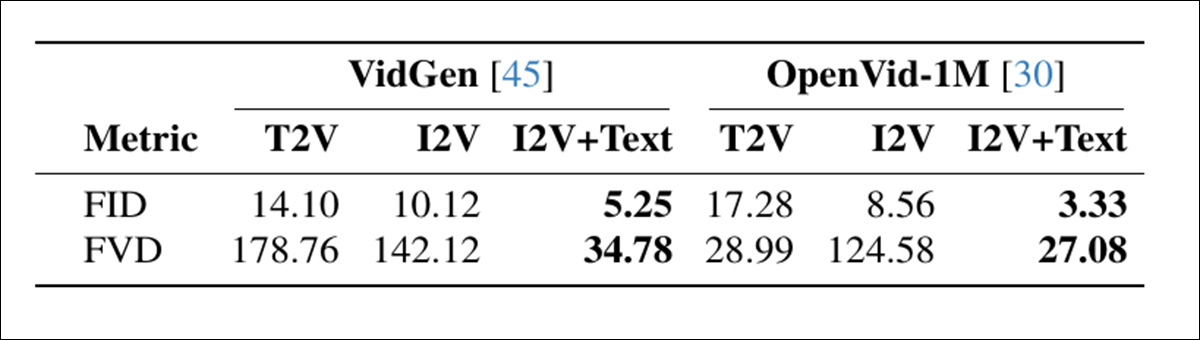

Diagnostické srovnání generativních módů zjistilo, že modely bez explicitního scénického kotvení dosáhly dobrých výsledků v pohybu, ale často kompromitovaly na scéně rozložení, zatímco image-kondicionované přístupy ukázaly opačný vzorec:

Srovnání video generativních módů na dvou datech, ukazující, že I2V+text dosahuje nejlepších rámcových kvalit (FID) a temporální koherence (FVD), zdůrazňující výhodu oddělení scénické konstrukce od pohybu. Zdroj

Tyto výsledky ukazují na strukturální vadu, kdy současné modely se snaží naučit scénické rozložení a animaci najednou, i když tyto dvě úkoly vyžadují různé druhy induktivního偏見, a jsou lépe zpracovány odděleně.

Možná nejzajímavější je, že tato “finta” může být potenciálně aplikována na lokální instalace modelů, jako jsou Wan 2.1 a 2.2, a podobné video difúzní modely, jako je Hunyuan Video. Anekdoticky, srovnání kvality hobbyist výstupu s komerčními generativními portály, jako jsou Kling a Runway, většina hlavních API poskytovatelů se snaží zlepšit otevřené zdrojové nabídky, jako je WAN, pomocí LoRAs, a – zdá se – s fintami podobného druhu, jako je vidět v nové práci.

Testy provedené pro metodu ukazují, že tato jednoduchá a modulární přístup nabízí nový stav-být na T2V-CompBench benchmark, významně zlepšující všechny testované modely. Autoři uvádějí, že zatímco jejich systém radikálně zlepšuje věrnost, neřeší (ani není určen k řešení) identifikační drift, který je目前 hlavní překážkou výzkumu generativní AI.

Nová práce pochází od čtyř výzkumníků z Ecole Polytechnique Fédérale de Lausanne (EPFL) ve Švýcarsku.

Metoda a data

Centrální návrh nové techniky spočívá v tom, že text-to-video (T2V) difúzní modely potřebují být “ukotveny” do počátečních snímků, které skutečně odpovídají požadovanému textovému podnětu.

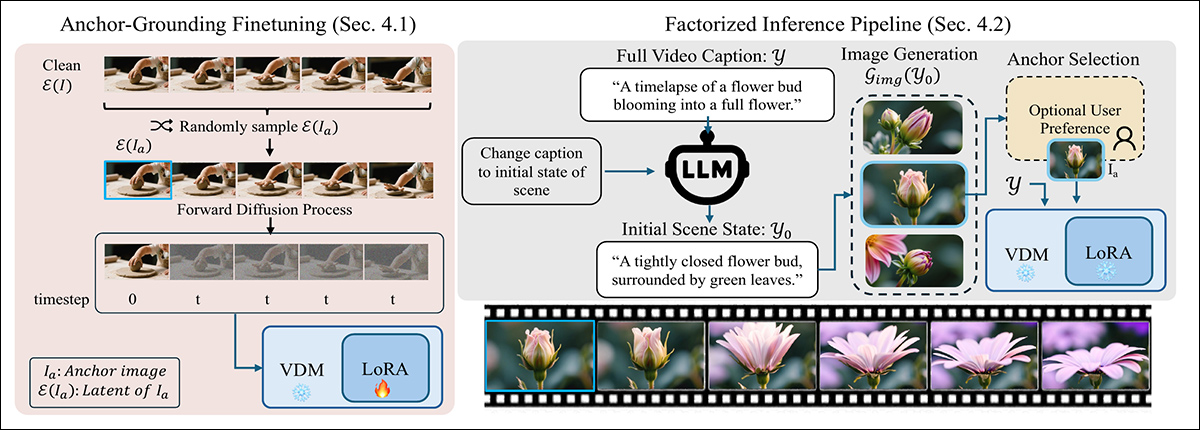

Aby se zajistilo, že model respektuje počáteční snímek, nová metoda narušuje standardní difúzní proces injekcí čistého latentního z kotvicího obrazu na časovém kroku nula, místo jednoho z obvyklých šumových vstupů. Tento neznámý vstup zpočátku zmást model, ale s minimální LoRA fine-tuningem, se naučí zacházet s injektovaným snímkem jako s pevným vizuálním kotvením, spíše než jako součástí šumové trajektorie:

Dvoufázová metoda pro ukotvení text-to-video generace s vizuálním kotvením: Vlevo, model je fine-tuned pomocí lehkého LoRA, aby zacházel s injektovaným čistým latentním jako s pevnou scénickou omezením. Vpravo, podnět je rozdělen na první snímkový popis, který je použit pro generování kotvicího obrazu, který řídí video.

Během inference, metoda přepisuje podnět, aby popisoval pouze první snímek, pomocí LLM pro extrakci pravděpodobného počátečního scénického stavu zaměřeného na rozložení a vzhled.

Tento přepisovaný podnět je předán generátoru obrazu pro výrobu kandidátního kotvicího snímku (který může být volitelně upraven uživatelem). Vybraný snímek je zakódován do latentního a injektován do difúzního procesu nahrazením prvního časového kroku, umožňující modelu generovat zbytek videa přitom zůstává ukotvený k počáteční scéně – proces, který funguje bez požadavku na změny základní architektury.

Proces byl testován vytvořením LoRAs pro Wan2.2-14B, Wan2.1-1B, a CogVideo1.5-5B. LoRA trénink byl proveden na rank 256, na 5000 náhodně vybraných klipů z UltraVideo sbírky.

Trénink trval 6000 kroků a vyžadoval 48 GPU hodin† pro Wan-1B a CogVideo-5B, a 96 GPU hodin pro Wan-14B. Autoři uvádějí, že Wan-5B nativně podporuje text-only a text-image kondicionování (které jsou v tomto případě vynuceny na starší rámce), a proto nevyžadoval žádný fine-tuning.

Testy

V experimentech provedených pro proces, každý textový podnět byl inicializován pomocí Qwen2.5-7B-Instruct, který použil výsledek pro generování podrobného “seed image” popisu obsahujícího popis celé scény. Tento popis byl poté předán QwenImage, který měl za úkol vygenerovat “magický snímek” pro vložení do difúzního procesu.

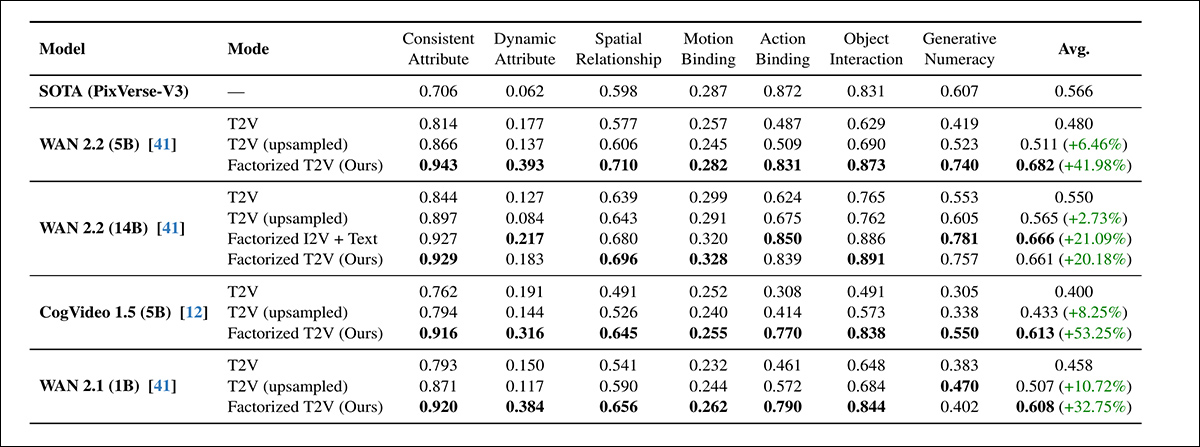

Benchmarky použité pro hodnocení systému zahrnovaly výše zmíněný T2V-CompBench, pro testování kompoziční understanding tím, že ohodnotí, jak dobře modely zachovaly objekty, atributy a akce v koherentní scéně; a VBench 2.0, pro hodnocení širšího rozumění a konzistence napříč 18 metrikami, seskupenými do tvůrčího, zdravého rozumění, ovladatelnosti, lidské věrnosti, a fyziky:

Na všech sedmi hodnocení kategorií T2V-CompBench, factorized T2V metoda překonala standardní a upsampled T2V baseline pro každý testovaný model, s zisky dosahujícími až 53,25%. Nejvyšší skóre varianty často odpovídaly nebo překonaly proprietární PixVerse-V3 benchmark.

Ohledně této počáteční série testů, autoři uvádějí*:

‘[Na] všech modelech, přidání kotvicího obrazu konzistentně zlepšuje kompoziční výkony. Všechny menší factorized modely (CogVideo 5B, Wan 5B a Wan 1B) překonávají větší Wan 14B T2V model.

‘Náš factorized Wan 5B také překonává komerční PixVerse-V3 baseline, který je nejlepší reportovaný model na benchmarku. To demonstruje, že vizuální kotvení podstatně zlepšuje scénickou a akční understanding, i v menších kapacitních modelech.

‘V rámci každé modelové rodiny, factorized verze překonává původní model. Značně, náš lehký kotvicí LoRA na WAN 14B dosahuje výkonu srovnatelného s jeho pretrained I2V 14B variantou (0,661 vs. 0,666), a to bez potřeby plného přeškolování.’

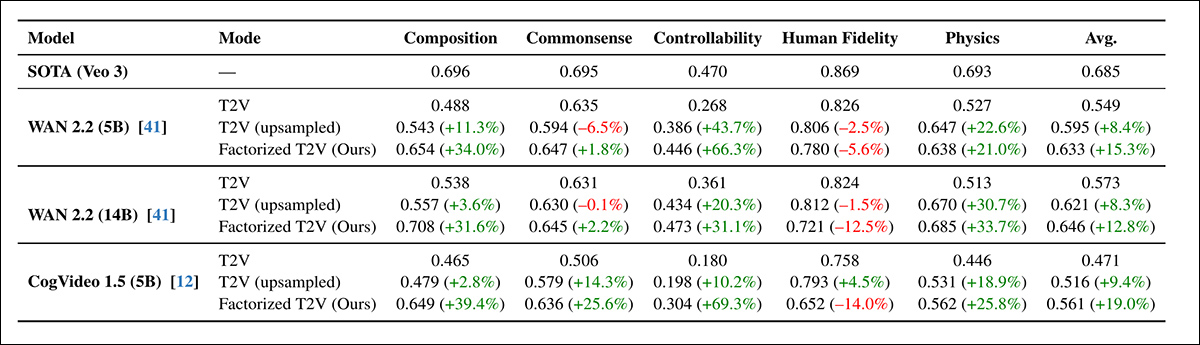

Další přišla VBench2.0 série:

Factorized T2V přístup konzistentně zlepšuje VBench 2.0 výkon napříč kompozicí, zdravým rozuměním, ovladatelností a fyzikou, s některými zisky překonávajícími 60% – i když lidská věrnost zůstala pod proprietární Veo 3 baseline.

Na všech architekturách, factorized přístup zvýšil skóre ve všech VBench kategoriích, kromě lidské věrnosti, která lehce poklesla, i s upsamplováním podnětu. WAN 5B překonával větší WAN 14B, posilující předchozí T2V-CompBench výsledky, že vizuální kotvení přispělo více než velikost.

Zatímco zisky na VBench byly konzistentní, byly menší než ty, které byly vidět na T2V-CompBench, a autoři připisují toto skutečnosti, že VBench má přísnější binární hodnocení režim.

Pro kvalitativní testy, práce poskytuje statické obrázky, ale odkazujeme čtenáře na kompozitní videa vložená do tohoto článku, pro jasnější představu, s výhradou, že zdrojová videa jsou četnější a rozmanitější, stejně jako mají větší rozlišení a detail. Najdete je zde. Ohledně kvalitativních výsledků, práce uvádí:

‘Kotvená videa konzistentně vykazují přesnější scénickou kompozici, silnější objekt-atribut vazbu a jasnější temporální progresi.’

Factorized metoda zůstala stabilní, i když byl počet difúzních kroků snížen z 50 na 15, ukazující téměř žádnou ztrátu výkonu na T2V-CompBench. Naopak, obě text-only a upsampled baseline se zhoršily výrazně za stejných podmínek.

Ačkoli snížení kroků mohlo teoreticky ztrojnásobit rychlost, plná generativní pipeline se stala pouze 2,1x rychlejší v praxi, kvůli fixním nákladům z kotvicího obrazu generace. Přesto, výsledky ukazují, že kotvení nejen zlepšuje vzorkovací kvalitu, ale také pomáhá stabilizovat difúzní proces, podporující rychlejší a efektivnější generaci bez ztráty přesnosti.

Projektový web poskytuje příklady upsampled vs. nové metody generací, z nichž nabízíme několik (nižší rozlišení) editovaných příkladů zde:

Kliknutím spustíte (bez zvuku). Upsampled počáteční zdroje vs. autorů factorized přístup.

Autoři uzavírají:

‘Naše výsledky naznačují, že zlepšené kotvení, spíše než zvýšená kapacita sama o sobě, může být stejně důležité. Nedávné pokroky v T2V difúzi se spoléhaly silně na zvýšení modelové velikosti a tréninkových dat, ale i velké modely často zápasí s odvozením koherentní počáteční scény z textu samotného.

‘To kontrastuje s obrazovou difúzí, kde škálování je relativně přímočaré; ve videových modelech, každá architektonická zlepšení musí operovat přes další temporální dimenzi, což škálování podstatně více náročné.

‘Naše zjištění ukazují, že zlepšené kotvení může doplnit škálování řešením jiné úzké místo: stanovení správné scény před tím, než začne syntéza pohybu.

‘Factorizací video generace do scénické konstrukce a temporální modelace, zmírníme několik společných selhání bez požadavku na podstatně větší modely. Považujeme toto za komplementární návrhový princip, který může vést budoucí architektury k více spolehlivým a strukturovaným video syntézám.’

Závěr

Ačkoli problémy s entanglementem jsou velmi reálné a mohou vyžadovat speciální řešení (jako zlepšenou kuraci a distribuční hodnocení před tréninkem), bylo fascinující sledovat, jak factorizace “rozlepila” několik zatvrzelých a “zablokovaných” konceptů do mnohem přesnějších renderování – s pouze mírnou vrstvou LoRA kondicionování a zásahem pozoruhodně zlepšeného start/seed obrazu.

Propast v zdrojích mezi lokální hobbyist inferencí a komerčními řešeními nemusí být tak obrovská, jak se zdá, protože téměř všichni poskytovatelé se snaží racionalizovat své značné GPU výdaje pro spotřebitele.

Anekdoticky, velmi velký počet současných generativních video poskytovatelů se zdá, že používají značkové a obecně “vylepšené” verze čínských otevřených zdrojových modelů. Hlavní “moat” těchto systémů se zdá být, že se jim podařilo trénovat LoRAs, nebo – za větší náklad a trochu větší odměny – provedly plné fine-tuning modelových vah††.

Insights tohoto druhu mohou pomoci uzavřít tuto propast dále, v kontextu scény, kde Číňané se zdají být odhodláni (ne nutně z altruistických nebo idealistických důvodů) demokratizovat gen AI, zatímco západní obchodní zájmy by snad raději viděli, že se zvyšující velikost modelu a regulace nakonec uzavřou za API a několika vrstvami obsahu filtrů.

* Autoři zdůrazňují, ne já.

† Práce nespecifikuje, který GPU byl zvolen, nebo kolik jich bylo použito.

†† Ačkoli LoRA cesta je pravděpodobnější, jak pro ekonomickou snadnost použití, tak protože plné váhy, spíše než quantizované váhy, nejsou vždy k dispozici.

Poprvé publikováno v pátek, 19. prosince 2025