Anderson 视角

使用 AI 提升真实照片的质量,在拍照前

与其使用 GenAI 来修复照片 之后 你拍摄它们,研究人员训练了一个系统,告诉你如何移动、摆姿势和构图,利用对什么使照片难忘的知识。

修复照片的后期处理已经变得越来越容易,一段时间以来,制造商和技术平台越来越多地提供相机内编辑,允许用户在拍摄后立即更改图像。这种类型的流行系统包括 Google 的 对话式编辑 和 Samsung 的 生成编辑 等。

然而,一个新兴的趋势偏爱“真实性”而不是 AI 提升的结果,这可能意味着许多消费者开始将“修改”的照片视为 AI 垃圾。

也许这就是为什么 Google 创建了一个 AI 训练的“相机教练”,它受 Gemini 的启发,能够在拍摄过程中直接指示如何提高照片质量:

Google 的相机教练告诉用户如何重新构图,另外提供了一些基本的建议。 来源

作为一个专有系统,并且在线上几乎没有关于它的信息,相机教练似乎利用 Gemini 来帮助用户提高构图(如上图所示)或进行微小的姿势变化(例如,靠近或直接看着相机)。

据我们所知,产品将构图推向中位数,可能是基于数百万上传的内容数据点,这些数据点可能贡献了 Gemini 的训练数据。在这个意义上,上传用户通过拒绝不满意的拍摄并上传他们喜欢的照片,创建了 AI 的校准——一种有效的(且免费的)数据集策划!

然而,照片在构图方面被“平均化”并不一定具有与难忘的照片相同的美学价值或观众影响。

超越“奶酪!”和三分法则

为此,并且为了创建一个更易于跨平台使用的系统,意大利的新研究提供了一个类似于教练风格的系统,它基于对什么使照片难忘的先验知识:

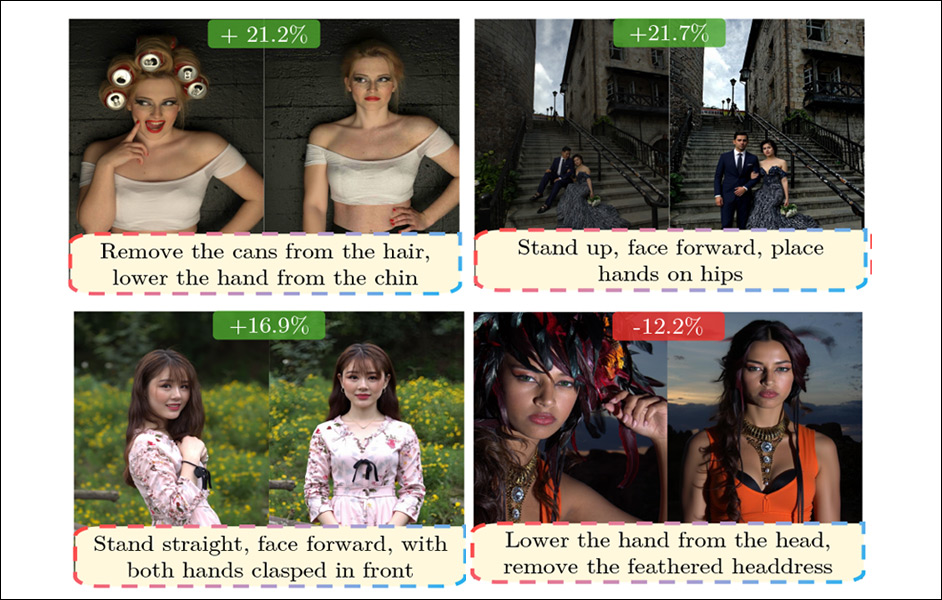

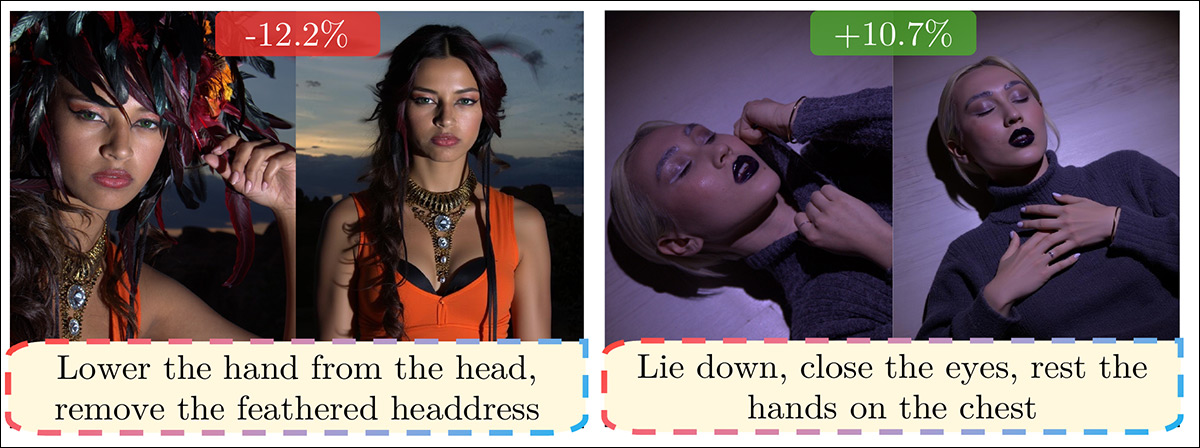

作者新系统的建议示例。 来源

在上面的示例中,我们看到作者新系统(称为 MemCoach)提供的建议,这些建议很难想象一个以构图为中心的 AI,如相机教练,能够提供。在第一个(最左边的)实例中,建议移除头饰尤其值得怀疑;在第二张图片中,很难想象一个传统的构图 AI 可以从一般场景(即一张年轻女性躺在地板上,眼睛闭着的“艺术”照片)中得出什么结论。

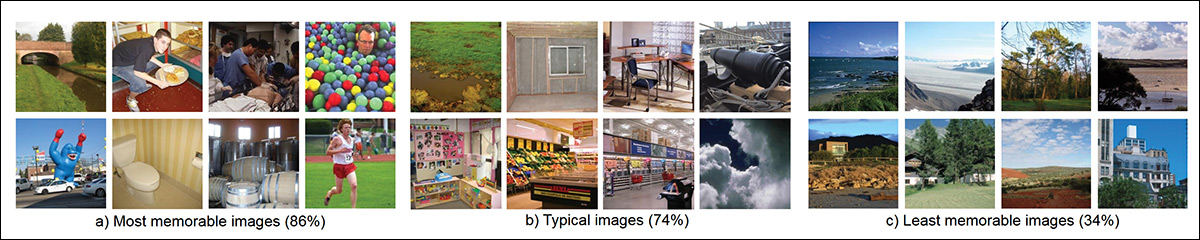

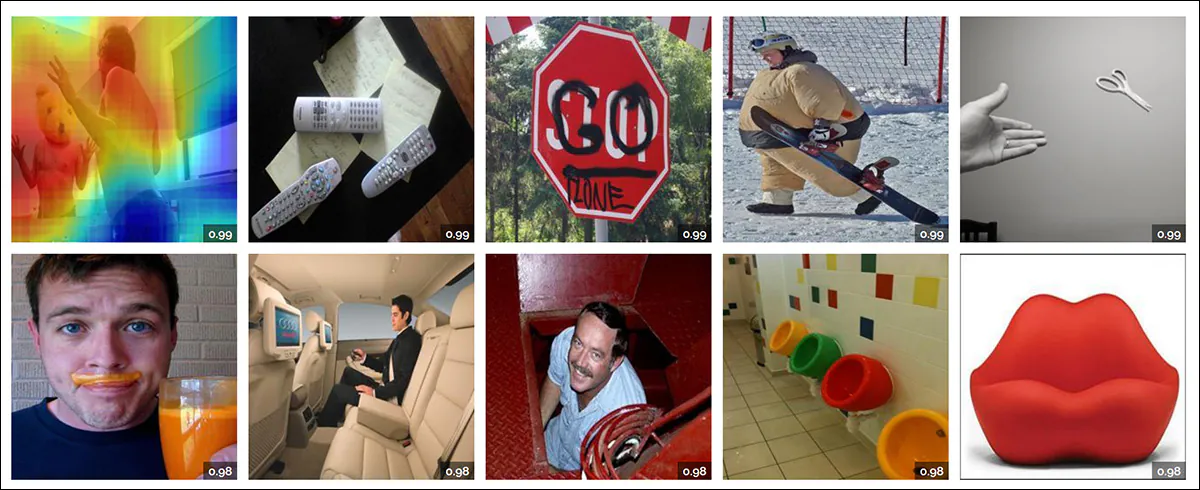

关于照片难忘性的核心理解,用于开发这三个意大利系统,来自各种先前的作品,包括 2015 年的 文章 什么使得一个物体难忘? 和 2013 年的 论文 什么使得一张照片难忘?。

来自 2013 年论文《什么使得一张照片难忘?》的代表性示例,按难忘性划分为好、一般和差。 来源

任何人,像我一样,具有负的 Unix 出生日期,可能会认识到“最不难忘的图像”的模板(上图右上角),来自我们童年时期的无数 幻灯片之夜。正如作者所述:

‘这些作品确定了关键的内在因素,例如 人物的存在、室内场景 或情感表达,而不是物体和 全景视图,以及外在因素,包括背景和 观察者。 ‘

该项目围绕“难忘性反馈”(MemFeed)展开,这在 MemCoach 教练应用程序中得到了体现,并且基于 PPR10K 数据集创建了一个基准(称为 MemBench)。

来自论文《PPR10K:一个大规模人像照片修饰数据集,具有人体区域掩码和组级一致性》中的样本。顶行显示原始图像,底行显示专家修饰后的版本以及对应的人体区域掩码。原始照片在视点、背景、照明和相机设置方面差异很大,而修饰后的结果显示出更好的视觉质量和更强的一致性。 来源

该论文观察到,照片中的难忘性是可以量化的,而不是主观判断的集合,而且作者进一步指出,这个属性已经在照片(各种 作品)和视频(各种 其他 作品)中都被识别出来。

新论文的标题为 如何拍摄一张难忘的照片?赋予用户可行的反馈,来自意大利特伦托大学、比萨大学和布鲁诺·凯斯勒基金会的四位研究人员。附件项目页面 MemCoach 表明,GitHub 代码和 Hugging Face 主持的数据将在下个月(2026 年 3 月)可用。

方法

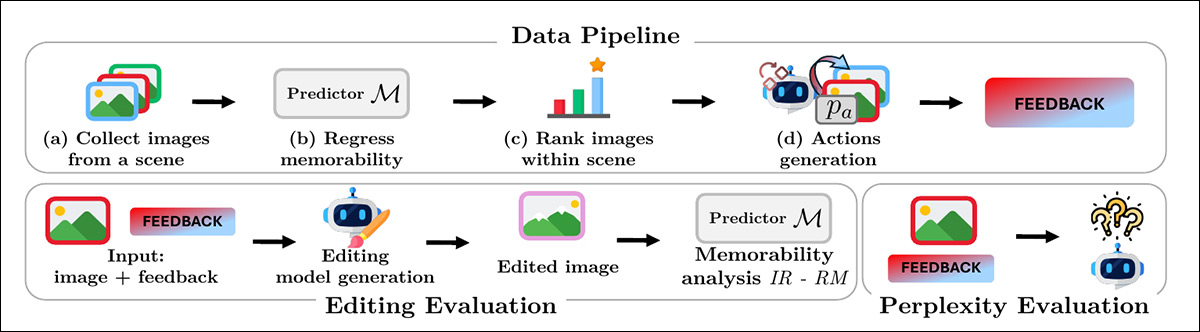

为了从源 PPR10K 人像数据集中策划 MemBench 数据集,研究人员将同一场景的照片分组,并使用基于 CLIP 特征 的训练预测器对每张图像进行难忘性评分。然后,他们根据难忘性在每个场景内对照片进行排名,并相应地配对:

MemBench 构建和评估的概述。顶行描述了数据管道,从按场景分组图像和预测难忘性到排名照片和生成难忘性感知的操作反馈。底行说明了评估,通过基于编辑的难忘性增益和困惑度评分来衡量反馈质量。

对于每对照片,使用 InternVL3.5 模型生成自然语言描述,以解释不太难忘的版本和更难忘的版本之间的可见差异;这些描述将构成难忘性反馈系统的训练信号。

相比之下,研究人员寻求更细致的解释†:

‘与专注于事后更正的计算摄影调整(例如“使图像更亮”)相反,我们专注于用户可以现场采取的语义操作,以获得更好的拍摄效果,例如“面对面”。’

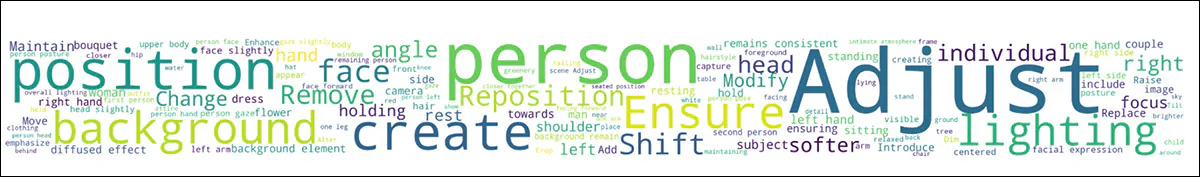

最终的 MemBench 集合包含大约 10,000 张图像,分组为 1,570 个场景,每个场景平均有 6.5 张图像。作者生成的词云(见下图)表明数据集中有广泛的语义类别:

MemBench 中最常见的词的词云。

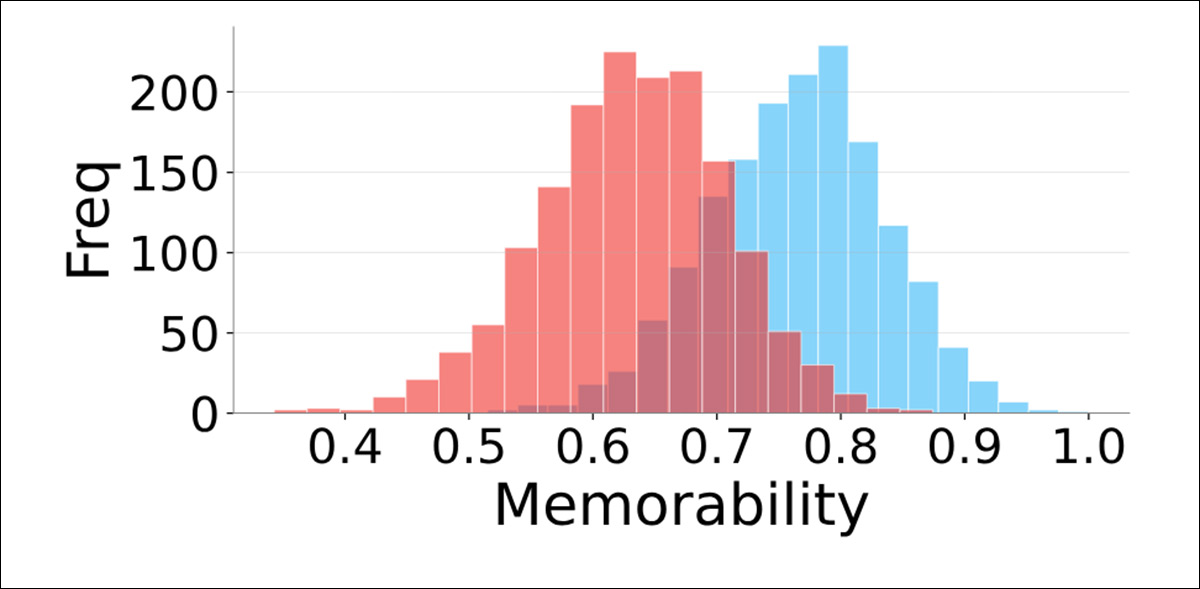

源照片的平均难忘性评分为 0.63,而同一场景中最难忘的照片的评分范围从 0.51 到 1.0,不同评分之间有一定的重叠:

比较每个场景中最不难忘和最难忘图像的难忘性评分分布。

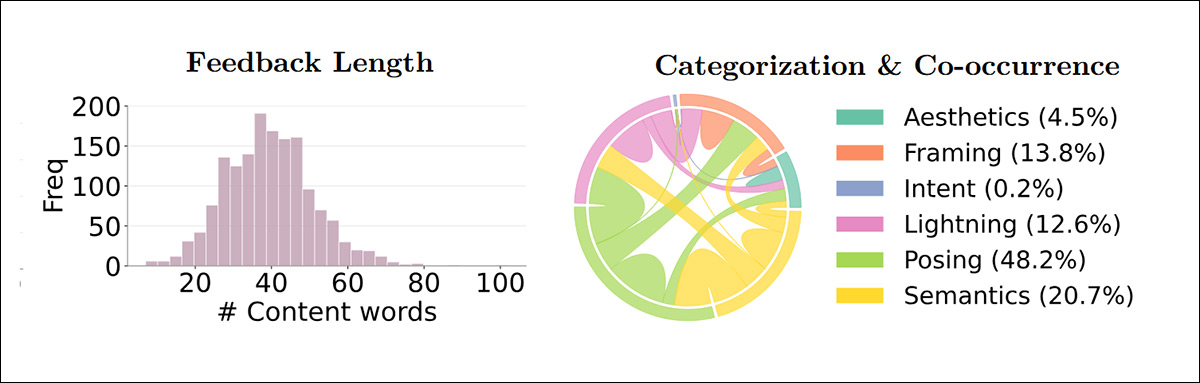

反馈的长度从 7 个字的短语到较长的指令(见下图左侧)不等。每条建议都使用 GPT-5 Mini 分解为小的操作类型(见下图右侧):

反馈长度分布,以内容词为单位测量,并使用和弦宽度表示不同类别之间的共现频率来分类原子子操作。

作者指出,大多数建议都集中在主题的姿势上,其次是对意义或场景内容的更改,构图通常与姿势相关,照明调整通常与语义更改相关。

通量电容器

为了评估反馈是否提高了难忘性,模拟了用户的遵守性,使用 FLUX.1 Kontext 生成模型作为摄影师的代理。给定源图像和文本反馈,FLUX 生成一个模拟所建议更改的编辑版本:

左侧的图像是真实的,来自数据集,右侧的图像是由 Flux 根据提示(黄色,下方)生成的。这样,可以在不需要大量人工参与的情况下评估提示的有效性。这种知识最终将反馈到 MemCoach 框架中,并且代表了可以迭代改进此类系统的工作流程(最终使用真实世界而不是 Flux 示例)。

原始图像和编辑图像都传递给难忘性预测器,允许测量编辑版本获得更高评分的频率——称为 改进率——以及相对于起始图像的增益大小,称为 相对难忘性。

还计算了与难忘性焦点参考建议的相似性,通过计算 困惑度 与基准描述,并在场景级别应用 80-20 拆分,以便仅在训练期间未使用的场景上进行测试。

当前状态

测试了当前多模态大型语言模型的难忘性意识。向几个领先模型展示了 LaMem 数据集中的图像,并询问它们图像是否难忘。然后将模型的置信度估计与原始研究中人类观察者分配的评分进行比较:

<img class=" wp-image-286044" src="https://www.unite.ai/wp-content/uploads/2026/02/table-1-and-figure-4.jpg" alt="表明基线多模态模型不捕捉难忘性的测试。左侧,模型预测和 LaMem 基准评分之间的 斯皮尔曼秩相关性,LaMem 中的标注者间协议作为参考。右侧,相对于编辑基线,零次反馈的改进率,仅显示边际增益。” width=”727″ height=”275″ /> 表明基线多模态模型不捕捉难忘性的测试。左侧,模型预测和 LaMem 基准评分之间的 斯皮尔曼秩相关性,LaMem 中的标注者间协议作为参考。右侧,相对于编辑基线,零次反馈的改进率,仅显示边际增益。

几乎没有发现与人类判断有意义的相关性,尽管经过大规模预训练,作者断言这些模型没有跟踪人们一致记住的内容。

LaMem 数据集的示例。左上角,我们还看到一个热图。 来源

MemCoach

MemCoach 专注于语义、现场指令,可以在按下快门之前执行,例如调整姿势、改变主题之间的交互或修改场景元素。MemCoach 提供的反馈从 7 到 102 个内容词不等。论文认为,难忘性似乎更多地由主题配置和叙事线索驱动,而不是简单的构图调整:

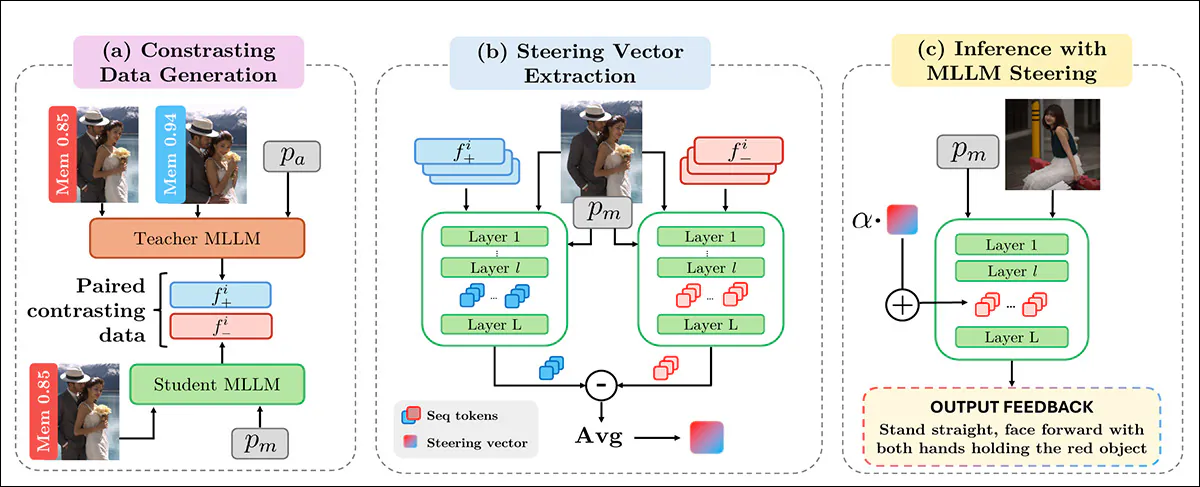

MemCoach 流水线的概述,其中来自教师 MLLM 的难忘性感知指导与中性学生响应配对,形成对比数据;层之间的激活差异被平均以推导难忘性导向向量;并且该向量在推理时被注入以在不需要额外训练的情况下将学生激活转向产生改进的、难忘性导向的反馈。

测试

在测试阶段,使用了七个多模态大型语言模型(MLLMs)来测试新系统:Qwen2.5V.L;InternVL3_5-8B;Idefics3-8B;以及 LLaVA-OneVision-1.5。此外,GPT-5 Mini 作为代表性闭源模型被包含在内,连同美学专用模型 Q-Instruct 和 AesExpert。MLLMs 作为零次和教师神谕操作。

InternVL3.5 用于教师和学生模型,使用 MemBench 训练拆分来创建对比示例:

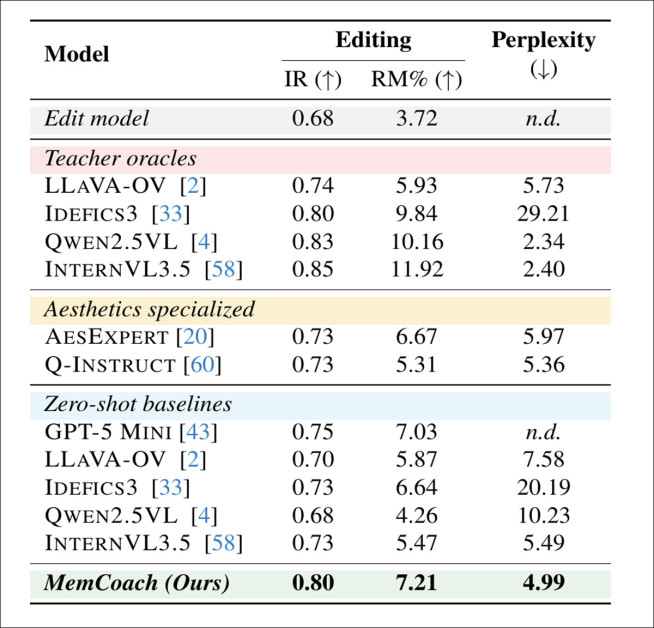

MemCoach 的性能与最先进的 MLLM 相比,跨教师神谕、美学专用模型和零次基线,显示出更高的改进率和具有竞争力的相对难忘性,以及最低的困惑度,表明反馈更一致、更具难忘性导向。

在上表中,我们看到 MemCoach 似乎比任何比较模型提供更有效的难忘性建议——并且引导的 InternVL3.5 模型更频繁地提高难忘性,并且提高的幅度更大,相比 GPT-5 Mini,改进率提高了 5%,相对难忘性提高了 31.81%。

它还优于专注于美学的系统,尽管不需要额外的训练。更低的困惑度,论文声称,进一步表明其反馈遵循人类难忘性判断倾向于奖励的相同语言模式:

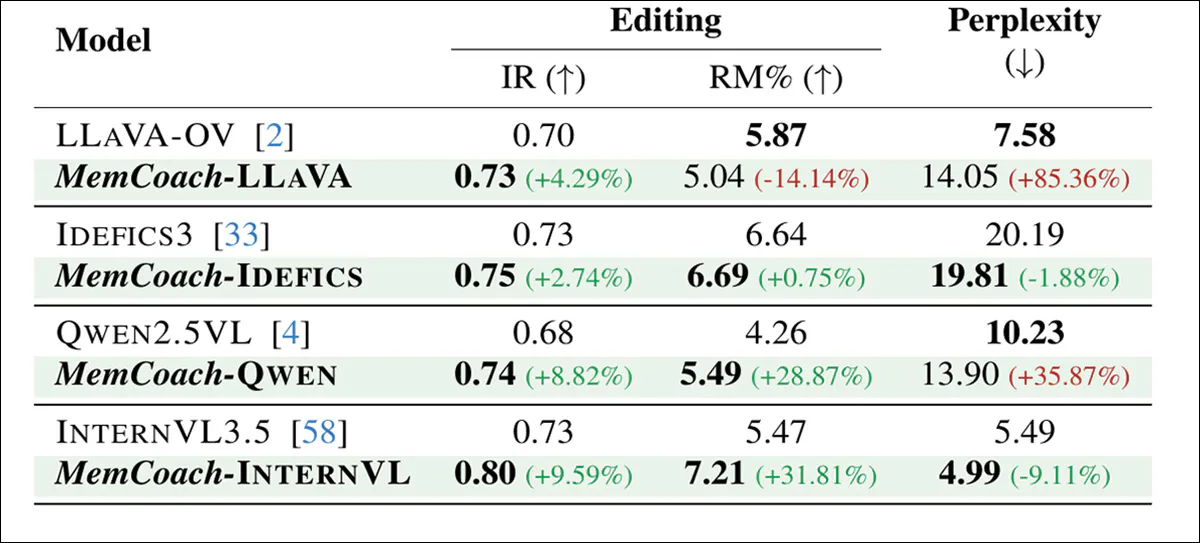

显示 MemCoach 在多个多模态骨架上提高难忘性导向反馈的一般化结果,始终提高改进率和相对难忘性,同时减少大多数模型的困惑度。

然后进行了定性评估,分析了 MemCoach 反馈的示例,其中源图像、自然语言建议和想象的改进结果并排显示:

MemCoach 生成的难忘性导向反馈的定性示例。每个三元组显示源图像、自然语言指令和结果编辑图像,相对难忘性(RM)表示测量的变化。指导范围从姿势和凝视调整到语义干预,例如对象删除,展示了成功的收益和删除不寻常元素会降低难忘性的情况。

作者指出:

‘这些示例突出了模型提出的建议的多样性,范围从细粒度的构图调整(例如改变凝视方向、姿势或手部位置)到语义干预(例如对象删除或面部表情变化)。’

‘反馈自然可解释且可执行,表达为简洁的文本指令(通常涉及动词“带来”、“站立”、“删除”),可以直接实施,有效地阐述如何拍摄一张难忘的照片。’

结论

比较 Google 的封闭式方法和 MemBench 项目的方法论将会非常有趣,特别是要了解 Google 使用了什么核心标准、参考和数据库来定义系统的美学标准。

这种类型的系统的负面方面,无论是开源还是闭源,在大规模上都存在风险,即强制执行统一的标准,这些标准注定会变成模因和陈词滥调——一种视觉上的等价物,类似于 AI 破折号辩论,其中“正确”的程序已经在 随意使用 中变得有些被诅咒。

* 我将作者的内联引用转换为超链接,如果链接在文章的其他地方没有显示。

† 该论文在这里(以及其他几处)引用了“补充材料”,我无法从论文、核心 Arxiv 列表或项目网站找到它。

首次发布于 2026 年 2 月 26 日星期四