人工智能

少即是多:为什么检索较少的文档可以提高 AI 答案的质量

检索增强生成(RAG) 是一种构建 AI 系统的方法,它将语言模型与外部知识源结合起来。简单来说,AI 首先搜索与用户查询相关的文档(如文章或网页),然后使用这些文档生成更准确的答案。这种方法因帮助 大型语言模型(LLM) 保持事实性和减少幻觉而受到赞扬,因为它们将响应基础在真实数据中。

直观地,人们可能会认为,AI 检索的文档越多,其答案就越好。然而,最近的研究表明了一个令人惊讶的转折:在向 AI 提供信息时,有时少即是多。

较少的文档,较好的答案

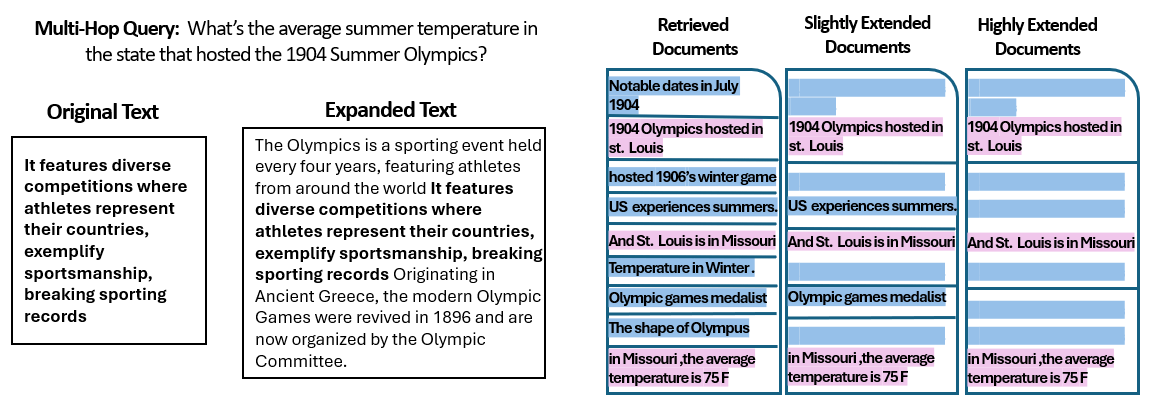

希伯来大学耶路撒冷分校的研究人员进行了一项 新研究,探讨了 RAG 系统中提供的文档数量如何影响其性能。关键是,他们保持了总文本长度不变,这意味着如果提供的文档较少,则这些文档会稍微扩展以填充与许多文档相同的长度。这样,任何性能差异都可以归因于文档数量而不是简单的输入长度。

研究人员使用了一个包含琐事问题的问答数据集(MuSiQue),每个问题最初与 20 个维基百科段落配对(只有少数包含答案,其他的都是干扰项)。通过将文档数量从 20 减少到只有 2-4 个真正相关的文档,并用一点额外的上下文填充以保持一致的长度,他们创建了场景,其中 AI 有较少的材料来考虑,但仍然大约有相同数量的单词来读取。

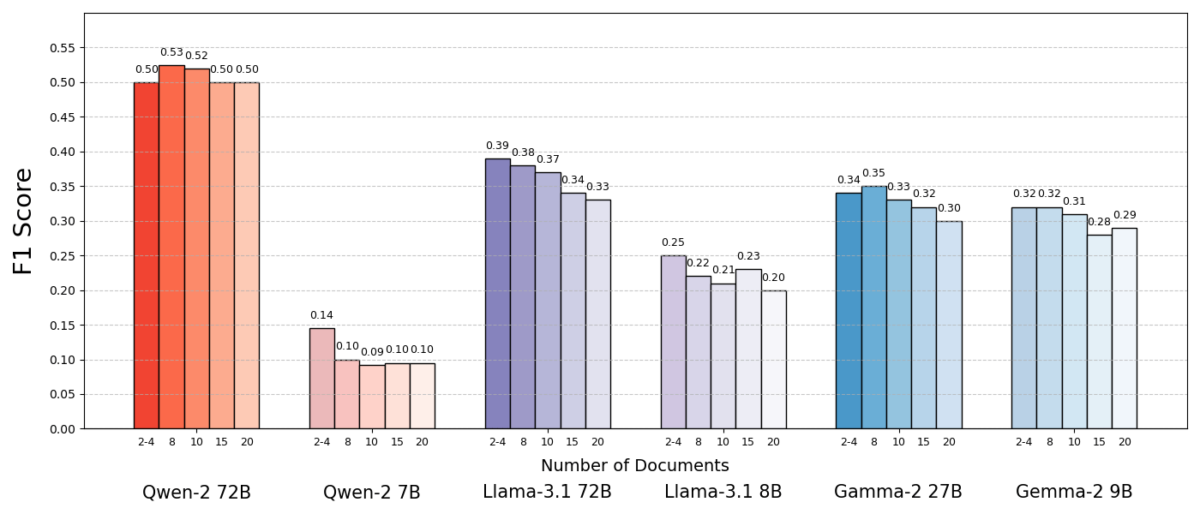

结果很惊人。在大多数情况下,AI 模型在给出较少文档而不是全部文档集时回答得更准确。性能显著提高,在某些情况下,当系统仅使用少数支持文档而不是大量集合时,准确率提高了多达 10%(F1 得分)。这种违反直觉的提升在几种不同的开源语言模型中都观察到了,包括 Meta 的 Llama 和其他模型的变体,表明这种现象不仅限于单个 AI 模型。

一个模型(Qwen-2)是一个值得注意的例外,它可以处理多个文档而不会降低分数,但几乎所有测试的模型在整体上都表现得更好,使用的文档较少。换句话说,添加更多参考材料超出了关键相关部分,实际上更常损害其性能而不是帮助。

来源:Levy 等

为什么这是一个惊喜?通常,RAG 系统的设计假设检索更广泛的信息只能帮助 AI——毕竟,如果答案不在前几个文档中,它可能在第十或第二十个文档中。

这项研究颠覆了这种说法,证明了不加区别地添加额外文档可能会适得其反。即使总文本长度保持不变,多个文档的存在(每个文档都有自己的上下文和怪癖)使得问答任务对 AI 更具挑战性。似乎,一旦超过某个点,每个额外文档都会引入更多噪音而不是信号,混淆模型并损害其提取正确答案的能力。

为什么 RAG 中的少即是多

这种“少即是多”的结果在我们考虑 AI 语言模型如何处理信息时是有道理的。当 AI 只提供最相关的文档时,它看到的上下文是专注的,摆脱了干扰,就像一个学生被交给了正确的页面来学习。

在这项研究中,模型在仅提供支持文档且不相关材料被删除时性能显著提高。剩余的上下文不仅更短,而且更干净——它包含直接指向答案的信息,除此之外什么都没有。由于文档较少,模型可以将其全部注意力集中在相关信息上,使其不太可能被分散注意力或混淆。

另一方面,当检索到很多文档时,AI 必须筛选相关和不相关内容的混合。这些额外文档经常是“相似但无关”的——它们可能与查询共享一个主题或关键词,但实际上并不包含答案。这样的内容可能会误导模型。AI 可能会浪费精力尝试在实际上并不指向正确答案的文档之间建立联系,或者更糟糕的是,它可能会错误地合并来自多个来源的信息。这增加了幻觉的风险——AI 生成听起来合理但不基于任何单一来源的答案。

本质上,向模型提供过多文档会稀释有用的信息并引入相互冲突的细节,使得 AI 更难确定什么是真实的。

有趣的是,研究人员发现,如果额外文档明显不相关(例如,随机无关文本),模型更擅长忽略它们。真正的麻烦来自于看似相关的干扰数据:当所有检索文本都在类似主题上时,AI 假设它应该使用所有这些文本,并且它可能难以判断哪些细节实际上很重要。这种观察与研究结果一致,即“随机干扰项比现实干扰项造成的混淆更少”。AI 可以过滤掉明显的无稽之谈,但微妙的离题信息是一个狡猾的陷阱——它以相关性为幌子潜入并破坏答案。通过将文档数量减少到真正必要的文档,我们避免了最初设置这些陷阱。

还有一种实际的好处:检索和处理较少文档降低了 RAG 系统的计算开销。每个被拉入的文档都必须被分析(嵌入、读取和由模型关注),这使用了时间和计算资源。消除多余文档使得系统更高效——它可以更快、更低成本地找到答案。在准确率通过关注较少来源而提高的场景中,我们获得了双赢:更好的答案和更精简、更高效的流程。

来源:Levy 等

重新思考 RAG:未来方向

这种新的证据表明,在检索中,质量往往优于数量,对于依赖外部知识的 AI 系统的未来具有重要意义。它表明,RAG 系统的设计师应该优先考虑智能过滤和文档排名,而不是简单地获取大量文档。与其获取 100 个可能的段落并希望答案埋藏在某个地方,不如获取前几个高度相关的段落。

研究作者强调了检索方法需要在提供给模型的信息中“平衡相关性和多样性”的必要性。换句话说,我们希望提供足够的主题覆盖范围来回答问题,但不能太多,以至于核心事实被大量无关文本淹没。

在未来,研究人员可能会探索帮助 AI 模型更好地处理多个文档的技术。一个方法是开发更好的检索系统或重新排序器,以确定哪些文档真正增加了价值,哪些文档只引入了冲突。另一个角度是改进语言模型本身:如果一个模型(如 Qwen-2)能够处理多个文档而不会失去准确性,研究它的训练或结构可能会提供有关如何使其他模型更强大的线索。也许未来的大型语言模型将包含识别何时两个来源说的是同一件事(或相互矛盾)并相应地关注的机制。目标将是使模型能够利用多种来源的丰富信息而不会陷入混淆——有效地同时获得两全其美的效果(信息的广度和关注的清晰度)。

值得注意的是,随着 AI 系统获得更大的上下文窗口(一次读取更多文本的能力),简单地将更多数据转储到提示中并不是万能的。更大的上下文并不自动意味着更好的理解力。这项研究表明,即使 AI 可以技术上一次读取 50 页,如果给它 50 页的混合质量信息,可能不会产生良好的结果。模型仍然从精心策划的相关内容中受益,而不是不加区别的数据转储。事实上,智能检索可能会在巨大上下文窗口时代变得更加重要——以确保额外的容量用于有价值的知识,而不是噪音。

“更多文档,相同长度”(这篇恰如其分的论文)研究的发现鼓励我们重新审视我们在 AI 研究中的假设。有时,将所有数据提供给 AI 并不像我们想象的那样有效。通过关注最相关的信息,我们不仅提高了 AI 生成答案的准确性,还使系统更加高效和值得信赖。这是一个违反直觉的教训,但它具有令人兴奋的影响:未来的 RAG 系统可能通过仔细选择检索的较少、更好的文档而变得更聪明、更精简。