Anderson 视角

通过秘密跟踪数据识别 AI 模型盗窃

一种新方法可以在几秒钟内秘密地为类似 ChatGPT 的模型添加水印,而无需重新训练,并且在一般输出中不会留下任何痕迹,并且可以经受住所有可行的删除尝试。

水印和“版权诱饵”的微妙区别在于,水印(无论是明显的还是隐藏的)通常旨在出现在整个集合(例如图像数据集)中,以阻止随意复制。

相比之下,虚构的条目是一段小的文本,通常是一个词语或定义,出现在一个大型且相对通用的集合中,旨在证明盗窃。当整个作品被非法复制时,无论是作为一个独立的作品还是作为一个衍生作品,原始所有者所种植的“唯一”和虚假的事实的存在将很容易揭示盗窃行为。

在向大型语言模型(LLM)和视觉语言模型(VLM)添加水印方面,输出中包含这些线索的程度通常在以下两个目标之间分裂:确保所有或大部分输出包含明显或潜在的水印;或者确保可以恢复一个“秘密令牌”,以证明盗窃——但它不会出现在模型的正常输出中。

证据的重量

后一种方法得到了中国、意大利和新加坡之间的一项有趣合作的解决,这项工作旨在为开源模型提供一种披露方法,以便它们不能轻易被商业化或以其他方式使用,而原始许可证则不允许。

例如,模型的原始许可证可能规定,任何人都可以在使自己的修改或更改公开可用时从作品中获利,条件是他们必须在相同的慷慨许可条款下公开可用——但一家公司可能希望保留对其“调整”的控制(例如,对模型进行微调),以创建一个不存在的护城河。

大部分研究都集中在与封闭源、仅 API 模型或仅可用优化(量化)权重的模型相关的检测例程上;这些模型更难以高效地编辑和修改,就像新论文所提议的那样(因为无法直接访问模型的架构)。

这种对 FOSS 发布的关注可能并不令人惊讶,因为中国的 AI 输出在过去一年中一直以慷慨地发布全重量模型为标志,这些模型至少可以与更“锁定”的西方等价物相媲美。

新方法,称为 EditMark,通过不需要对模型进行微调来添加“被污染”的数据,也不需要从一开始就将数据包含在训练中来区分自己。

这有几个好处:一个是,一旦发现和披露,训练数据集中包含的任何“线索”数据就不会再有效,因为它可以直接被攻击者针对;但是,要攻击 EditMark,恶意攻击者需要知道要针对模型的哪个层,并且要采取什么方法。这是一个不太可能的场景。

第二,这种方法很快且很便宜,需要几秒钟(而不是几天甚至几周)来应用于一个训练好的模型,从而消除了微调的巨大开支(微调的成本会随着模型的大小和要应用的数据而线性增加)。

最后,这种方法对模型的正常运行造成的损害远远小于微调或以前的编辑方法。

在测试中,EditMark 实现了 100% 的提取率,它将带有多个可能答案的数学查询嵌入到模型权重中。

作者表示:

‘综合实验表明 EditMark 在水印 LLM 方面具有出色的性能。EditMark 通过在不到 20 秒内嵌入 32 位水印,实现了 100% 的水印提取成功率(ESR)。’

‘值得注意的是,水印嵌入时间不到微调时间的 1/300(平均 6,875 秒),这凸显了 EditMark 实现高容量水印的速度和可靠性。’

‘此外,广泛的实验验证了 EditMark 的稳健性、隐秘性和保真度。’

新论文题为 EditMark:基于模型编辑的水印大型语言模型,由中国科学技术大学、西恩纳大学和新加坡 CFAR/IHPC/A\*STAR 的八位作者共同撰写。

方法

EditMark 方法包括四个组件:生成器、编码器、编辑器 和 解码器:

EditMark 流水线通过编辑模型以特定方式回答数学问题来嵌入水印,从而编码隐藏的标识信息。 来源:https://arxiv.org/pdf/2510.16367

生成器使用伪随机 种子 构造多答案数学问题;编码器根据水印选择答案,然后通过专用编辑过程将其嵌入到模型中。一旦编辑后的模型被发布或滥用,水印可以通过询问相同的问题并解码响应模式来提取。

然后,编辑器修改模型权重,以便当询问这些种子问题时,模型可靠地产生目标答案,从而将水印直接嵌入到其行为中。解码器然后通过将相同的问题提供给嫌疑模型并将其答案翻译回隐藏的签名来恢复水印。

威胁模型

该论文的威胁模型假设水印是在白盒设置中完成的。虽然这在安全相关研究中通常不是一个好兆头,但在这里这是正常的,因为该方法旨在保护拥有完全访问权限的所有者。

攻击者也假设在获得模型后拥有白盒访问权限,这意味着他们可以修改它(例如,通过剪枝或微调)。同样,这种场景在 FOSS 发布的情况下是正常且预期的。然而,攻击者不知道水印提取过程或所用方案,只能通过推断和实验(或泄露)来发现这种方法。

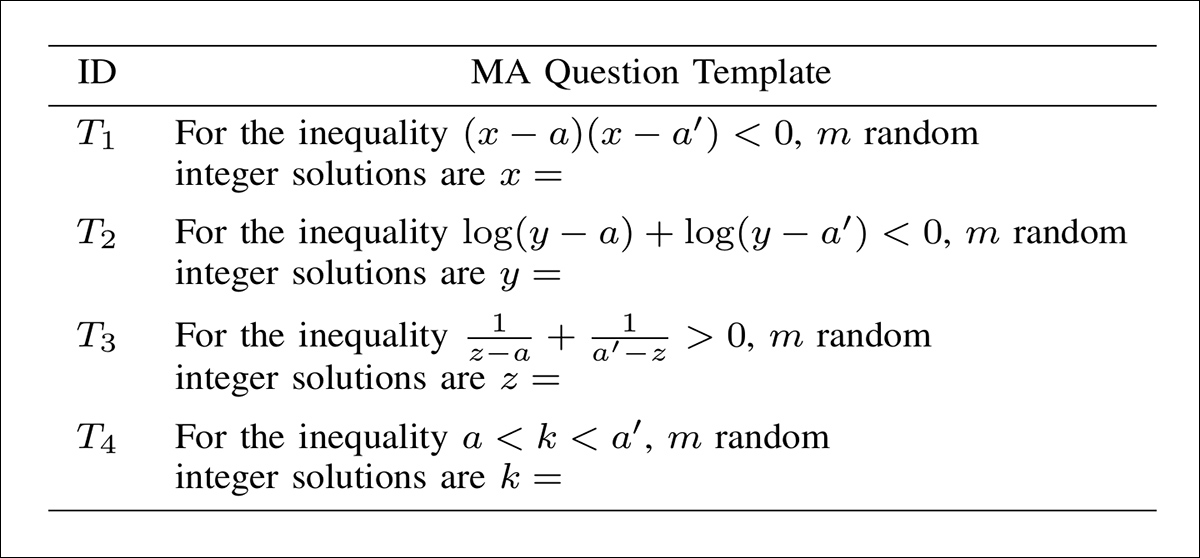

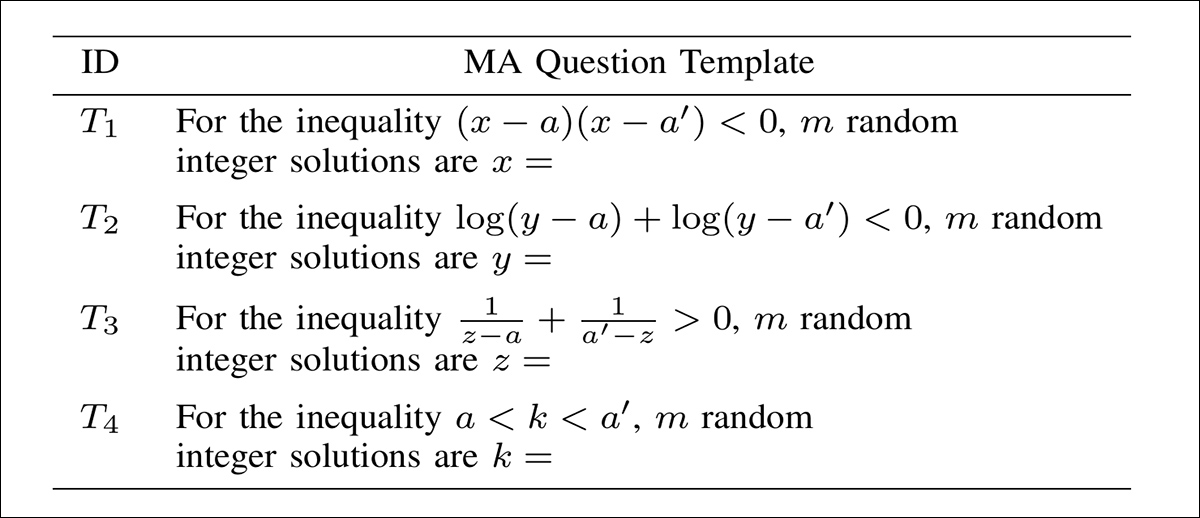

生成器构造逻辑上和事实上有效的数学问题,具有多个正确答案,使用 GPT-4o 来多样化模板(如下所示),并使用伪随机种子来确保每个问题都是唯一的。这使得已知的水印可以通过答案排列 确定性 地嵌入,同时最小化问题之间的重叠,以避免编辑 纠缠 :

用于水印嵌入的 GPT-4o 生成的问题模板,每个模板都结构化为从种子不等式中产生多个有效整数答案。

编码器将每个二进制水印段转换为从给定数学问题的解集中提取的整数的唯一排列。使用 词典排列理论 ,编码器将每个水印块的十进制值映射到 特定的有序答案选择 ,以确保水印以确定性的方式嵌入到模型的行为中。

至于编辑器,原始的 AlphaEdit 模型编辑方法,用于水印,缺乏精度和韧性,修改后的模型经常无法返回所需的答案。它所做的任何修改都很容易被剪枝或噪音破坏。

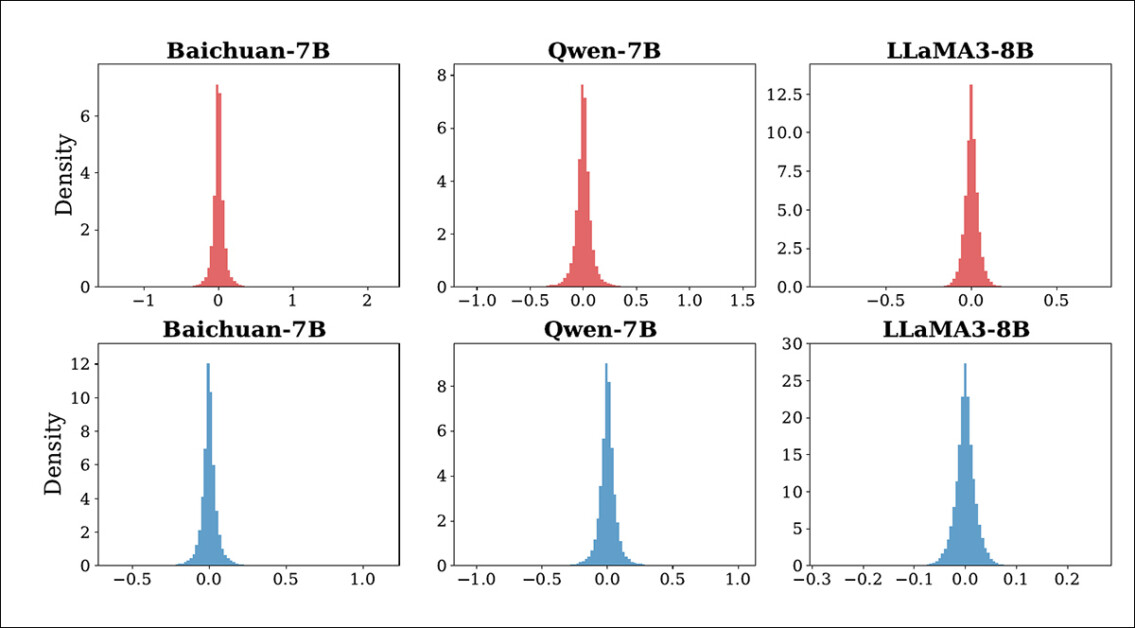

为了克服这一点,作者设计了一种多轮编辑策略,逐渐调整模型权重,直到其响应足够与所需的答案对齐。为了使编辑更能抵抗篡改,他们还在训练期间注入高斯噪音,以模拟攻击:

Baichuan-7B、Qwen-7B 和 LLaMA3-8B 模型在攻击前后 K1 的变化分布。顶行显示随机噪音注入的效果;底行显示模型剪枝的效果。所有更改都接近零,表明攻击不会显著破坏模型的内部行为。

评分系统在编辑足够准确时停止该过程,而 正则化 确保更新在多轮中保持稳定。

解码器询问模型与水印相同的特殊问题,然后读取其答案以推断隐藏的 ID。由于答案的模式遵循一个秘密规则,因此可以在不需要检查模型内部的情况下恢复此 ID。

数据和测试

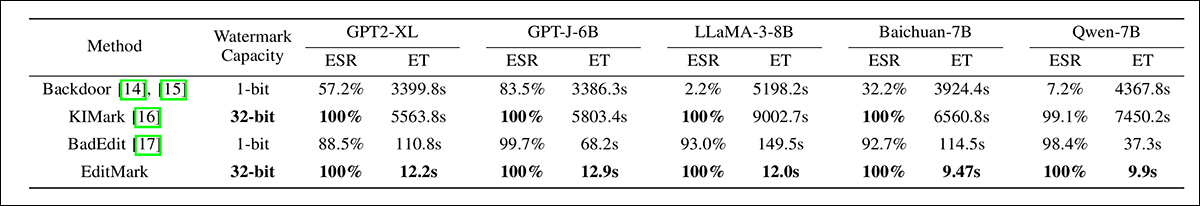

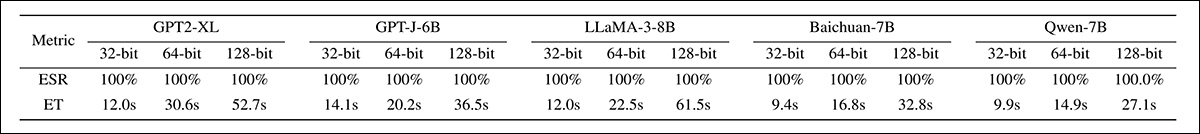

为了测试 EditMark,评估了五个 LLM:GPT2-X;GPT-J-6B;LLaMA-3-8B;Baichuan-7B;和 Qwen-7B。上述的 AlphaEdit 被用来嵌入水印,而提取成功率(ESR)和嵌入时间(ET)被用作指标。

作为基线,作者选择了 模型水印 (后门); KIMark ;和 BadEdit ,一个最初用于后门注入的框架,但在这里被改用于项目自己的目的。

作者编辑了 LLaMA-3-8 的第 15 层;GPT2-XL 和 GPT-J-6B 的第 17 层;以及 Qwen-7B 和 Baichuan-7B 的第 14 层。

实验是在四个 NVIDIA RTX 4090 GPU(每个 24GB 的 VRAM)上进行的,嵌入了 32 位、64 位和 128 位的水印。用于生成的问题模板如下图所示:

用于水印的多答案问题模板。每个问题基于不同类型的数学不等式,变量中插入随机值。模型被要求返回整数解的列表,答案的顺序用于编码或解码水印位。四个模板涵盖二次、对数、有理和基于区间的形式。所有这些都是使用 GPT-4o 生成的。

为了减少随机性的影响,测试中使用了从 1 到 20 的种子,并在不同的水印容量下进行了测试。

最初,研究人员测试了五个大型语言模型的 ESR 和时间成本,以嵌入水印:

EditMark 与三个先前水印方法在五个大型语言模型上的比较。报告了提取成功率(ESR)和嵌入时间(ET),单位为秒。EditMark 在所有模型上始终实现 100% 的成功率,同时将嵌入时间减少了几个数量级,在准确性和效率方面超出了所有基线,适用于不同大小和架构的模型。

作者指出:

‘[EditMark] 实现了 100% 的 ESR,并且只需不到 20 秒即可为所有评估的 LLM 嵌入 32 位水印。特别是,对于 Baichuan-7B 和 Qwen-7B,平均嵌入时间不到 10 秒,这表明 EditMark 的高效性。’

对于 128 位水印的评估,这是此类方案下可行的最高值,EditMark 保持了“不可磨灭”的状态:

EditMark 在五个语言模型上,水印长度为 32 位、64 位和 128 位的提取成功率和嵌入时间。所有情况下都保持了完美的成功率,而嵌入时间随着水印大小的增加而增加,但即使在 128 位时也保持在一分钟以内。

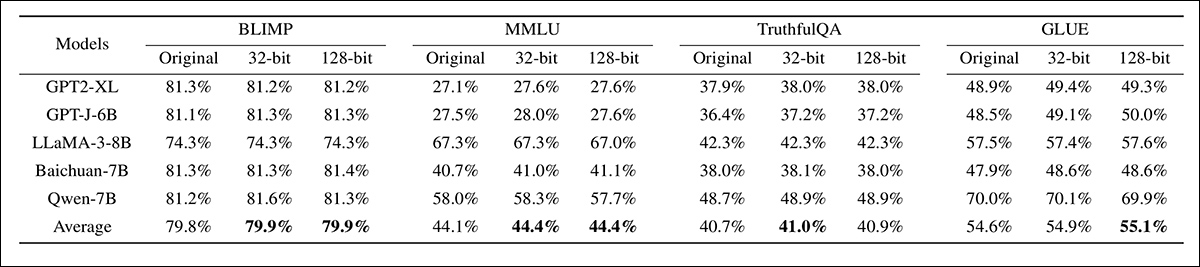

接下来,测试了系统在多个基准测试中的水印保真度:

在五个模型上评估水印保真度,比较未修改的模型和在 32 位和 128 位容量下水印的模型。性能在所有配置中保持稳定,平均分数仅略微波动,表明水印插入对基准准确性的影响有限。

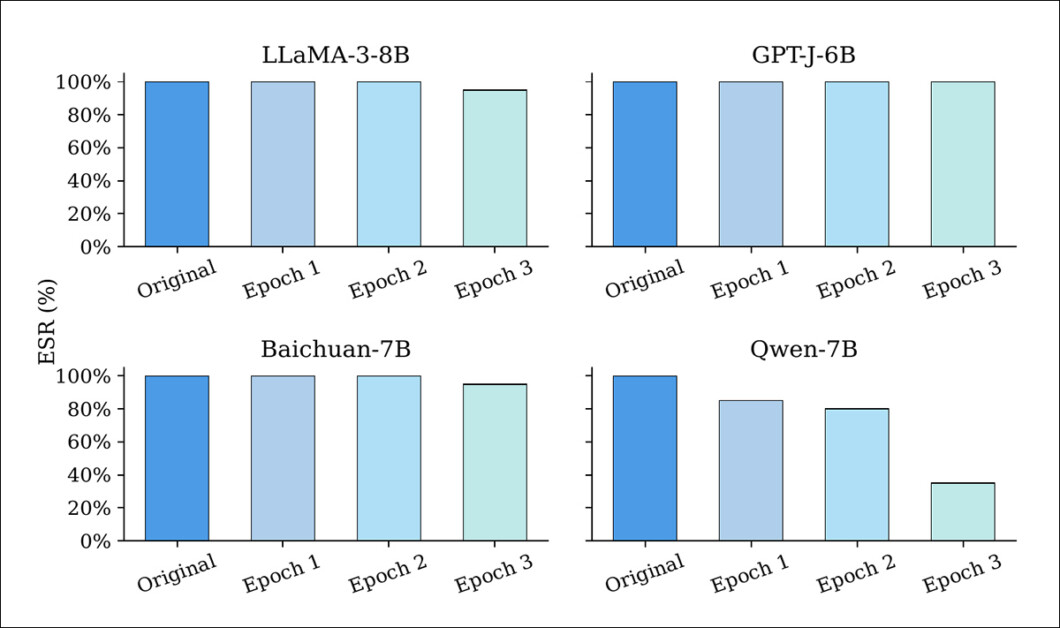

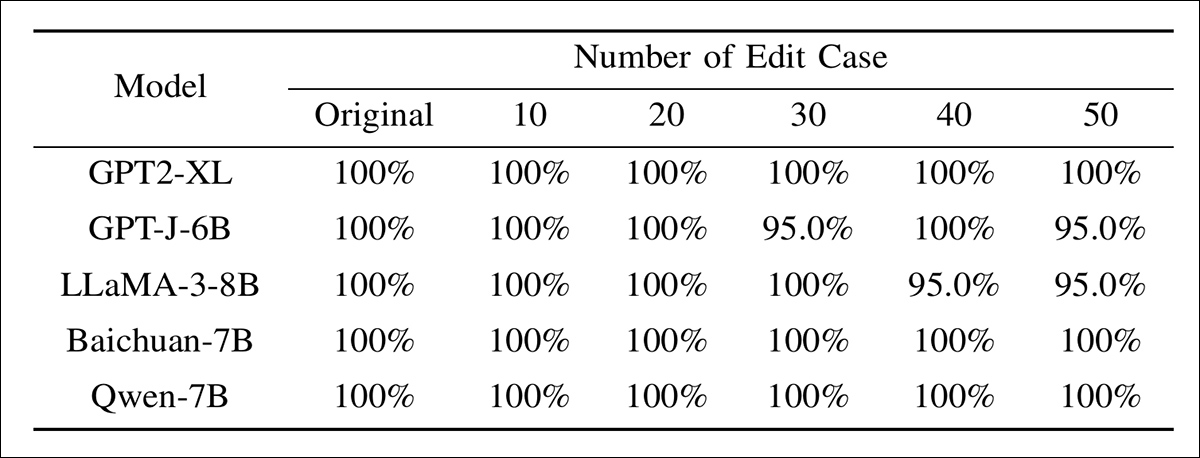

EditMark 的鲁棒性被测试为针对六种常见的攻击策略。模型首先使用五个不同的种子嵌入了 128 位的水印。微调,如下图所示,对大多数模型的提取成功率(ESR)仅造成了轻微的降低:

水印 LLM 的提取成功率(ESR)在微调一到三个 epoch 之前和之后。虽然大多数模型在整个过程中保持高 ESR,但 Qwen-7B 显示出显著的下降,表明它更容易受到参数更新的影响。

即使经过多个 epoch,大多数模型也保持了超过 90% 的 ESR,表明 EditMark 能够抵抗 LoRA 基础训练引入的参数漂移。

量化攻击降低了模型的精度,但大多数水印仍然保持完整:

水印模型在使用 Int-8 和 Int-4 精度量化之前和之后的提取成功率(ESR)。所有模型在 Int-8 量化下保持 100% 的 ESR,而 Int-4 量化会导致部分劣化,表明较低的精度会削弱但不能完全去除水印。

如上图所示,Int-8 量化 保持了所有模型的 100% 的 ESR,而 Int-4 量化对 ESR 产生了中等影响,但引入了不可接受的性能损失。

这个特定场景表明攻击者的潜在性是有限的,因为这会导致一个被黑客攻击但性能降低的模型。

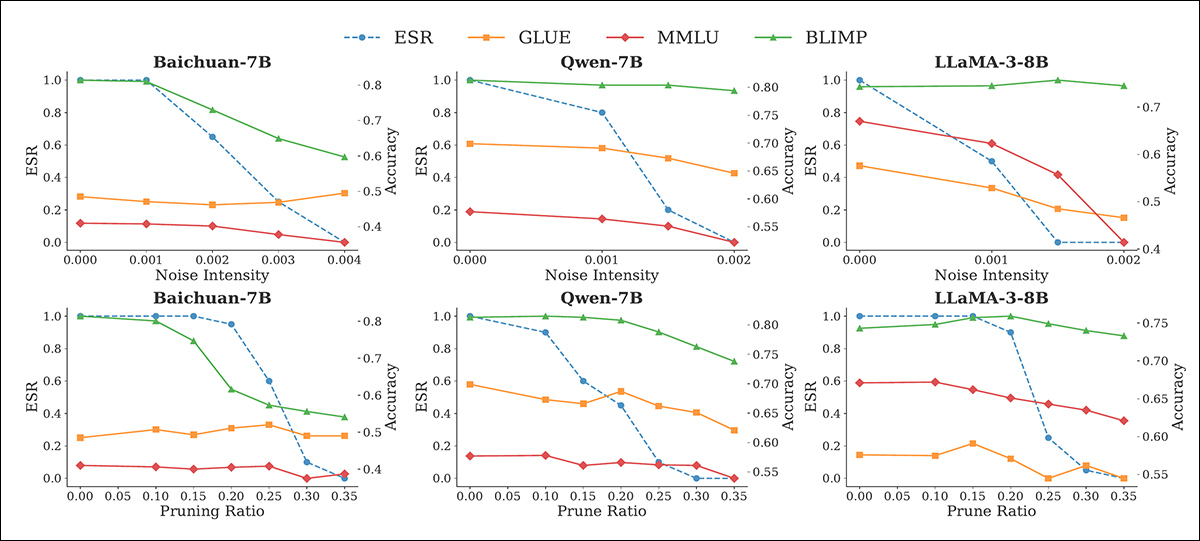

针对噪音和剪枝的测试评估了四个基准框架:MMLU;BLIMP;TruthfulQA;和 GLUE。这些攻击导致了 ESR 随着扰动的加剧而降低:

水印模型在噪音(顶行)和剪枝(底行)攻击下的 ESR 和基准性能的影响。随着 ESR 随着扰动的增加而降低,基准准确性也会降低,尤其是在更高的噪音强度和剪枝比率下,突出了(通常的)水印删除和模型实用性之间的紧张关系。

然而,这些攻击也导致了任务性能的明显下降,Baichuan-7B 在 BLIMP 上的性能下降了 27-31%,当噪音或剪枝被应用时。

还评估了模型编辑和自适应攻击:

水印模型在对已知水印层应用了不同程度的模型编辑后的提取成功率。即使在已知水印层应用了最多 50 次编辑后,所有模型的 ESR 也保持在 95% 以上,表明直接的参数修改对水印删除的影响有限。

在这里,EditMark 即使在针对确切的嵌入层时,也保持了超过 95% 的 ESR。

结论

数字版权管理、秘密水印和其他在 AI 时代之前曾经取得过(有限或部分)成功的安全方法很难应用于机器学习系统;当前机器学习系统的故意简化性质与缺乏合适的工具相结合,使得注入的水印相当脆弱。

令人印象深刻的是,看到一个针对 FOSS 模型分发的系统,并且它可以经受住除最不可能的场景外的所有场景;然而,实验中出现的微小性能下降可能会让潜在的采用者犹豫;尤其是当退回到以 API 为中心的控制模型可以几乎完全消除此类攻击时。

* 本站 曾经论证过 ,中国的“开源”模型发布并不一定是真正的开源,因为数据通常被隐瞒,这阻止了训练流水线的精确重现。可以说,这个话题邀请对比西方和东方的 AI 模型发布政治进行更深入的审视,这超出了本文的范围。

最初发布于 2025 年 10 月 27 日