人工智能

EAGLE:探索大型多模态语言模型的设计空间,使用混合编码器

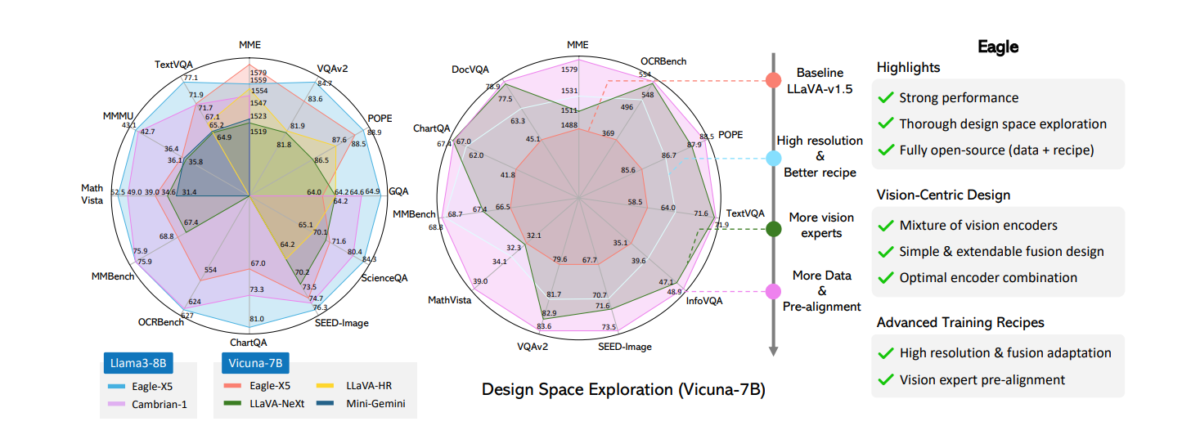

准确解释复杂视觉信息是多模态大型语言模型(MLLMs)的关键焦点。最近的工作表明,增强视觉感知能力显著减少了幻觉并提高了对分辨率敏感任务(如光学字符识别和文档分析)的性能。几种最近的MLLMs通过利用混合视觉编码器实现了这一点。尽管它们取得了成功,但仍缺乏系统性的比较和详细的消融研究来解决关键问题,例如专家选择和多个视觉专家的集成。本文提供了对使用混合视觉编码器和分辨率的MLLMs设计空间的全面探索,Eagle框架尝试探索使用混合编码器的多模态大型语言模型的设计空间。发现结果揭示了各种现有策略中的几个共同原则,导致了一种简化但有效的设计方法。Eagle发现,简单地连接来自一组互补视觉编码器的视觉令牌与更复杂的混合架构或策略一样有效。另外,Eagle引入了预对齐来弥合视觉专注编码器和语言令牌之间的差距,增强了模型的连贯性。所得到的MLLMs家族,Eagle,在主要的MLLM基准测试中超越了其他领先的开源模型。

Eagle的工作与多模态大型语言模型(MLLMs)的总体架构设计有关。除了前面提到的代表性开源研究外,其他著名的MLLMs家族包括但不限于MiniGPT-4、Lynx、Otter、QwenVL、CogVLM、VILA、GPT-4V、Gemini和Llama 3.1。根据视觉信号如何集成到语言模型中,MLLMs可以大致分为“跨模态注意力”模型和“前缀调优”模型。前者使用跨模态注意力将视觉信息注入LLMs的不同层次,而后者将视觉令牌视为语言令牌序列的一部分,并直接将其附加到文本嵌入中。Eagle的模型属于前缀调优家族,遵循LLaVA风格的多模态架构。考虑到MLLM是一个快速增长的领域,Eagle建议参考更详细的研究和调查以获取更多见解。

Eagle的工作与改进MLLMs的视觉编码器设计有关的研究密切相关。早期工作通常采用预训练在视觉语言对齐任务(如CLIP和EVA-CLIP)上的视觉编码器。更强大的视觉编码器,如SigLIP和InternVL,已被提出以增强视觉语言任务的能力,具有更好的设计、更大的模型规模和更有效的训练配方。由于模型通常在低分辨率图像上预训练,可能缺乏编码细节的能力,因此经常进行更高分辨率的适应以增加MLLM的输入分辨率。除了更高分辨率的适应外,像LLaVA-NeXT、LLaVA-UHD、Monkey、InternLM-XComposer和InternVL这样的模型使用平铺或自适应平铺来处理高分辨率输入,其中图像被分成低分辨率的补丁并分别处理。虽然引入额外视觉专家的方法使得处理更高分辨率成为可能,但这种方法与平铺技术略有不同,尽管两者兼容且可以组合。

EAGLE:使用混合编码器探索多模态LLMs的设计空间

大型语言模型(LLMs)的成功引发了人们对使其具有视觉感知能力的重大兴趣,使其能够在现实世界中看到、理解和推理。这些多模态大型语言模型(MLLMs)的核心是一个典型的设计,其中图像被转换为一系列视觉令牌,由视觉编码器完成,然后附加到文本嵌入中。CLIP通常被选为视觉编码器,因为其视觉表示与文本空间通过预训练在图像文本对上对齐。根据架构、训练配方和视觉令牌注入语言模型的方式,著名的MLLMs家族包括Flamingo、BLIP、PaLI、PaLM-E和LLaVA。这些模型大多保持相对较低的输入分辨率,这是由于预训练视觉编码器和LLM序列长度的限制。Eagle的工作与使用多个视觉编码器以提高感知能力的模型密切相关。

例如,像Mousi和Brave这样的模型通过连接或令牌方向上的通道来融合不同视觉编码器的视觉令牌。RADIO引入了一种多教师蒸馏方法,将不同视觉编码器的能力统一到一个模型中。MoAI、IVE和Prismer进一步使用视觉专家的输出(如OCR、检测或深度估计)来为MLLMs生成答案提供补充信息。MoVA设计了一个路由网络来根据给定的图像和指令分配最优视觉模型。

最近的研究表明,强大的视觉编码器设计对于减少MLLMs的幻觉和提高对分辨率敏感任务(如光学字符识别)的性能至关重要。几项工作专注于增强视觉编码器的能力, либо通过扩大预训练数据和参数, либо通过将图像分成低分辨率的补丁。然而,这些方法通常需要大量的训练资源。一个高效而强大的策略是混合预训练不同任务和输入分辨率的视觉编码器, либо通过将更高分辨率的编码器与CLIP编码器融合, либо顺序附加不同编码器的特征, либо采用更复杂的融合和路由策略来最大化不同编码器的优势。这种“混合视觉专家”方法已经被证明是有效的,尽管对其设计空间的详细研究和严格的消融仍然缺乏,这激发了Eagle重新审视这一领域。仍然存在一些关键问题:哪些视觉编码器组合应该选择,如何融合不同的专家,以及如何调整训练策略以包含更多视觉编码器。

为了解决这些问题,Eagle系统地调查了混合视觉编码器的设计空间,以提高MLLMs的感知能力。探索这个设计空间涉及以下步骤:1)基准测试各种视觉编码器和搜索更高分辨率的适应;2)进行“苹果对苹果”的比较视觉编码器融合策略;3)逐步识别多个视觉编码器的最佳组合;4)提高视觉专家预对齐和数据混合。这些探索步骤在以下图中进行了说明。

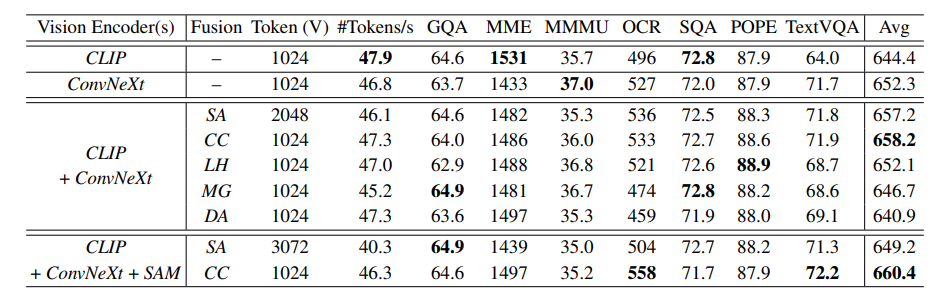

Eagle的研究涵盖了预训练在不同任务和分辨率上的视觉编码器的性能,例如视觉语言对齐、自监督学习、检测、分割和OCR。使用轮流方法,Eagle从基本的CLIP编码器开始,并添加一个额外的专家,每轮选择提供最佳改进的专家。

虽然Eagle的工作并不是第一个在MLLMs中利用多个视觉编码器,但系统研究导致了以下几点关键发现:

- 解锁视觉编码器在MLLMs训练期间很重要。这与像LLaVA这样的模型不同,考虑多个视觉编码器或教师,视觉编码器被冻结是一种常见的做法。

- 一些最近提出的融合策略没有显示出显著的优势。相反,直接通道连接出现为一种简单但具有竞争力的融合策略,提供了最佳的效率和性能。

- 包含额外的视觉专家会带来一致的收益。这使得系统地增强MLLMs的感知能力成为一个有前途的途径,除了扩大单个编码器。改进尤其是在视觉编码器被解锁时显著。

- 预对齐阶段是关键的。Eagle引入了一个预对齐阶段,其中非文本对齐的视觉专家被单独微调,使用一个冻结的LLM,然后一起训练。这个阶段显著提高了MLLMs在混合视觉编码器设计下的性能。

Eagle:方法和架构

与之前专注于新融合范式或视觉编码器之间的架构的工作不同,Eagle的目标是识别一种最小化的设计来融合不同的视觉编码器,支持详细的消融,并去除任何不必要的组件。如以下图所示,Eagle首先通过扩展基本的CLIP编码器到一组具有不同架构、预训练任务和分辨率的视觉专家开始。使用这些专家,Eagle然后比较不同的融合架构和方法,并探索如何优化多个编码器的预训练策略。

最后,Eagle结合所有发现,并将方法扩展到具有不同分辨率和领域知识的多个专家视觉编码器。使用与LLaVA-1.5相同的预训练数据,Eagle转移到有监督的微调阶段,通过收集一系列任务并将其转换为多模态对话,包括LLaVA-1.5、Laion-GPT4V、ShareGPT-4V、DocVQA、synDog-EN、ChartQA、DVQA和AI2D,结果为934k样本。

模型首先使用图像文本对预训练一个epoch,批大小为256,其中整个模型被冻结,只更新了投影层。在第二阶段,模型在有监督的微调数据上微调一个epoch,批大小为128。对于这次探索,Eagle使用Vicuna-7B作为底层语言模型。学习率分别设置为1e-3和2e-5。

更强大的CLIP编码器

Eagle首先探索CLIP模型,因为它已经成为许多MLLMs的主要选择。虽然CLIP模型被认为能够增强多模态任务,但其局限性也已被充分记录。例如,许多现有的MLLMs倾向于使用预训练的CLIP分辨率(如224×224或336×336)作为输入分辨率。在这些情况下,编码器通常难以捕捉对分辨率敏感任务(如OCR和文档理解)至关重要的细节。

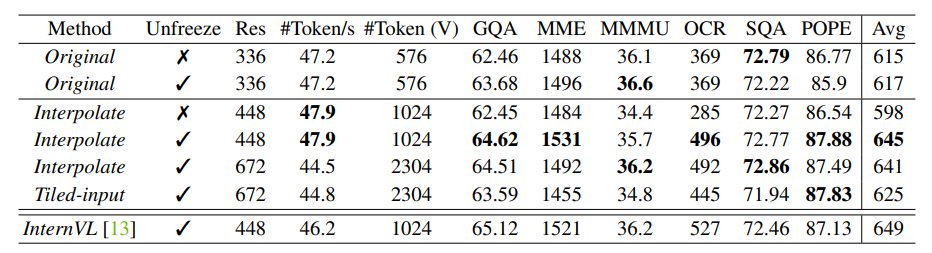

为了处理更高的输入分辨率,一个常见的方法是平铺,其中输入图像被分成图块并分别编码。另一种更简单的方法是直接将输入分辨率扩大并插入视觉变换器模型的位置嵌入,如果必要。Eagle比较了这些方法,使用冻结和解冻的视觉编码器,跨不同的分辨率,结果包含在上表中。发现可以总结如下:

- 解冻CLIP编码器在插值到更高的MLLM输入分辨率时会带来显著的改进,这个分辨率与CLIP预训练分辨率不同,没有性能退化,当分辨率保持相同时。

- 冻结CLIP编码器并直接适应更高的MLLM输入分辨率会显著损害性能。

- 在比较的策略中,直接插值到448×448,使用解冻的CLIP编码器,证明是有效和高效的,考虑到性能和成本。

- 最佳的CLIP编码器实现了与InternVL类似的性能,尽管它是一个更小的模型(300M vs. 6B),预训练数据较少。

值得注意的是,CLIP-448允许Eagle与LLaVA-HR和InternVL的设置保持一致,其中CLIP编码器被适应以输入448×448并输出1024个补丁令牌。为了进一步调查,Eagle遵循简单的策略,扩大输入分辨率并在训练期间解锁视觉编码器。

Eagle观察到现有的流行融合策略,尽管其设计各异,但可以大致分为以下几类:

- 序列追加:直接追加不同骨干的视觉令牌作为一个更长的序列。

- 通道连接:沿通道维度连接视觉令牌,不增加序列长度。

- LLaVA-HR:使用混合分辨率适配器将高分辨率特征注入低分辨率视觉编码器中。

- Mini-Gemini:使用CLIP令牌作为低分辨率查询,交叉注意另一个高分辨率视觉编码器,在局部窗口中。

- 可变形注意力:在Mini-Gemini的基础上引入的一个新基线,其中窗口注意力被替换为可变形注意力。

与其训练一个投影器来同时对齐多个视觉专家,如LLaVA原始预训练策略中一样,我们首先使用一个较小的语言模型(实践中使用Vicuna-7B)和下一个令牌预测监督来对齐每个单独专家的表示。如以下图所示,使用预对齐,整个训练过程包括三个步骤:1)训练每个预训练视觉专家,使用自己的投影器在SFT数据上进行训练,同时保持语言模型冻结;2)将所有视觉专家从第一步中结合起来,仅训练投影器,使用图像文本对数据;3)在SFT数据上训练整个模型。

Eagle:实验和结果

在精心开发了其策略后,Eagle已经建立了以下原则:(1)集成更多视觉专家,使用优化的训练配方;(2)通过直接通道连接来组合多个视觉专家;(3)预训练视觉专家,通过预对齐。在本节中,为了进一步展示Eagle模型的优势,加入了额外的训练数据,并将Eagle与当前最先进的MLLMs进行比较,跨越各种任务。Eagle使用Vicuna-v1.5-7B、Llama3-8B和Vicuna-v1.5-13B作为语言模型。对于视觉编码器,基于第2.6节的结果,Eagle模型被表示为Eagle-X4,包括四个视觉编码器:CLIP、ConvNeXt、Pix2Struct和EVA-02,以及Eagle-X5,包括一个额外的SAM视觉编码器。

视觉问答任务

Eagle在三个视觉问答(VQA)基准测试中比较了模型系列,包括GQA、VQAv2和VizWiz。如以下表所示,Eagle-X5在GQA和VQAv2上实现了最先进的性能,突出了包含额外视觉专家的优势。

OCR和图表理解任务

为了评估Eagle的OCR、文档和图表理解能力,模型被基准测试在OCRBench、TextVQA和ChartQA上。如上表所示,Eagle在TextVQA上显著超越了竞争对手,受益于其高分辨率架构和不同视觉编码器的集成。值得注意的是,Eagle保持了一个简单的设计,支持最多1024个令牌,无需复杂的图像平铺分解。

以下图显示了OCR和文档理解案例的例子。具有高分辨率适应和包含更多视觉专家的Eagle能够识别图像中的小文本,并根据用户指令准确提取信息。

为了更好地理解引入预训练在其他视觉任务上的专家的好处,以下图显示了仅使用ConvNeXt和CLIP视觉编码器的模型的结果,相比之下,Eagle-X5的结果。使用完整的视觉编码器集,模型成功纠正了错误,表明即使装备了高分辨率视觉编码器,预训练在视觉语言对齐上,Eagle的能力也通过集成预训练在不同视觉任务上的额外视觉专家而进一步增强。

多模态基准评估

Eagle被评估在七个基准测试中,以展示其在不同任务中的能力,包括MME、MMBench、SEED、MathVista、MMMU、ScienceQA和POPE。特别地,MME、MMBench和SEED评估了在涉及推理、识别、知识和OCR的各种现实任务中的整体性能。MMMU关注于需要大学水平知识的具有挑战性的问题。POPE评估了MLLMs的视觉幻觉。使用的指标遵循这些基准测试的默认设置。Eagle报告了MME的感知分数,MMBench的en_dev分割,SEED的图像分割,MathVista的test-mini分割,MMMU的val分割,POPE的F1分数,ScienceQA的图像分数,确保与其他模型报告的分数一致。

最终思考

在本文中,我们讨论了Eagle,一种对使用混合编码器的多模态大型语言模型的设计空间进行深入分析。与之前专注于设计新颖的融合范式的工作不同,Eagle发现系统的设计选择很重要,并发现了一系列有用的技术。步步优化个别视觉编码器的训练配方,找到了可扩展且高效的融合方法,并逐步组合了具有不同领域知识的视觉编码器。结果强调了基本的设计空间考虑的关键重要性。