Anderson 视角

AI生成的写作永远不会“疲劳”,因此揭露了自己

ChatGPT风格的AI通过增加一致性而暴露了自己,而人类的写作在整个过程中仍然是杂乱无章的。

大多数面向消费者的大型语言模型(LLMs)的上下文窗口有限,这是使它们忘记或错误回忆对话早期部分的因素之一,这些回忆错误会逐渐使输出变成完全的无意义的内容,或者更糟糕的是,看似连贯但包含微妙错误的文本。

由于这些情况会导致幻觉,而幻觉仍然是AI完全进入市场的最大障碍,因此,研究人员在创建可以生成更长但更一致的文本的生成AI系统方面投入了大量的研究工作。

事实上,取得了如此多的进展,以至于识别长篇AI内容(即纯粹由AI生成的内容,假设没有或最少的人类后期处理)被认为是一个日益增长的问题。

揭穿AI的长篇大论

尽管如此,最近的实证研究表明,AI文本生成器一次产生的输出越多,就越容易确定该文本是否由人类撰写;但是,关于这一检测“锚点”的公认智慧假设是,AI可以被区分,因为它与人类的不同之处在更长的文本中更频繁地出现。

关于这些“线索”在文本本身中的分布没有做出任何假设。

为了挑战这一点,并扩展这个问题,中国最近的一项有趣的研究工作提出了一种新方法,用于区分新型长篇AI内容生成器和真正的人类作者。研究人员声称,AI文本的标记生成方式意味着它变得更加一致,随着长度的增加,而人们自己的怪癖不会随着长度的增加而减少。

这种方式,作者建议他们的见解提供了一个潜在的新指标用于AI文本检测系统*:

‘AI生成的标记在文本的后半部分表现出较小和更稳定的概率波动,因为模型的预测变得越来越一致,随着上下文的积累。

‘我们将这种模式称为 后期波动衰减。这种现象反映了自回归生成的固有行为:随着更多上下文的可用性,模型的预测分布变得更加明确,从而导致标记级统计的可变性降低。

‘相比之下,人类写作继续引入意外的词汇选择,并且在整个过程中保持更高的波动性。’

为了捕捉AI文本中积累的奇怪的“平滑度”,研究人员定义了两个简单的特征:第一个测量写作的统计行为在标记之间“跳跃”的程度;第二个检查事物在短文本范围内保持稳定的程度。

两者都只从输出的第二半部分计算,而在那里,AI变得更加规律,人类写作不会。作者指出,虽然这些信号单独工作良好,但当与旧的检测方法结合时,它们更有效,这些方法扫描更广泛的模式。他们还指出,这种方法在较长的文本上表现最佳,在那里,对比变得更加明显。

新论文提供了一种通过第二半部分的时间特征分析来测试“AI性”的方法,不需要任何额外的训练或微调,或特权模型访问。

这项新工作的标题为《当AI安定下来:后期稳定性作为AI生成文本检测的签名》,来自杭州西湖大学的四位作者。

方法

为了捕捉AI生成文本中增长的平滑度,研究人员设计了两个测量,仅关注一段文本的第二半部分。这些测量依赖于对数概率评分,来自一个标准的语言模型,并且不需要任何微调、重新训练或额外的样本:

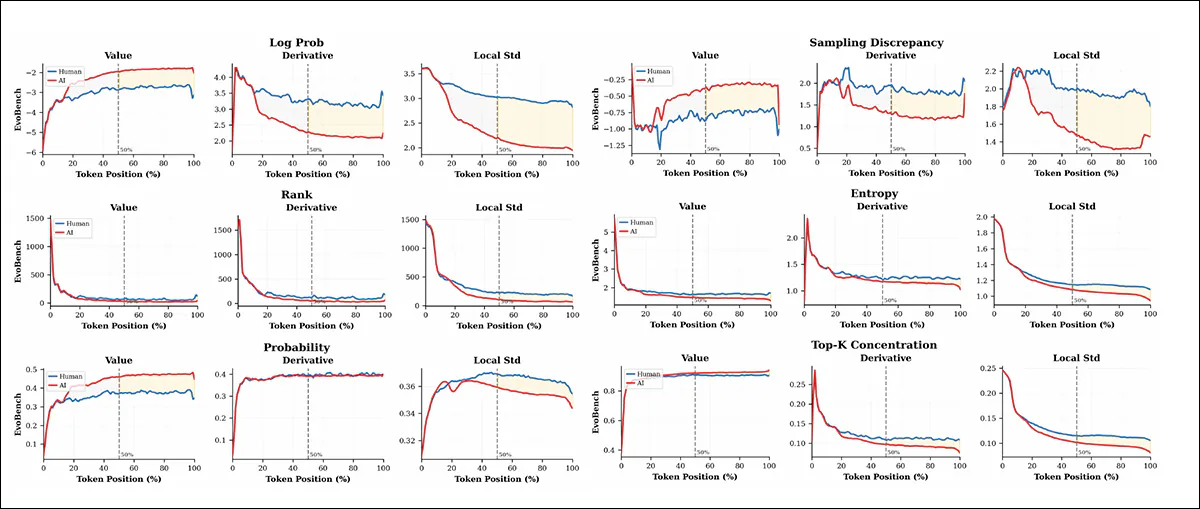

来自新论文的图像 – 每行显示EvoBench中一个基准指标在令牌序列上的行为:原始值(左),绝对导数(中),局部标准偏差(右)。人类和AI线分别以蓝色和红色显示。最大的偏差出现在文本的第二半部分,特别是对于对数概率和采样差异,这些指标显示出上升的分离和更平滑的AI输出。熵和Top-K集中度在时间上变化很小。来源 – https://arxiv.org/pdf/2601.04833

第一个测量,称为导数离散度(DD),跟踪模型的置信度从一个词到下一个词的变化程度。AI文本往往会进入一种节奏,这些变化变得更小、更可预测,在第二半部分。相比之下,人类写作保持“不均匀”。

第二个测量,称为局部波动性(LV),检查模型的置信度在小文本窗口内“跳跃”的程度。同样,AI往往会随着时间的推移变得更加稳定,而人类的选择仍然更令人惊讶、不一致:

AI文本变得更加平滑,而人类写作保持不均匀。这些图表跟踪模型的置信度在一段文本中如何变化,反映了词与词之间的变化的急剧程度和局部文本范围内的变化程度。在这两方面,AI生成的输出的下降都更为明显,特别是在中点之后,AI写作的稳定性比人类写作高出多达32%。黄色框突出了第二半部分的差距,在那里AI写作变得更加平滑。

同样,两个指标都只计算自输出的后半部分,在那里,人类和机器写作之间的差异最为明显。这些指标然后被合并成一个称为时间稳定性检测(TSD)的单一值——当写作变得“更平滑”(并且更可能是AI生成的)时,这个值会上升。然后使用一个简单的阈值来决定一个给定的段落是否可能由机器撰写。

因为这些特征关注的是何时出现模式,而不是仅仅是什么模式,所以它们与搜索整个段落的统计异常的旧方法相互补充。将TSD评分添加到2024年末提供的Fast-DetectGPT的输出中(也是与西湖大学合作),在结果中提供了额外的改进(尤其是对于长篇内容,其中晚期平滑效果最强)。

数据和测试

作者在两个相关的基准数据集上进行了测试:EvoBench包含32,000个人类/AI文本对,跨七个模型家族,包括GPT-4;GPT-4o;Claude;Google Gemini;LLaMA-3;和Qwen,总共有29个模型版本被收录。

另一个框架是MAGE,它提供了30,000个测试对,跨八个模型家族,包括(但不限于)OpenAI的GPT系列,以及LLaMA、OPT和FLAN-T5家族。

竞争者

新方法被测试与一系列使用相同的替代模型的零样本检测器。 可能性、熵、排名和对数排名(DetectGPT)测量了整个段落的标记级统计数据;LLR(DetectLLM)应用了归一化,以允许跨模型的直接比较;Fast-Detect 估计了通过基于采样的扰动来估计局部曲率。

Lastde分析了概率信号中的判别性子序列,而FourierGPT在频域中运行。 Diveye捕获了序列中“惊讶度”多样性的变化。

最后,UCE评估了令牌预测的不确定性概况,以识别不自然的置信模式。

实施和结果

所有检测方法都使用Llama-3-8B-Instruct作为共享的替代模型,输入序列限制为512个令牌。时间特征仅从每个段落的第二半部分提取,使用20个令牌的滑动窗口来测量波动性。一个融合版本的方法,称为TSD+,将所提出的信号与Fast-DetectGPT相结合。

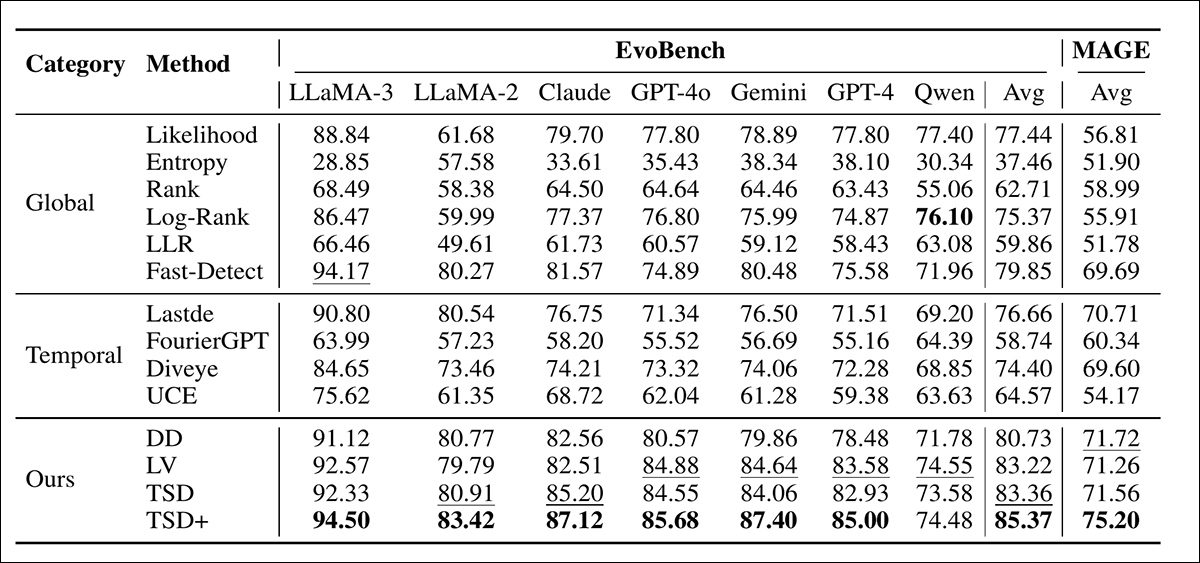

接收者操作特性曲线下面积(AUROC)是主要的评估指标†:

各种测试方法在检测AI生成文本方面的性能差异。检测准确性显示在两个基准上:EvoBench,涵盖多个高知名度的LLM,并且是MAGE,一个互补的数据集。指标按方法类型分组:全局统计、时间特征和提出的变体。平均AUROC评分显示在最后一列。作者的方法变体的结果始终优于先前的基准,而TSD+在几乎每个模型设置中都产生了最高的评分。

在这些初始结果中,作者指出:

‘我们的简单时间特征在单独方法中实现了最先进的性能,TSD在EvoBench上达到83.36%,在MAGE上达到71.56%,优于所有基准,包括Fast-DetectGPT。 ‘

‘这很值得注意,考虑到我们的方法的简单性:我们仅从序列的第二半部分计算二阶统计数据,而无需扰动采样或频域变换。’

新方法在较新的AI模型(如GPT-4和GPT-4o)上特别有效,识别AI撰写的文本比最接近的领先检测器更准确,性能差距高达9.66%。虽然较新的高级模型生成的文本不那么一致,这隐藏了一些自动化的迹象,但在末端仍然存在某些微妙的时间模式。

专注于广泛结构特征的竞争方法未能捕捉到这些后期模式。通过集成一个全局检测器,混合系统显然恢复了这些丢失的信号,并提高了性能,特别是在基准测试中,较短的AI输出可能会削弱时间线索。

结论

新工作中没有直接解决的一个方面是人类作家通过草稿和各种层次的监督来迭代他们的工作的趋势——有时包括外部监督,例如编辑和校对人员的输入,以及可能来自法律部门的建议更改,具体取决于上下文。

参与文档(例如,一篇深埋的报纸文章)的多个利益相关者可能会消除新提出的系统所依赖的怪癖,并且实际上相当于一种“模拟版本”的AI辅助草稿过程。

此外,所研究的系统本身是在这样的作品上进行训练的——随着训练数据在训练时间内被排名为权威,权重或被认为是最重要的来源可能是最“非自然”的;至少,相比于有人快速为同事撰写一封电子邮件,而不是为年度股东大会准备一份年度报告。

另一个相反的考虑是,多人贡献的文本内容也可能是最零碎、最有缺陷和最重复的散文,进入数据集,因为它们经常不会有一个最终的统一声音,使得它们的发展性质在散文中显而易见。

* 作者的原始文本样式从论文中复制;不是我的强调。

† 作者指出“主要”,同时列出了其他评估指标。

首次发表于2026年1月26日星期一