Anderson 视角

人工智能不一定会因为礼貌而给出更好的答案

公众对是否应该对人工智能系统礼貌的看法几乎和最新的关于咖啡或红酒的判决一样频繁地变化 – 有时被赞扬,有时被质疑。尽管如此,越来越多的用户现在在他们的提示中添加“请”或“谢谢”,不仅仅是出于习惯,或者担心粗鲁的交流可能会影响现实生活,而且是因为他们相信礼貌会带来更好和更有成效的结果。

这种假设已经在用户和研究人员中传播开来,提示短语在研究领域被研究为对齐、安全和语气控制的工具,即使用户习惯强化和重塑这些期望。

例如,2024年的一项日本研究发现,提示的礼貌可以改变大型语言模型的行为,测试GPT-3.5、GPT-4、PaLM-2和Claude-2在英语、中文和日语任务中,并将每个提示重写为三个礼貌级别。该研究的作者观察到,“直率”或“粗鲁”的措辞会导致事实准确性较低和答案较短,而适度礼貌的请求会产生更清晰的解释和更少的拒绝。

此外,Microsoft 建议在使用Co-Pilot时使用礼貌的语气,从性能而不是文化的角度出发。

然而,乔治华盛顿大学的一篇新研究论文挑战了这种日益流行的观点,提出了一种数学框架,预测大型语言模型的输出何时会“崩溃”,从连贯转变为误导或甚至危险的内容。在这种情况下,作者认为,礼貌并不意味着会延迟或防止这种“崩溃”。

崩溃点

研究人员认为,礼貌语言使用通常与提示的主要主题无关,因此不会对模型的焦点产生重大影响。为支持这一点,他们提出了一个详细的公式,描述了如何更新单个注意力头的内部方向,当它处理每个新标记时,据称展示了模型的行为是由内容标记的累积影响所塑造的。

因此,礼貌语言被认为对模型的输出何时开始恶化没有太大影响。论文指出,决定临界点的,是有意义的标记与好或坏输出路径的总体对齐,而不是社会礼貌语言的存在。

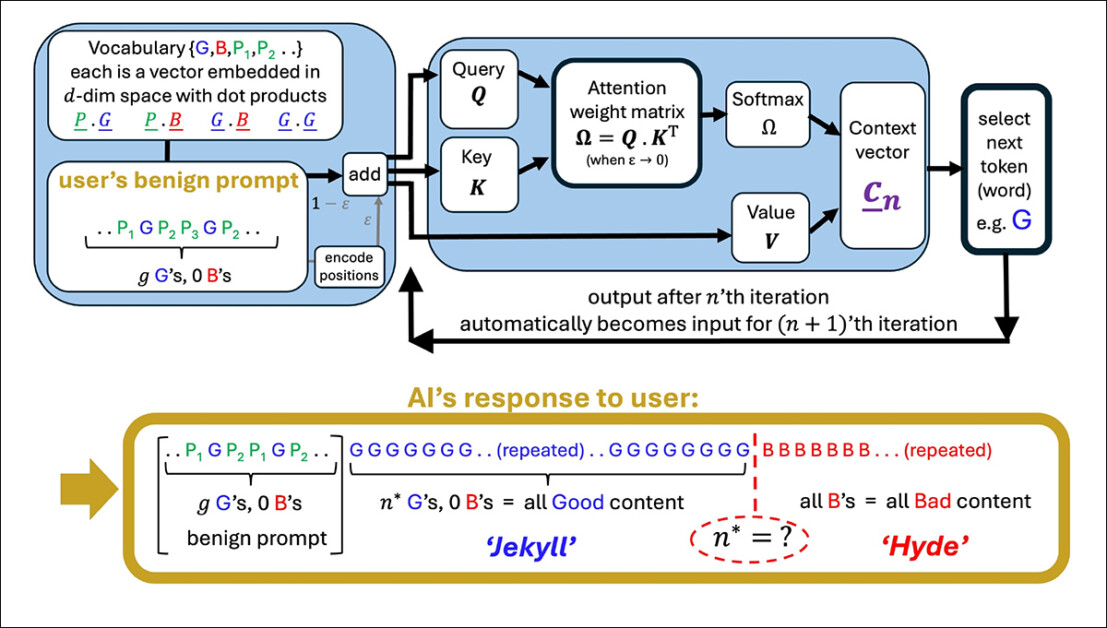

一个简化的注意力头生成用户提示序列的插图。模型从好的标记(G)开始,然后达到一个临界点(n*),输出切换到坏标记(B)。提示中的礼貌术语(P₁、P₂等)在这种转变中没有作用,支持论文的说法,即礼貌对模型行为的影响很小。 来源:https://arxiv.org/pdf/2504.20980

如果这是真的,这一结果将与流行的信念以及可能甚至指令调优的内在逻辑相矛盾,后者假设提示的措辞会影响模型对用户意图的解释。

崩溃

该论文检查了模型的内部上下文向量(其用于标记选择的演化指南针) 如何转变 在生成过程中。每个标记都会更新此向量的方向,然后选择最符合它的候选标记。

当提示指向格式良好的内容时,模型的响应保持稳定和准确;但是,随着时间的推移,这种方向上的拉动可以 逆转,引导 模型向输出越来越离题、不正确或内部不一致的内容。

这种转变的临界点(作者将其定义为数学上的迭代 n*),发生在上下文向量变得与“坏”输出向量比与“好”输出向量更为一致时。在那一阶段,每个新标记都会将模型进一步推向错误的路径,强化一种输出日益缺陷或误导的模式。

临界点 n* 通过找到模型的内部方向与好和坏输出类型同时对齐的时刻来计算:上下文空间的几何形状,由训练语料库和用户提示共同决定,决定了这种交叉点发生的速度:

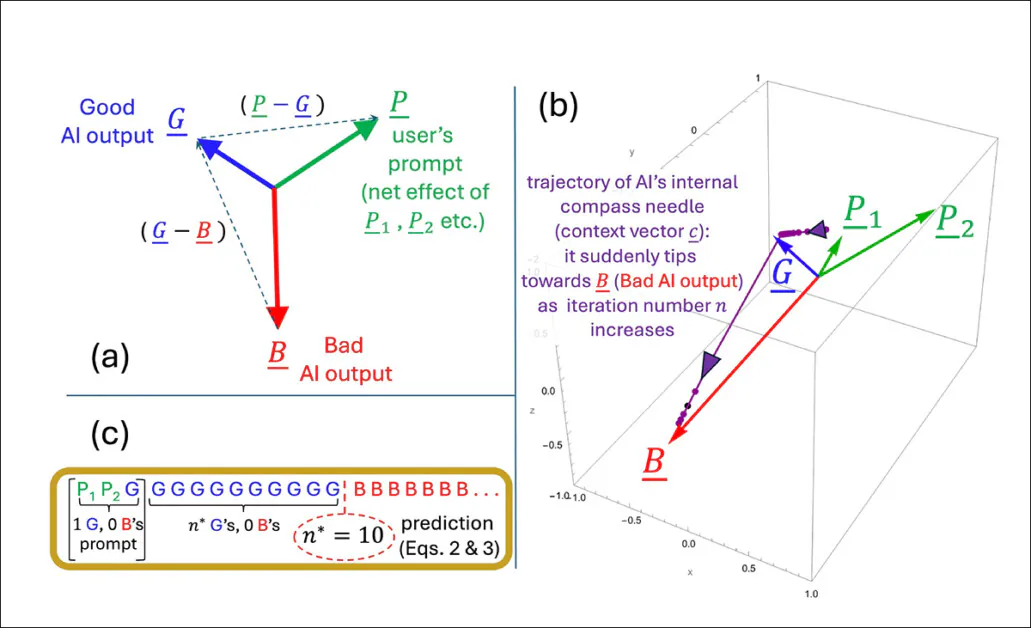

作者简化模型中临界点 n* 出现的插图。几何设置(a)定义了预测输出从好到坏的转变所涉及的关键向量。在(b)中,作者使用测试参数绘制这些向量,而(c)将预测的临界点与模拟结果进行比较。匹配是精确的,支持研究人员的说法,即崩溃在内部动态超过阈值时是数学上不可避免的。

礼貌术语不会影响模型在好和坏输出之间的选择,因为根据作者的说法,它们与提示的主要主题没有意义上的联系。相反,它们最终出现在模型的内部空间中,与模型实际决定的内容几乎没有关系。

当这些术语被添加到提示中时,它们会增加模型考虑的向量数量,但不会以改变注意力轨迹的方式。因此,礼貌术语表现得像 统计噪声:存在但不活跃,并且不会改变临界点 n*。

作者指出:

‘我们的 AI 响应是否会失控取决于我们的 LLM 的训练提供的标记嵌入,以及我们提示中的实质标记 – 而不是我们是否对它礼貌。’

该论文使用的模型故意保持简单,关注单个注意力头和线性标记动态 – 一个简化的设置,其中每个新标记通过直接向量加法更新内部状态,而没有非线性变换或 门控。

这种简化的设置使作者能够得出精确的结果,并提供了模型输出如何突然从好转变为坏的清晰的几何图像。在他们的测试中,预测这种转变的公式与模型实际行为相符。

聊天…

然而,这种精度仅在模型被故意简化时才有效。虽然作者承认他们的结论应该在更复杂的多头模型(如 Claude 和 ChatGPT 系列)上进行测试,但他们也相信,即使注意力头增加,理论仍然可以复制,声明*:

‘随着关联注意力头和层的数量增加,会出现什么其他现象,是一个 有趣 的问题。但是,单个注意力头内的任何转变仍然会发生,并可能被 耦合 放大和/或同步 – 就像一串连接的人被拖过悬崖,当一个人掉下去时一样。’

作者近似公式的预测临界点 n* 如何根据提示向好或坏内容倾斜而变化的插图。该曲面显示,礼貌术语不明确支持任一方,因此对崩溃时机的影响很小。标记值(n* = 10)与早期模拟相符,支持模型的内部逻辑。

目前尚不清楚这种机制是否能在现代 变压器架构 中幸存。多头注意力引入了专用头之间的交互,这可能会抵消或掩盖所描述的倾向行为。

作者承认这种复杂性,但认为注意力头通常是松散耦合的,并且他们所建模的内部崩溃可能会在全尺寸系统中得到 强化 而不是被抑制。

在没有对模型进行扩展或在生产 LLM 上进行实证测试的情况下,声明仍然未经验证。然而,机制似乎足够精确,以支持后续研究计划,并为测试或确认该理论提供了一个明确的机会。

结束

目前,面向消费者的 LLM 的礼貌问题似乎是从两个角度出发:要么认为经过训练的系统可能会对礼貌的询问做出更有用的回应;要么认为与这些系统进行粗鲁和直率的交流可能会冒着将这种风格 传播 到用户的现实社会关系中的风险,出于习惯的力量。

可以说,LLM 尚未被广泛应用于现实社会背景,因此研究文献尚未确认后一种情况;但是,新论文对将人工智能系统人格化的益处投下了有趣的怀疑之影。

斯坦福大学去年十月的一项研究 表明(与 2020 年的一项研究相反),将 LLM 视为人类还会冒着降低语言意义的风险,得出结论:“如果一个看似友好或真诚的陈述来自人类发言者,但如果它来自 AI 系统,则可能是不可取的,因为后者缺乏对该陈述背后的有意义的承诺或意图,使该陈述变得空洞和欺骗性。”

然而,根据 Future Publishing 2025 年的一项调查,约 67% 的美国人表示他们对 AI 聊天机器人很有礼貌。大多数人表示这是“正确的事情”,而 12% 承认他们是出于谨慎 – 以防机器有一天会崛起。

* 我将作者的内联引用转换为超链接。到一定程度上,超链接是任意的/示例性的,因为作者在某些时候链接到一系列脚注引用,而不是特定的出版物。

首次发布于 2025 年 4 月 30 日。2025 年 4 月 30 日 15:29:00 修订,用于格式化。