人工智能

分离“融合”的人在计算机视觉中

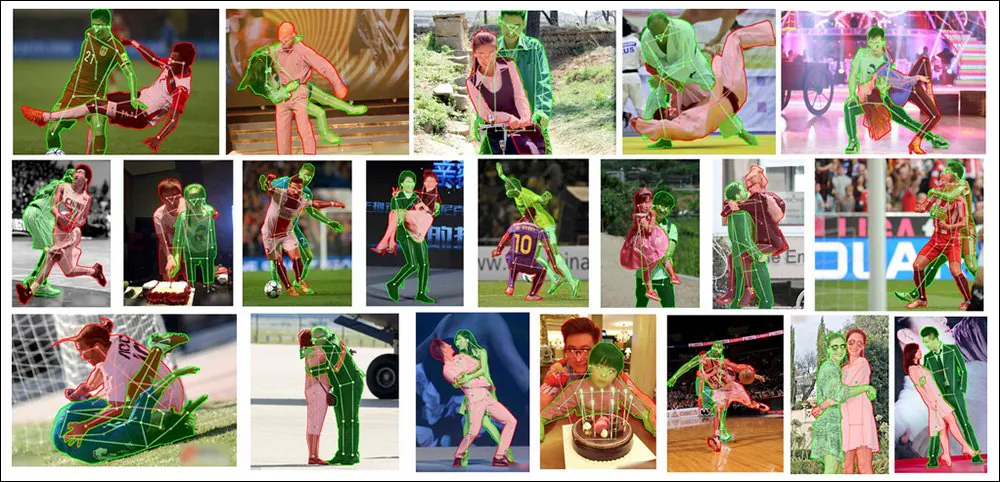

现在,现代科技的发展让我们可以看到许多令人惊叹的技术成果。来自现代科技集团创新中心的新论文提出了一种方法,用于分离“融合”的人在计算机视觉中——那些案例中,对象识别框架发现一个人与另一个人“太接近”(例如“拥抱”动作或“站在后面”的姿势),并且无法区分这两个人,混淆他们为单个人或实体。

两个成为一个,但这不是语义分割中的好事。这里我们看到论文的新系统在复杂和具有挑战性的图像中实现了最先进的结果,用于分离交织的人。 来源:https://arxiv.org/pdf/2210.03686.pdf

这是一个值得注意的问题,近年来在研究社区中得到了大量关注。解决这个问题而不需要明显但通常不切实际的高昂费用的人工标注,可能会使文本到图像系统(如 Stable Diffusion)在人体识别方面取得改进,这些系统经常“融合”人体,当提示姿势需要多个人在彼此附近时。

接受恐怖——文本到图像模型,如 DALL-E 2 和 Stable Diffusion(上面都有),难以表示彼此非常接近的人。

虽然像 DALL-E 2 和 Stable Diffusion 这样的生成模型不使用语义分割或对象识别,但这些怪异的人类组合不能通过应用这种上游方法来解决——因为最先进的对象识别库和资源在分离人方面并不比 CLIP 基于工作流的潜在扩散模型更好。

为了解决这个问题,新论文 ——题为 人类不需要标记更多人类:Occlusion Copy & Paste用于遮挡的人实例分割——改进和扩展了最近的“剪切和粘贴”方法,用于半合成数据,以在任务中实现新的最先进的结果,即使面对最具挑战性的源材料:

新的 Occlusion Copy & Paste 方法当前在该领域领先,即使面对以前的框架和方法,它们以更精心和更专门的方式解决了这个挑战,例如专门为遮挡建模。

剪切它!

该修改方法——称为 Occlusion Copy & Paste ——源自 2021 年的 Simple Copy-Paste 论文,由 Google 研究院领导,该论文提出,超越提取的对象和人在多样化的源训练图像中,可以提高图像识别系统的能力来分离每个实例:

来自 2021 年 Google 研究院领导的论文“Simple Copy-Paste 是实例分割的强大数据增强方法”,我们看到一个图像中的元素“迁移到”其他图像中,目标是训练一个更好和更敏感的图像识别模型。 来源:https://arxiv.org/pdf/2012.07177.pdf

新的版本在此自动和算法“重贴”中添加了限制和参数,类似于一个装满潜在候选项的“篮子”,用于“转移到”其他图像中,基于几个关键因素。

OC&P 的概念工作流程。

控制元素

这些限制因素包括 概率,即剪切和粘贴的发生概率,确保该过程不会一直发生,这将产生一种“饱和”效应,破坏数据增强;图像数量,即“篮子”中将有多少图像;以及 范围,即将粘贴到“宿主”图像中的图像数量。

关于后者,该论文指出 “我们需要足够的遮挡发生,但不能太多,因为它们可能会使图像过度拥挤,这可能会对学习有害。”

OC&P 的其他两项创新是 定向粘贴 和 增强实例粘贴。

定向粘贴确保粘贴的图像落在目标图像中现有的实例附近。在以前的方法中,新的元素仅限于图像边界内,没有考虑上下文。

增强实例粘贴确保粘贴的实例不会表现出一种“独特的外观”,可能会导致系统以某种方式对其进行分类,这可能会导致排除或“特殊处理”,这可能会阻碍泛化和适用性。增强粘贴调节了诸如亮度、锐度、缩放和旋转以及饱和度等视觉因素。

来自新论文的补充材料:将 OC&P 添加到现有的识别框架中相当简单,并且会导致在非常接近的环境中对人进行更好的个体化。 来源:https://arxiv.org/src/2210.03686v1/anc/OcclusionCopyPaste_Supplementary.pdf

此外,OC&P 规定了粘贴实例的 最小尺寸。例如,可能会从一个大型人群场景中提取一个人图像,并将其粘贴到另一个图像中,但在这种情况下,涉及的像素数量可能不太可能有助于识别。因此,系统根据目标图像的等化边长比率应用最小尺寸。

此外,OC&P 制定了尺寸感知粘贴,在寻找与粘贴对象相似的主题的同时,还考虑了目标图像中的边界框的大小。然而,这并不会导致人们认为是合理或真实的复合图像,而是以有助于训练的方式将语义上合适的元素组装在一起。

现实咬伤

OC&P 以及其前身都将真实性或最终“蒙太奇”图像的“照片真实性”置于次要地位。虽然保持最终组装不完全陷入 达达主义 很重要(否则,训练系统的实际部署永远不会希望遇到它们被训练的场景),但两项工作都发现,显著增加“视觉可信度”不仅会增加预处理时间,而且这种“现实增强”可能实际上是有害的。

来自新论文的补充材料:随机混合的增强图像。虽然这些场景可能看起来像幻觉,但它们仍然将类似的主题组合在一起;虽然遮挡对于人类眼球来说是幻想的,但遮挡的性质无法预先知道,也无法训练——因此,这种奇怪的形式“切断”足以迫使训练系统寻找和识别部分目标主题,而无需开发复杂的 Photoshop 风格的方法来使场景更可信。

数据和测试

对于测试阶段,系统在 人 类的 MS COCO 数据集上进行了训练,包含 262,465 个人类示例,跨越 64,115 张图像。然而,为了获得比 MS COCO 更好的掩码,图像还接受了 LVIS 掩码注释。

2019 年发布的 LVIS,是 Facebook 研究院的大型词汇实例分割数据集。 来源:https://arxiv.org/pdf/1908.03195.pdf

为了评估增强系统在处理大量遮挡人图像方面的性能,研究人员将 OC&P 与 OCHuman(遮挡人)基准进行了比较。

来自 OCHuman 数据集的示例,该数据集于 2018 年引入,以支持 Pose2Seg 检测项目。该项目旨在使用人的姿势和姿势作为语义分隔符来改进人体的语义分割。 来源:https://github.com/liruilong940607/OCHumanApi

由于 OCHuman 基准没有详尽的注释,因此新论文的研究人员创建了一个仅包含完全注释的示例子集,称为 OCHumanFL。这减少了验证集中的 人 实例数量到 2,240 个,跨越 1,113 张图像,以及测试集中的 1,923 个实例,跨越 951 张图像。原始和新策划的集都使用平均平均精度(mAP)作为核心指标进行了测试。

为了保持一致,架构由 Mask R-CNN 和 ResNet-50 主干以及 特征金字塔 网络组成,后者在准确性和训练速度之间提供了可接受的折衷。

鉴于研究人员注意到上游 ImageNet 的影响在类似情况下可能有害,因此整个系统从头开始在 4 个 NVIDIA V100 GPU 上训练,共 75 个 epoch,遵循 Facebook 2021 年发布的 Detectron 2 的初始化参数。

结果

除了上述结果外,基准结果表明 OC&P 在识别人体方面具有明显的优势,尤其是在测试中。

除了超越 PoSeg 和 Pose2Seg 之外,这篇论文最显著的成就之一是该系统可以被广泛应用于现有的框架,包括在试验中与其竞争的框架(见文章开头的结果框)。

该论文总结如下:

“我们方法的一个关键优势是它可以轻松应用于任何模型或其他模型中心的改进。考虑到深度学习领域的发展速度,对于每个人来说,具有高度互操作性的方法是有益的。我们将将其与模型中心的改进集成,以有效解决遮挡人实例分割问题,留作未来的工作。”

改进文本到图像合成的潜力

首席作者 Evan Ling 在给我们的电子邮件中观察到,OC&P 的主要优势是它可以保留原始掩码标签并从中获得新的价值“免费”地在新的背景中——即它们被粘贴到的图像中。

虽然人类的语义分割似乎与 Stable Diffusion 等模型难以区分人(而不是“融合”它们)有关,但任何语义标签文化对 Stable Diffusion 和 DALL-E 2 经常输出的噩梦般的人类渲染的影响都是非常遥远的。

数十亿 LAION 5B 子集图像构成了 Stable Diffusion 的生成能力,但这些图像不包含对象级别的标签,例如边界框和实例掩码,即使 CLIP 架构可能在某个时候从实例化中受益;相反,LAION 图像是“免费”标注的,因为它们的标签来自元数据和环境字幕等,随着图像被从网上抓取到数据集中。

“但除此之外,”Ling 告诉我们。“类似于我们的 OC&P 的某种增强可以在文本到图像生成模型的训练期间使用。但是我认为增强训练图像的真实性可能会成为一个问题。

“在我们的工作中,我们展示了‘完美’的真实性通常不需要用于监督实例分割,但我不确定是否可以对文本到图像生成模型训练得出相同的结论(尤其是当其输出预期为高度真实时)。在这种情况下,可能需要更多工作来‘完善’增强图像的真实性。”

CLIP 已经被用作 可能的多模态工具,用于语义分割,表明改进的人体识别和个体化系统,例如 OC&P,可能最终可以开发成任意拒绝“融合”和失真的人类表示的过滤器或分类器——这是 Stable Diffusion 目前难以实现的任务,因为它缺乏理解错误的能力(如果它有这种能力,它可能就不会犯错)。

只是利用 OpenAI 的 CLIP 框架(DALL-E 2 和 Stable Diffusion 的核心)进行语义分割的众多项目之一。 来源:https://openaccess.thecvf.com/content/CVPR2022/papers/Wang_CRIS_CLIP-Driven_Referring_Image_Segmentation_CVPR_2022_paper.pdf

“另一个问题是,”Ling 建议说,“是否只需在训练期间将遮挡人图像提供给这些生成模型就足够了,而不需要补充模型架构设计来缓解‘人体融合’的问题?那可能是一个很难直接回答的问题。它将非常有趣地看到我们如何在文本到图像生成模型训练期间注入某种实例级别的指导(通过实例级别标签,如实例掩码)。”

* 2022 年 10 月 10 日

首次发布于 2022 年 10 月 10 日。