Погляд Anderson

Total Recoil: Групи, які ставляться до штучного інтелекту як до неприйнятної домішки

‘Нульова толерантність’ до вмісту, створеного штучним інтелектом, стає дедалі привабливішим варіантом у світлі зростаючих юридичних, етичних та проблем, пов’язаних з користувачами штучного інтелекту; але чи є такий вид ‘відмови’ практичною пропозицією?

Опінія Хто користується соціальними медіа та іншими видами онлайн-форумів дискусій, можливо, помітив останнім часом, що зростає кількість спільнот, форумів та професійних організацій повністю забороняють використання генеративного штучного інтелекту, оскільки економічний вплив цієї технології поширюється за межі художників і письменників, чиї протести запалили поточні проблеми ще у 2023 році.

З юридичними та економічними наслідками революції штучного інтелекту все ще невизначеними, організації, які піддаються тиску як з боку користувачів, так і з боку внутрішніх юридичних радників, змушені приймати рішення щодо політики ще до того, як буде ясна повна картина – ситуація, ускладнена поширенням переконання, що затримка прийняття може залишити їх у конкурентній невигоді.

Штучний інтелект як міазма

Рішення про заборону є політичним, з наслідками; можливість заборонити, однак, передбачає як політичні, так і практичні пастки, оскільки історія заборони речей, які люди дійсно хочуть, є заплутаною至少; і навіть ліквідація речей, які ніхто не хоче потребує довгострокових, постійних зусиль.

Таким чином, переслідуваний досить неправильно зрозумілою історією луддитів, ті спільноти та організації, які ставляться до будь-якої сліду штучного інтелекту як до абсолютно неприйнятної часто приймають оборонний тон при оголошенні або обговоренні заборони на штучний інтелект.

Як аміші виявили за останні кілька століть, замкнений стан проти дійсно впливаючої технології може бути важким для підтримання; строго кажучи, наприклад, ті, хто дотримується правил веганства, не можуть дивитися фільми знятий на традиційному целулоїді, або навіть мати рентген. Аналогічно, відмову від фторування в країнах або містах, які приймають його може бути важко.

Ефективно, повсюдна та популярна технологія є ‘атмосферним’ явищем, яке не легко дозволяє встановлювати межі, які зараз встановлюють зростаюча кількість груп і організацій.

Дозаконні заходи

Як вже згадувалося, перші битви проти поширення штучного інтелекту були проведені в найменш визначеному та найбільш інтерпретативному секторі генеративного штучного інтелекту – розвагах. Коли Американська гільдія акторів екрану – Американська федерація телевізійних і радіомовних артистів (SAG-AFTRA) боролися за захист прав своїх членів у 2023 році, їм врешті вдалося отримати деякі помітні поступки.

Відтоді були дуже мало перемог такої ж вирішальної щодо штучного інтелекту – і битва за юридичну ясність у різних секторах тільки починається. Наприклад, більшість新的 законодавства щодо глибоких фейків, зокрема з Великої Британії та США, включає штучний інтелект лише в ширшу категорію злочинів (таких як образи без згоди, реальні чи фальшиві).

Гарячі на підборах після перемоги SAG-AFTRA, партія судових процесів щодо використання робіт інших видів художників завжди триває. Тим часом багато незадоволених груп очікує юридичного затвердження з місцевими правилами.

Перед подальшим розглядом логіки та обмежень ‘абсолютно неприйнятної’ ставлення до штучного інтелекту, давайте розглянемо деякі випадки, коли така політика здійснюється.

Заборони на штучний інтелект з нульовою толерантністю

Примітка про несогласність

Тільки цього місяця Bandcamp став першою великою онлайн-платформою музики, яка повністю заборонила вміст, створений штучним інтелектом. Заборона була оголошена в заяві, яка також заявила ‘Музика та аудіо, створені повністю або в суттєвій частині штучним інтелектом, не допускаються на Bandcamp’.

Ця обмеження, як і в майже всіх випадках, змушена робити ставку трохи через згаданий вище ‘міазматичний’ ефект широко поширених систем штучного інтелекту. В іншій частині оголошення зазначається, що музика, яка* ‘видимо створена повністю або з великою допомогою генеративного штучного інтелекту’ є ціллю заборони – прагматичне обмеження, оскільки в більшості областей принаймні дещо вмісту, створеного генеративним штучним інтелектом, здатне видатися повністю створеним людиною, як для людей, так і для постійно розвивається сектору виявлення штучного інтелекту.

Ефективно, це шаблон для більшості нових політик ‘з нульовою толерантністю’, які зараз вводяться в дію: те, що невідання штучного інтелекту є виправданням, в цих складних обставинах.

Після інциденту, коли музичний трек, створений штучним інтелектом, штурмував шведські чарти, IFPI Швеція, національна організація музичної індустрії, заборонила музику, створену штучним інтелектом, з включенням до чартів – хоча з звичайним застереженням, заявивши* ‘Наше правило полягає в тому, що якщо це пісня, яка в основному створена штучним інтелектом, вона не має права бути в топ-лісті’.

Знову ж таки, бажання повної заборони на штучний інтелект тут визнається непрактичним; заборона є потайною і повною, але реалізація є ефективно неможливою.

Комічний ефект

Хвилія заборон на вміст, створений генеративним штучним інтелектом, пронеслася через сцену комік-конвенцій у США та за кордоном за останні рік. Сан-Дієго Комік-Кон, який у 2024 році ввів комерційні обмеження на мистецтво, створене штучним інтелектом, цього місяця оголосив, що він забороняє вміст, створений штучним інтелектом, повністю, як повідомляється, у відповідь на протест художників.

Аналогічно, у жовтні минулого року Нью-Йорк Комік-Кон ввів повну заборону на продаж продукції або вмісту, створеного штучним інтелектом, з офіційного сайту заявив:

‘Продукт, матеріал або вміст, створені повністю або в суттєвій частині з використанням генеративних інструментів штучного інтелекту або алгоритмів (“створеного штучним інтелектом”) або що включає елементи, створені штучним інтелектом, включаючи, але не обмежуючись візуальним мистецтвом, зображеннями чи графікою, анімацією та/або матеріалами, заборонені до продажу на Нью-Йорк Комік-Кон.’

Знову ж таки, ми бачимо, що в ‘суттєвій частині’ формулювання повинно визнати складність визначення цілого творчого походження будь-якої роботи, ці дні. Це відображає початкову заборону Сан-Дієго на комерціалізацію виходу штучного інтелекту, а не пізнішої повної заборони вмісту, створеного штучним інтелектом. Тоді як цей підхід є досить ефективним ‘деплатформінгом’ вмісту, створеного штучним інтелектом, у більшості випадків (хоча така робота все ще могла бути використана як підживлення комерціалізованих платформ).

Далі, конвенція коміків FanX Солт-Лейк ввела більш вирішальну заборону на вміст, створений штучним інтелектом, у вересні минулого року, з засновником і продюсером Даном Фарром, який прокоментував:

‘Якщо клієнти приходять і купують шедевр і вони не розуміють, що генеративний штучний інтелект був використаний для його створення, вони можуть заплатити велику суму грошей за це, не розуміючи, що це не зовсім таке цінне.’

Анти-соціальний

Багато онлайн-спільнот також прийняли нульову толерантність до вмісту, створеного штучним інтелектом. Дійсно, це один з найбільш публічних аспектів неприйняття штучного інтелекту, і це була зростаюча частота таких заборон, яка привернула мою увагу до цієї теми:

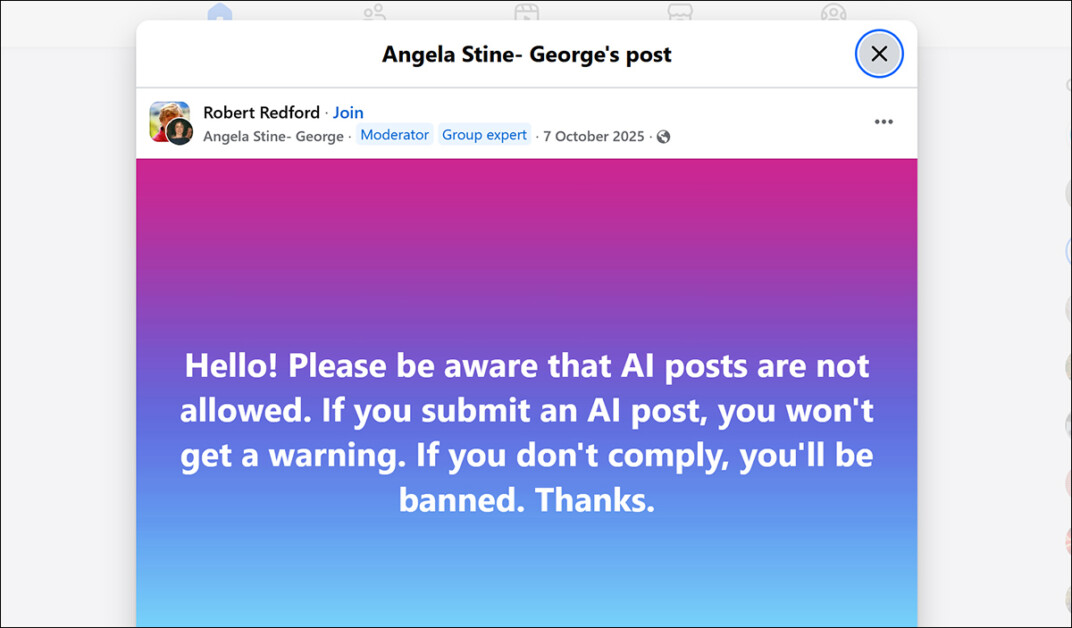

Типовий анти-штучний інтелект едикт з Facebook. Джерело

Reddit був особливо постраждав від цього, з модераторами різних великих субреддітів, які часто забороняють всі зображення, створені штучним інтелектом, мистецтво чи текстові форми (такі як художня література та програмування), коли такі публікації почали затоплювати їхні форуми та перевантажувати обмежені людські модераційні ресурси.

Дуже ранній приклад, з 2022 року, був субреддіт r/Dune, де близько 250 000 фанатів проголосували за заборону мистецтва, створеного штучним інтелектом, повністю, після того, як були затоплені штучним інтелектом, створеними зображеннями. Моди субреддіту зазначили на той час:

‘Ми визнаємо, що багато з цих творів цікаві для перегляду, і технологія дійсно цікава, але це технічно кваліфікується як низькозатратний вміст – особливо порівняно з оригінальним, створеним людиною, яким ми хотіли б надати пріоритет у майбутньому.’

Відтоді багато субреддітів (від r/lego до r/DataHoarder) аналогічно заявили, що будь-який вміст, створений навіть частково штучним інтелектом, буде видалений з виду – принаймні, як завжди, де впізнаваний.

Аналогічні заборони з’являються часто на Facebook. Однак, оскільки Meta, батьківська компанія Facebook, є однією з світових передових розробників штучного інтелекту, тоді як Reddit є натомість гаряче спірним та затребуваним джерелом постійного людського даних, ці заборони тенденціюють викликати менше контроверсій.

Дивно, що це займає.Meta деякий час, щоб наздогнати загальну громадську думку навколо штучного інтелекту – рік тому, наприклад, компанія зробила сміливий відступ від експерименту з агентами штучного інтелекту, які публікуються в різних хронологіях, через несприятливі реакції користувачів.

Заборони на ChatGPT

Одна особлива категорія ‘абсолютних’ заборон на штучний інтелект – це часта заборона проти використання ChatGPT у корпоративних або чутливих середовищах (і в цьому сенсі, те ж саме застосовується до будь-якої хмарної, доступної через API моделі мови, такої як Claude або Gemini).

Однак ці заборони зазвичай викликані не ліберальними проблемами навколо експлуатації даних навчання, а страхами, що OpenAI закінчить зберігання, обробку або навіть експлуатацію чутливої компанії IP, розкритої під час клієнтських чатів.

Хоча юридичні відділи можуть підтримувати або навіть ініціювати корпоративні заборони на платформи типу ChatGPT, вони також ймовірно будуть розглянути, чи може використання відкритих веб-даних для навчання комерційних систем піддати компанію або її клієнтів майбутнім зобов’язанням – особливо якщо триваючі судові процеси проти OpenAI або подібних сутностей призведуть до суттєвих судових рішень.

Приклади заборон на ChatGPT† включають хвилю реакційних заборон у 2023 році від Apple, Amazon, Spotify та Wells Fargo, серед багатьох інших. Того ж року дослідження Cisco виявило, що 27% організацій, опитаних, ввели подібні заборони – не на ChatGPT конкретно, а на використання генеративного штучного інтелекту загалом.

У 2024 році інше дослідження виявило, що 65% з топ-20 фармацевтичних компаній заборонили працівникам використовувати ChatGPT.

Чище, що багато, якщо не всі компанії, згадані тут, ймовірно, будуть шукати вигоду від штучного інтелекту способами, які краще відповідають їхнім інтересам; і що багато з них, ймовірно, будуть підтримувати або розробляти інші продукти штучного інтелекту для внутрішнього використання – або навіть комерційних продуктів API з кращою захистом інтелектуальної власності, ніж те, що може запропонувати OpenAI.

Багато урядів, які є основними прихильниками штучного інтелекту, також забороняють ChatGPT. Хоча деякі з них, такі як Куба та Північна Корея, є очевидними кандидатами на такий тип заборони, Китай, який зараз вважається лідером революції штучного інтелекту, забороняє ChatGPT на рівні уряду – очевидно, на користь домашніх альтернатив.

Висновок: Про нульову толерантність

Одна з проблем щодо тенденції до ‘абсолютних’ заборон на штучний інтелект (окрім складності визначення вмісту, створеного штучним інтелектом), полягає в тому, чи є непримиренна заборона дійсно ефективною. Насправді, легко неправильно зрозуміти, що таке ‘нульова толерантність’; що вона може досягти; і досить обмежені обставини, у яких вона може досягти своїх цілей.

Наприклад, Нью-Йорк, можливо, найбільш тісно пов’язаний з терміном ‘нульова толерантність’, був здатний піднятися з його злочинного мінімуму в 1970-х і 1980-х роках через поступове та тривале застосування теорії ‘розбитих вікон’, яка стверджує, що незалежно від того, наскільки бідний чи заможний район є, наявність навіть одного розбитого вікна буде тенденцією до дальших розбитих вікон – і подальшого посилення інших видів більш серйозних злочинів, оскільки тривале присутність початкового розбитого вікна свідчить про те, що влади або не спостерігають, або не турбуються.

Отже, ставлення ‘нульової толерантності’ до ‘зародкової’ злочину розбитого вікна вважається таким, що має вищі вигоди, оскільки ця ‘кримінальна ентропія’ ніколи не може отримати підґрунтя; таким чином, звертаючись до малих речей (таких як сміття та розбиті вікна, які не є дорогими проблемами для вирішення), більші речі (які коштували б більше для вирішення) доглядають за собою.

Виконана, однак, ця теорія (іноді критикована як расистська) може звучати як крайній авторитаризм, або навіть фашизм:

Натисніть, щоб відіграти. Від єдиного навчального фільму Джона Форда, ‘OSS – Під прикриттям’, приклад очевидної нульової толерантності у фальшивому контексті культури Другої світової війни. Джерело

Натомість ‘нульова толерантність’ часто ототожнюється в громадському розумінні з ‘суворими, але необхідними’ діями, такими як непримиренні закони, які більшість країн мають щодо покарань за шкоду неповнолітнім – тобто, чіткі правила для громадського блага, конкретизовані в каральні закони, які надихають мало суперечок чи компромісів.

Насправді, ZT був розроблений для досягнення міської реновації за бюджет, пропонуючи більші ресурси в громадській арені, ніж дійсно існували за лаштунками; не особливо застосований випадок для повернення джина штучного інтелекту в пляшку.

І на практиці генеративний штучний інтелект вже настільки поширений, що ваш очевидний вміст, вільний від штучного інтелекту, може вже зобов’язуватися йому – навіть якщо це підвищений кодек, створений штучним інтелектом у (не фальшивому) відео, яке ви створили, надіслали до YouTube, і опублікували на вашому улюбленому соціальному медіа-каналі. Якщо штучний інтелект дійсно стає подібним до культурного ‘газу’, він, здається, готується порушити чіткі кордони чи бінарні рішення, такі як ‘заборона на штучний інтелект’.

*Моє підкреслення.

† Який ми можемо вважати представником цього класу LLM, а не ексклюзивного продукту, в цьому сенсі.

Перше опубліковано четвер, 29 січня 2026