Штучний інтелект

Надання графічних нейронних мереж великими мовними моделями: Останній довідник

Графи – це структури даних, які представляють складні відносини в широкому діапазоні областей, включаючи соціальні мережі, бази знань, біологічні системи та багато іншого. У цих графах сутності представлені як вузли, а їх відносини зображені як ребра.

Спроможність ефективно представляти та міркувати про ці складні відносинні структури є важливою для забезпечення прогресу в галузях, таких як наука про мережі, хемінформатика та системи рекомендацій.

Графічні нейронні мережі (GNN) виникли як потужна структура глибокого навчання для завдань машинного навчання на графах. Інтегруючи графічну топологію в архітектуру нейронної мережі через агрегацію сусідів або графічні конволюції, GNN можуть вивчати низьковимірні векторні представлення, які кодують як властивості вузлів, так і їх структуровані ролі. Це дозволяє GNN досягати найкращих результатів на завданнях, таких як класифікація вузлів, передбачення зв’язків та класифікація графів у різних областях застосування.

Хоча GNN зробили суттєвий прогрес, деякі ключові виклики залишаються. Отримання високоякісних позначених даних для навчання наглядових моделей GNN може бути дорогим і тривалим. Крім того, GNN можуть мати труднощі з гетерогенними графічними структурами та ситуаціями, коли графічний розподіл у час тестування суттєво відрізняється від навчальних даних (загальне узагальнення).

Паралельно великі мовні моделі (LLM), такі як GPT-4 та LLaMA, захопили світ своїми неймовірними можливостями розуміння та генерації природної мови. Навчені на величезних текстових корпусах з мільярдами параметрів, LLM демонструють видатні можливості навчання з декількох прикладів, узагальнення задач та здравого глузду, які раніше вважалися надзвичайно складними для систем штучного інтелекту.

Видатний успіх LLM каталізував дослідження щодо використання їхньої потужності для завдань машинного навчання на графах. З одного боку, знання та можливості міркування LLM представляють можливості для покращення традиційних моделей GNN. З іншого боку, структуровані представлення та фактичні знання, властиві графам, можуть бути інструментальними у вирішенні деяких ключових обмежень LLM, таких як галюцинації та відсутність інтерпретації.

Графічні нейронні мережі та самонавчання

Щоб надати необхідний контекст, ми спочатку коротко розглянемо основні концепції та методи графічних нейронних мереж та самонавчального навчання представлення графів.

Архітектури графічних нейронних мереж

Архітектура графічної нейронної мережі – джерело

Ключова відмінність між традиційними глибокими нейронними мережами та GNN полягає в їх здатності працювати безпосередньо з графічними структурованими даними. GNN слідують схемі агрегації сусідів, де кожен вузол агрегує векторні властивості від своїх сусідів для обчислення свого представлення.

Було запропоновано численні архітектури GNN з різними варіантами функцій повідомлення та оновлення, таких як графічні конволюційні мережі (GCN), GraphSAGE, графічні мережі уваги (GAT) та графічні ізоморфні мережі (GIN) серед інших.

Нещодавно графічні трансформери здобули популярність, адаптуючи механізм самоуваги з природніх мовних трансформерів для роботи з графічними структурованими даними. Прикладами цього є GraphormerTransformer та GraphFormers. Ці моделі здатні захоплювати довгострокові залежності по всьому графу краще, ніж чисто сусідські GNN.

Самонавчання на графах

Хоча GNN є потужними моделями представлення, їхня продуктивність часто обмежена відсутністю великих позначених даних, необхідних для наглядового навчання. Самонавчання виникло як перспективний парадигма для попереднього навчання GNN на непозначених графічних даних, використовуючи завдання-претексти, які вимагають лише внутрішньої графічної структури та властивостей вузлів.

Самонавчальне графічне – джерело

Деякі загальні завдання-претексти, які використовуються для самонавчального попереднього навчання GNN, включають:

- Прогнозування властивостей вузлів: Випадкове маскування або пошкодження частини властивостей/ознак вузлів та завдання GNN їх відтворити.

- Прогнозування ребер/зв’язків: Навчання прогнозувати, чи існує ребро між парою вузлів, часто на основі випадкового маскування ребер.

- Контрастне навчання: Максимізація подібності між графічними виглядами одного графічного зразка, одночасно відштовхуючи виглядів від різних графів.

- Максимізація взаємної інформації: Максимізація взаємної інформації між локальними представленнями вузлів та цільовим представленням, таким як глобальне графічне вкладення.

Завдання-претексти, такі як ці, дозволяють GNN витягувати значимі структуровані та семантичні закономірності з непозначених графічних даних під час попереднього навчання. Попередньо навчений GNN потім можна донаструвати на відносно малих позначених підмножинах, щоб досягти успіху в різних завданнях, таких як класифікація вузлів, передбачення зв’язків та класифікація графів.

Використовуючи самонавчання, GNN, попередньо навчені на великих непозначених наборах даних, демонструють кращу узагальнюваність, стійкість до зміщення розподілу та ефективність порівняно з навчанням з нуля. Однак деякі ключові обмеження традиційних методів самонавчання GNN залишаються, які ми будемо досліджувати далі, використовуючи LLM для їх вирішення.

Покращення графічного машинного навчання великими мовними моделями

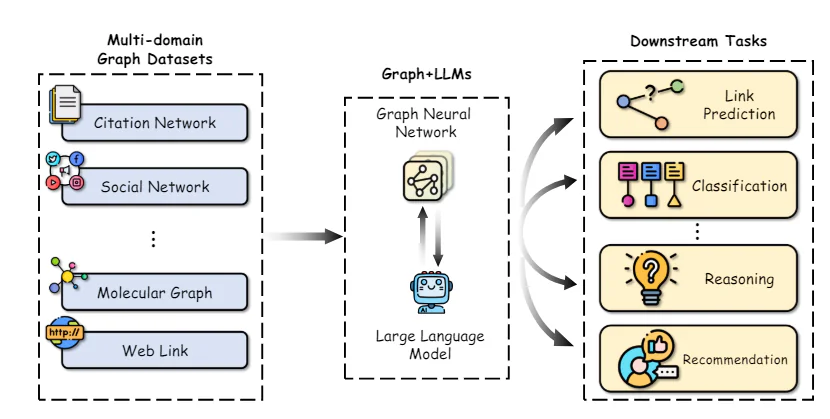

Інтеграція графів та LLM – джерело

Видатні можливості LLM щодо розуміння природної мови, міркування та навчання з декількох прикладів представляють можливості для покращення різних аспектів графічних машинних навчальних трубопроводів. Ми досліджуємо деякі ключові напрямки досліджень в цій сфері:

Одним з ключових викликів застосування GNN є отримання високоякісних представлень властивостей для вузлів та ребер, особливо коли вони містять багаті текстові атрибути, такі як описи, назви або анотації. Традиційно використовувалися прості мішки слів або попередньо навчені моделі вкладення слів, які часто не можуть захопити нюансів семантики.

Останні роботи продемонстрували силу використання великих мовних моделей як текстових кодувальників для побудови кращих представлень властивостей вузлів/ребер перед їх передачею в GNN. Наприклад, Chen et al. використовують LLM, такі як GPT-3, для кодування текстових атрибутів вузлів, демонструючи суттєві прибуття продуктивності порівняно з традиційними вкладеннями слів на завданнях класифікації вузлів.

Поза кращими текстовими кодувальниками LLM можна використовувати для генерації додаткової інформації з оригінальних текстових атрибутів напівнаглядовим чином. TAPE генерує потенційні мітки/пояснення для вузлів, використовуючи LLM, та використовує ці додаткові ознаки для покращення властивостей.

Покращуючи якість та виразність вхідних властивостей, LLM можуть передавати свої видатні можливості розуміння природної мови GNN, підвищуючи продуктивність на завданнях нижнього рівня.