Лідери думок

Що кожен вчений-даних повинен знати про графічні трансформери та їх вплив на структуровані дані

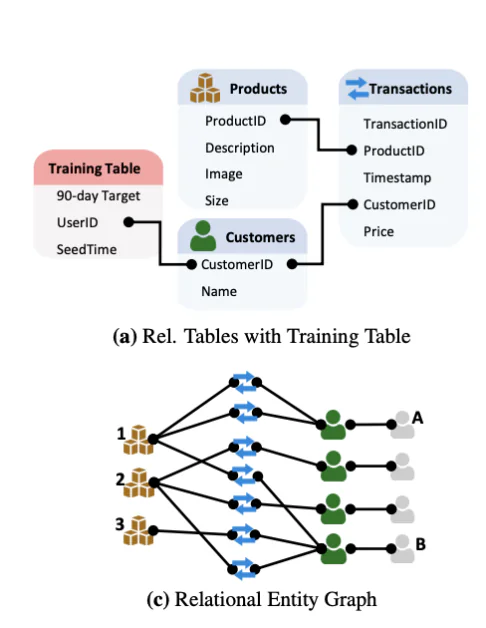

Я спільно створив Graph Neural Networks під час перебування в Стенфорді. Я рано визнав, що ця технологія була неймовірно потужною. Кожна точка даних, кожна спостереження, кожна частина знань не існує в ізоляції; вона є частиною графа, пов’язаного з іншими частинами знань. Що важливо, більшість цінних бізнес-даних, часто зберігаються у вигляді таблиць у базах даних і сховищах даних, можуть природно бути представлені як граф. Освоєння цієї реляційної структури є ключем до створення точних і не-галюцинаційних моделей ІІ.

Графічні нейронні мережі (GNN) ввели архітектуру передачі повідомлень, яка могла б міркувати над графами, захоплюючи зв’язки між частинами знань. Але так само, як Трансформери перетворили розуміння мови, новий клас моделей – Графічні Трансформери – приносять подібні вигоди графічним даним. Ці моделі поєднують гнучкість механізмів уваги з структурними графічними априорі для моделювання складних відносин більш ефективно, ніж їхні попередники GNN.

Чому графіки потребують більше, ніж передача повідомлень

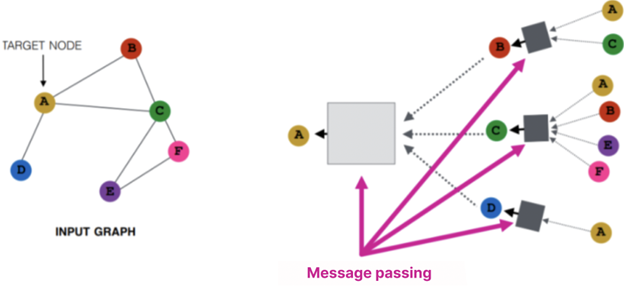

Традиційні графічні нейронні мережі (GNN) покладаються на передачу повідомлень, процес, під час якого кожен вузол оновлює свій внутрішній стан, агрегуючи інформацію від своїх сусідів. Подумайте про це як кожен вузол, який обмінюється резюме з найближчими вузлами, а потім використовує ці резюме для уточнення свого власного розуміння. За кілька шарів це дозволяє інформації поширюватися через граф.

Хоча це потужно для вивчення місцевих закономірностей, передача повідомлень має важливі обмеження:

- Перетискання: Коли інформація агрегується за багато стрибків, вона може стати стисненою, втрачаючи значущі деталі. Це особливо проблематично у глибоких GNN.

- Обмежений контекст: Стандартна передача повідомлень не може легко захопити довгострокові залежності без багатьох шарів, що збільшує складність і шум.

- Виразність: Багато графічних структур не можуть бути диференційовані лише за допомогою місцевої інформації сусідства, обмежуючи продуктивність моделі на завданнях, які вимагають тонких структурних відмінностей.

Це саме тут Графічні Трансформери вступають у дію. Заміняючи або доповнюючи передачу повідомлень механізмами уваги, вони дозволяють кожному вузлу безпосередньо звертатися до інших (навіть віддалених) на основі вивченого значення. Результатом є багатші представлення, краща масштабованість і можливість міркувати над складними структурами більш гнучко.

Від GNN до Графічних Трансформерів

Оригінальна модель Трансформера, представлена в іконічній статті, Увага – все, що вам потрібно, була розроблена для моделювання відносин між токенами в послідовності. Її успіх полягає в самої уваги, механізмі, який дозволяє кожному входу розглянути кожен інший вхід, зважений на вивчене значення.

Графічні Трансформери адаптують цей парадигму, дозволяючи вузлам звертатися не тільки до своїх сусідів, але й до будь-якого вузла в графі, або через повністю з’єднану увагу, або гібридний підхід, який балансує глобальні та місцеві сигнали. Викликом є введення поняття структури в модель, розроблену для неструктурованих послідовностей.

Графічні позиційні кодування

На відміну від тексту, графіки не мають вбудованого порядку, що робить позиційне кодування не тривіальним. Графічні Трансформери подолávají це різними методами:

- Лапласові власні вектори: Походять від графічної матриці Лапласа, вони забезпечують спектральне вкладення, яке захоплює глобальну структуру.

- Випадкові прогулянки: Захоплюють імовірність переходу від одного вузла до іншого за кілька стрибків.

- Структурні кодування: Включають метрики відстані, ступені вузлів або типи ребер.

Ці позиційні кодування, чи то спектральні, чи ймовірнісні, чи структурні, дають Графічним Трансформерам можливість зрозуміти, де кожен вузол знаходиться в рамках більшої графіки. Ця структурна осведомленість є суттєвою для того, щоб механізми уваги могли працювати осмислено над нерівномірними, неупорядкованими даними, в кінцевому підсумку дозволяючи моделі захопити відносини, які були б невидимі для простіших, чисто місцевих методів.

Реальні реалізації та випадки використання

Введення Графічних Трансформерів у виробництво вимагає інфраструктури, яка може масштабуватися до реальних розмірів даних. Бібліотеки, такі як PyTorch Geometric (PyG), роблять це можливим. Розроблена на основі PyTorch, PyG забезпечує модульну структуру для реалізації GNN і Графічних Трансформерів у різних застосуваннях, від моделювання молекул до систем рекомендацій. Вона підтримує навчання з використанням міні-пакетів як для багатьох малих графів, так і для одного великого графа, з підтримкою декількох графічних процесорів і torch.compile, що робить її придатною як для досліджень, так і для корпоративних робочих процесів.

Ці інструменти вже забезпечують широкий спектр реальних застосувань. У відкритті ліків Графічні Трансформери допомагають передбачувати молекулярні властивості, моделюючи атомні взаємодії як графіки. У логістиці та оптимізації ланцюга постачання вони можуть представляти та міркувати над динамічними мережами відправлень, складів та маршрутів. Компанії електронної комерції використовують їх для поліпшення рекомендацій, розуміючи поведінку співкупівлі та перегляду продуктів як відносні графіки. А у кібербезпеці графічні моделі використовуються для виявлення аномалій шляхом аналізу моделей доступу, топології мережі та послідовності подій.

У кожному з цих контекстів можливість вивчити з складних, взаємопов’язаних структур, не покладаючись виключно на ручні функції, виявляється великою перевагою.

Технічні розгляди

Хоча вони мають потенціал, Графічні Трансформери супроводжуються реальними інженерними компромісами. Повна самоувага масштабується квадратично з кількістю вузлів, що робить ефективність пам’яті та обчислювальної потужності головною проблемою, особливо для великомасштабних або густих графів. Багато реальних графів також мають напрямні ребра, вводячи асиметрії, які ускладнюють, як структурна інформація кодується. А у практичних розгортаннях вхідні дані рідко є однорідними: поєднання графічно-структурованих даних з текстом, часовими рядами або зображеннями вимагає ретельного архітектурного вибору та надійної попередньої обробки даних.

Ці виклики не є непереборними, але вони вимагають ретельного системного проектування, особливо при переході від дослідницьких прототипів до моделей, готових до виробництва.

Що далі: LLM зустрічаються з графіками

Одним із напрямків досліджень є інтеграція великих мовних моделей (LLM) з графічними структурами. Ці гібридні системи використовують LLM для кодування текстового контексту або витягування сутностей, а потім засновують цю інформацію в графі для міркування та прийняття рішень.

У біології це сприяло інструментам, таким як AlphaFold. У корпоративному ІІ це дозволяє системам підтримки клієнтів, які поєднують документацію та поведінкові графіки. Графічні Трансформери також відіграють зростаючу роль у тому, щоб штучні агенти приймали розумніші, більш дієвші рішення, дозволяючи їм міркувати над структурованими представленнями стану та пріоритезувати взаємодії динамічно. Це злиття допомагає агентам краще зрозуміти ієрархічні відносини, відстежувати залежності з часом та адаптувати свою поведінку в складних середовищах.

Ця галузь ще тільки починається, але потенціал є суттєвим.

Висновок

Графічні Трансформери не просто наступна ітерація GNN; вони представляють собою злиття уваги, структури та масштабованості. Чи працюєте ви у фінансах, біологічних науках чи системах рекомендацій, повідомлення чітке: ваші дані утворюють граф, тому ваші моделі також повинні бути графічними.