มุมมองของ Anderson

‘Survey Paper DDos Attack’ ที่ทำให้การวิจัยทางวิทยาศาสตร์ถูกครอบงำ

โมเดล AI ที่สร้างสรรค์ เช่น ChatGPT กำลังทำให้แพลตฟอร์มการเผยแพร่ทางวิชาการอัดแน่นไปด้วยเอกสารวิจัยที่สร้างโดย AI ในระดับที่ทำให้อัตราส่วนสัญญาณต่อเสียงรบกวนถึงขีดวิกฤติ การศึกษาใหม่ระบุว่าน้ำท่วมนี้ทำให้นักวิจัยต้องเผชิญกับความท้าทาย การบิดเบือนการอ้างอิง และการกัดกร่อนความน่าเชื่อถือของบันทึกทางวิทยาศาสตร์ โดยเปรียบเทียบการหลั่งไหลของเอกสารที่ช่วยเหลือโดย AI เหมือนกับการโจมตี ‘DDoS’ ต่อวิทยาศาสตร์เอง

(ส่วนหนึ่งเป็นความคิดเห็น) สัปดาห์ที่แล้ว สำหรับครั้งแรกในเจ็ดปีที่ติดตามกระแสวรรณกรรมทางวิทยาศาสตร์ที่เกี่ยวข้องกับ AI ฉันต้องยอมแพ้และยอมรับว่าอย่างน้อยในช่วงเวลาสูงสุด ฉันต้องเลือกว่าจะอยู่เหนือการเผยแพร่ใหม่ที่สำคัญหรือมีเวลาทำงานเขียนเกี่ยวกับบางส่วน

จำนวนรายการในหมวดหมู่ที่จำกัดมาก (เช่น การมองเห็นของคอมพิวเตอร์, การเรียนรู้ของเครื่อง, แบบจำลองภาษา และส่วนอื่นๆ ที่มีการสมัครสมาชิกน้อย) มีมากกว่า 1,000 รายการสำหรับการส่งในวันเดียว

ด้วยปริมาณดังกล่าว แม้แต่การดูหัวข้อใหม่ทั้งหมดและอ่านสรุปย่อบางส่วนก็จะทำให้เป็นวันที่ไม่มีประสิทธิภาพ

วันนี้คือวันศุกร์ที่ 7 ตุลาคม โดยการเปรียบเทียบ ในหมวด การเรียนรู้ของเครื่อง วันศุกร์ที่ผ่านมา (14 ตุลาคม) มีปริมาณการเผยแพร่ที่น้อยกว่า 400 รายการสำหรับวันศุกร์ของสัปดาห์ก่อน; มีเพียง 354 รายการ:

354 การส่งในหมวดการเรียนรู้ของเครื่องในหนึ่งวัน Source: https://arxiv.org/

คุณจะต้องอ่าน Arxiv ทุกวัน เป็นเวลาหลายปี เพื่อเข้าใจว่าตัวเลขเหล่านี้เพิ่มขึ้นมากเพียงใด

โดยยอมรับว่าวันศุกร์เป็น ‘ชั่วโมงเร่งด่วน’ สำหรับการส่ง เนื่องจากเป็นวันทำงานแรกที่เกิดขึ้นหลังวันหยุดสุดสัปดาห์ยาว และหมวดการเรียนรู้ของเครื่อง เป็น ส่วน ‘จับได้ทั้งหมด’ ที่มีเอกสารที่ไม่ซ้ำกันน้อยกว่าหมวดหมู่อื่นๆ ส่วนใหญ่

อย่างไรก็ตาม การเพิ่มขึ้นของการส่งเอกสารวิจัยเป็นปรากฏการณ์ที่ ได้รับการบันทึก ในวงการวิชาการและสื่อ

อาจเป็นด้านที่น่าตกใจที่สุดของการเพิ่มขึ้นนี้คือว่าหมวดหมู่อื่นๆ ที่อยู่ใกล้เคียงมีการเปลี่ยนแปลงน้อยมากในความถี่ในช่วงสามปีที่ผ่านมา ในขณะที่หมวดวิทยาศาสตร์คอมพิวเตอร์ (ดูสิ คุณสามารถระบุได้หรือไม่ในตัวเลขอย่างเป็นทางการของ Arxiv ด้านล่าง) กำลังอยู่ในเส้นทางขึ้นที่รุนแรง:

การเพิ่มขึ้นของเอกสารวิจัยวิทยาศาสตร์คอมพิวเตอร์ในช่วงสามปีที่ผ่านมา Source: https://info.arxiv.org/about/reports/submission_category_by_year.html

เพียงสามปีที่แล้ว การส่งเอกสารวิจัย AI ของ Arxiv คาดว่า จะเพิ่มขึ้นสองเท่าทุกๆ ไม่กี่ปี; และจะน่าสนใจที่จะอ่านสรุปประจำปีของ Arxiv เกี่ยวกับแนวโน้มที่สิ้นปี 2025

Volume ที่ 11

สองสาเหตุที่ชัดเจนที่สุดว่าทำไมสิ่งนี้จึงเกิดขึ้นคือ a) การมอบหมายทางการเงินอย่างไม่เคยปรากฏมาก่อน สำหรับ AI ที่สร้างสรรค์ ซึ่งดึงดูดการลงทุนในการวิจัยในระดับมหาศาลในภาคเอกชนและภาควิชาการ ซึ่งมักจะร่วมมือกัน; และ b) ข้อเท็จจริงที่ว่าระบบแบบจำลองภาษา AI เช่น ChatGPT ทำให้การ提交เอกสารวิจัย (รวมถึงเอกสารวิจัยเกี่ยวกับ AI) เป็นกระบวนการที่เกือบจะเป็นอุตสาหกรรม

อย่างไรก็ตาม คุณภาพของการส่งเอกสารวิจัย ไม่ได้เพิ่มขึ้น ทั้งในด้านปริมาณ (แม้ว่าเอาต์พุตที่มีข้อผิดพลาดของ AI จะ สร้างความสนใจมากขึ้น ในภาคกฎหมายมากกว่าภาควิชาการ ไม่น้อยเพราะผลกระทบในภาคนั้นชัดเจนกว่า)

นโยบายที่ไม่ยอมให้มีการยอมรับเป็นเรื่องยากที่จะนำไปใช้ในกรณีนี้ แม้ว่าการ ระบุเนื้อหาที่สร้างโดย AI จะง่ายกว่า; นอกเหนือจากข้อเท็จจริงที่ว่า AI เองเป็นของขวัญที่ชัดเจนสำหรับการวิจัยทางวิทยาศาสตร์โดยทั่วไป การใช้ AI ในการส่งเอกสารวิจัยโดยทั่วไป ได้ ปรับปรุงความชัดเจนของงานจากผู้ส่งที่ไม่ใช่ภาษาอังกฤษ – บุคคลและทีมที่จนถึงตอนนี้ ทำงานในความเสียเปรียบ

แต่ปัญหาในการลดข้อจำกัดทางภาษาในลักษณะนี้คือสิ่งที่ทำให้จำนวนผู้ส่งทั่วโลกเพิ่มขึ้น โดยไม่เพิ่มระดับการกำกับดูแลของมนุษย์ที่ให้คุณค่าแก่การทำงานนั้น

หากระดับการส่งเอกสารวิจัยยังคงเพิ่มขึ้นแบบเลขชี้กำลัง อัตราส่วนสัญญาณต่อเสียงรบกวนจะกลายเป็นเรื่องที่ควบคุมไม่ได้ และเฉพาะ AI เท่านั้นที่อาจจะสามารถนำทางน้ำท่วมและแหล่งน้ำใหม่ๆ ของเอกสารวิจัย AI ได้; สิ่งที่ไม่เหมาะสมที่จะทำมากกว่าการตรวจสอบเอาต์พุตของตนเอง

น่าขำที่ว่าการวิจัยทางวิทยาศาสตร์เป็นความพยายามของ มนุษย์ อย่างเข้มข้น

การโจมตีทางวิจัย

สาเหตุของการสะท้อนความคิดนี้คือการร่วมมือที่ ใหม่ จากประเทศจีนที่มีชื่อว่า หยุดการโจมตี DDoS ต่อชุมชนการวิจัยด้วยเอกสารวิจัยที่สร้างโดย AI

เอกสารตำแหน่งใหม่นี้มุ่งเน้นเฉพาะ การส่งเอกสารวิจัย – การสรุปผลงานวิจัยที่มีผลกระทบสูง ซึ่งโดยปกติจะรวมและให้ข้อมูลเชิงบริบท การตีความแนวโน้ม และการทำนายโดยใช้ข้อมูล:

เพียงเศษเสี้ยวของเอกสารวิจัยที่กำลังเติบโตอย่างมากในหมวดที่เกี่ยวข้องกับการเรียนรู้ของเครื่องและ AI ที่ arxiv.org

เนื่องจากเอกสารวิจัยสรุปมากกว่าสร้างขึ้นใหม่ จึงง่ายที่จะทำให้กลายเป็นกระบวนการอัตโนมัติด้วย AI และผู้เขียนของงานใหม่ระบุการแพร่กระจายของเอกสารวิจัยที่มีคุณภาพต่ำหรือไม่สมบูรณ์ในแง่ของ ภัยคุกคามด้านความปลอดภัย ต่อภาคการวิจัย†:

‘[การเพิ่มขึ้นอย่างรวดเร็วของเอกสารวิจัยที่สร้างโดย AI โดยเฉพาะอย่างยิ่งโดยใช้โมเดลภาษาขนาดใหญ่ (LLMs) ได้เปลี่ยนประเภทที่มีแรงงานสูงนี้ให้เป็นเอาต์พุตที่มีปริมาณสูงและความพยายามต่ำ โดยไม่ต้องมีการตรวจสอบ

‘สิ่งนี้ทำให้เกิดการเพิ่มขึ้นของเอกสารวิจัยที่มีคุณภาพต่ำหรือไม่สมบูรณ์ ซึ่งทำให้แพลตฟอร์มการเผยแพร่ทางวิชาการอัดแน่นไปด้วยเอกสารวิจัยที่ไม่มีคุณภาพ และทำให้นักวิจัยต้องเผชิญกับความท้าทาย และกัดกร่อนความน่าเชื่อถือของบันทึกทางวิทยาศาสตร์

‘[เราคิดว่า] เราต้องหยุดการอัปโหลดเอกสารวิจัยที่สร้างโดย AI จำนวนมาก (เช่น การโจมตี DDoS ของเอกสารวิจัย) ต่อชุมชนการวิจัย โดยการสร้างบรรทัดฐานที่เข้มงวดสำหรับการเขียนบทวิจารณ์ที่ช่วยเหลือโดย AI’

ผู้เขียนยืนยันว่าการเพิ่มขึ้นของการผลิตเอกสารวิจัยนี้ทำให้เกิดการหลอกลวงต่อระบบนิเวศการวิจัยด้วยรายงานที่มีการปรับปรุงซึ่งไม่มีความลึกที่สำคัญ และซึ่งอาจแพร่กระจายข้อผิดพลาดและ/หรือ สิ่งที่หลอกลวง การอ้างอิง

เอกสารนี้เตือนไว้ว่าหากไม่มีกฎหรือการกำกับดูแลที่ดีขึ้น เอกสารวิจัยที่สร้างโดย AI อาจกลายเป็นสำเนาที่ไม่มีความลึก ซึ่งทำให้หัวข้อที่สำคัญถูกบดบัง การวิเคราะห์ที่มีความหมายถูกซ่อน และการตรวจสอบเอกสารวิจัยนั้นไม่น่าเชื่อถือ:

‘ผลกระทบต่อคุณภาพการวิจัยและความน่าเชื่อถือมีผลกระทบอย่างลึกซึ้ง ประการแรก การพัฒนาที่แท้จริงอาจถูกบดบังโดยการสร้างซ้ำของงานที่มีอยู่แล้ว

‘ผู้เข้าใหม่และนักวิจัยสหวิทยาการอาจต้องดิ้นรนเพื่อค้นหาการทบทวนเอกสารที่เชื่อถือได้ระหว่างเสียงรบกวน นอกจากนี้ ข้อผิดพลาดหรือความลำเอียงที่เกิดจากการจัดรูปแบบอัตโนมัติอาจแพร่กระจายโดยไม่มีการตรวจสอบ และทำให้การวิจัยในอนาคตมีสมมติฐานที่ไม่ถูกต้อง

‘โดยสรุป การหลั่งไหลของเอกสารวิจัยที่ไม่ได้รับการตรวจสอบโดย AI ที่สร้างโดย AI ทำให้ทั้งความเข้มงวดของการตรวจสอบเอกสารวิจัยและความน่าเชื่อถือของบันทึกทางวิทยาศาสตร์ตกอยู่ในความเสี่ยง’

ผู้เขียนที่ ‘ผิดปกติ’

ผู้เขียนของเอกสารใหม่นี้ให้การวิเคราะห์ที่น่าสนใจเกี่ยวกับการพัฒนาการส่งเอกสารวิจัย:

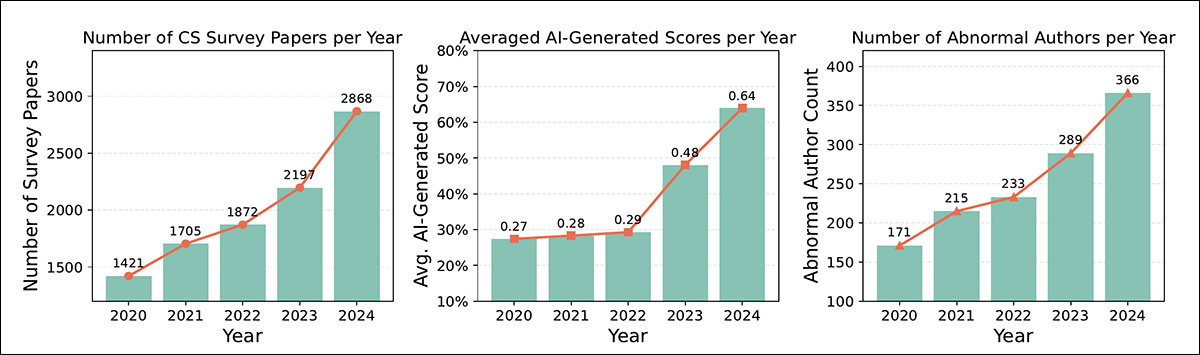

ซ้าย: จำนวนเอกสารวิจัยด้านวิทยาศาสตร์คอมพิวเตอร์จากปี 2020 ถึง 2024 กลาง: คะแนนการสร้างโดย AI สำหรับเอกสารเหล่านั้นในช่วงเวลาเดียวกัน ขวา: จำนวนผู้เขียนที่ถูกตีตราว่า ‘ผิดปกติ’ (ผู้ที่มีการส่งเอกสารวิจัยที่ไม่ธรรมดา ความหลากหลายในการร่วมเขียนที่จำกัด และรูปแบบสถาบันที่ซ้ำกัน) ทุกปี ทั้งสามแนวโน้มแสดงการเพิ่มขึ้นอย่างรวดเร็วตั้งแต่ปี 2023 ซึ่งตรงกับการเปิดตัว ChatGPT และโมเดลภาษาขนาดใหญ่อื่นๆ

ในคอลัมน์แรก เราจะเห็นแนวโน้มการเติบโต: การเพิ่มขึ้นเริ่มต้นในปี 2022 เมื่อ ChatGPT และโมเดลภาษาขนาดใหญ่เริ่มเป็นที่นิยม และโมเดลต่างๆ เช่น Claude, PaLM และ Gemini จะรักษาโมเมนตัมนี้ตลอดปี 2023

กราฟกลางแสดงการเพิ่มขึ้นอย่างรวดเร็วของการส่งเอกสารวิจัยหลังปี 2022 ซึ่งตรงกับการเปิดตัว ChatGPT ทีมวิจัยหนึ่ง พบว่า ในปี 2024 มากกว่า 10% ของบทคัดย่อทางวิทยาศาสตร์ถูกผ่าน LLM แล้ว รายงานที่แยกต่างหากจาก บริษัทตรวจจับ AI ระบุว่าการเพิ่มขึ้นหลัง ChatGPT อยู่ที่ 72% สำหรับเอกสารวิจัยใน arXiv ที่อาจถูกเขียนด้วยความช่วยเหลือของ AI จำนวนเอกสารวิจัยที่มีคะแนนการสร้างโดย AI สูงก็เพิ่มขึ้นเป็นสองเท่าในหนึ่งปี จาก 3.6% เป็น 6.2%

กราฟทางด้านขวาแสดงการเพิ่มขึ้นของ ‘รูปแบบผู้เขียนที่ผิดปกติ’ (นักวิจัยที่ส่งเอกสารวิจัยมากกว่าสามชิ้นในหนึ่งเดือน โดยทำงานร่วมกับผู้เขียนร่วมน้อยกว่าสองคน) โดยมีการเพิ่มขึ้นอย่างรวดเร็วตั้งแต่ปี 2022

ผู้เขียนระบุว่าเอกสารวิจัยเหล่านี้อาจถูกเขียนโดย AI โดยมีเหตุผลที่หลากหลาย บางส่วนถูกเขียนโดยผู้เขียนเดี่ยวหรือกลุ่มเล็กๆ ที่ส่งเอกสารวิจัยหลายชิ้นในเวลาสั้นๆ มีหลายชิ้นที่ครอบคลุมหัวข้อที่ไม่เกี่ยวข้อง และในบางกรณี ผู้เขียนไม่มีประวัติในด้านที่พวกเขากำลังสรุป

นอกจากนี้ บางส่วนถูกตีพิมพ์ภายใต้ชื่อรวมที่ไม่มีความสัมพันธ์กับสถาบัน – รูปแบบที่ชี้ให้เห็นว่ามีการหลั่งไหลของเอกสารวิจัยอย่างต่อเนื่องเพื่อเพิ่มการอ้างอิงหรือปรับปรุงโปรไฟล์ทางวิชาการ มากกว่าที่จะทำคุณูปการใดๆ ต่อเอกสารวิจัย

ปัญหา

แม้ว่าเราจะไม่สามารถครอบคลุมข้อโต้แย้งทั้งหมดของเอกสารใหม่นี้ได้ แต่เราควรพิจารณาบางส่วนของข้อสังเกตที่น่าสนใจที่สุด เช่นเดียวกับการมองหาวิธีแก้ปัญหา:

คุณภาพและความเป็นเอกลักษณ์

ปัญหาไม่ใช่แค่ปริมาณ: เอกสารวิจัยหลายชิ้นที่เขียนโดย AI ขาดสิ่งที่ทำให้เอกสารวิจัยมีประโยชน์: โครงสร้างที่ชัดเจน การวิเคราะห์ที่ลึกซึ้ง การอ้างอิงที่ถูกต้องและรอบคอบ และข้อมูลเชิงลึกที่แท้จริง

ผู้เขียนสังเกตว่าเอกสารวิจัยที่เขียนโดย AI มักขาดโครงสร้าง แต่เพียงแต่แสดงรายการเอกสารวิจัยโดยไม่มีทิศทางที่ชัดเจน ข้ามส่วนสำคัญ และไม่สามารถสร้างบริบทได้ ในทางกลับกัน เอกสารวิจัยที่เขียนโดยมนุษย์มักจะกำหนดหมวดหมู่ที่เหมาะสม และเล่าเรื่องราวที่สอดคล้องกัน

นอกจากนี้ เอกสารวิจัยที่อาจได้รับการช่วยเหลือจาก AI หลายชิ้นดูเหมือนจะคัดลอกการแบ่งหัวข้อที่มีอยู่แล้ว บางครั้งโดยตรงจากวิกิพีเดีย ตัวอย่างเช่น เอกสารระบุว่าเอกสารวิจัยหลายชิ้นเกี่ยวกับ วิชันทรานส์ฟอร์เมอร์ มีหัวข้อและโครงสร้างที่เหมือนกัน ซึ่งบ่งบอกถึงเอาต์พุตของ AI ที่ขึ้นรูป:

‘ในทางกลับกัน เอกสารวิจัยที่เขียนโดยมนุษย์ที่เขียนด้วยมืออาจแนะนำการจำแนกประเภทใหม่ เช่น การแบ่ง ViT ตามกลยุทธ์ประสิทธิภาพ การขาดโครงสร้างเดิมในเอกสารวิจัยที่เผยแพร่ใหม่หลายชิ้นทำให้เกิดความกังวลว่าอาจถูกสร้างโดย AI โดยมีการมีส่วนร่วมของมนุษย์ที่จำกัด’

อย่าพูดถึงเรื่องนั้น

อาจเป็นเรื่องที่น่าอายที่สุด เอกสารวิจัยที่เขียนโดย AI มักจะ การอ้างอิง ไม่ถูกต้อง โดยไม่รวมเอกสารวิจัยที่สำคัญ รวมถึงเอกสารวิจัยที่ไม่เกี่ยวข้อง และบางครั้งแม้แต่เอกสารวิจัยที่ ไม่มีอยู่จริง – ข้อผิดพลาดที่ชี้ให้เห็นว่าข้อมูลอ้างอิงมาจากการจับคู่รูปแบบผิวเผิน มากกว่าความเชี่ยวชาญที่แท้จริง

ผู้เขียนยังชี้ให้เห็นว่าเอกสารวิจัยบางชิ้นซึ่งมักมาจากทีมที่แตกต่างกัน完全 มีการทับซ้อนกันของรายการอ้างอิงถึง 70% – ระดับการทับซ้อนที่สูงมาก ซึ่งบ่งบอกถึงการอาศัย LLM ที่เหมือนกัน ซึ่งดึงข้อมูลจากชุดแหล่งข้อมูลที่แคบๆ

ในความเป็นจริง ผู้ใช้ ChatGPT จะรู้ว่าหัวข้อที่ไม่ค่อยมีคนรู้จักมากนัก มีแหล่งข้อมูลที่หลากหลายน้อยมากที่จะให้โมเดลที่จะ สร้างแบบจำลอง; มักจะพบว่าแหล่งข้อมูลของโมเดลบนเว็บมีประโยชน์มากกว่าการโต้ตอบกับข้อมูลนั้นผ่าน AI ที่ไม่มีข้อมูลเพียงพอในโดเมนนั้น

รูปแบบที่ ‘เป็นเนื้อเดียวกัน’ ที่เกิดขึ้น

ผู้เขียนยังชี้ให้เห็นว่าเอกสารวิจัยหลายชิ้นที่เขียนโดย AI ในหัวข้อเดียวกันมีลักษณะและเสียงที่เหมือนกันมาก LLMs ซ้ำคำและโครงสร้าง โดยเฉพาะสำหรับหัวข้อที่นิยม ส่งผลให้เกิดการหลั่งไหลของเอกสารวิจัยที่เหมือนกันที่ไม่เพิ่มคุณค่า และเพิ่มเสียงรบกวนให้กับนักวิจัยที่กำลังมองหาคำตอบในโดเมน:

‘เมื่อนักเขียนหลายคนขอให้ LLM “เขียนการวิจารณ์วรรณกรรมเกี่ยวกับ X” โมเดลมักจะสร้างผลลัพธ์ที่คล้ายกันมาก โดยเฉพาะสำหรับนิยามหรือข้อเท็จจริงที่รู้จักกันดี การวิจัยล่าสุด พบการเพิ่มขึ้นอย่างรวดเร็วในการใช้รูปแบบการเขียนที่เชื่อมโยงกับ LLMs ซึ่งบ่งบอกว่าหลายเอกสารวิจัยมีรูปแบบเดียวกัน’

ChatGPT ของคุณกำลังแสดงออกมา

เอกสารระบุว่าวิธีหนึ่งในการระบุเอกสารวิจัยที่เขียนโดย AI คือการมีคำว่า ‘ในฐานะโมเดลภาษา AI‘ หรือ ‘การหยุดความรู้ของฉัน‘ ซึ่งบ่งบอกถึงการดูแลหรือการปรับแต่งเอาต์พุตของโมเดลภาษาเพียงเล็กน้อยก่อนที่จะส่งเอกสารวิจัย (แม้ว่าการค้นหาที่มุ่งเป้าในขณะเขียนจะไม่พบคำบอกเล่านี้ที่ดัชนีใน Google Search)

เอกสารระบุว่าเอกสารวิจัยที่ ‘น่าสงสัย’ มากมักจะแสดงความหลากหลายของคำที่ต่ำกว่าและซ้ำคำ โดยตัวอย่างเช่น การเริ่มต้นหลายย่อหน้าด้วย นอกจากนี้ รูปแบบนี้ตามที่ผู้เขียนเสนอนั้นเป็นลักษณะของการเขียน GPT และอาจเป็นปัจจัยที่มีประโยชน์ในการตรวจจับข้อความที่สร้างโดยอัตโนมัติ

(ความคิดเห็นส่วนตัวของฉันเกี่ยวกับเรื่องนี้คือว่าข้อจำกัดของการเขียนออนไลน์มักต้องการให้ผู้เขียนแสดงรายการหลายรายการในรูปแบบที่ไม่มีรูปแบบ โดยไม่มีทางเลือกทางคำศัพท์ที่จำกัด ดังนั้น ChatGPT และเพื่อนๆ ของมันจึงมีแนวโน้มที่จะเรียนรู้นิสัยที่ไม่ดีนี้จากผู้เขียนที่ต้องเผชิญกับทางเลือกทางคำศัพท์ที่จำกัด)

แม้ว่านักวิจัยจะพัฒนาการอภิปรายที่น่าสนใจเกี่ยวกับผลกระทบเชิงลบของเอกสารวิจัย AI ต่อวัฒนธรรมการวิจัยและความน่าเชื่อถือ แต่เราต้องอ้างอิงผู้อ่านไปยัง เอกสารต้นฉบับ สำหรับความลึกมากขึ้นเกี่ยวกับเรื่องนี้

วิธีแก้ปัญหา?

วิธีแก้ปัญหาของเอกสารคือสิ่งที่น่าสนใจ มีความก้าวหน้า และในขณะเดียวกันก็ไม่ค่อยมีเอกลักษณ์เฉพาะตัว: ว่าประโยชน์ของเอกสารวิจัยควรแทนที่ด้วย การสำรวจแบบไดนามิกแบบสด – โดยการแปล เป็นรูปแบบที่คล้ายกับวิกิและหน้า GitHub ที่อัปเดตอย่างต่อเนื่องด้วยข้อมูลใหม่จาก LLM และระบบ AI อื่นๆ แต่การอัปเดตจะทำได้เฉพาะโดยมนุษย์ เพื่อให้ AI ไม่สามารถ ‘อัปโหลดอัตโนมัติ’ ได้

ระบบที่เสนอจะใช้การแบ่งส่วนและกิ่งของ GitHub โดยพื้นฐานแล้วเปลี่ยนแหล่งข้อมูลให้เป็นรายการอัปเดตอย่างต่อเนื่องเหมือนกับ ‘awesome’ สายรายการเชิงคุณภาพที่ GitHub:

‘ภายใต้โครงสร้างนี้ สมาชิกในชุมชนจะกำหนดหัวข้อการสำรวจวิกิโดยการระบุพื้นที่ หัวข้อการวิจัยหลัก และเอกสารอ้างอิงที่สำคัญ ซึ่งกำหนดขอบเขตและโครงสร้างเริ่มต้น

‘ต่อมา ตัวแทนการดูดซึม LLM จะติดตามการเก็บเอกสารวิจัย การดำเนินการประชุม และกระดานผู้นำการbenchmarking โดยอัตโนมัติ มันจะดึงข้อสรุป ตัวเลข และเมตริกการแสดงผลที่สำคัญ สรุปผลลัพธ์ใหม่โดยย่อ อัปเดตกราฟการอ้างอิงเพื่อสะท้อนความสัมพันธ์ระหว่างเอกสาร และแจ้งเตือนแนวโน้มการวิจัยที่เกิดขึ้นใหม่เพื่อการตรวจสอบเพิ่มเติม

‘โดยการออกแบบ การอัปเดตอัตโนมัติเหล่านี้เกิดขึ้นภายในไม่กี่ชั่วโมงหลังการเผยแพร่ เพื่อให้แน่ใจว่าคลังข้อมูลยังคงอยู่ในระดับแนวหน้า

‘ผู้ร่วมให้ข้อมูลของมนุษย์เข้ามาให้ความลึกในการตีความที่เครื่องจักรเพียงอย่างเดียวไม่สามารถให้ได้ พวกเขาพัฒนาตัวแบ่งประเภทที่พัฒนาไปสู่การรับรู้ถึงความแตกต่างเชิงวิธีการที่ละเอียดอ่อนระหว่างนวัตกรรมเชิงอัลกอริทึมในย่อยสาขาต่างๆ และให้การเปรียบเทียบเชิงวิพากษ์ที่ลึกซึ้งยิ่งขึ้นเพื่อเอกสาร

หนังสือแห่งการเปลี่ยนแปลง

ผู้เขียนพัฒนาการเสนอของตนอย่างกระตือรือร้นและยาวนาน และโดยพื้นฐานแล้วให้เหตุผลว่ามันถูกต้องด้วยสิ่งที่เป็นความจริง: การสำรวจที่เขียนด้วยมือซึ่งมีแรงงานสูงในหัวข้อที่เปลี่ยนแปลงอย่างรวดเร็วรอบๆ AI เก่ามากจนแทบจะไม่คุ้มที่จะเขียน; และเอกสารระบุว่าการหมุนเวียนสามเดือนสำหรับการสำรวจใหม่จะหมายความว่ามันจะล้าสมัย (หรือแม้แต่ ล้าสมัยอย่างรุนแรง) เมื่อวันเผยแพร่ที่กำหนดมาถึง:

‘ปีแล้วปีเล่า ชุมชนถูกหลั่งไหลด้วยการสรุปที่ซ้ำซ้อนหรือผิวเผิน ซึ่งเสียความเกี่ยวข้องอย่างรวดเร็ว ทำให้ผู้ปฏิบัติงานและผู้เริ่มต้นต้องดิ้นรนในการแยกแยะสัญญาณออกจากเสียงรบกวน

‘นอกจากนี้ ปริมาณเอกสารวิจัยที่เพิ่มขึ้นทำให้เกิดการอัดทับทางปัญญา เนื่องจากผู้อ่านต้องค้นหาเอกสารที่มีเนื้อหาสาระเพื่อค้นหาข้อมูลเชิงลึกที่มีความหมาย

ไม่น่าดีใจที่วิธีแก้ปัญหาของเอกสารนี้แบ่งปันคุณลักษณะที่ไม่ดีที่สุดและถูกวิพากษ์วิจารณ์มากที่สุดของ Discord: สิ่งที่สำคัญที่สุดคือว่ามันจะเป็นทรัพยากรที่เปลี่ยนแปลงและเคลื่อนไหวอยู่ตลอดเวลา

เนื่องจากส่วนใดๆ ของการสำรวจแบบไดนามิกแบบสดอาจหายไปหรือถูกแก้ไขได้ทุกเมื่อ จึงเป็นไปไม่ได้ที่จะใช้เป็นแหล่งอ้างอิงที่มั่นคงและเชื่อถือได้; ยกเว้นโดยการเชื่อมโยงไปยัง ‘การอัปเดตก่อนหน้า’ ในลักษณะเดียวกับที่ archive.is และ Wayback Machine รวมถึงไซต์เก็บถาวรอื่นๆ ให้ภาพถ่ายของเนื้อหาของหน้าเว็บที่ถูกแช่แข็งไว้ที่เวลาที่เฉพาะเจาะจง แต่ทรัพยากรใดที่การอัปโหลดดังกล่าวต้องการ และจะสามารถพึ่งพาได้หรือไม่?

นอกจากนี้ แพลตฟอร์ม/วิกิที่มีการเปลี่ยนแปลงและเนื้อหาที่เปลี่ยนแปลงอยู่ตลอดเวลาจะเป็นเรื่องที่ท้าทายในการดัชนี ไม่ว่าจะโดยเครื่องมือค้นหาทั่วไปหรือ LLMs

ส่วนที่อ่อนที่สุดของระบบที่เสนอคือความคิดที่ว่าคนจริงๆ ควรควบคุมการอัปโหลดจากตัวแทน LLM; เพราะคนจริงๆ มีราคาแพง สิ่งที่ถูกเสนอคือสิ่งที่อยู่ระหว่างพิพิธภัณฑ์และห้องสมุด – ทั้งสองอย่างต้องการการให้บริการด้านเนื้อหาที่มีคนเป็นเจ้าของในปริมาณที่สอดคล้องกับจำนวนข้อมูลและหัวข้อที่ครอบคลุม

หาก ‘ใช้คนจริงๆ‘ เป็นคำตอบเดียวสำหรับปัญหา AI แล้วปัญหานั้นยังคงเปิดและไม่ได้รับการแก้ไข

สรุป

ในขณะนี้ ชีวิตบนพื้นผิวของเอกสารวิจัยที่มีอายุการใช้งานสั้นคือเรื่องที่น่ารำคาญ; หากแนวโน้มปัจจุบันของการเขียนอัตโนมัติและการส่งเอกสารวิจัยขนาดใหญ่ดำเนินต่อไปตามที่คาดการณ์ไว้ในเอกสารใหม่ อัตราส่วนสัญญาณต่อเสียงรบกวนจะกลายเป็นเรื่องเร่งด่วน และเอกสารวิจัยจะไม่สามารถควบคุมได้

ในสถานการณ์ดังกล่าว จะยากกว่าที่เสียงที่ไม่ใช่ FAANG ที่จะถูกฟังในพายุของการส่งเอกสารวิจัย และผู้นำตลาดที่สำคัญจะน่าจะได้รับการยอมรับมากขึ้น

นอกเหนือจากการสำรวจแบบไดนามิกแบบสดแล้ว เอกสารใหม่นี้ยังเสนอแนะว่าผู้เขียนไม่เพียงแต่ต้องประกาศตนเองว่าใช้ AI ในส่วนใดๆ ของการส่งเอกสารวิจัย แต่ยังต้องระบุอย่างชัดเจนว่าส่วนใดของเอกสารวิจัยที่ได้รับการช่วยเหลือจาก AI (อาจเป็นไปได้ด้วยไฟล์ JSON ที่อยู่ข้างๆ)

เนื่องจากสิ่งนี้เป็นแนวคิดที่ยาก การวิจัยใหม่เสนอ ‘เก็ตโต้ของ AI‘ แทน – ส่วนแยกต่างหากในการส่งเอกสารวิจัยที่สงวนไว้สำหรับการมีส่วนร่วมของ AI

โดยสรุป เอกสารใหม่นี้ไม่มีคำตอบที่เป็นจริงที่จะนำเสนอ แต่ผู้เขียนได้ทำการบริการที่มีประโยชน์ในการกำหนดความท้าทายที่จะเกิดขึ้น

เอกสาร หยุดการโจมตี DDoS ต่อชุมชนการวิจัยด้วยเอกสารวิจัยที่สร้างโดย AI สามารถพบได้ที่ https://arxiv.org/abs/2510.09686 และเขียนโดยผู้เขียนหกคนจากภาควิชาต่างๆ ที่ Shanghai Jiao Tong University

___________________________________

* ไม่ใช่ทุกคนที่รู้สึกว่านี่เป็นกรณี.

†การเน้นของผู้เขียน ไม่ใช่ของผม นอกจากนี้ การแปลงอ้างอิงในบรรทัดของผู้เขียนให้เป็นลิงก์เมื่อเหมาะสม

เผยแพร่ครั้งแรกวันศุกร์ที่ 17 ตุลาคม 2025