ปัญญาประดิษฐ์

การแนะนำ Vertex AI

เมื่อพื้นที่ของปัญญาประดิษฐ์กำลังพัฒนาไปอย่างรวดเร็ว อุปสรรคที่สำคัญที่ผู้นำด้านเทคโนโลยี thườngพบคือการเปลี่ยนแปลงจากการทดลองไปสู่การเป็น “ระบบที่พร้อมสำหรับการใช้งานในองค์กร” ในขณะที่แชทบอทสำหรับผู้บริโภคและแพลตฟอร์มแบบโต้ตอบช่วยให้คนเห็นภาพได้ดีขึ้น แต่ธุรกิจไม่สามารถประสบความสำเร็จได้ด้วยการมีเพียงอินเทอร์เฟซการแชทเท่านั้น ในยุคที่การแข่งขันรุนแรงกว่าเดิม ธุรกิจต้องการระบบนิเวศที่มีความแข็งแกร่ง มีความสามารถในการปรับขนาด และมีความปลอดภัย และนี่คือสิ่งที่ Google พยายามที่จะนำเสนอด้วย Vertex AI ซึ่งเป็นแพลตฟอร์ม Artificial Intelligence & Machine Learning ที่รวมเป็นหนึ่งของ Google Cloud

Vertex AI พยายามที่จะสร้างตัวเองให้เป็นรากฐานสำหรับการรวม Generative AI เข้ากับโครงสร้างพื้นฐานของคลาวด์สมัยใหม่ โดยนำเสนอชุดคุณสมบัติที่ครอบคลุมซึ่งช่วยลดช่องว่างระหว่างโมเดลพื้นฐานที่ไม่ได้ถูกตัดทอนและแอปพลิเคชันที่พร้อมสำหรับการผลิต Vertex AI ไม่ใช่แค่การห่อหุ้มโมเดลภาษาขนาดใหญ่ (LLMs) แต่เป็นระบบนิเวศของ Machine Learning และ Artificial Intelligence (ML/AI) ที่รวม Generative AI เป็นส่วนหนึ่งของโครงสร้างพื้นฐานของคลาวด์สมัยใหม่

ที่ใจกลางของ Vertex AI คือ Model Garden ซึ่งเป็นตลาดกลางที่ให้เข้าถึงโมเดลพื้นฐานมากกว่า 200 โมเดล รวมถึง Gemini 2.5 Pro ซึ่งเป็นโมเดลที่มีหน้าต่างบริบทขนาด 2 ล้านโทเคน ในบทความนี้ เราจะวิเคราะห์สถาปัตยกรรมของ Vertex AI ตรวจสอบว่า Model Garden ทำหน้าที่เป็น “App Store” สำหรับอุตสาหกรรม และมองไปที่เสาหลักทางเทคนิคที่ทำให้แพลตฟอร์มนี้เป็นกระดูกสันหลังของซอฟต์แวร์องค์กรรุ่นต่อไป

สถาปัตยกรรมหลัก : แพลตฟอร์มที่รวมเป็นหนึ่ง

Vertex AI ไม่ใช่แค่การรวบรวมเครื่องมือที่ไม่เชื่อมต่อกัน แต่เป็นระบบนิเวศของข้อมูลและ AI ที่ออกแบบมาเพื่อเชื่อมต่อความแตกแยกของข้อมูล เครื่องมือ และทีมที่ยังคงเป็นปัญหาในการเรียนรู้ของเครื่องจักรมาจนถึงทุกวันนี้ การพัฒนาด้าน AI มักเกิดขึ้นในสภาพแวดล้อมที่แยกจากกัน และบางครั้งข้อมูลก็กระจายและถูกกักขังในหลายๆ ที่เก็บข้อมูล เช่น องค์กรอาจเก็บข้อมูลลูกค้าในคลังข้อมูล SQL ในขณะที่เอกสารที่ไม่มีโครงสร้างถูกทิ้งลงใน Data Lake เมื่อข้อมูลถูกกักขัง AI จะเห็นเพียง “ความจริงที่ไม่สมบูรณ์” ส่งผลให้เกิดผลลัพธ์ที่มีอคติหรืออัตราการหลอกลวงสูงเพราะไม่มีข้อมูลทั้งหมดขององค์กร

Vertex AI พยายามที่จะรวมชีวิตการทำงานทั้งหมด ตั้งแต่การนำเข้าข้อมูลดิบใน BigQuery และ Cloud Storage ไปจนถึงการตรวจสอบการผลิต โดยทำหน้าที่เป็น “เนื้อเยื่อเชื่อม” ระหว่างซิลโลเหล่านี้ Vertex AI รวมเข้ากับ Cloud Storage และ BigQuery โดยธรรมชาติ ทำให้โมเดล AI สามารถดึงข้อมูลได้โดยไม่ต้องมีการขนส่งข้อมูลที่ซับซ้อน

รากฐาน : AI Hypercomputer ของ Google

ชั้น GenAI ของ Vertex AI นั่งอยู่บนสถาปัตยกรรม AI Hypercomputer ของ Google ซึ่งเป็นระบบซูเปอร์คอมพิวเตอร์ที่รวมเข้าด้วยกัน ประกอบด้วย:

TPU v5p & v5e (Tensor Processing Units)

Tensor Processing Units ของ Google เป็น ASIC (Application-Specific Integrated Circuits) ที่ออกแบบมาโดยเฉพาะสำหรับการคูณเมทริกซ์ที่กำหนดการเรียนรู้เชิงลึก

- TPU v5p (Performance): นี่คือตัวเร่งความเร็วสำหรับการฝึกอบรมขนาดใหญ่ แต่ละ TPU v5p pod สามารถปรับขนาดได้ถึง 8,960 ชิปที่เชื่อมต่อกันด้วย Inter-Chip Interconnect (ICI) ที่มีแบนด์วิธสูงสุดของ Google ที่ 4,800 Gbps สำหรับผู้นำด้านเทคนิค สิ่งนี้หมายถึงการฝึกอบรมที่เร็วขึ้น 2.8 เท่าสำหรับโมเดล GPT-3 ขนาด (175B พารามิเตอร์) เมื่อเทียบกับรุ่นก่อนหน้า ลดเวลาในการเข้าสู่ตลาดอย่างมาก

- TPU v5e (Efficiency): ออกแบบมาเพื่อประสิทธิภาพที่มีต้นทุน ตัวเร่งความเร็ว v5e เป็นตัวเร่งความเร็วสำหรับการฝึกอบรมขนาดกลางและอินเฟอร์เรนซ์ที่มีปริมาณสูง มันให้ประสิทธิภาพที่ดีขึ้น 2.5 เท่า ทำให้เป็นตัวเลือกที่เหมาะสำหรับธุรกิจที่ต้องการรันการอนุมาน 24/7 โดยไม่ต้องมีงบประมาณขนาดใหญ่

NVIDIA H100/A100 GPUs สำหรับความยืดหยุ่น

ในขณะที่ TPUs เป็นแบบเฉพาะเจาะจง ทีมพัฒนามากมายพึ่งพานิเวศระบบ CUDA ของ NVIDIA Vertex AI ให้การสนับสนุนแบบแรกสำหรับการฮาร์ดแวร์ใหม่ล่าสุดของ NVIDIA:

- NVIDIA H100 (Hopper): เหมาะสำหรับการปรับให้เหมาะสมของโมเดลโอเพ่นซอร์สที่ใหญ่ที่สุด (เช่น Llama 3.1 405B) ที่ต้องการแบนด์วิธหน่วยความจำขนาดใหญ่

- Jupiter Networking: เพื่อป้องกัน “ปัญหาคอขวดของเครือข่าย” Google ใช้เนื้อผ้าเครือข่ายศูนย์ข้อมูล Jupiter ซึ่งรับประกันว่าข้อมูลจะเคลื่อนที่ระหว่าง GPU ด้วยความเร็วสูง โดยสนับสนุน RDMA (การเข้าถึงหน่วยความจำระยะไกล) เพื่อหลีกเลี่ยงภาระงานของ CPU และส่งมอบประสิทธิภาพที่ใกล้เคียงกันในโหนดที่กระจาย

การกำกับดูแลแบบไดนามิก

การเปลี่ยนแปลงทางเทคนิคที่สำคัญที่สุดใน Vertex AI คือ การกำกับดูแลแบบไดนามิก ในสภาพแวดล้อมที่มีประวัติการใช้งาน หากโหนด GPU ล้มเหลวระหว่างการฝึกอบรม 3 สัปดาห์ งานทั้งหมดอาจล้มเหลว

- การฟื้นตัวอัตโนมัติ: Vertex AI ซึ่งมักจะขับเคลื่อนโดย Google Kubernetes Engine (GKE) ภายใต้ฮูด มีคุณลักษณะ “การฟื้นตัวของตัวเอง” ของโหนด หากพบข้อผิดพลาดของฮาร์ดแวร์ แพลตฟอร์มจะย้ายงานไปยังโหนดที่มีสุขภาพดีโดยอัตโนมัติ

- ตัวกำหนดการวางแผนงานแบบไดนามิก: เครื่องมือนี้ช่วยให้ทีมสามารถขอความสามารถตามความเร่งด่วนได้ คุณสามารถเลือก Flex Start (ราคาถูกกว่า เริ่มต้นที่ความสามารถที่มีอยู่) หรือความสามารถที่รับประกันสำหรับการเปิดตัวที่สำคัญต่อภารกิจ

- การฝึกอบรมแบบเซิร์ฟเวอร์เลส: สำหรับทีมที่ต้องการการจัดการโครงสร้างพื้นฐานเป็นศูนย์ การฝึกอบรมแบบเซิร์ฟเวอร์เลสของ Vertex AI ช่วยให้คุณส่งโค้ดและข้อมูลของคุณ แพลตฟอร์มจะจัดเตรียมคลัสเตอร์ รันงาน และทำลายคลัสเตอร์ – คิดค่าใช้จ่ายเฉพาะสำหรับวินาทีการคำนวณที่ใช้

จุดเข้าถึงสามจุด: การค้นพบ การทดลอง และการทำให้自动

เพื่อให้เหมาะสมกับบุคลิกทางเทคนิคที่แตกต่างกัน ตั้งแต่นักวิทยาศาสตร์ข้อมูลไปจนถึงนักพัฒนาแอปพลิเคชัน Vertex AI มีจุดเข้าถึงหลักสามจุด:

- Model Garden: ตลาดสำหรับการค้นพบ

- Vertex AI Studio: สนามทดลองสำหรับการทดลอง

- Vertex AI Agent Builder: โรงงานสำหรับการทำให้自动

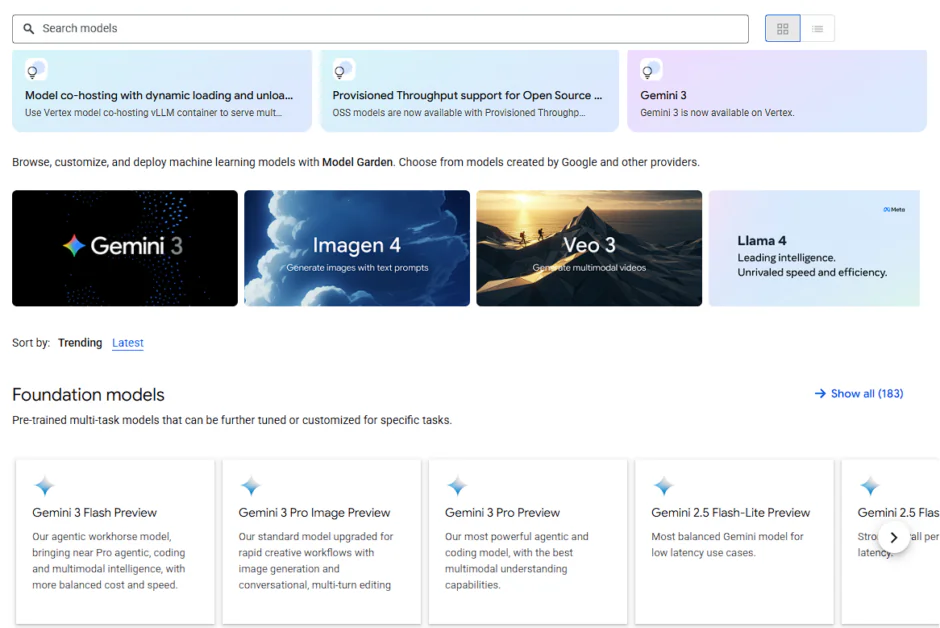

Model Garden: ตลาดสำหรับการค้นพบ

Model Garden ของ Google Cloud เป็นแพลตฟอร์มที่รวมเป็นหนึ่งใน Google Cloud สำหรับการค้นพบ การทดสอบ การปรับแต่ง และการนำไปใช้ของโมเดล AI หลายรูปแบบ รวมถึงโมเดลหลายรูปแบบ (การมองเห็น ข้อความ รหัส) สำหรับความต้องการทางธุรกิจต่างๆ โดยให้การผสานรวมที่ไร้รอยต่อกับเครื่องมือของ Vertex AI สำหรับการจัดการ MLOps ที่เป็นกระแส มันทำหน้าที่เป็นห้องสมุดที่ครอบคลุม ช่วยให้นักพัฒนาและธุรกิจเลือกโมเดลที่เหมาะสม (ตั้งแต่โมเดลพื้นฐานขนาดใหญ่ไปจนถึงโมเดลที่มีความเชี่ยวชาญ) สำหรับงานของตน ไม่ว่าจะเป็นการสร้างข้อความ การวิเคราะห์ภาพ หรือการเติมโค้ด และนำไปใช้อย่างมีประสิทธิภาพภายในสภาพแวดล้อม Google Cloud ของตน

Model Garden จัดหมวดหมู่โมเดลมากกว่า 200 โมเดลออกเป็นสามระดับที่แตกต่างกัน ทำให้архิตекторสามารถสร้างสมดุลระหว่างประสิทธิภาพ ต้นทุน และการควบคุม:

- โมเดล Google (First-Party): โมเดลหลายรูปแบบที่เป็นโมเดลหลักของ Vertex AI และ Google นำเสนอโมเดลเหล่านี้ในหลายขนาด ตั้งแต่ Pro ที่มีการให้เหตุผลที่ซับซ้อนไปจนถึง Flash ที่มีความหน่วงต่ำและปริมาณสูง ทำให้นักพัฒนาสามารถปรับโมเดลให้เหมาะกับกรณีการใช้งานของตน

- โมเดลของบุคคลที่สาม (Proprietary): ผ่านการร่วมมือเชิงกลยุทธ์ Vertex AI นำเสนอ “Model-as-a-Service” (MaaS) สำหรับยักษ์ใหญ่ด้าน AI เช่น Anthropic (Claude 3.5) และ Mistral AI แทนที่จะจัดการการเรียกเก็บเงินและข้อมูลรับรองความปลอดภัยแยกกันสำหรับผู้ให้บริการ AI ห้าราย ทีมเทคนิคสามารถเข้าถึงทั้งหมดผ่านโครงการ Google Cloud ที่มีอยู่ โดยใช้รูปแบบ API ที่รวมเป็นหนึ่ง

- โมเดลโอเพ่นซอร์สและโมเดลหนักเปิด: ระดับนี้รวมถึง Meta’s Llama 3.2, Mistral และ Gemma ของ Google โมเดลเหล่านี้เหมาะสำหรับองค์กรที่ต้องการติดตั้งโมเดลภายใน VPC (Virtual Private Cloud) ของตนเองเพื่อให้แน่ใจถึงการแยกข้อมูลสูงสุด

ในระบบที่ไม่รวมเป็นหนึ่ง การนำไปใช้ของโมเดลโอเพ่นซอร์ส เช่น Llama ต้องตั้งค่าสภาพแวดล้อม PyTorch การกำหนดค่าไดรเวอร์ CUDA และการจัดการส่วนหุ้ม Flask หรือ FastAPI

Model Garden ลดระยะเวลา “Munging” นี้ผ่าน จุดสิ้นสุดแบบจัดการแบบรวม:

- การนำไปใช้ด้วยคลิกเดียว: สำหรับหลายๆ โมเดล การคลิก “Deploy” จะเตรียมทรัพยากร TPU/GPU ที่จำเป็น ห่อโมเดลในคอนเทนเนอร์ที่พร้อมสำหรับการผลิต และให้จุดสิ้นสุด API แบบ REST

- การรวม Hugging Face: Vertex AI ตอนนี้ช่วยให้นักพัฒนาสามารถนำไปใช้โมเดลโดยตรงจาก Hugging Face Hub ไปยังจุดสิ้นสุดของ Vertex โดยให้การขยายความฉลาดที่เกือบจะไม่มีขอบเขต

- การเชื่อมต่อบริการส่วนตัว (PSC): สำหรับอุตสาหกรรมที่มีการควบคุมอย่างเข้มงวด โมเดลสามารถนำไปใช้โดยใช้ การเชื่อมต่อบริการส่วนตัว โดยรับประกันว่าจุดสิ้นสุดของโมเดลจะไม่ถูกเปิดเผยต่ออินเทอร์เน็ตสาธารณะ – ทำให้การจราจรข้อมูลอยู่ภายในเครือข่ายองค์กรเท่านั้น

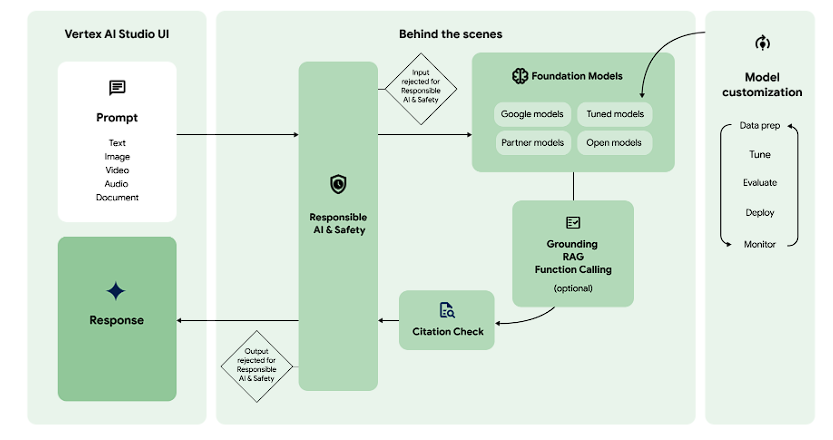

Vertex AI Studio: สนามทดลองสำหรับการทดลอง

ในขณะที่ Model Garden เกี่ยวกับการเลือก Vertex AI Studio เกี่ยวกับ ความแม่นยำ Vertex AI Studio สามารถเปรียบได้กับเครื่องมือและตัวแก้ปัญหาแบบดั้งเดิมที่คุณพบในสภาพแวดล้อมซอฟต์แวร์แบบดั้งเดิม สตูดิโอของ Vertex AI คือพื้นที่ทำงานที่โมเดลดิบถูกแกะสลักให้เป็นเครื่องมือทางธุรกิจโดยเฉพาะผ่านการผสมผสานของวิศวกรรมคำสั่ง การทดสอบหลายรูปแบบ และการปรับไฮเปอร์พารามิเตอร์ที่ทันสมัย

การสร้างต้นแบบหลายรูปแบบ: นอกเหนือจากข้อความ

คุณลักษณะที่โดดเด่นของสตูดิโอคือการสนับสนุน หลายรูปแบบ โดยธรรมชาติ ในขณะที่แพลตฟอร์มอื่นๆ ต้องการการเขียนโค้ดที่ซับซ้อนเพื่อรับมือกับข้อมูลที่ไม่ใช่ข้อความ Vertex AI Studio ช่วยให้คุณสามารถวางไฟล์โดยตรงลงในอินเทอร์เฟซเพื่อทดสอบความสามารถในการให้เหตุผลของ Gemini 2.5

- การวิเคราะห์วิดีโอ: คุณสามารถอัปโหลดวิดีโอบทความทางเทคนิค 45 นาทีและขอให้โมเดล “ระบุเวลาที่ API ที่เฉพาะเจาะจงถูกกล่าวถึงและให้สรุปที่มีเวลาเริ่มต้น”

- การวิเคราะห์เอกสาร: แทนที่จะอ่านข้อความเพียงอย่างเดียว โมเดลสามารถวิเคราะห์ การวางแนวภาพ ของเอกสาร PDF 1,000 หน้า โดยเข้าใจความสัมพันธ์ระหว่างแผนภูมิ ตาราง และข้อความที่อยู่รอบๆ

- การดำเนินการโค้ด: สตูดิโอสนับสนุน การดำเนินการโค้ดในพื้นที่เล่น หากคุณขอให้โมเดลแก้ปัญหาทางคณิตศาสตร์ที่ซับซ้อนหรือวิเคราะห์ CSV โมเดลสามารถเขียนและดำเนินการโค้ด Python ในสภาพแวดล้อมที่ปลอดภัยและแยกจากกันเพื่อให้ได้คำตอบที่ตรวจสอบแล้ว

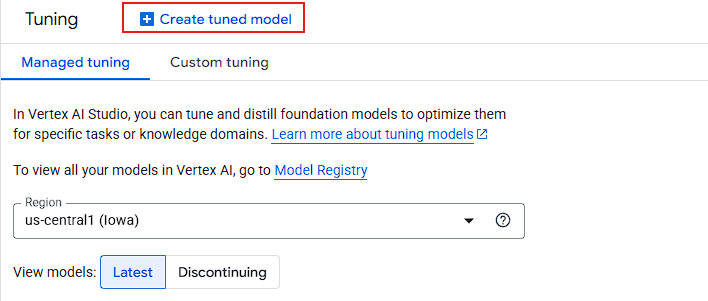

การปรับแต่งขั้นสูง: เส้นทางการปรับแต่ง

เมื่อการวิศวกรรมคำสั่ง (Zero-shot หรือ Few-shot) ถึงขีดจำกัด Vertex AI Studio ให้เครื่องมือหนัก: การปรับแต่งโมเดล

- การปรับให้เหมาะสมแบบมีผู้ดูแล (SFT): นักพัฒนาสามารถให้เซตข้อมูลของ “คำสั่ง/คำตอบ” (โดยทั่วไป 100+ ตัวอย่าง) ซึ่งสอนโมเดลให้ใช้เสียงแบรนด์ที่เฉพาะเจาะจง รูปแบบการออก (เช่น JSON ที่มีรายละเอียด) หรือภาษาเฉพาะโดเมน

- การแคชบริบท: สำหรับองค์กรที่จัดการกับเซตข้อมูลขนาดใหญ่และคงที่ (เช่น ห้องสมุดทางกฎหมายหรือฐานโค้ด) สตูดิโอช่วยให้สามารถ การแคชบริบท ได้ ซึ่งช่วยให้คุณสามารถ “โหลดล่วงหน้า” ล้านโทเค็นของข้อมูลเข้าไปในหน่วยความจำของโมเดล ลดความหน่วงและต้นทุนสำหรับการสืบค้นต่อๆ ไปอย่างมาก

- การกลั่นกรอง (ครู-นักเรียน): นี่คือการเคลื่อนไหวทางสถาปัตยกรรมระดับสูง คุณสามารถใช้โมเดลขนาดใหญ่ (Gemini 2.5 Pro) เพื่อ “สอน” โมเดลที่เล็กกว่าและเร็วกว่า (Gemini 2.0 Flash) ผลลัพธ์คือโมเดลที่มีขนาดเล็กและเร็วที่สุดซึ่งทำงานในระดับ “Pro” แต่ทำงานด้วยความเร็วและต้นทุนที่ “Flash”

Vertex AI Agent Builder: โรงงานสำหรับการทำให้自动

Vertex AI Agent Builder เป็นเฟรมเวิร์กการกำกับดูแลระดับสูงซึ่งช่วยให้นักพัฒนาสามารถสร้างตัวแทนเหล่านี้ได้โดยการรวมโมเดลพื้นฐานเข้ากับข้อมูลขององค์กรและ API ภายนอก

สถาปัตยกรรมของ “ความจริง”: การยึดและ RAG

อุปสรรคทางเทคนิคหลักที่สำคัญที่สุดต่อ AI องค์กรคือ การหลอกลวง Agent Builder ช่วยแก้ปัญหานี้ผ่านเครื่องยนต์ การยึด ที่ซับซ้อน

- การยึดด้วยการค้นหา Google: สำหรับการสืบค้นที่ต้องการความรู้ของโลกแบบเรียลไทม์ (เช่น “อัตราดอกเบี้ยจำนองปัจจุบันในนิวยอร์กคืออะไร?”) ตัวแทนสามารถค้นหา Google ได้ นำข้อเท็จจริงมา และอ้างอิงแหล่งที่มา

- Vertex AI Search (RAG-as-a-Service): แทนที่จะสร้างฐานข้อมูลเวกเตอร์ (Pinecone, Weaviate) ด้วยตนเอง นักพัฒนาสามารถใช้ Vertex AI Search เพื่อสร้างดัชนีเอกสารของตนเอง (PDF, HTML, BigQuery) โดยจัดการขั้นตอนการแบ่งชิ้น การฝัง และการดึงข้อมูลโดยอัตโนมัติ เพื่อให้แน่ใจว่าตัวแทนจะตอบตาม “แหล่งที่มาของความจริง” ภายในองค์กรเท่านั้น

- Vertex AI RAG Engine: สำหรับการใช้งานแบบกำหนดเองขนาดใหญ่ บริการนี้ช่วยให้สามารถค้นหาที่ผสมผสาน (การรวมผลลัพธ์เวกเตอร์และคีย์เวิร์ด) เพื่อปรับปรุงความแม่นยำได้ถึง 30% มากกว่าผลลัพธ์ LLM ทั่วไป

การกำกับดูแลตัวแทนหลายราย (A2A Protocol)

การทำงานขององค์กรขั้นสูงมักต้องการตัวแทนหลายรายที่ทำงานร่วมกัน Vertex AI นำ โปรโตคอลตัวแทนถึงตัวแทน (A2A) มาใช้ ซึ่งเป็นมาตรฐานที่เปิดกว้างที่ช่วยให้:

- “ตัวแทนการเดินทาง” พูดคุยกับ “ตัวแทนการเงิน” เพื่อให้แน่ใจว่าการจองเที่ยวบินอยู่ในงบประมาณขององค์กร

- การทำงานร่วมกัน: เนื่องจากใช้โปรโตคอลที่เปิดกว้าง ตัวแทนบน Vertex AI สามารถสื่อสารกับตัวแทนบนเฟรมเวิร์กอื่นๆ เช่น LangChain หรือ CrewAI

สแต็คของนักพัฒนา: ADK และ Agent Engine

สำหรับผู้ชม “แพลตฟอร์มเทคนิค” Agent Builder มีเส้นทางสองเส้นที่แตกต่างกัน:

- คอนโซลแบบไม่ต้องเขียนโค้ด: อินเทอร์เฟซแบบลากและวางสำหรับการสร้างต้นแบบและกำหนดค่าผู้ใช้งานธุรกิจอย่างรวดเร็ว

- ชุดพัฒนาตัวแทน (ADK): ชุดพัฒนาซอฟต์แวร์ Python สำหรับวิศวกร ซึ่งช่วยให้สามารถทำ “คำสั่งเป็นโค้ด” ได้ รวมถึงการบูรณาการกับการควบคุมเวอร์ชันและการนำไปใช้กับ Vertex AI Agent Engine—รันไทม์ที่จัดการการรักษาสถานะ การปรับขนาด และการจัดการสถานะโดยอัตโนมัติ

สรุป: จาก “สมมติว่า” ถึง “อะไรต่อไป”

การเปลี่ยนแปลงจากตัวอย่าง AI ที่น่าประทับใจไปสู่แอปพลิเคชันองค์กรที่พร้อมสำหรับการผลิตได้ยาวนานเป็น “หุบเขาตาย” สำหรับโครงการการเปลี่ยนแปลงดิจิทัล เมื่อเราได้สำรวจ Vertex AI ได้รับการออกแบบมาโดยเฉพาะเพื่อข้ามช่องว่างนี้ โดยการรวมความแตกแยกของข้อมูล โครงสร้างพื้นฐาน และการกำกับดูแลโมเดล Google Cloud ได้ย้ายการอภิปรายจากพลังของโมเดลภาษาขนาดใหญ่ไปสู่ ความต่อเนื่องในการทำงาน ของวงจรชีวิต AI