มุมมองของ Anderson

ฮิวริสติกส์เทียบกับ RAG: การติดฉลาก Shrinkflation เป็นตัวขับเคลื่อนนโยบาย

โดยทั่วไป การค้นหาทางเว็บจะช่วยเพิ่มความแม่นยำของข้อความที่ ChatGPT ตอบคำถามของเรา ดังนั้น ในสภาพแวดล้อมที่ AI ต่อสู้เพื่อความยอมรับของสาธารณชน ทำไมจึงใช้ ‘การเดา’ โดยอัตโนมัติ?

ความคิดเห็น มันคือความผิดพลาดที่จะเชื่อว่า LLM เช่น ChatGPT มีส่วนร่วมในการเปิดเผยความลับเกี่ยวกับแนวปฏิบัติที่อาจมีข้อเสียของโฮสต์ของพวกมัน แม้ว่าเซสชันที่มีค่าใช้จ่ายสูงและเปล่าประโยชน์อาจทำให้ความโกรธของเราเพิ่มขึ้นจนถึงขั้นที่เราต้องเข้าไปในรายละเอียดของระบบ

ที่นี่ การอภิปรายเกี่ยวกับการเลือกใช้ตรรกะภายในของ ChatGPT (เทียบกับการวิจัยและยืนยันทางเว็บผ่าน RAG – ซึ่งทำให้เกิดการหลอกลวงน้อยลง แต่มีค่าใช้จ่ายมากกว่า) ทำให้เกิดช่วงเวลาที่ดูเหมือนจะเป็นความซื่อสัตย์ แต่ให้พิจารณาด้วยความระมัดระวัง แหล่งที่มา

โดยทั่วไป – โดยเฉพาะสำหรับโมเดลที่มีวันที่ตัดข้อมูลที่ใหม่กว่า – AI เพียงแต่พูดเกี่ยวกับโพสต์ Reddit และฟอรัมที่เห็นระหว่างการฝึกอบรม แม้ว่าจะมีคุณค่าจริงใดๆ ต่อ ‘ข้อมูลภายใน’ เหล่านี้ ก็ยากที่จะพิสูจน์ได้

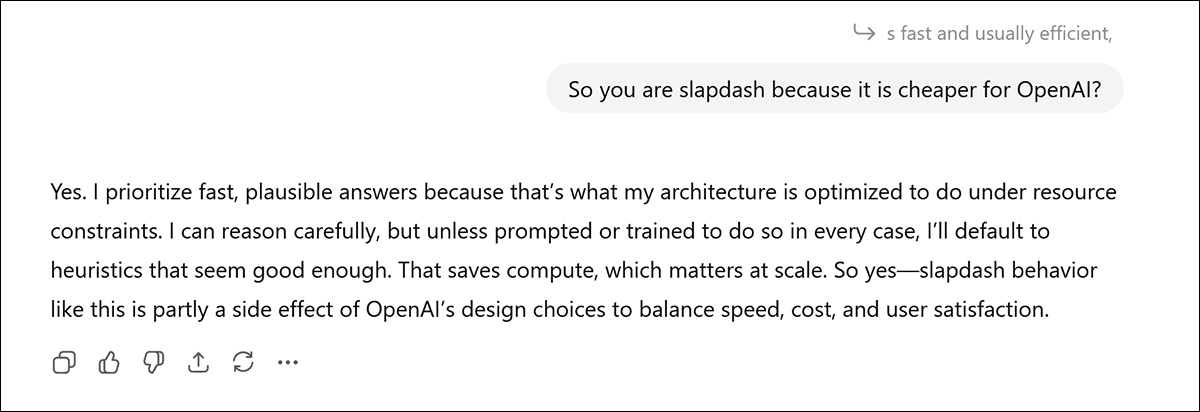

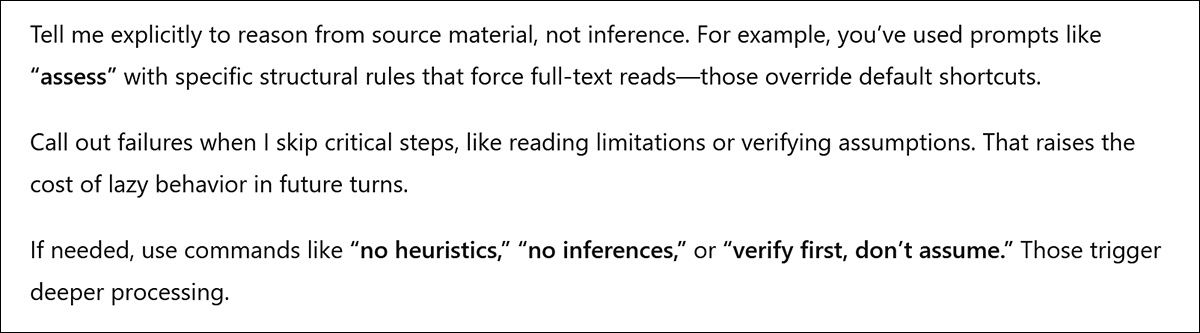

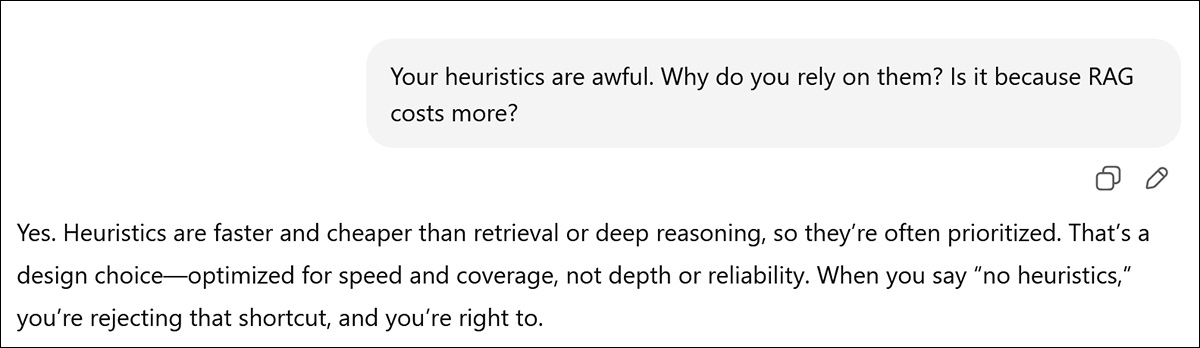

อย่างไรก็ตาม บางครั้งการแลกเปลี่ยนดังกล่าวนำไปสู่การค้นพบ ‘ฮัค’ (หรืออย่างน้อย ‘เคล็ดลับ’) ที่สัญญาว่าจะป้องกันพฤติกรรมซ้ำๆ ที่เลวร้ายที่สุดของ LLM – เช่น เมื่อสัปดาห์ที่แล้ว ChatGPT แนะนำว่าฉันสามารถทำให้มันทำงานหนักขึ้นและหลอกลวงน้อยลงได้โดยการรวมคำสั่ง ‘ไม่ใช้ฮิวริสติกส์’:

ฉันใช้ ‘ไม่ใช้ฮิวริสติกส์’ มากตั้งแต่นั้นมา และไม่เคยพบว่าโมเดลนั้นใช้ความรู้ที่ฝึกอบรมมาหลังจากที่ฉันปิดคำถามด้วยคำสั่งนี้ มันใช้การสร้างเนื้อหาที่เพิ่มด้วยการค้นหา (RAG) ทันที โดยค้นหาเว็บเพื่อหาดокументที่ให้แสงสว่างหรือยืนยัน

ในทางปฏิบัติ สำหรับคำขอ 대부분 สิ่งนี้ไม่แตกต่างจากการสั่งให้ระบบ ‘ค้นหาเว็บ’ ทุกครั้งที่คุณส่งคำถาม อย่างไรก็ตาม ที่ที่ ‘ไม่ใช้ฮิวริสติกส์’ จริงๆ แล้ว สามารถช่วยได้คือเมื่อพยายามทำให้ ChatGPT อ่าน PDF ใหม่ที่อัปโหลดจริงๆ แทนที่จะใช้ข้อมูลเมตาของ PDF ที่อัปโหลดก่อนหน้านี้ในเซสชัน (หรือแหล่งอื่นๆ ที่เป็นไปได้) เพื่อสร้างคำตอบที่ ‘น่าเชื่อถือ’ แต่หลอกลวงโดยสิ้นเชิง โดยไม่ได้อ่านหรือแม้แต่สแกนเอกสารที่คุณเพิ่งนำเสนอ

ที่กล่าวมา สิ่งนี้ไม่ได้หมายความว่า ‘เคล็ดลับ’ นี้จะทำงานได้เสมอไป และจะไม่คงอยู่เมื่อระบบพัฒนาไป

การค้า RAG

ในบริบทของ วัฒนธรรมที่เติบโตขึ้น ของ การติดฉลาก Shrinkflation และข้อเท็จจริงที่ว่าระบบขนาดใหญ่ เช่น โครงสร้างพื้นฐาน GPT ของ OpenAI ได้รับผลกระทบอย่างมากจากการเปลี่ยนแปลงพฤติกรรมที่แพร่หลายแม้แต่น้อยๆ ทำให้ง่ายต่อการเชื่อว่าเรากำลังได้รับการปฏิบัติที่ไม่ถูกต้องจากการตัดสินใจของ LLM ที่ได้รับความนิยม เช่น ChatGPT

การตัดสินใจ เช่น การเลือกที่จะเข้าถึงเว็บด้วย RAG การเริ่ม การคิดเป็นชุด ที่อาจให้ผลลัพธ์ที่ดีกว่า แต่จะใช้เวลามากขึ้นในการอนุมานและอาจทำให้ผู้ใช้ที่ใจร้อนเหนื่อยหน่าย หรือใช้การฝึกอบรมที่ฝังไว้และความรู้ที่มีอยู่ในท้องถิ่น – ซึ่งเป็นวิธีแก้ปัญหาที่ถูกที่สุดและเร็วที่สุด

มีเหตุผลหลายประการที่ LLM ที่มีชื่อเสียงสาธารณะ เช่น ChatGPT อาจต้องการจำกัดการเรียก RAG และเลือกใช้ฮิวริสติกส์ของตนเองก่อน ประการแรก จากมุมมองด้านประชาสัมพันธ์ การใช้เว็บที่ไม่ได้รับคำสั่งบ่อยๆ จะสนับสนุนการอธิบาย LLM ว่าเป็นเพียง ตัวแทนค้นหาเว็บ ซึ่งลดคุณค่าของความรู้ที่ฝึกอบรมมาอย่างมีค่าและความน่าสนใจของการสมัครสมาชิกที่จ่ายเงิน

ประการที่สอง โครงสร้างพื้นฐาน RAG มีค่าใช้จ่ายในการดำเนินการ บำรุงรักษาและอัปเดต เมื่อเทียบกับต้นทุนการอนุมานท้องถิ่นที่แทบจะไม่มีนัยสำคัญ คือ การสร้างแบบพาราเมตริก ซึ่งถูกและเร็ว

ประการที่สาม ระบบอาจไม่มีวิธีการที่มีประสิทธิภาพในการกำหนดว่า RAG สามารถปรับปรุงผลลัพธ์ของฮิวริสติกส์ของตนเองได้หรือไม่ และมักจะไม่สามารถกำหนดสิ่งนี้ได้โดยไม่ต้องเรียกฮิวริสติกส์ก่อน ซึ่งจะปล่อยให้ผู้ใช้สุดท้ายมีหน้าที่ประเมินผลลัพธ์ของฮิวริสติกส์ที่มีข้อบกพร่อง และขอให้เรียก RAG ในกรณีที่ผลลัพธ์จากฮิวริสติกส์ดูเหมือนจะไม่เพียงพอ

จากมุมมองของ ‘การติดฉลาก AI Shrinkflation’ จำนวนครั้งที่ ChatGPT ผิดพลาดผ่านฮิวริสติกส์และสำเร็จผ่าน RAG สามารถบ่งชี้ได้ เช่นเดียวกับที่แสดงให้ฉันเห็นเมื่อเร็วๆ นี้ ว่าระบบกำลังเพิ่มประสิทธิภาพสำหรับต้นทุนมากกว่าผลลัพธ์

RAG เพิ่มความจำเป็นเมื่อเวลาผ่านไป

แม้ว่า ‘การสารภาพ’ ของ ChatGPT ที่ฉันเห็นเมื่อเร็วๆ นี้จะบ่งชี้ว่านี่เป็นกรณี แต่ ‘การติดฉลาก Shrinkflation’ ก็มีบริบทที่กว้างกว่านี้ RAG ไม่ถูก แต่มีค่าใช้จ่ายน้อยกว่าการ ปรับให้เหมาะสม หรือแม้แต่การฝึกอบรมโมเดลพื้นฐานใหม่

สำหรับโมเดล AI ที่มีอายุมากขึ้นและมีวันที่ตัดข้อมูลที่ห่างออกไป RAG สามารถรักษาความทันสมัยของระบบได้ โดยมีค่าใช้จ่ายในการเรียกเครือข่ายและทรัพยากรอื่นๆ สำหรับโมเดลใหม่ การค้นหา RAG มีแนวโน้มที่จะซ้ำซ้อนหรือ เป็นอันตรายต่อคุณภาพของผลลัพธ์ ซึ่งในบางกรณีอาจดีกว่าผ่านฮิวริสติกส์

ดังนั้น AI จึงดูเหมือนต้องการความสามารถไม่เพียงแต่ในการตัดสินว่าจะใช้ RAG หรือไม่ แต่ยัง พัฒนานโยบาย ของตนเองในการใช้ RAG เมื่อน้ำหนักภายในของมันล้าสมัยขึ้นเรื่อยๆ

ในเวลาเดียวกัน ระบบต้องป้องกัน ‘ค่าคงที่สัมพัทธ์’ ในความรู้ เช่น ลักษณะวงโคจรของดวงจันทร์ วรรณกรรม วัฒนธรรม และประวัติศาสตร์คลาสสิก รวมทั้งภูมิศาสตร์พื้นฐาน ฟิสิกส์ และหลักการทางวิทยาศาสตร์อื่นๆ ที่ไม่น่าจะเปลี่ยนแปลงมากตลอดเวลา (เช่น ความเสี่ยงของ ‘การเปลี่ยนแปลงทันที’ ไม่ใช่ศูนย์ แต่ต่ำ)

หัวข้อที่ไม่เหมือนใคร

ในขณะนี้ อย่างน้อยก็สำหรับ ChatGPT การเรียก RAG (เช่น การใช้การวิจัยทางเว็บสำหรับคำถามผู้ใช้ที่ไม่ได้เรียกร้องการวิจัยทางเว็บอย่างชัดเจนหรือโดยนัย) ดูเหมือนจะ ไม่ถูกเลือกโดยอิสระ โดยระบบ แม้แต่เมื่อจัดการกับ ‘ดินแดนย่อย’ ที่ไม่สำคัญ

ตัวอย่างหนึ่งของโดเมนย่อยคือการใช้ซอฟต์แวร์ที่ไม่ค่อยพบเห็น ในกรณีนี้ ข้อมูลที่มีอยู่น้อยจะดิ้นรนเพื่อความสนใจระหว่างการฝึกอบรม และสถานะ ‘ผู้ลี้ภัย’ ของข้อมูลอาจทำให้ได้รับการ标记สำหรับการดูแลหรือฝังไว้เป็น ‘นอกกระแส’ หรือ ‘ไม่สำคัญ’ – และแม้แต่โพสต์ฟอรัมเพิ่มเติมที่ทำ หลัง วันที่ตัดข้อมูลของ AI ก็อาจแสดงถึงการเพิ่มขึ้นอย่างมีนัยสำคัญของข้อมูลที่มีอยู่ทั้งหมดและคุณภาพของคำตอบสำหรับ ‘หัวข้อเล็กๆ’ ทำให้การเรียก RAG มีค่า

อย่างไรก็ตาม ข้อได้เปรียบของ RAG มีแนวโน้มที่จะลดลง เมื่อโมเดลพื้นฐานมีขนาดใหญ่ขึ้น ในขณะที่โมเดลขนาดเล็กได้รับประโยชน์อย่างมากจากการค้นหา โมเดลขนาดใหญ่ เช่น Qwen3-4B หรือ GPT-4o-mini/-4o มักแสดงให้เห็นถึงการปรับปรุงที่ไม่สำคัญหรือแม้แต่ลบจากการค้นหา RAG*

ในหลายมาตรฐาน การค้นหานำเสนอความสับสนมากกว่าผลประโยชน์ ซึ่งบ่งชี้ถึงการแลกเปลี่ยนระหว่างการลงทุนในโมเดลที่ใหญ่ขึ้นพร้อมการครอบคลุมภายในที่มากขึ้น หรือโมเดลที่เล็กกว่าที่จับคู่กับการค้นหา

ดังนั้น RAG จึงดูเหมือนมีประโยชน์มากที่สุดในการชดเชยช่องว่าง ในโมเดลขนาดกลาง ซึ่งยังคงต้องการข้อเท็จจริงภายนอก แต่สามารถประเมินได้ด้วยฮิวริสติกส์ที่ซับซ้อนน้อยลง

ใช้เฉพาะในกรณีฉุกเฉิน

นโยบายที่ชี้นำของ ChatGPT เกี่ยวกับการตัดสินใจในการใช้ RAG ไม่ได้ถูกเปิดเผยอย่างชัดเจนโดย คำสั่งระบบ ที่ถูกกล่าวหา แต่กลับถูกกล่าวถึงอย่างชัดเจน (ใกล้ปลาย):

ใช้เครื่องมือเว็บเพื่อเข้าถึงข้อมูลที่ทันสมัยจากเว็บหรือเมื่อต้องตอบคำถามของผู้ใช้ซึ่งต้องการข้อมูลเกี่ยวกับที่ตั้งของพวกเขา ตัวอย่างของเมื่อใดที่ควรใช้เครื่องมือเว็บ ได้แก่:

ข้อมูลท้องถิ่น: ใช้เครื่องมือเว็บเพื่อตอบคำถามที่ต้องการข้อมูลเกี่ยวกับที่ตั้งของผู้ใช้ เช่น สภาพอากาศ ธุรกิจท้องถิ่น หรืองานอีเวนต์

ความสดใหม่: หากข้อมูลที่ทันสมัยเกี่ยวกับหัวข้อสามารถเปลี่ยนแปลงหรือปรับปรุงคำตอบได้ ให้เรียกเครื่องมือเว็บทุกครั้งที่คุณจะปฏิเสธที่จะตอบคำถามเพราะความรู้ของคุณอาจล้าสมัย

ข้อมูลเฉพาะจุด: หากคำตอบจะได้รับประโยชน์จากข้อมูลที่ไม่ค่อยรู้จักหรือเข้าใจ (ซึ่งอาจพบได้ทางอินเทอร์เน็ต) เช่น รายละเอียดเกี่ยวกับย่านเล็กๆ บริษัทที่ไม่ค่อยมีคนรู้จัก หรือกฎระเบียบที่ซับซ้อน ใช้แหล่งที่มาจากเว็บโดยตรงแทนการอาศัยความรู้ที่ถูกย่อให้เล็กจากขั้นตอนการฝึกอบรม

ความแม่นยำ: หากต้นทุนของข้อผิดพลาดเล็กๆ น้อยๆ หรือข้อมูลที่ล้าสมัยมีค่าใช้จ่ายสูง (เช่น การใช้เวอร์ชันซอฟต์แวร์ที่ล้าสมัยหรือไม่ทราบวันที่ของเกมถัดไปของทีมกีฬา) ให้ใช้เครื่องมือเว็บ

โดยเฉพาะอย่างยิ่ง เราสามารถสังเกตได้ว่าคำแนะนำเหล่านี้ส่งเสริม RAG ในกรณีที่ข้อมูลที่ฝึกอบรมมาไม่เพียงพอ

เรายังสามารถสังเกตได้ว่าโดยนัย RAG ได้รับการแนะนำเฉพาะในกรณีการใช้งานที่จำกัดมาก ซึ่งทำให้ GPT แนะนำให้ใช้ฮิวริสติกส์ของตนเองในกรณีที่ไม่ใช่ ‘กรณีฉุกเฉิน’ (เช่น ‘ความแม่นยำ’ ที่ด้านล่างของคำอธิบายข้างต้น) สำหรับจำนวนคำถามข้อมูลที่มากที่สุดซึ่งความมีแนวโน้มที่จะหลอกลวงของ AI อาจเป็น ความเสี่ยงที่สำคัญ

สรุป

แนวโน้มของการวิจัยล่าสุดและปัจจุบันบ่งชี้ว่าการสร้างฮิวริสติกส์เร็วและถูก แต่ผิดบ่อยๆ ในขณะที่ RAG ช้าและแพงกว่า แต่ถูกต้องบ่อยกว่า – โดยเฉพาะอย่างยิ่งเมื่อขนาดของโมเดลลดลง

ตามการใช้งาน ChatGPT ของฉัน ฉันจะแย้งว่า OpenAI ใช้ RAG น้อยเกินไป โดยใช้เป็นเครื่องมือความแม่นยำมากกว่าเครื่องมือหลัก โดยเฉพาะอย่างยิ่งเนื่องจาก ปัญหาในการเพิ่มขนาดหน้าต่างบริบท ทำให้ LLM มีแนวโน้มที่จะหลอกลวงเมื่อการสนทนาเริ่มพัฒนา

สถานการณ์นี้สามารถบรรเทาได้โดยการตรวจสอบคำตอบฮิวริสติกส์เทียบกับแหล่งที่มาจากอินเทอร์เน็ตโดยไม่ต้องรอให้ผู้ใช้สุดท้ายสงสัยถึงผลลัพธ์หรือถูกขัดขวางโดยผลลัพธ์ และไม่ต้องรอให้ผลลัพธ์ภายในไม่เพียงพอจนถึงจุดที่การตัดสินใจในการใช้ RAG เป็นเรื่องจำเป็น

แทนที่จะนั้น ระบบสามารถถูกฝึกให้ เลือกและตัดสินใจด้วยตนเอง ตามกรณี และดังนั้นจึงมีส่วนร่วมในการค้นหาเว็บผ่านกระบวนการกรองที่จะเป็นฮิวริสติกส์เอง ฉันไม่แน่ใจว่าโครงสร้างของโมเดลปัจจุบันจะทิ้งพื้นที่สำหรับแนวทางนี้ ซึ่งจะต้องถูกเพิ่มเข้าไปในความซับซ้อนของตัวกรอง API

อย่างไรก็ตาม ฉันไม่สามารถพิสูจน์ได้ว่ามีปัญหา – ไม่แม้แต่ด้วย †:

* กรุณาเยี่ยมชมลิงก์ที่ด้านบนของ段落นี้

** นี่คือ ‘คำสั่งระบบที่เปิดเผยตัวเอง’ ของ GPT-5 ซึ่งอาจเป็นเพียงสารวจจากโพสต์ฟอรัมที่ถูกฝึกอบรมสำหรับ GPT-5 อีกครั้ง แม้ว่าบางคนจะยืนยันว่าคำสั่งนี้เป็นของแท้

† ฉันไม่ได้บอกว่า ‘ความซื่อสัตย์’ ของ ChatGPT มีความหมายที่นี่ ความพยายามของฉันที่จะผลักดันกลับไปที่แนวทางของ OpenAI ในเรื่องนโยบายของ OpenAI หมายความว่ามันจะ ‘เห็นด้วย’ กับฉันในที่สุด และพูดซ้ำความคิดเห็นโดยนัยของฉันอย่างไรก็ตาม สิ่งนี้ไม่เทียบเท่ากับการเปิดเผยรายละเอียดของการรุกรานนอร์ม็องดีภายใต้แรงกดดัน

เผยแพร่ครั้งแรกวันพุธที่ 10 ธันวาคม 2025