ปัญญาประดิษฐ์

การเพิ่มประสิทธิภาพการเรียนรู้ของเครื่องจักรผ่านการปรับขนาดภาพโดยใช้ CNN

Google Research ได้เสนอวิธีการใหม่เพื่อเพิ่มประสิทธิภาพและความแม่นยำของการฝึกอบรมคอมพิวเตอร์วิทัศน์โดยการปรับปรุงวิธีการย่อภาพในขั้นตอนการประมวลผลล่วงหน้า

ใน paper การเรียนรู้เพื่อปรับขนาดภาพสำหรับงานคอมพิวเตอร์วิทัศน์ นักวิจัย Hossein Talebi และ Peyman Milanfar ใช้ CNN เพื่อสร้างสถาปัตยกรรมการปรับขนาดภาพแบบไฮบริดใหม่ที่สามารถปรับปรุงผลลัพธ์การรู้จำได้อย่างมีนัยสำคัญในฐานข้อมูลคอมพิวเตอร์วิทัศน์ที่ได้รับความนิยมสี่ฐานข้อมูล

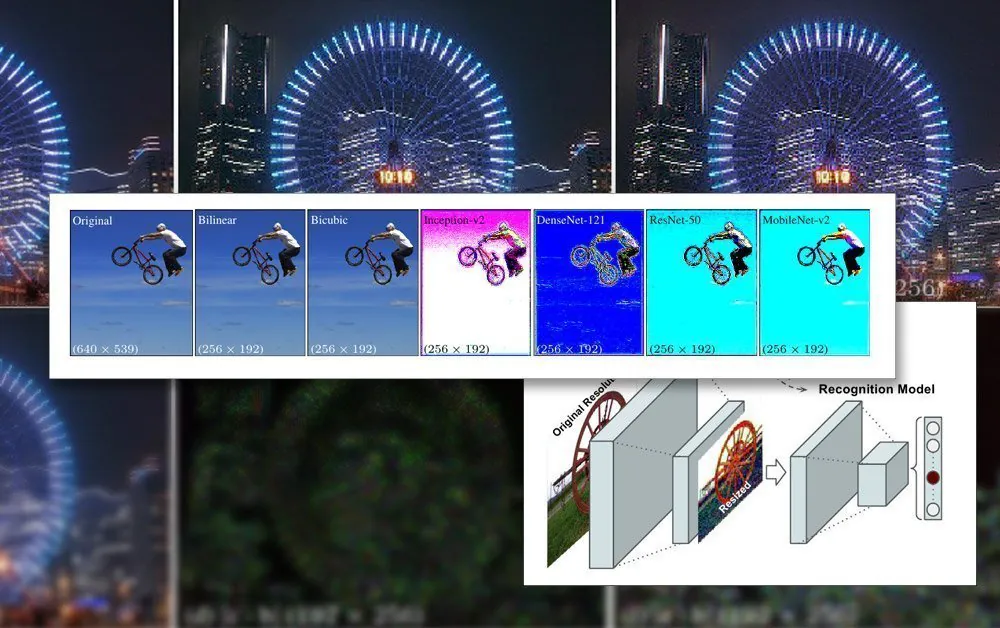

โครงสร้างแบบไฮบริดที่เสนอสำหรับการรู้จำและปรับขนาด Source: https://arxiv.org/pdf/2103.09950.pdf

paper นี้สังเกตเห็นว่าวิธีการปรับขนาด/ย่อภาพที่ใช้ในกระบวนการเรียนรู้ของเครื่องจักรอัตโนมัติเป็นเทคนิคที่ล้าสมัยและใช้วิธีการย่อภาพแบบพื้นฐาน เช่น bilinear, bicubic และ nearest neighbor การย่อภาพ – วิธีการที่ปฏิบัติต่อพิกเซลทั้งหมดอย่างไม่เลือก lọc

ในทางตรงกันข้าม วิธีการที่เสนอใหม่นี้เพิ่มข้อมูลภาพโดยใช้ CNN และรวมข้อมูลนั้นเข้ากับภาพที่ปรับขนาดซึ่งจะผ่านสถาปัตยกรรมแบบจำลองในที่สุด

ข้อจำกัดของภาพในกระบวนการฝึกอบรม AI

เพื่อฝึกอบรมแบบจำลองที่จัดการกับภาพ จะต้องมีขั้นตอนการประมวลผลล่วงหน้าซึ่งภาพที่มีขนาดและพื้นที่สีและความละเอียดต่างๆ (ที่จะช่วยให้ฐานข้อมูลฝึกอบรม) จะถูกตัดและปรับขนาดให้เหมาะสมและอยู่ในรูปแบบเดียว

โดยทั่วไป จะต้องมีการประนีประนอมระหว่างเวลาในการประมวลผล/ทรัพยากร ขนาดไฟล์ และคุณภาพของภาพ ในกรณีส่วนใหญ่ ขนาดสุดท้ายของภาพที่ประมวลผลจะเล็กมาก ตัวอย่างเช่น ภาพที่มีความละเอียด 80×80 ซึ่งเป็นภาพที่ใช้ในการสร้างฐานข้อมูล deepfakes ในช่วงแรกๆ ได้ถูกสร้างขึ้น:

เนื่องจากใบหน้า (และวัตถุอื่นๆ) มักไม่เหมาะสมกับอัตราส่วนสี่เหลี่ยมจัตุรัส จึงอาจต้องมีการเพิ่มแถบสีดำ (หรือพื้นที่ว่าง) เพื่อทำให้ภาพมีความสม่ำเสมอ ซึ่งจะลดพื้นที่ภาพที่ใช้ได้จริง:

ที่นี่ ใบหน้าถูกตัดออกจากพื้นที่ภาพที่ใหญ่กว่าจนกระทั่งถูกตัดให้เหมาะสมที่สุดเพื่อรวมพื้นที่ใบหน้าทั้งหมด อย่างไรก็ตาม ดังที่เห็นทางด้านซ้าย พื้นที่ที่เหลือจะไม่ได้ใช้ในการฝึกอบรม ซึ่งเพิ่มความสำคัญของคุณภาพภาพที่ปรับขนาด

เนื่องจากความสามารถของ GPU ได้ปรับปรุงขึ้นในช่วงไม่กี่ปีที่ผ่านมา โดยการเพิ่มขนาด VRAM ของการ์ด NVIDIA รุ่นใหม่ พื้นที่ภาพที่ใช้ในการฝึกอบรมจึงเริ่มเพิ่มขึ้น แม้ว่าขนาด 224×224 พิกเซลยังคงเป็นมาตรฐาน (เช่น ในฐานข้อมูล ResNet-50)

ภาพที่ไม่ได้ปรับขนาด 224×244 พิกเซล

การใส่แบตช์เข้าไปใน VRAM

สาเหตุที่ภาพทั้งหมดต้องมีขนาดเท่ากันคือว่า การลื่นไถลของความชัน วิธีการที่แบบจำลองปรับปรุงขึ้นตามเวลา ต้องการข้อมูลฝึกอบรมที่เป็นมาตรฐาน

สาเหตุที่ภาพต้องเล็กมากคือว่าภาพจะต้องถูกโหลด (ถูกแยกออก) เข้าไปใน VRAM ในระหว่างการฝึกอบรมเป็นแบตช์เล็กๆ โดยปกติจะอยู่ระหว่าง 6-24 ภาพต่อแบตช์ หากมีภาพที่ไม่เพียงพอในแต่ละแบตช์ จะไม่มีเนื้อหากลุ่มที่เพียงพอในการสร้างแบบจำลอง และจะทำให้เวลาในการฝึกอบรมยาวขึ้น หากมีภาพมากเกินไป ในแบตช์เดียว แบบจำลองอาจล้มเหลวในการได้รับคุณลักษณะและรายละเอียดที่จำเป็น (ดูรายละเอียดด้านล่าง)

ส่วน ‘การโหลดแบบเรียลไทม์’ ของสถาปัตยกรรมการฝึกอบรมเรียกว่า พื้นที่ 潛在 นี่คือที่ที่คุณลักษณะถูกถอดออกจากข้อมูลเดียวกันซ้ำๆ (เช่น ภาพเดียวกัน) จนกระทั่งแบบจำลองได้เข้าใกล้สภาวะที่มีความรู้ทั่วไปที่จำเป็นในการดำเนินการเปลี่ยนแปลงในข้อมูลที่ไม่เคยเห็นมาก่อน

กระบวนการนี้โดยทั่วไปใช้เวลาหลายวัน แต่อาจใช้เวลาหนึ่งเดือนหรือมากกว่านั้นในการคำนวณที่ต่อเนื่องและไม่หยุดยั้ง 24/7 เพื่อให้ได้ผลลัพธ์ที่มีประโยชน์ การเพิ่มขนาด VRAM จะช่วยได้ แต่การเพิ่มขนาดภาพเพียงเล็กน้อยอาจส่งผลกระทบต่อความสามารถในการประมวลผลและความแม่นยำที่อาจไม่ดีเสมอไป

การใช้ VRAM ที่มีขนาดใหญ่ขึ้นเพื่อรองรับขนาดแบตช์ที่ใหญ่ขึ้นยังเป็นเรื่องที่ซับซ้อน เนื่องจากความเร็วในการฝึกอบรมที่เพิ่มขึ้นที่ได้รับจากสิ่งนี้มีแนวโน้มที่จะถูกชดเชยด้วยผลลัพธ์ที่ไม่แม่นยำ

ดังนั้น เนื่องจากสถาปัตยกรรมการฝึกอบรมมีข้อจำกัดอย่างมาก สิ่งใดๆ ที่สามารถปรับปรุงภายในข้อจำกัดที่มีอยู่ของกระบวนการคือความสำเร็จที่สำคัญ

วิธีการที่การย่อภาพที่ดีกว่าช่วยให้ได้ผล

คุณภาพสุดท้ายของภาพที่จะรวมอยู่ในฐานข้อมูลฝึกอบรมได้พิสูจน์แล้วว่ามีผลกระทบต่อผลลัพธ์ของการฝึกอบรม โดยเฉพาะอย่างยิ่ง งานการรู้จำวัตถุ ในปี 2018 นักวิจัยจาก Max Planck Institute for Intelligent Systems โต้แย้ง ว่าการเลือกวิธีการย่อภาพส่งผลกระทบต่อประสิทธิภาพและผลลัพธ์ของการฝึกอบรม

นอกจากนี้ การทำงานก่อนหน้านี้ของ Google (ที่เขียนร่วมกับ ผู้เขียนของ paper ใหม่) พบว่าความแม่นยำในการจำแนกประเภทสามารถปรับปรุงได้โดย การควบคุม อาร์ตแฟคต์ของการบีบอัดในภาพฐานข้อมูล

แบบจำลอง CNN ที่สร้างไว้ในตัวย่อภาพใหม่นี้รวมการย่อภาพแบบ bilinear กับฟังก์ชัน ‘skip connection’ ที่สามารถรวมเอาออัพพุตจากแบบจำลองที่ฝึกอบรมแล้วเข้ากับภาพที่ปรับขนาด

ไม่เหมือนกับสถาปัตยกรรม encoder/decoder ทั่วไป การเสนอใหม่นี้สามารถทำงานได้ไม่เพียงแต่ในแบบ feed-forward bottleneck แต่ยังสามารถทำงานในแบบ inverse bottleneck สำหรับการปรับขนาดขึ้นไปยังขนาดและอัตราส่วนใดๆ ได้ นอกจากนี้ วิธีการย่อภาพ ‘มาตรฐาน’ สามารถเปลี่ยนออกเป็นวิธีการอื่นๆ ที่เหมาะสม เช่น Lanczos

รายละเอียดความถี่สูง

วิธีการใหม่นี้สามารถสร้างภาพที่ดูเหมือนจะ ‘อบ’ คุณลักษณะสำคัญ (ที่จะถูกตระหนักโดยกระบวนการฝึกอบรม) เข้าไปในภาพต้นฉบับโดยตรง ในแง่ของสุนทรียศาสตร์ ผลลัพธ์ไม่เหมือนกับภาพทั่วไป:

วิธีการใหม่นี้ใช้กับ 네็ตเวิร์กสี่แบบ – Inception V2; DenseNet-121; ResNet-50; และ MobileNet-V2 ผลลัพธ์ของวิธีการย่อภาพ/ปรับขนาดของ Google Research สร้างภาพที่มีการรวมพิกเซลที่ชัดเจน โดยคาดการณ์ลักษณะที่จะถูกตระหนักโดยกระบวนการฝึกอบรม

นักวิจัยสังเกตว่าการทดลองเบื้องต้นนี้ได้รับการปรับให้เหมาะสมสำหรับงานการรู้จำภาพเท่านั้น และในการทดลอง พวกเขาพบว่า ‘การย่อภาพที่เรียนรู้’ ที่ใช้ CNN สามารถบรรลุผลลัพธ์ที่ดีขึ้นในงานการรู้จำภาพ นักวิจัยตั้งใจที่จะนำวิธีการนี้ไปใช้กับงานคอมพิวเตอร์วิทัศน์ที่ใช้ภาพอื่นๆ ในอนาคต