Искусственный интеллект

Почему генеративные видеосистемы не могут создавать полные фильмы?

Возникновение и прогресс генеративного ИИ-видео заставил многих наблюдателей предсказать, что машинное обучение станет причиной смерти киноиндустрии, как мы ее знаем – вместо этого, отдельные создатели смогут создавать голливудские блокбастеры дома, либо на локальных, либо на облачных системах GPU.

Возможно ли это? Даже если это возможно, является ли оно близким, как считают многие?

Тот факт, что отдельные люди в конечном итоге смогут создавать фильмы в той форме, в которой мы их знаем, с последовательными персонажами, повествовательной непрерывностью и полной фотореалистичностью, вполне возможен – и, возможно, даже неизбежен.

Однако есть несколько真正 фундаментальных причин, почему это вряд ли произойдет с видеосистемами, основанными на латентных диффузионных моделях.

Этот последний факт важен, потому что, на данный момент, эта категория включает каждую популярную текст-в-видео (T2) и изображение-в-видео (I2V) систему, доступную на рынке, включая Minimax, Kling, Sora, Imagen, Luma, Amazon Video Generator, Runway ML, Kaiber (и, насколько мы можем судить, предстоящую видеофункциональность Adobe Firefly pending); среди многих других.

Здесь мы рассматриваем перспективу истинных авторских полнометражных ген-ИИ-произведений, созданных отдельными людьми, с последовательными персонажами, операторской работой и визуальными эффектами, по крайней мере, на уровне современного состояния дел в Голливуде.

Давайте рассмотрим некоторые из самых больших практических препятствий на пути к этим задачам.

1: Вы не можете получить точный последующий кадр

Непоследовательность повествования является самым большим из этих препятствий. Факт состоит в том, что ни одна из доступных видеосистем не может создать真正 точный ‘последующий кадр’*.

Это связано с тем, что деноизирующая диффузионная модель в основе этих систем полагается на случайный шум, и эта основная principio не поддается повторной интерпретации точно одного и того же контента дважды (т.е. с разных углов или путем разработки предыдущего кадра в последующий кадр, который поддерживает последовательность с предыдущим кадром).

Где используются текстовые подсказки, отдельно или вместе с загруженными ‘семенными’ изображениями (мультимодальный вход), токены, полученные из подсказки, будут вызывать семантически-приемлемый контент из обученной латентной области модели.

Однако, дальнейшее препятствие ‘случайному шуму’ фактору, оно никогда не сделает это одинаково дважды.

Это означает, что личности людей в видео будут склонны меняться, и объекты и окружающая среда не будут соответствовать начальному кадру.

Это причина, по которой вирусные клипы, изображающие необычные визуальные эффекты и голливудский уровень вывода, склонны быть либо отдельными кадрами, либо ‘шоу-монтажом’ возможностей системы, где каждый кадр имеет разных персонажей и окружающую среду.

Отрывки из генеративного ИИ-монтажа от Marco van Hylckama Vlieg – источник: https://www.linkedin.com/posts/marcovhv_thanks-to-generative-ai-we-are-all-filmmakers-activity-7240024800906076160-nEXZ/

Вывод в этих коллекциях ад хок видео-генераций (которые могут быть неискренними в случае коммерческих систем) заключается в том, что базовая система может создавать связные и последовательные повествования.

Аналогия, используемая здесь, – это трейлер фильма, который включает только минуту или две кадров из фильма, но дает аудитории повод相信, что весь фильм существует.

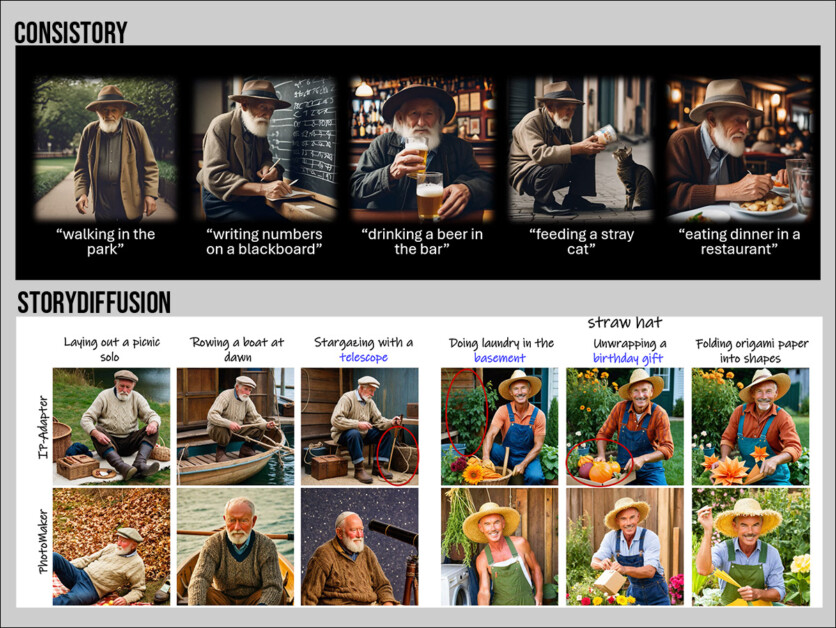

Единственные системы, которые в настоящее время предлагают повествовательную последовательность в диффузионной модели, – это те, которые производят статические изображения. Сюда входят ConsiStory от NVIDIA и различные проекты в научной литературе, такие как TheaterGen, DreamStory и StoryDiffusion.

Два примера ‘статической’ повествовательной последовательности, из недавних моделей:: Источники: https://research.nvidia.com/labs/par/consistory/ и https://arxiv.org/pdf/2405.01434

В теории можно использовать лучшую версию таких систем (ни одна из вышеперечисленных не является真正 последовательной), чтобы создать серию изображений-в-видео, которые можно соединить в последовательность.

На текущем уровне развития эта подход не производит правдоподобных последующих кадров; и, в любом случае, мы уже отошли от авторской мечты, добавив слой сложности.

Мы также можем использовать Low Rank Adaptation (LoRA) модели, специально обученные на персонажах, вещах или окружающей среде, чтобы поддерживать лучшую последовательность между кадрами.

Однако, если персонаж хочет появиться в новом костюме, обычно необходимо обучить совершенно новую LoRA, которая воплощает персонажа, одетого в этот наряд (хотя подконцепции, такие как ‘красное платье’, можно обучить в отдельные LoRAs, вместе с подходящими изображениями, они не всегда легко работают с ними).

Это добавляет значительную сложность, даже к открывающей сцене в фильме, где человек встает с постели, надевает халат, зевает, смотрит в окно спальни и идет в ванную, чтобы почистить зубы.

Такая сцена, содержащая примерно 4-8 кадров, может быть снята за одно утро с помощью традиционных кинопроцессов; на текущем уровне развития генеративного ИИ это потенциально представляет собой недели работы, множество обученных LoRAs (или других вспомогательных систем) и значительное количество постобработки.

Альтернативно, можно использовать видео-в-видео, где обычные или CGI-кадры преобразуются через текст-подсказки в альтернативные интерпретации. Runway предлагает такую систему, например.

CGI (слева) из Blender, интерпретированный в текст-усиленном эксперименте Runway видео-в-видео Mathieu Visnjevec – Источник: https://www.linkedin.com/posts/genz-tunisia_digitalcreation-liveportrait-aianimation-activity-7240776811737972736-uxiB/?

Здесь есть две проблемы: вы уже должны создать основные кадры, поэтому вы уже делаете фильм дважды, даже если вы используете синтетическую систему, такую как UnReal’s MetaHuman.

Если вы создаете CGI-модели (как в вышеуказанном клипе) и используете их в видео-изображении-преобразовании, их последовательность между кадрами не может быть надежной.

Это связано с тем, что видеодиффузионные модели не видят ‘большой картины’ – скорее, они создают новый кадр на основе предыдущего кадра/кадров и, в некоторых случаях, учитывают ближайший будущий кадр; но, чтобы сравнить процесс с шахматной игрой, они не могут думать ‘десять ходов вперед’, и не могут помнить десять ходов назад.

Во-вторых, диффузионная модель все равно будет бороться за поддержание последовательного вида между кадрами, даже если вы включите множество LoRAs для персонажа, окружающей среды и стиля освещения, по причинам, упомянутым в начале этого раздела.

Исправление в постпродакшене

Есть другие недостатки чистой ‘одиночной пользовательской’ генерации видео ИИ, такие как трудность они испытывают в изображении быстрых движений и общая, гораздо более серьезная проблема получения временной последовательности в выходном видео.

Кроме того, создание конкретных лицевых выступлений практически является делом случая в генеративном видео, как и синхронизация губ для диалога.

В обоих случаях использование вспомогательных систем, таких как LivePortrait и AnimateDiff, становится очень популярным в сообществе VFX, поскольку это позволяет перенести, по крайней мере, широкие лицевые выражения и синхронизацию губ в существующий генерируемый вывод.

Пример передачи выражения (ведущий видео в нижнем левом углу) наложенного на целевое видео с LivePortrait. Видео от Generative Z TunisiaGenerative. См. полную версию в лучшем качестве на https://www.linkedin.com/posts/genz-tunisia_digitalcreation-liveportrait-aianimation-activity-7240776811737972736-uxiB/?

Дальнейшее множество сложных решений, включающих инструменты, такие как Stable Diffusion GUI ComfyUI и профессиональное композитное и манипулятивное приложение Nuke, а также манипуляция латентным пространством, позволяют практикам ИИ-VFX получить больший контроль над лицевыми выражениями и расположением.

Хотя он описывает процесс лицевой анимации в ComfyUI как ‘пытку’, профессионал VFX Francisco Contreras разработал такую процедуру, которая позволяет наложить фонемы губ и другие аспекты лицевого/головного изображения.

Stable Diffusion, с помощью рабочего процесса ComfyUI, усиленного Nuke, позволил профессионалу VFX Francisco Contreras получить необычный контроль над лицевыми аспектами. Для полного видео, в лучшем разрешении, перейдите по ссылке https://www.linkedin.com/feed/update/urn:li:activity:7243056650012495872/

Заключение

Ничто из этого не обещает перспективы генерации связных и фотореалистичных блокбастерских полнометражных фильмов одним пользователем, с реалистичным диалогом, синхронизацией губ, выступлениями, окружающей средой и последовательностью.

Кроме того, препятствия, описанные здесь, по крайней мере, в отношении диффузионных генеративных видеомоделей, не обязательно решаемы ‘в любой момент’ сейчас, несмотря на комментарии на форумах и внимание СМИ, которые утверждают обратное. Ограничения, описанные здесь, кажутся внутренними для архитектуры.

В исследованиях ИИ-синтеза, как и в любых научных исследованиях, блестящие идеи периодически поражают нас своим потенциалом, только чтобы дальнейшие исследования раскрыли их фундаментальные ограничения.

В области генеративного/синтетического пространства это уже произошло с генеративными противостоящими сетями (GANs) и нейронными радиационными полями (NeRF), которые в конечном итоге оказались очень трудными для инструментализации в коммерческие системы, несмотря на годы академических исследований в этом направлении. Эти технологии теперь появляются чаще всего как вспомогательные компоненты в альтернативных архитектурах.

Так же, как киностудии могут надеяться, что обучение на лицензированных каталогах фильмов может устранить художников VFX, ИИ на самом деле добавляет роли в рабочую силу на данный момент.

Независимо от того, могут ли диффузионные видеосистемы действительно быть преобразованы в повествовательно-последовательные и фотореалистичные генераторы фильмов или же все это просто еще одно алхимическое преследование, должно стать очевидным в течение следующих 12 месяцев.

Возможно, нам нужен совершенно новый подход; или, возможно, Gaussian Splatting (GSplat), который был разработан в начале 1990-х годов и недавно приобрел популярность в области синтеза изображений, представляет собой потенциальную альтернативу диффузионной видеогенерации.

Поскольку GSplat потребовалось 34 года, чтобы стать заметным, возможно, что более старые претенденты, такие как NeRF и GANs – и даже латентные диффузионные модели – еще не имели своего дня.

* Хотя функция AI Storyboard от Kaiber предлагает такую функциональность, результаты, которые я видел, не являются производственными качествами.

Мартин Андерсон – бывший руководитель научно-исследовательского контента в metaphysic.ai

Опубликовано в понедельник, 23 сентября 2024 года