Взгляд Anderson

Добавление диалога к реальному видео с помощью ИИ

Новая框架 ИИ может переписать, удалить или добавить слова человека в видео без пересъёмки, в единой системе от начала до конца.

Три года назад интернет был бы поражён любым из 20-30框架 ИИ для изменения видео, которые публикуются в академических порталах каждую неделю; но поскольку эта популярная ветвь исследований теперь стала настолько плодотворной, что почти образует отдельную ветвь ‘ИИ-мусора’, и я освещаю гораздо меньше таких выпусков, чем два или три года назад.

Однако один из текущих выпусков в этой линии привлёк моё внимание: интегрированная система, которая может вмешаться в реальные видеоклипы и вставить новый диалог в существующий видео (а не создавать целый генеративный клип из лица или кадра, что гораздо более распространено).

В примерах ниже, которые я отредактировал вместе из множества образцов видео, доступных на сайте проекта project website, мы сначала видим реальный исходный клип, а затем, ниже, наложенный ИИ-диалог в середине клипа, включая синтез голоса и синхронизацию губ:

Нажмите, чтобы воспроизвести. Местная редакция со стежкой – один из нескольких режимов, предлагаемых FacEDiT. Пожалуйста, обратитесь к исходному сайту для лучшего разрешения. Источник – https://facedit.github.io/

Этот подход является одним из трёх, разработанных для нового метода, этот называется ‘местная редакция со стежкой’, и тот, который наиболее интересует авторов (а также меня). По сути, клип расширяется за счёт использования одного из средних кадров в качестве начальной точки для новой интерпретации ИИ, и его последующего (реального) кадра в качестве цели, к которой должна стремиться вставленная генеративная клип.

В клипах, видимых выше, эти ‘семенные’ и ‘целевые’ кадры представлены верхней видеопаузой, в то время как изменённый видео ниже обеспечивает генеративную заполнение.

Авторы формулируют этот подход синтеза лица и голоса как первый полностью интегрированный метод от начала до конца для редактирования видео ИИ такого рода, наблюдая потенциал полностью разработанной框架 такой как эта для телевизионного и кинопроизводства:

‘Кинематографисты и медиапродюсеры часто cần пересматривать определённые части записанных видео – может быть, слово было сказано неверно или сценарий изменился после съёмки. Например, в иконической сцене из Титаника (1997), где Роуз говорит, “Я никогда не отпущу тебя, Джек,” режиссёр может позже решить, что это должно быть “Я никогда не забуду тебя, Джек”.

‘Традиционно, такие изменения требуют пересъёмки всей сцены, что дорого и耗ает время. Синтез говорящего лица предлагает практическую альтернативу, автоматически изменяя движение лица, чтобы оно соответствовало пересмотренному диалогу, исключая необходимость в пересъёмке.’

Хотя ИИ-вставки такого рода могут столкнуться с культурным или промышленным сопротивлением, они также могут составлять новый тип функциональности в системах и наборах инструментов VFX, возглавляемых человеком. В любом случае, на данный момент, проблемы являются строго техническими.

Помимо расширения клипа за счёт дополнительного ИИ-генерированного диалога, новая система также может изменить существующий диалог:

Нажмите, чтобы воспроизвести. Пример изменения существующего диалога, а не вставки дополнительного диалога. Пожалуйста, обратитесь к исходному сайту для лучшего разрешения.

Состояние Искусства

На данный момент нет систем от начала до конца, которые предлагают такую возможность синтеза; хотя растущее число платформ ИИ, таких как серия Veo от Google, могут генерировать аудио, и различные другие框架 могут создавать deepfaked аудио, на данный момент необходимо создать довольно сложный конвейер различных архитектур и трюков, чтобы вмешаться в реальное видео таким образом, как новая система – озаглавленная FacEDiT – может сделать.

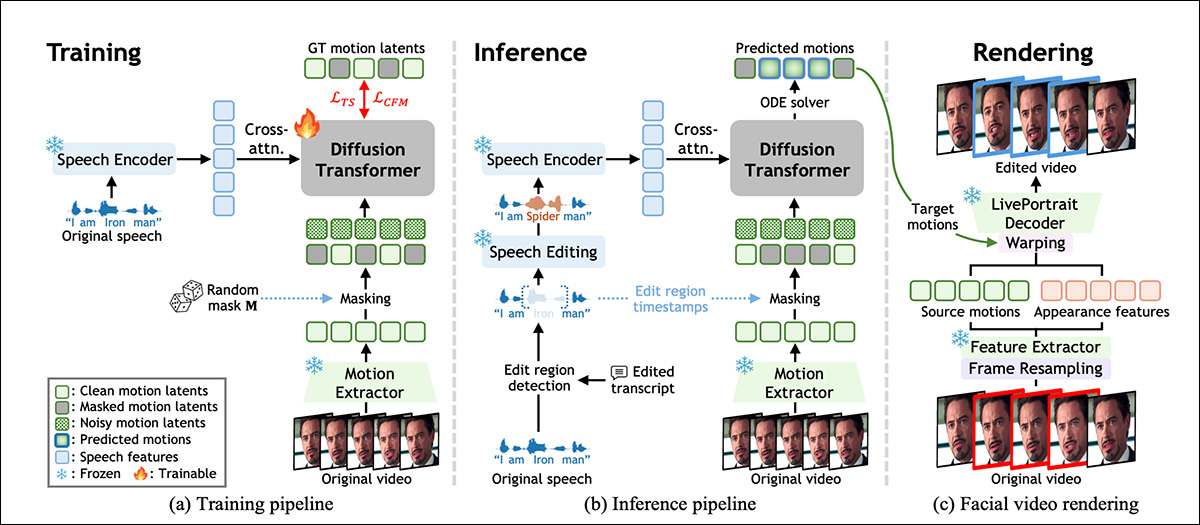

Система использует Diffusion Transformers (DiT) в сочетании с Flow Matching, чтобы создать движения лица, обусловленные окружающими (контекстными) движениями и аудио-контентом. Система использует существующие популярные пакеты, которые занимаются реконструкцией лица, включая LivePortrait (недавно приобретённый компанией Kling).

Помимо этого метода, учитывая, что их подход является первым, который интегрирует эти проблемы в единое решение, авторы создали новую базу данных, называемую FacEDiTBench, вместе с несколькими совершенно новыми метриками оценки, подходящими для этой конкретной задачи.

Новая работа озаглавлена FacEDiT: Unified Talking Face Editing and Generation via Facial Motion Infilling, и исходит от четырёх исследователей из Университета науки и технологий ПОСТЕХ (POSTECH), Института науки и технологий KAIST и Университета Техаса в Остине.

Метод

FacEDiT обучен реконструировать движение лица, изучая, как заполнить пропущенные части исходной игры актёра, на основе окружающего движения и аудио-контента. Как показано в схеме ниже, этот процесс позволяет модели действовать как заполнитель пробелов во время обучения, предсказывая движения лица, соответствующие голосу, и сохраняя последовательность с исходным видео:

Обзор системы FacEDiT, показывающий, как движение лица изучается через самообучение во время обучения, управляемое отредактированным диалогом во время вывода, и, наконец, отображаемое обратно в видео, повторно используя внешний вид исходного кадра, но заменяя только целевое движение. Источник

Во время вывода одна и та же архитектура поддерживает два различных вывода, в зависимости от того, сколько видео маскируется: частичные редакции, где изменяется только фраза и остальное остаётся нетронутым; или генерация полного предложения, где новое движение синтезируется полностью с нуля.

Модель обучается с помощью Flow Matching, который рассматривает видеоредактирование как своего рода путь между двумя версиями движения лица.

Вместо того, чтобы учиться угадывать, как должно выглядеть отредактированное лицо с нуля, Flow Matching учится плавно и гладко перемещаться между шумовой заглушкой и правильным движением. Чтобы облегчить это, система представляет движение лица как компактный набор чисел, извлечённых из каждого кадра с помощью версии вышеупомянутой системы LivePortrait (см. схему выше).

Эти векторы движения предназначены для описания выражений и положения головы без переплетения идентичности, так что изменения диалога могут быть локализованы без влияния на общий вид человека.

Обучение FacEDiT

Чтобы обучить FacEDiT, каждый видеоклип был разбит на ряд снимков движения лица, и каждый кадр был сопоставлен с соответствующим фрагментом аудио. Случайные части данных о движении затем были скрыты, и модель была попросена угадать, какими должны быть эти пропущенные движения, используя как речь, так и окружающее незамаскированное движение для контекста.

Поскольку маскированные диапазоны и их позиции варьируются от одного обучающего примера к другому, модель постепенно учится обрабатывать как небольшие внутренние редакции, так и более длинные пробелы, для генерации полной последовательности, в зависимости от того, сколько информации она получает.

Система Diffusion Transformer учится восстанавливать маскированное движение, уточняя шумовые входные данные со временем. Вместо того, чтобы подавать речь и движение в модель одновременно, аудио вводится в каждый блок обработки через кросс-аттенцию, что помогает системе более точно соответствовать движения губ аудио-речи.

Чтобы сохранить реализм на протяжении редактирования, внимание смещается в сторону соседних кадров, а не всего таймлайна, заставляя модель сосредоточиться на локальной непрерывности и предотвращая мерцания или скачки движения на границах изменённых областей. Встроенные позиционные вложения (которые сообщают модели, где каждый кадр появляется в последовательности)进一步 помогают модели сохранять естественный временной поток и контекст.

Во время обучения система учится предсказывать пропущенные движения лица, реконструируя маскированные диапазоны на основе речи и ближайшего незамаскированного движения. Во время вывода эта же настройка используется повторно, но с масками, теперь управляемыми редактированием речи.

Когда слово или фраза вставляется, удаляется или изменяется, система находит затронутый регион, маскирует его и регенерирует движение, соответствующее новому аудио. Генерация полной последовательности рассматривается как специальный случай, где весь регион маскируется и синтезируется с нуля.

Данные и Тесты

Основная структура системы состоит из 22 слоёв для Diffusion Transformer, каждый из которых имеет 16 головок внимания и размеры кормления 1024 и 2024px. Особенности движения и внешнего вида извлекаются с помощью замороженных компонентов LivePortrait, а речь кодируется с помощью WavLM и изменяется с помощью VoiceCraft.

Специальный слой проекции отображает 786-мерные особенности речи в латентное пространство DiT, при этом только DiT и модуль проекции обучаются с нуля.

Обучение проводилось под оптимизатором AdamW с целевой скоростью обучения 1e‑4, в течение миллиона шагов, на двух GPU A6000 (каждый с 48GB видеопамяти), при общем батч-размере восьми.

FacEDiTBench

Датасет FacEDiTBench содержит 250 примеров, каждый из которых имеет видеоклип исходной и отредактированной речи, а также транскрипты для обоих. Видео взяты из трёх источников, с 100 клипами из HDTF, 100 из Hallo3, и 50 из CelebV-Dub. Каждый был вручную проверен, чтобы подтвердить, что и аудио, и видео были достаточно чёткими для оценки.

GPT‑4o был использован для пересмотра каждого транскрипта, чтобы создать грамматически правильные редакции. Эти пересмотренные транскрипты, вместе с исходной речью, были переданы в VoiceCraft, чтобы произвести новый аудио; и на каждом этапе как транскрипт, так и сгенерированная речь были вручную проверены на качество.

Каждый образец был помечен типом редакции, временем изменения и длиной изменённого диапазона, и редакции были классифицированы как вставки, удаления или замены. Количество изменённых слов варьировалось от коротких редакций по 1-3 слова, средних редакций по 4-6 слов и более длинных редакций по 7-10 слов.

Три пользовательских метрики были определены для оценки качества редактирования. Фотометрическая непрерывность, чтобы измерить, насколько хорошо освещение и цвет отредактированного сегмента смешиваются с окружающим видео, сравнивая различия на пиксельном уровне на границах; непрерывность движения, чтобы оценить последовательность движения лица, измеряя изменения оптического потока через отредактированные и неотредактированные кадры; и сохранение идентичности, чтобы оценить, остаётся ли внешний вид субъекта последовательным после редактирования, сравнивая вложения лица из исходной и сгенерированной последовательности с помощью модели распознавания лица ArcFace.

Тесты

Модель тестирования была обучена на материалах из трёх вышеупомянутых наборов данных, в общей сложности около 200 часов видеоконтента, включая блоги и фильмы, а также высококачественные видео с YouTube.

Чтобы оценить редактирование говорящего лица, был использован FacEDiTBench, в дополнение к тестовому набору HDTF, который стал стандартом для этой серии задач.

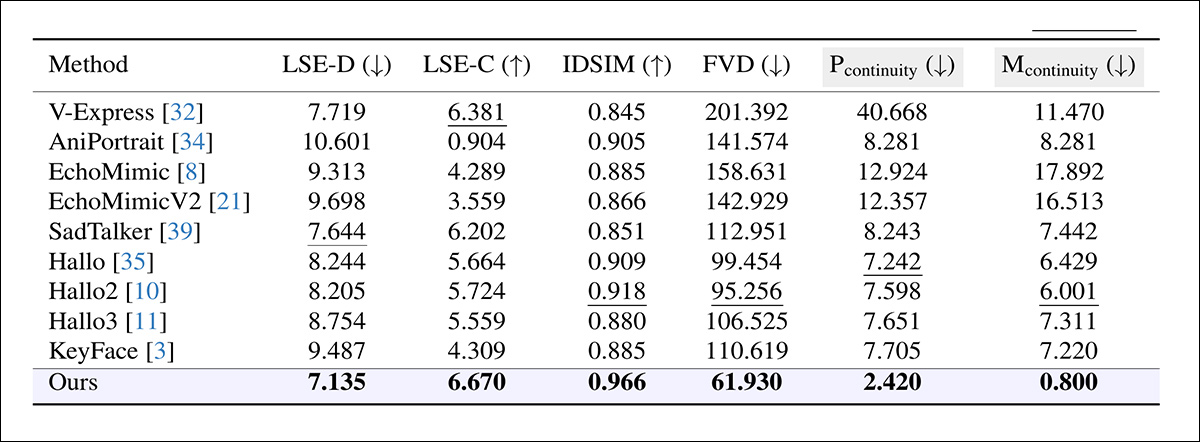

Поскольку не было напрямую сравнимых систем, способных охватить такую функциональность от начала до конца, авторы выбрали ряд框架, которые воспроизводили хотя бы часть целевой функциональности и могли действовать как базовые линии; а именно, KeyFace; EchoMimic; EchoMimicV2; Hallo; Hallo2; Hallo3; V-Express; AniPortrait; и SadTalker.

Несколько установленных метрик также были использованы для оценки качества генерации и редактирования, с точностью синхронизации губ, оценённой через SyncNet, сообщающую как абсолютную ошибку между движениями губ и аудио (LSE-D), так и коэффициент уверенности (LSE-C); Fréchet Video Distance (FVD) количественно оценивает, насколько реалистично выглядит видео; и Learned Perceptual Similarity Metrics (LPIPS), измеряющие перцептивное сходство между сгенерированными и исходными кадрами.

Для редактирования все метрики, кроме LPIPS, применялись только к изменённому сегменту; для генерации вся видео оценивалась, с исключением непрерывности границ.

Каждая модель была вынуждена синтезировать соответствующий видеосегмент, который затем был вставлен в исходный клип (исследователи отмечают, что этот метод часто вводил видимые разрывы, где отредактированный сегмент встречался с окружающим видео). Был протестирован также второй подход, при котором вся видео регенерировалась из изменённого аудио – но это неизбежно перезаписывало неотредактированные регионы и не сохраняло исходную игру:

Сравнение производительности редактирования по системам, изначально разработанным для генерации говорящего лица, с FacEDiT, превосходящим все базовые линии по всем метрикам, достигая более низкой ошибки синхронизации губ (LSE-D), более высокой уверенности синхронизации (LSE-C), более сильного сохранения идентичности (IDSIM), более высокой реалистичности (FVD) и более плавных переходов через границы редактирования (Pcontinuity, Mcontinuity). Серые столбцы подчеркивают ключевые критерии для оценки качества границ; жирные и подчёркнутые значения указывают на лучшие и вторые результаты соответственно

Относительно этих результатов, авторы комментируют:

‘[Наша] модель значительно превосходит существующие методы на задаче редактирования. Она достигает сильной непрерывности границ и высокой сохранности идентичности, демонстрируя свою способность сохранять временную и визуальную последовательность во время редактирования. Кроме того, её превосходная точность синхронизации губ и низкий FVD отражают реализм синтезированного видео.’

Нажмите, чтобы воспроизвести. Результаты, собранные этим автором из опубликованных видео на сайте проекта. Пожалуйста, обратитесь к исходному сайту для лучшего разрешения.

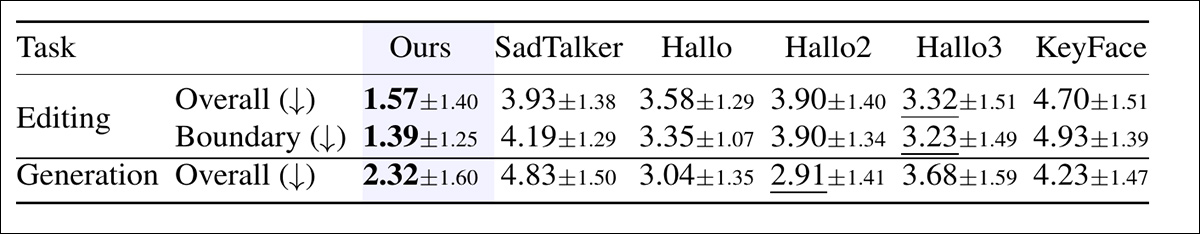

Было также проведено исследование с участием человека, чтобы оценить воспринимаемое качество как редактирования, так и генерации.

Для каждого сравнения участники просматривали шесть видео и ранжировали их по общему качеству, учитывая точность синхронизации губ, естественность и реализм движения головы. В испытаниях редактирования участники также оценивали гладкость переходов между отредактированными и неотредактированными сегментами:

Средние ранги, назначенные оценщиками человека, где более низкий означает лучший. В обоих редактировании и генерации участники оценивали, насколько естественно и хорошо синхронизировано каждое видео выглядит. Для редактирования они также оценивали, насколько гладким был переход между отредактированным и неотредактированным диалогом. Жирные и подчёркнутые числа указывают на лучшие два результата.

В исследовании FacEDiT последовательно занимал первое место с значительным отрывом как в качестве редактирования, так и в гладкости переходов, также получая высокие оценки в генерации.

Из-за нехватки места мы направляем читателя к исходной статье для дальнейших деталей об анализах и дополнительных тестах, которые были проведены и сообщены в новой работе. На самом деле, прототипические исследовательские предложения такого рода борются за генерирование осмысленных разделов тестирования, поскольку само ядро предложения является потенциальной базовой линией для последующей работы.

Заключение

Даже для вывода системы такого рода могут потребоваться значительные вычислительные ресурсы, что делает трудным для пользователей – здесь, предположительно, студий VFX – сохранять работу на месте. Поэтому подходы, которые могут быть адаптированы к реалистичным локальным ресурсам, всегда будут предпочитаемы поставщиками, которые находятся под юридическим обязательством защищать клиентские кадры и общую интеллектуальную собственность.

Это не означает критику нового предложения, которое может работать идеально под квантовыми весами или другими оптимизациями, и которое является первым предложением такого рода, привлекшим меня обратно к этому направлению исследований за довольно долгое время.

Опубликовано впервые в среду, 17 декабря 2022 года. Отредактировано 20:10 EET, в тот же день, для добавления пробела в первый абзац.